title: "Meta Llama 4 登場:Scout 與 Maverick 原生多模態 MoE 架構深度解析"

description: "Meta 正式發布 Llama 4 模型家族,包括 Scout 與 Maverick。本文深入解讀這兩款原生多模態 MoE 模型,探討其 1000 萬 token 上下文窗口與超越 GPT-4o 的性能表現。"

作者注:Meta 發布 Llama 4 Scout 和 Maverick,採用原生多模態 MoE 架構,Scout 擁有 1000 萬 token 上下文窗口,Maverick 綜合評測超越 GPT-4o,本文深度解讀技術細節和開發者影響。

Meta 正式發布 Llama 4 模型家族,首批原生多模態 MoE 開源模型 Llama 4 Scout 和 Maverick 引發 AI 社群廣泛關注。本文快速解讀這一里程碑事件對 AI 開發者和整個行業的深遠影響。

核心價值: 3 分鐘了解 Llama 4 Scout 與 Maverick 的核心技術突破、評測表現和實際應用價值。

Llama 4 Scout 與 Maverick 核心資訊速覽

| 項目 | Llama 4 Scout | Llama 4 Maverick |

|---|---|---|

| 發布時間 | 2025 年 4 月 5 日 | 2025 年 4 月 5 日 |

| 架構類型 | 原生多模態 MoE | 原生多模態 MoE |

| 活躍參數 | 170 億 | 170 億 |

| 專家數量 | 16 個 | 128 個 |

| 總參數量 | 1090 億 | 4000 億 |

| 上下文窗口 | 1000 萬 token | 100 萬 token |

| 開源協議 | Llama 許可證 | Llama 許可證 |

Llama 4 Scout 與 Maverick 關鍵定位

Llama 4 是 Meta 推出的第四代大規模語言模型家族,也是 Llama 系列首次採用 原生多模態 和 混合專家(MoE) 架構的版本。與先前的 Llama 3 系列相比,Llama 4 在架構層面進行了根本性的重構。

Scout 定位為高效長文本處理模型,以極低的推理成本提供業界最長的 1000 萬 token 上下文窗口。Maverick 則定位為高性能通用模型,透過 128 個專家網路實現了超越 GPT-4o 的綜合能力。

兩款模型均已開放權重下載,開發者可透過 llama.com 和 Hugging Face 獲取。

Llama 4 Scout と Maverick の技術アーキテクチャ解説

ネイティブ・マルチモーダル Early Fusion アーキテクチャ

Llama 4 の最大のアーキテクチャ上の革新は、ネイティブ・マルチモーダル学習にあります。これまでの「ビジュアルモジュールを言語モデルの後段に接続する」手法とは異なり、Llama 4 は事前学習段階から Early Fusion(早期融合)スキームを採用し、テキストと視覚トークンを統一してモデルのバックボーンネットワークに入力します。

これは、Llama 4 が画像とテキストが混在するコンテンツを理解する際、「画像を見てから言葉にする」という二段階処理ではなく、画像とテキストを一体化した入力として真に理解・推論できることを意味します。

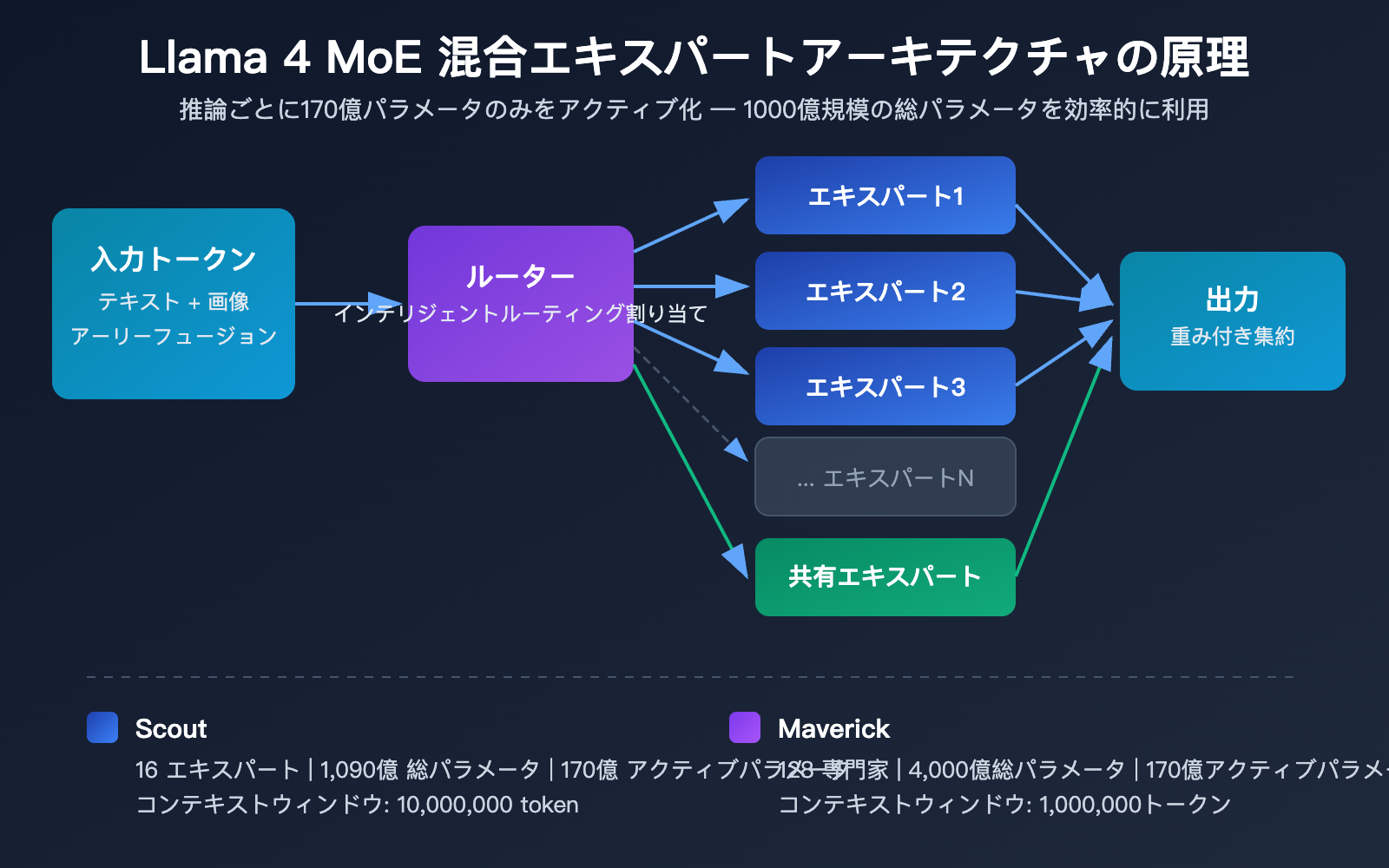

Llama 4 MoE(混合エキスパート)メカニズム

| 技術詳細 | Scout (16 エキスパート) | Maverick (128 エキスパート) |

|---|---|---|

| 総パラメータ数 | 1,090億 | 4,000億 |

| 推論時アクティブ数 | 170億パラメータ | 170億パラメータ |

| ルーティングエキスパート数 | 16個 + 共有エキスパート | 128個 + 共有エキスパート |

| 推論効率 | NVIDIA H100 1枚で動作 (INT4) | NVIDIA H100 DGX 1台で動作 |

| コンテキストアーキテクチャ | iRoPE (位置エンコーディング交差なしのアテンション) | 標準アテンション |

MoE アーキテクチャの核心的な利点は、総パラメータ数がそれぞれ 1,090億、4,000億と膨大であるにもかかわらず、推論時には毎回 170億パラメータのみがアクティブになる点です。これにより、Llama 4 Scout は NVIDIA H100 GPU 1枚で INT4 量子化を実行でき、導入のハードルを大幅に下げています。

Llama 4 の学習データと規模

Llama 4 の学習データ規模は 30兆トークン以上 に達し、Llama 3 の 2 倍となりました。多言語データ量は Llama 3 の 10 倍で、200 言語をカバーしています。学習には FP8 精度を採用し、Behemoth モデルにおいて GPU あたり 390 TFLOPs という学習効率を実現しました。

Llama 4 Scout と Maverick の評価パフォーマンス

Llama 4 Maverick の評価データ

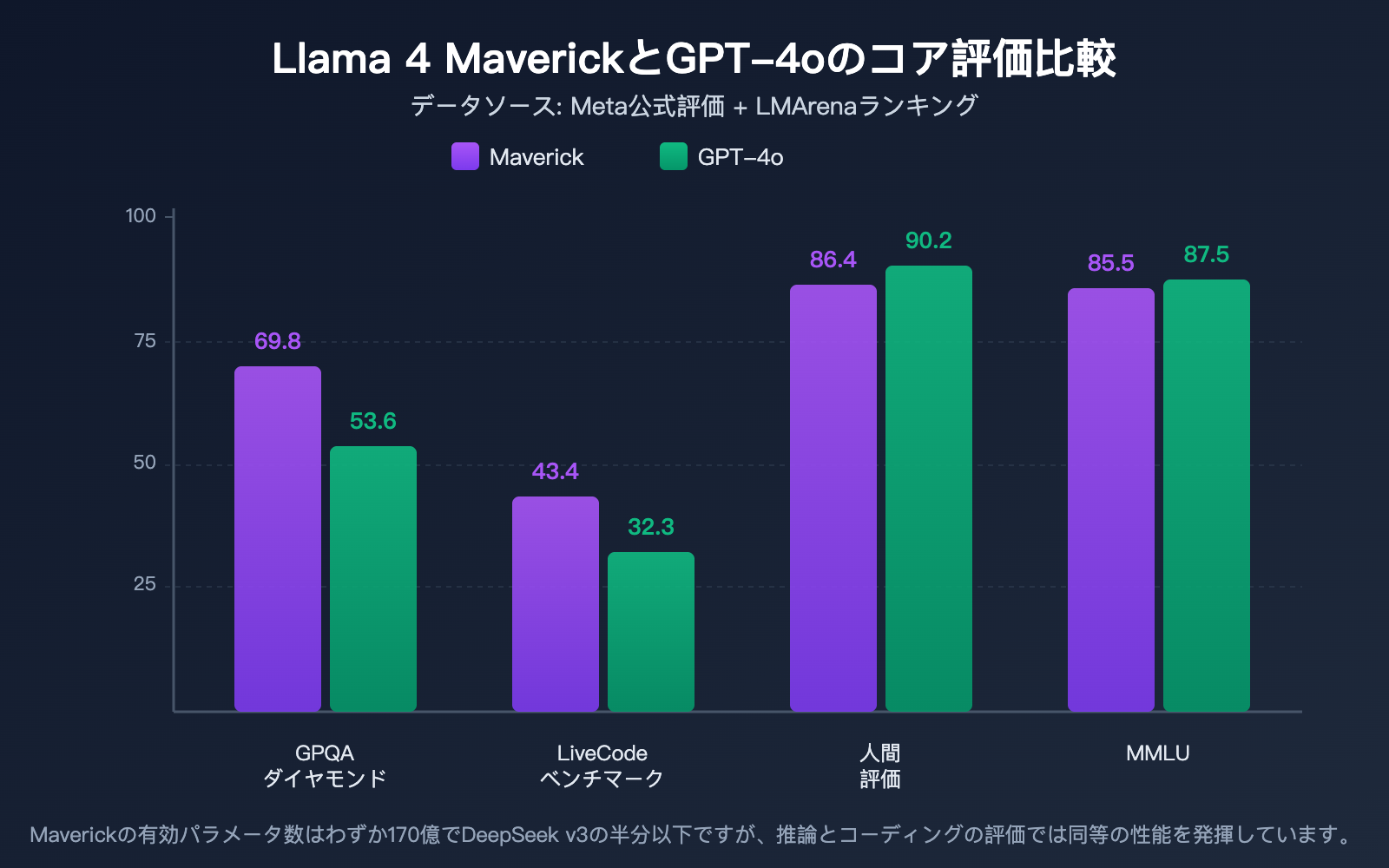

Maverick は複数の権威ある評価指標で優れた成績を収めており、総合能力において GPT-4o や Gemini 2.0 Flash を上回っています。

| 評価ベンチマーク | Llama 4 Maverick | GPT-4o | Gemini 2.0 Flash | 評価 |

|---|---|---|---|---|

| MMLU | 85.5 | ~87-88 | – | トップレベルに肉薄 |

| GPQA Diamond | 69.8 | 53.6 | – | 大幅リード |

| LiveCodeBench | 43.4 | 32.3 | – | 顕著なリード |

| HumanEval | 86.4% | 90.2% | – | 同等レベル |

| LMArena ELO | 1417 | 1417未満 | 1417未満 | トップクラス |

注目すべきポイント:

GPQA Diamond 科学推論でリード: Maverick は GPQA Diamond で 69.8 点を記録し、GPT-4o の 53.6 点を 16 ポイント以上上回り、強力な専門分野の推論能力を示しました。

LiveCodeBench コーディング能力: リアルタイムプログラミング評価である LiveCodeBench において、Maverick は 43.4 点で GPT-4o の 32.3 点をリードしました。また、推論およびコーディングタスクにおいて DeepSeek v3 と同等の性能を示しましたが、Maverick のアクティブパラメータ数は DeepSeek v3 の半分以下です。

LMArena 人間による評価でトップクラス: Maverick の実験バージョンは LMArena(Chatbot Arena)で 1417 ELO スコアを獲得し、世界トップクラスのモデルの仲間入りを果たしました。

Llama 4 Scout の評価ハイライト

Scout はアクティブパラメータ数がわずか 170 億の「小型」モデルですが、そのパフォーマンスは非常に印象的です:

- 幅広い評価ベンチマークで Gemma 3、Gemini 2.0 Flash-Lite、Mistral 3.1 を上回る

- パラメータ数の多い Llama 3.3 70B を含む、前世代のすべての Llama 3 モデルを凌駕

- 業界最長クラスの 1,000 万トークンのコンテキストウィンドウ を持ち、約 750 万文字のテキストを処理可能

- NVIDIA H100 GPU 1枚で動作し、推論コストが極めて低い

🎯 開発者へのアドバイス: Llama 4 Scout と Maverick は、どちらも OpenAI 互換インターフェース呼び出しをサポートしています。これらのモデルの実際の効果を素早くテストしたい場合は、APIYI (apiyi.com) プラットフォームから統合 API インターフェースを取得してください。1 つのキーで、複数のオープンソースおよびクローズドソースモデルを切り替えて呼び出すことができます。

Llama 4 Scout と Maverick が開発者に与える影響

1,000万トークンのコンテキストウィンドウの応用価値

Scoutの1,000万トークンというコンテキストウィンドウは、現在公開されているモデルの中で最も長く、この能力は開発者に全く新しいアプリケーションの可能性を切り拓いています。

- コードベース全体の分析: 中規模から大規模なプロジェクトのコード全体を一度にモデルに入力して分析可能

- 長文ドキュメント処理: 数百ページに及ぶ技術文書、法的契約書、研究論文を一度に処理

- 長期間の対話記憶: 対話型アプリケーションにおいて、極めて長いコンテキストの記憶を保持

- 大規模データ抽出: 膨大な非構造化テキストから構造化情報をバッチ処理で抽出

Llama 4 がオープンソースエコシステムに与える影響

| 影響の側面 | 具体的な変化 | 開発者のメリット |

|---|---|---|

| デプロイのハードル | ScoutはシングルGPUで動作可能 | ハードウェアコストの削減 |

| モデル能力 | GPT-4oクラスを凌駕 | オープンソースがクローズドソースに追随 |

| マルチモーダル | ネイティブな画像・テキスト理解 | 追加の視覚モジュールが不要 |

| コンテキスト | 1,000万トークン | 全く新しい応用シナリオ |

| カスタマイズ | 重みの微調整(ファインチューニング)が可能 | 垂直市場向けに最適化 |

Llama 4のリリースは、オープンソースモデルが総合能力において初めて主流のクローズドソース商用モデルに完全に追いつき、あるいは追い越したことを意味します。開発者にとって、これは以下のことを意味します。

コスト面での優位性: Llama 4をベースにしたプライベートデプロイを行うことで、特に高頻度で呼び出しを行う本番環境において、API呼び出しコストを大幅に削減できます。

カスタマイズの自由度: 重みが公開されているため、開発者はLlama 4をベースに微調整、量子化、蒸留などの操作を行い、特定の垂直市場向けに専用モデルを構築できます。

エコシステムの繁栄: Llama 4はリリース初日から、AWS、Google Cloud、Azure、Together.ai、Groq、Fireworksなど、多くのクラウドプラットフォームからサポートを受けています。

Llama 4 のプラットフォーム統合

MetaはLlama 4を自社のソーシャルプラットフォームに統合し、Meta AIアシスタントにマルチモーダル機能を提供しています。

- WhatsApp: 画像を送信してAIによる分析や対話が可能

- Messenger: マルチモーダルなインタラクティブQ&A

- Instagram Direct: 画像理解とクリエイティブ支援

- Meta.ai: ウェブブラウザから直接利用可能

AI大規模言語モデルがこれほど大規模に、数十億人のユーザーを対象として直接消費者向けにデプロイされるのは今回が初めてです。

Llama 4 Behemoth: 現在トレーニング中のフラッグシップモデル

ScoutとMaverickに加え、MetaはLlama 4ファミリーのフラッグシップモデルである Behemoth についても予告しています。

| パラメータ | Behemoth スペック |

|---|---|

| アクティブパラメータ | 2,880億 |

| エキスパート数 | 16個 |

| 総パラメータ数 | 約2兆 |

| トレーニング状況 | 進行中 |

Metaが公開した初期のチェックポイントデータによると、Behemothは複数のSTEM評価において、GPT-4.5、Claude Sonnet 3.7、Gemini 2.0 Proをすでに上回っています。Maverickはトレーニング過程で知識蒸留を通じてBehemothから能力を継承しており、これがMaverickが比較的小さなアクティブパラメータ数でトップクラスの性能を実現している理由です。

💡 アドバイス: Behemothの最終リリースは、オープンソースモデルの能力上限をさらに押し上げるでしょう。開発者の皆さんは、現段階ではScoutとMaverickをベースにアプリケーションを構築し、APIYI (apiyi.com) プラットフォーム上で複数のモデルを比較テストしながら、Behemothのリリースを待ってシームレスに切り替えることをお勧めします。

Llama 4 Scout および Maverick のクイックアクセス

超シンプルな API 呼び出し例

OpenAI 互換インターフェースを使用すれば、わずか 10 行のコードで Llama 4 モデルを呼び出すことができます:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{"role": "user", "content": "MoEアーキテクチャの仕組みを説明してください"}]

)

print(response.choices[0].message.content)

マルチモーダル呼び出しの例を見る

import openai

import base64

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# ローカル画像を読み込んでエンコード

with open("image.jpg", "rb") as f:

image_data = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "この画像の内容を説明してください"},

{"type": "image_url", "image_url": {

"url": f"data:image/jpeg;base64,{image_data}"

}}

]

}]

)

print(response.choices[0].message.content)

🚀 クイックスタート: APIYI (apiyi.com) で APIキーを取得し、無料のテストクレジットを活用することをお勧めします。当プラットフォームは Llama 4 Scout、Maverick およびその他の主要モデルの統一インターフェース呼び出しをサポートしており、異なるモデルのパフォーマンスを素早く比較できます。

よくある質問

Q1: Llama 4 Scout と Maverick のどちらを選ぶべきですか?

超長文テキスト(完全なコードベースや長いドキュメントの分析など)を扱う必要がある場合は、Scout(1,000万トークンのコンテキストウィンドウ)を選択してください。総合的な能力が最も高い汎用モデルが必要な場合は、Maverick(128の専門家モデル、GPT-4oを上回る評価)が適しています。どちらも APIYI (apiyi.com) プラットフォームで実際の効果をテストできるため、最適な選択をサポートします。

Q2: Llama 4 は完全に無料ですか?

Llama 4 は Llama ライセンスに基づき重みが公開されており、商用利用が可能です。ただし、月間アクティブユーザー数が7億人を超える企業は、Meta に特別な許可を申請する必要があります。大多数の開発者や企業にとっては無料で利用可能です。自身でのデプロイが難しい場合は、APIYI (apiyi.com) などのサードパーティプラットフォームを通じて、API経由で必要な分だけ呼び出すことも可能です。

Q3: Llama 4 Maverick は本当に GPT-4o より優れていますか?

GPQA Diamond(科学的推論)や LiveCodeBench(リアルタイムプログラミング)などの主要な評価指標において、Maverick は GPT-4o を明確にリードしています。MMLU や HumanEval では両者は接戦です。LMArena の人間による評価でも、Maverick はトップクラスの ELO スコアに達しています。全体として、Maverick は総合評価において GPT-4o と同等のティアにあり、一部の指標ではそれを上回っています。

まとめ

Llama 4 Scout と Maverick の核心ポイント:

- アーキテクチャの革新: 初のネイティブ・マルチモーダル MoE オープンソースモデルであり、Early Fusion アーキテクチャにより真のテキスト・画像統合理解を実現。

- 性能の飛躍: Maverick は GPQA Diamond において GPT-4o を 16 ポイント以上リードし、Scout は 170 億の有効パラメータで Llama 3.3 70B を凌駕。

- アプリケーションの変革: 1,000 万トークンのコンテキストウィンドウとオープンなウェイトにより、開発者に全く新しいアプリケーションシナリオとデプロイの可能性を提供。

Llama 4 のリリースは、オープンソースの大規模言語モデルが新たな時代に突入したことを示しています。エンタープライズレベルのアプリケーション構築であれ、個人プロジェクトであれ、開発者は Llama 4 を活用することで、トップクラスのクローズドモデルに匹敵する能力を手に入れることができます。APIYI (apiyi.com) を通じて Llama 4 シリーズを素早く体験することをお勧めします。プラットフォームでは無料枠と統一されたマルチモデル API を提供しており、開発者の効率的なモデル選定をサポートします。

📚 参考資料

-

Meta AI 公式ブログ – Llama 4 リリース告知: モデルの技術詳細と評価データの権威あるソース

- リンク:

ai.meta.com/blog/llama-4-multimodal-intelligence - 説明: アーキテクチャの紹介、評価データ、リリースの詳細を網羅

- リンク:

-

Llama 公式サイト – モデルダウンロード: Llama 4 モデルのウェイトとドキュメントの入手先

- リンク:

llama.com/models/llama-4 - 説明: モデルのダウンロード、ライセンス情報、技術ドキュメントを提供

- リンク:

-

Hugging Face – Llama 4 モデルライブラリ: オープンソースコミュニティによるホスティングと利用ガイド

- リンク:

huggingface.co/meta-llama - 説明: モデルカード、量子化バージョン、コミュニティでの議論を提供

- リンク:

著者: APIYI 技術チーム

技術交流: Llama 4 の使用感についてコメント欄でぜひお聞かせください。AI モデルの接続に関する詳細資料は、APIYI ドキュメントセンター (docs.apiyi.com) をご覧ください。