作者注:Meta 发布 Llama 4 Scout 和 Maverick,采用原生多模态 MoE 架构,Scout 拥有 1000 万 token 上下文窗口,Maverick 综合评测超越 GPT-4o,本文深度解读技术细节和开发者影响

Meta 正式发布 Llama 4 模型家族,首批原生多模态 MoE 开源模型 Llama 4 Scout 和 Maverick 引发 AI 社区广泛关注。本文快速解读这一里程碑事件对 AI 开发者和整个行业的深远影响。

核心价值: 3 分钟了解 Llama 4 Scout 与 Maverick 的核心技术突破、评测表现和实际应用价值。

Llama 4 Scout 与 Maverick 核心信息速览

| 信息项 | Llama 4 Scout | Llama 4 Maverick |

|---|---|---|

| 发布时间 | 2025 年 4 月 5 日 | 2025 年 4 月 5 日 |

| 架构类型 | 原生多模态 MoE | 原生多模态 MoE |

| 活跃参数 | 170 亿 | 170 亿 |

| 专家数量 | 16 个 | 128 个 |

| 总参数量 | 1090 亿 | 4000 亿 |

| 上下文窗口 | 1000 万 token | 100 万 token |

| 开源协议 | Llama 许可证 | Llama 许可证 |

Llama 4 Scout 与 Maverick 关键定位

Llama 4 是 Meta 推出的第四代大语言模型家族,也是 Llama 系列首次采用 原生多模态 和 混合专家(MoE) 架构的版本。与此前 Llama 3 系列相比,Llama 4 在架构层面进行了根本性重构。

Scout 定位为高效长文本处理模型,以极低的推理成本提供业界最长的 1000 万 token 上下文窗口。Maverick 则定位为高性能通用模型,通过 128 个专家网络实现了超越 GPT-4o 的综合能力。

两款模型均已开放权重下载,开发者可通过 llama.com 和 Hugging Face 获取。

Llama 4 Scout 与 Maverick 技术架构解析

原生多模态 Early Fusion 架构

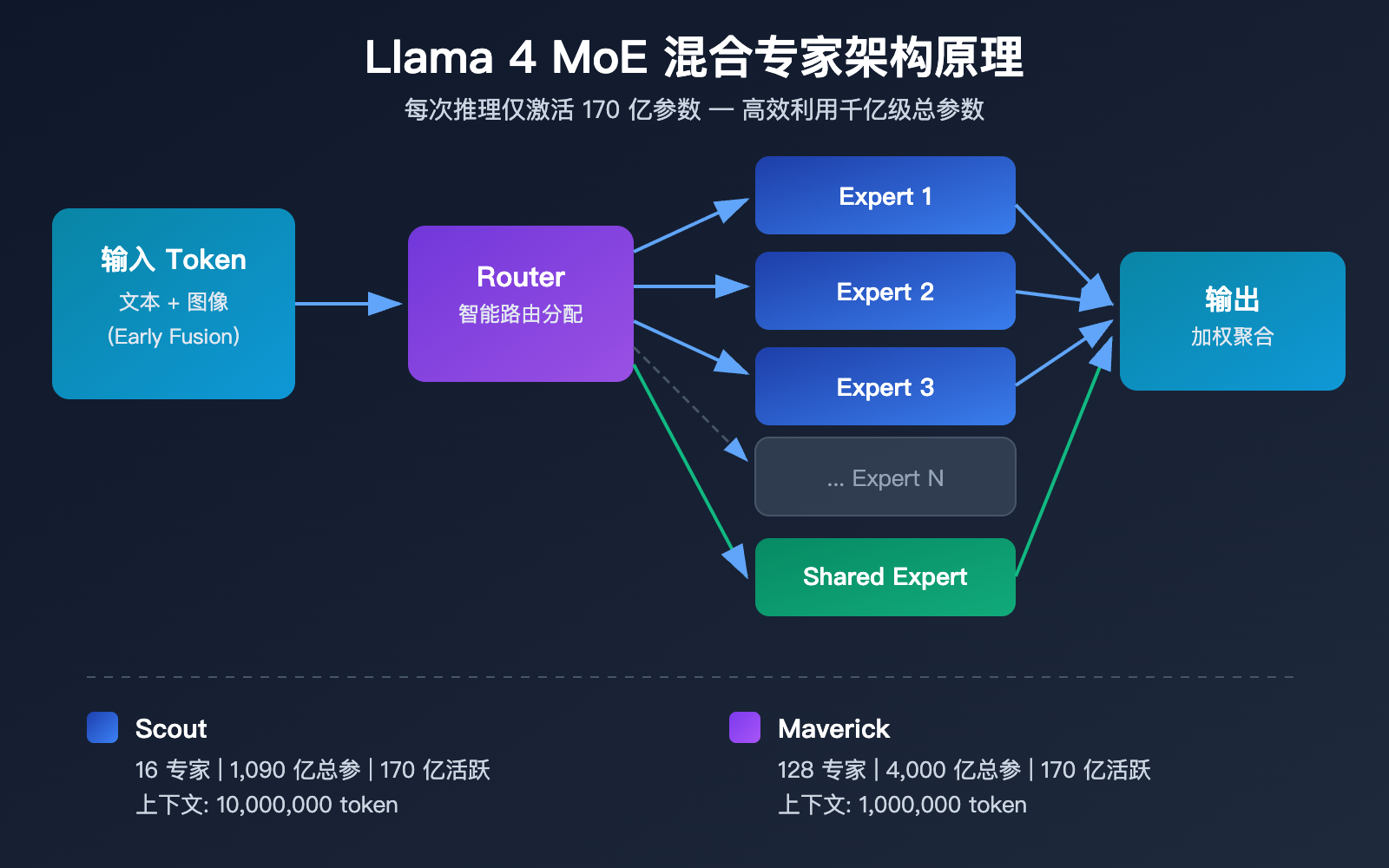

Llama 4 最大的架构创新在于 原生多模态训练。不同于此前将视觉模块后期接入语言模型的做法,Llama 4 从预训练阶段就采用 Early Fusion(早期融合)方案,将文本和视觉 token 统一接入模型主干网络。

这意味着 Llama 4 在理解图文混合内容时,不再是"先看图再说话"的两阶段处理,而是真正将图像和文本作为一体化输入进行理解和推理。

Llama 4 MoE 混合专家机制

| 技术细节 | Scout (16 专家) | Maverick (128 专家) |

|---|---|---|

| 总参数量 | 1090 亿 | 4000 亿 |

| 每次推理激活 | 170 亿参数 | 170 亿参数 |

| 路由专家数 | 16 个 + 共享专家 | 128 个 + 共享专家 |

| 推理效率 | 单张 H100 可运行 (INT4) | 单台 H100 DGX 可运行 |

| 上下文架构 | iRoPE (无位置编码交错注意力) | 标准注意力 |

MoE 架构的核心优势在于:虽然总参数量分别高达 1090 亿和 4000 亿,但每次推理时仅激活 170 亿参数。这让 Llama 4 Scout 可以在单张 NVIDIA H100 GPU 上以 INT4 量化方式运行,大幅降低了部署门槛。

Llama 4 训练数据与规模

Llama 4 的训练数据规模达到 30 万亿+ token,是 Llama 3 的 2 倍。多语言数据量更是 Llama 3 的 10 倍,覆盖 200 种语言。训练采用 FP8 精度,在 Behemoth 模型上实现了每 GPU 390 TFLOPs 的训练效率。

Llama 4 Scout 与 Maverick 评测表现

Llama 4 Maverick 评测数据

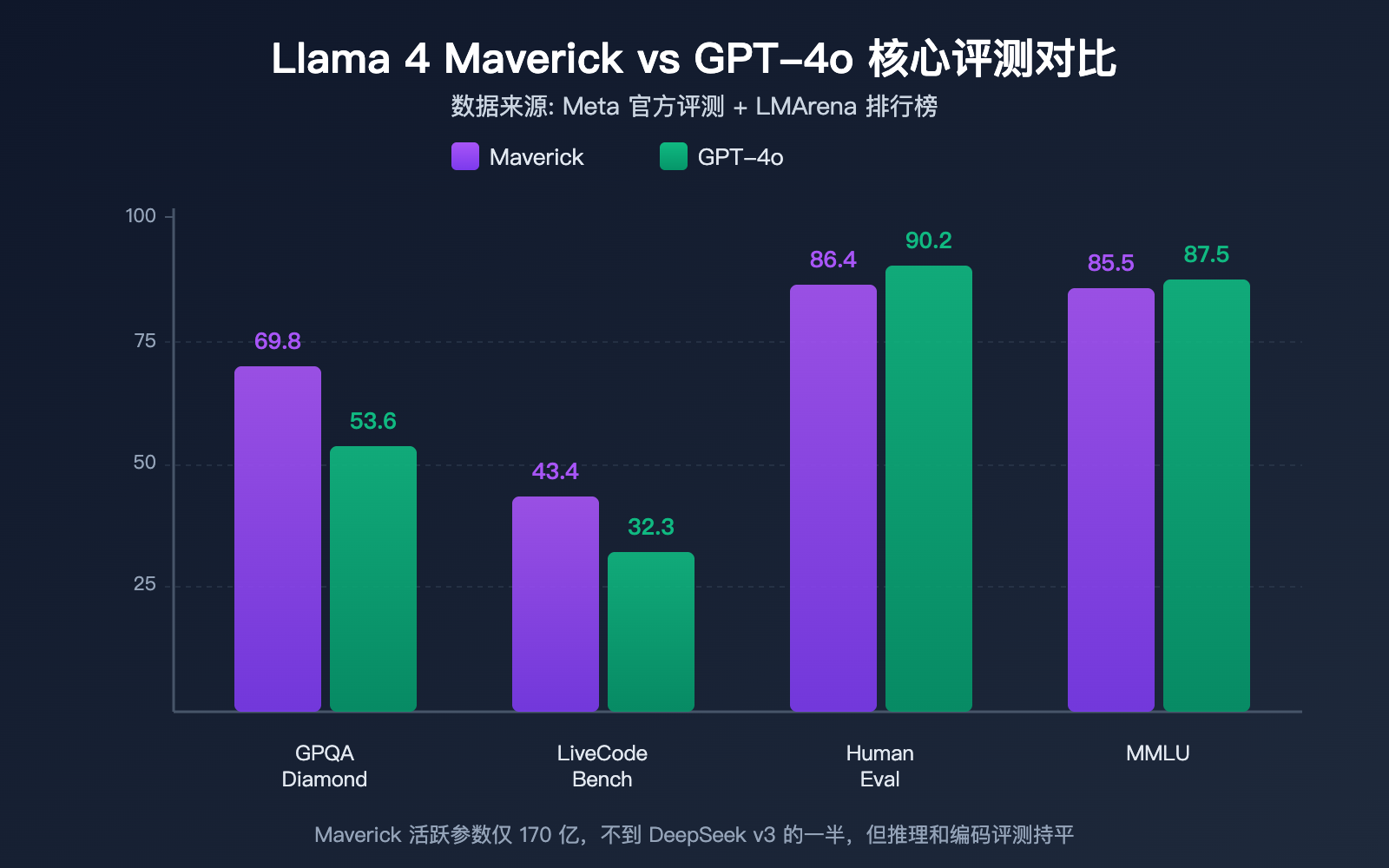

Maverick 在多项权威评测中表现突出,综合能力超越 GPT-4o 和 Gemini 2.0 Flash:

| 评测基准 | Llama 4 Maverick | GPT-4o | Gemini 2.0 Flash | 评价 |

|---|---|---|---|---|

| MMLU | 85.5 | ~87-88 | – | 接近顶尖 |

| GPQA Diamond | 69.8 | 53.6 | – | 大幅领先 |

| LiveCodeBench | 43.4 | 32.3 | – | 显著领先 |

| HumanEval | 86.4% | 90.2% | – | 接近水平 |

| LMArena ELO | 1417 | 低于 1417 | 低于 1417 | 顶级水平 |

值得关注的几个亮点:

GPQA Diamond 科学推理领先: Maverick 在 GPQA Diamond 上得分 69.8,比 GPT-4o 的 53.6 高出超过 16 个百分点,展现了强大的专业学科推理能力。

LiveCodeBench 编码能力突出: 在实时编程评测 LiveCodeBench 中,Maverick 以 43.4 分领先 GPT-4o 的 32.3 分,同时在推理和编码任务上与 DeepSeek v3 持平——而 Maverick 的活跃参数量不到 DeepSeek v3 的一半。

LMArena 人类偏好评测顶级: Maverick 实验版本在 LMArena(Chatbot Arena)获得 1417 ELO 评分,进入全球顶级模型行列。

Llama 4 Scout 评测亮点

Scout 作为一个仅 170 亿活跃参数的"小"模型,性能表现令人印象深刻:

- 在广泛的评测基准上超越 Gemma 3、Gemini 2.0 Flash-Lite 和 Mistral 3.1

- 超越上一代所有 Llama 3 模型,包括参数量更大的 Llama 3.3 70B

- 拥有业界最长的 1000 万 token 上下文窗口,可处理约 750 万字的文本

- 单张 H100 GPU 即可运行,推理成本极低

🎯 开发者建议: Llama 4 Scout 和 Maverick 均已支持 OpenAI 兼容接口调用。如需快速测试这些模型的实际效果,可通过 API易 apiyi.com 平台获取统一 API 接口,一个 Key 即可切换调用多种开源和闭源模型。

Llama 4 Scout 与 Maverick 对开发者的影响

1000 万 token 上下文窗口的应用价值

Scout 的 1000 万 token 上下文窗口是目前公开发布模型中最长的,这一能力为开发者打开了全新的应用空间:

- 完整代码库分析: 可将整个中大型项目的代码一次性输入模型进行分析

- 长文档处理: 一次性处理数百页的技术文档、法律合同或研究论文

- 多轮对话记忆: 在对话式应用中保持极长的上下文记忆

- 大规模数据抽取: 从海量非结构化文本中批量提取结构化信息

Llama 4 开源生态影响

| 影响维度 | 具体变化 | 开发者收益 |

|---|---|---|

| 部署门槛 | Scout 单卡可运行 | 降低硬件成本 |

| 模型能力 | 超越 GPT-4o 级别 | 开源追平闭源 |

| 多模态 | 原生图文理解 | 无需额外视觉模块 |

| 上下文 | 1000 万 token | 全新应用场景 |

| 定制化 | 开放权重微调 | 垂直场景优化 |

Llama 4 的发布标志着开源模型在综合能力上首次全面追平甚至超越主流闭源商业模型。对于开发者而言,这意味着:

成本优势: 基于 Llama 4 进行私有化部署,可以显著降低 API 调用成本,特别适合高频调用的生产场景。

定制自由: 开放权重意味着开发者可以基于 Llama 4 进行微调、量化、蒸馏等操作,针对垂直场景打造专属模型。

生态繁荣: Llama 4 发布首日即获得 AWS、Google Cloud、Azure、Together.ai、Groq、Fireworks 等多家云平台支持。

Llama 4 平台集成

Meta 已将 Llama 4 集成至旗下社交平台,为 Meta AI 助手提供多模态能力:

- WhatsApp: 支持发送图片进行 AI 分析和对话

- Messenger: 多模态交互问答

- Instagram Direct: 图片理解和创意辅助

- Meta.ai: 网页端直接使用

这是首次有 AI 大模型以如此大规模直接面向消费者部署,覆盖数十亿用户。

Llama 4 Behemoth: 仍在训练的旗舰模型

除了 Scout 和 Maverick,Meta 还预告了 Llama 4 家族的旗舰模型 Behemoth:

| 参数 | Behemoth 规格 |

|---|---|

| 活跃参数 | 2880 亿 |

| 专家数量 | 16 个 |

| 总参数量 | 约 2 万亿 |

| 训练状态 | 进行中 |

根据 Meta 公布的早期检查点数据,Behemoth 在多项 STEM 评测中已超越 GPT-4.5、Claude Sonnet 3.7 和 Gemini 2.0 Pro。Maverick 在训练过程中通过知识蒸馏从 Behemoth 获取能力提升,这也解释了 Maverick 以较小的活跃参数实现顶级性能的原因。

💡 关注建议: Behemoth 的最终发布将进一步推动开源模型的能力上限。开发者现阶段可先基于 Scout 和 Maverick 构建应用,在 API易 apiyi.com 平台上进行多模型对比测试,待 Behemoth 发布后无缝切换。

Llama 4 Scout 与 Maverick 快速接入

极简 API 调用示例

通过 OpenAI 兼容接口,10 行代码即可调用 Llama 4 模型:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{"role": "user", "content": "解释 MoE 架构的工作原理"}]

)

print(response.choices[0].message.content)

查看多模态调用示例

import openai

import base64

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 读取本地图片并编码

with open("image.jpg", "rb") as f:

image_data = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "请描述这张图片的内容"},

{"type": "image_url", "image_url": {

"url": f"data:image/jpeg;base64,{image_data}"

}}

]

}]

)

print(response.choices[0].message.content)

🚀 快速开始: 推荐通过 API易 apiyi.com 获取 API Key 和免费测试额度,平台支持 Llama 4 Scout、Maverick 以及其他主流模型的统一接口调用,便于快速对比不同模型的实际表现。

常见问题

Q1: Llama 4 Scout 和 Maverick 如何选择?

如果你需要处理超长文本(如完整代码库、长文档分析),选择 Scout(1000 万 token 上下文)。如果你需要综合能力最强的通用模型,选择 Maverick(128 专家、评测超越 GPT-4o)。两者均可通过 API易 apiyi.com 平台进行实际效果测试,帮助做出最佳选择。

Q2: Llama 4 是完全免费的吗?

Llama 4 采用 Llama 许可证开放权重,允许商业使用。但月活超过 7 亿的企业需向 Meta 申请特别许可。对于绝大多数开发者和企业,可以免费使用。如果不想自行部署,也可以通过 API易 apiyi.com 等第三方平台以 API 方式按需调用。

Q3: Llama 4 Maverick 真的比 GPT-4o 强吗?

在 GPQA Diamond(科学推理)和 LiveCodeBench(实时编程)等关键评测上,Maverick 确实显著领先 GPT-4o。在 MMLU 和 HumanEval 上两者接近。LMArena 人类偏好评测中 Maverick 也达到了顶级 ELO 分数。总体而言,Maverick 在综合评测中与 GPT-4o 处于同一梯队,部分指标领先。

总结

Llama 4 Scout 与 Maverick 的核心要点:

- 架构革新: 首批原生多模态 MoE 开源模型,Early Fusion 架构实现真正的图文一体化理解

- 性能突破: Maverick 在 GPQA Diamond 领先 GPT-4o 超过 16 个百分点,Scout 以 170 亿活跃参数超越 Llama 3.3 70B

- 应用变革: 1000 万 token 上下文窗口和开放权重,为开发者开辟全新应用场景和部署可能

Llama 4 的发布标志着开源大模型进入全新时代。无论是构建企业级应用还是个人项目,开发者都可以基于 Llama 4 获得媲美顶级闭源模型的能力。推荐通过 API易 apiyi.com 快速体验 Llama 4 系列模型,平台提供免费额度和多模型统一接口,助力开发者高效选型。

📚 参考资料

-

Meta AI 官方博客 – Llama 4 发布公告: 模型技术细节和评测数据的权威来源

- 链接:

ai.meta.com/blog/llama-4-multimodal-intelligence - 说明: 包含完整的架构介绍、评测数据和发布详情

- 链接:

-

Llama 官网 – 模型下载: 获取 Llama 4 模型权重和文档

- 链接:

llama.com/models/llama-4 - 说明: 提供模型下载、许可证信息和技术文档

- 链接:

-

Hugging Face – Llama 4 模型库: 开源社区托管和使用指南

- 链接:

huggingface.co/meta-llama - 说明: 提供模型卡片、量化版本和社区讨论

- 链接:

作者: APIYI 技术团队

技术交流: 欢迎在评论区讨论 Llama 4 的使用心得,更多 AI 模型接入资料可访问 API易 docs.apiyi.com 文档中心