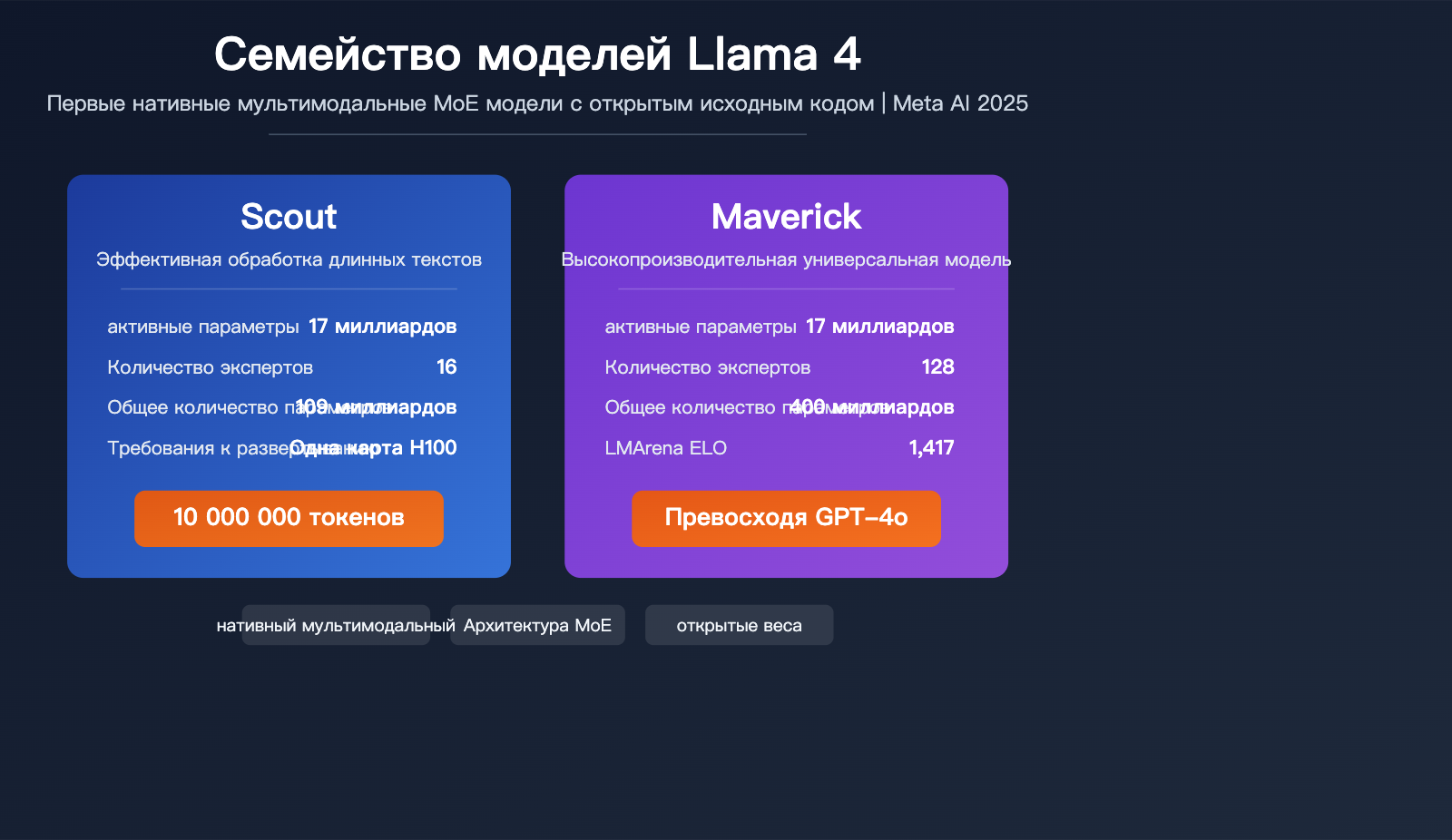

Авторское примечание: Meta представила Llama 4 Scout и Maverick на базе архитектуры MoE с нативной поддержкой мультимодальности. Scout обладает контекстным окном в 10 млн токенов, а Maverick по результатам комплексного тестирования превосходит GPT-4o. В этой статье мы подробно разберем технические детали и влияние релиза на разработчиков.

Meta официально выпустила семейство моделей Llama 4. Первые открытые мультимодальные модели на архитектуре MoE — Llama 4 Scout и Maverick — вызвали огромный интерес в AI-сообществе. В этом материале мы кратко разберем, что этот важный этап значит для AI-разработчиков и всей индустрии в целом.

Ключевая ценность: 3 минуты на изучение основных технических прорывов, результатов тестирования и практической значимости Llama 4 Scout и Maverick.

Краткий обзор ключевых характеристик Llama 4 Scout и Maverick

| Параметр | Llama 4 Scout | Llama 4 Maverick |

|---|---|---|

| Дата релиза | 5 апреля 2025 г. | 5 апреля 2025 г. |

| Тип архитектуры | Нативная мультимодальная MoE | Нативная мультимодальная MoE |

| Активные параметры | 17 млрд | 17 млрд |

| Количество экспертов | 16 | 128 |

| Общее кол-во параметров | 109 млрд | 400 млрд |

| Контекстное окно | 10 млн токенов | 1 млн токенов |

| Лицензия | Llama License | Llama License |

Позиционирование Llama 4 Scout и Maverick

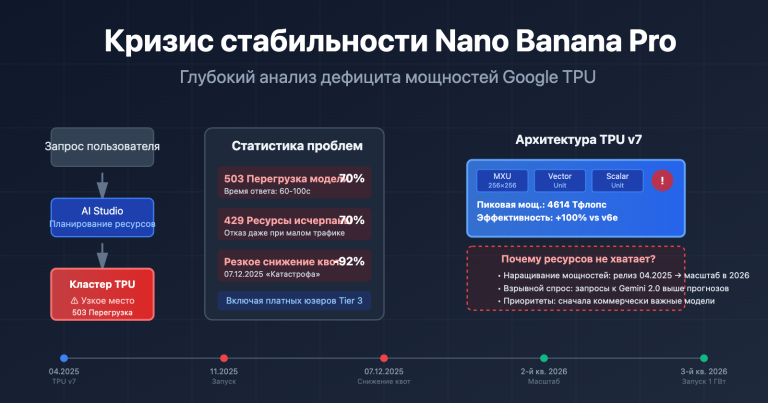

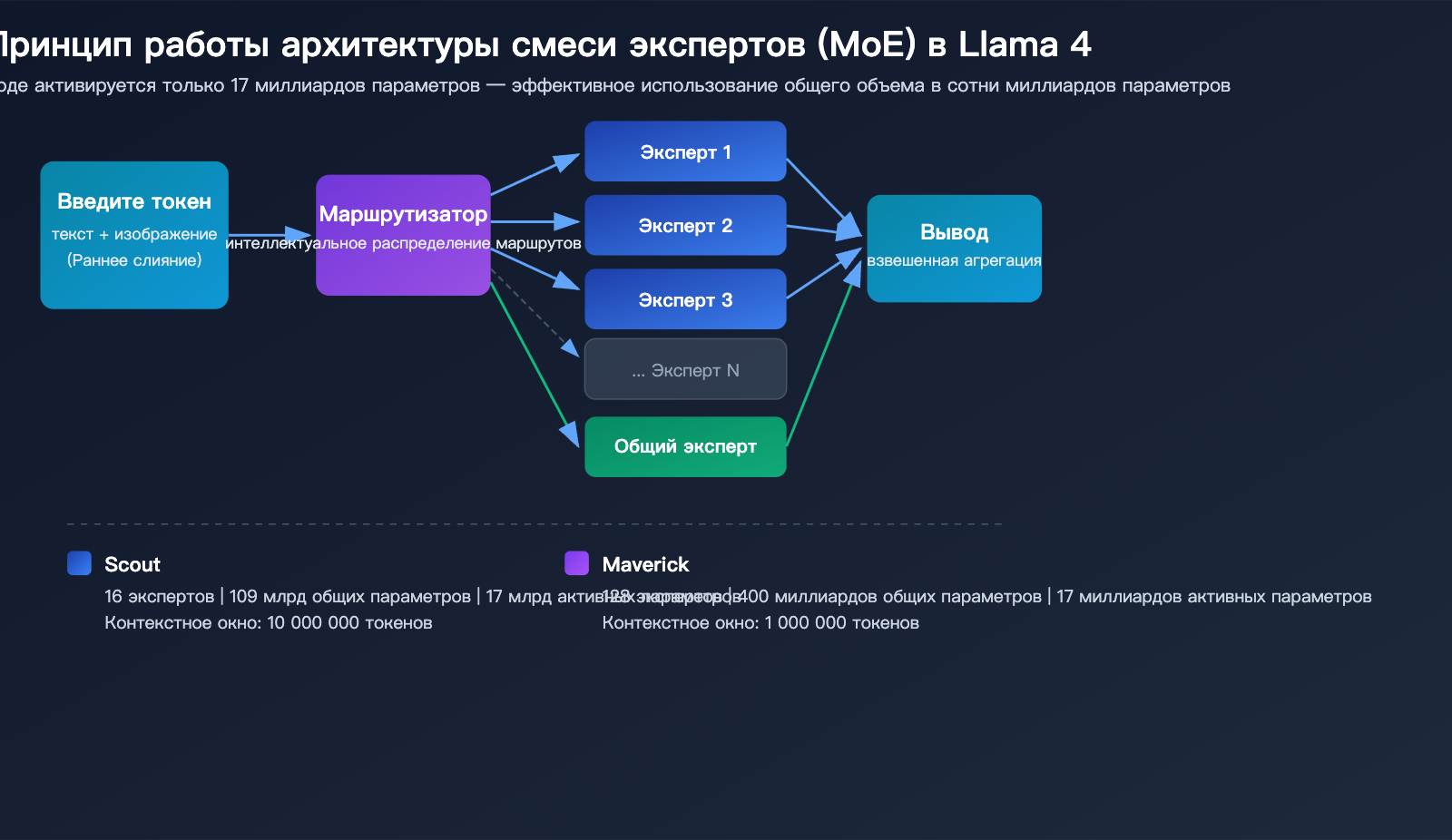

Llama 4 — это четвертое поколение больших языковых моделей от Meta, ставшее первым в серии Llama, использующим нативную мультимодальность и архитектуру смеси экспертов (MoE). По сравнению с серией Llama 3, в Llama 4 была проведена фундаментальная переработка архитектуры.

Scout позиционируется как эффективная модель для обработки длинных текстов, предлагающая самое большое в индустрии контекстное окно в 10 миллионов токенов при крайне низких затратах на инференс. Maverick же выступает в роли высокопроизводительной универсальной модели, которая благодаря 128 экспертным сетям превосходит GPT-4o по совокупности возможностей.

Веса обеих моделей уже доступны для скачивания; разработчики могут получить их через llama.com и Hugging Face.

Анализ технической архитектуры Llama 4 Scout и Maverick

Архитектура нативного мультимодального Early Fusion

Главное архитектурное новшество Llama 4 заключается в нативном мультимодальном обучении. В отличие от предыдущих подходов, где визуальные модули подключались к языковой модели на поздних этапах, Llama 4 с самого начала претренинга использует схему Early Fusion (ранняя интеграция). Это позволяет подавать текстовые и визуальные токены в основную сеть модели как единое целое.

Это означает, что при обработке смешанного контента (текст + изображения) Llama 4 больше не работает по двухэтапной схеме «сначала смотрим, потом говорим», а воспринимает и анализирует данные как единый мультимодальный поток.

Механизм смешанных экспертов (MoE) в Llama 4

| Техническая деталь | Scout (16 экспертов) | Maverick (128 экспертов) |

|---|---|---|

| Общее кол-во параметров | 109 млрд | 400 млрд |

| Активных параметров на вызов | 17 млрд | 17 млрд |

| Кол-во маршрутизируемых экспертов | 16 + общие эксперты | 128 + общие эксперты |

| Эффективность вывода | Работает на одной H100 (INT4) | Требуется одна H100 DGX |

| Архитектура контекста | iRoPE (без чередования позиционного кодирования) | Стандартное внимание |

Ключевое преимущество архитектуры MoE заключается в том, что при колоссальном общем объеме параметров (109 млрд и 400 млрд соответственно), в процессе каждого вызова модели задействуется лишь 17 млрд параметров. Это позволяет запускать Llama 4 Scout на одной видеокарте NVIDIA H100 с квантованием INT4, что значительно снижает порог входа для развертывания.

Данные для обучения и масштаб Llama 4

Объем данных для обучения Llama 4 достиг 30+ трлн токенов, что в 2 раза больше, чем у Llama 3. Объем мультиязычных данных вырос в 10 раз и теперь охватывает 200 языков. Обучение проводилось в формате FP8, что позволило достичь эффективности 390 TFLOPs на GPU для модели Behemoth.

Обзор производительности Llama 4 Scout и Maverick

Данные тестирования Llama 4 Maverick

Maverick демонстрирует выдающиеся результаты в ряде авторитетных бенчмарков, превосходя по совокупности возможностей GPT-4o и Gemini 2.0 Flash:

| Бенчмарк | Llama 4 Maverick | GPT-4o | Gemini 2.0 Flash | Оценка |

|---|---|---|---|---|

| MMLU | 85.5 | ~87-88 | — | Почти на пике |

| GPQA Diamond | 69.8 | 53.6 | — | Значительный отрыв |

| LiveCodeBench | 43.4 | 32.3 | — | Заметное преимущество |

| HumanEval | 86.4% | 90.2% | — | На одном уровне |

| LMArena ELO | 1417 | Ниже 1417 | Ниже 1417 | Топовый уровень |

Несколько ключевых моментов, заслуживающих внимания:

Лидерство в научных рассуждениях GPQA Diamond: Maverick набрал 69.8 баллов в GPQA Diamond, что более чем на 16 процентных пунктов выше результата GPT-4o (53.6), демонстрируя мощные способности к логическим выводам в специализированных дисциплинах.

Выдающиеся навыки кодинга в LiveCodeBench: В бенчмарке для программирования в реальном времени LiveCodeBench модель Maverick набрала 43.4 балла против 32.3 у GPT-4o. При этом по задачам на логику и кодинг она идет вровень с DeepSeek v3, хотя количество активных параметров у Maverick составляет менее половины от DeepSeek v3.

Топовые позиции в рейтинге предпочтений пользователей LMArena: Экспериментальная версия Maverick получила 1417 баллов ELO в LMArena (Chatbot Arena), войдя в число лучших моделей мира.

Ключевые показатели Llama 4 Scout

Scout — это «маленькая» модель с 17 миллиардами активных параметров, но её производительность впечатляет:

- Превосходит Gemma 3, Gemini 2.0 Flash-Lite и Mistral 3.1 в широком спектре бенчмарков.

- Обходит все модели предыдущего поколения Llama 3, включая Llama 3.3 70B с гораздо большим количеством параметров.

- Обладает одним из самых больших в индустрии контекстных окон на 10 миллионов токенов, что позволяет обрабатывать около 7,5 миллионов слов текста.

- Может работать на одной видеокарте H100, что обеспечивает крайне низкую стоимость вызова модели.

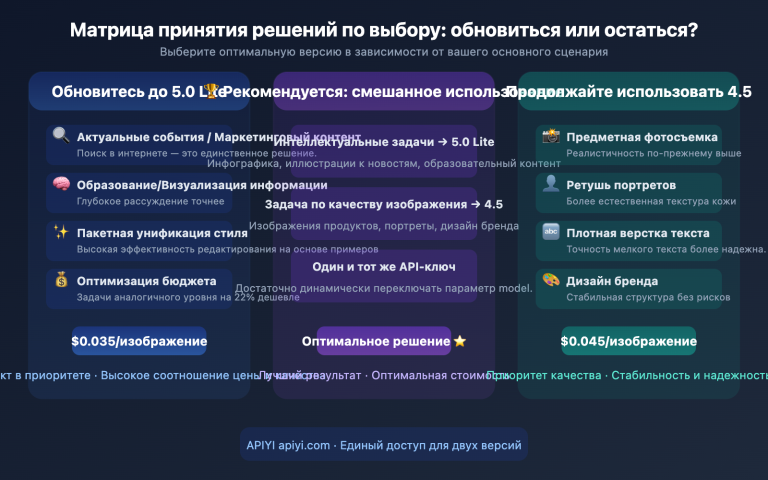

🎯 Совет разработчикам: Llama 4 Scout и Maverick уже поддерживают вызов через интерфейс, совместимый с OpenAI. Если вам нужно быстро протестировать эти модели в деле, вы можете получить унифицированный API-интерфейс через платформу APIYI (apiyi.com). Один ключ позволяет переключаться между множеством открытых и закрытых моделей.

Влияние Llama 4 Scout и Maverick на разработчиков

Практическая ценность контекстного окна в 10 млн токенов

Контекстное окно Scout на 10 млн токенов — самое большое среди всех публично доступных моделей на сегодняшний день. Эта возможность открывает перед разработчиками совершенно новые горизонты:

- Анализ целых кодовых баз: теперь можно загрузить в модель весь проект среднего или крупного размера для комплексного анализа за один раз.

- Обработка длинных документов: единовременная работа с сотнями страниц технической документации, юридических контрактов или научных статей.

- Память многоходовых диалогов: сохранение невероятно длинной истории контекста в разговорных приложениях.

- Масштабное извлечение данных: пакетное извлечение структурированной информации из огромных массивов неструктурированного текста.

Влияние Llama 4 на экосистему open-source

| Аспект влияния | Конкретные изменения | Выгода для разработчика |

|---|---|---|

| Порог развертывания | Scout работает на одной видеокарте | Снижение затрат на оборудование |

| Возможности модели | Уровень выше GPT-4o | Open-source догнал проприетарные модели |

| Мультимодальность | Нативное понимание изображений и текста | Не нужны дополнительные визуальные модули |

| Контекст | 10 млн токенов | Новые сценарии использования |

| Кастомизация | Открытые веса для дообучения | Оптимизация под узкие задачи |

Выход Llama 4 знаменует собой момент, когда open-source модели впервые полностью сравнялись с ведущими коммерческими моделями по совокупности возможностей, а местами и превзошли их. Для разработчиков это означает:

Ценовое преимущество: частное развертывание Llama 4 позволяет значительно сократить расходы на вызов модели, что особенно актуально для продакшн-сценариев с высокой частотой запросов.

Свобода кастомизации: открытые веса позволяют разработчикам заниматься дообучением (fine-tuning), квантованием и дистилляцией, создавая специализированные модели под конкретные вертикали.

Развитая экосистема: в первый же день после релиза Llama 4 получила поддержку от множества облачных платформ, включая AWS, Google Cloud, Azure, Together.ai, Groq и Fireworks.

Интеграция Llama 4 в платформы

Meta уже интегрировала Llama 4 в свои социальные сети, обеспечив Meta AI мультимодальными возможностями:

- WhatsApp: поддержка отправки изображений для анализа и общения с ИИ.

- Messenger: мультимодальные интерактивные вопросы и ответы.

- Instagram Direct: понимание изображений и помощь в творческих задачах.

- Meta.ai: прямое использование в веб-версии.

Это первый случай, когда большая языковая модель развертывается для потребителей в таком масштабе, охватывая миллиарды пользователей.

Llama 4 Behemoth: флагманская модель в процессе обучения

Помимо Scout и Maverick, Meta анонсировала флагманскую модель семейства Llama 4 — Behemoth:

| Параметр | Характеристики Behemoth |

|---|---|

| Активные параметры | 288 млрд |

| Количество экспертов | 16 |

| Общее количество параметров | около 2 трлн |

| Статус обучения | в процессе |

Согласно ранним данным контрольных точек, опубликованным Meta, Behemoth уже превосходит GPT-4.5, Claude Sonnet 3.7 и Gemini 2.0 Pro в ряде STEM-тестов. Maverick в процессе обучения получает прирост способностей за счет дистилляции знаний от Behemoth, что объясняет, как Maverick достигает топовой производительности при меньшем количестве активных параметров.

💡 Совет: Релиз Behemoth еще выше поднимет планку возможностей open-source моделей. Разработчики могут уже сейчас создавать приложения на базе Scout и Maverick, проводить сравнительное тестирование моделей на платформе APIYI (apiyi.com), а после выхода Behemoth — бесшовно переключиться на него.

Быстрый доступ к Llama 4 Scout и Maverick

Пример минималистичного вызова API

Благодаря совместимости с интерфейсом OpenAI, вызов модели Llama 4 займет всего 10 строк кода:

import openai

# Инициализация клиента для работы с APIYI

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Вызов модели

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{"role": "user", "content": "Объясни принцип работы архитектуры MoE"}]

)

print(response.choices[0].message.content)

Посмотреть пример мультимодального вызова

import openai

import base64

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Чтение локального изображения и его кодирование

with open("image.jpg", "rb") as f:

image_data = base64.b64encode(f.read()).decode()

# Отправка мультимодального запроса

response = client.chat.completions.create(

model="meta-llama/llama-4-maverick",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": "Опиши, что изображено на этой картинке"},

{"type": "image_url", "image_url": {

"url": f"data:image/jpeg;base64,{image_data}"

}}

]

}]

)

print(response.choices[0].message.content)

🚀 Быстрый старт: Рекомендуем получить API-ключ и бесплатные тестовые лимиты на платформе APIYI (apiyi.com). Платформа поддерживает единый интерфейс для вызова Llama 4 Scout, Maverick и других популярных моделей, что позволяет удобно сравнивать их производительность в реальных задачах.

Часто задаваемые вопросы

Q1: Что выбрать: Llama 4 Scout или Maverick?

Если вам нужно работать с очень длинными текстами (например, анализировать целые кодовые базы или объемные документы), выбирайте Scout (контекстное окно 10 млн токенов). Если же вам нужна универсальная модель с максимальными возможностями, выбирайте Maverick (128 экспертов, превосходит GPT-4o по результатам тестов). Обе модели доступны на платформе APIYI (apiyi.com) для тестирования, что поможет вам сделать правильный выбор.

Q2: Llama 4 полностью бесплатна?

Llama 4 распространяется по лицензии Llama с открытыми весами и разрешает коммерческое использование. Однако компании с ежемесячной аудиторией более 700 миллионов пользователей должны запрашивать специальное разрешение у Meta. Для большинства разработчиков и компаний модель бесплатна. Если вы не хотите заниматься самостоятельным развертыванием, вы можете использовать API через сторонние платформы, такие как APIYI (apiyi.com), оплачивая только фактическое использование.

Q3: Действительно ли Llama 4 Maverick лучше, чем GPT-4o?

В ключевых тестах, таких как GPQA Diamond (научные рассуждения) и LiveCodeBench (программирование в реальном времени), Maverick действительно значительно опережает GPT-4o. В тестах MMLU и HumanEval показатели моделей близки. В рейтинге человеческих предпочтений LMArena модель Maverick также достигла топовых значений ELO. В целом, Maverick находится в одной лиге с GPT-4o, а по некоторым метрикам даже превосходит её.

Резюме

Ключевые особенности Llama 4 Scout и Maverick:

- Архитектурные инновации: Первые нативные мультимодальные модели с архитектурой MoE (смесь экспертов) с открытым исходным кодом. Архитектура Early Fusion обеспечивает по-настоящему глубокое понимание связей между текстом и изображениями.

- Прорыв в производительности: Maverick опережает GPT-4o в тесте GPQA Diamond более чем на 16 процентных пунктов, а Scout с 17 миллиардами активных параметров превосходит Llama 3.3 70B.

- Революция в применении: Контекстное окно на 10 миллионов токенов и открытые веса открывают перед разработчиками принципиально новые сценарии использования и возможности для развертывания.

Выход Llama 4 знаменует собой начало новой эры для открытых больших языковых моделей. Теперь разработчики могут создавать как корпоративные решения, так и личные проекты, опираясь на возможности, сопоставимые с топовыми закрытыми моделями. Рекомендуем быстро протестировать модели серии Llama 4 через APIYI (apiyi.com) — платформа предоставляет бесплатные лимиты и единый интерфейс для работы с различными моделями, что значительно упрощает выбор подходящего инструмента.

📚 Справочные материалы

-

Официальный блог Meta AI — Анонс Llama 4: Авторитетный источник технических деталей и данных тестирования.

- Ссылка:

ai.meta.com/blog/llama-4-multimodal-intelligence - Описание: Содержит полное описание архитектуры, результаты тестов и подробности релиза.

- Ссылка:

-

Официальный сайт Llama — Загрузка моделей: Получение весов и документации Llama 4.

- Ссылка:

llama.com/models/llama-4 - Описание: Доступ к скачиванию моделей, лицензионной информации и технической документации.

- Ссылка:

-

Hugging Face — Библиотека моделей Llama 4: Руководство по использованию в сообществе open-source.

- Ссылка:

huggingface.co/meta-llama - Описание: Карточки моделей, квантованные версии и обсуждения в сообществе.

- Ссылка:

Автор: Техническая команда APIYI

Техническое обсуждение: Приглашаем обсудить опыт работы с Llama 4 в комментариях. Больше материалов по интеграции AI-моделей можно найти в центре документации APIYI: docs.apiyi.com