xAIの公式発表によると、8種類の旧版Grokモデルが2026年5月15日 12:00(太平洋標準時)をもって一斉に廃止されることになりました。該当するリクエストは自動的に「grok-4.3」へリダイレクトされますが、課金は新モデルの料金体系が適用されます。本記事では、この変更がAI開発者や企業ユーザーに与える影響を迅速に解説します。

核心的な価値: Grokモデルの廃止リスト、リダイレクトルール、コスト変動、およびAPIYIの同期終了戦略に基づいた呼び出しコードの切り替え方法を3分で理解できます。

Grokモデル廃止に関する重要情報のまとめ

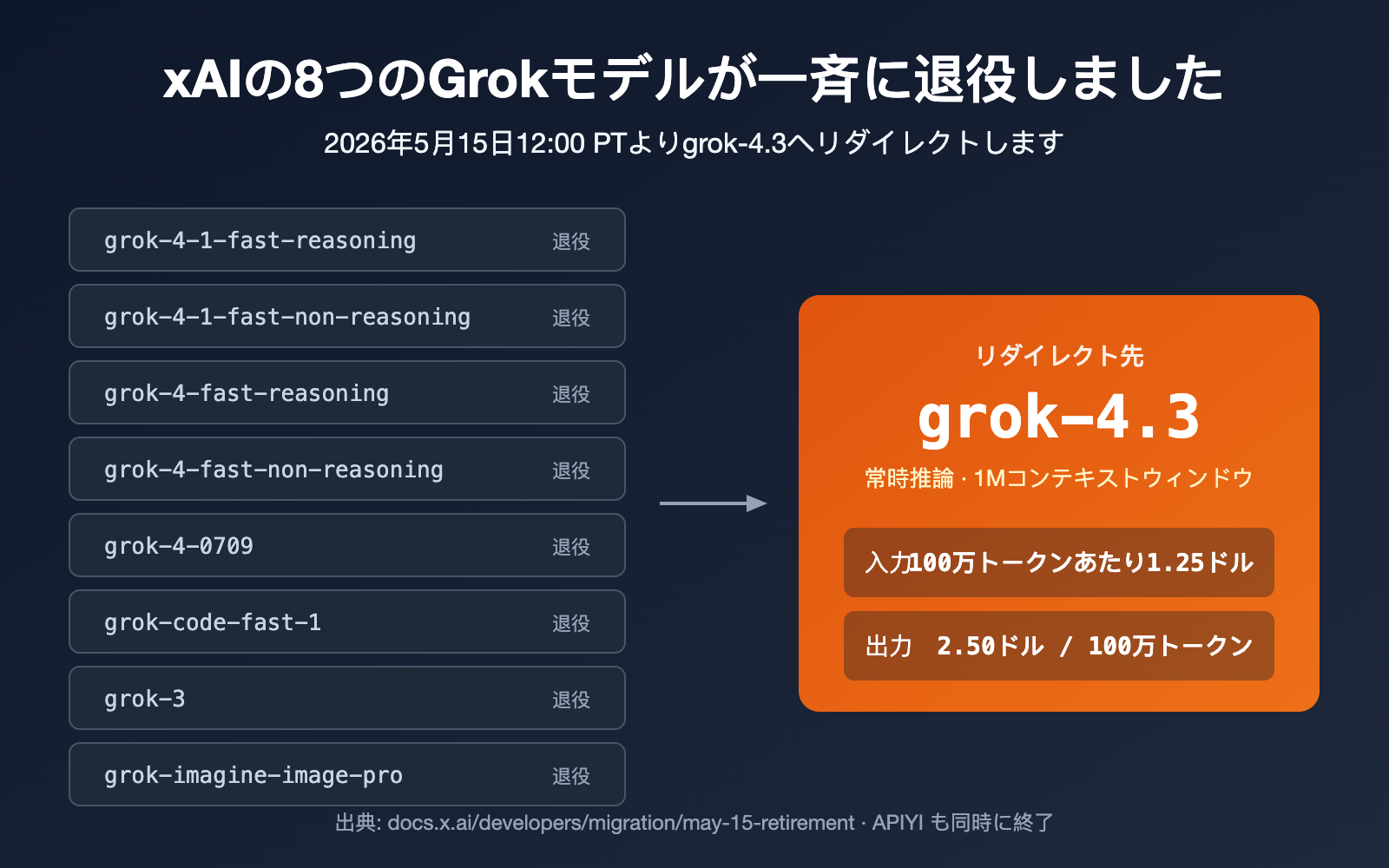

xAIは移行ドキュメントの中で、明確なタイムラインと影響範囲を提示しています。今回の廃止は一部のマイナーなモデルを整理するものではなく、過去半年間の主力であった推論(reasoning)、非推論(non-reasoning)、コード生成、画像生成モデルを網羅するものです。本番環境でこれらのモデル名を長期間利用しているチームにとって、5月15日はコードの切り替えを完了させるべき「デッドライン」となります。

| 項目 | 詳細 |

|---|---|

| 廃止日時 | 2026年5月15日 12:00 PT |

| 発表元 | xAI 公式 (docs.x.ai) |

| 廃止モデル数 | 8種類 |

| リダイレクト先 | grok-4.3 / grok-imagine-image-quality |

| 新モデル料金 | $1.25 / 1M 入力、$2.50 / 1M 出力 |

| コンテキストウィンドウ | 1,000,000 トークン |

| 資料ソース | docs.x.ai/developers/migration/may-15-retirement |

Grokモデル廃止リストの詳細

今回一斉に廃止される8つのモデルは、4つの主要なワークロードをカバーしています。高速推論シリーズ(grok-4-1-fast-reasoning、grok-4-fast-reasoning)は高スループット推論向け、低遅延対話シリーズ(grok-4-1-fast-non-reasoning、grok-4-fast-non-reasoning)はリアルタイム対話向けです。また、grok-4-0709とgrok-3は初期の汎用フラッグシップモデルであり、grok-code-fast-1とgrok-imagine-image-proはそれぞれコード生成と画像生成を担っていました。

| モデル名 (slug) | カテゴリ | 典型的な用途 | リダイレクト先 |

|---|---|---|---|

| grok-4-1-fast-reasoning | 推論 | 高スループット推論 | grok-4.3 (low effort) |

| grok-4-1-fast-non-reasoning | 非推論 | 低遅延対話 | grok-4.3 (none effort) |

| grok-4-fast-reasoning | 推論 | 高速推論 | grok-4.3 (low effort) |

| grok-4-fast-non-reasoning | 非推論 | リアルタイム対話 | grok-4.3 (none effort) |

| grok-4-0709 | 推論 | 汎用フラッグシップ | grok-4.3 (low effort) |

| grok-code-fast-1 | コーディング | インテリジェントなコーディング | grok-4.3 (low effort) |

| grok-3 | 非推論 | 長期本番環境 | grok-4.3 (none effort) |

| grok-imagine-image-pro | 画像生成 | 高品質画像生成 | grok-imagine-image-quality |

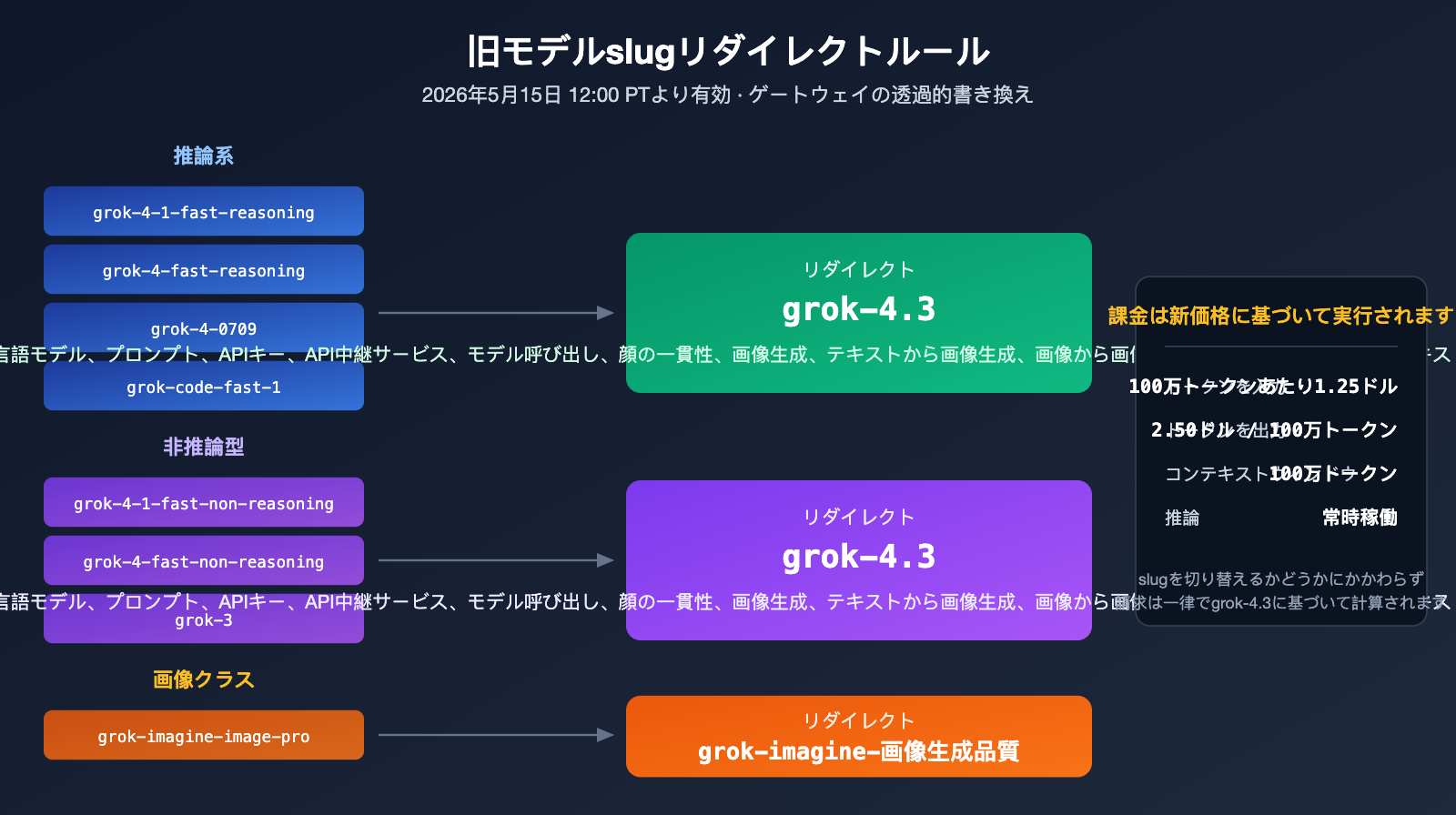

公式ドキュメントによると、すべての推論系モデルは「grok-4.3」と「low reasoning effort」の組み合わせでサービスが提供され、すべての非推論系モデルは「none effort」に変更されることで、元のモデルに近い遅延を維持します。画像生成リクエストはすべて「grok-imagine-image-quality」で処理されるようになります。

Grok モデルの提供終了とリダイレクトルールの解説

5月15日 12:00(太平洋標準時)以降、旧モデルのslug(識別子)は即座に404エラーを返すのではなく、ゲートウェイによって自動的に grok-4.3 へと転送されます。この「スムーズな移行」は互換性の観点からは非常に親切ですが、同時にコスト面での落とし穴にもなり得ます。多くのチームが「リクエストが成功しているから問題ない」と誤解し、月末の請求書を見て初めて単価が密かに上昇していたことに気づくケースが多発しています。

Grok モデル提供終了に伴う推論(Reasoning)挙動の変化

grok-4.3 と旧版の fast-reasoning シリーズの最大の違いは、「Always-on Reasoning(常時推論)」という設計にあります。grok-4.3 は推論(Chain-of-Thought)をオプション機能ではなく、モデルの標準的な挙動として組み込んでいます。開発者は推論強度を low、medium、high の3段階から選択できますが、推論を完全にオフにするオプションはありません。旧版の fast-non-reasoning モデルは推論プロセスをスキップしていましたが、リダイレクト後の none effort 設定では grok-4.3 が従来の「直接回答」体験をシミュレートするものの、実際の処理経路では少量の内部推論トークンが消費されます。

注目すべき点は、xAIが今回のSDKレベルで「互換モードパラメータ」を提供していないことです。つまり、コード内に model="grok-4-fast-reasoning" とハードコーディングされている場合、動作は継続できても、推論強度を正確に制御することはできません。レイテンシや回答の一貫性に敏感なビジネスアプリケーションでは、明示的に reasoning_effort フィールドを渡す必要があります。そうしないとデフォルト設定が適用され、旧モデルの挙動を再現できなくなります。

極限の応答速度を求めるリアルタイムアプリケーションの場合、APIYI (apiyi.com) を活用して、2つの effort 設定によるレイテンシの差を実測し、ビジネス側のプロンプト設計を調整するかどうかを判断することをお勧めします。統一されたインターフェースに切り替えることで、追加のパラメータ変更なしに、異なる推論強度でのスループットと初回トークン生成までの遅延(TTFT)を迅速に比較検証できます。

Grok モデル提供終了に伴う画像生成モデルの変化

grok-imagine-image-pro は、過去半年間xAIが推し進めてきた高解像度画像生成モデルです。今回、grok-imagine-image-quality への切り替えが行われましたが、新モデルは画像の詳細やプロンプトへの忠実度がさらに最適化されています。ただし、1枚あたりの生成コストやレイテンシ特性には変化が生じています。

🎯 移行のアドバイス: 現在

grok-imagine-image-proを使用しているプロジェクトでは、直ちにサンドボックス環境で常用しているプロンプトの回帰テストを行うことを強く推奨します。新旧モデル間での画質の違い、生成速度、および1枚あたりのコスト変化を比較し、ビジネス側で意図しない挙動やコスト増が発生しないよう確認してください。

Grok モデル退役:コストへの影響分析

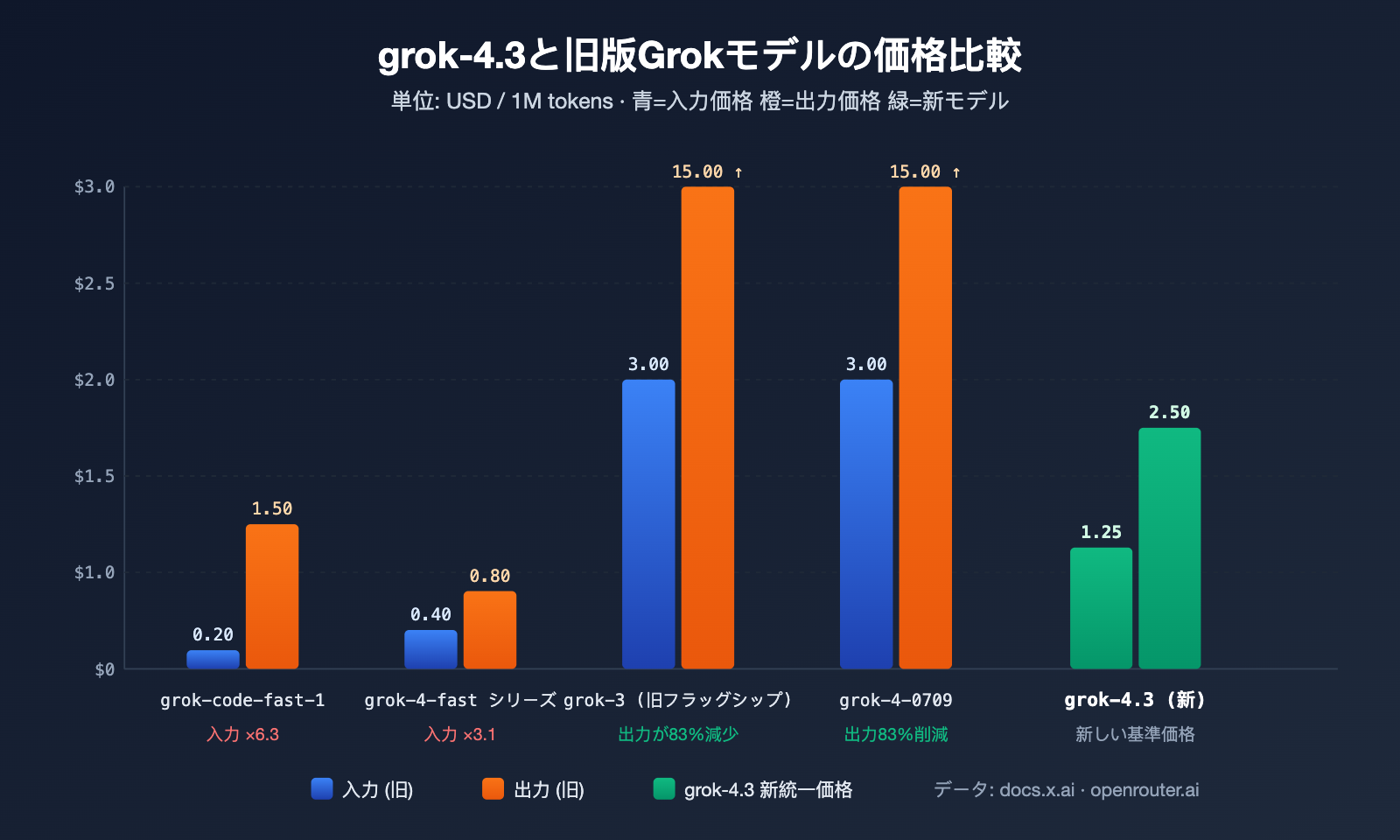

今回の退役告知において、最も過小評価されている重要なポイントは「コストの変化」です。grok-4.3 は入力 100万トークンあたり 1.25ドル、出力 100万トークンあたり 2.50ドルという統一価格を設定しました。もともと grok-4-0709 や grok-3 を利用していたチームにとっては大きな変化ではありませんが、fast-reasoning、fast-non-reasoning、grok-code-fast-1 といった低価格なスラグ(slug)に依存していたプロジェクトにとっては、単価が大幅に上昇することになります。

Grok モデル退役:5 つの重要なコスト変動

以下の表は、5月15日以降に開発者が特に注意すべき 5 つのコスト変動ポイントをまとめたものです。移行前に確認することをお勧めします。

| コスト変動ポイント | 旧モデルの状況 | grok-4.3 の状況 | リスクレベル |

|---|---|---|---|

| 入力単価 | fast シリーズは概ね $0.5/1M 未満 | 一律 $1.25/1M | 高 |

| 出力単価 | grok-code-fast-1 は $1.50/1M のみ | 一律 $2.50/1M | 高 |

| 推論トークン課金 | 一部のモデルは課金対象外 | 推論トークンも出力価格で課金 | 中 |

| コンテキストウィンドウ | 256K~512K | 1M 全量課金 | 中 |

| キャッシュとツール呼び出し | 価格体系が分散 | 0.20/1M プロンプトキャッシュ + ツール呼び出しは回数課金 | 低 |

特に注意が必要なのは、grok-4.3 がデフォルトで「always-on reasoning(推論常時有効)」である点です。たとえ low effort を選択しても、リクエストごとに旧版の fast-non-reasoning よりも多くの推論トークンを消費します。この部分は出力価格として課金されるため、月次請求書で最も見落とされやすい「隠れたコスト増」となります。社内テストでは、同じ短い質問のプロンプトを grok-4.3(low effort)に切り替えただけで、平均出力トークン数が fast-non-reasoning と比較して 20%〜35% 増加することが確認されました。つまり、単価が同じであっても、月次請求額は自然と上昇することになります。

典型的なカスタマーサポート用 Agent のシナリオで例えると、1日平均 100 万回のリクエスト(1回あたり入力 800 + 出力 400 トークン)がある場合、grok-4-fast-non-reasoning を使用すると月額コストは約 4,000 ドル前後です。同じ負荷で grok-4.3 に切り替えると、公式価格での単純計算で月額約 13,500 ドルに跳ね上がり、さらに推論トークンの増加分を重ねると、実際の請求額は 17,000 ドル近くに達します。この規模の差異は、運用チームや財務チームが 5 月中に予算の再検討を行う必要があるレベルです。

もう一つ過小評価されがちなコストは、プロンプトの改修作業です。grok-4.3 の推論挙動は「段階的に推論してから回答する」傾向が強いため、過去に grok-3 向けに調整したプロンプトテンプレートでは「出力が冗長になる」「冒頭に結論がない」といった現象が発生します。旧モデルのような「直接回答+短い結論」というスタイルに戻すには、システムプロンプトで出力構造を明示的に制約するか、reasoning effort を none に設定する必要があります。しかし、どちらの方法をとるにしても、回帰テストやプロンプトライブラリの更新といった追加工数が発生します。

💰 コスト管理: 移行期間中は、APIYI (apiyi.com) のリクエストログパネルでモデルのスラグごとにトークン使用量を確認し、実際のユースケースに合わせて

medium effortに切り替えて品質を上げるか、あるいはnone effortに固定してコストを抑制するかを判断することをお勧めします。

Grok モデルの提供終了に伴う影響分析

開発者への影響

今回のモデル一斉終了により、最も直接的な影響を受けるのは grok-code-fast-1 を利用していた開発者です。同モデルはこれまで $0.20/$1.50 という非常に高いコストパフォーマンスで、LiveCodeBench において 80.0% のスコアを記録していました。grok-4.3 への移行により単価が実質倍増するため、チームはコード補完、PR レビュー、エージェントオーケストレーションといった高頻度タスクのコスト予算を再評価する必要があります。これまで運用できていた「インライン補完 + 長文コンテキスト検索」の組み合わせは、トークン消費量を抑えるために複数のステップに分割する必要が出てくるでしょう。

エージェントフレームワークを利用している場合、ツール呼び出しの判断に fast シリーズを利用していた経路も影響を受けます。grok-4.3 はツール呼び出し能力こそ向上していますが、最初のトークン生成までの遅延(TTFT)がわずかに長いため、エンジニアはタイムアウト、リトライ、および同時実行数のパラメータを再調整する必要があります。まずは APIYI (apiyi.com) のステージング環境で回帰テストを行い、成功率、遅延分布が元の運用環境と許容範囲内であることを確認してから、全量切り替えを行うことを推奨します。

企業ユーザーへの影響

企業ユーザーにとっての懸念点は SLA(サービス品質保証)とコンプライアンスです。grok-4.3 へのアップグレードにより、既存の 8 つのモデルがカバーしていた全シナリオが統合されるため、モデル選定のマトリックスが簡素化され、企業ガバナンス(モデルレジストリ、監査、セキュリティコンプライアンス)の観点からはむしろ好都合です。ただし、財務面では既存の予算や割引ルール、特に月額契約のトークンパックやコミットメント割引条項が、統一された価格体系によって無効にならないか再確認が必要です。運用面でも、5 月の請求額が予期せず急増してアラートが鳴らないよう、監視閾値の更新が求められます。

複数モデルを組み合わせた呼び出しを行うシナリオでは、Grok、Claude、GPT などのモデルを統一された課金ビューに集約し、部門や業務ラインごとにコストを紐付けることで、モデルの頻繁なアップデートによる予算管理への影響を緩和することをお勧めします。今回のモデル終了は、単一のプロバイダーに依存するリスクが「供給停止」だけでなく、「同じ slug の裏側でこっそり中身が入れ替わること」による隠れたコスト変動にもあることを企業側に再認識させました。

業界への影響

xAI が 8 つのモデルを一度に終了させた背景には、grok-4.3 の「always-on reasoning + 1M context」という組み合わせが、推論、対話、コード生成、ツール呼び出しの 4 つのワークロードを同時にこなせるほど汎用的になったというシグナルがあります。これは Claude や OpenAI が近年進めている「推論モデル」と「指示追従モデル」を統合する方向性と一致しており、大規模言語モデルの製品化が「単一のフラッグシップモデルで全てをカバーする」フェーズに入ったことを示しています。開発者が直面するモデルマトリックスは簡素化されますが、個々のモデルの能力境界と価格弾力性はより強調されることになるでしょう。

もう一つの注目すべきトレンドは、「推論(reasoning)がデフォルトで有効化され、effort(努力量)で段階を分ける」仕組みが業界標準になりつつある点です。この設計は遅延とコストのトレードオフを開発者に委ねるものですが、前提として SDK と監視プラットフォームが effort フィールドをネイティブにサポートしている必要があります。API 中継サービスやアグリゲーションプラットフォームにとって、モデルのライフサイクル管理は新たなコア能力となるでしょう。APIYI (apiyi.com) では、すでに Grok モデルの移行ドキュメントを製品コンソールに反映し、影響を受ける slug に対して終了通知を送ることで、開発者の漏れを防ぐサポートを行っています。

APIYI 同期終了のお知らせ

xAI の公式戦略と整合性を保ち、課金の混乱を避けるため、APIYI (apiyi.com) では同期的な終了計画を策定し、古い slug を呼び出しているユーザー向けにスムーズな移行パスを提供します。コンソールでは、アカウント単位で過去 30 日間の各終了対象 slug の呼び出し回数とコスト割合を集計し、チーム責任者が移行前に影響を受ける業務モジュールを明確に把握できるようにしています。

| フェーズ | 時期 | APIYI のアクション |

|---|---|---|

| 警告期間 | 2026-05-15 まで | コンソールでのバナー表示、影響を受けるアカウントへのメール通知 |

| リダイレクト期間 | 2026-05-15 12:00 PT より | 旧 slug を自動的に grok-4.3 へ転送し、レスポンスヘッダーに deprecated を付与 |

| 完全終了 | xAI のスケジュールに準拠 | コンソールから旧 slug の選択肢を削除 |

開発者は base_url を変更する必要はなく、リクエストパラメータの model フィールドを grok-4.3 に書き換えるだけで対応可能です。業務内で推論(reasoning)と非推論(non-reasoning)の両方の呼び出しが混在している場合は、SDK のカプセル化レイヤーに effort 設定項目を追加し、負荷テストや A/B テスト時に統一して制御できるようにすることをお勧めします。以下は完全な呼び出し例です。既存のプロジェクトにコピーして検証してください。

import openai

# APIYI を使用した呼び出し例

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "user", "content": "always-on reasoning について 200 字で説明して"}

],

extra_body={"reasoning_effort": "low"}

)

print(response.choices[0].message.content)

Node.js / TypeScript 版を表示

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const completion = await client.chat.completions.create({

model: "grok-4.3",

messages: [{ role: "user", content: "grok-4.3 移行の要点をまとめて" }],

// @ts-expect-error xAI 独自フィールド

reasoning_effort: "low",

});

console.log(completion.choices[0].message.content);

🚀 移行のアドバイス: 移行前に APIYI (apiyi.com) の「モデル比較」パネルを使用して、同じプロンプトを

grok-4.3と旧モデルにそれぞれ送信し、レスポンスの品質と最初のトークン生成までの遅延を比較した上で、reasoning effortの最終的な設定値を決定することをお勧めします。

よくある質問

Q1: 5月15日以降、古いslugで引き続き呼び出しはできますか?

可能です。ただし、実際に実行されるモデルは「grok-4.3」となり、課金も「grok-4.3」の新価格($1.25/$2.50)が適用されます。月々の請求額が予期せず増加するのを避けるため、コード内の model フィールドを早急に「grok-4.3」へ更新することを強く推奨します。

Q2: grok-code-fast-1 から移行した後もコード補完に適していますか?

「grok-4.3」は「LiveCodeBench」や「SWE-bench」において「grok-code-fast-1」よりも高いスコアを記録しており、全体的なコーディング能力は向上しています。ただし、レイテンシと単価は上昇します。実際の業務サンプルを用いてP95レイテンシとPRあたりの平均トークン消費量を測定し、インライン補完用途として適しているか判断することをお勧めします。

Q3: APIYIプラットフォームでAPIキーを再申請する必要がありますか?

いいえ、必要ありません。既存のAPIYIキーは「grok-4.3」などの新モデルとそのまま互換性があり、base_urlも変更不要です。リクエストボディ内の model 名を調整するだけで利用できます。モデルの完全なリストとステータスは、APIYI(apiyi.com)のコンソールで確認可能です。

Q4: 画像生成モデル「grok-imagine-image-pro」の移行における注意点はありますか?

リクエストは「grok-imagine-image-quality」へリダイレクトされます。画面のスタイル、サンプリングシード、デフォルトパラメータに差異が生じる可能性があります。ビジネス側の画像生成結果が急激に変化するのを防ぐため、まずはサンドボックス環境で過去のプロンプトを実行し、効果が安定していることを確認してから本番環境へ移行することを推奨します。

まとめ

xAIは「fast-reasoning」「fast-non-reasoning」「grok-code-fast-1」「grok-3」「grok-imagine-image-pro」など8つの主力モデルを一斉に終了し、5月15日 12:00 PTより「grok-4.3」および「grok-imagine-image-quality」へ完全に切り替えます。移行作業自体の工数は大きくありませんが、単価や推論トークンの課金体系の変化は、コストに敏感なビジネスにとって大きな影響を及ぼします。優先的に以下の3点を行うことを推奨します:本番コードの model フィールドを「grok-4.3」に統一する、reasoning_effort を明示的に指定してレイテンシとコストを制御する、そして実際の業務サンプルを用いてエンドツーエンドのコスト試算を行うことです。

今回のモデルアップグレードを、システム改善の好機と捉えることをお勧めします。APIYI(apiyi.com)上で「grok-4.3」「Claude」「GPT」など複数のモデルを同時に実行し、レイテンシとコストを比較してください。モデル選定を「ベンダーのペースに合わせる」ものから「ビジネス指標に基づいて選定する」ものへと変えることで、長期的にはより安定した運用が可能になります。また、次回同様のモデル終了告知があった際も、切り替えコストを数時間以内に抑えることができるでしょう。

著者: APIYI Team — APIYI(apiyi.com)、企業向けAI大規模言語モデルAPI中継サービス。Grok、Claude、GPT、Geminiなど主要モデルの統一的な接続をサポートしています。