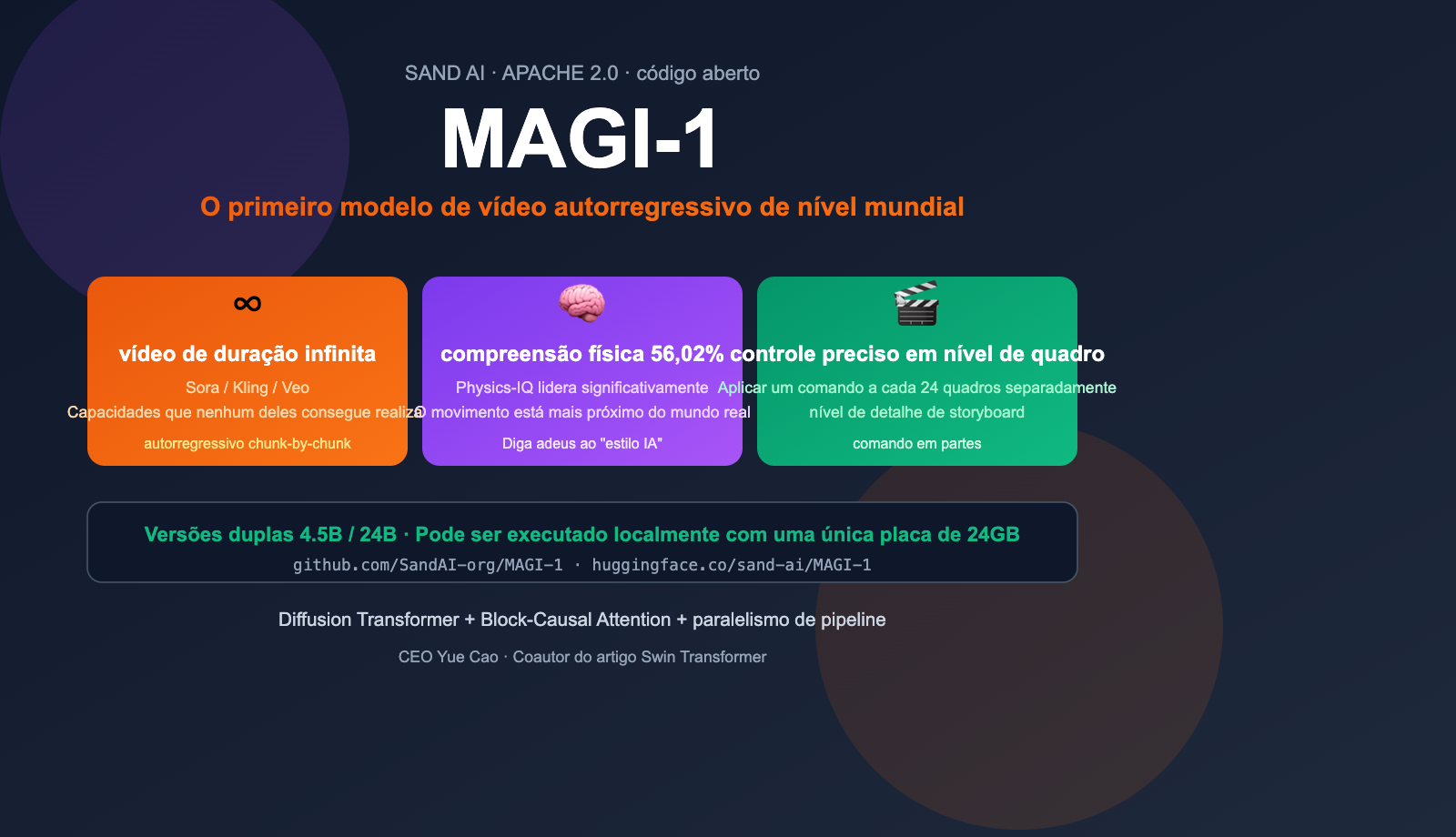

Se você tem visto o pessoal comentar sobre "Magi AI" ou "MAGI-1" ultimamente, mas não sabe exatamente o que o diferencia do Sora, Kling ou Veo, este artigo é o guia introdutório perfeito para você. O Magi AI é um modelo de geração de vídeos de código aberto muito interessante criado pela Sand AI — ele é o primeiro "modelo de geração de vídeo autorregressivo" de nível profissional do mundo e suporta a geração de vídeos de duração infinita.

Valor central: Ao terminar este artigo, você entenderá o que é o Magi AI, por que ele segue um caminho diferente do Sora/Kling, para que serve e como colocá-lo para rodar em 5 minutos.

O que é o Magi AI: Pontos principais

Definição rápida: Magi AI = Modelo de geração de vídeo de arquitetura híbrida "autorregressiva + difusão" de código aberto da Sand AI.

Ele foi desenvolvido pela equipe da Sand.ai (cujo CEO é Yue Cao, coautor do clássico artigo sobre Swin Transformer). O MAGI-1 foi lançado em código aberto em 21 de abril de 2025, com uma atualização para o Magi-1.1 em 2026. O código, os pesos e as ferramentas de inferência estão todos disponíveis no GitHub e no Hugging Face sob a licença Apache 2.0.

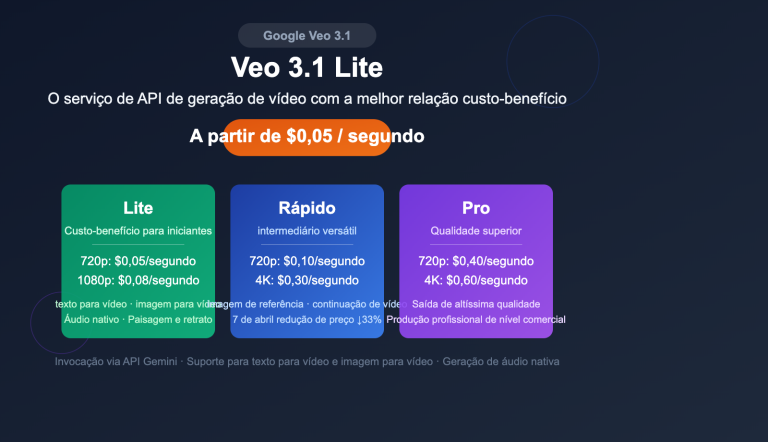

| Ponto | Descrição | Valor |

|---|---|---|

| Licença | Apache 2.0 | Totalmente comercializável |

| Escala do modelo | Versões duplas 4.5B / 24B | Do uso pessoal ao empresarial |

| Arquitetura central | Autorregressiva + Diffusion Transformer | Primeiro modelo de vídeo autorregressivo de ponta do mundo |

| Recurso matador | Geração de vídeo de duração infinita | Nem Sora nem Kling conseguem |

| Bloco base | Geração chunk-by-chunk de 24 quadros | Suporta geração em fluxo (streaming) |

| Compreensão física | Physics-IQ 56.02% | Supera significativamente os similares |

| Controlabilidade | Comando chunk-wise | Controle preciso por nível de quadro |

| GitHub | SandAI-org/MAGI-1 | Código completo + pesos |

💡 Entendimento rápido: O Magi AI segue um caminho completamente diferente do Sora, Veo e Kling. Esses modelos convencionais realizam a geração de todo o segmento de uma só vez, por isso possuem um limite de duração; já o Magi-1 realiza a geração autorregressiva por chunk, o que, teoricamente, permite que ele continue gerando indefinidamente. Essa é uma inovação verdadeiramente diferenciada no campo de vídeo por IA. Se você quiser testar e comparar os principais modelos de geração de vídeo atuais, pode usar o serviço proxy de API da APIYI (apiyi.com) para acessar o Veo, Kling, Wan e outros, e combinar com o Magi de código aberto rodando localmente — essa é a estratégia de comparação com o melhor custo-benefício.

Arquitetura técnica central do Magi AI

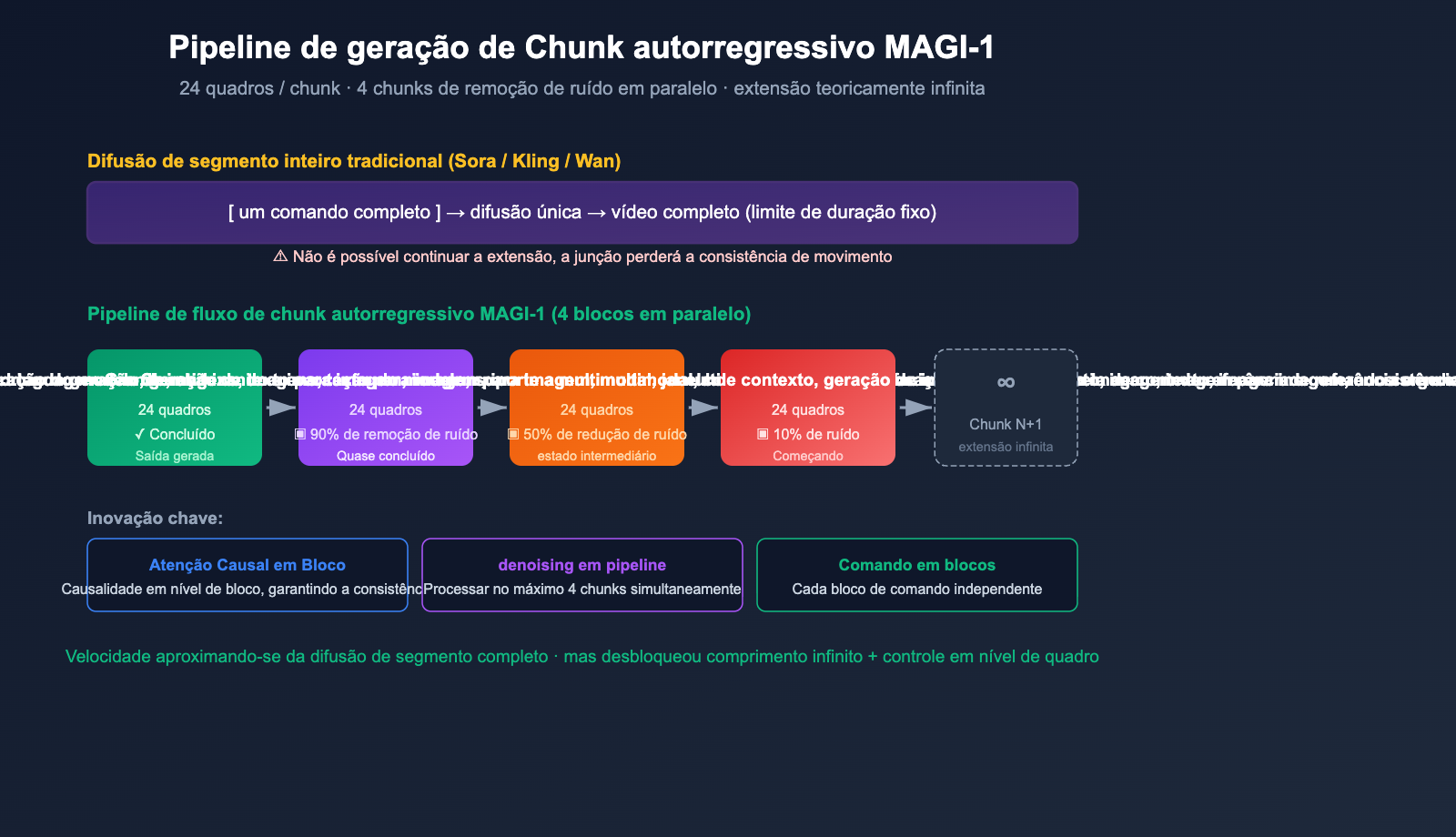

Para entender o diferencial do Magi AI, é preciso primeiro compreender seu mecanismo de "geração autorregressiva por blocos" (chunk) — este é o maior ponto de divergência em relação a todos os modelos de vídeo convencionais.

Geração autorregressiva chunk-by-chunk

A grande maioria dos modelos de vídeo atuais (Sora, Veo, Kling, Wan, etc.) segue a rota de difusão de vídeo completo:

[prompt de vídeo completo] → [difusão de remoção de ruído única] → [saída de vídeo completo]

O problema dessa abordagem é: o limite de duração é fixo. O Sora 1.0 suporta no máximo 60 segundos por vez, o Kling de 5 a 10 segundos; para durações maiores, é necessário "emendar" os clipes, o que frequentemente resulta na perda da consistência do movimento.

O Magi-1 adota uma rota híbrida de autorregressão + difusão em blocos:

prompt → 1º bloco (24 quadros) difusão de remoção de ruído → 2º bloco (24 quadros) → 3º bloco → ... → ∞

Dentro de cada bloco (chunk), a difusão de remoção de ruído ainda é usada para garantir a qualidade, mas entre os blocos ocorre a autorregressão — o bloco seguinte é gerado com base no anterior. Isso desbloqueia a capacidade de "vídeo de duração infinita", algo que outros modelos não conseguem fazer.

Pipeline paralelo: remoção de ruído em 4 blocos simultâneos

O que é ainda mais inteligente é que o Magi-1 não faz você esperar "o 1º bloco terminar completamente para começar o 2º". O design do seu pipeline suporta o processamento simultâneo de até 4 blocos — assim que o bloco atual atinge um certo nível de remoção de ruído, o próximo já pode começar a ser pré-processado. Isso faz com que a velocidade da geração autorregressiva não seja muito inferior à da difusão de vídeo completo.

Diffusion Transformer + Inovações múltiplas

A base do Magi-1 é a arquitetura Diffusion Transformer (DiT), que integra uma série de otimizações de eficiência de treinamento:

| Ponto técnico | Função |

|---|---|

| Block-Causal Attention | Atenção causal por blocos, garante consistência autorregressiva |

| Parallel Attention Block | Bloco de atenção paralela, aumenta a velocidade |

| QK-Norm + GQA | Estabilidade de treinamento + inferência eficiente |

| Sandwich Normalization in FFN | Estabilidade no treinamento de Modelos de Linguagem Grandes |

| SwiGLU | Função de ativação moderna |

| Softcap Modulation | Controla a explosão de pontuações de atenção |

Essa stack tecnológica é praticamente idêntica ao "arsenal moderno de Transformer" usado por LLMs de ponta como o Llama 3 e o Mistral — e é essa a razão fundamental pela qual o Magi-1 consegue atingir uma qualidade de vídeo de primeira linha em escalas de parâmetros como 4.5B/24B, que podem ser executadas localmente.

Versão dupla: 4.5B / 24B

| Versão | Quantidade de parâmetros | Cenário ideal | Requisitos de hardware |

|---|---|---|---|

| MAGI-1 4.5B | 4.5 B | Desenvolvedores independentes, experimentos locais | Roda em uma única GPU (24GB+) |

| MAGI-1 24B | 24 B | Implantação em produção, qualidade máxima | Múltiplas GPUs / Recomendado H100 |

A Sand AI disponibilizou ambos os modelos em código aberto. O objetivo do 4.5B é permitir que "desenvolvedores independentes também possam brincar", enquanto o 24B é o carro-chefe voltado para o desempenho máximo.

As capacidades principais do Magi AI

Capacidade 1: Geração de vídeo de duração infinita

Esta é a capacidade mais exclusiva do Magi-1 e algo que os principais modelos de vídeo atuais não conseguem fazer. A documentação oficial afirma claramente: "O Magi-1 é o único modelo em geração de vídeo por IA que oferece capacidades de extensão de vídeo infinita."

Significado prático: você pode fazer com que o Magi-1 gere um vídeo contínuo de 5 minutos, 10 minutos ou até 1 hora, com uma consistência de movimento e cenário muito superior aos métodos de "emenda". Isso é uma grande vantagem para curtas-metragens, anúncios longos e vídeos educacionais.

Capacidade 2: Compreensão física de alto nível

No benchmark Physics-IQ, o Magi-1 obteve 56,02%, superando significativamente todos os modelos similares atuais. O Physics-IQ mede a capacidade do modelo de prever "o que acontecerá a seguir no mundo físico" — para onde uma bola rolará, como a água fluirá, como as roupas balançarão.

Com uma compreensão física aprimorada, o "ar de IA" da imagem diminui, tornando-a muito mais próxima do movimento do mundo real.

Capacidade 3: Controle preciso em nível de quadro (Chunk-wise Prompting)

Como a geração é feita bloco a bloco (chunk-by-chunk), o Magi-1 permite que você forneça um comando separado para cada bloco de 24 quadros:

bloco 1: "um gato correndo na grama"

bloco 2: "o gato começa a pular"

bloco 3: "o gato é atraído por uma borboleta e para"

bloco 4: "o gato persegue a borboleta em direção ao céu"

Esse nível de controle refinado é quase impossível de alcançar em modelos de difusão tradicionais de segmento único. Ele reduz a carga de trabalho de "storyboard de vídeo longo" para um nível perfeitamente executável.

Capacidade 4: Poderoso Image-to-Video (I2V)

O Magi-1 tem um desempenho particularmente excelente em tarefas de imagem para vídeo. Com uma imagem estática + uma descrição de texto, ele consegue gerar um vídeo com alta consistência em relação à imagem e movimentos naturais. Isso é mais controlável do que o T2V (texto para imagem) puro, tornando-o mais adequado para cenários de produção real.

Capacidade 5: Excelente seguimento de comando

A Sand AI testou especificamente o seguimento de instruções no artigo, e os resultados mostram que a capacidade de seguir comandos do Magi-1 é significativamente melhor que a do Wan 2.1 e do HunyuanVideo, podendo competir de igual para igual com o modelo fechado Hailuo i2v-01. Isso significa que o comando que você escreve será realmente levado em consideração, em vez de o modelo apenas "improvisar livremente".

Comparativo do Magi AI com os principais modelos de vídeo

Uma das perguntas que mais recebemos dos novos usuários é: "Como o Magi se compara ao Sora, Kling e Wan?". Abaixo, apresentamos uma tabela comparativa clara.

| Dimensão de comparação | MAGI-1 | Sora 2 | Kling 2 | Wan 2.6 | HunyuanVideo |

|---|---|---|---|---|---|

| Open Source | ✅ Apache 2.0 | ❌ | ❌ | ✅ | ✅ |

| Arquitetura | Autorregressivo + Difusão | Difusão | Difusão | Difusão | Difusão |

| Duração infinita | ✅ Único suporte | ❌ | ❌ | ❌ | ❌ |

| Controle nível Chunk | ✅ | ❌ | ❌ | ❌ | ❌ |

| Parâmetros | 4.5B / 24B | Não divulgado | Não divulgado | 14B | 13B |

| Physics-IQ | 56.02% | — | — | Médio | Médio |

| Aderência ao comando | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| Execução local | ✅ 4.5B single-GPU | ❌ | ❌ | ✅ | ✅ |

| Uso comercial | ✅ Apache 2.0 | ⚠ Restrito | ⚠ Por plano | ✅ | ⚠ Ver licença |

🎯 Conclusão: Se você busca "qualidade máxima + vídeos curtos de uma só vez", o Sora 2 / Kling 2 ainda são a primeira escolha; se você precisa de "código aberto + vídeos longos + controle por frames", o Magi AI é a única resposta atual; se você quer "executar localmente e usar API para comparar", recomendamos a implementação local do MAGI-1 4.5B e a utilização do serviço proxy de API APIYI (apiyi.com) para invocar modelos de código fechado como Veo / Sora simultaneamente, realizando o teste comparativo mais completo possível.

Primeiros passos com o Magi AI

Método 1: Teste online via Web (mais rápido)

A maneira mais simples é acessar diretamente o Web App oficial:

- Acesso:

magi.sand.ai/app/projects - Basta registrar uma conta para começar

- Sem necessidade de configurar ambiente, roda direto no navegador

Ideal para usuários que querem "ver o resultado antes de decidir".

Método 2: Implementação local via GitHub

Se você deseja realizar pesquisas ou usar a ferramenta a longo prazo localmente, clone o código-fonte do GitHub:

# Clonar o repositório

git clone https://github.com/SandAI-org/MAGI-1.git

cd MAGI-1

# Instalar dependências

pip install -r requirements.txt

# Baixar pesos 4.5B (aprox. 9GB)

huggingface-cli download sand-ai/MAGI-1 --local-dir ./ckpt/

# Executar um exemplo mínimo

python inference.py \

--model_path ./ckpt/4.5B_base \

--prompt "A cat walking on the snow, cinematic lighting" \

--output ./output/cat.mp4 \

--num_chunks 4

💡 Dica: Para a primeira execução local, recomendamos usar o modelo 4.5B + GPU com 24GB de VRAM (RTX 3090/4090 são suficientes). Embora a versão 24B ofereça melhor qualidade, ela exige um cluster de H100, elevando o custo em uma ordem de grandeza.

Método 3: Baixar pesos diretamente do Hugging Face

huggingface-cli download sand-ai/MAGI-1 \

--include "ckpt/magi/4.5B_base/*" \

--local-dir ./

Os pesos são armazenados no formato padrão safetensors e podem ser carregados diretamente via diffusers ou transformers.

Fluxo de trabalho recomendado: Magi local + API de modelos fechados

Para desenvolvedores, o fluxo de trabalho mais prático é:

- Executar MAGI-1 4.5B localmente: Para aproveitar capacidades únicas como vídeos de duração infinita e controle por frames.

- Invocar APIs do Veo / Sora / Kling: Para buscar a máxima qualidade de imagem em clipes individuais.

- Acesso unificado: Utilize o serviço proxy de API APIYI (apiyi.com) para acessar os principais modelos de vídeo internacionais em um só lugar, evitando problemas de conta, rede e faturamento.

- Comparação horizontal: Execute o mesmo comando em ambos os sistemas e escolha a saída que melhor se adapta à sua tarefa.

Para quem o Magi AI é indicado

Cenário 1: Criadores que precisam de vídeos longos

Séries curtas, anúncios longos, vídeos educacionais, documentários — nesses cenários, a solução tradicional de "emendar clipes de 5 segundos" atingiu seu limite. A geração de duração infinita do Magi-1 é a única solução pronta para uso atualmente.

Cenário 2: Diretores que precisam de controle preciso de storyboard

O "chunk-wise prompting" (comando por blocos) permite que você controle cada segmento da cena como se estivesse escrevendo um storyboard. Isso é extremamente útil para criadores de vídeos curtos, artistas de storyboard de animação e diretores de publicidade.

Cenário 3: Pesquisadores de geração de vídeo / Colaboradores de código aberto

Com licença Apache 2.0, pesos completos, artigos científicos e repositório no GitHub, o Magi é atualmente a melhor implementação de referência de código aberto para o estudo de "geração de vídeo autorregressiva". Se você está pesquisando nessa área, o Magi-1 é um projeto praticamente obrigatório de ler e executar.

Cenário 4: Pequenas e médias equipes que desejam implantação local

Modelos de código fechado como Sora e Kling só podem ser usados via API, o que significa que você não tem controle total sobre os dados. O Magi-1 utiliza a licença Apache 2.0, os pesos podem ser baixados e ele pode ser totalmente implantado em sua própria nuvem privada, sendo muito amigável para setores sensíveis a dados (saúde, finanças, educação).

Perguntas frequentes sobre o Magi AI

Q1: O Magi AI é gratuito? Pode ser usado comercialmente?

É totalmente gratuito e pode ser usado comercialmente sob a licença Apache 2.0. Esta é uma das maiores vantagens do Magi em relação a modelos de código fechado como Sora e Kling. Você só precisa arcar com os custos de hardware/GPU, sem taxas de invocação do modelo, sem mensalidades e sem restrições comerciais.

Q2: Qual é melhor: Magi-1, Wan 2.6 ou HunyuanVideo?

De acordo com os dados comparativos do artigo da Sand AI, o Magi-1 supera o Wan 2.1 e o HunyuanVideo em três indicadores: compreensão física (Physics-IQ), seguimento de comando e qualidade de movimento. No entanto, o Wan 2.6 é uma versão mais recente, com um ecossistema comunitário e uma cadeia de ferramentas mais maduros. Conselho real: use o Wan 2.6 para vídeos curtos e alta qualidade de imagem, e o Magi-1 para vídeos longos e cenários de controle preciso; eles não são excludentes.

Q3: O “vídeo de duração infinita” é realmente infinito?

Teoricamente, sim. O mecanismo de geração de blocos autorregressivos do Magi-1 não possui um limite superior de duração, você pode deixá-lo gerando continuamente. As limitações reais vêm principalmente da memória de vídeo (VRAM) e do tempo: a VRAM só precisa salvar o estado dos blocos atuais, então não há risco de estouro; já o tempo cresce linearmente — um vídeo de 5 minutos leva cerca de 5 vezes mais tempo que um de 1 minuto.

Q4: Qual é a diferença entre a versão 4.5B e a 24B?

A 4.5B é o "modelo de vídeo autorregressivo mais potente que uma placa de vídeo de consumo pode rodar", com qualidade superior à maioria dos primeiros modelos de código fechado, mas ainda abaixo dos modelos topo de linha como Sora 2 e Kling 2. A versão 24B é a que realmente compete no topo, aproximando-se da qualidade dos modelos fechados de elite. Se você é um criador individual ou pesquisador, a 4.5B é suficiente; para produção comercial, recomenda-se a 24B com várias placas H100.

Q5: Preciso substituir o Sora / Kling que uso atualmente pelo Magi?

Não precisa substituir, a recomendação é usá-los de forma complementar. Sora e Kling ainda possuem vantagens na qualidade de imagem de cenas únicas e na linguagem cinematográfica, enquanto o Magi tem vantagens exclusivas em duração, controle e autonomia de código aberto. A melhor estratégia é: use a APIYI (apiyi.com) para acessar modelos estrangeiros de código fechado para curtas de alta qualidade, e use o Magi implantado localmente para vídeos longos e controle refinado, escolhendo a ferramenta mais adequada para cada cenário.

Q6: Como desenvolvedores chineses podem baixar os pesos do Magi-1?

Basta baixar diretamente no Hugging Face (huggingface.co/sand-ai/MAGI-1). Se encontrar problemas de rede, você pode usar o espelho hf-mirror ou o espelho do ModelScope. A Sand AI é uma startup chinesa de IA muito amigável aos desenvolvedores, e a comunidade possui uma grande quantidade de tutoriais e discussões em chinês.

Resumo

O Magi AI é um dos projetos mais inovadores no campo da geração de vídeo open-source para 2025-2026. Ele representa três pilares fundamentais:

- A viabilidade da geração de vídeo autorregressiva foi validada: O Magi-1 é o primeiro modelo de vídeo autorregressivo do mundo a atingir um nível de elite, provando que a abordagem "chunk-by-chunk + Difusão" é um caminho viável, além da "difusão de segmento completo".

- Vídeos de duração infinita deixam a ficção científica e tornam-se realidade: Esta é uma capacidade que Sora, Kling e Veo ainda não alcançaram, e o Magi a entrega de forma open-source pela primeira vez.

- O ecossistema de vídeo open-source foi elevado a um novo patamar: Com licença Apache 2.0, pesos completos e uma versão de 4.5B para hardware de consumo, ele torna realidade o sonho de que "desenvolvedores individuais também podem usar modelos de vídeo de ponta".

🚀 Sugestão de ação: Se você quer experimentar as capacidades do Magi AI hoje mesmo, o caminho mais rápido é: primeiro, acesse

magi.sand.ai/app/projectspara criar uma conta e testar online; segundo, se gostar dos resultados, siga o README do GitHub para implantar a versão 4.5B localmente; terceiro, compare as saídas do Magi (local) com as do Veo / Sora / Kling (acessados via serviço proxy de API da APIYI em apiyi.com) para montar sua própria "caixa de ferramentas de modelos". Assim, seja para criar vídeos longos, storyboards detalhados ou buscar a maior qualidade em um único segmento, você terá a ferramenta certa à disposição.

Autor: Equipe APIYI — Focada em fornecer acesso estável aos principais Modelos de Linguagem Grande de IA para desenvolvedores. Visite apiyi.com para saber mais.

Referências

-

Repositório principal do MAGI-1 no GitHub

- Link:

github.com/SandAI-org/MAGI-1 - Descrição: Código-fonte, scripts de download de pesos e exemplos de inferência.

- Link:

-

Cartão do modelo MAGI-1 no Hugging Face

- Link:

huggingface.co/sand-ai/MAGI-1 - Descrição: Pesos e documentação para as versões 4.5B / 24B.

- Link:

-

Artigo oficial do MAGI-1 (PDF)

- Link:

static.magi.world/static/files/MAGI_1.pdf - Descrição: Detalhes técnicos completos e resultados de benchmarks.

- Link:

-

Página oficial de apresentação do Magi da Sand AI

- Link:

sand.ai/magi - Descrição: Página principal do projeto e apresentação do produto.

- Link:

-

Web App online do MAGI-1

- Link:

magi.sand.ai/app/projects - Descrição: Teste diretamente pelo navegador.

- Link:

-

Wiki do ComfyUI – Relatório sobre o MAGI-1

- Link:

comfyui-wiki.com/en/news/2025-04-23-magi-1-autoregressive-video-generation-model-released - Descrição: Relatório detalhado de terceiros e análise comparativa.

- Link: