Falls Sie in letzter Zeit Diskussionen über "Magi AI" oder "MAGI-1" verfolgt haben, sich aber fragen, worin der Unterschied zu Sora, Kling oder Veo besteht, ist dieser Artikel genau das Richtige für Sie. Magi AI ist ein faszinierendes, von Sand AI quelloffenes Videogenerierungsmodell – es ist das weltweit erste "autoregressive Videogenerierungsmodell" auf Top-Niveau, das zudem die Generierung von Videos unendlicher Länge unterstützt.

Kernnutzen: Nach dem Lesen dieses Artikels wissen Sie, was Magi AI ist, warum es einen anderen Weg als Sora/Kling einschlägt, wofür es eingesetzt werden kann und wie Sie es in 5 Minuten zum Laufen bringen.

Was ist Magi AI? Die wichtigsten Punkte

Kurz definiert: Magi AI = Ein von Sand AI quelloffenes Videogenerierungsmodell, das auf einer hybriden "autoregressiven + Diffusions"-Architektur basiert.

Es wurde vom Team von Sand.ai entwickelt (CEO ist Yue Cao, Mitautor des klassischen Swin-Transformer-Papers). Am 21. April 2025 wurde MAGI-1 erstmals quelloffen veröffentlicht und 2026 auf Magi-1.1 aktualisiert. Code, Gewichte und Inferenz-Tools sind vollständig unter der Apache 2.0-Lizenz auf GitHub und Hugging Face verfügbar.

| Punkt | Beschreibung | Wert |

|---|---|---|

| Open-Source-Lizenz | Apache 2.0 | Voll kommerziell nutzbar |

| Modellgröße | 4.5B / 24B Dual-Version | Von Privatpersonen bis Unternehmen |

| Kernarchitektur | Autoregressiv + Diffusion Transformer | Erstes autoregressives Top-Videomodell weltweit |

| Killer-Feature | Generierung unendlicher Videolänge | Sora/Kling können das nicht |

| Basis-Block | 24-Frame-Chunk-by-Chunk-Generierung | Unterstützt Streaming-Generierung |

| Physikverständnis | Physics-IQ 56.02% | Übertrifft Vergleichsmodelle deutlich |

| Steuerbarkeit | Chunk-weise Eingabeaufforderung | Präzise Steuerung auf Frame-Ebene |

| GitHub | SandAI-org/MAGI-1 | Vollständiger Code + Gewichte |

💡 Schnell verstanden: Magi AI verfolgt einen völlig anderen Ansatz als Sora, Veo oder Kling. Diese gängigen Modelle generieren das gesamte Segment in einem Durchgang, weshalb die Länge begrenzt ist. Magi-1 hingegen generiert Chunk für Chunk autoregressiv, was theoretisch eine unendliche Fortsetzung ermöglicht. Dies ist eine echte differenzierte Innovation im Bereich der KI-Videos. Wenn Sie die aktuellen führenden Videogenerierungsmodelle vergleichen möchten, können Sie über den API-Proxy-Dienst APIYI (apiyi.com) Veo, Kling, Wan usw. zentral einbinden und in Kombination mit dem quelloffenen Magi lokal ausführen – das ist die kosteneffizienteste Vergleichsmethode.

Die technische Kernarchitektur von Magi AI

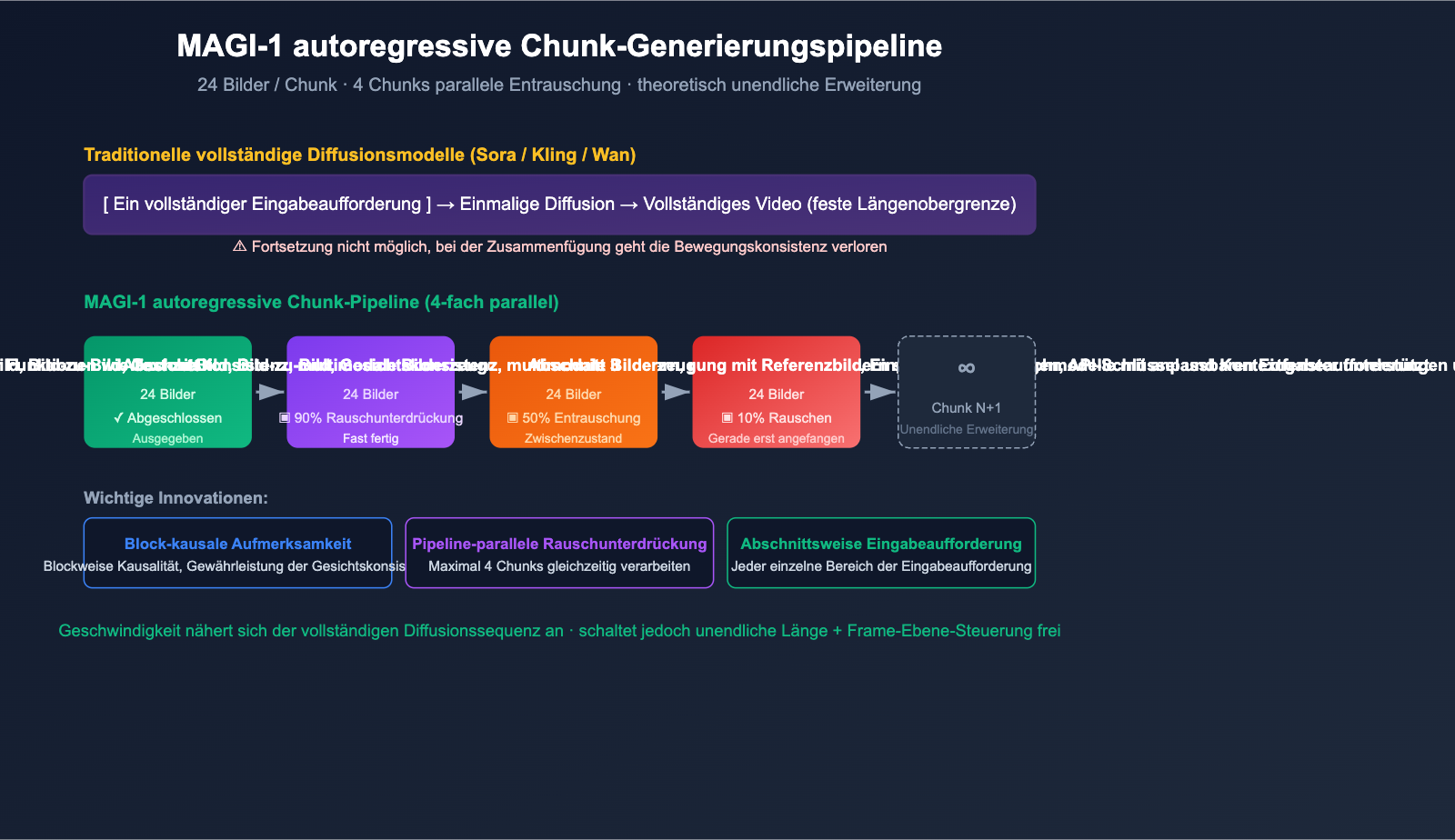

Um die Differenzierung von Magi AI zu verstehen, muss man zunächst den Mechanismus der "autoregressiven Chunk-Generierung" betrachten – dies ist der größte Unterschied zu allen gängigen Videomodellen.

Autoregressive Chunk-by-Chunk-Generierung

Die überwiegende Mehrheit der gängigen Videomodelle (Sora, Veo, Kling, Wan usw.) verfolgt den Ansatz der vollständigen Diffusionssequenz:

[Vollständiger Video-Prompt] → [Einmalige Diffusions-Entrauschung] → [Vollständige Videoausgabe]

Das Problem bei diesem Ansatz: Die maximale Länge ist fest begrenzt. Sora 1.0 schafft maximal 60 Sekunden, Kling 5-10 Sekunden. Längere Videos erfordern ein "Zusammensetzen" (Stitching), was jedoch häufig die Bewegungskonsistenz beeinträchtigt.

Magi-1 hingegen nutzt einen hybriden Ansatz aus Autoregressivität und blockweiser Diffusion:

Prompt → 1. Block (24 Frames) Diffusions-Entrauschung → 2. Block (24 Frames) → 3. Block → ... → ∞

Innerhalb jedes Chunks sorgt die Diffusion weiterhin für hohe Qualität, aber die Chunks selbst sind autoregressiv miteinander verknüpft – der nachfolgende Block baut auf dem vorherigen auf. Dies ermöglicht "unendlich lange Videos", eine Fähigkeit, die andere Modelle nicht bieten.

Pipeline-Parallelität: 4 Blöcke bei gleichzeitiger Entrauschung

Besonders clever: Magi-1 zwingt Sie nicht dazu, zu warten, bis "Block 1 vollständig fertig ist, bevor Block 2 beginnt". Das Pipeline-Design unterstützt die gleichzeitige Verarbeitung von bis zu 4 Chunks – sobald der aktuelle Block einen gewissen Entrauschungsgrad erreicht hat, kann der nächste Block bereits vorgewärmt werden. Dadurch ist die autoregressive Generierung kaum langsamer als die vollständige Diffusionssequenz.

Diffusion Transformer + zahlreiche Innovationen

Magi-1 basiert auf der Diffusion Transformer (DiT) Architektur und integriert zahlreiche Optimierungen für die Trainingseffizienz:

| Technischer Punkt | Funktion |

|---|---|

| Block-Causal Attention | Blockweise kausale Aufmerksamkeit, sichert autoregressive Konsistenz |

| Parallel Attention Block | Parallele Aufmerksamkeitsblöcke zur Beschleunigung |

| QK-Norm + GQA | Trainingsstabilität + effiziente Inferenz |

| Sandwich Normalization in FFN | Stabilität beim Training großer Sprachmodelle |

| SwiGLU | Moderne Aktivierungsfunktion |

| Softcap Modulation | Kontrolle von Attention-Score-Explosionen |

Dieser Tech-Stack entspricht nahezu exakt dem "modernen Transformer-Arsenal", das auch führende LLMs wie Llama 3 oder Mistral verwenden – dies ist der Grund, warum Magi-1 bei einer Parametergröße von 4,5B/24B (die auf lokaler Hardware ausführbar ist) eine erstklassige Videoqualität erreicht.

Zwei Versionen: 4.5B / 24B

| Version | Parameteranzahl | Geeignet für | Hardware-Anforderungen |

|---|---|---|---|

| MAGI-1 4.5B | 4,5 Mrd. | Einzelentwickler, lokale Experimente | Auf einer Karte ausführbar (24GB+) |

| MAGI-1 24B | 24 Mrd. | Produktion, höchste Qualität | Multi-GPU / H100 empfohlen |

Sand AI hat beide Versionen gleichzeitig als Open Source veröffentlicht. Die 4.5B-Variante soll es "unabhängigen Entwicklern ermöglichen, damit zu experimentieren", während die 24B-Version das Flaggschiff für Spitzenleistungen ist.

Die Kernkompetenzen von Magi AI

Fähigkeit 1: Videogenerierung mit unendlicher Länge

Dies ist die einzigartigste Fähigkeit von Magi-1, die andere gängige Videomodelle nicht bieten können. Die offizielle Dokumentation besagt ausdrücklich: „Magi-1 ist das einzige Modell in der KI-Videogenerierung, das Funktionen zur unendlichen Videoerweiterung bietet.“

Praktische Bedeutung: Sie können Magi-1 ein 5-minütiges, 10-minütiges oder sogar einstündiges kontinuierliches Video generieren lassen, wobei die Konsistenz von Bewegungen und Szenen weitaus besser ist als bei der „Stückwerk“-Methode. Dies ist ein enormer Vorteil für Kurzfilme, lange Werbespots und Lehrvideos.

Fähigkeit 2: Erstklassiges physikalisches Verständnis

Im Physics-IQ-Benchmark erreichte Magi-1 56,02 % und übertraf damit alle aktuellen vergleichbaren Modelle bei weitem. Physics-IQ testet die Fähigkeit des Modells, vorherzusagen, „wie die physische Welt weitergeht“ – wohin ein Ball rollt, wie Wasser fließt oder wie sich Kleidung bewegt.

Durch das verbesserte physikalische Verständnis wirkt das Bild weniger „künstlich“ und die Bewegungen sind deutlich näher an der realen Welt.

Fähigkeit 3: Frame-genaue Steuerung (Chunk-wise Prompting)

Da die Generierung blockweise (Chunk-by-Chunk) erfolgt, unterstützt Magi-1 für jeden 24-Frame-Block individuelle Eingabeaufforderungen:

chunk 1: "Eine Katze rennt über eine Wiese"

chunk 2: "Die Katze beginnt zu springen"

chunk 3: "Die Katze wird von einem Schmetterling abgelenkt und hält an"

chunk 4: "Die Katze jagt den Schmetterling in den Himmel"

Eine solch präzise Steuerung ist bei herkömmlichen Modellen, die das gesamte Segment auf einmal diffundieren, nahezu unmöglich. Dies reduziert den Arbeitsaufwand für das „Storyboarding von langen Videos“ auf ein technisch umsetzbares Niveau.

Fähigkeit 4: Leistungsstarkes Bild-zu-Video (I2V)

Magi-1 zeigt besonders bei Bild-zu-Video-Aufgaben herausragende Leistungen. Mit einem statischen Bild und einer Textbeschreibung kann es Videos generieren, die hochgradig konsistent zum Bild sind und natürliche Bewegungen aufweisen. Dies ist kontrollierbarer als reines Text-zu-Bild (T2V) und eignet sich besser für reale Produktionsszenarien.

Fähigkeit 5: Erstklassige Befolgung von Eingabeaufforderungen

Sand AI hat in seinem Paper speziell die Befolgung von Anweisungen (Instruction Following) getestet. Die Ergebnisse zeigen, dass die Fähigkeit von Magi-1, Anweisungen zu befolgen, deutlich besser ist als bei Wan 2.1 und HunyuanVideo und mit dem Closed-Source-Modell Hailuo i2v-01 mithalten kann. Das bedeutet, dass Ihre Eingabeaufforderungen tatsächlich ernst genommen werden, anstatt dass das Modell „frei interpretiert“.

Magi AI im Vergleich zu führenden Videomodellen

Viele neue Nutzer stellen sich die Frage: „Wie schlägt sich Magi im Vergleich zu Sora, Kling oder Wan?“ Hier ist eine übersichtliche Vergleichstabelle:

| Vergleichsdimension | MAGI-1 | Sora 2 | Kling 2 | Wan 2.6 | HunyuanVideo |

|---|---|---|---|---|---|

| Open Source | ✅ Apache 2.0 | ❌ | ❌ | ✅ | ✅ |

| Architektur | Autoregressiv + Diffusion | Diffusion | Diffusion | Diffusion | Diffusion |

| Unbegrenzte Länge | ✅ Einzigartig | ❌ | ❌ | ❌ | ❌ |

| Chunk-Steuerung | ✅ | ❌ | ❌ | ❌ | ❌ |

| Parameteranzahl | 4.5B / 24B | Nicht öffentlich | Nicht öffentlich | 14B | 13B |

| Physics-IQ | 56.02% | — | — | Mittel | Mittel |

| Prompt-Befolgung | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| Lokal ausführbar | ✅ 4.5B Einzelkarte | ❌ | ❌ | ✅ | ✅ |

| Kommerziell nutzbar | ✅ Apache 2.0 | ⚠ Eingeschränkt | ⚠ Nach Plan | ✅ | ⚠ Siehe Lizenz |

🎯 Fazit: Wenn Sie „höchste Bildqualität + kurze Clips aus einer Hand“ suchen, bleiben Sora 2 / Kling 2 die erste Wahl. Wenn Sie „Open Source + lange Videos + Frame-genaue Steuerung“ benötigen, ist Magi AI aktuell die einzige Antwort. Wenn Sie „lokal ausführen und per API vergleichen“ möchten, empfehlen wir die lokale Bereitstellung von MAGI-1 4.5B in Kombination mit dem API-Proxy-Dienst APIYI (apiyi.com), um Modelle wie Veo oder Sora für umfassende Vergleichstests anzubinden.

Magi AI: Schnelleinstieg

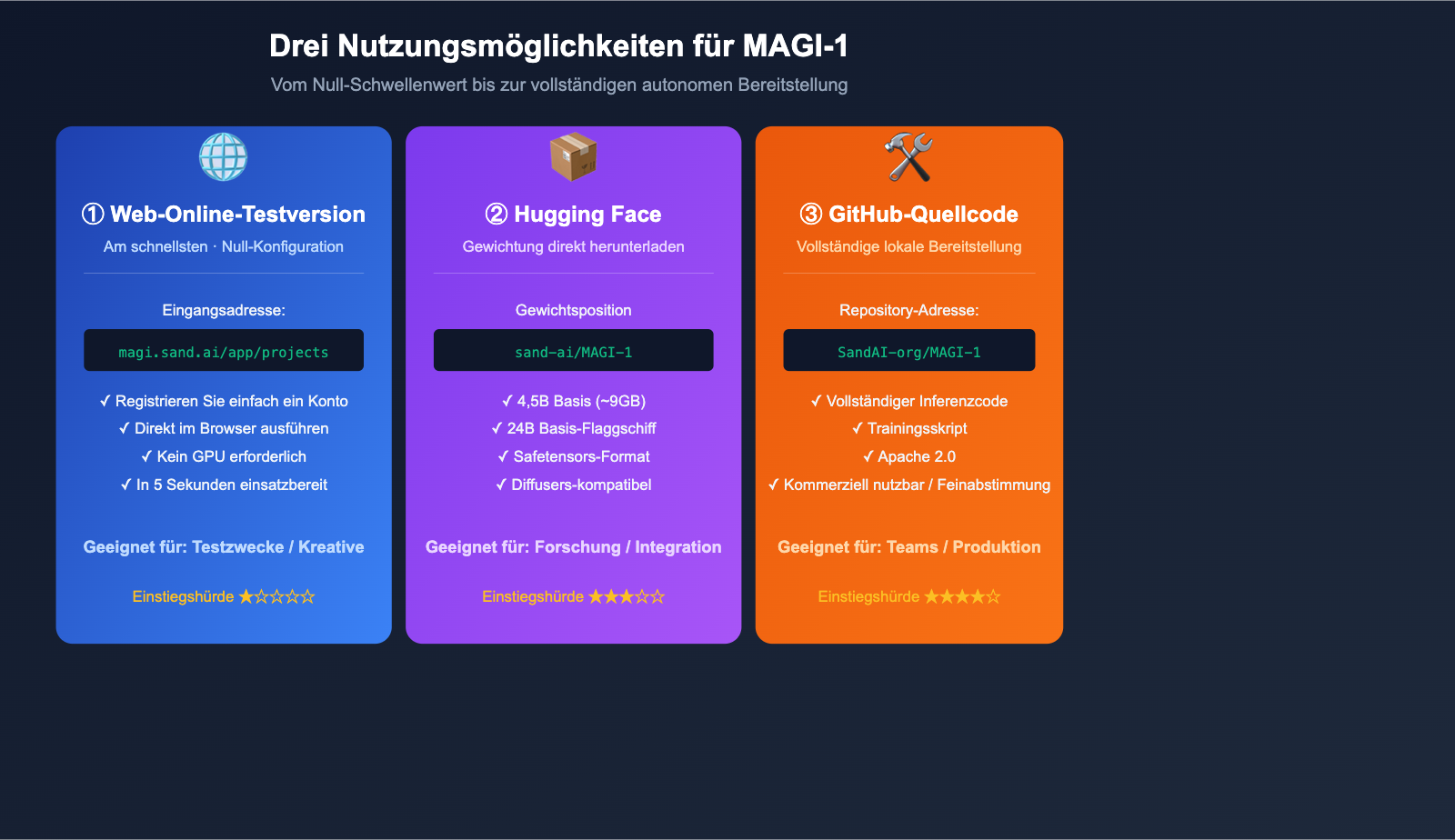

Methode 1: Web-Test (Am schnellsten)

Der einfachste Weg ist die Nutzung der offiziellen Web-App:

- URL:

magi.sand.ai/app/projects - Registrieren und loslegen.

- Keine Konfiguration erforderlich, läuft direkt im Browser.

Ideal für Nutzer, die „erst einmal die Ergebnisse sehen“ wollen.

Methode 2: Lokale Bereitstellung via GitHub

Für Forschungszwecke oder den langfristigen lokalen Einsatz können Sie den Quellcode von GitHub klonen:

# Repository klonen

git clone https://github.com/SandAI-org/MAGI-1.git

cd MAGI-1

# Abhängigkeiten installieren

pip install -r requirements.txt

# 4.5B-Gewichte herunterladen (ca. 9 GB)

huggingface-cli download sand-ai/MAGI-1 --local-dir ./ckpt/

# Ein minimales Beispiel ausführen

python inference.py \

--model_path ./ckpt/4.5B_base \

--prompt "A cat walking on the snow, cinematic lighting" \

--output ./output/cat.mp4 \

--num_chunks 4

💡 Empfehlung: Für den ersten lokalen Test empfehlen wir das 4.5B-Modell mit einer Grafikkarte mit 24 GB VRAM (RTX 3090/4090 reicht aus). Die 24B-Version bietet zwar eine höhere Qualität, erfordert jedoch mehrere H100-GPUs, was die Kosten erheblich steigert.

Methode 3: Gewichte direkt von Hugging Face laden

huggingface-cli download sand-ai/MAGI-1 \

--include "ckpt/magi/4.5B_base/*" \

--local-dir ./

Die Gewichte liegen im Standard-Safetensors-Format vor und können direkt mit diffusers oder transformers geladen werden.

Empfohlener Workflow: Magi lokal + führende geschlossene APIs im Vergleich

Für Entwickler ist dieser Workflow am effizientesten:

- Lokale Ausführung von MAGI-1 4.5B: Für unbegrenzte Videolänge, Frame-Steuerung und andere einzigartige Funktionen.

- API-Aufruf von Veo / Sora / Kling: Für maximale Bildqualität bei einzelnen Clips.

- Zentrale Anbindung: Nutzen Sie den API-Proxy-Dienst APIYI (apiyi.com), um internationale Top-Videomodelle zentral anzubinden und Probleme mit Konten, Netzwerken oder Abrechnungen zu vermeiden.

- Vergleichsanalyse: Führen Sie beide Ansätze mit demselben Prompt aus und wählen Sie das Ergebnis, das am besten zu Ihrer Aufgabe passt.

Für wen ist Magi AI geeignet?

Szenario 1: Kreative, die lange Videos benötigen

Kurzfilme, lange Werbespots, Lehrvideos, Dokumentationen – bei diesen Formaten stößt der traditionelle Ansatz, alle 5 Sekunden einen neuen Clip zu schneiden, an seine Grenzen. Die Generierung unbegrenzter Länge von Magi-1 ist derzeit die einzige sofort einsatzbereite Lösung.

Szenario 2: Regisseure, die eine präzise Storyboard-Kontrolle benötigen

Dank "chunk-wise prompting" können Sie jeden Bildabschnitt so präzise steuern, als würden Sie ein Storyboard schreiben. Dies ist äußerst nützlich für Kurzvideo-Ersteller, Animations-Storyboard-Künstler und Werberegisseure.

Szenario 3: Forscher im Bereich Videogenerierung / Open-Source-Mitwirkende

Mit der Apache 2.0-Lizenz, vollständigen Gewichten, dem zugehörigen Paper und dem GitHub-Repository ist Magi die derzeit beste Open-Source-Referenzimplementierung für die Erforschung der "autoregressiven Videogenerierung". Wenn Sie in diesem Bereich forschen, ist Magi-1 ein Projekt, das man gelesen und ausprobiert haben muss.

Szenario 4: Kleine und mittlere Teams mit Bedarf an lokaler Bereitstellung

Geschlossene Modelle wie Sora oder Kling können nur über APIs genutzt werden, was bedeutet, dass man die volle Kontrolle über die Daten verliert. Magi-1 steht unter der Apache 2.0-Lizenz, die Gewichte sind herunterladbar und es kann vollständig in der eigenen privaten Cloud bereitgestellt werden, was besonders für datensensible Branchen (Gesundheitswesen, Finanzen, Bildung) sehr vorteilhaft ist.

Häufig gestellte Fragen zu Magi AI

Q1: Ist Magi AI kostenlos? Kann es kommerziell genutzt werden?

Es ist komplett kostenlos und unter der Apache 2.0-Lizenz vollständig kommerziell nutzbar. Dies ist einer der größten Vorteile von Magi gegenüber geschlossenen Modellen wie Sora oder Kling. Sie tragen lediglich die Kosten für Hardware/GPU-Rechenleistung; es fallen keine API-Gebühren, keine monatlichen Kosten und keine kommerziellen Einschränkungen an.

Q2: Welches Modell ist besser: Magi-1, Wan 2.6 oder HunyuanVideo?

Laut den Vergleichsdaten im Sand-AI-Paper übertrifft Magi-1 die Modelle Wan 2.1 und HunyuanVideo in den drei Kategorien Physics-IQ (physikalisches Verständnis), Prompt-Befolgung und Bewegungsqualität. Wan 2.6 ist jedoch eine neuere Version mit einem ausgereifteren Community-Ökosystem und Toolchain. Unsere Empfehlung: Nutzen Sie Wan 2.6 für Kurzvideos und Szenen mit hoher Bildqualität, und Magi-1 für lange Videos und präzise Steuerung – beide Modelle ergänzen sich hervorragend.

Q3: Ist „unbegrenzte Videolänge“ wirklich unbegrenzt?

Theoretisch ja. Der autoregressive Chunk-Generierungsmechanismus von Magi-1 hat keine inhärente Längenbeschränkung; Sie können die Generierung theoretisch endlos fortsetzen. Praktische Einschränkungen ergeben sich hauptsächlich durch den Grafikspeicher (VRAM) und die Zeit: Der VRAM muss nur den Status der aktuellen Chunks speichern, daher gibt es keinen Überlauf. Die Zeit wächst jedoch linear – ein 5-minütiges Video benötigt etwa fünfmal so viel Zeit wie ein 1-minütiges.

Q4: Wie groß ist der Unterschied zwischen der 4.5B- und der 24B-Version?

Die 4.5B-Version ist das "leistungsstärkste autoregressive Videomodell, das auf Consumer-Grafikkarten läuft". Die Qualität übertrifft bereits die meisten frühen geschlossenen Modelle, liegt aber noch hinter Spitzenmodellen wie Sora 2 oder Kling 2 zurück. Die 24B-Version ist das Modell für höchste Ansprüche und nähert sich in der Qualität den führenden geschlossenen Modellen an. Für private Projekte oder Forschung reicht die 4.5B-Version völlig aus; für die kommerzielle Produktion empfehlen wir 24B in Kombination mit mehreren H100-GPUs.

Q5: Muss ich mein aktuelles Sora / Kling durch Magi ersetzen?

Sie müssen nicht ersetzen, sondern sollten ergänzend arbeiten. Sora und Kling bieten weiterhin Vorteile bei der Bildqualität einzelner Segmente und der Filmsprache, während Magi bei Länge, Kontrollierbarkeit und Open-Source-Autonomie punktet. Die optimale Strategie: Nutzen Sie APIYI (apiyi.com), um internationale geschlossene Modelle für hochwertige Kurzfilme anzubinden, und setzen Sie Magi lokal für lange Videos und präzise Steuerung ein – wählen Sie das Werkzeug, das am besten zum jeweiligen Szenario passt.

Q6: Wie können chinesische Entwickler die Gewichte von Magi-1 herunterladen?

Laden Sie diese einfach direkt von Hugging Face herunter (huggingface.co/sand-ai/MAGI-1). Bei Netzwerkproblemen können Sie hf-mirror oder ModelScope-Spiegelserver verwenden. Sand AI ist ein chinesisches KI-Startup, das sehr entwicklerfreundlich ist; in der Community finden sich zahlreiche Tutorials und Diskussionen auf Chinesisch.

Zusammenfassung

Magi AI ist eines der innovativsten Open-Source-Projekte im Bereich der Videogenerierung für den Zeitraum 2025-2026. Es steht für drei wesentliche Durchbrüche:

- Validierung der autoregressiven Videogenerierung: Magi-1 ist das weltweit erste autoregressive Videomodell auf Top-Niveau. Es beweist, dass der Ansatz „Chunk-by-Chunk + Diffusion“ neben der „vollständigen Diffusionsmethode“ ein absolut gangbarer Weg ist.

- Unendlich lange Videos werden Realität: Eine Fähigkeit, die Sora, Kling oder Veo bisher nicht bieten konnten – Magi liefert dies erstmals als Open-Source-Lösung.

- Das Open-Source-Video-Ökosystem erreicht ein neues Level: Dank Apache 2.0-Lizenz, vollständigen Modellgewichten und einer 4,5B-Version für Consumer-Hardware wird es für Einzelentwickler möglich, mit erstklassigen Videomodellen zu arbeiten.

🚀 Handlungsempfehlung: Wenn Sie die Fähigkeiten von Magi AI heute noch testen möchten, ist dies der schnellste Weg: Erstens, registrieren Sie sich unter

magi.sand.ai/app/projectsfür eine Online-Demo. Zweitens, wenn Sie von den Ergebnissen überzeugt sind, führen Sie eine lokale Bereitstellung der 4,5B-Version gemäß der GitHub-README durch. Drittens, vergleichen Sie die Ergebnisse von Magi (lokal) mit denen von Veo, Sora oder Kling (via APIYI apiyi.com), um Ihren eigenen „Modell-Werkzeugkasten“ aufzubauen. So haben Sie für jedes Szenario – ob Langvideos, detaillierte Storyboards oder maximale Qualität bei kurzen Clips – das passende Werkzeug zur Hand.

Autor: APIYI Team — Wir konzentrieren uns darauf, Entwicklern einen stabilen Zugang zu führenden KI-Großsprachmodellen zu bieten. Besuchen Sie apiyi.com für weitere Informationen.

Referenzen

-

MAGI-1 GitHub-Haupt-Repository

- Link:

github.com/SandAI-org/MAGI-1 - Beschreibung: Quellcode, Skripte zum Herunterladen der Gewichte, Inferenz-Beispiele

- Link:

-

MAGI-1 Hugging Face Modell-Karte

- Link:

huggingface.co/sand-ai/MAGI-1 - Beschreibung: Gewichte und Dokumentation für die 4,5B- und 24B-Versionen

- Link:

-

Offizielles MAGI-1 Whitepaper (PDF)

- Link:

static.magi.world/static/files/MAGI_1.pdf - Beschreibung: Vollständige technische Details und Benchmark-Ergebnisse

- Link:

-

Offizielle Magi-Vorstellungsseite von Sand AI

- Link:

sand.ai/magi - Beschreibung: Projekt-Homepage und Produktvorstellung

- Link:

-

MAGI-1 Online-Web-App

- Link:

magi.sand.ai/app/projects - Beschreibung: Direkte Testmöglichkeit im Browser

- Link:

-

ComfyUI Wiki – MAGI-1 Bericht

- Link:

comfyui-wiki.com/en/news/2025-04-23-magi-1-autoregressive-video-generation-model-released - Beschreibung: Ausführlicher Bericht und Vergleich durch Dritte

- Link: