Jika Anda baru-baru ini melihat banyak orang membahas "Magi AI" atau "MAGI-1", namun belum tahu apa bedanya dengan Sora, Kling, atau Veo, artikel ini adalah panduan pengantar untuk Anda. Magi AI adalah model pembuatan video sumber terbuka (open-source) yang sangat menarik dari Sand AI — ini adalah "model pembuatan video autoregresif" pertama di dunia yang mencapai standar kelas atas, serta mendukung pembuatan video dengan durasi tak terbatas.

Nilai Inti: Setelah membaca artikel ini, Anda akan memahami apa itu Magi AI, mengapa jalurnya berbeda dengan Sora/Kling, apa kegunaannya, dan bagaimana cara menjalankannya dalam 5 menit.

Apa itu Magi AI: Poin Utama

Definisi singkat: Magi AI = Model pembuatan video dengan arsitektur hibrida "autoregresif + difusi" yang bersumber terbuka dari Sand AI.

Model ini dikembangkan oleh tim Sand.ai (CEO-nya adalah Yue Cao, salah satu penulis makalah klasik Swin Transformer). MAGI-1 pertama kali dirilis secara open-source pada 21 April 2025, dan diperbarui ke Magi-1.1 pada tahun 2026. Kode, bobot (weights), dan alat inferensi semuanya tersedia di GitHub dan Hugging Face di bawah lisensi Apache 2.0.

| Poin Utama | Penjelasan | Nilai |

|---|---|---|

| Lisensi Open-Source | Apache 2.0 | Sepenuhnya bisa dikomersialkan |

| Skala Model | Versi ganda 4.5B / 24B | Mencakup kebutuhan individu hingga perusahaan |

| Arsitektur Inti | Autoregresif + Diffusion Transformer | Model video autoregresif kelas atas pertama di dunia |

| Fitur Unggulan | Pembuatan video durasi tak terbatas | Tidak bisa dilakukan oleh Sora/Kling |

| Blok Dasar | Pembuatan 24 frame chunk-by-chunk | Mendukung pembuatan streaming |

| Pemahaman Fisika | Physics-IQ 56.02% | Jauh melampaui model sejenis |

| Kontrol | Chunk-wise prompting | Kontrol presisi tingkat frame |

| GitHub | SandAI-org/MAGI-1 | Kode lengkap + bobot |

💡 Pemahaman Cepat: Magi AI menempuh jalur yang benar-benar berbeda dari Sora, Veo, dan Kling. Model-model arus utama tersebut melakukan pembuatan sekaligus dalam satu segmen, sehingga memiliki batas durasi; sedangkan Magi-1 melakukan pembuatan autoregresif per chunk, sehingga secara teoritis dapat terus berlanjut. Ini adalah inovasi diferensiasi yang nyata di bidang video AI. Jika Anda ingin menguji dan membandingkan model pembuatan video arus utama saat ini, Anda bisa menggunakan APIYI (apiyi.com) untuk mengakses Veo, Kling, Wan, dll., lalu menggabungkannya dengan Magi open-source yang dijalankan secara lokal. Ini adalah solusi perbandingan dengan efisiensi biaya terbaik.

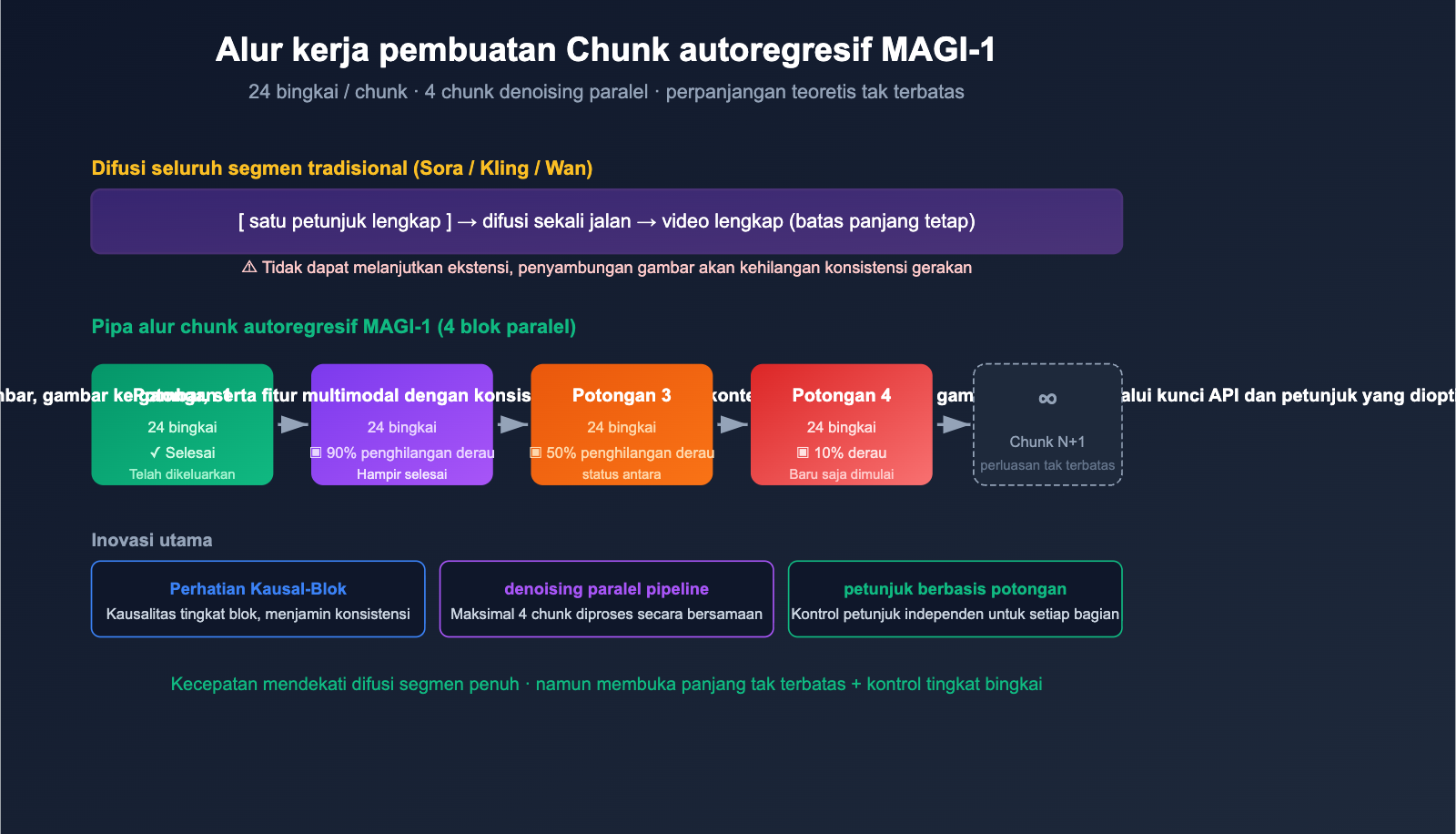

Untuk memahami apa yang membuat Magi AI berbeda, kita harus melihat mekanisme "generasi chunk autoregresif"-nya. Inilah perbedaan mendasar antara Magi AI dengan model video arus utama lainnya.

Generasi Autoregresif chunk-by-chunk

Sebagian besar model video populer saat ini (seperti Sora, Veo, Kling, Wan, dll.) menggunakan pendekatan difusi segmen penuh:

[Prompt video lengkap] → [Difusi denoising satu tahap] → [Output video lengkap]

Masalah dari metode ini adalah: batas panjang video yang kaku. Sora 1.0 maksimal 60 detik, Kling 5-10 detik, dan jika ingin lebih panjang, model harus melakukan "penyambungan" (stitching), yang sering kali menyebabkan hilangnya konsistensi gerakan.

Magi-1 menggunakan pendekatan hibrida autoregresif + difusi berbasis blok:

prompt → Blok 1 (24 frame) difusi denoising → Blok 2 (24 frame) → Blok 3 → ... → ∞

Setiap chunk tetap menggunakan difusi denoising untuk menjaga kualitas, namun antar-chunk bersifat autoregresif—blok berikutnya dihasilkan berdasarkan blok sebelumnya. Inilah yang membuka kemampuan "video durasi tak terbatas" yang tidak dimiliki model lain.

Pipeline Paralel: 4 Blok Denoising Sekaligus

Yang lebih cerdas, Magi-1 tidak mengharuskan Anda menunggu "Blok 1 selesai sepenuhnya baru mulai Blok 2". Desain pipelinenya mendukung pemrosesan hingga 4 chunk secara bersamaan—setelah blok saat ini mencapai tingkat denoising tertentu, blok berikutnya bisa mulai melakukan pemanasan (pre-warming). Hal ini membuat kecepatan generasi autoregresif tidak jauh berbeda dengan difusi segmen penuh.

Diffusion Transformer + Berbagai Inovasi

Magi-1 menggunakan arsitektur Diffusion Transformer (DiT) dan mengintegrasikan berbagai optimasi efisiensi pelatihan:

| Poin Teknis | Fungsi |

|---|---|

| Block-Causal Attention | Atensi kausal berbasis blok, menjamin konsistensi autoregresif |

| Parallel Attention Block | Blok atensi paralel, meningkatkan kecepatan |

| QK-Norm + GQA | Stabilitas pelatihan + efisiensi inferensi |

| Sandwich Normalization in FFN | Stabilitas pelatihan Model Bahasa Besar |

| SwiGLU | Fungsi aktivasi modern |

| Softcap Modulation | Mengontrol ledakan skor atensi |

Tumpukan teknologi ini hampir identik dengan "arsenal Transformer modern" yang digunakan oleh LLM papan atas seperti Llama 3 / Mistral. Inilah alasan mendasar mengapa Magi-1 mampu mencapai kualitas video kelas atas pada skala parameter 4,5B/24B yang "bisa dijalankan secara lokal".

Dua Versi: 4,5B / 24B

| Versi | Jumlah Parameter | Skenario yang Cocok | Kebutuhan Hardware |

|---|---|---|---|

| MAGI-1 4,5B | 4,5 B | Pengembang individu, eksperimen lokal | Bisa dijalankan di satu kartu (24GB+) |

| MAGI-1 24B | 24 B | Deployment produksi, kualitas tertinggi | Multi-GPU / Disarankan H100 |

Sand AI merilis kedua versi ini sebagai open source. Versi 4,5B ditujukan agar "pengembang independen bisa bereksperimen", sementara versi 24B adalah versi unggulan untuk performa maksimal.

Kemampuan Inti Magi AI

Kemampuan 1: Pembuatan Video dengan Durasi Tak Terbatas

Ini adalah kemampuan paling unik dari Magi-1 dan tidak dimiliki oleh model video arus utama lainnya. Dokumen resmi menyatakan dengan jelas: "Magi-1 adalah satu-satunya model dalam pembuatan video AI yang menyediakan kemampuan ekstensi video tanpa batas."

Makna praktisnya: Anda bisa meminta Magi-1 untuk menghasilkan video berdurasi 5 menit, 10 menit, bahkan 1 jam secara berkelanjutan, dengan konsistensi gerakan dan adegan yang jauh lebih baik daripada metode "penyambungan klip". Ini adalah keuntungan besar untuk film pendek, iklan panjang, dan video edukasi.

Kemampuan 2: Pemahaman Fisika Tingkat Atas

Pada tolok ukur Physics-IQ, Magi-1 meraih skor 56,02%, jauh melampaui semua model sejenis saat ini. Physics-IQ menguji kemampuan prediksi model tentang "apa yang akan terjadi selanjutnya di dunia fisik" — ke mana bola akan menggelinding, bagaimana air mengalir, atau bagaimana pakaian berkibar.

Dengan pemahaman fisika yang meningkat, kesan "AI" pada gambar berkurang, sehingga gerakan terlihat lebih mendekati dunia nyata.

Kemampuan 3: Kontrol Presisi Tingkat Bingkai (Chunk-wise Prompting)

Karena menggunakan metode pembuatan chunk-by-chunk (blok demi blok), Magi-1 mendukung pemberian petunjuk (prompt) secara terpisah untuk setiap blok 24 bingkai:

blok 1: "seekor kucing berlari di atas rumput"

blok 2: "kucing mulai melompat"

blok 3: "kucing tertarik oleh kupu-kupu, lalu berhenti"

blok 4: "kucing mengejar kupu-kupu terbang ke langit"

Kontrol sedetail ini hampir mustahil dilakukan pada model difusi tradisional yang menghasilkan seluruh segmen sekaligus. Hal ini menurunkan beban kerja "penyusunan storyboard video panjang" ke tingkat yang sangat praktis untuk dikerjakan.

Kemampuan 4: Gambar ke Video (I2V) yang Kuat

Magi-1 tampil sangat unggul dalam tugas gambar ke video. Dengan memberikan satu gambar statis + deskripsi teks, model ini dapat menghasilkan video yang sangat konsisten dengan gambar tersebut dan memiliki gerakan yang alami. Ini lebih terkontrol dibandingkan T2V (teks ke gambar) murni, sehingga lebih cocok untuk kebutuhan produksi nyata.

Kemampuan 5: Kepatuhan terhadap Petunjuk (Prompt) Tingkat Atas

Dalam makalahnya, Sand AI secara khusus menguji kepatuhan terhadap instruksi (instruction following). Hasilnya menunjukkan bahwa kemampuan Magi-1 dalam mengikuti petunjuk jauh lebih baik daripada Wan 2.1 dan HunyuanVideo, dan mampu bersaing dengan model tertutup seperti Hailuo i2v-01. Artinya, petunjuk yang Anda tulis akan benar-benar diperhatikan oleh model, bukan sekadar "berimprovisasi sendiri".

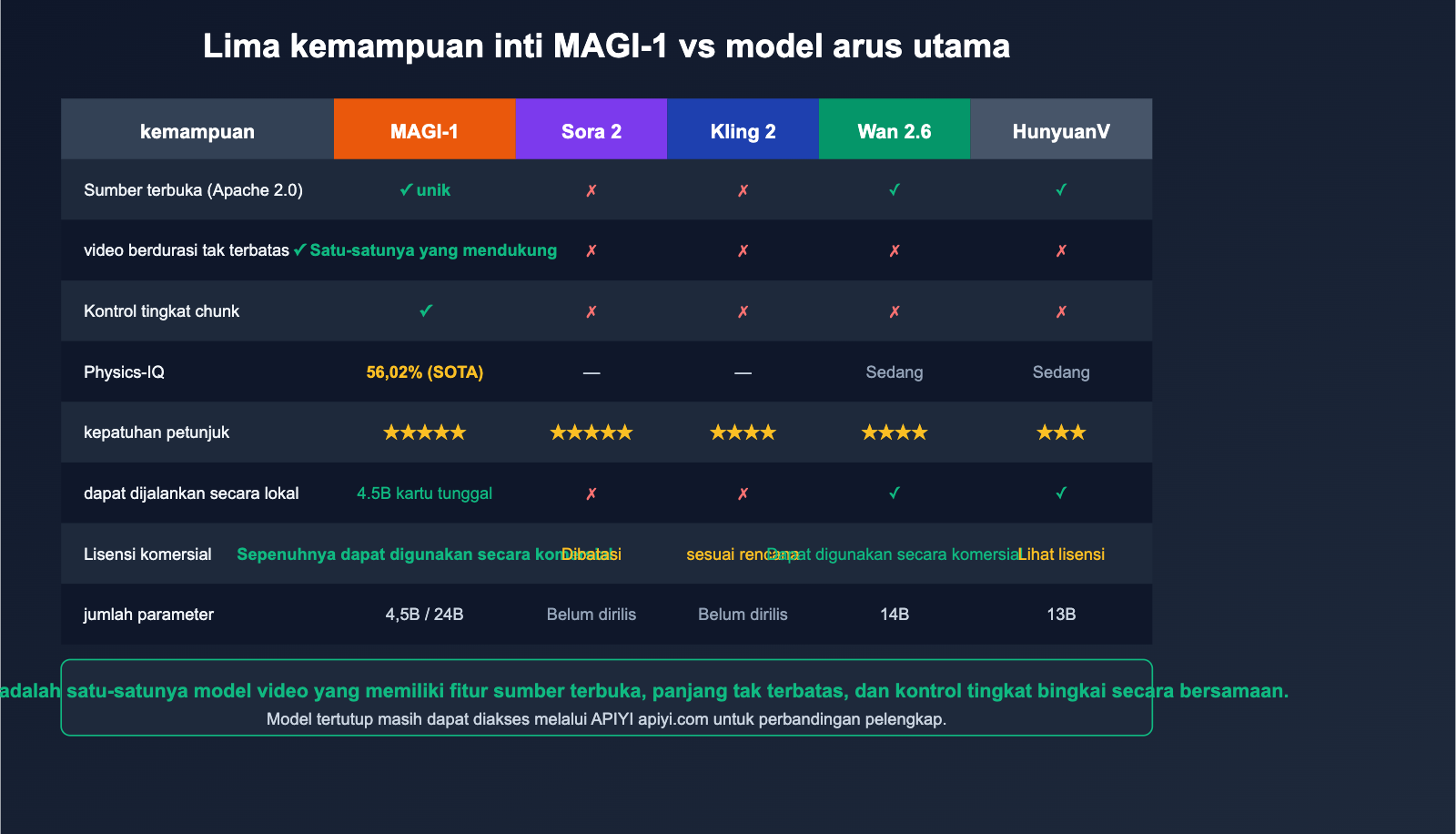

Perbandingan Magi AI dengan Model Video Utama

Banyak pengguna baru yang bertanya: "Bagaimana perbandingan Magi dengan Sora, Kling, dan Wan?" Berikut adalah tabel perbandingan yang jelas.

| Dimensi Perbandingan | MAGI-1 | Sora 2 | Kling 2 | Wan 2.6 | HunyuanVideo |

|---|---|---|---|---|---|

| Open Source | ✅ Apache 2.0 | ❌ | ❌ | ✅ | ✅ |

| Arsitektur | Autoregressive + Diffusion | Diffusion | Diffusion | Diffusion | Diffusion |

| Panjang Tak Terbatas | ✅ Satu-satunya yang mendukung | ❌ | ❌ | ❌ | ❌ |

| Kontrol Level Chunk | ✅ | ❌ | ❌ | ❌ | ❌ |

| Jumlah Parameter | 4.5B / 24B | Tidak diungkap | Tidak diungkap | 14B | 13B |

| Physics-IQ | 56.02% | — | — | Sedang | Sedang |

| Kepatuhan Prompt | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| Jalan Lokal | ✅ 4.5B Single GPU | ❌ | ❌ | ✅ | ✅ |

| Komersial | ✅ Apache 2.0 | ⚠ Terbatas | ⚠ Sesuai plan | ✅ | ⚠ Cek lisensi |

🎯 Kesimpulan: Jika Anda menginginkan "kualitas gambar terbaik + video pendek sekali jadi", Sora 2 / Kling 2 tetap menjadi pilihan utama; jika Anda menginginkan "open source + video panjang + kontrol frame", Magi AI adalah satu-satunya jawaban saat ini; jika Anda ingin "bisa jalan lokal sekaligus pakai API untuk perbandingan", disarankan menggunakan deployment lokal MAGI-1 4.5B + memanggil model closed-source seperti Veo / Sora melalui APIYI apiyi.com untuk pengujian perbandingan yang paling lengkap.

Memulai Cepat Magi AI

Cara 1: Uji Coba Web Online (Tercepat)

Cara termudah adalah langsung membuka Web App resmi:

- Link:

magi.sand.ai/app/projects - Daftar akun untuk mulai menggunakan

- Tanpa konfigurasi lingkungan, bisa langsung jalan di browser

Cocok bagi pengguna yang ingin "melihat hasilnya dulu".

Cara 2: Deployment Lokal Source Code GitHub

Jika Anda ingin melakukan riset atau penggunaan jangka panjang secara lokal, tarik source code dari GitHub:

# Clone repositori

git clone https://github.com/SandAI-org/MAGI-1.git

cd MAGI-1

# Instal dependensi

pip install -r requirements.txt

# Unduh bobot 4.5B (sekitar 9GB)

huggingface-cli download sand-ai/MAGI-1 --local-dir ./ckpt/

# Jalankan contoh minimal

python inference.py \

--model_path ./ckpt/4.5B_base \

--prompt "A cat walking on the snow, cinematic lighting" \

--output ./output/cat.mp4 \

--num_chunks 4

💡 Saran: Untuk percobaan lokal pertama, disarankan menggunakan model 4.5B + VRAM GPU tunggal 24GB (RTX 3090/4090 sudah cukup). Versi 24B memang memiliki kualitas lebih baik, tetapi memerlukan konfigurasi multi-GPU H100 dengan biaya yang jauh lebih tinggi.

Cara 3: Tarik Bobot Langsung dari Hugging Face

huggingface-cli download sand-ai/MAGI-1 \

--include "ckpt/magi/4.5B_base/*" \

--local-dir ./

Bobot disimpan dalam format standar safetensors, sehingga bisa langsung dimuat menggunakan diffusers / transformers.

Alur Kerja yang Direkomendasikan: Magi Lokal + Perbandingan API Closed-Source Utama

Bagi pengembang, alur kerja yang paling praktis adalah sebagai berikut:

- Jalankan MAGI-1 4.5B secara lokal: Untuk kemampuan unik seperti video durasi tak terbatas dan kontrol frame.

- Panggil API Veo / Sora / Kling: Untuk mengejar kualitas gambar per segmen tertinggi.

- Akses Terpadu: Gunakan APIYI apiyi.com untuk mengakses model video closed-source papan atas luar negeri dalam satu pintu, menghindari masalah akun, jaringan, dan penagihan.

- Perbandingan Horizontal: Jalankan kedua set pada prompt yang sama, lalu pilih output yang paling sesuai untuk tugas Anda saat ini.

Siapa yang Cocok Menggunakan Magi AI

Skenario 1: Kreator yang Membutuhkan Video Berdurasi Panjang

Untuk drama pendek, iklan berdurasi panjang, video edukasi, hingga dokumenter — solusi tradisional "penyambungan video per 5 detik" sudah mencapai batasnya. Pembuatan video dengan durasi tak terbatas dari Magi-1 adalah satu-satunya solusi siap pakai saat ini.

Skenario 2: Sutradara yang Membutuhkan Kontrol Storyboard Presisi

"Chunk-wise prompting" memungkinkan Anda mengontrol setiap segmen visual layaknya menulis papan storyboard. Fitur ini sangat berguna bagi kreator video pendek, pembuat storyboard animasi, dan sutradara iklan.

Skenario 3: Peneliti Pembuatan Video / Kontributor Open Source

Dengan lisensi Apache 2.0, bobot model lengkap, makalah penelitian, dan repositori GitHub, Magi adalah referensi implementasi open source terbaik saat ini untuk mempelajari "pembuatan video autoregresif". Jika Anda sedang meneliti bidang ini, Magi-1 adalah proyek yang wajib dibaca dan dicoba.

Skenario 4: Tim Kecil yang Ingin Melakukan Deployment Lokal

Model closed-source seperti Sora atau Kling hanya bisa digunakan melalui API, sehingga data tidak sepenuhnya berada dalam kendali Anda. Magi-1 menggunakan lisensi Apache 2.0, bobotnya dapat diunduh, dan dapat sepenuhnya di-deploy di cloud pribadi Anda. Hal ini sangat ramah bagi industri yang sensitif terhadap data (medis, keuangan, pendidikan).

Pertanyaan Umum tentang Magi AI

Q1: Apakah Magi AI gratis? Apakah bisa digunakan untuk tujuan komersial?

Sepenuhnya gratis, dan dapat digunakan secara komersial di bawah lisensi Apache 2.0. Ini adalah salah satu keunggulan terbesar Magi dibandingkan model closed-source seperti Sora atau Kling. Anda hanya perlu menanggung biaya perangkat keras/GPU, tanpa biaya pemanggilan API, tanpa biaya bulanan, dan tanpa batasan komersial.

Q2: Mana yang lebih baik antara Magi-1, Wan 2.6, dan HunyuanVideo?

Berdasarkan data perbandingan makalah Sand AI, Magi-1 unggul atas Wan 2.1 dan HunyuanVideo dalam tiga indikator: pemahaman fisik (Physics-IQ), kepatuhan terhadap petunjuk, dan kualitas gerakan. Namun, Wan 2.6 adalah versi yang lebih baru dengan ekosistem komunitas dan toolchain yang lebih matang. Saran praktis: Gunakan Wan 2.6 untuk video pendek dan kualitas gambar tinggi, serta gunakan Magi-1 untuk video panjang dan kontrol presisi. Keduanya tidak saling meniadakan.

Q3: Apakah “video durasi tak terbatas” benar-benar tidak terbatas?

Secara teori, ya. Mekanisme pembuatan chunk autoregresif Magi-1 tidak memiliki batas panjang, sehingga Anda bisa terus membuatnya. Batasan nyata utamanya berasal dari VRAM dan waktu: VRAM hanya perlu menyimpan status beberapa chunk saat ini, jadi tidak akan crash; sedangkan waktu akan bertambah secara linear — video 5 menit membutuhkan waktu sekitar 5 kali lipat dari video 1 menit.

Q4: Seberapa besar perbedaan antara versi 4.5B dan 24B?

4.5B adalah "model video autoregresif terkuat yang bisa dijalankan di kartu grafis konsumen", kualitasnya sudah melampaui sebagian besar model closed-source awal, namun masih ada jarak dengan model flagship papan atas seperti Sora 2 atau Kling 2. Versi 24B adalah versi "pengejar performa" yang kualitasnya mendekati model closed-source kelas satu. Jika Anda hanya untuk kreasi pribadi atau riset, 4.5B sudah cukup; jika untuk produksi tingkat komersial, disarankan menggunakan 24B dengan multi-kartu H100.

Q5: Apakah saya perlu mengganti Sora / Kling yang saya gunakan sekarang dengan Magi?

Tidak perlu mengganti, disarankan untuk menggunakannya secara komplementer. Sora dan Kling masih memiliki keunggulan dalam kualitas gambar per segmen dan bahasa kamera, sementara Magi memiliki keunggulan eksklusif dalam durasi, kontrol, dan kemandirian open source. Strategi terbaik adalah: gunakan APIYI apiyi.com untuk mengakses model closed-source luar negeri guna membuat video pendek berkualitas tinggi, dan gunakan Magi dengan deployment lokal untuk video panjang serta kontrol presisi. Pilih alat yang paling sesuai dengan skenario Anda.

Q6: Bagaimana cara pengembang di Tiongkok mengunduh bobot Magi-1?

Anda bisa langsung mengunduhnya di Hugging Face (huggingface.co/sand-ai/MAGI-1). Jika menemui masalah jaringan, Anda dapat menggunakan mirror hf-mirror atau modelscope. Sand AI adalah perusahaan rintisan AI asal Tiongkok yang sangat ramah terhadap pengembang lokal, dan terdapat banyak tutorial serta diskusi dalam bahasa Mandarin di komunitasnya.

Ringkasan

Magi AI adalah salah satu proyek paling inovatif di bidang pembuatan video sumber terbuka (open-source) untuk tahun 2025-2026. Proyek ini merepresentasikan tiga hal penting:

- Validasi jalur pembuatan video autoregresif: Magi-1 adalah model video autoregresif pertama di dunia yang mencapai standar kelas atas, membuktikan bahwa "chunk-by-chunk + Diffusion" adalah jalur alternatif yang layak selain metode "difusi segmen penuh".

- Video berdurasi tak terbatas bukan lagi fiksi ilmiah: Ini adalah kemampuan yang belum bisa dilakukan oleh Sora, Kling, maupun Veo, dan Magi menghadirkan kemampuan ini secara terbuka untuk pertama kalinya.

- Ekosistem video sumber terbuka kembali meningkat: Dengan lisensi Apache 2.0, bobot model lengkap, dan versi 4.5B yang ramah konsumen, "pengembang individu kini bisa menjalankan model video kelas atas" menjadi kenyataan.

🚀 Saran Tindakan: Jika Anda ingin mencoba kemampuan Magi AI hari ini, jalur tercepat adalah: Langkah pertama, buka

magi.sand.ai/app/projectsuntuk mendaftar akun dan mencoba secara daring; Langkah kedua, jika hasilnya memuaskan, ikuti panduan GitHub README untuk menyebarkan versi 4.5B secara lokal; Langkah ketiga, lakukan perbandingan antara hasil Magi (lokal) dengan Veo / Sora / Kling (diakses melalui layanan proksi API APIYI di apiyi.com) untuk membangun "kotak alat model" Anda sendiri. Dengan cara ini, Anda akan memiliki senjata yang tepat untuk membuat video panjang, storyboard mendetail, atau mengejar kualitas segmen tunggal tertinggi.

Penulis: Tim APIYI — Fokus menyediakan akses stabil ke Model Bahasa Besar AI utama bagi pengembang, kunjungi apiyi.com untuk informasi lebih lanjut.

Referensi

-

Repositori Utama GitHub MAGI-1

- Tautan:

github.com/SandAI-org/MAGI-1 - Keterangan: Kode sumber, skrip pengunduhan bobot, dan contoh inferensi.

- Tautan:

-

Kartu Model Hugging Face MAGI-1

- Tautan:

huggingface.co/sand-ai/MAGI-1 - Keterangan: Bobot dan penjelasan untuk versi 4.5B / 24B.

- Tautan:

-

Makalah Resmi MAGI-1 (PDF)

- Tautan:

static.magi.world/static/files/MAGI_1.pdf - Keterangan: Detail teknis lengkap dan hasil pengujian benchmark.

- Tautan:

-

Halaman Pengenalan Resmi Magi dari Sand AI

- Tautan:

sand.ai/magi - Keterangan: Beranda proyek dan pengenalan produk.

- Tautan:

-

Aplikasi Web Daring MAGI-1

- Tautan:

magi.sand.ai/app/projects - Keterangan: Uji coba langsung melalui peramban.

- Tautan:

-

Wiki ComfyUI – Laporan MAGI-1

- Tautan:

comfyui-wiki.com/en/news/2025-04-23-magi-1-autoregressive-video-generation-model-released - Keterangan: Laporan mendalam dan perbandingan dari pihak ketiga.

- Tautan: