Если вы в последнее время часто слышите обсуждения «Magi AI» или «MAGI-1», но не понимаете, чем они отличаются от Sora, Kling или Veo, эта статья — отличная точка входа. Magi AI — это крайне интересный опенсорсный проект от Sand AI. Это первая в мире «авторегрессионная модель генерации видео» топового уровня, которая поддерживает генерацию видео бесконечной длины.

Ключевая ценность: прочитав этот материал, вы поймете, что такое Magi AI, почему он идет по другому пути, нежели Sora или Kling, для чего его можно использовать и как запустить его за 5 минут.

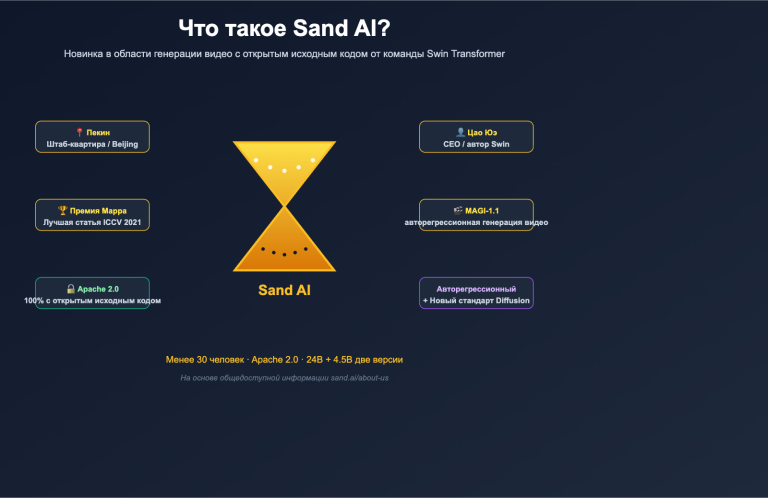

Что такое Magi AI: основные моменты

Определение в одном предложении: Magi AI = опенсорсная модель генерации видео от Sand AI, основанная на гибридной архитектуре «авторегрессия + диффузия».

Она разработана командой Sand.ai (генеральный директор — Юэ Цао, соавтор классической статьи о Swin Transformer). Первая версия MAGI-1 была представлена 21 апреля 2025 года, а в 2026 году вышла итерация Magi-1.1. Код, веса и инструменты для инференса полностью открыты на GitHub и Hugging Face под лицензией Apache 2.0.

| Параметр | Описание | Ценность |

|---|---|---|

| Лицензия | Apache 2.0 | Полностью коммерческая |

| Масштаб модели | 4.5B / 24B (две версии) | От личного использования до бизнеса |

| Архитектура | Авторегрессия + Diffusion Transformer | Первая в мире авторегрессионная модель видео |

| Киллер-фича | Генерация видео бесконечной длины | Недоступно для Sora/Kling |

| Базовый блок | Генерация по 24 кадра (chunk-by-chunk) | Поддержка потоковой генерации |

| Понимание физики | Physics-IQ 56.02% | Значительно превосходит аналоги |

| Управляемость | Пофрагментный промпт | Точный контроль на уровне кадров |

| GitHub | SandAI-org/MAGI-1 | Полный код + веса |

💡 Краткий итог: Magi AI идет по пути, кардинально отличному от Sora, Veo и Kling. Эти популярные модели генерируют весь фрагмент целиком, поэтому у них есть ограничение по длине. Magi-1 же генерирует видео по фрагментам (chunks) в авторегрессионном режиме, что теоретически позволяет продолжать генерацию бесконечно. Это настоящий инновационный прорыв в области AI-видео. Если вы хотите сравнить текущие топовые модели, вы можете использовать сервис-прокси API APIYI (apiyi.com) для доступа к Veo, Kling, Wan и другим, а в сочетании с локальным запуском опенсорсного Magi это будет самым выгодным вариантом для сравнения.

Архитектура ядра Magi AI

Чтобы понять, в чем уникальность Magi AI, нужно разобраться в его механизме «авторегрессионной генерации чанков» (chunk generation) — именно это отличает его от всех популярных видеомоделей.

Авторегрессионная генерация по чанкам

Большинство современных видеомоделей (Sora, Veo, Kling, Wan и др.) используют подход целостной диффузии:

[Полный промпт видео] → [Одноэтапная диффузия/шумоподавление] → [Вывод готового видео]

Проблема этого метода в том, что лимит длины фиксирован. Sora 1.0 выдает максимум 60 секунд, Kling — 5–10 секунд. Если нужно больше, приходится «склеивать» фрагменты, что часто приводит к потере временной согласованности движений.

Magi-1 использует гибридный подход: авторегрессия + блочная диффузия:

промпт → 1-й чанк (24 кадра) → 2-й чанк (24 кадра) → 3-й чанк → ... → ∞

Внутри каждого чанка по-прежнему используется диффузия для обеспечения качества, но между чанками работает авторегрессия — следующий блок генерируется на основе предыдущего. Это открывает возможность создания «бесконечно длинных видео», чего другие модели пока не умеют.

Конвейерная параллелизация: обработка 4 чанков одновременно

Что еще круче — Magi-1 не заставляет вас ждать, пока «первый чанк полностью завершится, чтобы начать второй». Архитектура конвейера поддерживает одновременную обработку до 4 чанков: как только текущий блок проходит определенный этап шумоподавления, следующий уже начинает «разогреваться». Благодаря этому скорость авторегрессионной генерации практически не уступает методам целостной диффузии.

Diffusion Transformer + инновации

В основе Magi-1 лежит архитектура Diffusion Transformer (DiT) с множеством оптимизаций эффективности обучения:

| Технология | Назначение |

|---|---|

| Block-Causal Attention | Блочная причинно-следственная аттеншн-механика для согласованности |

| Parallel Attention Block | Параллельные блоки внимания для ускорения |

| QK-Norm + GQA | Стабильность обучения + эффективность инференса |

| Sandwich Normalization in FFN | Стабильность обучения больших моделей |

| SwiGLU | Современная функция активации |

| Softcap Modulation | Предотвращение «взрыва» весов внимания |

Этот стек технологий практически идентичен «современному арсеналу Transformer», который используют топовые LLM вроде Llama 3 или Mistral. Именно поэтому Magi-1 удается достичь качества видео уровня лидеров рынка при параметрах 4.5B/24B, которые можно запустить даже на домашнем железе.

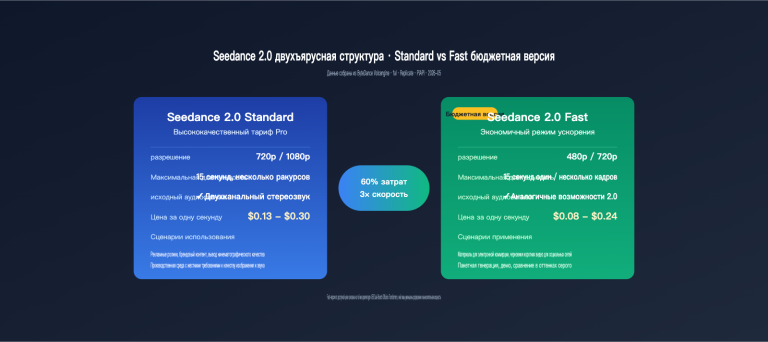

Две версии: 4.5B / 24B

| Версия | Параметры | Сценарии использования | Требования к железу |

|---|---|---|---|

| MAGI-1 4.5B | 4.5 млрд | Индивидуальные разработчики, локальные тесты | Одна карта (24 ГБ+) |

| MAGI-1 24B | 24 млрд | Продакшн, максимальное качество | Несколько карт / Рекомендуется H100 |

Sand AI одновременно выпустила обе версии: 4.5B создана для того, чтобы «инди-разработчики могли экспериментировать», а 24B — это флагман для достижения топовых результатов.

Основные возможности Magi AI

Способность 1: Генерация видео бесконечной длины

Это самая уникальная особенность Magi-1, недоступная другим популярным моделям. В официальной документации прямо сказано: "Magi-1 — единственная модель в генерации видео с помощью ИИ, предоставляющая возможности бесконечного расширения видео".

Что это значит на практике: вы можете создать с помощью Magi-1 непрерывное видео длительностью 5, 10 минут или даже час, при этом согласованность движений и сцен будет гораздо выше, чем при обычном "склеивании" фрагментов. Это огромное преимущество для короткометражек, длинной рекламы и обучающих видео.

Способность 2: Превосходное понимание физики

В бенчмарке Physics-IQ модель Magi-1 набрала 56,02%, значительно опередив всех текущих конкурентов. Physics-IQ оценивает способность модели предсказывать, что произойдет в физическом мире дальше: куда покатится мяч, как потечет вода или как будет развеваться одежда.

Когда понимание физики на высоте, "искусственность" картинки исчезает, и движения становятся гораздо ближе к реальному миру.

Способность 3: Точное покадровое управление (Chunk-wise Prompting)

Поскольку генерация происходит блоками (chunk-by-chunk), Magi-1 позволяет задавать отдельный промпт для каждого блока из 24 кадров:

блок 1: "кот бежит по траве"

блок 2: "кот начинает прыгать"

блок 3: "кот отвлекается на бабочку и останавливается"

блок 4: "кот гонится за бабочкой, взлетая в небо"

Такой уровень детального контроля практически невозможен в традиционных моделях, работающих с диффузией всего ролика целиком. Это переводит задачу "раскадровки длинного видео" на уровень, пригодный для реального продакшена.

Способность 4: Мощная функция "изображение-в-изображение" (I2V)

Magi-1 особенно хороша в задачах Image-to-Video. Даете статичное изображение + текстовое описание, и модель генерирует видео, которое идеально соответствует картинке и имеет естественную динамику. Это гораздо более управляемый процесс, чем чистый текст-в-изображение (T2V), что делает его идеальным для рабочих задач.

Способность 5: Точное следование промпту

В своей статье исследователи Sand AI провели специальное тестирование на следование инструкциям. Результаты показали, что способность Magi-1 следовать промпту значительно выше, чем у Wan 2.1 и HunyuanVideo, и она вполне может конкурировать с закрытой моделью Hailuo i2v-01. Это значит, что ваш промпт действительно будет принят к исполнению, а не станет лишь "поводом для фантазии" модели.

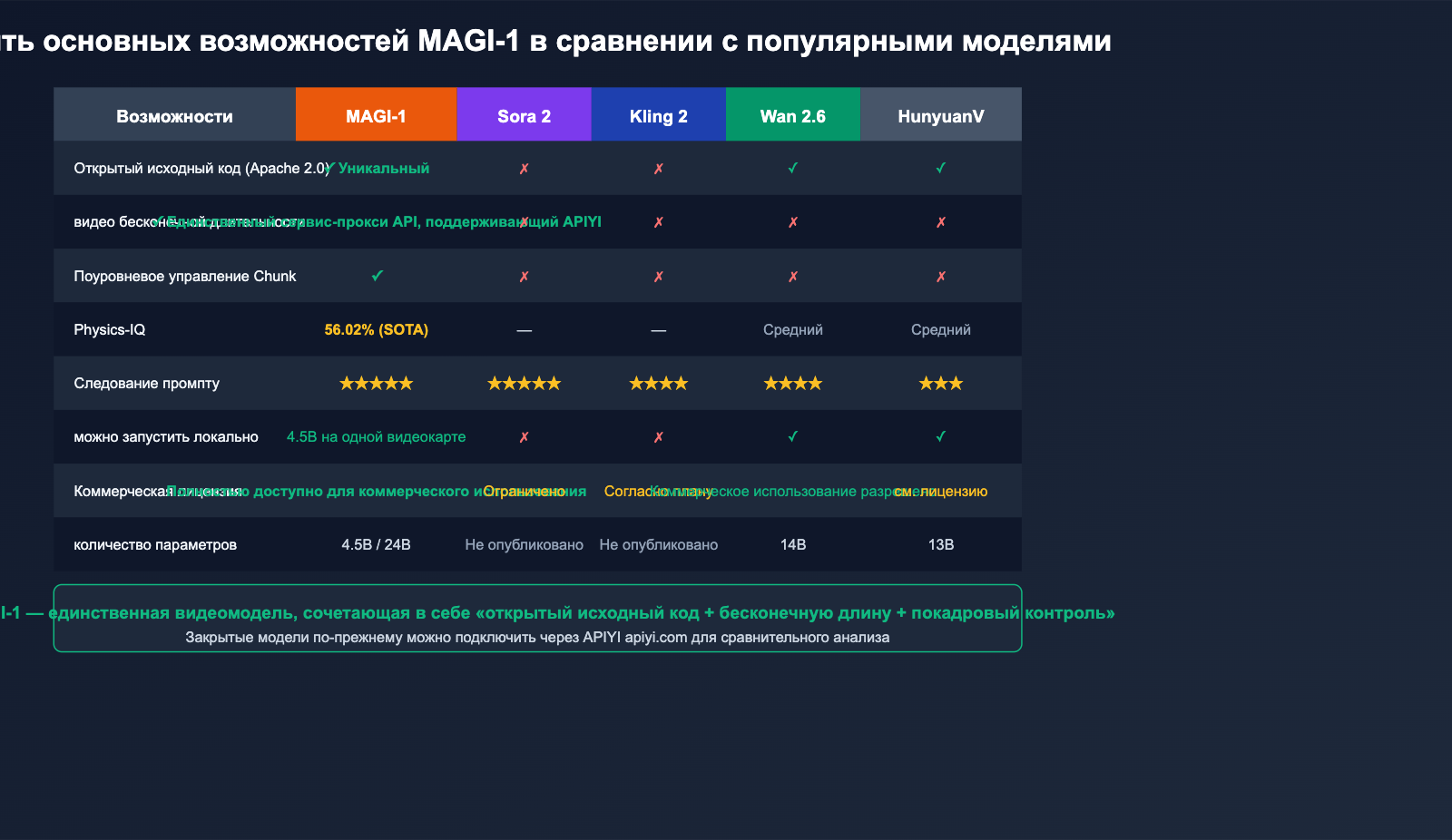

Сравнение Magi AI с популярными видеомоделями

Многих новых пользователей в первую очередь интересует: «Как Magi соотносится с Sora, Kling и Wan?» Ниже приведена наглядная сравнительная таблица.

| Параметр сравнения | MAGI-1 | Sora 2 | Kling 2 | Wan 2.6 | HunyuanVideo |

|---|---|---|---|---|---|

| Open Source | ✅ Apache 2.0 | ❌ | ❌ | ✅ | ✅ |

| Архитектура | Авторегрессия + Diffusion | Diffusion | Diffusion | Diffusion | Diffusion |

| Бесконечная длина | ✅ Единственная поддержка | ❌ | ❌ | ❌ | ❌ |

| Контроль на уровне чанков | ✅ | ❌ | ❌ | ❌ | ❌ |

| Количество параметров | 4.5B / 24B | Не раскрыто | Не раскрыто | 14B | 13B |

| Physics-IQ | 56.02% | — | — | Средне | Средне |

| Следование промпту | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| Локальный запуск | ✅ 4.5B на одной карте | ❌ | ❌ | ✅ | ✅ |

| Коммерческое использование | ✅ Apache 2.0 | ⚠ Ограничено | ⚠ По тарифу | ✅ | ⚠ См. лицензию |

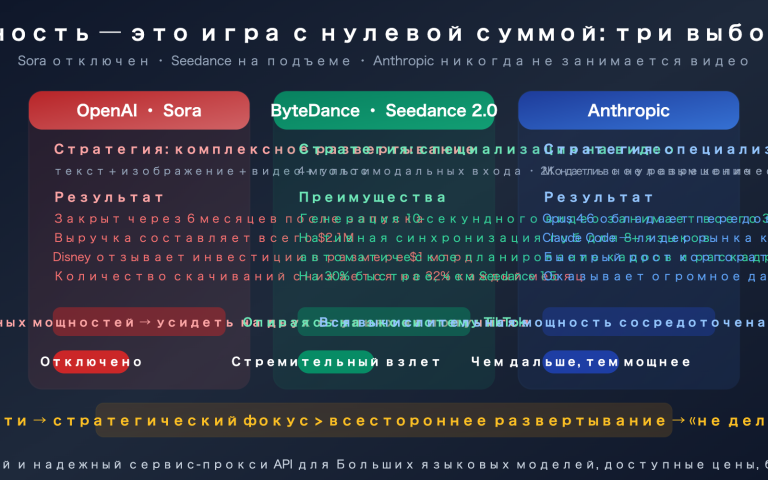

🎯 Вывод: Если вам нужно «максимальное качество + короткое видео за один проход», Sora 2 / Kling 2 остаются лучшим выбором. Если же вам нужен «Open Source + длинные видео + покадровый контроль», то Magi AI — на данный момент единственный вариант. Если вы хотите «и запускать локально, и использовать API для сравнения», рекомендуем локальный деплой MAGI-1 4.5B в сочетании с вызовом закрытых моделей вроде Veo или Sora через сервис-прокси API APIYI (apiyi.com) для максимально полного тестирования.

Быстрый старт с Magi AI

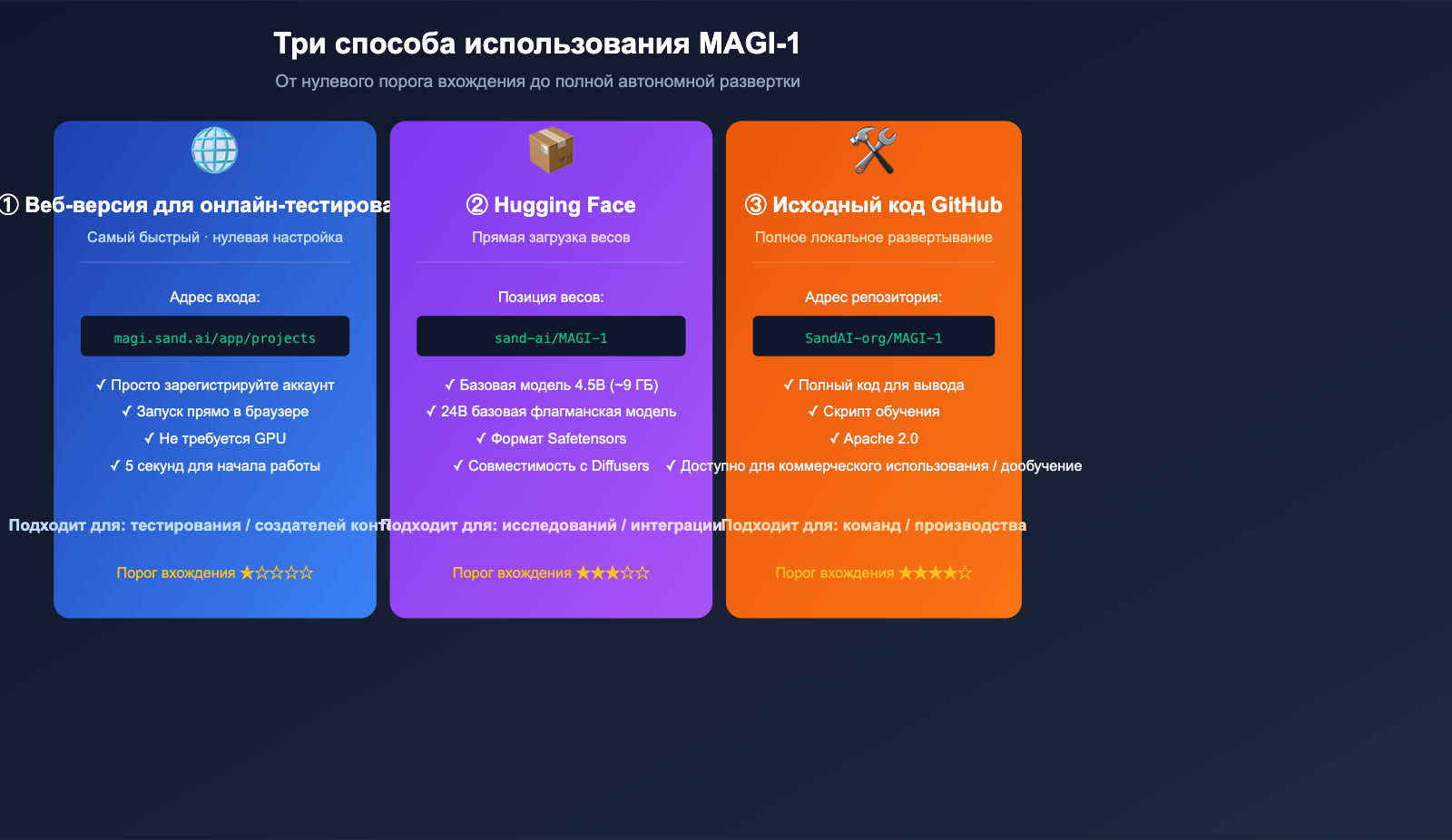

Способ 1: Онлайн-тестирование через Web (самый быстрый)

Самый простой способ — зайти в официальное веб-приложение:

- Ссылка:

magi.sand.ai/app/projects - Просто зарегистрируйтесь и пользуйтесь

- Никакой настройки окружения, всё работает прямо в браузере

Подходит для тех, кто хочет «сначала посмотреть на результат».

Способ 2: Локальный деплой из исходников GitHub

Если вы занимаетесь исследованиями или планируете долгосрочное использование, клонируйте репозиторий с GitHub:

# Клонирование репозитория

git clone https://github.com/SandAI-org/MAGI-1.git

cd MAGI-1

# Установка зависимостей

pip install -r requirements.txt

# Скачивание весов 4.5B (около 9 ГБ)

huggingface-cli download sand-ai/MAGI-1 --local-dir ./ckpt/

# Запуск минимального примера

python inference.py \

--model_path ./ckpt/4.5B_base \

--prompt "A cat walking on the snow, cinematic lighting" \

--output ./output/cat.mp4 \

--num_chunks 4

💡 Совет: Для первого локального запуска рекомендуем использовать модель 4.5B + видеокарту с 24 ГБ видеопамяти (RTX 3090/4090 вполне хватит). Версия 24B хоть и выдает лучшее качество, но требует связки из нескольких H100, что на порядок дороже.

Способ 3: Скачивание весов напрямую с Hugging Face

huggingface-cli download sand-ai/MAGI-1 \

--include "ckpt/magi/4.5B_base/*" \

--local-dir ./

Веса хранятся в стандартном формате safetensors, их можно загружать напрямую через diffusers / transformers.

Рекомендуемый рабочий процесс: Локальный Magi + сравнение с популярными закрытыми API

Для разработчиков наиболее практичный рабочий процесс выглядит так:

- Локальный запуск MAGI-1 4.5B: для задач, требующих бесконечной длины видео, покадрового контроля и других уникальных возможностей.

- Вызов API Veo / Sora / Kling: для достижения максимального качества в рамках одного сегмента.

- Единая точка входа: используйте сервис-прокси API APIYI (apiyi.com) для подключения топовых зарубежных закрытых видеомоделей, чтобы избежать проблем с аккаунтами, доступом и оплатой.

- Сравнительный анализ: запускайте один и тот же промпт на обеих системах и выбирайте результат, который лучше всего подходит для вашей задачи.

Кому подойдет Magi AI

Сценарий 1: Создатели длинных видео

Короткометражки, рекламные ролики, обучающие видео, документалистика — в этих сферах традиционный подход «склейки по 5 секунд» уже уперся в потолок. Генерация видео неограниченной длины в Magi-1 — это единственное на сегодня готовое решение «из коробки».

Сценарий 2: Режиссеры, которым нужен точный контроль над раскадровкой

Функция «chunk-wise prompting» позволяет управлять каждым фрагментом видео, словно вы пишете раскадровку. Это невероятно полезно для создателей коротких видео, аниматоров и рекламных режиссеров.

Сценарий 3: Исследователи генерации видео / Open-source контрибьюторы

Лицензия Apache 2.0, полные веса, научная статья и репозиторий на GitHub — на данный момент Magi является лучшей реализацией с открытым исходным кодом для изучения «авторегрессионной генерации видео». Если вы работаете в этом направлении, Magi-1 — проект, который обязательно нужно изучить и протестировать.

Сценарий 4: Небольшие команды, планирующие локальное развертывание

Закрытые модели вроде Sora или Kling доступны только через API, что не дает полного контроля над данными. Magi-1 распространяется по лицензии Apache 2.0, веса доступны для скачивания, и ее можно полностью развернуть в собственном частном облаке, что крайне важно для отраслей с высокими требованиями к безопасности данных (медицина, финансы, образование).

Часто задаваемые вопросы о Magi AI

Q1: Magi AI бесплатный? Можно ли использовать его в коммерческих целях?

Да, он полностью бесплатный, и его можно свободно использовать в коммерческих целях по лицензии Apache 2.0. Это одно из главных преимуществ Magi перед закрытыми моделями вроде Sora или Kling. Вы несете расходы только на оборудование или вычислительные мощности GPU — никаких оплат за вызов модели, ежемесячных подписок или ограничений на коммерческое использование.

Q2: Что лучше: Magi-1, Wan 2.6 или HunyuanVideo?

Согласно сравнительным данным из статьи Sand AI, Magi-1 превосходит Wan 2.1 и HunyuanVideo по трем показателям: физическое понимание (Physics-IQ), следование промпту и качество движения. Однако Wan 2.6 — это более свежая версия с более зрелой экосистемой и инструментарием. Наш совет: для коротких видео и высокого качества картинки используйте Wan 2.6, а для длинных видео и точного контроля — Magi-1. Они отлично дополняют друг друга.

Q3: «Видео неограниченной длины» — это правда?

Теоретически — да. Механизм авторегрессионной генерации чанков (фрагментов) в Magi-1 не имеет лимита по длине, вы можете продолжать генерацию бесконечно. Реальные ограничения связаны только с объемом видеопамяти и временем: видеопамяти нужно лишь для хранения состояния текущих чанков, поэтому переполнения не будет. Время же растет линейно — 5-минутное видео потребует примерно в 5 раз больше времени, чем 1-минутное.

Q4: Насколько велика разница между версиями 4.5B и 24B?

4.5B — это «самая мощная авторегрессионная модель для видео, которую можно запустить на потребительской видеокарте». По качеству она уже превосходит большинство ранних закрытых моделей, но все еще уступает топовым флагманам вроде Sora 2 или Kling 2. Версия 24B — это настоящий «тяжеловес», приближающийся по качеству к лучшим закрытым моделям. Если вы занимаетесь личным творчеством или исследованиями, 4.5B будет вполне достаточно; для коммерческого производства рекомендуем 24B в связке с несколькими H100.

Q5: Нужно ли мне заменять текущие Sora / Kling на Magi?

Заменять не нужно, лучше использовать их в связке. Sora и Kling по-прежнему выигрывают в качестве отдельного кадра и киноязыке, а Magi обладает уникальными преимуществами в плане длины, управляемости и независимости open-source решения. Оптимальная стратегия: использовать APIYI (apiyi.com) для доступа к зарубежным закрытым моделям при создании качественных коротких роликов, а Magi — для локального развертывания при создании длинных видео и сложных сцен. Выбирайте инструмент под конкретную задачу.

Q6: Как разработчикам из Китая скачать веса Magi-1?

Скачать их можно напрямую на Hugging Face (huggingface.co/sand-ai/MAGI-1). Если возникнут проблемы с доступом, можно воспользоваться зеркалами hf-mirror или modelscope. Sand AI — это китайский AI-стартап, они очень открыты к местным разработчикам, поэтому в сообществе доступно множество руководств и обсуждений на китайском языке.

Резюме

Magi AI — один из самых инновационных проектов в области генерации видео с открытым исходным кодом на 2025–2026 годы. Он знаменует собой три важных достижения:

- Доказана жизнеспособность авторегрессионного пути генерации видео: Magi-1 — первая в мире авторегрессионная модель видео уровня SOTA (State-of-the-Art), которая доказывает, что подход «chunk-by-chunk + диффузия» является еще одним эффективным путем наряду с «диффузией целого сегмента».

- Видео бесконечной длины перешли из разряда фантастики в реальность: Это возможность, недоступная Sora, Kling или Veo, которую Magi впервые предоставляет в формате open-source.

- Экосистема видео с открытым кодом вышла на новый уровень: Лицензия Apache 2.0, полные веса и потребительская версия на 4,5 млрд параметров делают реальной возможность «запуска топовых видеомоделей на домашнем ПК».

🚀 Советы по действиям: Если вы хотите протестировать возможности Magi AI прямо сейчас, самый быстрый путь: во-первых, перейдите на

magi.sand.ai/app/projects, зарегистрируйтесь и попробуйте онлайн. Во-вторых, если результат вас впечатлит, разверните версию 4.5B локально, следуя инструкции в GitHub README. В-третьих, сравните результаты Magi (локально) с Veo, Sora или Kling (через сервис-прокси API APIYI apiyi.com), чтобы собрать собственный «инструментарий моделей». Так у вас всегда будет подходящее решение — будь то создание длинных видео, детальная раскадровка или погоня за максимальным качеством отдельного фрагмента.

Автор: Команда APIYI — специализируемся на предоставлении разработчикам стабильного доступа к основным большим языковым моделям. Узнайте больше на apiyi.com.

Справочные материалы

-

Основной репозиторий MAGI-1 на GitHub

- Ссылка:

github.com/SandAI-org/MAGI-1 - Описание: Исходный код, скрипты для загрузки весов, примеры инференса.

- Ссылка:

-

Карточка модели MAGI-1 на Hugging Face

- Ссылка:

huggingface.co/sand-ai/MAGI-1 - Описание: Веса и документация для двух версий: 4.5B и 24B.

- Ссылка:

-

Официальная статья MAGI-1 (PDF)

- Ссылка:

static.magi.world/static/files/MAGI_1.pdf - Описание: Полные технические детали и результаты бенчмарков.

- Ссылка:

-

Официальная страница Magi от Sand AI

- Ссылка:

sand.ai/magi - Описание: Главная страница проекта и презентация продукта.

- Ссылка:

-

Веб-приложение MAGI-1

- Ссылка:

magi.sand.ai/app/projects - Описание: Прямое тестирование в браузере.

- Ссылка:

-

ComfyUI Wiki — отчет о MAGI-1

- Ссылка:

comfyui-wiki.com/en/news/2025-04-23-magi-1-autoregressive-video-generation-model-released - Описание: Сторонний глубокий анализ и сравнительный обзор.

- Ссылка: