如果你最近看到大家在討論 "Magi AI" 或 "MAGI-1",但不知道它和 Sora、Kling、Veo 有什麼不同,本文就是寫給你的入門科普。Magi AI 是 Sand AI 開源的一個非常有意思的視頻生成模型 —— 它是全球第一個達到一線水準的"自迴歸視頻生成模型",並且支持無限長度視頻生成。

核心價值: 讀完本文,你將清楚 Magi AI 是什麼、它爲什麼和 Sora/Kling 走的不是一條路、能用來做什麼,以及如何 5 分鐘跑起來。

Magi AI 是什麼 核心要點

一句話定義: Magi AI = Sand AI 開源的、基於"自迴歸 + 擴散"混合架構的視頻生成模型。

它由 Sand.ai 團隊(CEO 是 Yue Cao,也就是經典 Swin Transformer 論文的共同作者)開發,2025 年 4 月 21 日首次開源 MAGI-1,2026 年迭代到 Magi-1.1。代碼、權重、推理工具全部在 GitHub 和 Hugging Face 上以 Apache 2.0 協議開放。

| 要點 | 說明 | 價值 |

|---|---|---|

| 開源協議 | Apache 2.0 | 完全可商用 |

| 模型規模 | 4.5B / 24B 雙版本 | 個人到企業全覆蓋 |

| 核心架構 | 自迴歸 + Diffusion Transformer | 全球首個一線自迴歸視頻模型 |

| 殺手特性 | 無限長度視頻生成 | Sora/Kling 都做不到 |

| 基礎塊 | 24 幀 chunk-by-chunk 生成 | 支持流式生成 |

| 物理理解 | Physics-IQ 56.02% | 大幅超越同類 |

| 可控性 | chunk-wise prompting | 幀級別精準控制 |

| GitHub | SandAI-org/MAGI-1 | 完整代碼 + 權重 |

💡 快速理解: Magi AI 走的是一條與 Sora、Veo、Kling 完全不同的路線。這些主流模型都是整段一次性生成,因此長度有上限;而 Magi-1 是逐 chunk 自迴歸生成,理論上可以一直生成下去。這在 AI 視頻領域是一個真正的差異化創新。如果你想測試當前主流的視頻生成模型做對比,可以通過 API易 apiyi.com 一站接入 Veo、Kling、Wan 等,配合開源的 Magi 在本地跑,是性價比最高的對比方案。

Magi AI 的核心技術架構

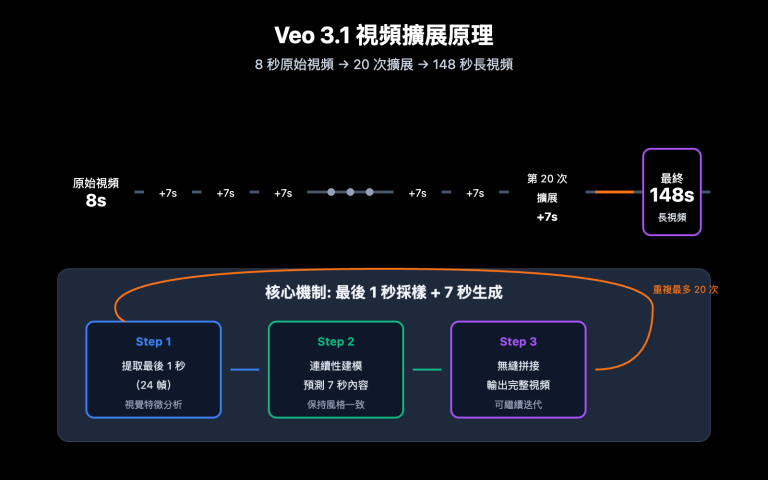

要理解 Magi AI 的差異化,必須先理解它的"自迴歸 chunk 生成"機制 —— 這是它和所有主流視頻模型最大的不同。

chunk-by-chunk 自迴歸生成

絕大多數主流視頻模型(Sora、Veo、Kling、Wan 等)走的都是整段擴散路線:

[一段完整視頻 prompt] → [一次性擴散去噪] → [完整視頻輸出]

這種方式的問題是: 長度上限是固定的。Sora 1.0 一次最多 60 秒,Kling 一次 5-10 秒,再長就需要"接片",而接片往往會丟失運動一致性。

Magi-1 則是自迴歸 + 塊級擴散的混合路線:

prompt → 第 1 塊 (24 幀) 擴散去噪 → 第 2 塊 (24 幀) → 第 3 塊 → ... → ∞

每一個 chunk 內部仍然用擴散去噪保證質量,但 chunk 之間是自迴歸的 —— 後一塊基於前一塊繼續生成。這就解鎖了"無限長度視頻"這個其他模型做不到的能力。

流水線並行:4 塊同時去噪

更聰明的是,Magi-1 沒有讓你等"第 1 塊全部完成纔開始第 2 塊"。它的 pipeline 設計支持最多 4 個 chunk 同時處理 —— 當前塊去噪到一定程度後,下一塊就可以開始預熱。這讓自迴歸生成的速度並沒有比整段擴散慢多少。

Diffusion Transformer + 多項創新

Magi-1 底層是 Diffusion Transformer (DiT) 架構,並集成了大量訓練效率優化:

| 技術點 | 作用 |

|---|---|

| Block-Causal Attention | 塊級因果注意力,保證自迴歸一致性 |

| Parallel Attention Block | 並行注意力塊,提速 |

| QK-Norm + GQA | 訓練穩定 + 推理高效 |

| Sandwich Normalization in FFN | 大模型訓練穩定性 |

| SwiGLU | 現代激活函數 |

| Softcap Modulation | 控制注意力分數爆炸 |

這套技術棧和 Llama 3 / Mistral 這類一線 LLM 用的"現代 Transformer 武器庫"幾乎一致 —— 這也是 Magi-1 能在 4.5B/24B 這種"個人可跑"的參數量級下達到一線視頻質量的根本原因。

雙版本: 4.5B / 24B

| 版本 | 參數量 | 適合場景 | 硬件要求 |

|---|---|---|---|

| MAGI-1 4.5B | 4.5 B | 個人開發者、本地實驗 | 單卡可跑 (24GB+) |

| MAGI-1 24B | 24 B | 生產部署、最高質量 | 多卡 / H100 推薦 |

Sand AI 同時開源了兩個版本,4.5B 的目的是讓"獨立開發者也能玩",24B 纔是衝榜用的旗艦。

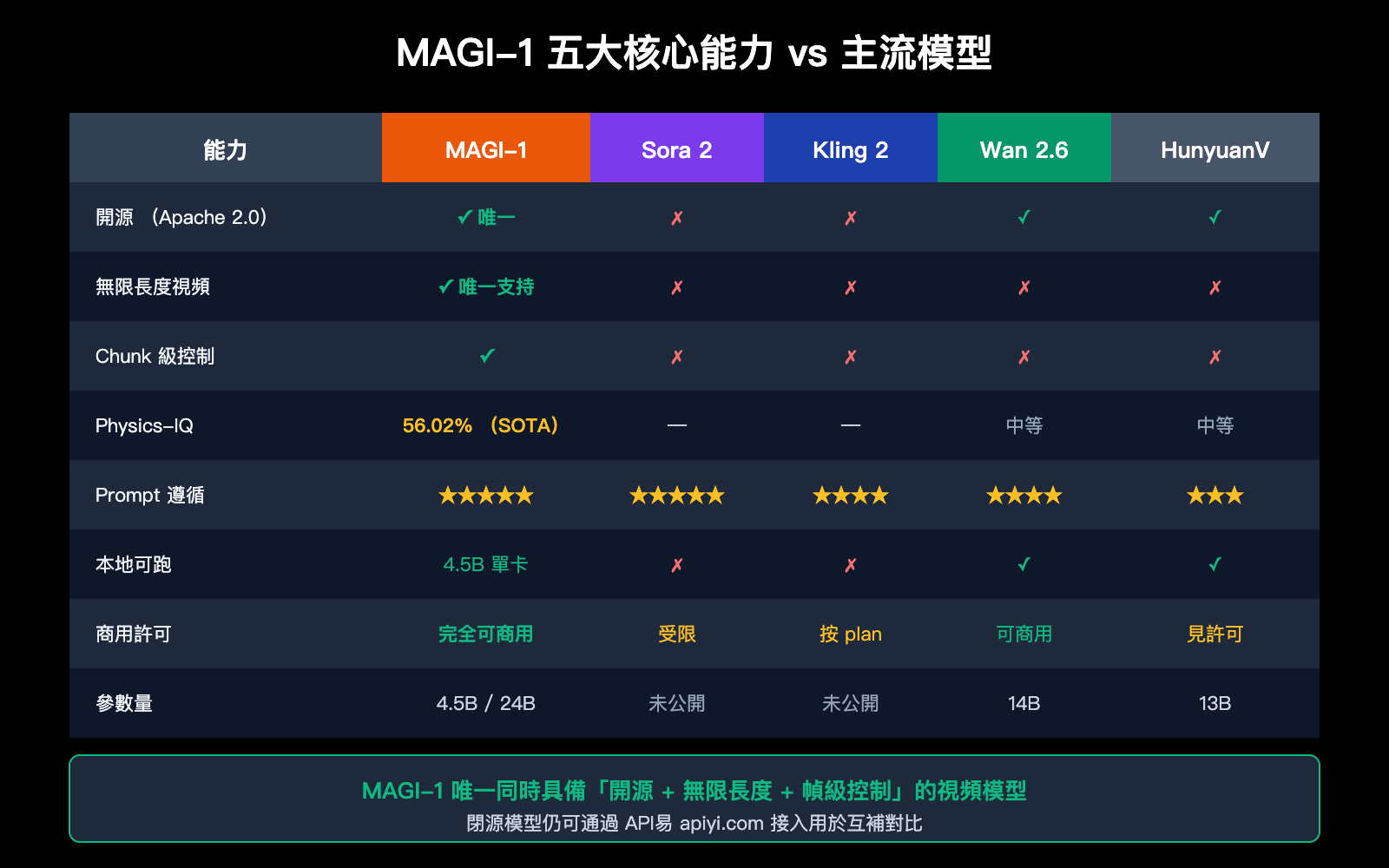

Magi AI 的核心能力

能力 1: 無限長度視頻生成

這是 Magi-1 最獨特的能力,也是其他主流視頻模型做不到的。官方文檔明確寫道:"Magi-1 is the sole model in AI video generation that provides infinite video extension capabilities."

實際意義:你可以讓 Magi-1 生成一個 5 分鐘、10 分鐘甚至 1 小時的連續視頻,運動和場景的一致性比"接片"方式好得多。這對短劇、長廣告、教學視頻是巨大利好。

能力 2: 頂級的物理理解

在 Physics-IQ benchmark 上,Magi-1 拿到 56.02%,大幅超越當前所有同類模型。Physics-IQ 測的是模型對"物理世界繼續會怎樣"的預測能力 —— 球會往哪滾、水會怎麼流、衣服會怎麼飄。

物理理解上去了,畫面"AI 味"就下降,更接近真實世界的運動。

能力 3: 幀級精準控制 (Chunk-wise Prompting)

因爲是 chunk-by-chunk 生成,Magi-1 支持給每一個 24 幀的塊分別打 prompt:

chunk 1: "一隻貓在草地上奔跑"

chunk 2: "貓開始跳躍"

chunk 3: "貓被一隻蝴蝶吸引,停下來"

chunk 4: "貓追蝴蝶飛向天空"

這種級別的精細控制,在傳統整段擴散的模型上是幾乎不可能做到的。它直接把"長視頻分鏡"這個工作量降到了可工程化的水平。

能力 4: 強 Image-to-Video (I2V)

Magi-1 在 Image-to-Video 任務上表現尤其出色。給一張靜態圖 + 一段文本描述,它能生成與圖像高度一致、運動自然的視頻。這比純 T2V (Text-to-Video) 更可控,更適合實際生產場景。

能力 5: 頂級 prompt 遵循

Sand AI 在論文中專門測試了 instruction following,結果顯示 Magi-1 的指令遵循能力顯著好於 Wan 2.1 和 HunyuanVideo,可以與閉源 Hailuo i2v-01 掰手腕。這意味着你寫的 prompt 真的會被它當回事,而不是"自由發揮"。

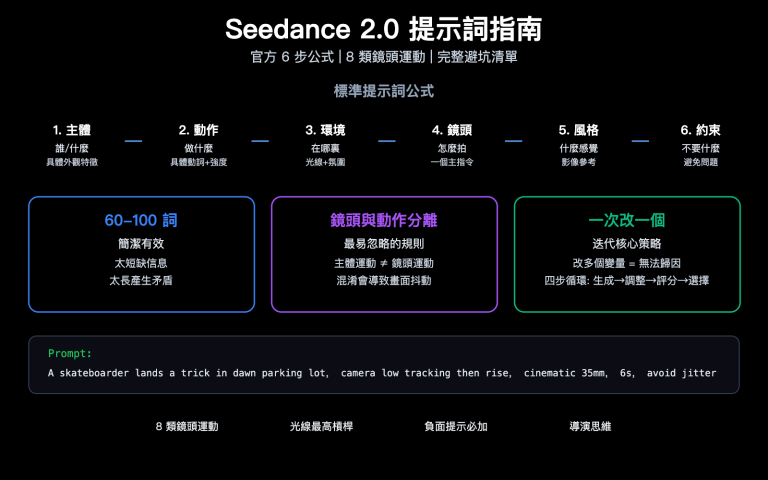

Magi AI 與主流視頻模型對比

很多新用戶最關心的問題是: "Magi 和 Sora、Kling、Wan 比起來怎麼樣?"下面給出一張明確的對比表。

| 對比維度 | MAGI-1 | Sora 2 | Kling 2 | Wan 2.6 | HunyuanVideo |

|---|---|---|---|---|---|

| 開源 | ✅ Apache 2.0 | ❌ | ❌ | ✅ | ✅ |

| 架構 | 自迴歸 + Diffusion | Diffusion | Diffusion | Diffusion | Diffusion |

| 無限長度 | ✅ 唯一支持 | ❌ | ❌ | ❌ | ❌ |

| Chunk 級控制 | ✅ | ❌ | ❌ | ❌ | ❌ |

| 參數量 | 4.5B / 24B | 未公開 | 未公開 | 14B | 13B |

| Physics-IQ | 56.02% | — | — | 中等 | 中等 |

| Prompt 遵循 | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐⭐ | ⭐⭐⭐ |

| 本地可跑 | ✅ 4.5B 單卡 | ❌ | ❌ | ✅ | ✅ |

| 可商用 | ✅ Apache 2.0 | ⚠ 商用受限 | ⚠ 按 plan | ✅ | ⚠ 見許可 |

🎯 結論: 如果你要"最高畫質 + 一次性短視頻",Sora 2 / Kling 2 仍是首選;如果你要"開源 + 長視頻 + 幀級控制",Magi AI 是目前唯一的答案;如果你要"既能本地跑又能接 API 做對比",建議用 MAGI-1 4.5B 本地部署 + 通過 API易 apiyi.com 同時調用 Veo / Sora 等閉源模型,做最完整的對比測試。

Magi AI 快速上手

方式 1: Web 在線試用 (最快)

最簡單的方式是直接打開官方 Web App:

- 入口:

magi.sand.ai/app/projects - 註冊賬號即可使用

- 無需任何環境配置,瀏覽器就能跑

適合"我先看看效果再說"的用戶。

方式 2: GitHub 源碼本地部署

如果你想做研究或在本地長期使用,從 GitHub 拉源碼:

# 克隆倉庫

git clone https://github.com/SandAI-org/MAGI-1.git

cd MAGI-1

# 安裝依賴

pip install -r requirements.txt

# 下載 4.5B 權重 (約 9GB)

huggingface-cli download sand-ai/MAGI-1 --local-dir ./ckpt/

# 跑一個最小示例

python inference.py \

--model_path ./ckpt/4.5B_base \

--prompt "A cat walking on the snow, cinematic lighting" \

--output ./output/cat.mp4 \

--num_chunks 4

💡 建議: 第一次本地跑建議先用 4.5B 模型 + 單卡 24GB 顯存 (RTX 3090/4090 即可)。24B 版本雖然質量更好,但需要多卡 H100 配合,成本要高一個量級。

方式 3: Hugging Face 直接拉權重

huggingface-cli download sand-ai/MAGI-1 \

--include "ckpt/magi/4.5B_base/*" \

--local-dir ./

權重以標準 safetensors 格式存儲,可以直接用 diffusers / transformers 加載。

推薦工作流: Magi 本地 + 主流閉源 API 對比

對開發者來說,最務實的工作流是這樣:

- 本地跑 MAGI-1 4.5B: 用於無限長度視頻、幀級控制等獨特能力

- API 調用 Veo / Sora / Kling: 用於追求最高單段畫質

- 統一接入: 通過 API易 apiyi.com 一站接入海外頂級閉源視頻模型,避免賬號、網絡、計費三重問題

- 橫向對比: 在同一個 prompt 上跑兩套,挑最適合當前任務的輸出

Magi AI 適合什麼人

場景 1: 需要長視頻的創作者

短劇、長廣告、教學視頻、紀錄片 —— 這些場景下,"5 秒一接片"的傳統方案已經走到瓶頸。Magi-1 的無限長度生成是當前唯一開箱即用的方案。

場景 2: 需要精細分鏡控制的導演

"chunk-wise prompting" 讓你可以像寫分鏡表一樣控制每一段畫面。這對短視頻創作者、動畫分鏡師、廣告導演非常有用。

場景 3: 視頻生成研究者 / 開源貢獻者

Apache 2.0 協議 + 完整權重 + 論文 + GitHub 倉庫,Magi 是目前研究"自迴歸視頻生成"最好的開源參考實現。如果你在做這個方向的研究,Magi-1 幾乎是必讀必跑的項目。

場景 4: 想本地部署的中小團隊

Sora、Kling 這類閉源模型只能通過 API 用,數據不能完全自主控制。Magi-1 是 Apache 2.0,權重可下載,完全可以部署在自己的私有云裏,對數據敏感的行業(醫療、金融、教育)非常友好。

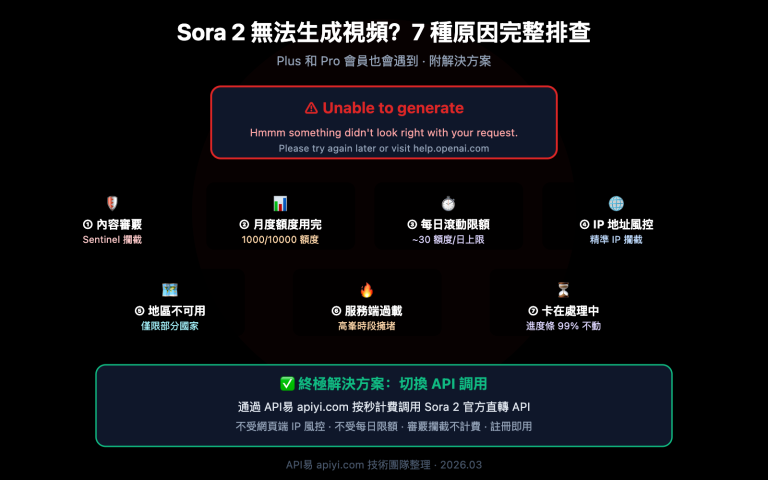

Magi AI 常見問題

Q1: Magi AI 是免費的嗎?可以商用嗎?

完全免費,並且Apache 2.0 協議下完全可商用。這是 Magi 相對於 Sora、Kling 等閉源模型最大的優勢之一。你只需要承擔硬件 / GPU 算力成本,沒有 API 調用費用,沒有月費,沒有商用限制。

Q2: Magi-1 和 Wan 2.6、HunyuanVideo 哪個更好?

按 Sand AI 論文的對比數據,Magi-1 在 Physics-IQ 物理理解、Prompt 遵循、Motion Quality 三項指標上均領先 Wan 2.1 和 HunyuanVideo。但 Wan 2.6 是更新的版本,社區生態和工具鏈更成熟。真實建議: 短視頻和高畫質場景用 Wan 2.6,長視頻和精細控制場景用 Magi-1,兩者並不衝突。

Q3: “無限長度視頻” 是真的無限嗎?

理論上是。Magi-1 的自迴歸 chunk 生成機制本身沒有長度上限,你可以讓它一直生成下去。實際限制主要來自顯存和時間: 顯存只需要保存當前幾個 chunk 的狀態,所以不會爆;時間則是線性增長的 —— 5 分鐘視頻大約需要 5 倍於 1 分鐘的時間。

Q4: 4.5B 版本和 24B 版本差距有多大?

4.5B 是"消費級顯卡能跑的最強自迴歸視頻模型",質量上已經超過了大多數早期閉源模型,但與 Sora 2、Kling 2 這種最頂級的閉源旗艦仍有差距。24B 纔是真正的"衝榜版本",在質量上接近一線閉源模型。如果你只是個人創作或研究,4.5B 完全夠用;如果是商業級生產,建議用 24B + 多卡 H100。

Q5: 我需要用 Magi 替代我現在用的 Sora / Kling 嗎?

不需要替代,建議互補使用。Sora、Kling 在單段畫質和鏡頭語言上仍有優勢,Magi 在長度、控制性和開源自主性上有獨家優勢。最優策略是: 用 API易 apiyi.com 接入海外閉源模型做高質量短片,用 Magi 本地部署做長視頻和精細控制,按場景選最合適的工具。

Q6: 中國開發者如何下載 Magi-1 的權重?

直接在 Hugging Face 上 (huggingface.co/sand-ai/MAGI-1) 下載即可。如果遇到網絡問題,可以使用 hf-mirror 鏡像或 modelscope 鏡像。Sand AI 是一家中國 AI 創業公司,對中國開發者非常友好,社區裏有大量中文教程和討論。

總結

Magi AI 是 2025-2026 年開源視頻生成領域最有創新性的項目之一。它代表了三件事:

- 自迴歸視頻生成路線被驗證可行: Magi-1 是全球第一個達到一線水準的自迴歸視頻模型,證明了"chunk-by-chunk + Diffusion"是除"整段擴散"之外的另一條可行路徑

- 無限長度視頻從科幻走入現實: 這是 Sora、Kling、Veo 都做不到的能力,Magi 第一次開源化交付

- 開源視頻生態被再次推高: Apache 2.0 + 完整權重 + 4.5B 消費級版本,讓"個人開發者也能玩頂級視頻模型"成爲現實

🚀 行動建議: 如果你今天就想體驗 Magi AI 的能力,最快的路徑是: 第一步打開

magi.sand.ai/app/projects註冊賬號在線試玩;第二步如果覺得效果不錯,按 GitHub README 在本地部署 4.5B 版本;第三步把 Magi (本地) 和 Veo / Sora / Kling (通過 API易 apiyi.com 接入) 的輸出做橫向對比,建立屬於你自己的"模型工具箱"。這樣無論是做長視頻、做精細分鏡,還是追求最高單段質量,都有合適的武器可用。

作者: APIYI Team — 專注於爲開發者提供主流 AI 大模型的穩定接入,訪問 apiyi.com 瞭解更多。

參考資料

-

MAGI-1 GitHub 主倉庫

- 鏈接:

github.com/SandAI-org/MAGI-1 - 說明: 源碼、權重下載腳本、推理示例

- 鏈接:

-

MAGI-1 Hugging Face 模型卡

- 鏈接:

huggingface.co/sand-ai/MAGI-1 - 說明: 4.5B / 24B 雙版本權重與說明

- 鏈接:

-

MAGI-1 官方論文 (PDF)

- 鏈接:

static.magi.world/static/files/MAGI_1.pdf - 說明: 完整技術細節與基準測試結果

- 鏈接:

-

Sand AI 官方 Magi 介紹頁

- 鏈接:

sand.ai/magi - 說明: 項目主頁與產品介紹

- 鏈接:

-

MAGI-1 在線 Web App

- 鏈接:

magi.sand.ai/app/projects - 說明: 瀏覽器端直接試用

- 鏈接:

-

ComfyUI Wiki – MAGI-1 報道

- 鏈接:

comfyui-wiki.com/en/news/2025-04-23-magi-1-autoregressive-video-generation-model-released - 說明: 第三方深度報道與對比

- 鏈接: