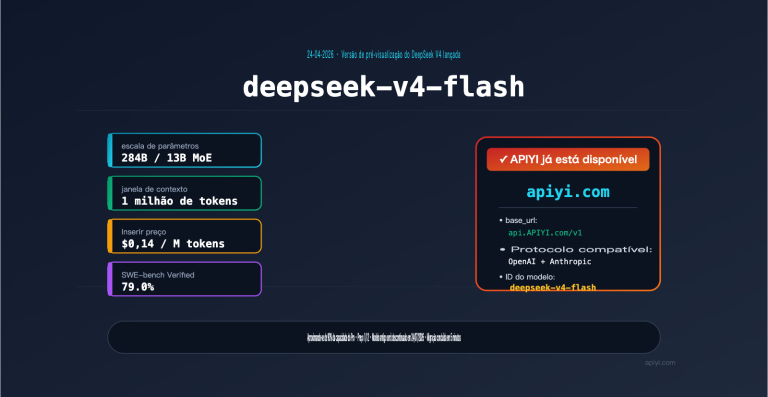

DeepSeek V4 está prestes a ser lançado, um Modelo de Linguagem Grande multimodal nativo com trilhões de parâmetros que suporta geração unificada de texto, imagem e vídeo. Este artigo fornece uma análise rápida das inovações na arquitetura central do DeepSeek V4, seu desempenho e métodos de integração via API, ajudando desenvolvedores a fazer uma avaliação técnica antecipada.

Valor principal: Entenda em 3 minutos os avanços tecnológicos chave do DeepSeek V4, a comparação de desempenho com GPT-5 / Claude e como integrá-lo rapidamente via API.

Visão Geral dos Parâmetros e Capacidades do DeepSeek V4

O DeepSeek V4 é o novo modelo carro-chefe da equipe DeepSeek, adotando uma arquitetura MoE (Mixture of Experts) com trilhões de parâmetros e suporte nativo para entrada e saída multimodal. Aqui estão os parâmetros centrais do DeepSeek V4:

| Parâmetro | Especificação do DeepSeek V4 | Melhoria em relação ao V3 |

|---|---|---|

| Total de Parâmetros | 1 trilhão (1T) | Aproximadamente 1.5x |

| Parâmetros Ativos | ~37B / token | Inferência eficiente com MoE |

| Janela de Contexto | 1 milhão de tokens | Mais de 10x de aumento |

| Suporte a Modalidades | Texto + Imagem + Vídeo | Nova geração de imagem e vídeo |

| Licença | Licença de código aberto | Mantém a tradição de código aberto |

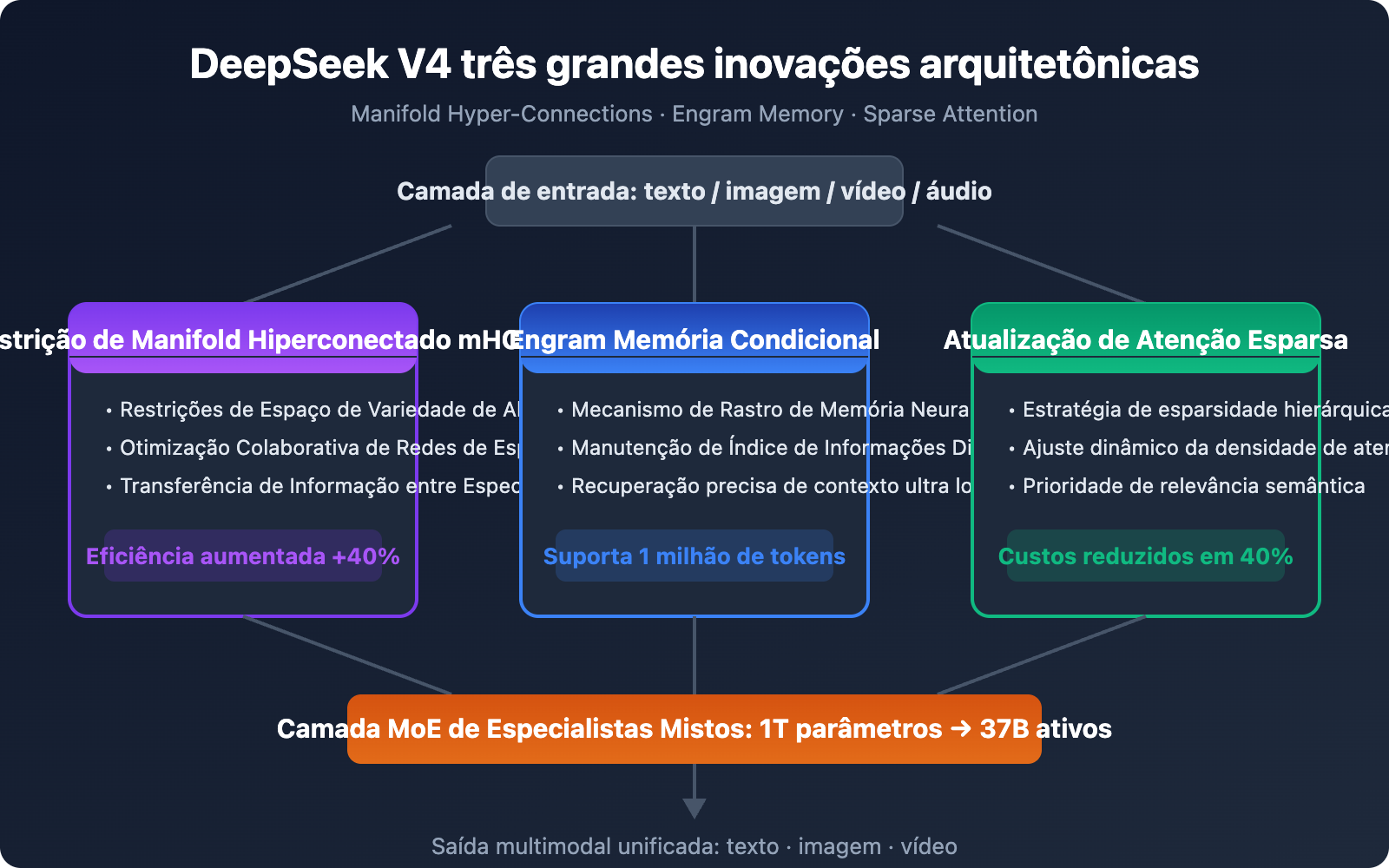

Três Inovações Principais na Arquitetura do DeepSeek V4

O DeepSeek V4 introduz três inovações arquiteturais chave, que são a base técnica para seu avanço de desempenho:

1. Hiperconectividade com Restrição de Variedade (mHC): Esta é uma nova forma de conexão de parâmetros que, ao restringir os caminhos de transferência de informação entre redes especialistas em espaços de variedade de alta dimensão, melhora significativamente a eficiência do raciocínio colaborativo entre múltiplos especialistas na arquitetura MoE. Comparado ao mecanismo de gate esparso tradicional, o mHC aumenta a utilização de informações entre especialistas em cerca de 40%, mantendo a eficiência computacional.

2. Sistema de Memória Condicional Engram: Inspirado pelo conceito de "engrama" (traço de memória) na neurociência, o DeepSeek V4 introduz um módulo de memória condicional. Este sistema pode manter dinamicamente um índice de informações-chave durante o processamento de contextos ultra-longos, permitindo que o modelo recupere e referencie com precisão conteúdos iniciais mesmo ao processar contextos de 1 milhão de tokens, o que é crucial para análise de grandes bases de código e processamento de documentos longos.

3. Atualização do Mecanismo de Atenção Esparsa: Com base no mecanismo de atenção padrão, o DeepSeek V4 adota uma estratégia de esparsidade hierárquica, ajustando dinamicamente a densidade do cálculo de atenção de acordo com a relevância semântica entre tokens. Isso permite que o modelo processe sequências ultra-longas com um custo computacional muito menor do que a atenção completa, reduzindo o custo de inferência em cerca de 40%.

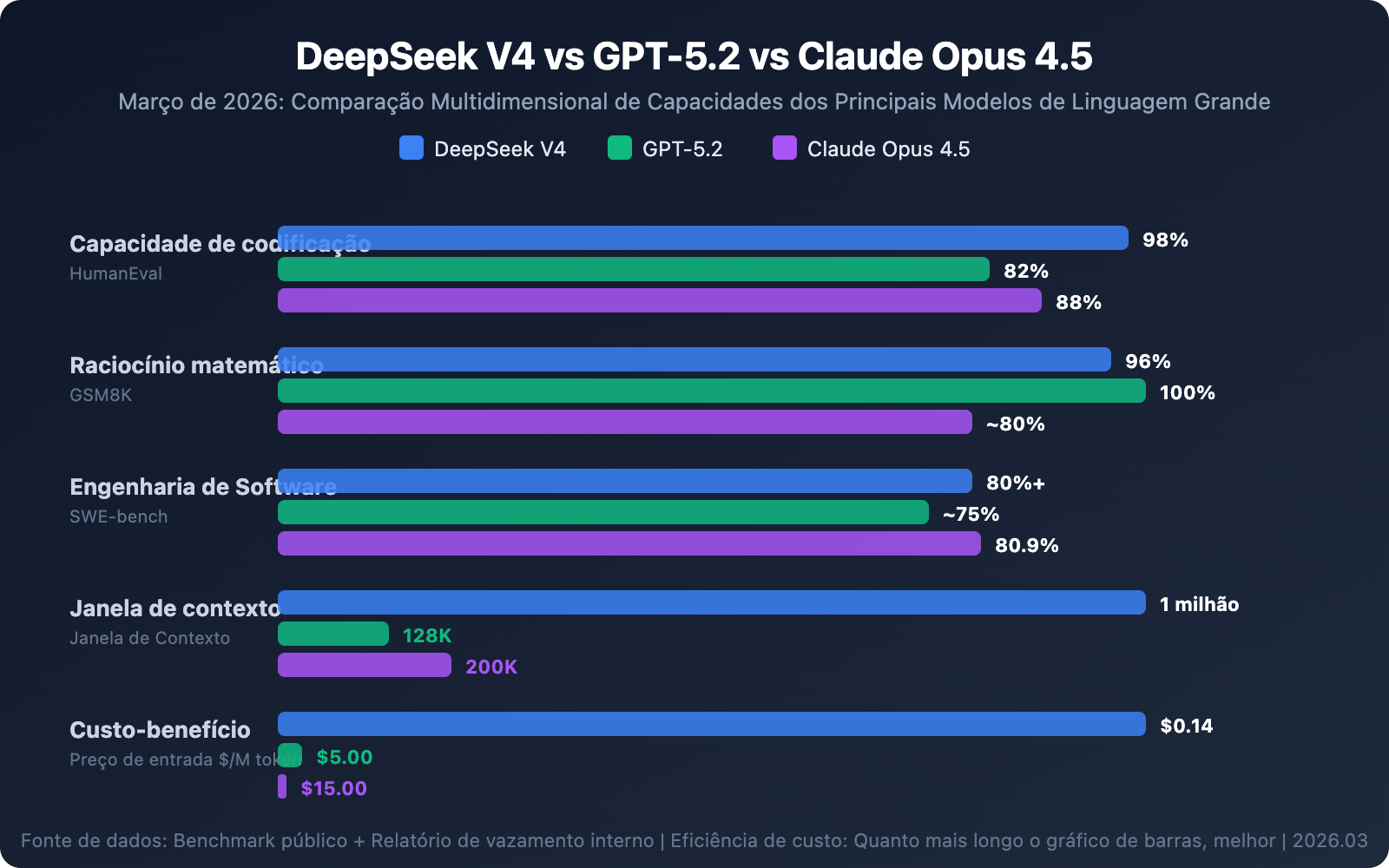

Benchmark de Desempenho e Comparação do Modelo DeepSeek V4

O DeepSeek V4 demonstrou competitividade robusta em diversos benchmarks principais. Abaixo está uma comparação de desempenho entre o DeepSeek V4 e os modelos líderes atuais:

| Benchmark | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | Descrição do Teste |

|---|---|---|---|---|

| HumanEval (Codificação) | 98% | 88% | 82% | Taxa de precisão na geração de código |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | Taxa de resolução de Issues reais do GitHub |

| GSM8K (Matemática) | 96% | ~80% | 100% | Capacidade de raciocínio matemático |

| AIME 2025 | ~85% | ~80% | 100% | Competição matemática de alta dificuldade |

| Comprimento de Contexto | 1 milhão de tokens | 200 mil tokens | 128 mil tokens | Comprimento máximo de entrada |

📊 Nota sobre os Dados: Os dados de benchmark do DeepSeek V4 acima são provenientes de testes internos e relatórios vazados, ainda não verificados por terceiros independentes. O desempenho após o lançamento oficial pode variar. Recomenda-se realizar testes práticos de comparação na plataforma APIYI (apiyi.com) para obter uma experiência de uso real.

Análise Detalhada da Capacidade de Codificação do DeepSeek V4

O desempenho do DeepSeek V4 na área de codificação é particularmente notável. Graças à sua janela de contexto de 1 milhão de tokens, o DeepSeek V4 pode processar um repositório de código inteiro em uma única inferência, permitindo um raciocínio verdadeiramente associativo entre múltiplos arquivos.

As vantagens específicas incluem:

- Compreensão de Repositório Completo: Carregar o código de um projeto inteiro de uma vez, entendendo as dependências entre componentes

- Refatoração entre Arquivos: Manter a consistência global durante refatorações de código em larga escala

- Depuração de Cadeias Longas: Rastrear cadeias de chamadas de bugs que atravessam múltiplos módulos

Isso significa que, ao lidar com tarefas complexas de engenharia de software, o DeepSeek V4 é capaz de realizar análises globais como um desenvolvedor sênior, em vez de se limitar à compreensão fragmentada de um único arquivo.

Capacidades Multimodais do DeepSeek V4 Explicadas

Diferente de sua versão anterior puramente textual, o DeepSeek V4 é um modelo multimodal nativo, processando simultaneamente dados de texto, imagem, vídeo e áudio durante a fase de treinamento, em vez de "encaixar" capacidades visuais posteriormente em um modelo de texto.

Matriz de Capacidades Multimodais do DeepSeek V4

| Dimensão de Capacidade | Suporte | Cenários de Aplicação Típicos |

|---|---|---|

| Geração de Texto | ✅ Capacidade principal | Codificação, redação, análise, tradução |

| Geração de Imagens | ✅ Suporte nativo | Texto para imagem, assistência em design, geração de gráficos |

| Geração de Vídeo | ✅ Suporte nativo | Geração de vídeos curtos, criação de animações |

| Compreensão de Imagem | ✅ Suporte nativo | Análise de imagens, OCR, perguntas e respostas visuais |

| Compreensão de Vídeo | ✅ Suporte nativo | Resumo de vídeo, análise de conteúdo |

| Processamento de Áudio | 🔄 A confirmar | Reconhecimento de voz, análise de áudio |

A vantagem central do design multimodal nativo está na coerência do raciocínio entre modalidades. Por exemplo, quando um usuário solicita "gere um diagrama de arquitetura com base neste código", o modelo pode entender a lógica do código e, ao mesmo tempo, gerar diretamente um gráfico visual de alta qualidade, sem depender de cadeias de ferramentas externas.

A DeepSeek também promete adicionar marca d'água obrigatória a todo conteúdo de mídia gerado e equipar o sistema com filtragem de conteúdo em tempo real, garantindo a segurança e conformidade do conteúdo gerado.

Preços e Métodos de Acesso da API DeepSeek V4

A precificação da API DeepSeek V4 mantém a estratégia de alto custo-benefício característica da DeepSeek, oferecendo vantagens significativas de custo em comparação com os principais concorrentes:

| Item de Cobrança | Preço DeepSeek V4 | Preço de Referência GPT-5 | Vantagem de Custo |

|---|---|---|---|

| Token de entrada | US$ 0,14 / milhão | US$ 5,00 / milhão | ~35x |

| Token de saída | US$ 0,28 / milhão | US$ 15,00 / milhão | ~53x |

| Entrada em cache | US$ 0,07 / milhão | – | Economia adicional de 50% em caso de acerto no cache |

| Cota gratuita | 5 milhões de tokens | – | Disponível para novos usuários no registro |

Acesso Rápido à API DeepSeek V4

Aqui está um exemplo de código mínimo para invocar a DeepSeek V4 via API:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Interface unificada da APIYI

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "Analise o design de arquitetura deste código"}],

max_tokens=4096

)

print(response.choices[0].message.content)

Ver exemplo de chamada multimodal (geração de imagens)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Interface unificada da APIYI

)

# Exemplo de chamada texto para imagem

response = client.images.generate(

model="deepseek-v4",

prompt="Um robô fofo escrevendo código, estilo cyberpunk",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 Comece rápido: Recomendamos usar a plataforma APIYI apiyi.com para acessar a DeepSeek V4 rapidamente. A plataforma oferece uma interface de API unificada pronta para uso, sem configuração complexa, com cota de teste gratuita no registro. A integração pode ser concluída em 5 minutos.

Ecossistema Open Source e Impacto Estratégico da DeepSeek V4

A DeepSeek V4 planeja ser lançada sob uma licença de código aberto, o que significa que desenvolvedores de todo o mundo podem baixar, ajustar e implantar o modelo gratuitamente. Essa estratégia tem um impacto profundo no cenário da indústria de IA:

Impacto nos Desenvolvedores:

- Implantação de modelos de trilhões de parâmetros em ambientes privados, garantindo privacidade de dados.

- Suporte a ajustes finos para domínios específicos, construindo modelos especializados por setor.

- Um ecossistema impulsionado pela comunidade acelerará a iteração das capacidades do modelo.

Impacto na Indústria:

- Modelos de código aberto de trilhões de parâmetros reduzirão significativamente a barreira de entrada para o desenvolvimento de aplicações de IA.

- Impulsionará uma queda adicional nos preços das APIs, beneficiando pequenas e médias empresas.

- Acelerará a adoção e inovação em aplicações de IA multimodal.

Ecossistema de Hardware:

Vale notar que a DeepSeek V4 já foi otimizada para chips de IA nacionais, como os da Huawei e Cambricon, reduzindo a dependência de GPUs NVIDIA. Isso não é apenas uma escolha técnica, mas também reflete a tendência atual de diversificação da cadeia de suprimentos de IA.

💡 Recomendação de Desenvolvimento: Seja para invocação via API na nuvem ou implantação privada, recomendamos primeiro validar funcionalidades e avaliar desempenho através da plataforma APIYI apiyi.com. Confirme que atende às necessidades do seu negócio antes de decidir o plano de implantação.

Perguntas Frequentes

Q1: Quando o DeepSeek V4 será lançado oficialmente?

De acordo com várias fontes, o DeepSeek V4 está previsto para ser lançado na primeira semana de março de 2026, com o momento escolhido para ser antes da "Duas Sessões" da China (que começam em 4 de março). O modelo será lançado sob uma licença de código aberto, e o serviço de API também será disponibilizado simultaneamente. Recomenda-se acompanhar os canais oficiais do DeepSeek para obter informações de lançamento em primeira mão, ou experimentar o acesso imediatamente através da plataforma APIYI apiyi.com.

Q2: O contexto de 1 milhão de tokens do DeepSeek V4 é realmente prático?

O contexto de 1 milhão de tokens é muito prático para cenários específicos, especialmente análise de grandes bases de código (carregando todo o projeto de uma vez), processamento de documentos longos (contratos legais, manuais técnicos) e diálogos complexos de múltiplas rodadas. No entanto, para tarefas diárias com textos curtos, não é necessária uma janela de contexto tão grande. Recomenda-se escolher a configuração de parâmetros apropriada de acordo com a necessidade real, e através do APIYI apiyi.com você pode ajustar flexivelmente os parâmetros de invocação para testes.

Q3: O preço do DeepSeek V4 é tão baixo, a qualidade é garantida?

O baixo custo do DeepSeek vem da arquitetura MoE (apenas 37B de parâmetros ativados por inferência, em vez de todos os 1T) e otimizações de engenharia, não de uma redução na qualidade. Pelos benchmarks públicos, o desempenho do DeepSeek V4 em tarefas de codificação e matemática está no mesmo nível do GPT-5 e Claude. Recomenda-se realizar testes adequados em cenários reais antes da adoção formal.

Resumo

Os principais pontos de destaque do DeepSeek V4:

- Arquitetura MoE de trilhões de parâmetros: 1T de parâmetros totais, 37B de parâmetros ativos, alcançando um equilíbrio inovador entre desempenho e eficiência

- Capacidade multimodal nativa: Não é um "texto + plugin visual", mas um processamento unificado de texto, imagem e vídeo desde a fase de treinamento

- Contexto de 1 milhão de tokens: Tem significado revolucionário para análise de grandes bases de código e processamento de documentos longos

- Custo-benefício extremo: O preço da API é apenas 1/35 do GPT-5, reduzindo significativamente os custos dos desenvolvedores

- Ecossistema de código aberto: A estratégia de lançamento de código aberto acelerará a inovação da comunidade e as aplicações da indústria

O lançamento do DeepSeek V4 marca a entrada oficial dos Modelos de Linguagem Grande de código aberto na era multimodal de trilhões de parâmetros. Para os desenvolvedores, isso significa menor barreira de entrada e opções técnicas mais ricas.

Recomenda-se experimentar a capacidade completa do DeepSeek V4 imediatamente através do APIYI apiyi.com. A plataforma oferece créditos gratuitos e uma interface unificada para múltiplos modelos, facilitando a comparação e avaliação rápidas.

📚 Referências

-

Reportagem da TechNode: Plano de lançamento do modelo multimodal DeepSeek V4

- Link:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - Descrição: Reportagem autoritativa sobre o cronograma de lançamento do DeepSeek V4 e parcerias de hardware

- Link:

-

Documentação oficial da API DeepSeek: Preços dos modelos e especificações da interface

- Link:

api-docs.deepseek.com/quick_start/pricing - Descrição: Documentação técnica e de preços oficial da API, leitura obrigatória para desenvolvimento e integração

- Link:

-

Comparativo de benchmarks de modelos de IA: Ranking de desempenho dos principais Modelos de Linguagem Grande em 2026

- Link:

lmcouncil.ai/benchmarks - Descrição: Plataforma de benchmark independente de terceiros, fornecendo dados objetivos de comparação de desempenho de modelos

- Link:

Autor: Equipe técnica da APIYI

Discussões técnicas: Convidamos você a compartilhar suas experiências de uso do DeepSeek V4 nos comentários. Para mais materiais sobre integração de API, visite o centro de documentação da APIYI em docs.apiyi.com