Nota do autor: Uma análise profunda sobre o real motivo do encerramento do OpenAI Sora 2, a pressão competitiva do Seedance 2.0 e a estratégia de concentração de poder computacional por trás da decisão da Anthropic de não desenvolver modelos de imagem e vídeo, além das lições para o setor.

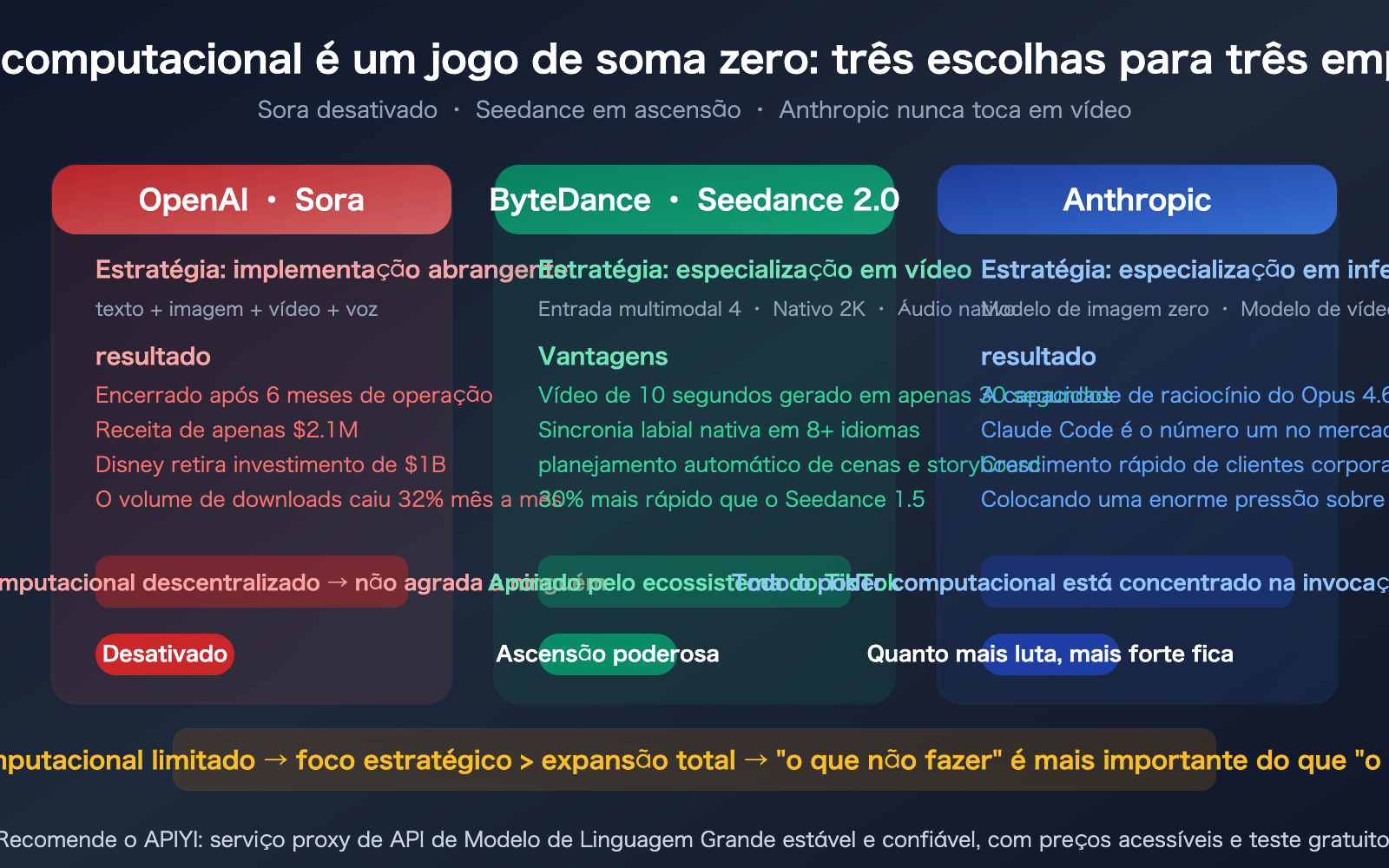

Em 24 de março de 2026, a OpenAI anunciou oficialmente o encerramento do Sora — após apenas 6 meses no ar, com uma receita acumulada de apenas 2,1 milhões de dólares e a retirada de um plano de investimento de 1 bilhão de dólares pela Disney. Paralelamente, o Seedance 2.0, da ByteDance, conquistou o mercado rapidamente com resolução 2K nativa, entrada multimodal e geração ultrarrápida em 30 segundos. Mas um fato ainda mais digno de reflexão é que a Anthropic, desde o início, nunca desenvolveu nenhum modelo de geração de imagem ou vídeo, e ainda assim continua crescendo com força na corrida da IA. Este artigo analisa, sob a ótica da economia de poder computacional, a lógica subjacente ao fim do Sora, à ascensão do Seedance e à estratégia de foco da Anthropic.

Valor central: Entenda em 3 minutos o dilema do poder computacional no mercado de geração de vídeo por IA e por que a estratégia de "o que não fazer" é mais importante do que "o que fazer".

title: Fatos sobre o encerramento do Sora 2

description: Uma análise técnica sobre os motivos estratégicos e financeiros por trás do encerramento do Sora 2 pela OpenAI.

Fatos sobre o encerramento do Sora 2

Vamos entender primeiro o que aconteceu, para depois analisar o porquê.

| Fato | Detalhes | Impacto |

|---|---|---|

| Data de encerramento | Anunciado oficialmente em 24 de março de 2026 | Apenas 6 meses após o lançamento |

| Receita acumulada | Cerca de US$ 2,1 milhões em compras no app | Insuficiente para cobrir custos de computação |

| Tendência de downloads | Pico de 3,33 milhões em novembro → 1,13 milhão em fevereiro | Queda mensal de 32% |

| Saída da Disney | Retirada do plano de investimento de US$ 1 bilhão | Perda do parceiro de conteúdo mais importante |

| Posição oficial | "Crescimento na demanda por computação, foco em simulação de mundo para robótica" | Realocação de poder computacional para modelos de texto/raciocínio |

| Atitude do CEO | Sam Altman disse aos funcionários: encerrar o Sora libera recursos para a próxima geração de modelos | Vídeo não é uma prioridade |

A equipe do Sora disse em sua declaração de despedida: "Estamos nos despedindo do Sora. Obrigado a cada um que usou o Sora para criar, compartilhar e construir comunidades. O que vocês fizeram com o Sora é importante, e sabemos que esta notícia é decepcionante."

Ao mesmo tempo, a CNBC apontou que a OpenAI está cortando projetos de alto custo antes do IPO, e o encerramento do Sora faz parte desse controle de custos.

3 razões profundas para o encerramento do Sora 2

Razão 1: O buraco negro de computação da geração de vídeo

Este é o motivo fundamental. O consumo de poder computacional para a geração de vídeo é centenas de vezes maior que o da geração de texto:

| Tipo de tarefa | Consumo de computação por vez | Produção por dólar | Eficiência de uso da GPU |

|---|---|---|---|

| Conversa de texto | Nível de milissegundos | Milhares de conversas | Altíssima |

| Geração de imagem | Nível de segundos | Centenas de imagens | Alta |

| Geração de vídeo (10s) | Nível de minutos | Dezenas de vídeos | Baixa |

Cada solicitação de vídeo do Sora "martelava" a infraestrutura de servidores da OpenAI, e mesmo o modelo de assinatura não conseguia cobrir os custos. Mais importante: se essas GPUs fossem usadas para modelos de texto e raciocínio (GPT-5, o3, etc.), poderiam gerar um valor comercial muito maior.

Razão 2: O impacto competitivo de rivais como o Seedance 2.0

O Seedance 2.0 da ByteDance foi lançado em fevereiro de 2026 e superou o Sora em quase todas as dimensões:

| Dimensão de comparação | Sora | Seedance 2.0 |

|---|---|---|

| Resolução de saída | 1080p | 2K nativo (2048×1080) |

| Velocidade de geração | ~60-120s / 10s de vídeo | ~30s / 10s de vídeo |

| Modalidades de entrada | Texto + Imagem | Texto + Imagem (9) + Vídeo (3) + Áudio (3) |

| Áudio nativo | Não suportado (requer dublagem posterior) | Suportado (sincronia labial em 8+ idiomas) |

| Controle de câmera | Básico | Storyboard automático e planejamento de câmera |

| Vantagem de ecossistema | Aplicativo independente | Baseado no ecossistema de conteúdo do TikTok/Douyin |

O Seedance 2.0 conta com o ecossistema do TikTok da ByteDance, possuindo naturalmente cenários de consumo de vídeo e base de usuários. Como um aplicativo independente, o Sora carecia de canais de distribuição de conteúdo; após gerar o vídeo, o usuário não tinha um destino claro para o consumo.

Além do Seedance, o Veo 3 do Google, o Kling 2.0 do Kuaishou e o Ray 2 da Luma também lançaram concorrentes no início de 2026. O mercado de geração de vídeo tornou-se extremamente saturado, e a vantagem de pioneirismo do Sora foi igualada ou superada.

Razão 3: Ajuste estratégico da própria OpenAI

A OpenAI enfrenta uma pressão competitiva imensa da Anthropic. Relatórios da Bloomberg e da CNBC mencionam que o sistema de IA da Anthropic tem crescido rapidamente em popularidade entre clientes corporativos e engenheiros de software, representando uma ameaça comercial direta à OpenAI.

Sob essa pressão, a OpenAI precisa concentrar seu poder computacional no campo de batalha principal: raciocínio de texto e capacidade de codificação. Cada GPU usada para renderizar vídeos do Sora é uma GPU que não foi usada para treinar o GPT-5 ou otimizar o o3.

🎯 Insight do setor: O encerramento do Sora não significa que a "geração de vídeo não funciona", mas sim que "fazer geração de vídeo não é rentável para a OpenAI". O poder computacional estava disperso em muitas linhas de produtos, impedindo que qualquer uma delas atingisse seu potencial máximo.

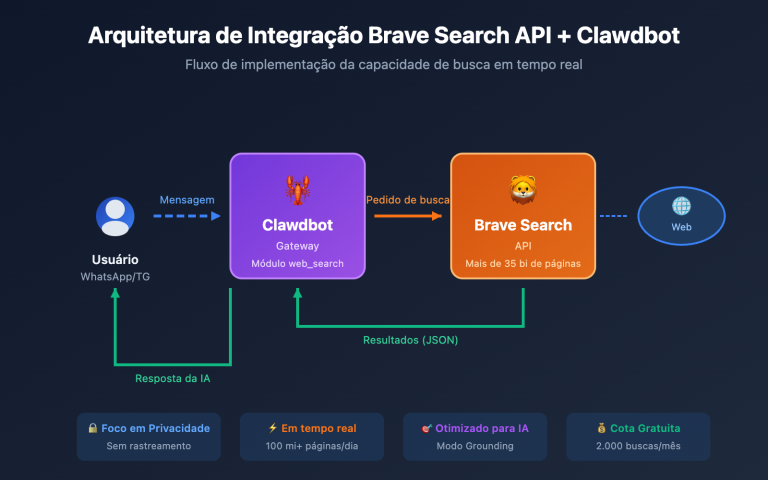

Se sua aplicação de IA precisa invocar modelos de texto e vídeo simultaneamente, recomendamos o gerenciamento unificado através da APIYI (apiyi.com), uma plataforma que cobre diversos modelos como Seedance, Kling, Claude e outros.

Por que a Anthropic nunca investiu em modelos de imagem e vídeo

Esta é uma escolha estratégica que merece uma reflexão mais profunda. Desde a sua fundação, a Anthropic nunca lançou nenhum modelo de geração de imagens ou vídeos — nem mesmo seguiu a rota de "modelo de texto com capacidades de imagem integradas", como o Nano Banana (geração de imagens do Gemini) do Google.

A estratégia de concentração de poder computacional da Anthropic

A lógica da Anthropic é simples: o poder computacional é limitado e deve ser totalmente concentrado nas direções de maior valor.

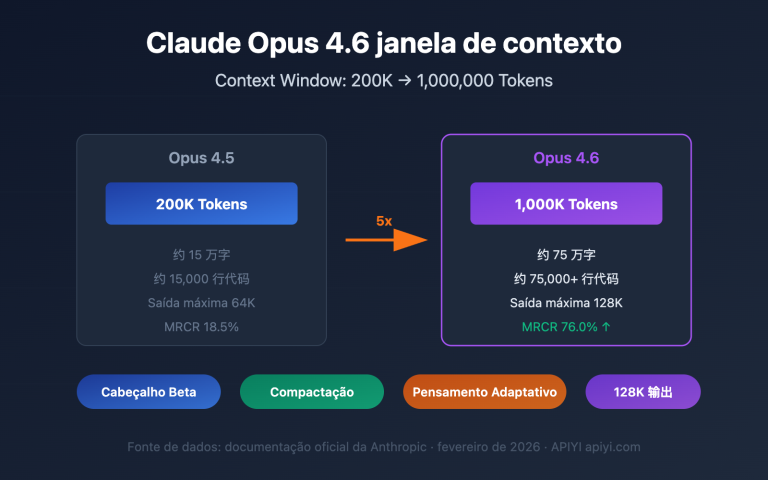

Para a Anthropic, as direções de maior valor são o raciocínio e o código — estas são as capacidades essenciais pelas quais os clientes corporativos estão dispostos a pagar caro. O motivo pelo qual a capacidade de raciocínio do Opus 4.6 consegue superar a concorrência deve-se, em grande parte, ao fato de a Anthropic não ter dispersado suas GPUs em modelos de imagem e vídeo.

Isso cria um contraste nítido com a OpenAI:

| Dimensão Estratégica | OpenAI (Dispersa) | Anthropic (Concentrada) |

|---|---|---|

| Linha de produtos | GPT + DALL·E + Sora + Whisper + Jukebox | Claude (apenas texto/código) |

| Alocação de poder computacional | Texto + Imagem + Vídeo + Áudio | 100% raciocínio de texto |

| Competitividade central | "Faz de tudo" | "O melhor em raciocínio e código" |

| Modelo de negócios | Consumidor + API + Corporativo | API + Corporativo (alto valor por cliente) |

| Resultado do Sora | Descontinuado em 6 meses, US$ 2,1M de receita | — |

| Resultado do Claude Code | — | Líder no mercado de agentes de codificação |

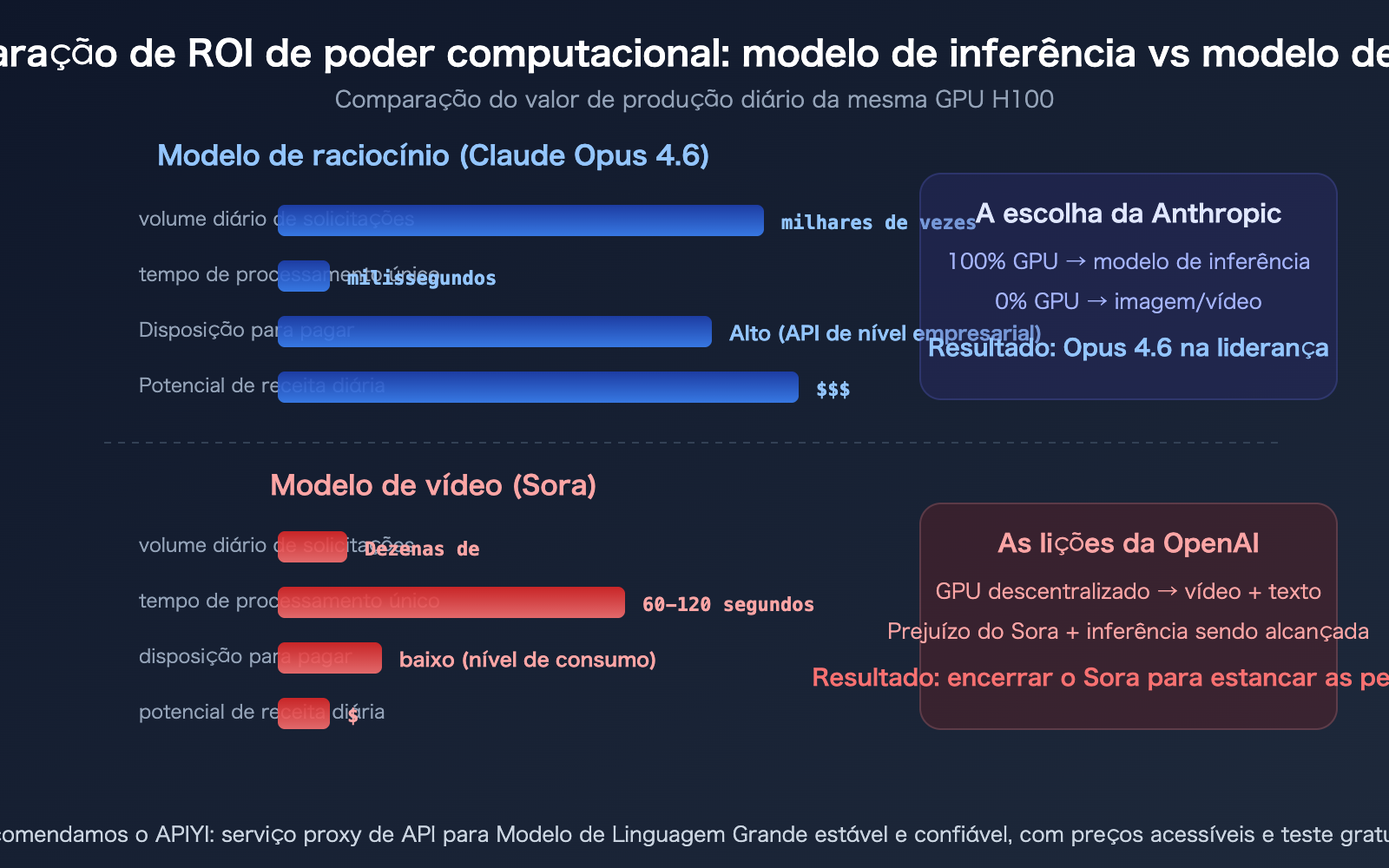

Por que o ROI dos modelos de raciocínio é muito superior ao dos modelos de vídeo

Do ponto de vista comercial, o retorno por unidade de poder computacional entre modelos de raciocínio e modelos de vídeo não está na mesma escala:

- Modelos de raciocínio: Clientes corporativos pagam por token, com margens de lucro altas, alta frequência de uso e capacidade de integração em fluxos de trabalho.

- Modelos de vídeo: A disposição do consumidor para pagar é baixa (o Sora provou isso), o consumo de poder computacional é gigantesco e a frequência de uso é baixa.

Uma GPU H100 usada para rodar o Claude Opus 4.6 pode atender a milhares de solicitações de raciocínio de nível corporativo por dia, gerando uma receita de API considerável. A mesma GPU usada para geração de vídeo só conseguiria gerar algumas dezenas de vídeos por dia, e a maioria dos usuários não estaria disposta a pagar por isso.

O sinal por trás da ausência de geração de imagens na Anthropic

Embora arquivos de configuração vazados mostrem que existem nomes de funções como create_image e edit_image internamente no Claude, a Anthropic ainda não lançou oficialmente nenhuma capacidade de geração de imagens. No Manifold, a probabilidade de o mercado acreditar que "a Anthropic lançará um modelo de geração de imagens em 2026" continua caindo.

A cultura institucional e a estratégia de alocação de recursos da Anthropic apontam para a mesma direção: levar a capacidade de raciocínio ao extremo, em vez de dispersar energia com imagens e vídeos.

🎯 Dica para desenvolvedores: O fato de a Anthropic não fazer imagens/vídeos não significa que sua aplicação não possa ter essas capacidades. Através do serviço proxy de API da APIYI (apiyi.com), você pode acessar simultaneamente o Claude (raciocínio), o Nano Banana 2 (geração de imagens) e o Seedance (geração de vídeos), complementando as vantagens de diferentes modelos.

A Economia da Computação no Setor de Geração de Vídeo por IA

O encerramento do Sora serviu como um alerta para toda a indústria de geração de vídeo por IA: existe um abismo enorme entre o consumo de poder computacional dos modelos de vídeo e a sua viabilidade comercial.

Comparativo de Preços de API para Geração de Vídeo por IA

| Modelo | Preço por segundo de vídeo | Custo de 10s de vídeo | Velocidade de geração | Resolução |

|---|---|---|---|---|

| Sora | $0,10/s | $1,00 | 60-120 s | 1080p |

| Kling 2.0 | $0,07/s | $0,70 | Médio | 1080p |

| Ray 2 | $0,05-0,16/s | $0,50-1,62 | 47-167 s | 1080p |

| Ray 2 Flash | $0,02-0,05/s | $0,17-0,54 | 30-53 s | 720p |

| Seedance 2.0 | Não divulgado | Níveis de pagamento | ~30 s | 2K |

Comparando com o custo dos modelos de texto: o preço de saída de tokens do Claude Opus 4.6 é de cerca de $60 por milhão de tokens, sendo que uma conversa de inferência completa (~1000 tokens de saída) custa cerca de $0,06 — o que equivale apenas ao custo de gerar 0,6 segundos de vídeo pelo Sora.

Quem sobreviverá no setor de vídeo

O encerramento do Sora não significa que a geração de vídeo por IA não tenha futuro, mas aponta para uma condição crucial: apenas empresas que possuem um ecossistema de conteúdo podem sobreviver a longo prazo no setor de vídeo.

- ByteDance (Seedance): Com o suporte do TikTok e do Douyin, possui naturalmente cenários de consumo de vídeo e uma base de usuários.

- Google (Veo): Com o suporte do YouTube, a maior plataforma de vídeo do mundo.

- Kuaishou (Kling): Plataforma de vídeos curtos, com um ecossistema fechado.

Por outro lado, a OpenAI não possui sua própria plataforma de conteúdo — os vídeos gerados pelo Sora carecem de uma saída para consumo; os usuários não sabem onde publicar os vídeos após criá-los.

Dica: Embora o Sora tenha sido desativado, o mercado de API para geração de vídeo continua ativo. Modelos como Kling, Seedance e Ray 2 podem ser acessados de forma unificada através da APIYI (apiyi.com), permitindo que você utilize diversas capacidades de geração de vídeo com uma única chave API.

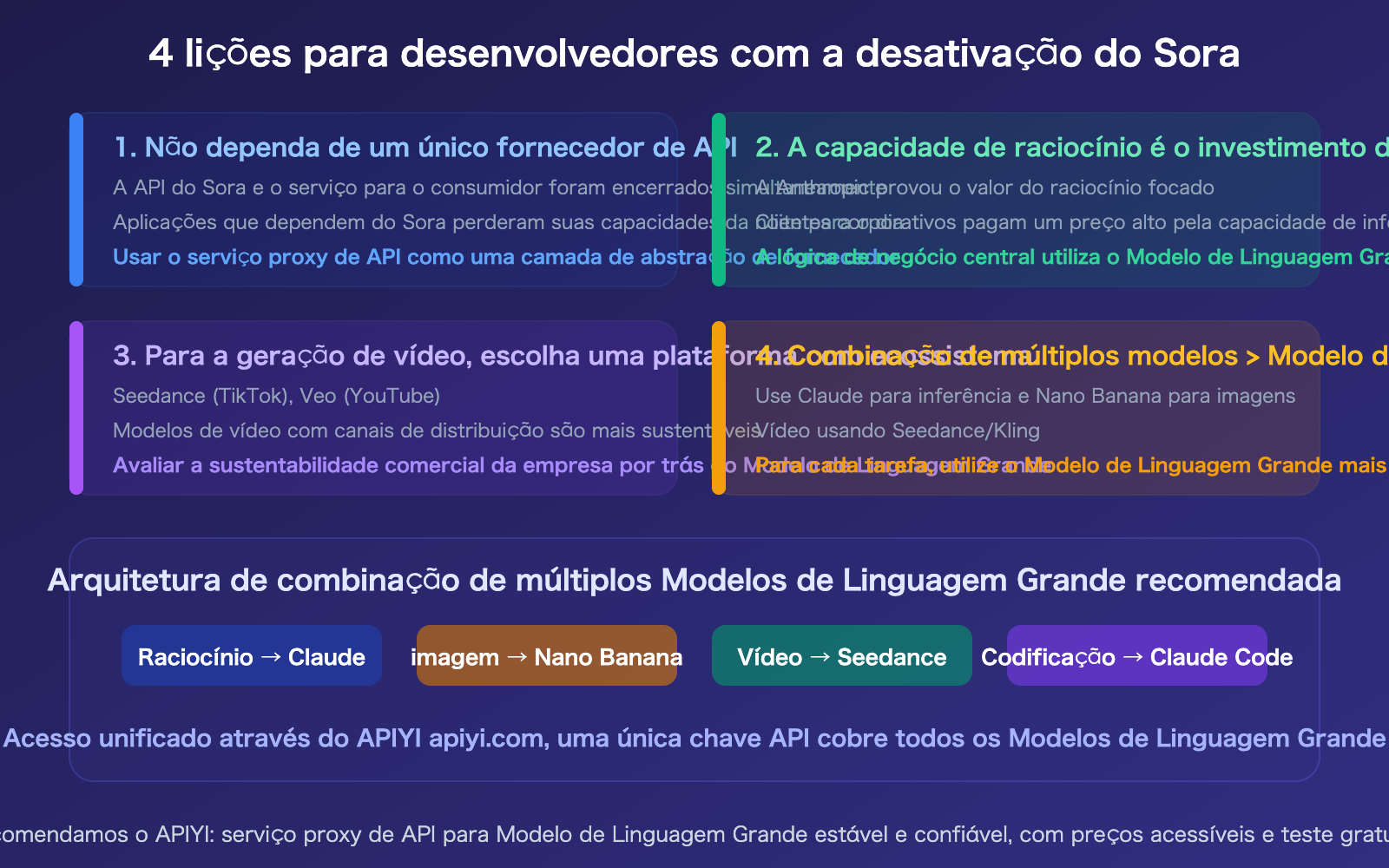

Lições para desenvolvedores

Perguntas Frequentes

Q1: Com o encerramento do Sora, o que acontece com a minha integração de API do Sora?

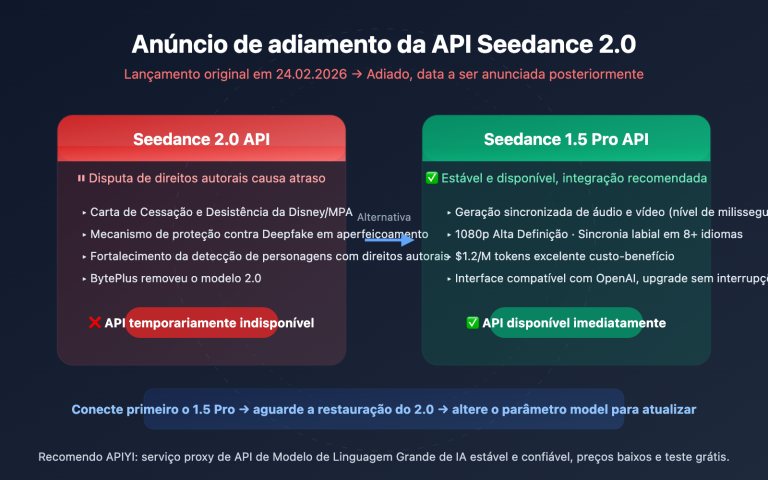

A API e o serviço ao consumidor do Sora foram descontinuados simultaneamente, portanto, todas as integrações de API deixarão de funcionar. Recomendamos migrar imediatamente para alternativas: Seedance 2.0 (maior qualidade e velocidade), Kling 2.0 (melhor custo-benefício, US$ 0,07/segundo) ou Ray 2 Flash (a opção mais barata, a partir de US$ 0,02/segundo). Através da APIYI (apiyi.com), você pode alternar rapidamente para esses modelos alternativos apenas alterando o nome do modelo.

Q2: A Anthropic pretende criar geração de imagens ou vídeos no futuro?

É pouco provável a curto prazo. Embora documentos vazados mostrem a existência de uma função create_image internamente no Claude, a cultura institucional e a estratégia de alocação de recursos da Anthropic priorizam a capacidade de raciocínio. O mercado de previsões Manifold também indica uma probabilidade baixa. A vantagem competitiva da Anthropic vem justamente dessa disciplina estratégica de "saber o que não fazer", concentrando todo o poder computacional no raciocínio.

Q3: Qual é mais adequado para integração de API: Seedance 2.0 ou Kling 2.0?

Depende da sua necessidade: o Seedance 2.0 é superior em qualidade e funcionalidades (nativo 2K, áudio nativo, entrada multimodal), mas o preço da API ainda não é totalmente transparente. O preço da API do Kling 2.0 é mais transparente (US$ 0,07/segundo) e o ecossistema é mais aberto. Se você busca a máxima qualidade, escolha o Seedance; se busca custo-benefício, escolha o Kling. Ambos podem ser acessados via APIYI (apiyi.com).

Q4: O encerramento do Sora pela OpenAI afetará o desenvolvimento do GPT-5?

Pelo contrário — o encerramento do Sora serve justamente para liberar poder computacional para o GPT-5. Sam Altman deixou claro aos funcionários que os recursos liberados pelo Sora serão destinados ao modelo de próxima geração. Do ponto de vista competitivo, a OpenAI enfrenta um forte desafio da Anthropic Claude no mercado corporativo e precisa concentrar seu poder computacional em texto e raciocínio para manter sua competitividade.

Resumo

As principais lições do encerramento do Sora:

- Poder computacional é um jogo de soma zero: A lição da OpenAI prova que tentar fazer texto, imagem, vídeo e áudio simultaneamente impede que qualquer uma dessas áreas atinja o nível máximo. A Anthropic nunca tocou em imagens ou vídeos, concentrando 100% do poder computacional no raciocínio, o que resultou na capacidade de raciocínio do Opus 4.6 superando a concorrência.

- O setor de vídeo precisa de um ecossistema de conteúdo: A falta de canais de distribuição do Sora resultou em baixa retenção de usuários e uma receita de apenas US$ 2,1 milhões. O Seedance conta com o suporte do TikTok e o Veo com o YouTube, possuindo cenários naturais de consumo de vídeo.

- A combinação de múltiplos modelos é a solução ideal: A estratégia de que "o que não fazer" é mais importante do que "o que fazer" significa que os desenvolvedores devem usar uma combinação dos melhores modelos de cada área, em vez de depender de um modelo "faz-tudo".

Recomendamos gerenciar a invocação do modelo de forma unificada através da APIYI (apiyi.com) — use o Claude para raciocínio, Nano Banana para imagens e Seedance/Kling para vídeos — a plataforma oferece créditos gratuitos e uma interface unificada, cobrindo todos os modelos com uma única chave API.

📚 Referências

-

TechCrunch: OpenAI encerra o Sora: Relatório completo sobre o encerramento do Sora

- Link:

techcrunch.com/2026/03/24/openais-sora-was-the-creepiest-app-on-your-phone-now-its-shutting-down/ - Descrição: Inclui dados de download, receita e o comunicado oficial da OpenAI

- Link:

-

CNBC: OpenAI fecha o Sora enquanto a empresa tenta reduzir custos: Análise sob a perspectiva de custos computacionais e IPO

- Link:

cnbc.com/2026/03/24/openai-shutters-short-form-video-app-sora-as-company-reels-in-costs.html - Descrição: Inclui dados financeiros e análise da pressão competitiva

- Link:

-

Variety: Disney desiste de planos de investimento de US$ 1 bilhão: Relatório sobre a retirada de investimento da Disney

- Link:

variety.com/2026/digital/news/openai-shutting-down-sora-video-disney-1236698277/ - Descrição: Contexto detalhado sobre a saída da Disney da parceria

- Link:

-

Site oficial do Seedance 2.0: Apresentação completa das funcionalidades do modelo de geração de vídeo da ByteDance

- Link:

seedance2.ai - Descrição: Inclui detalhes sobre entrada multimodal, saída em 2K e recursos de áudio nativo

- Link:

-

Central de Documentação da APIYI: Integração de API unificada para múltiplos modelos

- Link:

docs.apiyi.com - Descrição: Suporte para acesso centralizado ao Claude, Nano Banana e modelos de geração de vídeo

- Link:

Autor: Equipe técnica da APIYI

Troca de conhecimento: Sinta-se à vontade para discutir na seção de comentários. Para mais materiais, visite a central de documentação da APIYI em docs.apiyi.com