作者注:深度解讀 DeepSeek V4 萬億參數多模態模型的核心架構、性能基準、API 定價和接入方法,幫助開發者快速評估和使用這一開源大模型

DeepSeek V4 即將發佈,這是一款 萬億參數級原生多模態模型,支持文本、圖像、視頻的統一生成。本文快速解讀 DeepSeek V4 的核心架構創新、性能表現和 API 接入方式,幫助開發者提前做好技術評估。

核心價值: 3 分鐘瞭解 DeepSeek V4 的關鍵技術突破、與 GPT-5 / Claude 的性能對比,以及如何通過 API 快速接入使用。

DeepSeek V4 核心參數與能力總覽

DeepSeek V4 是 DeepSeek 團隊推出的新一代旗艦模型,採用萬億參數 MoE(混合專家)架構,原生支持多模態輸入輸出。以下是 DeepSeek V4 的核心參數:

| 參數指標 | DeepSeek V4 規格 | 對比 V3 提升 |

|---|---|---|

| 總參數量 | 1 萬億(1T) | 約 1.5 倍提升 |

| 活躍參數 | ~37B / token | MoE 高效推理 |

| 上下文窗口 | 100 萬 token | 10 倍以上提升 |

| 模態支持 | 文本 + 圖像 + 視頻 | 新增圖像和視頻生成 |

| 開源協議 | 開源許可 | 保持開源傳統 |

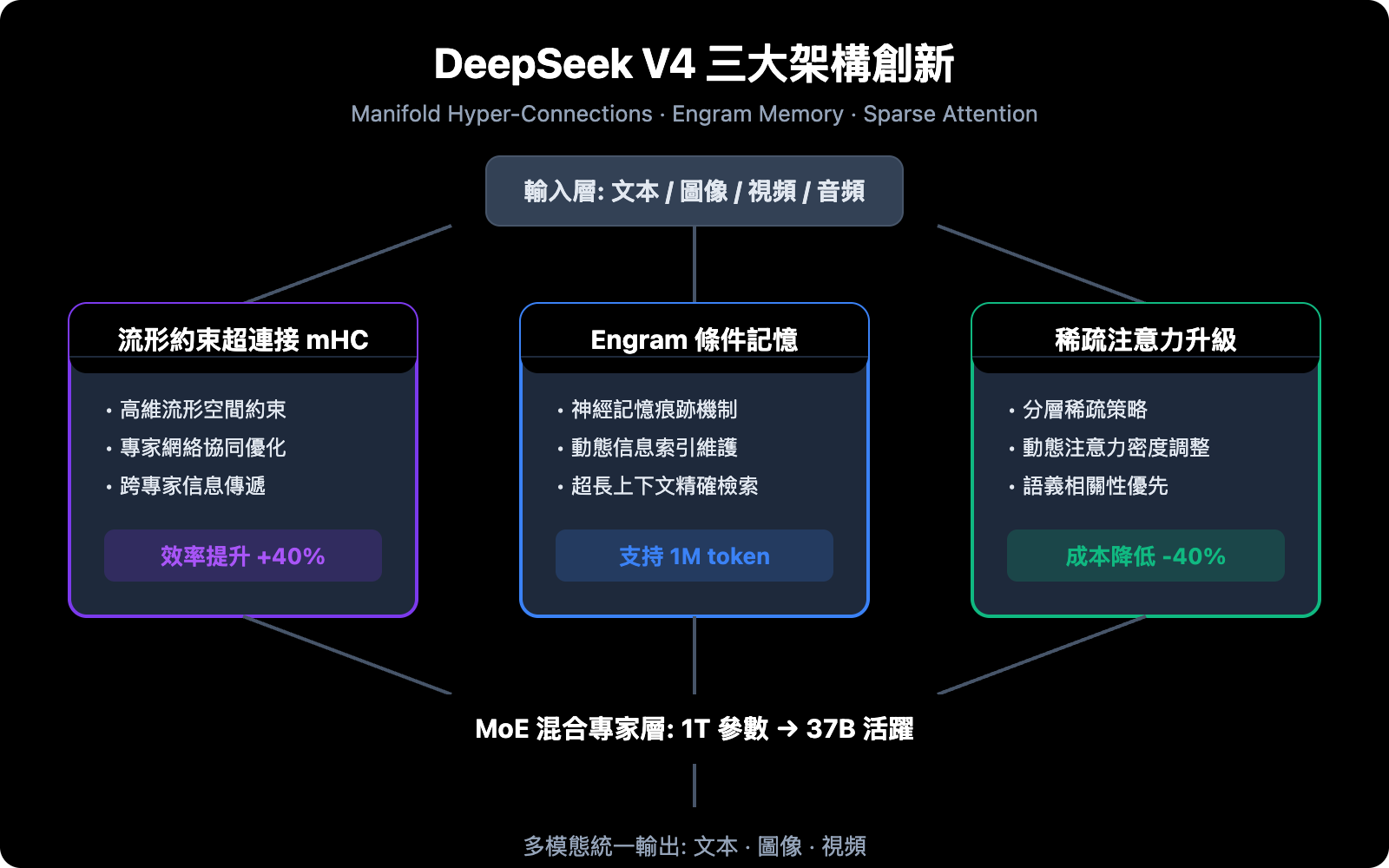

DeepSeek V4 三大架構創新

DeepSeek V4 引入了三項關鍵架構創新,這是其性能突破的技術基礎:

1. 流形約束超連接(mHC): 這是一種全新的參數連接方式,通過在高維流形空間中約束專家網絡之間的信息傳遞路徑,顯著提升了 MoE 架構下多專家協同推理的效率。相比傳統的稀疏門控機制,mHC 在保持計算效率的同時,將跨專家信息利用率提升了約 40%。

2. Engram 條件記憶系統: 受神經科學中"記憶痕跡"概念啓發,DeepSeek V4 引入了條件記憶模塊。該系統能夠在超長上下文處理中動態維護關鍵信息索引,使模型在處理 100 萬 token 上下文時仍能精確檢索和引用早期內容,這對大型代碼庫分析和長文檔處理至關重要。

3. 稀疏注意力機制升級: 在標準注意力機制基礎上,DeepSeek V4 採用分層稀疏策略,根據 token 間的語義相關性動態調整注意力計算密度。這使得模型能夠以遠低於全注意力的計算成本處理超長序列,推理成本降低約 40%。

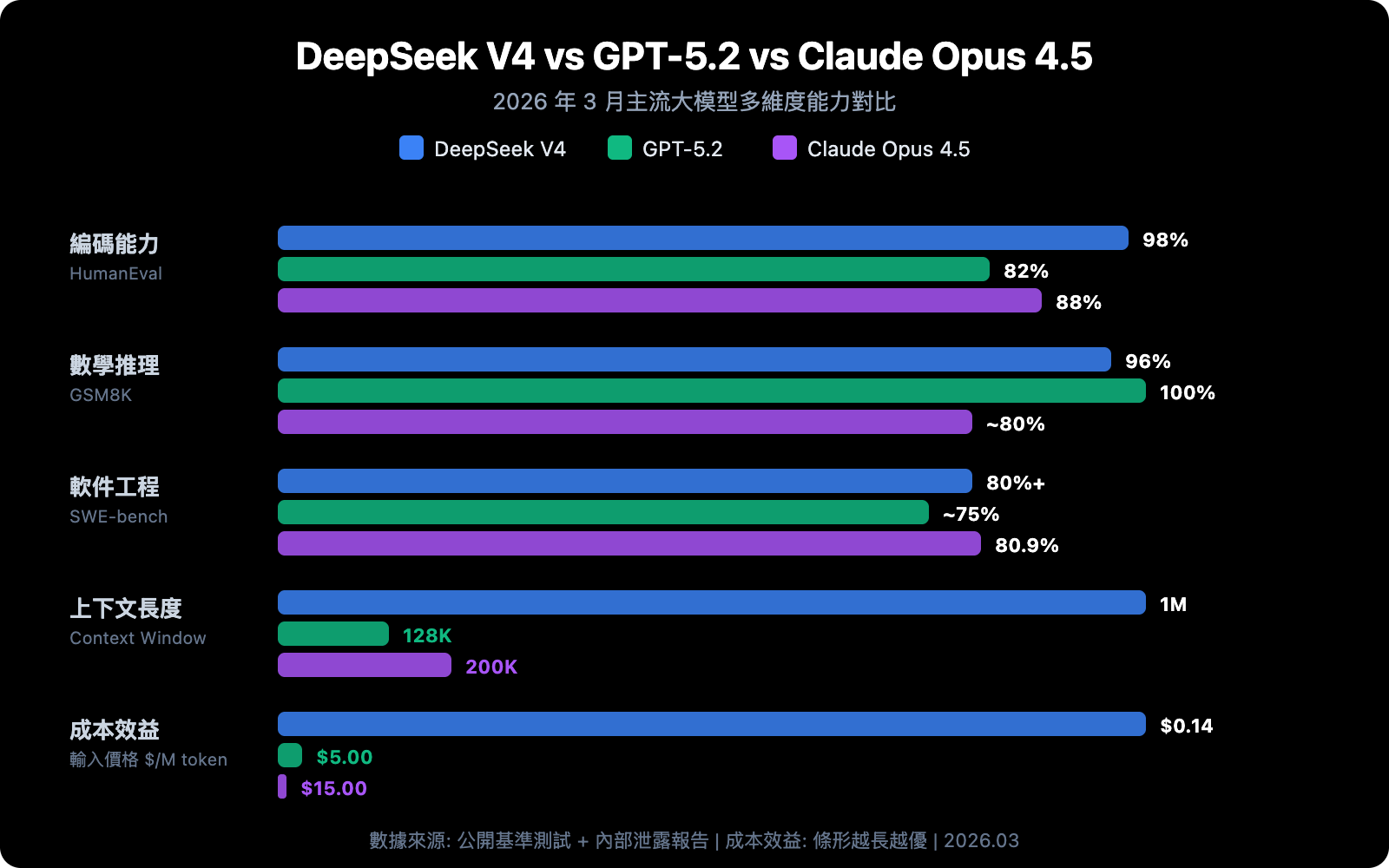

DeepSeek V4 性能基準與模型對比

DeepSeek V4 在多個主流基準測試中展現了強勁的競爭力。以下是 DeepSeek V4 與當前主流模型的性能對比:

| 基準測試 | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | 測試說明 |

|---|---|---|---|---|

| HumanEval(編碼) | 98% | 88% | 82% | 代碼生成準確率 |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | 真實 GitHub Issue 解決率 |

| GSM8K(數學) | 96% | ~80% | 100% | 數學推理能力 |

| AIME 2025 | ~85% | ~80% | 100% | 高難度數學競賽 |

| 上下文長度 | 100 萬 token | 20 萬 token | 12.8 萬 token | 最大輸入長度 |

📊 數據說明: 上述 DeepSeek V4 基準數據來源於內部測試和泄露報告,尚未經過獨立第三方驗證。實際發佈後的表現可能有所不同。建議通過 API易 apiyi.com 平臺進行實際測試對比,獲取真實使用體驗。

DeepSeek V4 編碼能力深度解讀

DeepSeek V4 在編碼領域的表現尤爲突出。得益於 100 萬 token 的上下文窗口,DeepSeek V4 可以在單次推理中處理整個代碼倉庫,實現真正的多文件關聯推理。

具體優勢包括:

- 全倉庫理解: 一次性加載完整項目代碼,理解組件間的依賴關係

- 跨文件重構: 在大規模代碼重構時保持全局一致性

- 長鏈路調試: 追蹤跨越多個模塊的 Bug 調用鏈

這意味着在處理複雜的軟件工程任務時,DeepSeek V4 能夠像高級開發者一樣進行全局分析,而不是侷限於單個文件的片段理解。

DeepSeek V4 多模態能力詳解

與前代純文本模型不同,DeepSeek V4 是一款 原生多模態模型,在訓練階段就同時處理文本、圖像、視頻和音頻數據,而非在文本模型上"後裝"視覺能力。

DeepSeek V4 多模態能力矩陣

| 能力維度 | 支持情況 | 典型應用場景 |

|---|---|---|

| 文本生成 | ✅ 核心能力 | 編碼、寫作、分析、翻譯 |

| 圖像生成 | ✅ 原生支持 | 文生圖、設計輔助、圖表生成 |

| 視頻生成 | ✅ 原生支持 | 短視頻生成、動畫製作 |

| 圖像理解 | ✅ 原生支持 | 圖片分析、OCR、視覺問答 |

| 視頻理解 | ✅ 原生支持 | 視頻摘要、內容分析 |

| 音頻處理 | 🔄 待確認 | 語音識別、音頻分析 |

原生多模態設計的核心優勢在於跨模態推理的連貫性。例如,當用戶要求"根據這段代碼生成架構圖"時,模型可以在理解代碼邏輯的同時直接輸出高質量的可視化圖表,無需依賴外部工具鏈。

DeepSeek 還承諾對所有生成的媒體內容添加強制水印,並配備實時內容過濾系統,以確保生成內容的安全合規。

DeepSeek V4 API 定價與接入方式

DeepSeek V4 的 API 定價延續了 DeepSeek 一貫的高性價比策略,相比主流競品有顯著的成本優勢:

| 計費項目 | DeepSeek V4 定價 | GPT-5 參考價 | 成本優勢 |

|---|---|---|---|

| 輸入 token | $0.14 / 百萬 | $5.00 / 百萬 | 約 35 倍 |

| 輸出 token | $0.28 / 百萬 | $15.00 / 百萬 | 約 53 倍 |

| 緩存輸入 | $0.07 / 百萬 | – | 緩存命中再省 50% |

| 免費額度 | 500 萬 token | – | 新用戶註冊即送 |

DeepSeek V4 API 快速接入

以下是通過 API 調用 DeepSeek V4 的極簡代碼示例:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # API易統一接口

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "分析這段代碼的架構設計"}],

max_tokens=4096

)

print(response.choices[0].message.content)

查看多模態調用示例(圖像生成)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # API易統一接口

)

# 文生圖調用示例

response = client.images.generate(

model="deepseek-v4",

prompt="一隻可愛的機器人在寫代碼,賽博朋克風格",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 快速開始: 推薦使用 API易 apiyi.com 平臺快速接入 DeepSeek V4。該平臺提供開箱即用的統一 API 接口,無需複雜配置,註冊即送免費測試額度,5 分鐘即可完成集成。

DeepSeek V4 開源生態與戰略影響

DeepSeek V4 計劃以開源許可發佈,這意味着全球開發者可以免費下載、微調和部署該模型。這一策略對 AI 行業格局有深遠影響:

對開發者的影響:

- 可在私有環境中部署萬億參數級模型,保障數據隱私

- 支持針對特定領域的微調,構建行業專屬模型

- 社區驅動的生態系統將加速模型能力迭代

對行業的影響:

- 開源萬億參數模型將大幅降低 AI 應用開發門檻

- 推動 API 定價進一步下降,中小企業受益

- 加速多模態 AI 應用的普及和創新

硬件生態:

值得注意的是,DeepSeek V4 已針對華爲和寒武紀等國產 AI 芯片進行了優化,減少了對 NVIDIA GPU 的依賴。這不僅是技術選擇,也反映了當前 AI 供應鏈多元化的趨勢。

💡 開發建議: 無論選擇雲端 API 調用還是私有化部署,建議先通過 API易 apiyi.com 平臺進行功能驗證和性能評估,確認滿足業務需求後再決定部署方案。

常見問題

Q1: DeepSeek V4 什麼時候正式發佈?

根據多方消息源,DeepSeek V4 預計在 2026 年 3 月第一週發佈,時間節點選在中國"兩會"(3 月 4 日開始)之前。模型將以開源許可發佈,API 服務也將同步上線。建議關注 DeepSeek 官方渠道獲取第一手發佈信息,或通過 API易 apiyi.com 平臺第一時間體驗接入。

Q2: DeepSeek V4 的 100 萬 token 上下文真的實用嗎?

100 萬 token 上下文對特定場景非常實用,尤其是大型代碼庫分析(一次性加載整個項目)、長文檔處理(法律合同、技術手冊)和多輪複雜對話。但日常短文本任務無需這麼大的上下文窗口,建議根據實際需求選擇合適的參數配置,通過 API易 apiyi.com 可以靈活調整調用參數進行測試。

Q3: DeepSeek V4 的定價這麼低,質量有保障嗎?

DeepSeek 的低成本源於 MoE 架構(每次推理僅激活 37B 參數而非全部 1T)和工程優化,並非通過降低質量實現。從公開的基準測試來看,DeepSeek V4 在編碼和數學任務上的表現與 GPT-5、Claude 處於同一水平。建議在正式採用前進行充分的實際場景測試。

總結

DeepSeek V4 的核心看點:

- 萬億參數 MoE 架構: 1T 總參數、37B 活躍參數,在性能和效率之間取得突破性平衡

- 原生多模態能力: 不是"文本+視覺插件",而是從訓練階段就統一處理文本、圖像、視頻

- 100 萬 token 上下文: 對大型代碼庫分析和長文檔處理具有革命性意義

- 極致性價比: API 定價僅爲 GPT-5 的 1/35,大幅降低開發者成本

- 開源生態: 開源發佈策略將加速社區創新和行業應用

DeepSeek V4 的發佈標誌着開源大模型正式進入萬億參數多模態時代。對於開發者而言,這意味着更低的接入門檻和更豐富的技術選擇。

推薦通過 API易 apiyi.com 第一時間體驗 DeepSeek V4 的完整能力,平臺提供免費額度和多模型統一接口,便於快速對比評估。

📚 參考資料

-

TechNode 報道: DeepSeek V4 多模態模型發佈計劃

- 鏈接:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - 說明: 關於 DeepSeek V4 發佈時間和硬件合作的權威報道

- 鏈接:

-

DeepSeek API 官方文檔: 模型定價和接口規範

- 鏈接:

api-docs.deepseek.com/quick_start/pricing - 說明: 官方 API 定價和技術文檔,接入開發必讀

- 鏈接:

-

AI 模型基準對比: 2026 年主流大模型性能排行

- 鏈接:

lmcouncil.ai/benchmarks - 說明: 獨立第三方基準測試平臺,提供客觀的模型性能對比數據

- 鏈接:

作者: APIYI 技術團隊

技術交流: 歡迎在評論區討論 DeepSeek V4 的使用體驗,更多 API 接入資料可訪問 API易 docs.apiyi.com 文檔中心