ملاحظة المؤلف: تحليل معمق للهيكل الأساسي، معايير الأداء، تسعير API وطرق الوصول لنموذج DeepSeek V4 متعدد الوسائط ذي التريليون معلمة، لمساعدة المطورين على تقييم واستخدام هذا النموذج اللغوي الكبير مفتوح المصدر بسرعة.

يوشك DeepSeek V4 على الإصدار، وهو نموذج متعدد الوسائط أصلي بمقياس تريليون معلمة، يدعم توليد النصوص والصور والفيديو بشكل موحد. يقدم هذا المقال تفسيرًا سريعًا للابتكارات في الهيكل الأساسي، الأداء وطرق الوصول عبر API لـ DeepSeek V4، لمساعدة المطورين على إجراء التقييم التقني مسبقًا.

القيمة الأساسية: 3 دقائق لفهم الاختراقات التقنية الرئيسية لـ DeepSeek V4، ومقارنة الأداء مع GPT-5 / Claude، وكيفية الوصول السريع عبر API للاستخدام.

نظرة عامة على المعلمات الأساسية وقدرات DeepSeek V4

DeepSeek V4 هو النموذج الرئيسي الجديد من فريق DeepSeek، ويستخدم هيكل MoE (خليط الخبراء) بتريليون معلمة، ويدعم بشكل أصلي الإدخال والإخراج متعدد الوسائط. فيما يلي المعلمات الأساسية لـ DeepSeek V4:

| مؤشر المعلمة | مواصفات DeepSeek V4 | مقارنة مع V3 |

|---|---|---|

| إجمالي المعلمات | 1 تريليون (1T) | تحسين بنحو 1.5 مرة |

| المعلمات النشطة | ~37 مليار / رمز | استدلال فعال مع MoE |

| نافذة السياق | 1 مليون رمز | تحسين بأكثر من 10 مرات |

| دعم الوسائط | نص + صورة + فيديو | إضافة توليد الصور والفيديو |

| ترخيص المصدر المفتوح | ترخيص مفتوح المصدر | الحفاظ على التقليد المفتوح |

ثلاث ابتكارات هيكلية رئيسية في DeepSeek V4

يقدم DeepSeek V4 ثلاث ابتكارات هيكلية رئيسية، وهي الأساس التقني لتحقيق اختراق في الأداء:

1. اتصال فائق مقيد بالمتشعب (mHC): هذه طريقة جديدة تمامًا لربط المعلمات، حيث يتم تقييد مسارات نقل المعلومات بين شبكات الخبراء في فضاء متعدد الأبعاد، مما يحسن بشكل كبير كفاءة الاستدلال التعاوني بين خبراء متعددين في هيكل MoE. مقارنة بآلية البوابات المتفرقة التقليدية، يرفع mHC معدل استخدام المعلومات عبر الخبراء بنحو 40% مع الحفاظ على كفاءة الحساب.

2. نظام ذاكرة شرطي Engram: مستوحى من مفهوم "أثر الذاكرة" في علم الأعصاب، قدم DeepSeek V4 وحدة ذاكرة شرطية. يمكن لهذا النظام الحفاظ ديناميكيًا على فهرس المعلومات الرئيسية أثناء معالجة السياق الطويل جدًا، مما يمكّن النموذج من استرجاع والاستشهاد بالمحتوى المبكر بدقة حتى عند معالجة سياق بطول 1 مليون رمز، وهذا أمر بالغ الأهمية لتحليل مستودعات التعليمات البرمجية الكبيرة ومعالجة المستندات الطويلة.

3. ترقية آلية الانتباه المتفرق: بناءً على آلية الانتباه القياسية، يستخدم DeepSeek V4 استراتيجية متفرقة هرمية، حيث يتم تعديل كثافة حساب الانتباه ديناميكيًا بناءً على الارتباط الدلالي بين الرموز. هذا يمكّن النموذج من معالجة تسلسلات طويلة جدًا بتكلفة حسابية أقل بكثير من الانتباه الكامل، مما يقلل تكلفة الاستدلال بنحو 40%.

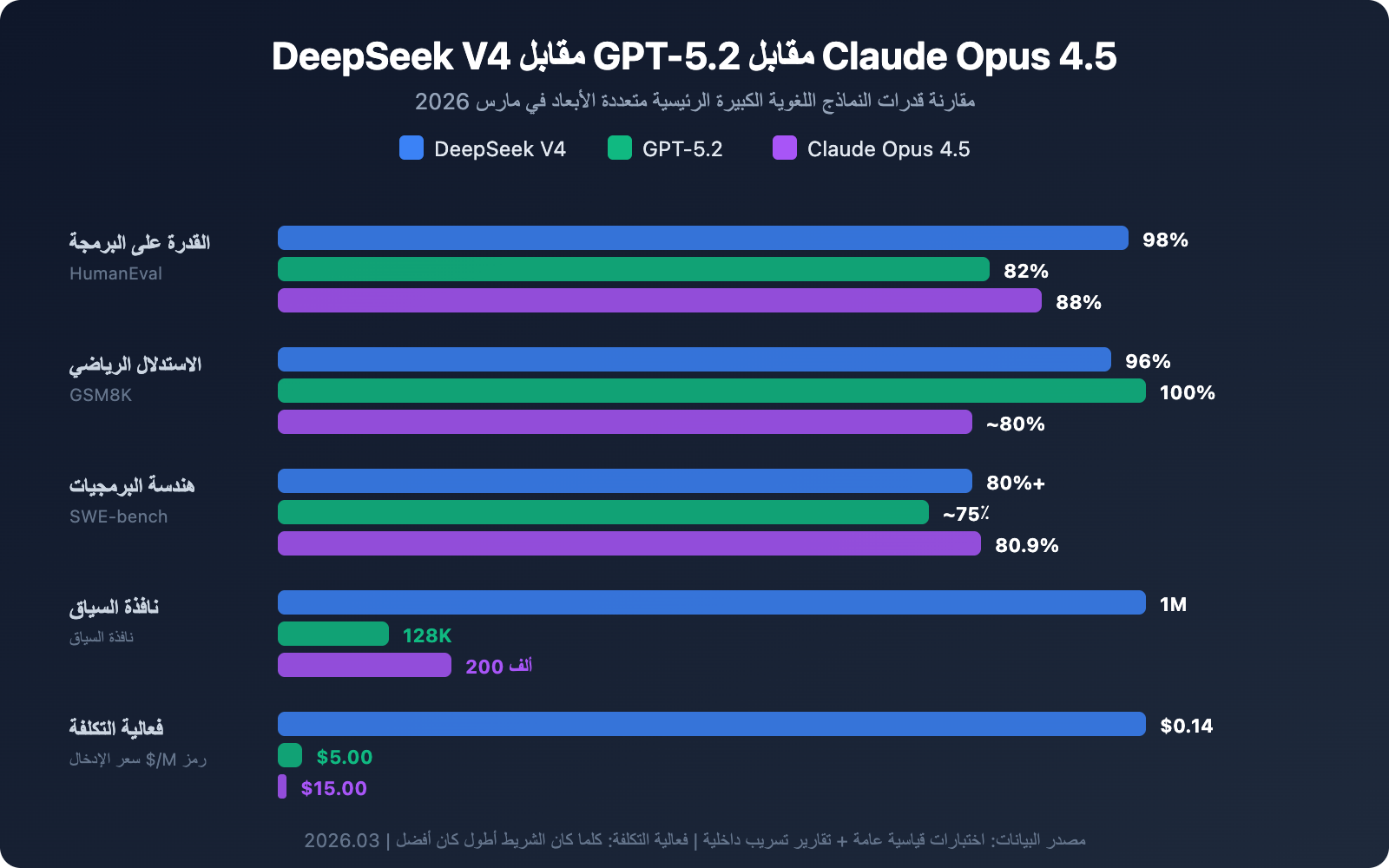

معايير أداء DeepSeek V4 ومقارنة النماذج

أظهر DeepSeek V4 قدرة تنافسية قوية في العديد من الاختبارات القياسية الرئيسية. فيما يلي مقارنة أداء DeepSeek V4 مع النماذج السائدة الحالية:

| الاختبار القياسي | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | شرح الاختبار |

|---|---|---|---|---|

| HumanEval (الترميز) | 98% | 88% | 82% | دقة توليد الكود |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | معدل حل مشكلات GitHub الحقيقية |

| GSM8K (الرياضيات) | 96% | ~80% | 100% | قدرة الاستدلال الرياضي |

| AIME 2025 | ~85% | ~80% | 100% | مسابقة رياضيات عالية الصعوبة |

| طول السياق | 1 مليون رمز | 200 ألف رمز | 128 ألف رمز | الحد الأقصى لطول الإدخال |

📊 توضيح البيانات: بيانات معايير DeepSeek V4 المذكورة أعلاه مستمدة من الاختبارات الداخلية والتقارير المسربة، ولم يتم التحقق منها بعد من قبل طرف ثالث مستقل. قد يختلف الأداء الفعلي بعد الإصدار. نوصي بإجراء اختبارات عملية ومقارنة عبر منصة APIYI على apiyi.com للحصول على تجربة استخدام حقيقية.

تفسير عميق لقدرات الترميز في DeepSeek V4

يبرز أداء DeepSeek V4 بشكل خاص في مجال الترميز. بفضل نافذة سياق تبلغ مليون رمز، يمكن لـ DeepSeek V4 معالجة مستودع كود كامل في استدلال واحد، مما يحقق استدلالًا ترابطيًا حقيقيًا عبر الملفات المتعددة.

تشمل المزايا المحددة ما يلي:

- فهم المستودع الكامل: تحميل كود المشروع الكامل دفعة واحدة، وفهم علاقات التبعية بين المكونات

- إعادة الهيكلة عبر الملفات: الحفاظ على الاتساق الشامل أثناء إعادة هيكلة الكود على نطاق واسع

- تصحيح الأخطاء في المسار الطويل: تتبع سلسلة استدعاءات الأخطاء التي تمتد عبر وحدات متعددة

هذا يعني أنه عند معالجة مهام هندسة البرمجيات المعقدة، يمكن لـ DeepSeek V4 إجراء تحليل شامل مثل المطور المتقدم، بدلاً من الاقتصار على فهم أجزاء من ملف واحد.

شرح تفصيلي لقدرات DeepSeek V4 متعددة الوسائط

على عكس النموذج النصي البحت من الجيل السابق، فإن DeepSeek V4 هو نموذج متعدد الوسائط أصلي، حيث يعالج بيانات النص والصور والفيديو والصوت في وقت واحد خلال مرحلة التدريب، وليس "تركيب" القدرات البصرية لاحقًا على نموذج نصي.

مصفوفة قدرات DeepSeek V4 متعددة الوسائط

| بُعد القدرة | حالة الدعم | سيناريوهات التطبيق النموذجية |

|---|---|---|

| توليد النص | ✅ قدرة أساسية | الترميز، الكتابة، التحليل، الترجمة |

| توليد الصور | ✅ مدعوم أصليًا | تحويل النص إلى صورة، مساعدة التصميم، توليد المخططات |

| توليد الفيديو | ✅ مدعوم أصليًا | توليد مقاطع الفيديو القصيرة، صناعة الرسوم المتحركة |

| فهم الصور | ✅ مدعوم أصليًا | تحليل الصور، التعرف الضوئي على الحروف، الأسئلة والأجوبة البصرية |

| فهم الفيديو | ✅ مدعوم أصليًا | تلخيص الفيديو، تحليل المحتوى |

| معالجة الصوت | 🔄 قيد التأكيد | التعرف على الكلام، تحليل الصوت |

تكمن الميزة الأساسية في التصميم متعدد الوسائط الأصلي في اتساق الاستدلال عبر الوسائط. على سبيل المثال، عندما يطلب المستخدم "إنشاء مخطط هيكلي بناءً على هذا الكود"، يمكن للنموذج إخراج مخططات مرئية عالية الجودة مباشرة مع فهم منطق الكود، دون الاعتماد على سلسلة أدوات خارجية.

تعد DeepSeek أيضًا بإضافة علامة مائية إجبارية لجميع محتويات الوسائط المُنشأة، وتزويدها بنظام تصفية محتوى في الوقت الفعلي، لضمان أمان وامتثال المحتوى المُنشأ.

تسعير وطرق الوصول إلى DeepSeek V4 API

يستمر تسعير DeepSeek V4 API في اتباع استراتيجية القيمة العالية مقابل السعر التي تميز DeepSeek، مع تقديم ميزة تكلفة واضحة مقارنة بالمنافسين الرئيسيين:

| بند الفاتورة | تسعير DeepSeek V4 | سعر GPT-5 المرجعي | ميزة التكلفة |

|---|---|---|---|

| رموز الإدخال | 0.14 دولار / مليون | 5.00 دولار / مليون | حوالي 35 ضعف |

| رموز الإخراج | 0.28 دولار / مليون | 15.00 دولار / مليون | حوالي 53 ضعف |

| الإدخال المخزن مؤقتًا | 0.07 دولار / مليون | – | توفير إضافي 50% عند إصابة ذاكرة التخزين المؤقت |

| الحد المجاني | 5 ملايين رمز | – | يُمنح للمستخدمين الجدد عند التسجيل |

الوصول السريع إلى DeepSeek V4 API

إليك مثالاً بسيطاً للشفرة البرمجية لاستدعاء DeepSeek V4 عبر API:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # واجهة APIYI الموحدة

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "حلل تصميم بنية هذا الكود"}],

max_tokens=4096

)

print(response.choices[0].message.content)

عرض مثال استدعاء متعدد الوسائط (توليد الصور)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # واجهة APIYI الموحدة

)

# مثال على استدعاء تحويل النص إلى صورة

response = client.images.generate(

model="deepseek-v4",

prompt="روبوت لطيف يكتب كود، بأسلوب سايبربانك",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 البدء السريع: نوصي باستخدام منصة APIYI apiyi.com للوصول السريع إلى DeepSeek V4. توفر المنصة واجهة API موحدة جاهزة للاستخدام دون حاجة لإعدادات معقدة، مع رصيد تجريبي مجاني عند التسجيل، مما يمكنك من إكمال التكامل في 5 دقائق فقط.

النظام البيئي المفتوح المصدر لـ DeepSeek V4 وتأثيره الاستراتيجي

يخطط DeepSeek V4 للإصدار بترخيص مفتوح المصدر، مما يعني أن المطورين حول العالم يمكنهم تنزيل النموذج وتدقيقه ونشره مجاناً. هذه الاستراتيجية لها تأثير عميق على مشهد صناعة الذكاء الاصطناعي:

التأثير على المطورين:

- إمكانية نشر نموذج بمليارات المعلمات في بيئات خاصة، لضمان خصوصية البيانات

- دعم التدقيق الدقيق لمجالات محددة، لبناء نماذج مخصصة للقطاع

- النظام البيئي القائم على المجتمع سيُسرّع من تطور قدرات النموذج

التأثير على الصناعة:

- النموذج المفتوح المصدر بمليارات المعلمات سيخفض بشكل كبير عتبة تطوير تطبيقات الذكاء الاصطناعي

- دفع تسعير API لمزيد من الانخفاض، لصالح الشركات الصغيرة والمتوسطة

- تسريع انتشار وتطوير تطبيقات الذكاء الاصطناعي متعددة الوسائط

النظام البيئي للأجهزة:

من الجدير بالذكر أن DeepSeek V4 تم تحسينه ليعمل على شرائح الذكاء الاصطناعي المحلية مثل Huawei و Cambricon، مما يقلل الاعتماد على بطاقات NVIDIA GPU. هذا ليس مجرد خيار تقني، بل يعكس أيضاً اتجاه تنويع سلسلة توريد الذكاء الاصطناعي الحالي.

💡 نصيحة للمطورين: سواء اخترت استدعاء API عبر السحابة أو النشر الخاص، نوصي أولاً بالتحقق من الوظائف وتقييم الأداء عبر منصة APIYI apiyi.com، والتأكد من تلبية متطلبات العمل قبل اتخاذ قرار خطة النشر.

الأسئلة الشائعة

س1: متى سيتم الإعلان الرسمي عن DeepSeek V4؟

وفقًا لعدة مصادر، من المتوقع إصدار DeepSeek V4 في الأسبوع الأول من مارس 2026، حيث تم اختيار هذا التوقيت قبل بدء "الجلسات الكاملة" في الصين (التي تبدأ في 4 مارس). سيتم إصدار النموذج بموجب ترخيص مفتوح المصدر، وستُطلق خدمة API في نفس الوقت. نوصي بمتابعة القنوات الرسمية لـ DeepSeek للحصول على معلومات الإصدار مباشرة، أو تجربة الوصول إليه عبر منصة APIYI (apiyi.com) فور إتاحته.

س2: هل نافذة السياق التي تبلغ 1 مليون رمز في DeepSeek V4 عملية حقًا؟

نافذة السياق التي تبلغ 1 مليون رمز عملية للغاية في سيناريوهات محددة، خاصة تحليل مستودعات التعليمات البرمجية الكبيرة (تحميل مشروع كامل دفعة واحدة)، ومعالجة المستندات الطويلة (العقود القانونية، الكتيبات الفنية)، والمحادثات المعقدة متعددة الجولات. ومع ذلك، لا تتطلب مهام النصوص القصيرة اليومية نافذة سياق بهذا الحجم، لذا نوصي باختيار إعدادات المعلمات المناسبة بناءً على الاحتياجات الفعلية. يمكنك ضبط معلمات الاستدعاء واختبارها بمرونة عبر APIYI (apiyi.com).

س3: سعر DeepSeek V4 منخفض جدًا، فهل الجودة مضمونة؟

ينبع التكلفة المنخفضة لـ DeepSeek من بنيته المعمارية MoE (حيث يتم تنشيط 37 مليار معلمة فقط أثناء كل عملية استدلال وليس كل المعلمات البالغة 1 تريليون) ومن التحسينات الهندسية، وليس من خلال خفض الجودة. استنادًا إلى اختبارات المعايير المنشورة، فإن أداء DeepSeek V4 في مهام البرمجة والرياضيات على نفس مستوى GPT-5 وClaude. نوصي بإجراء اختبارات كافية في سيناريوهات عملية قبل اعتماده رسميًا.

الخلاصة

النقاط الرئيسية في DeepSeek V4:

- بنية MoE ذات تريليون معلمة: 1 تريليون معلمة إجمالية، 37 مليار معلمة نشطة، مما يحقق توازنًا مبتكرًا بين الأداء والكفاءة.

- القدرات المتعددة الوسائط الأصلية: ليست "نص + إضافة بصرية"، بل معالجة موحدة للنص والصور والفيديو منذ مرحلة التدريب.

- نافذة سياق 1 مليون رمز: ذات أهمية ثورية لتحليل مستودعات التعليمات البرمجية الكبيرة ومعالجة المستندات الطويلة.

- قيمة سعرية استثنائية: سعر API يبلغ 1/35 فقط من سعر GPT-5، مما يخفض تكاليف المطورين بشكل كبير.

- بيئة مفتوحة المصدر: إستراتيجية الإصدار مفتوح المصدر ستسرع من الابتكار المجتمعي والتطبيقات الصناعية.

يشير إصدار DeepSeek V4 إلى دخول نماذج اللغة الكبيرة مفتوحة المصدر رسميًا إلى عصر المعلمات التريليونية والمتعددة الوسائط. بالنسبة للمطورين، هذا يعني عتبة وصول أقل وتقنيات أكثر تنوعًا للاختيار من بينها.

نوصي بتجربة القدرات الكاملة لـ DeepSeek V4 عبر APIYI (apiyi.com) فور إتاحته، حيث توفر المنصة رصيدًا مجانيًا وواجهة موحدة للعديد من النماذج، مما يسهل التقييم والمقارنة السريعة.

📚 مراجع

-

تقرير TechNode: خطة إطلاق نموذج DeepSeek V4 متعدد الوسائط

- الرابط:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - الوصف: تقرير موثوق حول توقيت إطلاق DeepSeek V4 والتعاون في مجال الأجهزة

- الرابط:

-

الوثائق الرسمية لـ DeepSeek API: تسعير النماذج ومواصفات الواجهة

- الرابط:

api-docs.deepseek.com/quick_start/pricing - الوصف: الوثائق التقنية والتسعير الرسمي للـ API، قراءة ضرورية للمطورين

- الرابط:

-

مقارنة معايير نماذج الذكاء الاصطناعي: ترتيب أداء نماذج اللغة الكبيرة الرئيسية لعام 2026

- الرابط:

lmcouncil.ai/benchmarks - الوصف: منصة اختبار معايير مستقلة من طرف ثالث، تقدم بيانات مقارنة موضوعية لأداء النماذج

- الرابط:

المؤلف: فريق APIYI التقني

التواصل التقني: نرحب بالنقاش حول تجربة استخدام DeepSeek V4 في قسم التعليقات. للمزيد من مواد دمج الـ API، يمكن زيارة مركز وثائق APIYI docs.apiyi.com