Nota del autor: Análisis en profundidad de la arquitectura central, puntos de referencia de rendimiento, precios de API y métodos de integración del modelo multimodal DeepSeek V4 con billones de parámetros, para ayudar a los desarrolladores a evaluar y utilizar rápidamente este gran modelo de lenguaje de código abierto.

DeepSeek V4 está a punto de ser lanzado, es un modelo multimodal nativo de nivel de billones de parámetros que admite la generación unificada de texto, imágenes y video. Este artículo interpreta rápidamente las innovaciones en la arquitectura central, el rendimiento y los métodos de integración de API de DeepSeek V4, ayudando a los desarrolladores a realizar evaluaciones técnicas con anticipación.

Valor central: Comprende en 3 minutos los avances tecnológicos clave de DeepSeek V4, la comparación de rendimiento con GPT-5 / Claude, y cómo integrarlo rápidamente mediante API.

Visión general de los parámetros y capacidades clave de DeepSeek V4

DeepSeek V4 es el nuevo modelo insignia del equipo de DeepSeek, que adopta una arquitectura MoE (Mixture of Experts) de billones de parámetros y admite de forma nativa la entrada y salida multimodal. A continuación, se presentan los parámetros clave de DeepSeek V4:

| Indicador de parámetros | Especificaciones de DeepSeek V4 | Mejora respecto a V3 |

|---|---|---|

| Total de parámetros | 1 billón (1T) | Aprox. 1.5x |

| Parámetros activos | ~37B / token | Inferencia eficiente MoE |

| Ventana de contexto | 1 millón de tokens | Más de 10x |

| Soporte de modalidades | Texto + Imagen + Video | Nueva generación de imágenes y video |

| Licencia | Licencia de código abierto | Mantiene la tradición de código abierto |

Tres innovaciones clave en la arquitectura de DeepSeek V4

DeepSeek V4 introduce tres innovaciones clave en su arquitectura, que son la base técnica de su avance en rendimiento:

1. Hiperconectividad con restricción de variedad (mHC): Esta es una nueva forma de conexión de parámetros que, al restringir las rutas de transferencia de información entre redes expertas en espacios de variedad de alta dimensión, mejora significativamente la eficiencia del razonamiento colaborativo entre múltiples expertos en la arquitectura MoE. En comparación con los mecanismos de puerta dispersos tradicionales, mHC mejora la utilización de información entre expertos en aproximadamente un 40% mientras mantiene la eficiencia computacional.

2. Sistema de memoria condicional Engram: Inspirado en el concepto de "engrama" en neurociencia, DeepSeek V4 introduce un módulo de memoria condicional. Este sistema puede mantener dinámicamente un índice de información clave durante el procesamiento de contextos extremadamente largos, permitiendo que el modelo recupere y haga referencia con precisión a contenido inicial incluso al procesar contextos de 1 millón de tokens, lo cual es crucial para el análisis de grandes bases de código y el procesamiento de documentos extensos.

3. Actualización del mecanismo de atención dispersa: Sobre la base del mecanismo de atención estándar, DeepSeek V4 adopta una estrategia de dispersión jerárquica, ajustando dinámicamente la densidad del cálculo de atención según la relevancia semántica entre tokens. Esto permite que el modelo procese secuencias extremadamente largas con un costo computacional mucho menor que la atención completa, reduciendo el costo de inferencia en aproximadamente un 40%.

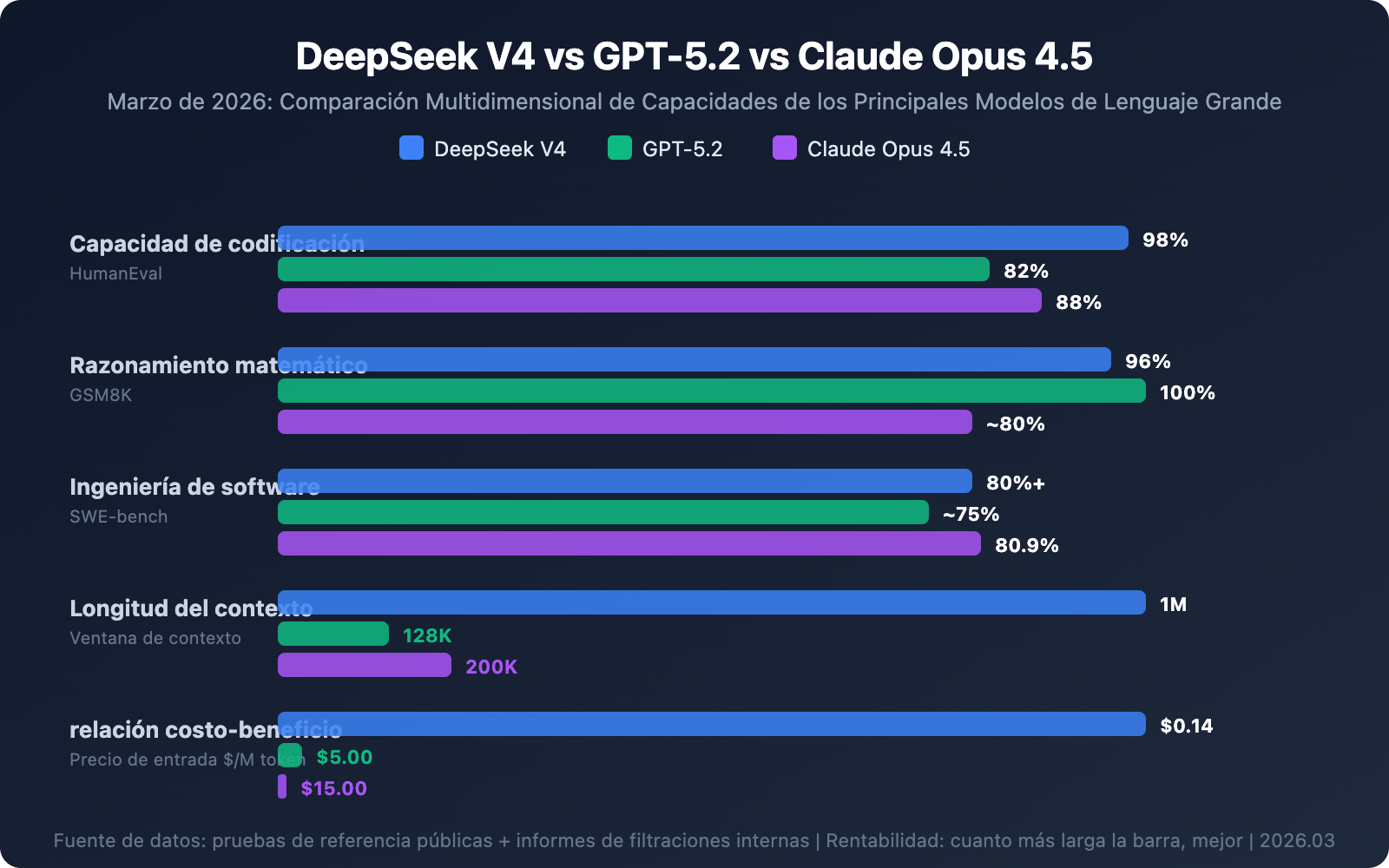

Benchmark de rendimiento y comparación de modelos DeepSeek V4

DeepSeek V4 ha demostrado una fuerte competitividad en múltiples benchmarks principales. A continuación, se presenta una comparación de rendimiento entre DeepSeek V4 y los modelos líderes actuales:

| Benchmark | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | Descripción de la prueba |

|---|---|---|---|---|

| HumanEval (codificación) | 98% | 88% | 82% | Precisión en generación de código |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | Tasa de resolución de issues reales de GitHub |

| GSM8K (matemáticas) | 96% | ~80% | 100% | Capacidad de razonamiento matemático |

| AIME 2025 | ~85% | ~80% | 100% | Competencia matemática de alta dificultad |

| Longitud de contexto | 1 millón de tokens | 200 mil tokens | 128 mil tokens | Longitud máxima de entrada |

📊 Nota sobre los datos: Los datos de benchmark de DeepSeek V4 anteriores provienen de pruebas internas y reportes filtrados, aún no han sido verificados por terceros independientes. El rendimiento real después del lanzamiento puede variar. Se recomienda realizar pruebas comparativas prácticas a través de la plataforma APIYI apiyi.com para obtener una experiencia de uso real.

Análisis en profundidad de las capacidades de codificación de DeepSeek V4

El rendimiento de DeepSeek V4 en el ámbito de la codificación es particularmente destacado. Gracias a su ventana de contexto de 1 millón de tokens, DeepSeek V4 puede procesar un repositorio de código completo en una sola inferencia, logrando un verdadero razonamiento asociativo entre múltiples archivos.

Las ventajas específicas incluyen:

- Comprensión de repositorio completo: Carga el código del proyecto completo de una vez, comprendiendo las dependencias entre componentes

- Refactorización entre archivos: Mantiene la coherencia global durante refactorizaciones de código a gran escala

- Depuración de cadenas largas: Rastrea cadenas de llamadas de errores que abarcan múltiples módulos

Esto significa que al abordar tareas complejas de ingeniería de software, DeepSeek V4 puede realizar análisis globales como lo haría un desarrollador senior, en lugar de limitarse a la comprensión fragmentada de archivos individuales.

Capacidades multimodales detalladas de DeepSeek V4

A diferencia de su predecesor puramente textual, DeepSeek V4 es un modelo multimodal nativo, que procesa simultáneamente datos de texto, imágenes, video y audio durante la fase de entrenamiento, en lugar de "añadir" capacidades visuales posteriormente a un modelo de texto.

Matriz de capacidades multimodales de DeepSeek V4

| Dimensión de capacidad | Soporte | Escenarios de aplicación típicos |

|---|---|---|

| Generación de texto | ✅ Capacidad principal | Codificación, escritura, análisis, traducción |

| Generación de imágenes | ✅ Soporte nativo | Texto a imagen, asistencia en diseño, generación de gráficos |

| Generación de video | ✅ Soporte nativo | Generación de videos cortos, creación de animaciones |

| Comprensión de imágenes | ✅ Soporte nativo | Análisis de imágenes, OCR, preguntas y respuestas visuales |

| Comprensión de video | ✅ Soporte nativo | Resumen de video, análisis de contenido |

| Procesamiento de audio | 🔄 Por confirmar | Reconocimiento de voz, análisis de audio |

La ventaja central del diseño multimodal nativo radica en la coherencia del razonamiento entre modalidades. Por ejemplo, cuando un usuario solicita "generar un diagrama de arquitectura basado en este código", el modelo puede comprender la lógica del código y simultáneamente generar un diagrama visual de alta calidad, sin depender de cadenas de herramientas externas.

DeepSeek también promete agregar marcas de agua obligatorias a todo el contenido multimedia generado, junto con un sistema de filtrado de contenido en tiempo real, para garantizar la seguridad y conformidad del contenido generado.

Precios y métodos de acceso a la API de DeepSeek V4

La tarificación de la API de DeepSeek V4 continúa con la estrategia de alta relación calidad-precio característica de DeepSeek, ofreciendo una ventaja de coste significativa frente a los competidores principales:

| Concepto de facturación | Precio DeepSeek V4 | Precio de referencia GPT-5 | Ventaja de coste |

|---|---|---|---|

| Token de entrada | $0.14 / millón | $5.00 / millón | Aprox. 35 veces |

| Token de salida | $0.28 / millón | $15.00 / millón | Aprox. 53 veces |

| Entrada en caché | $0.07 / millón | – | Ahorro adicional del 50% en aciertos de caché |

| Cuota gratuita | 5 millones de tokens | – | Se otorga al registrarse como nuevo usuario |

Acceso rápido a la API de DeepSeek V4

A continuación, un ejemplo de código mínimo para invocar a DeepSeek V4 a través de la API:

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1" # Interfaz unificada de APIYI

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "Analiza el diseño de arquitectura de este código"}],

max_tokens=4096

)

print(response.choices[0].message.content)

Ver ejemplo de invocación multimodal (generación de imágenes)

import openai

client = openai.OpenAI(

api_key="TU_CLAVE_API",

base_url="https://vip.apiyi.com/v1" # Interfaz unificada de APIYI

)

# Ejemplo de invocación de texto a imagen

response = client.images.generate(

model="deepseek-v4",

prompt="Un robot adorable escribiendo código, estilo ciberpunk",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 Inicio rápido: Se recomienda utilizar la plataforma APIYI apiyi.com para acceder rápidamente a DeepSeek V4. Esta plataforma ofrece una interfaz API unificada lista para usar, sin configuraciones complejas, incluye una cuota de prueba gratuita al registrarse y permite completar la integración en 5 minutos.

Ecosistema de código abierto e impacto estratégico de DeepSeek V4

DeepSeek V4 planea publicarse bajo una licencia de código abierto, lo que significa que desarrolladores de todo el mundo podrán descargar, ajustar y desplegar el modelo de forma gratuita. Esta estrategia tiene un impacto profundo en el panorama de la industria de la IA:

Impacto en los desarrolladores:

- Posibilidad de desplegar modelos de billones de parámetros en entornos privados, garantizando la privacidad de los datos.

- Soporte para ajuste fino orientado a dominios específicos, construyendo modelos especializados por sector.

- El ecosistema impulsado por la comunidad acelerará la iteración de capacidades del modelo.

Impacto en la industria:

- Los modelos de código abierto de billones de parámetros reducirán drásticamente la barrera de entrada para el desarrollo de aplicaciones de IA.

- Impulsarán una mayor reducción en los precios de las API, beneficiando a las pequeñas y medianas empresas.

- Acelerarán la adopción e innovación en aplicaciones de IA multimodal.

Ecosistema de hardware:

Es importante destacar que DeepSeek V4 ya está optimizado para chips de IA nacionales como los de Huawei y Cambricon, reduciendo la dependencia de las GPU de NVIDIA. Esto no es solo una elección técnica, sino que refleja la tendencia actual hacia la diversificación de la cadena de suministro de IA.

💡 Recomendación para desarrolladores: Ya sea que elijas la invocación por API en la nube o el despliegue privado, se recomienda realizar primero una validación de funcionalidad y evaluación de rendimiento a través de la plataforma APIYI apiyi.com, confirmando que cumple con los requisitos del negocio antes de decidir el esquema de despliegue.

Preguntas frecuentes

Q1: ¿Cuándo se lanzará oficialmente DeepSeek V4?

Según múltiples fuentes, se espera que DeepSeek V4 se lance en la primera semana de marzo de 2026, eligiendo un momento anterior a las "Dos Sesiones" de China (que comienzan el 4 de marzo). El modelo se lanzará bajo una licencia de código abierto, y el servicio de API se pondrá en marcha simultáneamente. Se recomienda seguir los canales oficiales de DeepSeek para obtener información de primera mano sobre el lanzamiento, o experimentar con la integración a través de la plataforma APIYI apiyi.com tan pronto como esté disponible.

Q2: ¿Es realmente práctica la ventana de contexto de 1 millón de tokens de DeepSeek V4?

La ventana de contexto de 1 millón de tokens es muy práctica para escenarios específicos, especialmente en el análisis de grandes bases de código (cargando un proyecto completo de una vez), procesamiento de documentos extensos (contratos legales, manuales técnicos) y conversaciones complejas de múltiples turnos. Sin embargo, para tareas de texto corto del día a día no es necesaria una ventana tan grande. Se recomienda elegir la configuración de parámetros adecuada según las necesidades reales. A través de APIYI apiyi.com puedes ajustar de manera flexible los parámetros de invocación para realizar pruebas.

Q3: Con un precio tan bajo, ¿está garantizada la calidad de DeepSeek V4?

El bajo costo de DeepSeek se debe a su arquitectura MoE (que activa solo 37B de parámetros por inferencia en lugar de los 1T totales) y a optimizaciones de ingeniería, no a una reducción en la calidad. Según las pruebas de referencia públicas, el rendimiento de DeepSeek V4 en tareas de codificación y matemáticas está al mismo nivel que GPT-5 y Claude. Se recomienda realizar pruebas exhaustivas en escenarios reales antes de adoptarlo formalmente.

Resumen

Los puntos clave de DeepSeek V4:

- Arquitectura MoE de billón de parámetros: 1T de parámetros totales, 37B de parámetros activos, logrando un equilibrio innovador entre rendimiento y eficiencia.

- Capacidad multimodal nativa: No es un "texto + complemento visual", sino un procesamiento unificado de texto, imagen y video desde la fase de entrenamiento.

- Ventana de contexto de 1 millón de tokens: Tiene un significado revolucionario para el análisis de grandes repositorios de código y el procesamiento de documentos extensos.

- Relación calidad-precio extrema: El precio de la API es solo 1/35 del de GPT-5, reduciendo significativamente los costos para los desarrolladores.

- Ecosistema de código abierto: La estrategia de lanzamiento de código abierto acelerará la innovación comunitaria y las aplicaciones industriales.

El lanzamiento de DeepSeek V4 marca la entrada oficial de los Modelos de Lenguaje Grande de código abierto en la era multimodal de billones de parámetros. Para los desarrolladores, esto significa un umbral de acceso más bajo y opciones tecnológicas más ricas.

Se recomienda experimentar con las capacidades completas de DeepSeek V4 a través de APIYI apiyi.com tan pronto como sea posible. La plataforma ofrece cuota gratuita y una interfaz unificada para múltiples modelos, facilitando la comparación y evaluación rápida.

📚 Referencias

-

Reporte de TechNode: Plan de lanzamiento del modelo multimodal DeepSeek V4

- Enlace:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - Descripción: Reporte autoritativo sobre la fecha de lanzamiento de DeepSeek V4 y la colaboración en hardware

- Enlace:

-

Documentación oficial de DeepSeek API: Precios del modelo y especificaciones de la interfaz

- Enlace:

api-docs.deepseek.com/quick_start/pricing - Descripción: Documentación técnica y de precios oficial de la API, lectura obligatoria para el desarrollo de integración

- Enlace:

-

Comparativa de benchmarks de modelos de IA: Ranking de rendimiento de los principales Modelos de Lenguaje Grande en 2026

- Enlace:

lmcouncil.ai/benchmarks - Descripción: Plataforma de pruebas de referencia independiente, proporciona datos objetivos de comparación de rendimiento de modelos

- Enlace:

Autor: Equipo técnico de APIYI

Intercambio técnico: Bienvenidos a discutir la experiencia de uso de DeepSeek V4 en los comentarios. Para más materiales sobre integración de API, pueden visitar el centro de documentación de APIYI docs.apiyi.com