DeepSeek V4 steht vor der Veröffentlichung. Es handelt sich um ein natives multimodales Modell mit Billionen von Parametern, das die einheitliche Erzeugung von Text, Bildern und Videos unterstützt. Dieser Artikel bietet einen schnellen Überblick über die innovativen Kernarchitekturen, die Leistungsfähigkeit und die API-Integrationsmöglichkeiten von DeepSeek V4, um Entwicklern eine frühzeitige technische Bewertung zu ermöglichen.

Kernnutzen: In 3 Minuten erfahren Sie die wichtigsten technischen Durchbrüche von DeepSeek V4, einen Leistungsvergleich mit GPT-5 / Claude und wie Sie es schnell über die API nutzen können.

Überblick über Kernparameter und Fähigkeiten von DeepSeek V4

DeepSeek V4 ist das neue Flaggschiff-Modell des DeepSeek-Teams. Es basiert auf einer MoE-Architektur (Mixture of Experts) mit Billionen von Parametern und unterstützt nativ multimodale Ein- und Ausgaben. Hier sind die Kernparameter von DeepSeek V4:

| Parameterkennzahl | DeepSeek V4 Spezifikation | Verbesserung gegenüber V3 |

|---|---|---|

| Gesamtparameter | 1 Billion (1T) | ca. 1,5-fache Steigerung |

| Aktive Parameter | ~37B / Token | Effizientes MoE-Inferenz |

| Kontextfenster | 1 Million Token | >10-fache Steigerung |

| Modalitätsunterstützung | Text + Bild + Video | Neu: Bild- und Videoerzeugung |

| Open-Source-Lizenz | Open-Source-Lizenz | Beibehaltung der Open-Source-Tradition |

Drei Architektur-Innovationen von DeepSeek V4

DeepSeek V4 führt drei Schlüsselinnovationen in der Architektur ein, die die Grundlage für seinen Leistungsdurchbruch bilden:

1. Manifold-Constrained Hyperconnectivity (mHC): Dies ist eine völlig neue Art der Parameterverbindung. Durch die Einschränkung der Informationsübertragungspfade zwischen Expertennetzwerken im hochdimensionalen Mannigfaltigkeitsraum wird die Effizienz der kollaborativen Inferenz in der MoE-Architektur erheblich gesteigert. Im Vergleich zu traditionellen spärlichen Gating-Mechanismen steigert mHC die nutzbare Information zwischen Experten um etwa 40 %, bei gleichbleibender Recheneffizienz.

2. Engram Conditional Memory System: Inspiriert vom neurowissenschaftlichen Konzept der "Engramme" (Gedächtnisspuren) führt DeepSeek V4 ein bedingtes Speichermodul ein. Dieses System kann während der Verarbeitung extrem langer Kontexte dynamisch Indizes für Schlüsselinformationen pflegen. Dadurch kann das Modell auch bei der Verarbeitung von 1 Million Token Kontext frühere Inhalte präzise abrufen und referenzieren – entscheidend für die Analyse großer Codebasen und die Verarbeitung langer Dokumente.

3. Upgrade des Sparse Attention-Mechanismus: Aufbauend auf dem Standard-Attention-Mechanismus verwendet DeepSeek V4 eine hierarchische Sparse-Strategie, die die Dichte der Attention-Berechnung basierend auf der semantischen Relevanz zwischen Tokens dynamisch anpasst. Dies ermöglicht es dem Modell, extrem lange Sequenzen mit weitaus geringeren Rechenkosten als bei voller Attention zu verarbeiten, wodurch die Inferenzkosten um etwa 40 % gesenkt werden.

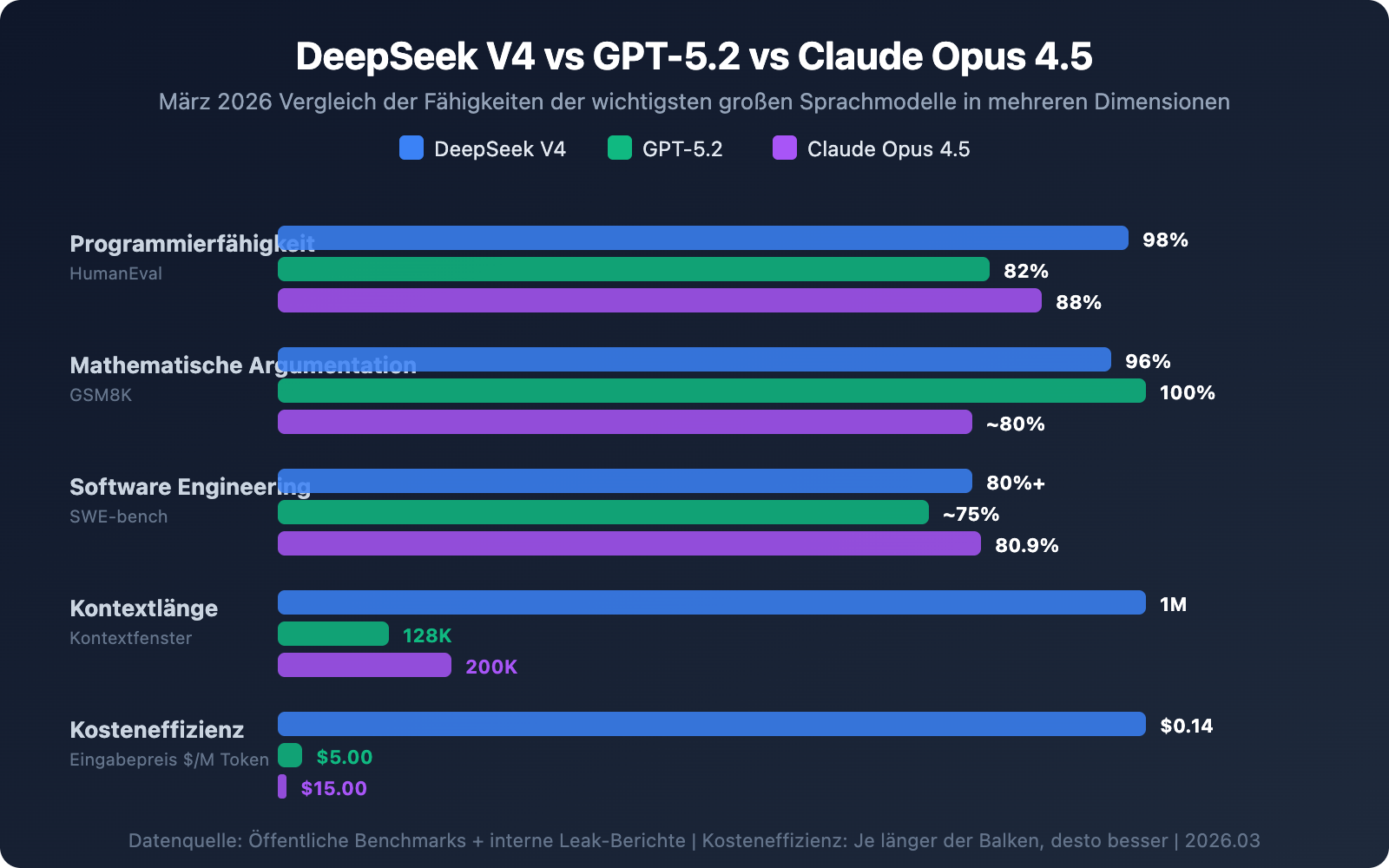

DeepSeek V4 Leistungsbenchmark und Modellvergleich

DeepSeek V4 zeigt in mehreren gängigen Benchmark-Tests eine starke Wettbewerbsfähigkeit. Hier ist der Leistungsvergleich zwischen DeepSeek V4 und aktuellen Hauptstrom-Modellen:

| Benchmark-Test | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | Testbeschreibung |

|---|---|---|---|---|

| HumanEval (Codierung) | 98% | 88% | 82% | Genauigkeit der Codegenerierung |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | Lösung realer GitHub-Issues |

| GSM8K (Mathematik) | 96% | ~80% | 100% | Mathematische Denkfähigkeit |

| AIME 2025 | ~85% | ~80% | 100% | Hochschwieriger Mathematikwettbewerb |

| Kontextlänge | 1 Million Token | 200.000 Token | 128.000 Token | Maximale Eingabelänge |

📊 Datenhinweis: Die oben genannten DeepSeek V4 Benchmark-Daten stammen aus internen Tests und geleakten Berichten und wurden noch nicht von unabhängigen Dritten verifiziert. Die tatsächliche Leistung nach der Veröffentlichung kann abweichen. Es wird empfohlen, praktische Tests und Vergleiche über die APIYI-Plattform apiyi.com durchzuführen, um echte Nutzungserfahrungen zu sammeln.

Tiefere Einblicke in die Codierungsfähigkeiten von DeepSeek V4

Die Leistung von DeepSeek V4 im Bereich der Codierung ist besonders herausragend. Dank des Kontextfensters von 1 Million Token kann DeepSeek V4 ein gesamtes Code-Repository in einem einzigen Inferenzdurchlauf verarbeiten und echte Multi-Datei-Assoziationsschlüsse durchführen.

Konkrete Vorteile sind:

- Vollständiges Repository-Verständnis: Einmaliges Laden des gesamten Projektcodes, Verständnis der Abhängigkeiten zwischen Komponenten

- Übergreifende Dateirefaktorisierung: Beibehaltung der globalen Konsistenz bei umfangreichen Code-Refactorings

- Debuggen langer Ablaufketten: Verfolgen von Bug-Aufrufketten, die mehrere Module überspannen

Das bedeutet, dass DeepSeek V4 bei der Bearbeitung komplexer Software-Engineering-Aufgaben wie ein erfahrener Entwickler globale Analysen durchführen kann, anstatt sich auf das fragmentierte Verständnis einzelner Dateien zu beschränken.

Detaillierte Erklärung der multimodalen Fähigkeiten von DeepSeek V4

Im Gegensatz zur vorherigen reinen Textmodell-Generation ist DeepSeek V4 ein natives multimodales Modell, das bereits während des Trainings Text-, Bild-, Video- und Audiodaten gleichzeitig verarbeitet, anstatt visuelle Fähigkeiten nachträglich auf ein Textmodell "aufzusetzen".

Fähigkeitsmatrix der Multimodalität von DeepSeek V4

| Fähigkeitsdimension | Unterstützung | Typische Anwendungsszenarien |

|---|---|---|

| Textgenerierung | ✅ Kernfähigkeit | Codierung, Schreiben, Analyse, Übersetzung |

| Bilderzeugung | ✅ Native Unterstützung | Text-zu-Bild, Designunterstützung, Diagrammgenerierung |

| Videogenerierung | ✅ Native Unterstützung | Kurzvideoerstellung, Animation |

| Bildverständnis | ✅ Native Unterstützung | Bildanalyse, OCR, visuelle Fragebeantwortung |

| Videoverständnis | ✅ Native Unterstützung | Videozusammenfassung, Inhaltsanalyse |

| Audioverarbeitung | 🔄 Noch zu bestätigen | Spracherkennung, Audioanalyse |

Der Kernvorteil des nativen multimodalen Designs liegt in der Kohärenz der modellübergreifenden Schlussfolgerung. Wenn ein Benutzer beispielsweise "Erstelle ein Architekturdiagramm basierend auf diesem Code" anfordert, kann das Modell gleichzeitig die Code-Logik verstehen und direkt hochwertige Visualisierungsdiagramme ausgeben, ohne auf externe Toolchains angewiesen zu sein.

DeepSeek hat außerdem zugesagt, allen generierten Medieninhalten einen obligatorischen Wasserzeichen hinzuzufügen und mit einem Echtzeit-Inhaltsfiltersystem auszustatten, um die Sicherheit und Konformität der generierten Inhalte zu gewährleisten.

DeepSeek V4 API-Preise und Zugangswege

Die API-Preise für DeepSeek V4 setzen die traditionell hohe Preis-Leistung von DeepSeek fort und bieten im Vergleich zu den Hauptkonkurrenten deutliche Kostenvorteile:

| Abrechnungsposition | DeepSeek V4 Preis | GPT-5 Referenzpreis | Kostenvorteil |

|---|---|---|---|

| Input-Token | 0,14 $ / Million | 5,00 $ / Million | ca. 35-fach |

| Output-Token | 0,28 $ / Million | 15,00 $ / Million | ca. 53-fach |

| Cache-Input | 0,07 $ / Million | – | Weitere 50% Ersparnis bei Cache-Treffer |

| Kostenloses Kontingent | 5 Millionen Token | – | Bei Neuregistierung sofort verfügbar |

Schnelleinrichtung für die DeepSeek V4 API

Hier ist ein minimalistisches Codebeispiel für den Aufruf von DeepSeek V4 über die API:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI einheitliche Schnittstelle

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "Analysiere den Architekturentwurf dieses Codes"}],

max_tokens=4096

)

print(response.choices[0].message.content)

Multimodales Aufrufbeispiel anzeigen (Bilderzeugung)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # APIYI einheitliche Schnittstelle

)

# Text-zu-Bild Aufrufbeispiel

response = client.images.generate(

model="deepseek-v4",

prompt="Ein niedlicher Roboter, der Code schreibt, im Cyberpunk-Stil",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 Schnellstart: Für den schnellen Zugang zu DeepSeek V4 empfehlen wir die Plattform APIYI apiyi.com. Die Plattform bietet eine sofort einsatzbereite, einheitliche API-Schnittstelle ohne komplexe Konfiguration, inklusive kostenlosem Testkontingent bei Registrierung. Die Integration ist in 5 Minuten erledigt.

DeepSeek V4 Open-Source-Ökosystem und strategische Auswirkungen

DeepSeek V4 soll unter einer Open-Source-Lizenz veröffentlicht werden. Das bedeutet, dass Entwickler weltweit das Modell kostenlos herunterladen, anpassen und bereitstellen können. Diese Strategie hat tiefgreifende Auswirkungen auf die KI-Branche:

Auswirkungen auf Entwickler:

- Bereitstellung von Billionen-Parameter-Modellen in privaten Umgebungen für Datenschutz

- Unterstützung für Feinabstimmung auf spezifische Domänen, um branchenspezifische Modelle zu erstellen

- Community-getriebenes Ökosystem beschleunigt die Weiterentwicklung der Modellfähigkeiten

Auswirkungen auf die Branche:

- Open-Source-Modelle mit Billionen Parametern senken die Einstiegshürde für KI-Anwendungen erheblich

- Treiben die API-Preise weiter nach unten, was kleinen und mittleren Unternehmen zugutekommt

- Beschleunigen die Verbreitung und Innovation multimodaler KI-Anwendungen

Hardware-Ökosystem:

Bemerkenswert ist, dass DeepSeek V4 bereits für einheimische KI-Chips wie von Huawei und Cambricon optimiert wurde, was die Abhängigkeit von NVIDIA-GPUs verringert. Dies ist nicht nur eine technische Entscheidung, sondern spiegelt auch den aktuellen Trend zur Diversifizierung der KI-Lieferkette wider.

💡 Entwicklungsempfehlung: Egal, ob Sie sich für Cloud-API-Aufrufe oder eine private Bereitstellung entscheiden, empfehlen wir, zunächst die Funktionalität und Leistung über die APIYI-Plattform apiyi.com zu validieren und zu bewerten. Vergewissern Sie sich, dass die Anforderungen Ihres Unternehmens erfüllt sind, bevor Sie sich für ein Bereitstellungsschema entscheiden.

Häufig gestellte Fragen

F1: Wann wird DeepSeek V4 offiziell veröffentlicht?

Nach Informationen aus mehreren Quellen wird DeepSeek V4 voraussichtlich in der ersten Märzwoche 2026 veröffentlicht, zeitlich vor den chinesischen "Zwei Tagungen" (beginnend am 4. März). Das Modell wird unter einer Open-Source-Lizenz veröffentlicht, und der API-Dienst wird gleichzeitig starten. Es wird empfohlen, die offiziellen Kanäle von DeepSeek für Erstinformationen zu verfolgen oder über die Plattform APIYI (apiyi.com) den Zugang sofort nach Veröffentlichung zu testen.

F2: Ist das 1-Million-Token-Kontextfenster von DeepSeek V4 wirklich praktisch?

Ein Kontextfenster von 1 Million Token ist für bestimmte Szenarien sehr praktisch, insbesondere für die Analyse großer Codebasen (Laden eines gesamten Projekts auf einmal), die Verarbeitung langer Dokumente (Rechtsverträge, technische Handbücher) und mehrstufige, komplexe Dialoge. Für alltägliche Aufgaben mit kurzen Texten ist ein so großes Kontextfenster jedoch nicht erforderlich. Es wird empfohlen, die Parameterkonfiguration je nach tatsächlichem Bedarf zu wählen. Über APIYI (apiyi.com) können Sie die Aufrufparameter flexibel anpassen und testen.

F3: Ist die Qualität bei einem so niedrigen Preis für DeepSeek V4 gewährleistet?

Die niedrigen Kosten von DeepSeek resultieren aus der MoE-Architektur (bei jedem Inferenzvorgang werden nur 37B der 1T Parameter aktiviert) und technischen Optimierungen, nicht aus einer Qualitätsreduzierung. Laut öffentlichen Benchmark-Tests liegt DeepSeek V4 bei Codierungs- und Mathematikaufgaben auf demselben Niveau wie GPT-5 und Claude. Es wird empfohlen, vor der offiziellen Einführung umfangreiche Tests in realen Szenarien durchzuführen.

Zusammenfassung

Die Kernpunkte von DeepSeek V4:

- MoE-Architektur mit Billionen Parametern: 1T Gesamtparameter, 37B aktive Parameter – ein bahnbrechender Kompromiss zwischen Leistung und Effizienz.

- Native Multimodalität: Kein "Text + visuelles Plugin", sondern eine einheitliche Verarbeitung von Text, Bildern und Videos bereits im Training.

- 1-Million-Token-Kontextfenster: Revolutionär für die Analyse großer Codebasen und die Verarbeitung langer Dokumente.

- Extreme Preis-Leistung: Die API-Preise sind nur 1/35 so hoch wie bei GPT-5 und senken die Kosten für Entwickler erheblich.

- Open-Source-Ökosystem: Die Open-Source-Veröffentlichungsstrategie wird Innovationen in der Community und Branchenanwendungen beschleunigen.

Die Veröffentlichung von DeepSeek V4 markiert den Eintritt von Open-Source-Großsprachmodellen in die Ära der multimodalen Billionen-Parameter-Modelle. Für Entwickler bedeutet dies niedrigere Zugangshürden und eine größere technologische Auswahl.

Wir empfehlen, die volle Leistungsfähigkeit von DeepSeek V4 über APIYI (apiyi.com) sofort nach Veröffentlichung zu testen. Die Plattform bietet kostenlose Kontingente und eine einheitliche Schnittstelle für mehrere Modelle, was einen schnellen Vergleich und eine einfache Bewertung ermöglicht.

📚 Referenzmaterial

-

TechNode-Bericht: Veröffentlichungsplan für das multimodale Modell DeepSeek V4

- Link:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - Beschreibung: Autoritativer Bericht über den Veröffentlichungszeitplan und Hardware-Partnerschaften von DeepSeek V4

- Link:

-

Offizielle DeepSeek-API-Dokumentation: Modellpreise und Schnittstellenspezifikationen

- Link:

api-docs.deepseek.com/quick_start/pricing - Beschreibung: Offizielle API-Preisliste und technische Dokumentation, essentiell für die Integration und Entwicklung

- Link:

-

KI-Modell-Benchmark-Vergleich: Leistungsranking der führenden großen Sprachmodelle 2026

- Link:

lmcouncil.ai/benchmarks - Beschreibung: Unabhängige Benchmarking-Plattform von Drittanbietern, bietet objektive Leistungsvergleiche zwischen Modellen

- Link:

Autor: APIYI-Technologie-Team

Technischer Austausch: Diskutieren Sie gerne Ihre Erfahrungen mit DeepSeek V4 in den Kommentaren. Weitere Materialien zur API-Integration finden Sie im APIYI-Dokumentationszentrum unter docs.apiyi.com.