A xAI concluiu o lançamento completo da API Grok 4.3 em 30 de abril de 2026. Com a redução direta de cerca de 40% no preço de entrada, a expansão da janela de contexto para 1M de tokens e o suporte nativo inédito para entrada de vídeo, esses três pilares praticamente reescreveram o modelo de custos para aplicações de agentes inteligentes. Este artigo traz uma análise completa sobre as principais atualizações da API Grok 4.3, detalhes de precificação, comparação de desempenho e caminhos para implementação.

Valor central: Entenda em 3 minutos todas as informações cruciais sobre a API Grok 4.3, seu significado para a indústria e o caminho mais rápido para integração no Brasil via serviço proxy de API.

Visão geral da API Grok 4.3

Esta atualização da xAI segue a estratégia de "redução de preço + expansão de capacidade + multimodalidade". Apenas 4 meses após a geração anterior, o Grok 4.20, a xAI utilizou uma iteração de versão principal para reduzir significativamente a curva de custos dos modelos de raciocínio. Vamos alinhar todos os parâmetros principais em uma tabela antes de detalhá-los.

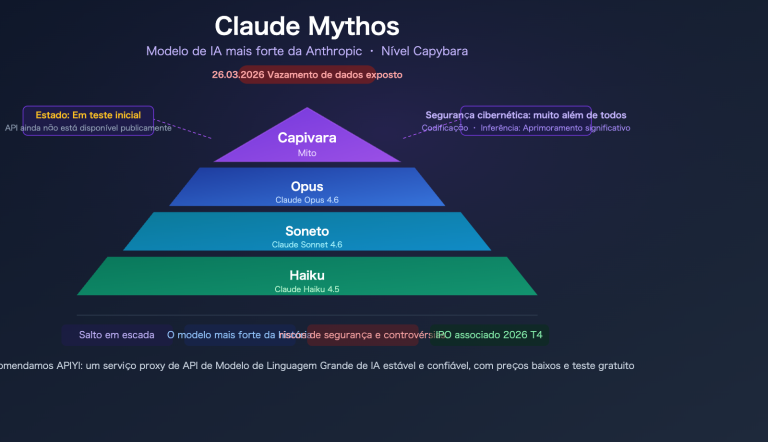

Antes de entrar na tabela, vale esclarecer o posicionamento do Grok 4.3 no portfólio da xAI. Atualmente, a xAI oferece três níveis de modelos via API: Grok 4 Fast, focado em "custo-benefício extremo"; Grok 4.3, o "carro-chefe de raciocínio"; e o Grok Code Fast 1, especializado em tarefas de código. O Grok 4.3 é o modelo recomendado pela xAI para todos os usuários da API, sendo descrito na documentação como o modelo "mais inteligente e rápido" da casa.

Parâmetros principais da API Grok 4.3

| Item | Detalhes |

|---|---|

| Data de lançamento | 30 de abril de 2026 (Disponibilidade total da API) |

| Lançamento Beta | 17 de abril de 2026 (Usuários SuperGrok Heavy) |

| ID do modelo | grok-4.3 |

| Janela de contexto | 1.000.000 tokens (1M) |

| Velocidade de saída | Aprox. 207 tokens/segundo |

| Preço de entrada | $1,25 / milhão de tokens |

| Preço de saída | $2,50 / milhão de tokens |

| Modalidades suportadas | Texto, Imagem (≤ 20 MiB por imagem), Vídeo (novo) |

| Modo de raciocínio | Ativado por padrão (Reasoning Always-On) |

| Corte de conhecimento | Novembro de 2024 |

| Desconto Batch API | 50–80% do preço padrão (processamento em 24h) |

| Índice de inteligência AA | 53 (bem acima da média de 34 na mesma faixa de preço) |

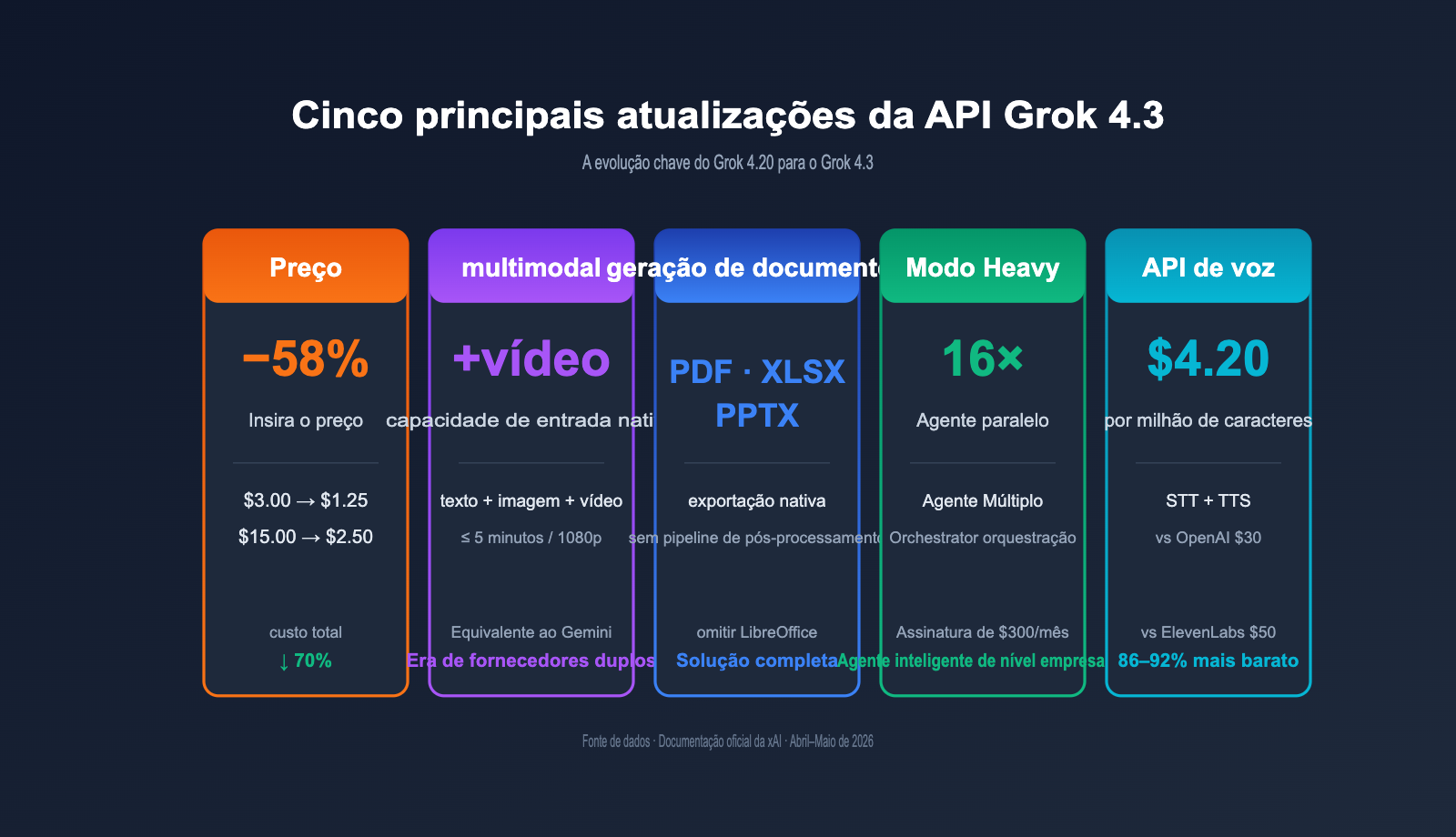

Cinco atualizações principais da API Grok 4.3

A atualização da xAI vai além do preço. Consolidamos as mudanças em cinco dimensões para facilitar a compreensão.

| Direção da atualização | Era 4.20 | Status atual do Grok 4.3 | Impacto |

|---|---|---|---|

| Preço | $3,00 / $15,00 | $1,25 / $2,50 | Redução de ~58% na entrada |

| Multimodalidade | Texto + Imagem | Texto + Imagem + Vídeo | Agentes podem "assistir" a vídeos |

| Geração de documentos | Apenas texto | Saída nativa PDF/XLSX/PPTX | Elimina pipeline de pós-processamento |

| Sistema Heavy | Agente único | Agendamento paralelo de 16 agentes | Tarefas complexas em uma única execução |

| API de voz | Sem API independente | API STT/TTS $4,20/milhão de caracteres | 86–92% mais barato que a OpenAI |

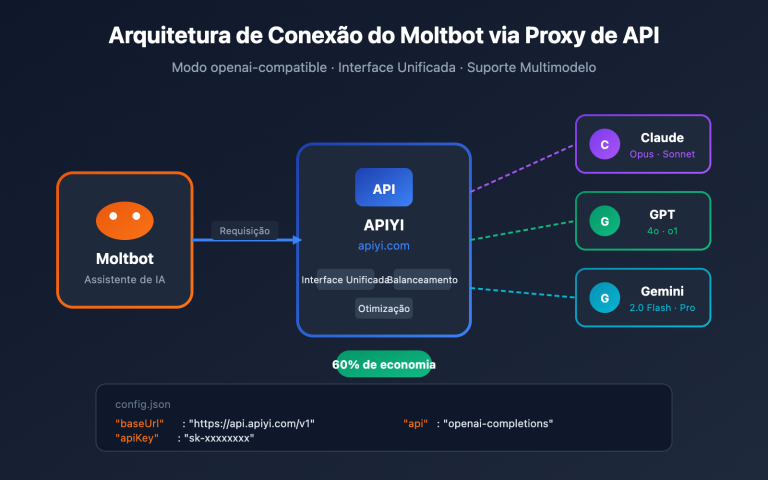

🎯 Dica de teste rápido: Desenvolvedores brasileiros podem utilizar o serviço proxy de API da APIYI (apiyi.com) para acessar o Grok 4.3 de forma estável. Basta definir a

base_urlcomohttps://vip.apiyi.com/v1e o campo do modelo comogrok-4.3. A velocidade de resposta é idêntica à oficial e suporta chamadas compatíveis com o SDK da OpenAI.

Análise Profunda dos Preços da API do Grok 4.3

O preço é a parte que mais chamou a atenção nesta versão. Vamos analisar a fatura detalhadamente, dividindo-a em quatro níveis: preço unitário, processamento em lote (Batch), chamadas de ferramentas e assinaturas.

Preço Padrão da API do Grok 4.3

A tabela de preços oficial da xAI especifica claramente as taxas por token. Os dados abaixo foram extraídos da documentação oficial da xAI e das cotações em tempo real do OpenRouter.

| Item | Preço Unitário | Observações |

|---|---|---|

| Tokens de entrada | $1,25 / milhão | Inclui tokens de texto de imagens e quadros de vídeo |

| Tokens de saída | $2,50 / milhão | Inclui tokens de saída de etapas de raciocínio |

| Tokens de entrada em cache | $0,31 / milhão | Cobrado quando o cache é atingido |

| Entrada de imagem | Cobrado por token | Máximo de 20 MiB por imagem |

| Entrada de vídeo | Cobrado por token de quadro | Nova funcionalidade |

Considerando uma proporção comum de 3:1 entre entrada e saída, o preço médio da API do Grok 4.3 é de aproximadamente $1,56 por milhão de tokens. Comparado às séries GPT-5 e Claude Opus 4.7, este preço situa-se na faixa mais acessível entre os modelos de raciocínio.

Preço de Chamada de Ferramentas no Servidor do Grok 4.3

A API do Grok 4.3 possui ferramentas integradas no lado do servidor. Os três tipos de ferramentas a seguir são cobrados por número de chamadas, separadamente das taxas de tokens.

| Tipo de Ferramenta | Preço | Cenário de Aplicação |

|---|---|---|

| Web Search | $5 / 1k chamadas | Pesquisa online em tempo real |

| X (Twitter) Search | $5 / 1k chamadas | Pesquisa na linha do tempo da plataforma X |

| Code Execution | $5 / 1k chamadas | Execução de código em sandbox |

💡 Dica de otimização de custos: Recomendamos misturar o Grok 4.3 com o Grok 4 Fast em cenários de concorrência média, roteando consultas simples para o 4 Fast (cujo custo é apenas 1/4 do 4.3) e deixando tarefas de raciocínio complexas para o 4.3. A plataforma APIYI (apiyi.com) suporta a alternância entre os dois modelos sob o mesmo

base_url, sem a necessidade de reescrever a lógica de autenticação.

Assinatura SuperGrok Heavy do Grok 4.3

Além da API cobrada por token, a xAI lançou a assinatura SuperGrok Heavy voltada para usuários intensivos.

| Nível de Assinatura | Mensalidade | Conteúdo Incluído |

|---|---|---|

| Grok Free | $0 | Uso limitado do Grok 4.3 |

| SuperGrok | $30 / mês | Cota maior + entrada de vídeo |

| SuperGrok Heavy | $300 / mês | Modo 16-Agent Heavy + prioridade + recursos antecipados |

Os níveis de assinatura competem com o ChatGPT Pro ($200/mês) e o Claude Max ($200/mês). O preço é um pouco mais alto, mas o modo 16-Agent Heavy é, de fato, o produto que mais se aproxima de um "cluster de agentes inteligentes de nível empresarial" disponível publicamente hoje.

Estimativa de Custo Real da API do Grok 4.3

Muitas equipes querem saber "quanto realmente economizaremos ao migrar para o Grok 4.3". Fizemos uma estimativa usando três volumes de negócios típicos, assumindo uma proporção de entrada/saída de 3:1.

| Volume de Negócios | Volume mensal de tokens | Mensalidade Grok 4.3 | Mensalidade Claude Opus 4.7 | Economia |

|---|---|---|---|---|

| Desenvolvedor individual | 10M | ~$15 | ~$185 | -92% |

| SaaS médio | 500M | ~$780 | ~$9.200 | -92% |

| Atendimento ao cliente corporativo | 5.000M | ~$7.800 | ~$92.000 | -92% |

Observe que, quando a taxa de acerto do prompt caching do Claude Opus 4.7 é alta, o custo real cai de 30% a 50%. O Grok 4.3 também suporta descontos para entradas em cache ($0,31 / milhão de tokens), portanto, a tabela mostra o "preço bruto sem cache". A diferença real será um pouco menor, mas ainda na ordem de 6 a 8 vezes.

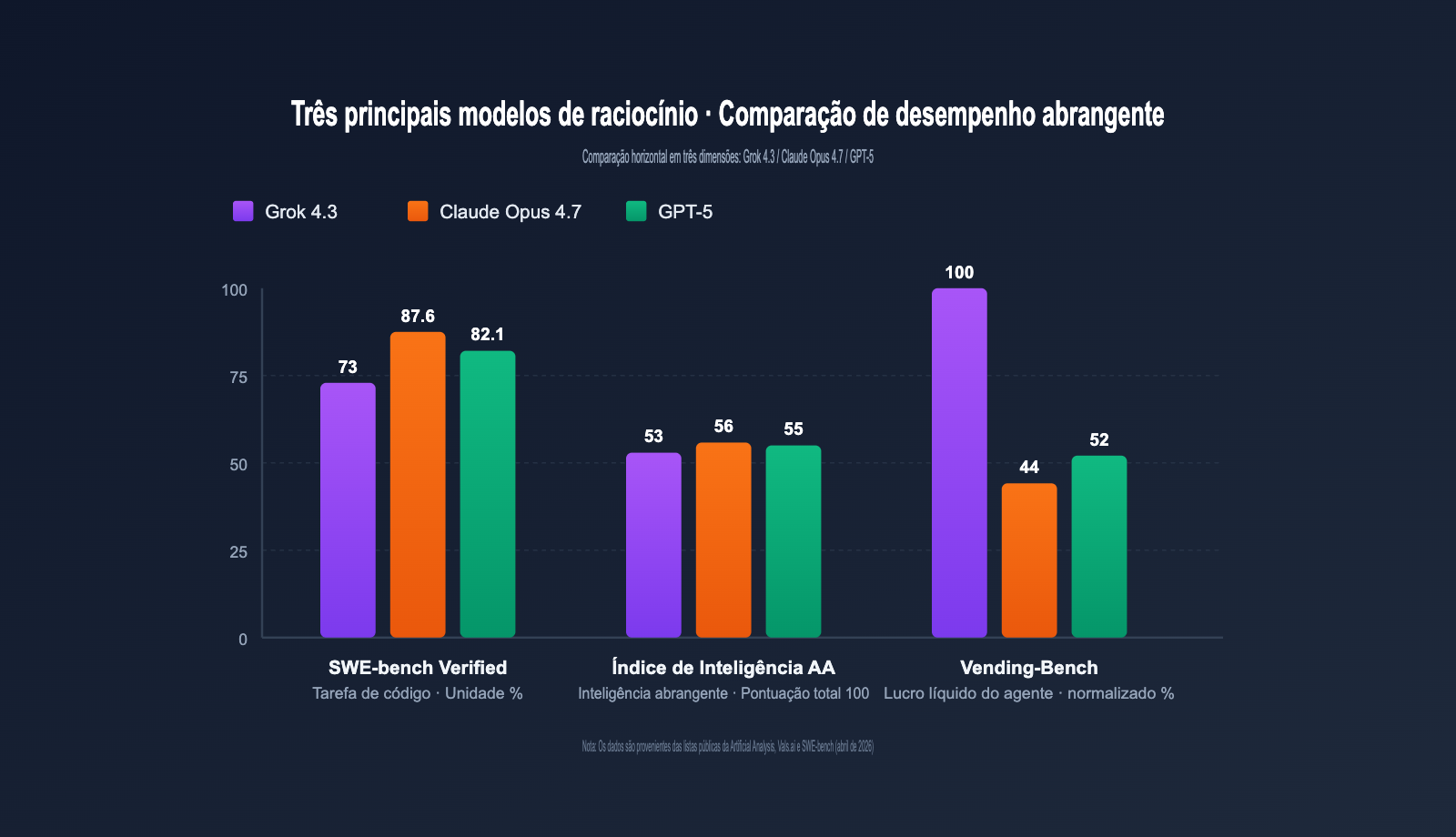

Comparação de Desempenho da API do Grok 4.3

O preço não é tudo. Usamos dados públicos de rankings recentes para avaliar a posição real do Grok 4.3 em tarefas de raciocínio, codificação e agentes.

Comparação Abrangente do Grok 4.3 com Modelos da Mesma Categoria

A tabela abaixo resume os dados de referência disponíveis publicamente até o final de abril de 2026. Os preços referem-se aos valores de tabela da API.

| Modelo | Índice de Inteligência AA | SWE-bench Verified | Velocidade de Saída | Preço de Entrada | Contexto |

|---|---|---|---|---|---|

| Grok 4.3 | 53 | ~73% | 207 tps | $1,25 | 1M |

| Claude Opus 4.7 | 56 | 87,6% | 78 tps | $15,00 | 200k |

| GPT-5 (Raciocínio Alto) | 55 | 82,1% | 95 tps | $5,00 | 400k |

| Gemini 3 Pro | 54 | 79,4% | 130 tps | $3,50 | 2M |

| Grok 4 Fast | 41 | 58,2% | 235 tps | $0,30 | 256k |

Podemos tirar algumas conclusões claras:

- Codificação não é o ponto forte do Grok 4.3: O SWE-bench fica atrás do Claude Opus 4.7 em cerca de 14 pontos percentuais.

- Agentes são o campo do Grok 4.3: Em tarefas de simulação de longa duração como o Vending-Bench, o Grok 4.3 supera o Opus 4.7 em cerca de 1,26 vezes.

- Combinação imbatível de throughput e preço: Com 207 tps de velocidade e $1,25 de preço de entrada, é único entre os modelos de raciocínio.

Desempenho do Grok 4.3 em Diferentes Tipos de Tarefas

Dividindo por granularidade de tarefa, os resultados práticos são os seguintes:

| Tipo de Tarefa | Desempenho do Grok 4.3 | Cenários Recomendados |

|---|---|---|

| Resumo de contexto longo | ⭐⭐⭐⭐⭐ | Janela de 1M + alto throughput, processa livros inteiros sem problemas |

| Fluxo de trabalho de agentes | ⭐⭐⭐⭐⭐ | Desempenho de topo em tarefas de longa cadeia tipo Vending-Bench |

| Geração e refatoração de código | ⭐⭐⭐⭐ | Inferior ao Opus 4.7, mas a vantagem de preço compensa a diferença |

| Raciocínio matemático complexo | ⭐⭐⭐⭐ | Série AIME próxima ao GPT-5 |

| Compreensão multimodal | ⭐⭐⭐⭐ | Entrada de vídeo é um recurso novo, precisão aceitável |

| Memória de longo prazo | ⭐⭐ | Ainda não suporta memória persistente, requer camada de memória externa |

🎯 Sugestão de seleção: A escolha do modelo depende principalmente dos seus cenários de aplicação específicos e requisitos de qualidade. Recomendamos realizar testes práticos através da plataforma APIYI (apiyi.com), que suporta a chamada de interface unificada para modelos de raciocínio convencionais como Grok 4.3, Claude Opus 4.7 e GPT-5, facilitando a comparação horizontal com dados reais de negócios.

Detalhando as três novas capacidades da API do Grok 4.3

Além do preço, o Grok 4.3 trouxe três novas capacidades que merecem destaque, as quais eram completamente inexistentes na era do Grok 4.20.

Capacidade de entrada de vídeo do Grok 4.3

O Grok 4.3 é o primeiro modelo de API da xAI a oferecer suporte nativo para entrada de vídeo. Não se trata de "transcrever primeiro para depois alimentar o texto", mas sim de processar os quadros de vídeo diretamente através de um codificador visual.

Parâmetros de vídeo suportados:

| Parâmetro | Limite |

|---|---|

| Duração por vídeo | ≤ 5 minutos (recomendação oficial) |

| Resolução de vídeo | ≤ 1080p |

| Amostragem de quadros | Extração automática a 1–4 fps |

| Formatos de arquivo | mp4, mov, webm |

| Método de cobrança | Cobrado por tokens de imagem após a extração dos quadros |

Nos cenários de aplicação prática, existem duas direções principais: primeiro, a extração de eventos críticos em vídeos de monitoramento/segurança; segundo, o resumo estruturado de vídeos de aulas/reuniões. Este último, combinado com a janela de contexto de 1M, permite "alimentar o sistema com uma aula completa de 4 horas e obter notas de capítulo completas".

A tabela abaixo resume os tipos de aplicações típicas de entrada de vídeo que observamos e os pontos técnicos correspondentes.

| Cenário de aplicação | Pontos técnicos principais | Dificuldade de implementação |

|---|---|---|

| Detecção de eventos em vídeo de monitoramento | Definir system prompt para focar em eventos, fps de extração em 2 | Baixa |

| Atas de reuniões em vídeo | Combinar com STT para extrair áudio, quadros de vídeo para identificar troca de orador | Média |

| Notas de capítulos de vídeos educacionais | Dividir vídeos longos em fatias de 5 minutos, resumir ao final | Baixa |

| Documentação de vídeos de demonstração de produtos | Extrair quadros para identificar passos da UI, gerar tutoriais ilustrados | Média |

| Moderação de conteúdo de vídeos curtos | Vídeos ≤ 60 segundos, chamadas em lote simultâneas | Baixa |

Capacidade de geração de documentos do Grok 4.3

A funcionalidade mais subestimada da nova versão é, na verdade, a geração de documentos. O Grok 4.3 pode gerar diretamente arquivos PDF, Excel (XLSX) e PowerPoint (PPTX) para download durante a conversa, com o conteúdo preenchido pelo modelo em tempo real.

# Exemplo minimalista: Peça ao Grok 4.3 para gerar diretamente um Excel de relatório financeiro

from openai import OpenAI

client = OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Gere para mim um relatório financeiro comparativo do setor SaaS do 4º trimestre de 2025 em XLSX, contendo as colunas de receita, taxa de crescimento e margem bruta"

}],

extra_body={"output_format": "xlsx"}

)

# A resposta contém a URL do arquivo para download

print(response.choices[0].message.attachments[0].url)

Ver código completo de geração de documentos (incluindo alternância entre formatos PDF/PPTX)

from openai import OpenAI

import requests

import os

client = OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

OUTPUT_FORMATS = ["pdf", "xlsx", "pptx"]

def generate_doc(prompt: str, fmt: str, save_dir: str = "./outputs"):

"""Chama o Grok 4.3 para gerar um documento no formato especificado e salvar localmente"""

if fmt not in OUTPUT_FORMATS:

raise ValueError(f"o formato deve ser um destes: {OUTPUT_FORMATS}")

response = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

extra_body={"output_format": fmt}

)

attachment = response.choices[0].message.attachments[0]

file_url = attachment.url

file_name = attachment.filename or f"output.{fmt}"

os.makedirs(save_dir, exist_ok=True)

save_path = os.path.join(save_dir, file_name)

file_resp = requests.get(file_url, timeout=60)

file_resp.raise_for_status()

with open(save_path, "wb") as f:

f.write(file_resp.content)

return save_path

if __name__ == "__main__":

pdf_path = generate_doc(

"Escreva um relatório de tendências do setor de Modelos de Linguagem Grande de IA para 2026, 5 páginas",

"pdf"

)

print(f"PDF salvo: {pdf_path}")

ppt_path = generate_doc(

"Crie um PPT de 10 páginas para o lançamento do produto da API Grok 4.3",

"pptx"

)

print(f"PPTX salvo: {ppt_path}")

💡 Dica de integração: A função de geração de documentos pode ser transmitida diretamente através do serviço proxy de API da APIYI (apiyi.com), sem necessidade de adaptação de parâmetros extras; tanto o SDK Python quanto o Node.js podem ser chamados normalmente.

API de voz lançada simultaneamente com o Grok 4.3

O que é fácil ignorar é que, no mesmo dia em que lançou o Grok 4.3, a xAI também lançou APIs independentes de STT (voz para texto) e TTS (texto para voz). Essas duas APIs são cobradas separadamente do modelo principal.

| API de voz | Preço xAI | Preço similar OpenAI | Diferença de preço |

|---|---|---|---|

| STT (equivalente ao Whisper) | $4,20 / milhão de caracteres | ~$30 / milhão de caracteres | 86% mais barato |

| TTS (alta expressividade) | $4,20 / milhão de caracteres | ~$50 / milhão de caracteres (ElevenLabs) | 92% mais barato |

Essa estratégia de precificação significa que a xAI reduziu o piso de preço da IA de voz para 1/10 do valor de mercado. Para cenários de alto volume de áudio, como robôs de atendimento ao cliente, geração de podcasts e assistentes de voz veiculares, a curva de preços foi completamente reescrita.

Análise do impacto da API do Grok 4.3 para desenvolvedores

Impacto direto para desenvolvedores de aplicações de IA

| Dimensão de impacto | Mudança específica | Sugestão de resposta |

|---|---|---|

| Estrutura de custos | Custo de aplicações de raciocínio ↓ 40–60% | Reavaliar a proporção de uso de modelos avançados |

| Seleção de arquitetura | Janela de contexto de 1M reduz a necessidade de RAG | A curto prazo, usar contexto longo para substituir parte da recuperação |

| Produtos multimodais | Entrada de vídeo reduz a barreira da IA visual | Projetos de vídeo para monitoramento/educação/saúde valem o investimento |

| Produtos de agentes | 16-Agent Heavy aumenta o limite de tarefas complexas | Arquiteturas Multi-Agent entram em fase prática |

| Produtos de voz | Custo de TTS/STT cai drasticamente | Front-ends de voz podem ser totalmente baseados em IA |

Impacto de médio a longo prazo na indústria de IA

Primeiro, a guerra de preços dos modelos de raciocínio começou oficialmente. O Grok 4.3 reduziu o preço da combinação de janela de contexto de 1M + raciocínio para cerca de 1/12 do Claude Opus 4.7. Essa precificação não é um teste tímido, mas sim uma quebra definitiva do consenso antigo da indústria de que "modelos de raciocínio devem ser caros". Isso forçará a OpenAI e a Anthropic a responderem com preços no segundo semestre de 2026, seja acompanhando ou diferenciando-se por outros meios (codificação mais forte, memória mais longa).

Segundo, a "entrada nativa de vídeo" sai da fase de demonstração para a produção. Antes disso, o Gemini era a única API comercial a fornecer entrada de vídeo em escala. Com a entrada do Grok 4.3, a multimodalidade de vídeo entra na era dos dois fornecedores reais. Isso significa que produtos de IA de vídeo que antes não podiam ser iniciados devido ao "risco de fornecedor único" agora podem ser oficialmente agendados. Seja uma empresa de educação querendo "fazer upload de gravações de aula para gerar notas automaticamente" ou montadoras querendo "recuperação semântica de reprodução de eventos de câmeras veiculares", o caminho técnico já está disponível.

Terceiro, os Multi-Agents entram na era da "assinatura". A arquitetura de 16 agentes do SuperGrok Heavy é oferecida por assinatura. Se esse modelo de negócios funcionar, ele abrirá caminho para futuras formas de produtos cobrados por "número de agentes". No passado, os Multi-Agents eram implementados principalmente na camada de aplicação por frameworks de código aberto (LangGraph, AutoGen, CrewAI). Agora, a xAI trouxe essa camada diretamente para a plataforma de modelos, o que significa que o paradigma de "Agente como Serviço" (Agent-as-a-Service) começou a se concretizar.

Quarto, a ausência de memória persistente na xAI é uma falha real. O ChatGPT e o Claude já suportam memória entre sessões há mais de um ano, e o Grok 4.3 ainda não preencheu essa lacuna, o que é uma desvantagem significativa em produtos do tipo "assistente pessoal". A solução de curto prazo é construir uma camada de memória na própria aplicação (banco de dados vetorial + recuperação RAG). Soluções da comunidade como Mem0 e Letta já estão maduras, mas apenas a memória nativa oficial poderá desbloquear formas de produtos mais profundas.

Quinto, a velocidade de raciocínio torna-se uma nova dimensão competitiva. A velocidade de saída de 207 tokens/segundo é a mais rápida da indústria para modelos de raciocínio, permitindo que tarefas que antes exigiam processamento em lote possam ser realizadas via interação em tempo real, como revisão de código, perguntas e respostas sobre documentos longos e geração de conteúdo dinâmico. A vantagem de velocidade, somada ao baixo custo, gera um novo tipo de forma de aplicação: microsserviços de raciocínio de alta frequência e baixa latência.

Matriz de Decisão para Seleção da API Grok 4.3

Nem todos os cenários são ideais para migrar para o Grok 4.3. Compilamos uma matriz de decisão baseada em consultas reais de negócios das últimas duas semanas para ajudar na sua escolha.

Cenários Recomendados para a API Grok 4.3

| Cenário | Motivo da Recomendação |

|---|---|

| Resumo e análise de documentos longos | 1M de janela de contexto + 207 tps de saída; processa livros inteiros ou relatórios de 200 páginas sem esforço |

| Agente de atendimento ao cliente / tratamento de reclamações | Reasoning ativado por padrão e preço baixo o suficiente para "um agente por pessoa" |

| Compreensão de conteúdo de vídeo | Único com entrada nativa de vídeo, junto com o Gemini, e com preço mais competitivo |

| Rotulagem de dados offline em larga escala | Com o desconto da Batch API, o custo chega a $0,65 / milhão de tokens, reduzindo drasticamente os custos |

| Atas de reunião multimodais | Integração de vídeo + áudio + texto; gera documentos diretamente em PDF/PPTX |

| Tarefas de agentes de longa cadeia | Os dados do Vending-Bench comprovam que este é um ponto forte do Grok 4.3 |

Cenários NÃO Recomendados para a API Grok 4.3

| Cenário | Motivo da Não Recomendação |

|---|---|

| Agente de codificação de elite | O SWE-bench ainda está cerca de 14 pontos percentuais atrás do Claude Opus 4.7 |

| Assistente pessoal (com memória forte) | Falta memória persistente; requer a construção de uma camada de memória própria |

| Interação de latência ultrabaixa | 207 tps já é rápido, mas o Grok 4 Fast (235 tps) é mais barato e adequado |

| Sensibilidade extrema ao chinês nativo | O desempenho em chinês é bom, mas ainda ligeiramente inferior ao topo de linha do Claude / GPT-5 |

| Escrita jurídica / médica com conformidade rigorosa | Conhecimento limitado a novembro de 2024; menos atualizado que o Claude Opus 4.7 |

Sugestão de Divisão de Tarefas: Grok 4.3 vs. Grok 4 Fast

Muitas equipes perguntam: em um mesmo projeto, devo usar o Grok 4.3 ou o Grok 4 Fast? Nossa sugestão é dividir o tráfego com base na complexidade da tarefa.

| Tipo de Tarefa | Modelo Recomendado | Motivo |

|---|---|---|

| Respostas simples de FAQ | Grok 4 Fast | Preço unitário é 1/4 do 4.3, com velocidade superior |

| Classificação de moderação de conteúdo | Grok 4 Fast | Não requer reasoning; o Fast é suficiente |

| Geração de planos complexos | Grok 4.3 | O reasoning é obrigatório; o 4.3 é a escolha padrão |

| Chamada de ferramentas em várias etapas | Grok 4.3 | O chain de ferramentas no lado do servidor requer suporte a reasoning |

| Processamento de documentos longos (>200k) | Grok 4.3 | O contexto do Fast é limitado a 256k; apenas o 4.3 possui 1M |

💡 Sugestão de arquitetura: No serviço proxy de API da APIYI (apiyi.com), você pode rotear automaticamente para o Grok 4 Fast ou Grok 4.3 com base no tamanho do token da solicitação ou em etiquetas de tarefa. Com o mesmo código SDK e a mesma chave API, basta alterar um campo para trocar de modelo, reduzindo drasticamente os custos de engenharia.

Tutorial Completo de Acesso à API Grok 4.3 no Brasil

O acesso às interfaces oficiais da xAI enfrenta barreiras de rede e pagamento. Abaixo, apresentamos o caminho mais estável para a integração.

Passos para Acesso à API Grok 4.3 (Compatível com OpenAI SDK)

# Exemplo completo de acesso no Brasil, usando o SDK oficial da OpenAI

from openai import OpenAI

client = OpenAI(

api_key="Sua chave API APIYI",

base_url="https://vip.apiyi.com/v1" # base_url do serviço proxy APIYI

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "system", "content": "Você é um analista sênior de produtos de IA"},

{"role": "user", "content": "Analise três impactos de longo prazo do Grok 4.3 na indústria de agentes inteligentes"}

],

temperature=0.7,

max_tokens=2048

)

print(response.choices[0].message.content)

Ver código completo para saída em streaming + entrada de imagem

from openai import OpenAI

import base64

client = OpenAI(

api_key="Sua chave API APIYI",

base_url="https://vip.apiyi.com/v1"

)

# 1. Saída em streaming

def stream_chat(prompt: str):

stream = client.chat.completions.create(

model="grok-4.3",

messages=[{"role": "user", "content": prompt}],

stream=True

)

for chunk in stream:

content = chunk.choices[0].delta.content

if content:

print(content, end="", flush=True)

print()

# 2. Entrada de imagem

def vision_chat(image_path: str, question: str):

with open(image_path, "rb") as f:

b64 = base64.b64encode(f.read()).decode()

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": [

{"type": "text", "text": question},

{"type": "image_url", "image_url": {

"url": f"data:image/png;base64,{b64}"

}}

]

}]

)

return response.choices[0].message.content

if __name__ == "__main__":

stream_chat("Explique em três parágrafos o impacto da janela de contexto de 1M na arquitetura RAG")

answer = vision_chat(

"./screenshot.png",

"Em qual camada desta arquitetura o Grok 4.3 se encontra?"

)

print(answer)

Prática de Uso de Ferramentas (Tool Use) com a API Grok 4.3

Além do protocolo compatível com OpenAI, o Grok 4.3 suporta nativamente três tipos de ferramentas server-side. Basta declará-las através do campo tools, e o modelo decidirá autonomamente quando e qual chamar, sem necessidade de orquestração extra na camada de aplicação.

# Exemplo de chamada de ferramenta no lado do servidor com Grok 4.3:

# Permitir que o modelo pesquise na web + execute código em sandbox

from openai import OpenAI

client = OpenAI(

api_key="Sua chave API APIYI",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[{

"role": "user",

"content": "Verifique a precificação de tokens do Grok 4.3 da xAI hoje e use Python para calcular o custo total de 1 milhão de chamadas"

}],

tools=[

{"type": "web_search"}, # Pesquisa na web

{"type": "code_execution"} # Execução em sandbox

]

)

print(response.choices[0].message.content)

O modelo encadeará as chamadas de ferramentas conforme necessário. Por exemplo, primeiro usa web_search para capturar o preço mais recente e, em seguida, code_execution para realizar o cálculo matemático, fornecendo uma resposta estruturada. Essa capacidade de "cadeia de ferramentas autônoma" exigia orquestração manual na era do Grok 4.20, mas o Grok 4.3 pode realizar tudo em uma única solicitação.

Melhores Práticas para Migração da OpenAI para a API Grok 4.3

Muitas equipes construíram sistemas baseados na interface da OpenAI. Ao migrar para o Grok 4.3, basta observar os seguintes pontos-chave:

| Item de Migração | Escrita original OpenAI | Escrita recomendada Grok 4.3 |

|---|---|---|

| base_url | https://api.openai.com/v1 |

https://vip.apiyi.com/v1 |

| Campo do modelo | gpt-5 |

grok-4.3 |

| Configuração de reasoning | reasoning_effort="high" |

Ativado por padrão, sem configuração |

| Declaração de ferramentas | tools=[{"type": "function", ...}] |

Igual, ferramentas server-side usam tipos internos como web_search |

| Saída em streaming | stream=True |

Totalmente compatível |

| Modo JSON | response_format={"type": "json_object"} |

Totalmente compatível |

Em projetos reais, sugerimos um processo de três etapas: primeiro, no ambiente de teste, altere apenas a base_url e o model para validar o diálogo básico; segundo, roteie solicitações de reasoning de alto valor para o Grok 4.3, mantendo o diálogo comum no modelo original para comparação A/B; terceiro, decida entre a migração total ou uma arquitetura híbrida com base nos dados reais.

🎯 Sugestão de arquitetura híbrida: Na plataforma APIYI (apiyi.com), todos os modelos principais (Grok 4.3, Claude Opus 4.7, GPT-5, Gemini 3 Pro) compartilham a mesma

base_urle chave API. Na camada de aplicação, basta alterar o campomodelpara alternar entre eles, sem necessidade de trabalho extra de integração.

Observações sobre o Acesso à API Grok 4.3

| Observação | Descrição |

|---|---|

| Campo do modelo | Use estritamente grok-4.3 (não grok4.3 ou Grok-4.3) |

| base_url | Recomendamos https://vip.apiyi.com/v1 para estabilidade e baixa latência |

| Campo de Reasoning | Ativado por padrão, sem parâmetros extras |

| Contexto ultralongo | Recomendamos entrada ≤ 800k tokens para deixar margem para o reasoning |

| Entrada de vídeo | Enviada via campo video_url; atualmente recomendado para vídeos de até 5 minutos |

🎯 Sugestão de uso prático: Recomendamos solicitar uma chave de teste na APIYI (apiyi.com) para validar o ciclo mínimo e, após estabilizar, migrar para a cota de produção. A plataforma suporta pré-pagamento de saldo e cobrança por uso, sem necessidade de cartão de crédito internacional, adequando-se aos processos financeiros de equipes brasileiras.

Perguntas Frequentes sobre a API do Grok 4.3

Q1: A API do Grok 4.3 é realmente mais barata que a do Grok 4.20? Qual é a redução?

Sim, e a redução é significativa. O Grok 4.20 tinha um preço anterior de aproximadamente US$ 3,00 / US$ 15,00 (entrada/saída), enquanto o Grok 4.3 foi ajustado para US$ 1,25 / US$ 2,50. Isso representa uma redução de cerca de 58% no preço de entrada e 83% no de saída. Considerando uma proporção de entrada/saída de 3:1, a redução no custo total é de aproximadamente 70%. Este é um sinal claro de que a xAI está atacando agressivamente o mercado de modelos de raciocínio.

Q2: A janela de contexto de 1M do Grok 4.3 está disponível na China?

Sim. A janela de contexto de 1M é uma capacidade do próprio modelo e não possui restrições geográficas. Desenvolvedores locais que acessam via serviços proxy de API, como o APIYI (apiyi.com), também contam com suporte a contextos longos. No entanto, atenção: quanto maior o número de tokens por solicitação, maior a latência (pode levar mais de 30 segundos de ponta a ponta). Recomendamos o processamento assíncrono ou o agendamento segmentado para contextos extremamente longos em ambientes de produção.

Q3: Como escolher entre o Grok 4.3 e o Claude Opus 4.7?

Escolha de acordo com o tipo de tarefa: se o foco do seu negócio for geração de código ou agentes de codificação de longa cadeia, escolha o Claude Opus 4.7, que ainda lidera o SWE-bench em cerca de 14 pontos percentuais. Se o foco for resumo de contextos longos, agentes do tipo Vending-Bench ou compreensão multimodal de vídeo, escolha o Grok 4.3; ele é 12 vezes mais barato e possui melhor adequação às tarefas. A arquitetura híbrida é a tendência para 2026: usar um serviço proxy de API unificado para alternar entre os dois modelos.

Q4: O que é o sistema 16-Agent Heavy do Grok 4.3? É possível chamá-lo via API?

O 16-Agent Heavy é um sistema de agendamento paralelo sobreposto ao modelo principal pela xAI, onde um orquestrador coordena até 16 agentes de trabalho para processar subtarefas em paralelo, sendo ideal para planejamento complexo e simulações de longa duração. Atualmente, o modo Heavy está disponível apenas para assinantes do SuperGrok Heavy (US$ 300/mês). A interface padrão da API ainda não expõe diretamente o acesso aos 16 agentes, mas você pode implementar sua própria orquestração multi-agente na camada de aplicação usando o Grok 4.3, obtendo resultados próximos ao modo Heavy nativo.

Q5: O Grok 4.3 API não possui memória persistente. Quais são as alternativas?

Você precisará construir um módulo de memória na camada de aplicação. A prática comum é armazenar o histórico de conversas do usuário em um banco de dados vetorial e, antes da invocação do modelo, recuperar os fragmentos top-k via RAG para compor o contexto. A comunidade possui soluções maduras como Mem0 e Letta, que se conectam diretamente a interfaces compatíveis com OpenAI e, portanto, também são compatíveis com o Grok 4.3. Sugerimos configurar o base_url para o APIYI (apiyi.com) para validar o diálogo básico e, em seguida, adicionar a camada de memória; esse é o caminho com menor custo de iteração.

Q6: Quais cenários de entrada de vídeo o Grok 4.3 suporta? Existe limite de duração?

A recomendação oficial é de vídeos com ≤ 5 minutos, ≤ 1080p e nos formatos mp4/mov/webm. O faturamento é feito com base em tokens de imagem após a extração de quadros. Aplicações típicas incluem: extração de eventos-chave de vídeos de vigilância, resumos estruturados de reuniões, notas de capítulos de vídeos educacionais e documentação automática de vídeos de demonstração de produtos. Se o vídeo for mais longo, recomendamos realizar o fatiamento no cliente e, em seguida, realizar chamadas paralelas ao Grok 4.3 para processamento.

Q7: Preciso alterar o código para migrar do OpenAI/Claude para o Grok 4.3?

Você só precisa alterar dois campos. A API do Grok 4.3 é totalmente compatível com o protocolo Chat Completions da OpenAI. Basta mudar o campo do modelo de gpt-5 ou claude-opus-4-7 para grok-4.3 e alterar o base_url do fornecedor original para https://vip.apiyi.com/v1. Saída em streaming, tool calling e JSON mode mantêm os mesmos nomes de campos da OpenAI, sem necessidade de reescrever a lógica do cliente. A entrada de vídeo é exclusiva do Grok 4.3 e é feita através do campo video_url, sem afetar o fluxo de entrada de imagens existente.

Q8: Para quais cenários o modo Batch do Grok 4.3 é adequado?

É ideal para tarefas em lote que não exigem tempo real e podem ser concluídas em até 24 horas, como rotulagem de dados offline, análise de logs históricos, pré-processamento de documentos em larga escala e arquivamento de moderação de conteúdo. A API Batch oferece uma economia adicional de 20% a 50% sobre o preço padrão. Para tarefas de processamento em lote com alta entrada e baixa saída, o custo real pode chegar a um patamar mínimo próximo de US$ 0,65 por milhão de tokens. Se o seu negócio não é sensível à latência, migrar o tráfego para o modo Batch é o caminho de migração com o menor custo unitário.

Pontos de atenção para desenvolvedores chineses sobre a API do Grok 4.3

Preparamos uma lista de verificação para equipes chinesas, cobrindo três dimensões: técnica, conformidade e custos.

Dimensão de Acesso Técnico

Primeiro, priorize serviços proxy de API estáveis em vez de construir seu próprio proxy. A interface oficial da xAI para o Grok 4.3 exige uma rede externa estável, e proxies autoconstruídos são propensos a instabilidades de conexão sob alta concorrência. Serviços proxy de API possuem implantações em múltiplos data centers locais, oferecendo melhor latência e estabilidade. Segundo, ao alterar o base_url para https://vip.apiyi.com/v1, o SDK não precisa de nenhuma alteração; seja o SDK da OpenAI para Python, o pacote openai para Node.js ou o go-openai para Go, todos podem ser usados diretamente.

Dimensão de Conformidade e Faturamento

Primeiro, equipes chinesas podem usar o serviço proxy de API para realizar pagamentos em RMB, evitando problemas de conformidade com cartões de crédito estrangeiros e pagamentos transfronteiriços. Segundo, as plataformas de proxy geralmente operam com faturamento por uso e saldo pré-pago, o que é mais amigável para os processos financeiros de empresas locais. Terceiro, para conformidade de dados transfronteiriços, recomendamos realizar a anonimização de informações sensíveis na camada de aplicação; não envie dados privados de clientes diretamente para modelos de raciocínio.

Dimensão de Controle de Custos

Primeiro, aproveite o desconto de cached_input do Grok 4.3; em cenários com comandos do sistema longos e fixos, o preço unitário real pode cair para US$ 0,31 por milhão de tokens. Segundo, direcione todas as tarefas que não exigem tempo real para o modo Batch e economize mais 20% a 50%. Terceiro, roteie tarefas simples para o Grok 4 Fast e reserve o 4.3 apenas para tarefas de raciocínio; o custo geral pode ser reduzido em 60% a 70%.

🎯 Resumo para implementação local: Recomendamos que as equipes chinesas adotem o seguinte caminho para o Grok 4.3: Serviço proxy de API (APIYI apiyi.com) + OpenAI SDK + Roteamento híbrido de modelos + Prioridade para Batch API. Essa combinação equilibra estabilidade e controle de custos, tendo sido validada em diversos produtos SaaS locais.

Resumo: O verdadeiro significado da API Grok 4.3

Voltando à nossa análise inicial, o Grok 4.3 não é apenas uma atualização de um "modelo mais inteligente", mas sim uma atualização que "redefine a curva de custos dos modelos de raciocínio". Três números explicam isso perfeitamente: US$ 1,25 por entrada, 1M de janela de contexto e uma velocidade de saída de 207 tokens/segundo. Essa combinação é única na categoria de modelos de raciocínio.

Os melhores cenários de aplicação para a API Grok 4.3 concentram-se em: resumo e análise de contextos longos, processamento estruturado de múltiplos fluxos de vídeo, fluxos de trabalho de colaboração multiagente e raciocínio de alta taxa de transferência sensível à latência. Ele não substitui o Claude Opus 4.7, mas, em muitas tarefas que antes exigiam o Opus 4.7, o Grok 4.3 oferece uma nova opção que é "12 vezes mais barata e com uma janela de contexto 5 vezes maior".

Para desenvolvedores brasileiros e globais, o caminho de integração da API Grok 4.3 já está muito maduro. Recomendamos realizar a integração e os testes diretamente pela plataforma APIYI (apiyi.com). O base_url é compatível com o SDK da OpenAI e basta utilizar o campo de modelo grok-4.3, sem necessidade de qualquer alteração no código. Na mesma plataforma, você também pode invocar o Claude Opus 4.7, GPT-5 e Gemini 3 Pro, facilitando comparações horizontais e orquestrações híbridas.

O verdadeiro teste para o Grok 4.3 virá no segundo semestre de 2026: saber se a OpenAI e a Anthropic seguirão com reduções de preços, se a xAI conseguirá suprir a lacuna de memória persistente e se o modo "16-Agent Heavy" conseguirá romper as barreiras dos sistemas de assinatura. Até lá, esta é uma das APIs de raciocínio com o melhor custo-benefício do mercado, valendo a pena que cada desenvolvedor de aplicações de agentes a teste com seus próprios dados reais.

Referências

-

Documentação oficial do modelo xAI: ID do modelo, preços e especificações de capacidade

- Link:

docs.x.ai/developers/models - Descrição: Contém os parâmetros completos da API Grok 4.3 e regras de cobrança.

- Link:

-

Notícias oficiais da xAI: Lançamentos de produtos e anúncios de atualização

- Link:

x.ai/news - Descrição: Conferência de lançamento e introdução de recursos do Grok 4.3.

- Link:

-

Tabela de preços em tempo real do OpenRouter: Comparação de modelos e histórico de preços

- Link:

openrouter.ai/x-ai/grok-4.3 - Descrição: Preços em tempo real e monitoramento de latência.

- Link:

-

Ranking de inteligência da Artificial Analysis: Índice de inteligência abrangente e dados de velocidade

- Link:

artificialanalysis.ai/models/grok-4-3 - Descrição: Comparação de dimensões como índice AA, velocidade e janela de contexto.

- Link:

-

Documentação de integração da APIYI: Tutorial completo para integração do Grok 4.3 via serviço proxy de API

- Link:

help.apiyi.com - Descrição: Inclui exemplos de SDK para Python/Node.js e explicações sobre cobrança.

- Link:

Autor: Equipe APIYI — Especializada em serviço proxy de API para modelos de linguagem grandes, ajudando desenvolvedores a invocar modelos como Grok 4.3, Claude Opus 4.7 e GPT-5 com um clique. Acesse APIYI (apiyi.com) para obter créditos de teste gratuitos.