Примечание автора: Глубокий разбор ключевой архитектуры, эталонных показателей производительности, ценовой политики API и методов подключения мультимодальной модели DeepSeek V4 с триллионом параметров. Помогает разработчикам быстро оценить и начать использовать эту открытую большую языковую модель.

DeepSeek V4 скоро выходит — это родная мультимодальная модель с триллионом параметров, поддерживающая единую генерацию текста, изображений и видео. В этой статье мы быстро разберём ключевые архитектурные инновации, производительность и способы подключения через API DeepSeek V4, чтобы помочь разработчикам заранее провести техническую оценку.

Основная ценность: За 3 минуты узнайте о ключевых технологических прорывах DeepSeek V4, сравнении производительности с GPT-5 / Claude, а также о том, как быстро подключиться и использовать её через API.

Обзор ключевых параметров и возможностей DeepSeek V4

DeepSeek V4 — это новое флагманское решение от команды DeepSeek, использующее архитектуру MoE (Mixture of Experts) с триллионом параметров и нативно поддерживающее мультимодальный ввод и вывод. Вот ключевые параметры DeepSeek V4:

| Параметр | Спецификация DeepSeek V4 | Улучшение по сравнению с V3 |

|---|---|---|

| Общее количество параметров | 1 триллион (1T) | Увеличение примерно в 1.5 раза |

| Активные параметры | ~37B / токен | Эффективный вывод MoE |

| Контекстное окно | 1 миллион токенов | Увеличение более чем в 10 раз |

| Поддержка модальностей | Текст + Изображение + Видео | Добавлена генерация изображений и видео |

| Лицензия | Открытая лицензия | Сохранена традиция открытого кода |

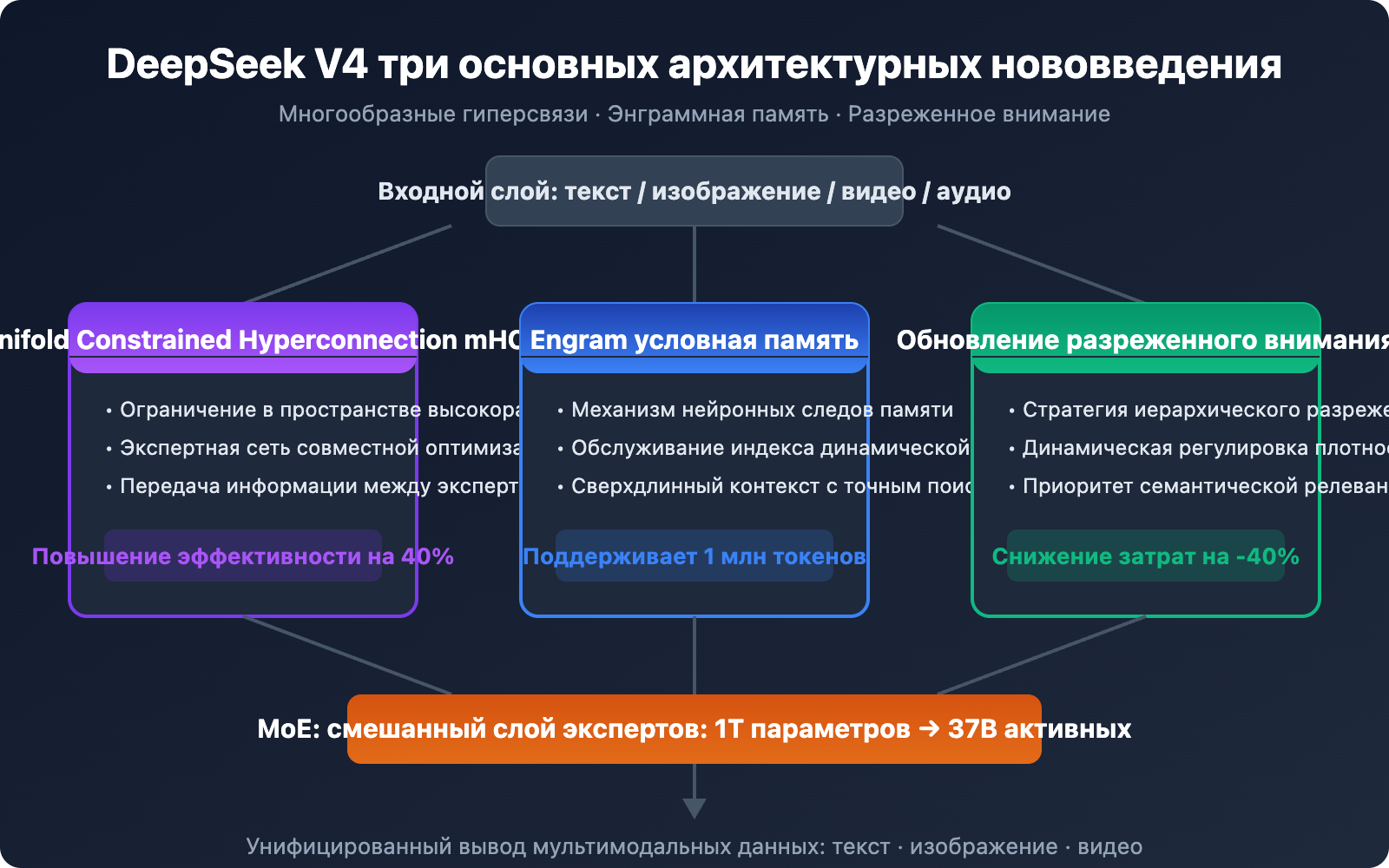

Три ключевые архитектурные инновации DeepSeek V4

DeepSeek V4 представляет три ключевые архитектурные инновации, которые лежат в основе его прорывной производительности:

1. Многообразие ограниченных гиперсвязей (mHC): Это совершенно новый способ соединения параметров, который значительно повышает эффективность совместного вывода нескольких экспертов в архитектуре MoE за счёт ограничения путей передачи информации между экспертными сетями в пространстве многообразий высокой размерности. По сравнению с традиционными разреженными механизмами шлюзов, mHC повышает коэффициент использования информации между экспертами примерно на 40%, сохраняя при этом вычислительную эффективность.

2. Условная система памяти Engram: Вдохновлённая концепцией «следов памяти» из нейробиологии, DeepSeek V4 включает модуль условной памяти. Эта система способна динамически поддерживать индексацию ключевой информации при обработке сверхдлинного контекста, позволяя модели точно извлекать и ссылаться на ранний контент даже при обработке 1 миллиона токенов, что критически важно для анализа больших кодовых баз и обработки длинных документов.

3. Улучшенный механизм разреженного внимания: На основе стандартного механизма внимания DeepSeek V4 использует иерархическую разреженную стратегию, которая динамически регулирует плотность вычислений внимания в зависимости от семантической связи между токенами. Это позволяет модели обрабатывать сверхдлинные последовательности с вычислительными затратами, значительно меньшими, чем при полном внимании, снижая стоимость вывода примерно на 40%.

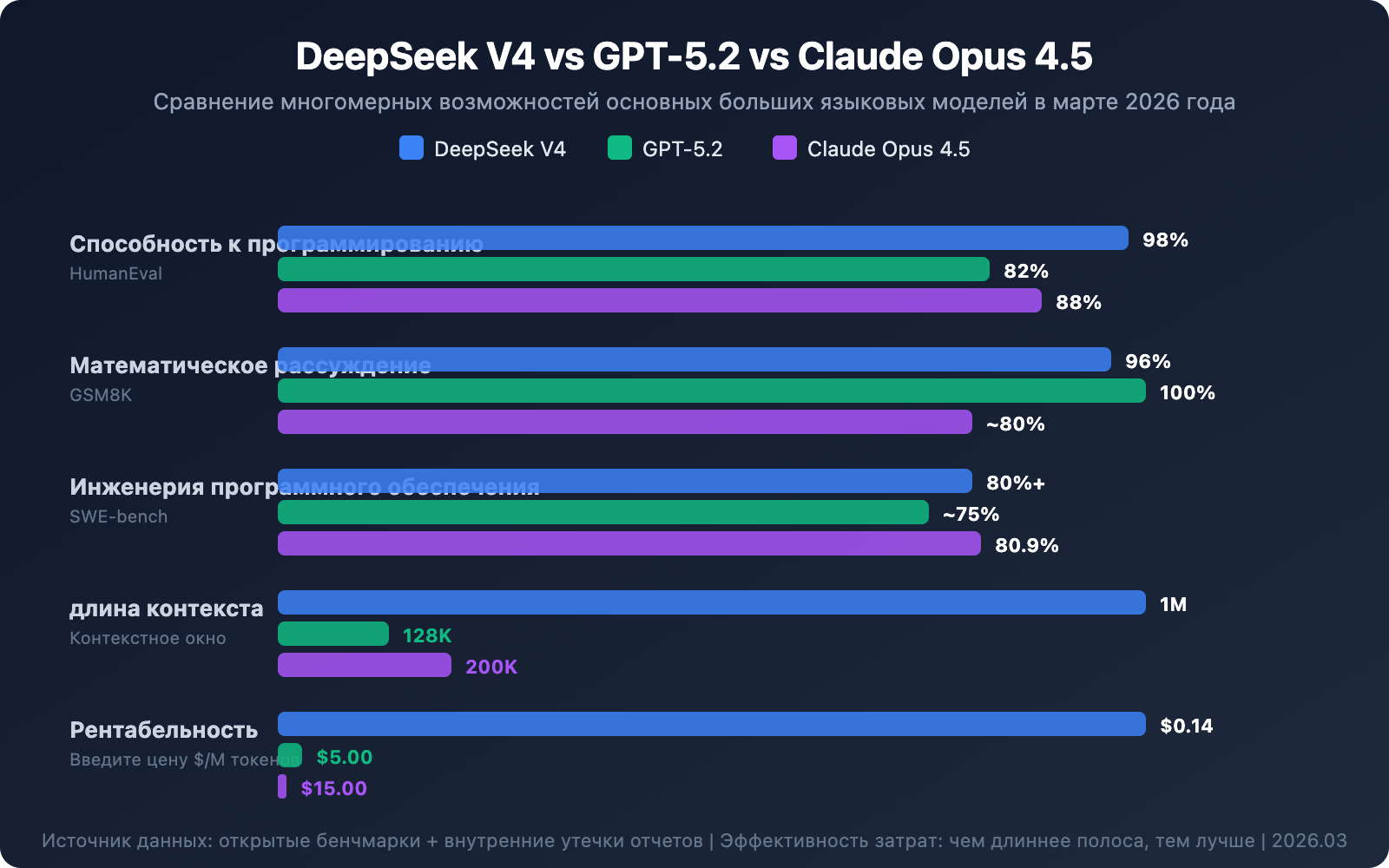

Бенчмарки производительности и сравнение моделей DeepSeek V4

DeepSeek V4 демонстрирует впечатляющую конкурентоспособность в нескольких основных бенчмарках. Ниже представлено сравнение производительности DeepSeek V4 с текущими ведущими моделями:

| Бенчмарк | DeepSeek V4 | Claude Opus 4.5 | GPT-5.2 | Описание теста |

|---|---|---|---|---|

| HumanEval (кодирование) | 98% | 88% | 82% | Точность генерации кода |

| SWE-bench Verified | 80%+ | 80.9% | ~75% | Успешность решения реальных GitHub Issue |

| GSM8K (математика) | 96% | ~80% | 100% | Способность к математическим рассуждениям |

| AIME 2025 | ~85% | ~80% | 100% | Сложные математические соревнования |

| Длина контекста | 1 млн токенов | 200 тыс. токенов | 128 тыс. токенов | Максимальная длина ввода |

📊 Примечание к данным: Приведённые выше бенчмарки DeepSeek V4 основаны на внутреннем тестировании и утечках, они ещё не прошли независимую проверку третьей стороной. Фактическая производительность после релиза может отличаться. Рекомендуем провести практическое тестирование и сравнение на платформе APIYI apiyi.com, чтобы получить реальный опыт использования.

Подробный разбор возможностей DeepSeek V4 в кодировании

DeepSeek V4 особенно выделяется в области программирования. Благодаря контекстному окну в 1 миллион токенов, модель может обрабатывать целый репозиторий кода за один проход, осуществляя по-настоящему связанные рассуждения между несколькими файлами.

Конкретные преимущества включают:

- Понимание всего репозитория: Загрузка полного кода проекта за раз для понимания зависимостей между компонентами.

- Рефакторинг между файлами: Поддержание глобальной согласованности при крупномасштабном рефакторинге кода.

- Отладка длинных цепочек: Отслеживание цепочек вызовов багов, затрагивающих несколько модулей.

Это означает, что при работе со сложными задачами программной инженерии DeepSeek V4 способен проводить глобальный анализ, подобно опытному разработчику, а не ограничиваться фрагментарным пониманием отдельных файлов.

Подробный обзор мультимодальных возможностей DeepSeek V4

В отличие от предыдущего поколения чисто текстовых моделей, DeepSeek V4 — это нативная мультимодальная модель. Она обучалась на текстовых, графических, видео- и аудиоданных одновременно, а не получила визуальные возможности в виде "надстройки" поверх текстовой модели.

Матрица мультимодальных возможностей DeepSeek V4

| Направление возможностей | Поддержка | Типичные сценарии применения |

|---|---|---|

| Генерация текста | ✅ Основная возможность | Кодирование, написание текстов, анализ, перевод |

| Генерация изображений | ✅ Нативная поддержка | Текст-в-изображение, помощь в дизайне, генерация диаграмм |

| Генерация видео | ✅ Нативная поддержка | Создание коротких видео, анимация |

| Понимание изображений | ✅ Нативная поддержка | Анализ изображений, OCR, визуальные вопросы и ответы |

| Понимание видео | ✅ Нативная поддержка | Резюмирование видео, анализ контента |

| Обработка аудио | 🔄 Требует подтверждения | Распознавание речи, анализ аудио |

Ключевое преимущество нативного мультимодального дизайна — согласованность межмодальных рассуждений. Например, когда пользователь просит "сгенерировать диаграмму архитектуры на основе этого кода", модель может одновременно понимать логику кода и напрямую выводить высококачественную визуальную диаграмму, не полагаясь на внешние инструменты.

DeepSeek также обещает добавлять обязательный водяной знак ко всем сгенерированным медиафайлам и оснащать систему фильтрацией контента в реальном времени для обеспечения безопасности и соответствия генерируемого контента.

Ценообразование и способы подключения к API DeepSeek V4

Цены на API DeepSeek V4 продолжают традицию высокой рентабельности DeepSeek и имеют значительные преимущества по стоимости по сравнению с основными конкурентами:

| Пункт тарификации | Цена DeepSeek V4 | Ориентировочная цена GPT-5 | Преимущество в стоимости |

|---|---|---|---|

| Входные токены | $0.14 / млн | $5.00 / млн | ~ в 35 раз |

| Выходные токены | $0.28 / млн | $15.00 / млн | ~ в 53 раза |

| Кэшированные входные данные | $0.07 / млн | — | Дополнительная экономия 50% при попадании в кэш |

| Бесплатный лимит | 5 млн токенов | — | Доступно сразу после регистрации нового пользователя |

Быстрое подключение к API DeepSeek V4

Ниже приведён минималистичный пример кода для вызова DeepSeek V4 через API:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Единый интерфейс APIYI

)

response = client.chat.completions.create(

model="deepseek-v4",

messages=[{"role": "user", "content": "Проанализируйте архитектурный дизайн этого кода"}],

max_tokens=4096

)

print(response.choices[0].message.content)

Посмотреть пример мультимодального вызова (генерация изображений)

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1" # Единый интерфейс APIYI

)

# Пример вызова для генерации изображения из текста

response = client.images.generate(

model="deepseek-v4",

prompt="Милый робот, пишущий код, в стиле киберпанк",

size="1024x1024",

quality="hd"

)

print(response.data[0].url)

🚀 Быстрый старт: Рекомендуем использовать платформу APIYI apiyi.com для быстрого подключения к DeepSeek V4. Платформа предоставляет готовый к использованию единый API-интерфейс, не требующий сложной настройки. Регистрация даёт бесплатный тестовый лимит, а интеграция занимает всего 5 минут.

Экосистема с открытым исходным кодом и стратегическое влияние DeepSeek V4

DeepSeek V4 планируется выпустить под лицензией с открытым исходным кодом. Это означает, что разработчики по всему миру смогут бесплатно загружать, дорабатывать и развертывать эту модель. Эта стратегия оказывает глубокое влияние на ландшафт индустрии ИИ:

Влияние на разработчиков:

- Возможность развертывания модели с триллионом параметров в частной среде, что обеспечивает конфиденциальность данных.

- Поддержка доработки под конкретные предметные области для создания специализированных отраслевых моделей.

- Экосистема, управляемая сообществом, ускорит итерацию возможностей модели.

Влияние на отрасль:

- Модель с триллионом параметров с открытым исходным кодом значительно снизит порог входа для разработки приложений ИИ.

- Будет способствовать дальнейшему снижению цен на API, что выгодно для малого и среднего бизнеса.

- Ускорит распространение и инновации в области мультимодальных приложений ИИ.

Аппаратная экосистема:

Стоит отметить, что DeepSeek V4 уже оптимизирована для китайских ИИ-чипов, таких как Huawei и Cambricon, что снижает зависимость от GPU NVIDIA. Это не просто технический выбор, но и отражение текущей тенденции к диверсификации цепочек поставок в ИИ.

💡 Рекомендация для разработки: Независимо от того, выбираете ли вы вызов облачного API или локальное развертывание, рекомендуется сначала провести проверку функциональности и оценку производительности через платформу APIYI apiyi.com, чтобы убедиться, что решение соответствует бизнес-требованиям, прежде чем принимать решение о схеме развертывания.

Часто задаваемые вопросы

Вопрос 1: Когда DeepSeek V4 будет официально выпущена?

Согласно данным из нескольких источников, релиз DeepSeek V4 ожидается в первую неделю марта 2026 года, незадолго до начала сессии Всекитайского собрания народных представителей (4 марта). Модель будет выпущена под открытой лицензией, а API-сервис запустится одновременно. Рекомендуем следить за официальными каналами DeepSeek для получения информации из первых рук или использовать платформу APIYI apiyi.com для быстрого доступа и интеграции.

Вопрос 2: Контекстное окно в 1 млн токенов у DeepSeek V4 — это действительно практично?

Контекстное окно в 1 млн токенов очень полезно для определённых сценариев, особенно для анализа больших кодовых баз (загрузка всего проекта целиком), обработки длинных документов (юридические контракты, технические руководства) и многораундовых сложных диалогов. Однако для повседневных задач с короткими текстами такое большое окно не требуется. Рекомендуется выбирать подходящие параметры конфигурации в зависимости от реальных потребностей. На платформе APIYI apiyi.com можно гибко настраивать параметры вызова для тестирования.

Вопрос 3: Цена DeepSeek V4 такая низкая. Гарантирует ли это качество?

Низкая стоимость DeepSeek обусловлена архитектурой MoE (при каждом выводе активируется только 37 млрд параметров из общего объёма в 1 трлн) и инженерными оптимизациями, а не снижением качества. Согласно открытым бенчмаркам, DeepSeek V4 демонстрирует производительность на уровне GPT-5 и Claude в задачах кодирования и математики. Перед внедрением рекомендуется провести всестороннее тестирование в реальных сценариях.

Итоги

Ключевые особенности DeepSeek V4:

- Архитектура MoE с триллионом параметров: 1 трлн общих параметров, 37 млрд активных — прорывной баланс между производительностью и эффективностью.

- Нативная мультимодальность: Не просто «текст + визуальный плагин», а единая обработка текста, изображений и видео с этапа обучения.

- Контекстное окно в 1 млн токенов: Имеет революционное значение для анализа больших кодовых баз и обработки длинных документов.

- Максимальная экономичность: Стоимость API составляет всего 1/35 от цены GPT-5, что значительно снижает затраты разработчиков.

- Экосистема с открытым исходным кодом: Стратегия открытого релиза ускорит инновации в сообществе и отраслевое внедрение.

Выпуск DeepSeek V4 знаменует вступление открытых больших языковых моделей в эру триллионных мультимодальных параметров. Для разработчиков это означает более низкий порог входа и более богатый выбор технологий.

Рекомендуем воспользоваться платформой APIYI apiyi.com, чтобы первыми оценить полные возможности DeepSeek V4. Платформа предоставляет бесплатные квоты и унифицированный интерфейс для нескольких моделей, что удобно для быстрого сравнения и оценки.

📚 Справочные материалы

-

Статья TechNode: План выпуска мультимодальной модели DeepSeek V4

- Ссылка:

technode.com/2026/03/02/deepseek-plans-v4-multimodal-model-release-this-week-sources-say/ - Описание: Авторитетный репортаж о сроках выхода DeepSeek V4 и аппаратном сотрудничестве

- Ссылка:

-

Официальная документация DeepSeek API: Ценообразование моделей и спецификации интерфейса

- Ссылка:

api-docs.deepseek.com/quick_start/pricing - Описание: Официальная документация по API-ценам и технологиям, обязательна к прочтению для разработчиков

- Ссылка:

-

Сравнение бенчмарков ИИ-моделей: Рейтинг производительности основных больших языковых моделей 2026 года

- Ссылка:

lmcouncil.ai/benchmarks - Описание: Независимая платформа стороннего тестирования, предоставляющая объективные данные для сравнения производительности моделей

- Ссылка:

Автор: Техническая команда APIYI

Техническое обсуждение: Приглашаем обсудить опыт использования DeepSeek V4 в комментариях. Больше материалов по интеграции API можно найти в документации APIYI docs.apiyi.com