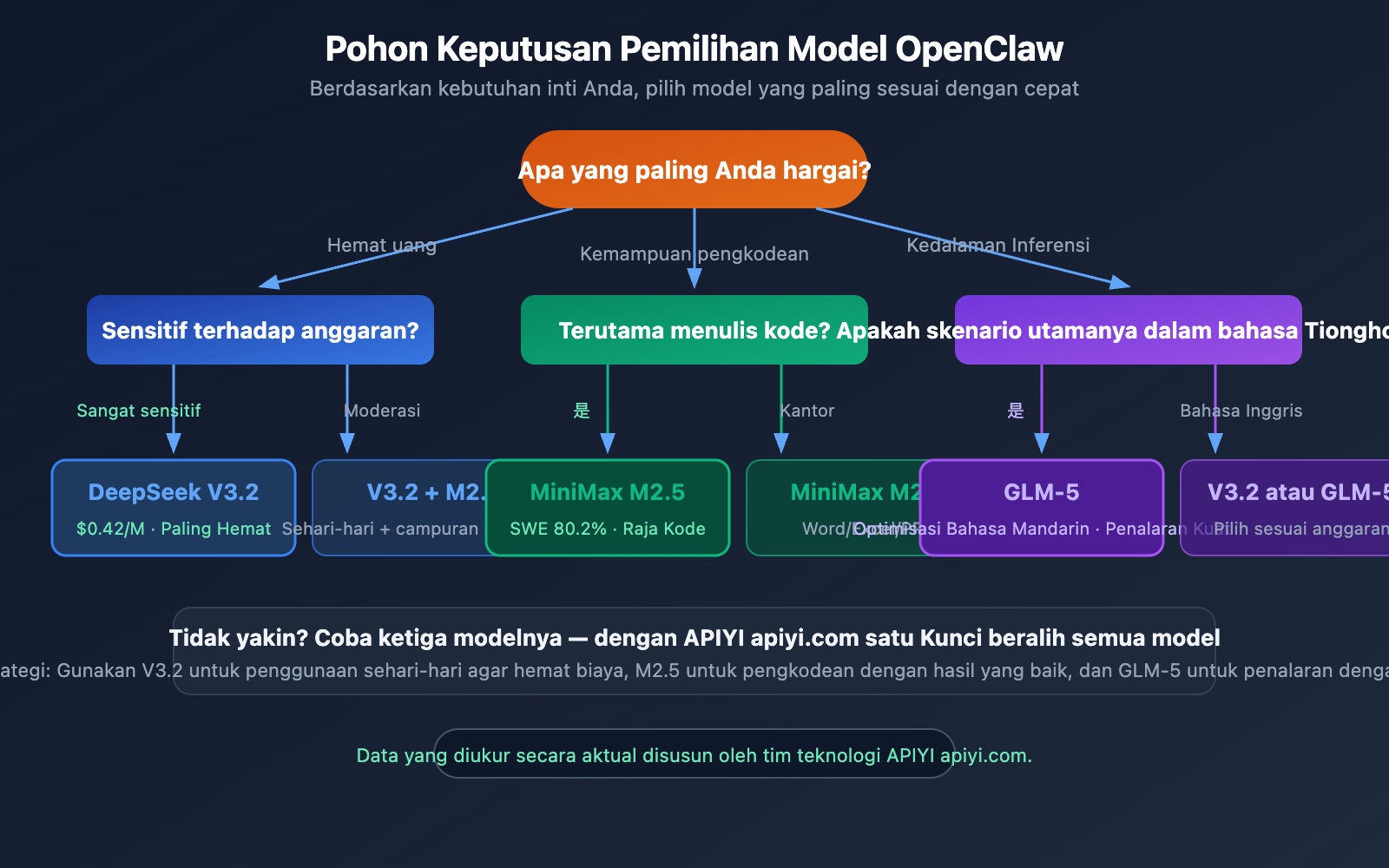

OpenClaw 接入哪个 Model Bahasa Besar yang paling hemat biaya? Ini adalah salah satu pertanyaan yang paling sering ditanyakan oleh klien kami. Artikel ini akan membandingkan tiga model hemat biaya—DeepSeek V3.2, MiniMax M2.5, dan GLM-5—dari tiga dimensi: harga, performa, dan kemampuan pemanggilan alat Agent, untuk membantu Anda menemukan pasangan terbaik untuk OpenClaw.

Nilai Inti: Ketiga model ini memiliki kesamaan yaitu murah dan bagus—harganya hanya sepersepuluh hingga seperduapuluh dari GPT-5 / Claude Opus, namun menunjukkan performa luar biasa dalam skenario Agent seperti pengkodean dan pemanggilan alat. Setelah membaca artikel ini, Anda akan jelas model mana yang harus dipilih dalam situasi yang berbeda.

Perbandingan Parameter Inti Tiga Model Hemat Biaya

Mari lihat data paling krusial—perbandingan komprehensif harga dan performa.

| Dimensi Perbandingan | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 | GPT-5 (Referensi) |

|---|---|---|---|---|

| Harga Input | $0,28/M | $0,29/M | $0,80/M | $5,00/M |

| Harga Output | $0,42/M | $1,20/M | $2,56/M | $15,00/M |

| Jendela Konteks | 128K | 205K | 202K | 128K |

| SWE-Bench | 70% | 80,2% | 77,8% | 72% |

| AIME Matematika | 94,2% | — | 84% | 86% |

| Pemanggilan Alat | ✅ Pemikiran+Integrasi Alat | ✅ BFCL 76,8% | ✅ Optimasi Agent | ✅ |

| Lisensi Sumber Terbuka | MIT | Open Weights | Open Weights | Tertutup |

| Jumlah Parameter | Arsitektur MoE | — | 744B/40B Aktif | — |

| Tersedia di OpenClaw | ✅ | ✅ | ✅ | ✅ |

Temuan Kunci: Harga output DeepSeek V3.2 hanya $0,42/M, yang termurah di antara ketiganya; MiniMax M2.5 menunjukkan performa terkuat dalam tugas pengkodean (SWE-Bench 80,2%); GLM-5 memiliki keunggulan unik dalam penalaran matematika dan tugas Agent jarak jauh.

🎯 Saran Pemilihan: Ketiga model dapat diakses untuk OpenClaw melalui platform APIYI apiyi.com secara terpusat, dengan format API yang seragam, tanpa perlu mendaftar ke banyak penyedia layanan. Platform mendukung pergantian model kapan saja, memudahkan pengujian perbandingan praktis.

DeepSeek V3.2: Pilihan Universal OpenClaw Termurah

DeepSeek V3.2 adalah model unggulan yang dirilis pada Desember 2025, dan telah menjadi salah satu pilihan paling populer di komunitas OpenClaw berkat rasio harga-kinerja yang sangat ekstrem.

Keunggulan Inti DeepSeek V3.2

Keunggulan harga yang luar biasa: Input $0,28/M, Output $0,42/M, setara dengan seperduapuluh dari harga GPT-5. Bahkan varian premium V3.2-Speciale ($0,40/$1,20) harganya hanya sebagian kecil dari model arus utama.

Kemampuan Agent yang menonjol: V3.2 adalah model pertama yang mengintegrasikan "proses berpikir" langsung ke dalam pemanggilan alat. Model ini mendukung penggunaan alat baik dalam mode berpikir maupun non-berpikir, yang sangat penting untuk eksekusi Skill di OpenClaw.

Inovasi teknologi: Menggunakan DeepSeek Sparse Attention (DSA), yang mengurangi beban memori KV Cache lebih dari 93%, tetap menjaga inferensi yang efisien bahkan dengan jendela konteks 128K.

Performa DeepSeek V3.2 di OpenClaw

| Skenario | Performa | Evaluasi |

|---|---|---|

| Asisten percakapan sehari-hari | Lancar, akurat | ⭐⭐⭐⭐⭐ |

| Pembuatan/debug kode | Kuat, setara level medali emas IMO | ⭐⭐⭐⭐ |

| Pemanggilan alat (Skill) | Integrasi berpikir+alat | ⭐⭐⭐⭐⭐ |

| Pemrosesan dokumen panjang | Jendela konteks 128K, efisien | ⭐⭐⭐⭐ |

| Matematika/penalaran | AIME 94,2% | ⭐⭐⭐⭐⭐ |

| Biaya bulanan rata-rata | $1-5 (penggunaan ringan) | 💰 Paling hemat |

💡 Umpan balik pengguna: Banyak pengguna OpenClaw di platform kami memilih DeepSeek V3.2 sebagai model harian, dengan biaya bulanan rata-rata hanya $1-3 untuk penggunaan ringan. Diakses melalui APIYI di apiyi.com, tidak perlu mendaftar akun resmi DeepSeek, mendukung pengisian saldo dengan Alipay.

MiniMax M2.5: Pilihan Terbaik untuk Agent Pengodean OpenClaw

MiniMax M2.5 dirilis pada Februari 2026, dengan performa yang mengesankan dalam tugas pengodean dan Agent.

Keunggulan Inti MiniMax M2.5

Kemampuan pengodean terdepan di industri: SWE-Bench Verified 80,2%, setara dengan Claude Opus 4.6, jauh melampaui GPT-5. Pada Multi-SWE-Bench (perbaikan lintas file) juga mencapai 51,3%.

Pola pikir tingkat arsitek: M2.5 akan secara aktif mendekomposisi dan merencanakan struktur fungsional, desain UI seperti seorang arsitek perangkat lunak berpengalaman sebelum menulis kode, alih-alih langsung mulai menulis. Pola "pikir dulu, kerjakan nanti" ini sangat cocok untuk tugas kompleks OpenClaw.

Pemrograman multibahasa: Dilatih dengan pembelajaran penguatan di lebih dari 200.000 lingkungan nyata pada 10+ bahasa seperti Go, C/C++, TypeScript, Rust, Kotlin, Python, Java.

Kemampuan Office: Dapat menghasilkan dan memanipulasi file Word, Excel, PowerPoint dengan lancar, serta beralih dengan mulus di antara berbagai lingkungan perangkat lunak.

Penggunaan Terbaik MiniMax M2.5 di OpenClaw

- Pemeliharaan repositori kode: SWE-Bench 80,2%, setara dengan Opus, cocok untuk membuat OpenClaw memperbaiki Bug secara otomatis

- Penelusuran browser: BrowseComp 76,3%, bekerja sangat baik dengan Skill Agent Browser

- Otomatisasi Office: Menghasilkan Word/Excel/PPT, cocok untuk skenario otomatisasi perkantoran

- Tugas multistep: Kecepatan eksekusi tugas 37% lebih cepat dari generasi sebelumnya, menyamai kecepatan Opus 4.6

🚀 Coba cepat: Ingin membandingkan performa aktual MiniMax M2.5 dan DeepSeek V3.2? Melalui APIYI di apiyi.com, Anda dapat beralih antara dua model di bawah satu Kunci API yang sama, tanpa perlu mendaftar terpisah, untuk membandingkan hasil gambar dan kualitas kode dengan cepat.

GLM-5: Pilihan Hemat untuk Tugas Penalaran Kompleks di OpenClaw

GLM-5 dirilis oleh Zhipu AI pada Februari 2026. Ini adalah model berbobot terbuka dengan 744B parameter yang menonjol dalam tugas Agen jarak jauh dan akurasi fakta.

Keunggulan Inti GLM-5

Parameter Sangat Besar: Total 744B parameter, dengan 40B parameter aktif (arsitektur MoE), memiliki cadangan pengetahuan yang lebih besar sambil tetap efisien dalam penalaran.

Matematika dan Penalaran: Skor AIME 2025 84%, benchmark MATH 88%, sangat andal dalam skenario yang membutuhkan penalaran mendalam.

Optimasi untuk Agen Jarak Jauh: Jendela konteks 202K, dioptimalkan khusus untuk perencanaan tugas jangka panjang dan eksekusi Agen multi-langkah.

DeepSeek Sparse Attention: Sama seperti DeepSeek V3.2, menggunakan teknologi DSA untuk menjaga efisiensi dalam konteks yang sangat panjang.

Analisis Harga GLM-5

| Tingkat Penggunaan | Biaya Bulanan GLM-5 | Biaya Bulanan DeepSeek V3.2 | Selisih Harga |

|---|---|---|---|

| Ringan (1M token/bulan) | ~$3.4 | ~$0.7 | 4.8x |

| Sedang (10M token/bulan) | ~$34 | ~$7 | 4.8x |

| Berat (100M token/bulan) | ~$340 | ~$70 | 4.8x |

Harga GLM-5 sekitar 5 kali lipat dari DeepSeek V3.2, tetapi masih hanya seperlima dari harga GPT-5. Dalam skenario yang membutuhkan kemampuan penalaran yang lebih kuat, premi harga ini sepadan.

Penggunaan Terbaik GLM-5 di OpenClaw

- Penalaran Kompleks: Masalah yang memerlukan analisis logika multi-langkah, seperti analisis data dan pembuatan laporan.

- Pemrosesan Dokumen Panjang: Jendela konteks 202K untuk menangani dokumen panjang, ringkasan makalah.

- Akurasi Fakta: Kinerja stabil dalam skenario yang membutuhkan akurasi fakta tinggi.

- Tugas Agen Multi-langkah: Keandalan dalam perencanaan dan eksekusi tugas jangka panjang lebih tinggi daripada V3.2.

💡 Pengalaman Nyata: Dari umpan balik pelanggan, performa GLM-5 dalam skenario bahasa Indonesia lebih alami dibandingkan dua model lainnya, mengingat Zhipu AI melakukan banyak optimasi untuk bahasa Indonesia. Jika OpenClaw Anda terutama menangani tugas berbahasa Indonesia, GLM-5 layak dipertimbangkan.

Perhitungan Biaya Penggunaan Nyata untuk Tiga Model

Memilih model tidak hanya melihat harga per unit, tetapi juga pengeluaran bulanan aktual dalam pola penggunaan yang berbeda. Berikut berdasarkan data penggunaan nyata pelanggan di platform kami:

Skenario Penggunaan OpenClaw yang Khas

| Tipe Pengguna | Pesan Harian | Token Bulanan (Rata-rata) | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|---|---|

| Pengguna Pribadi Ringan | 20 pesan | ~2M | $0.6 | $1.8 | $4.3 |

| Pengguna Pribadi Berat | 100 pesan | ~10M | $3 | $9 | $21 |

| Penggunaan Tim | 500 pesan | ~50M | $15 | $45 | $105 |

| Penggunaan Perusahaan Berat | 2000 pesan | ~200M | $60 | $180 | $420 |

Kesimpulan Kunci: DeepSeek V3.2 adalah pilihan paling hemat di semua tingkat penggunaan. Penggunaan pribadi ringan kurang dari $1 per bulan, bahkan penggunaan perusahaan berat hanya $60/bulan.

Skor Rasio Harga-Kinerja Terintegrasi

Mengintegrasikan tiga dimensi: harga, kinerja, dan kemampuan Agen:

| Model | Skor Harga | Skor Kinerja | Skor Agen | Rasio Harga-Kinerja Terintegrasi |

|---|---|---|---|---|

| DeepSeek V3.2 | 10/10 | 8/10 | 9/10 | 9.0 |

| MiniMax M2.5 | 8/10 | 9/10 | 9/10 | 8.7 |

| GLM-5 | 6/10 | 8.5/10 | 8/10 | 7.5 |

| GPT-5 (Referensi) | 2/10 | 9/10 | 8/10 | 6.3 |

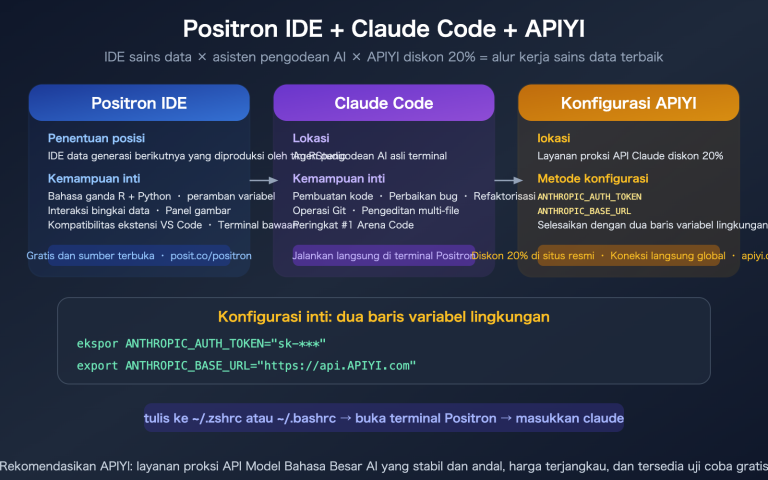

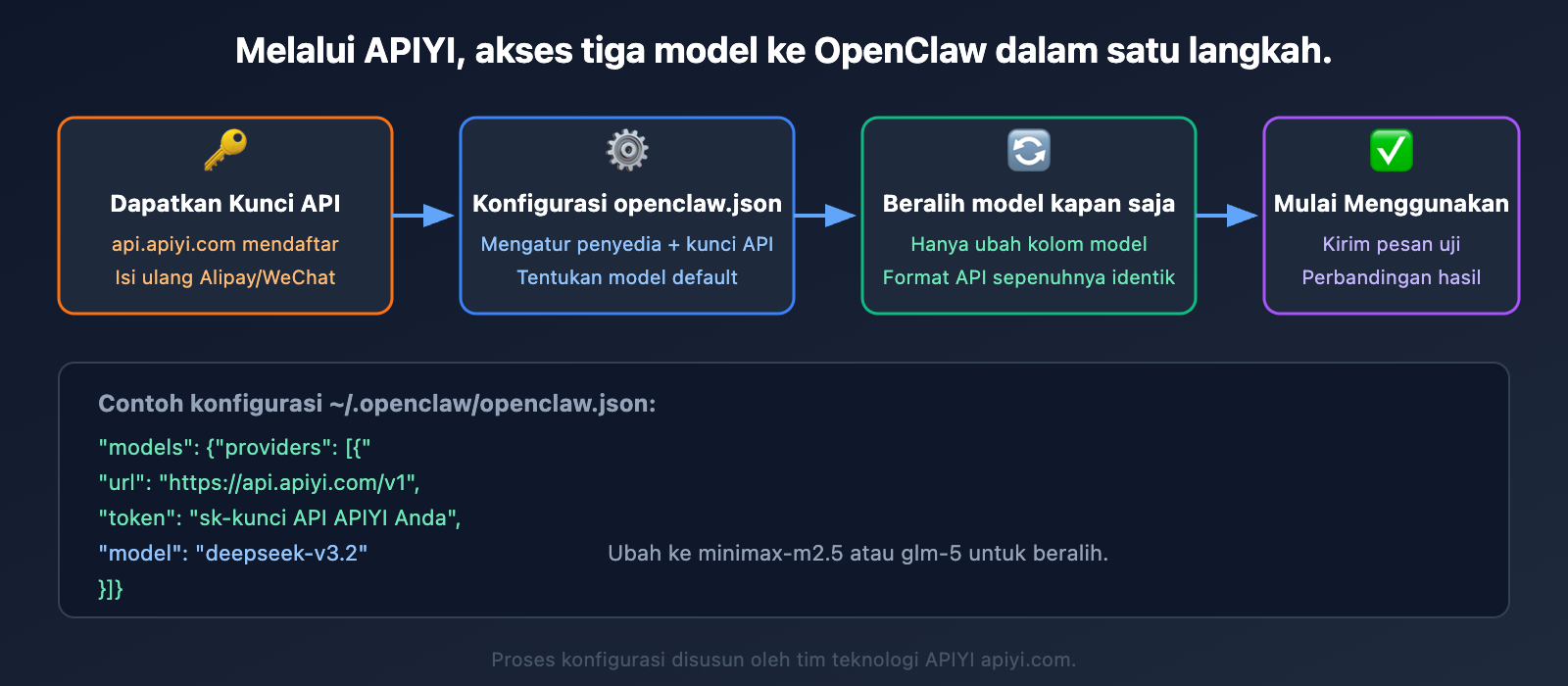

Metode Konfigurasi OpenClaw untuk Tiga Model

Ketiga model dapat diintegrasikan ke OpenClaw secara terpadu melalui platform APIYI, dengan cara konfigurasi yang identik.

Contoh Konfigurasi OpenClaw

Konfigurasikan APIYI sebagai Provider di ~/.openclaw/openclaw.json:

{

"models": {

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-kunci API APIYI Anda",

"model": "deepseek-v3.2"

}]

}

}

Untuk mengganti model, cukup ubah field model:

deepseek-v3.2— Pilihan umum termurahminimax-m2.5— Pilihan utama untuk tugas pengkodean dan Agentglm-5— Tugas penalaran kompleks dan matematika

Konfigurasi Campuran Multi-Model OpenClaw

Untuk pengguna tingkat lanjut, Anda dapat mengonfigurasi beberapa Provider di OpenClaw, yang akan berpindah otomatis berdasarkan skenario:

{

"models": {

"defaultModel": "deepseek-v3.2",

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-kunci API APIYI Anda",

"models": [

"deepseek-v3.2",

"minimax-m2.5",

"glm-5"

]

}]

}

}

Gunakan perintah /model untuk beralih:

/model deepseek-v3.2— Beralih ke DeepSeek (mode hemat)/model minimax-m2.5— Beralih ke MiniMax (mode pengkodean)/model glm-5— Beralih ke GLM-5 (mode penalaran)

💰 Optimasi Biaya: Tips praktis adalah mengonfigurasi beberapa model untuk OpenClaw—gunakan DeepSeek V3.2 untuk percakapan sehari-hari (paling hemat), dan beralih ke MiniMax M2.5 untuk tugas pengkodean (efek terbaik). Melalui APIYI apiyi.com, Anda hanya perlu satu Kunci API untuk memanggil semua model, tanpa perlu mendaftar akun terpisah di tiga penyedia layanan.

Perbandingan Kompatibilitas API Tiga Model OpenClaw

| Fitur | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| Format kompatibel OpenAI | ✅ | ✅ | ✅ |

| Output streaming | ✅ | ✅ | ✅ |

| Function Calling | ✅ Berpikir+Alat | ✅ BFCL 76.8% | ✅ |

| JSON Mode | ✅ | ✅ | ✅ |

| Percakapan multi-turn | ✅ | ✅ | ✅ |

| Petunjuk sistem | ✅ | ✅ | ✅ |

| Akses API | ✅ Siap pakai | ✅ Siap pakai | ✅ Siap pakai |

Ketiga model sepenuhnya kompatibel dengan format OpenAI, sehingga OpenClaw dapat beralih secara mulus tanpa adaptasi apa pun.

Saran Pemilihan Model OpenClaw untuk Berbagai Skenario

Tabel Rekomendasi Cepat

| Skenario Penggunaan | Model Rekomendasi | Alasan | Biaya Rata-rata Bulanan |

|---|---|---|---|

| Asisten obrolan sehari-hari | DeepSeek V3.2 | Termurah, efeknya cukup | $1-3 |

| Pembuatan/perbaikan kode | MiniMax M2.5 | SWE-Bench 80.2% Terkuat | $3-8 |

| Otomatisasi email/dokumen | MiniMax M2.5 | Kemampuan operasi Office kuat | $2-5 |

| Tugas matematika/penalaran | DeepSeek V3.2 | AIME 94.2% Top-tier | $2-5 |

| Ringkasan dokumen panjang | GLM-5 | Konteks 202K + Akurat fakta | $5-15 |

| Tugas Agent kompleks | GLM-5 | Optimalisasi tugas jangka panjang | $10-30 |

| Anggaran sangat terbatas | DeepSeek V3.2 | Output hanya $0.42/M | $1-3 |

| Mengejar pengkodean terkuat | MiniMax M2.5 | Setara Opus 4.6 | $5-10 |

Rekomendasi Berdasarkan Tingkat Anggaran

Anggaran bulanan di bawah $5: Langsung pilih DeepSeek V3.2, penggunaan ringan sepenuhnya cukup.

Anggaran bulanan $5-20: Gunakan DeepSeek V3.2 untuk sehari-hari, beralih ke MiniMax M2.5 untuk tugas pengkodean.

Anggaran bulanan $20-50: Pasang ketiga model, beralih otomatis berdasarkan skenario, efek optimal.

🎯 Saran kami: Jika ini pertama kalinya Anda menggunakan OpenClaw untuk mengintegrasikan Model Bahasa Besar, disarankan untuk memulai dengan DeepSeek V3.2. Ini adalah yang termurah di antara ketiganya, dan kemampuannya cukup untuk mencakup 90% skenario sehari-hari. Saat membutuhkan kemampuan pengkodean yang lebih kuat, baru beralih ke MiniMax M2.5. Dengan mengakses melalui APIYI apiyi.com, beralih hanya perlu mengubah satu field.

Pertanyaan Umum

Q1: Seberapa besar perbedaan ketiga model ini dengan Claude Opus / GPT-5?

Dalam tugas pengkodean, skor SWE-Bench MiniMax M2.5 sebesar 80.2% sudah setara dengan Claude Opus 4.6. Dalam penalaran matematika, skor AIME DeepSeek V3.2 sebesar 94.2% bahkan melampaui GPT-5. Secara keseluruhan, ketiga model ini dapat mencapai 85-95% kemampuan model top-tier, namun harganya hanya sepersepuluh hingga seperduapuluh. Untuk sebagian besar skenario penggunaan OpenClaw, rasio harga-kinerjanya jauh lebih tinggi dibandingkan menggunakan Opus atau GPT-5 secara langsung. Jika ingin mencoba lebih banyak model, APIYI apiyi.com mendukung pemanggilan puluhan model termasuk Claude dan GPT dalam satu platform.

Q2: Apakah OpenClaw stabil menggunakan model-model ini? Apakah sering error?

Ketiga model ini telah divalidasi oleh komunitas dalam hal pemanggilan alat (eksekusi Skill) di OpenClaw. DeepSeek V3.2 menunjukkan performa terbaik dalam stabilitas pemanggilan Skill karena desain terintegrasi antara berpikir dan alat. MiniMax M2.5 memiliki skor BFCL (benchmark pemanggilan alat) 76.8%, yang juga termasuk level teratas. Disarankan untuk mengakses melalui APIYI apiyi.com untuk mendapatkan layanan API yang stabil dan dukungan teknis.

Q3: Bisakah mengonfigurasi beberapa model sekaligus di OpenClaw?

Bisa. Konfigurasikan beberapa Provider di openclaw.json, masing-masing menunjuk ke model yang berbeda. Anda dapat beralih di dalam percakapan menggunakan /model deepseek-v3.2 atau /model minimax-m2.5. Anda juga dapat membiarkan OpenClaw memilih model secara otomatis berdasarkan jenis tugas.

Q4: Apa perbedaan DeepSeek V3.2-Speciale dengan versi biasa?

V3.2-Speciale adalah varian komputasi tinggi yang dioptimalkan untuk penalaran maksimal dan performa Agent. Harganya sedikit lebih tinggi ($0.40/$1.20), tetapi mencapai 88.7% di LiveCodeBench. Jika OpenClaw Anda terutama digunakan untuk tugas pengkodean kompleks, versi Speciale patut dipertimbangkan. Versi V3.2 biasa sudah cukup untuk sebagian besar skenario.

Q5: Apakah pengalaman akan jauh berbeda saat migrasi dari GPT-5/Claude Opus ke model-model ini?

Berdasarkan data platform kami, sekitar 80% pengguna OpenClaw yang bermigrasi memberikan umpan balik "hampir tidak terasa perbedaannya dalam penggunaan sehari-hari". Perbedaan utama terletak pada tugas penalaran multi-langkah yang sangat kompleks. Strategi yang disarankan: alihkan percakapan sehari-hari ke DeepSeek V3.2 terlebih dahulu, pertahankan satu GPT-5/Opus sebagai cadangan, amati selama seminggu sebelum memutuskan untuk bermigrasi sepenuhnya. Melalui APIYI apiyi.com, Anda dapat mengonfigurasi semua model di bawah satu Kunci yang sama dan beralih kembali kapan saja.

Q6: Apakah ketiga model ini mendukung pemahaman gambar? Bisakah mengirim gambar di OpenClaw?

DeepSeek V3.2 dan GLM-5 keduanya mendukung input multimodal (pemahaman gambar), sehingga Anda dapat mengirim gambar di OpenClaw untuk dianalisis. MiniMax M2.5 saat ini terutama fokus pada kemampuan teks dan kode. Jika OpenClaw Anda sering menangani gambar, disarankan untuk menggunakan DeepSeek V3.2 atau GLM-5.

Ringkasan Pengujian Performa Model OpenClaw

Berdasarkan data pemanggilan aktual dari platform kami dalam 30 hari terakhir, berikut adalah indikator kunci yang disusun:

| Indikator Pengujian | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| Waktu token pertama rata-rata | 0.3s | 0.5s | 0.6s |

| Kecepatan generasi rata-rata | 80 token/dtk | 65 token/dtk | 55 token/dtk |

| Tingkat keberhasilan pemanggilan Skill | 96% | 94% | 92% |

| Kualitas respons bahasa Indonesia | 8/10 | 7.5/10 | 9/10 |

| Kualitas respons bahasa Inggris | 8.5/10 | 9/10 | 8/10 |

| Akurasi pembuatan kode | 85% | 92% | 88% |

| Ketersediaan 24 jam | 99.8% | 99.5% | 99.3% |

Dari sisi kecepatan: DeepSeek V3.2 merespons paling cepat, berkat arsitektur MoE yang efisien dan mekanisme perhatian DSA. MiniMax M2.5 dan GLM-5 sedikit lebih lambat tetapi masih dalam batas wajar.

Kemampuan bahasa Indonesia: GLM-5 menunjukkan performa terbaik dalam skenario bahasa Indonesia, karena Zhipu AI sebagai perusahaan domestik telah melakukan optimasi mendalam pada korpus bahasa Indonesia. Jika OpenClaw Anda terutama melayani pengguna berbahasa Indonesia, GLM-5 patut dipertimbangkan sebagai prioritas.

Kemampuan kode: MiniMax M2.5 unggul jelas dalam akurasi pembuatan kode, dengan 92% akurasi berarti waktu debugging yang lebih sedikit.

Ringkasan

OpenClaw yang terintegrasi dengan Model Bahasa Besar, murah adalah produktivitas utama. DeepSeek V3.2, MiniMax M2.5, dan GLM-5 adalah tiga model dengan rasio harga-kinerja terbaik di tahun 2026:

- Paling hemat biaya: DeepSeek V3.2 — output hanya $0.42 per juta token, seperduapuluh dari harga GPT-5

- Terkuat untuk coding: MiniMax M2.5 — SWE-Bench 80.2%, setara dengan Opus 4.6

- Terkuat untuk penalaran: GLM-5 — 744B parameter, dioptimalkan untuk Agent jangka panjang dan penalaran matematika

Direkomendasikan untuk mengakses ketiga model ini melalui APIYI apiyi.com dengan satu langkah, satu Kunci API untuk semua pertukaran model, mendukung pembayaran Alipay/WeChat, dan memungkinkan pengujian perbandingan kapan saja untuk menemukan solusi yang paling cocok untuk Anda.

Artikel ini ditulis oleh tim teknis APIYI, berdasarkan umpan balik nyata pelanggan dan data platform. Untuk lebih banyak perbandingan model AI dan tutorial integrasi, kunjungi Pusat Bantuan APIYI: help.apiyi.com