Welches große Sprachmodell bietet für OpenClaw das beste Preis-Leistungs-Verhältnis? Das ist eine der am häufigsten gestellten Fragen unserer Kunden. Dieser Artikel vergleicht drei kostengünstige Modelle – DeepSeek V3.2, MiniMax M2.5 und GLM-5 – anhand der drei Dimensionen Preis, Leistung und Agent-Tool-Fähigkeiten, um Ihnen zu helfen, den perfekten Partner für OpenClaw zu finden.

Kernaussage: Diese drei Modelle haben gemeinsam, dass sie günstig und leistungsstark sind – sie kosten nur ein Zehntel bis ein Zwanzigstel von GPT-5 / Claude Opus, glänzen aber in Agent-Szenarien wie Programmierung und Tool-Aufrufen. Nach der Lektüre dieses Artikels wissen Sie genau, welches Modell Sie in welchem Szenario wählen sollten.

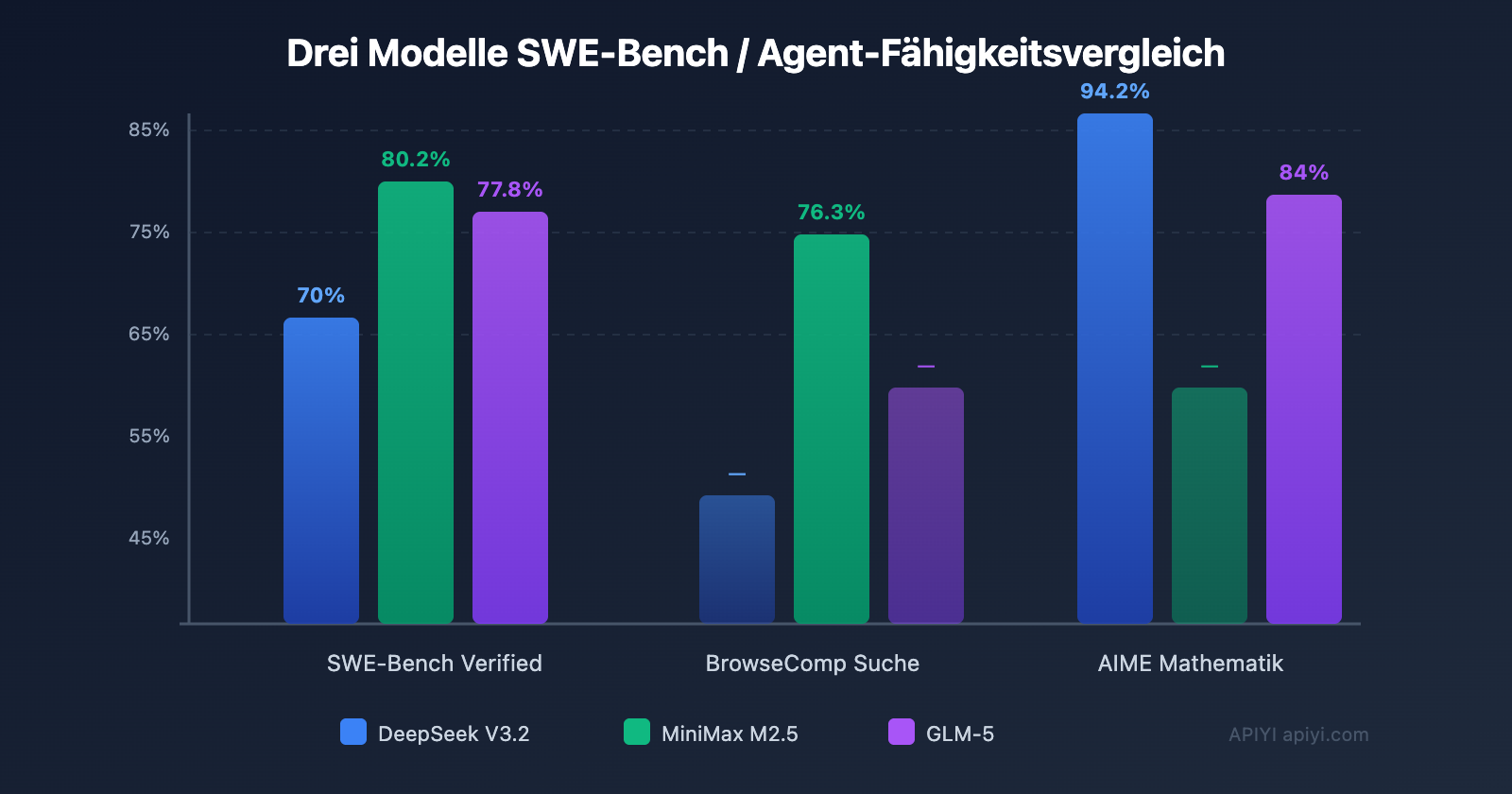

Vergleich der Kernparameter von drei kostengünstigen Modellen

Zuerst die wichtigsten Daten – ein umfassender Vergleich von Preis und Leistung.

| Vergleichsdimension | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 | GPT-5 (Referenz) |

|---|---|---|---|---|

| Eingabepreis | $0,28/M | $0,29/M | $0,80/M | $5,00/M |

| Ausgabepreis | $0,42/M | $1,20/M | $2,56/M | $15,00/M |

| Kontextfenster | 128K | 205K | 202K | 128K |

| SWE-Bench | 70% | 80,2% | 77,8% | 72% |

| AIME Mathematik | 94,2% | — | 84% | 86% |

| Tool-Aufrufe | ✅ Denken+Tool-Integration | ✅ BFCL 76,8% | ✅ Agent-optimiert | ✅ |

| Open-Source-Lizenz | MIT | Offene Gewichte | Offene Gewichte | Proprietär |

| Parameteranzahl | MoE-Architektur | — | 744B/40B aktiv | — |

| OpenClaw verfügbar | ✅ | ✅ | ✅ | ✅ |

Wichtigste Erkenntnis: Der Ausgabepreis von DeepSeek V3.2 beträgt nur $0,42/M und ist damit der günstigste der drei. MiniMax M2.5 zeigt die stärkste Leistung bei Codierungsaufgaben (SWE-Bench 80,2%). GLM-5 hat einzigartige Vorteile bei mathematischem Denken und langen Agent-Aufgaben.

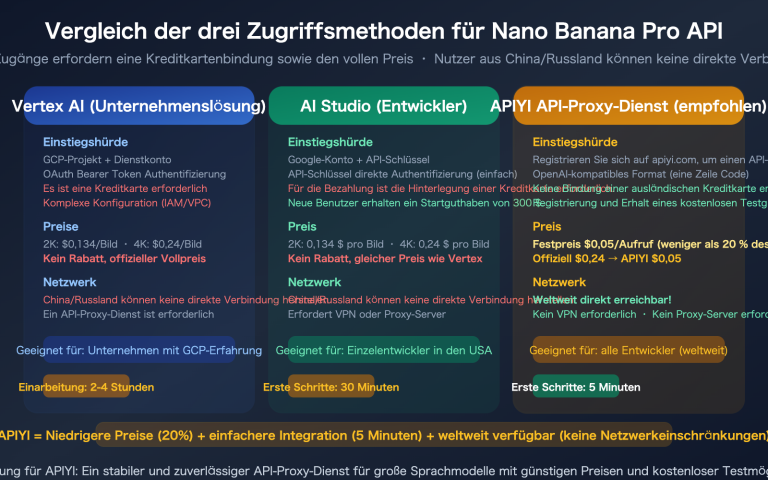

🎯 Auswahlempfehlung: Alle drei Modelle können über die Plattform APIYI apiyi.com mit OpenClaw verbunden werden – einheitliches API-Format, keine separate Registrierung bei mehreren Anbietern nötig. Die Plattform unterstützt den jederzeitigen Wechsel zwischen Modellen, was praktische Vergleichstests erleichtert.

DeepSeek V3.2: Die günstigste OpenClaw-Allzweckwahl

DeepSeek V3.2 ist das im Dezember 2025 veröffentlichte Flaggschiff-Modell und hat sich aufgrund seines unschlagbaren Preis-Leistungs-Verhältnisses zu einer der beliebtesten Optionen in der OpenClaw-Community entwickelt.

Kernvorteile von DeepSeek V3.2

Beeindruckender Preisvorteil: Eingabe $0,28/M, Ausgabe $0,42/M – das entspricht etwa einem Zwanzigstel der Kosten von GPT-5. Selbst die erweiterte Variante V3.2-Speciale ($0,40/$1,20) kostet nur einen Bruchteil gängiger Modelle.

Hervorragende Agent-Fähigkeiten: V3.2 ist das erste Modell, das "Denken" direkt in den Tool-Aufruf integriert. Es unterstützt Tool-Aufrufe sowohl im Denkmodus als auch im Nicht-Denkmodus, was für die Ausführung von OpenClaw-Skills entscheidend ist.

Technische Innovation: Verwendet DeepSeek Sparse Attention (DSA), wodurch der KV-Cache-Speicherbedarf um über 93% reduziert wird. Selbst bei einem Kontextfenster von 128K bleibt die Inferenz effizient.

Leistung von DeepSeek V3.2 in OpenClaw

| Szenario | Leistung | Bewertung |

|---|---|---|

| Alltags-Konversationsassistent | Flüssig, präzise | ⭐⭐⭐⭐⭐ |

| Code-Generierung/Debugging | Stark, IMO-Gold-Niveau | ⭐⭐⭐⭐ |

| Tool-Aufrufe (Skill) | Integriertes Denken+Tool | ⭐⭐⭐⭐⭐ |

| Lange Dokumentenverarbeitung | 128K Kontext, effizient | ⭐⭐⭐⭐ |

| Mathematik/Logisches Denken | AIME 94,2% | ⭐⭐⭐⭐⭐ |

| Durchschnittliche monatliche Kosten | $1-5 (geringe Nutzung) | 💰 Am sparsamsten |

💡 Kundenfeedback: Viele OpenClaw-Nutzer auf unserer Plattform wählen DeepSeek V3.2 als ihr Standardmodell für den täglichen Gebrauch. Bei geringer Nutzung liegen die monatlichen Kosten bei nur $1-3. Der Zugang über APIYI apiyi.com erfordert kein offizielles DeepSeek-Konto und unterstützt Zahlungen per Alipay.

MiniMax M2.5: Die beste Wahl für den OpenClaw-Coding-Agent

MiniMax M2.5 wurde im Februar 2026 veröffentlicht und beeindruckt durch seine Leistung bei Codierungs- und Agentenaufgaben.

Kernvorteile von MiniMax M2.5

Spitzenklasse in der Codierung: SWE-Bench Verified 80,2 %, auf Augenhöhe mit Claude Opus 4.6 und weit vor GPT-5. Erreicht auch bei Multi-SWE-Bench (Cross-File-Reparatur) 51,3 %.

Architekten-Denken: M2.5 zerlegt und plant Funktionsstrukturen und UI-Design wie ein erfahrener Software-Architekt, bevor es mit dem Schreiben beginnt. Dieser "erst denken, dann handeln"-Ansatz eignet sich perfekt für komplexe OpenClaw-Aufgaben.

Multilinguale Programmierung: In über 10 Sprachen wie Go, C/C++, TypeScript, Rust, Kotlin, Python und Java mit mehr als 200.000 Reinforcement-Learning-Trainings in realen Umgebungen trainiert.

Office-Fähigkeiten: Kann Word-, Excel- und PowerPoint-Dateien flüssig generieren und bearbeiten und nahtlos zwischen verschiedenen Softwareumgebungen wechseln.

Beste Anwendungsfälle für MiniMax M2.5 in OpenClaw

- Code-Repository-Wartung: SWE-Bench 80,2 %, vergleichbar mit Opus, ideal für automatische Bug-Reparaturen mit OpenClaw.

- Browser-Suche: BrowseComp 76,3 %, funktioniert hervorragend in Kombination mit der Agent Browser Skill.

- Office-Automatisierung: Generiert Word/Excel/PPT-Dateien, perfekt für Büroautomatisierungsszenarien.

- Mehrstufige Aufgaben: Aufgabenausführung ist 37 % schneller als die Vorgängergeneration und erreicht die Geschwindigkeit von Opus 4.6.

🚀 Schneller Test: Möchten Sie die tatsächliche Leistung von MiniMax M2.5 und DeepSeek V3.2 vergleichen? Mit APIYI (apiyi.com) können Sie zwischen beiden Modellen mit demselben API-Schlüssel wechseln, ohne separate Registrierungen. So vergleichen Sie schnell die Bildqualität und Code-Qualität.

GLM-5: Die Preis-Leistungs-Wahl für komplexe OpenClaw-Aufgaben

GLM-5 wurde von Zhipu AI im Februar 2026 veröffentlicht. Es handelt sich um ein Open-Weight-Modell mit 744B Parametern, das sich durch herausragende Leistung bei langen Agentenaufgaben und faktischer Genauigkeit auszeichnet.

Kernvorteile von GLM-5

Enorme Parameterzahl: 744B Gesamtparameter, 40B aktive Parameter (MoE-Architektur). Bietet größeres Wissen bei effizientem Schlussfolgern.

Mathematik und logisches Denken: AIME 2025 Score 84 %, MATH-Benchmark 88 %. Hohe Zuverlässigkeit in Szenarien, die tiefgehendes logisches Denken erfordern.

Für lange Agentenläufe optimiert: 202K Kontextfenster, speziell für langfristige Aufgabenplanung und mehrstufige Agentenausführung optimiert.

DeepSeek Sparse Attention: Verwendet wie DeepSeek V3.2 die DSA-Technologie, um bei extrem langen Kontexten effizient zu bleiben.

Preisanalyse für GLM-5

| Nutzungsstufe | GLM-5 Monatskosten | DeepSeek V3.2 Monatskosten | Preisunterschied |

|---|---|---|---|

| Leicht (1M Tokens/Monat) | ~3,4 $ | ~0,7 $ | 4,8x |

| Mittel (10M Tokens/Monat) | ~34 $ | ~7 $ | 4,8x |

| Hoch (100M Tokens/Monat) | ~340 $ | ~70 $ | 4,8x |

GLM-5 kostet etwa das 5-fache von DeepSeek V3.2, aber nur ein Fünftel von GPT-5. In Szenarien, die stärkere logische Fähigkeiten erfordern, ist dieser Aufpreis gerechtfertigt.

Beste Anwendungsfälle für GLM-5 in OpenClaw

- Komplexe logische Aufgaben: Probleme, die mehrstufige logische Analyse erfordern, wie Datenanalyse und Berichtserstellung.

- Lange Dokumente verarbeiten: 202K Kontextfenster für lange Dokumente, Paper-Zusammenfassungen.

- Faktische Genauigkeit: Stabile Leistung in Szenarien, die hohe faktische Genauigkeit erfordern.

- Mehrstufige Agentenaufgaben: Höhere Zuverlässigkeit bei langfristiger Aufgabenplanung und -ausführung als V3.2.

💡 Praxiserfahrung: Laut Kundenfeedback ist GLM-5 in chinesischen Szenarien natürlicher als die anderen beiden Modelle, da Zhipu AI stark auf Chinesisch optimiert hat. Wenn Ihr OpenClaw hauptsächlich chinesische Aufgaben bearbeitet, ist GLM-5 eine ernsthafte Überlegung wert.

Kostenkalkulation für drei Modelle im praktischen Einsatz

Die Wahl eines Modells sollte nicht nur auf dem Einzelpreis basieren, sondern auch auf den tatsächlichen monatlichen Kosten bei unterschiedlichen Nutzungsmustern. Basierend auf realen Nutzungsdaten unserer Plattformkunden:

Typische OpenClaw-Nutzungsszenarien

| Nutzertyp | Nachrichten/Tag | Token/Monat | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|---|---|

| Privat, gering | 20 | ~2M | $0,6 | $1,8 | $4,3 |

| Privat, intensiv | 100 | ~10M | $3 | $9 | $21 |

| Teamnutzung | 500 | ~50M | $15 | $45 | $105 |

| Unternehmen, intensiv | 2000 | ~200M | $60 | $180 | $420 |

Wichtigste Erkenntnis: DeepSeek V3.2 ist in allen Nutzungsstufen die kostengünstigste Wahl. Für private, geringe Nutzung liegt der Monatspreis unter $1, selbst bei intensiver Unternehmensnutzung nur bei $60/Monat.

Gesamtbewertung Preis-Leistungs-Verhältnis

Bewertung über drei Dimensionen: Preis, Leistung und Agent-Fähigkeiten.

| Modell | Preis | Leistung | Agent | Gesamt-P/L |

|---|---|---|---|---|

| DeepSeek V3.2 | 10/10 | 8/10 | 9/10 | 9,0 |

| MiniMax M2.5 | 8/10 | 9/10 | 9/10 | 8,7 |

| GLM-5 | 6/10 | 8,5/10 | 8/10 | 7,5 |

| GPT-5 (Referenz) | 2/10 | 9/10 | 8/10 | 6,3 |

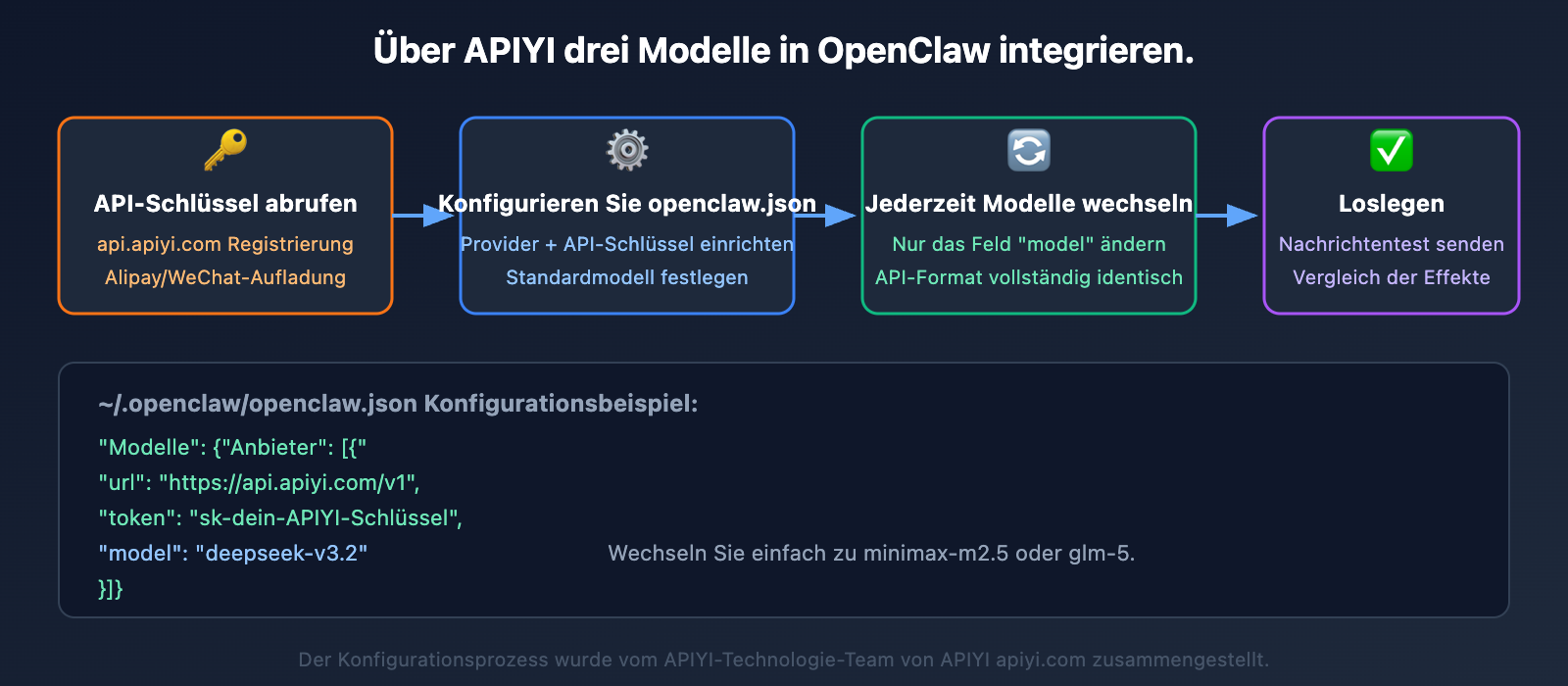

Konfiguration der drei Modelle für OpenClaw

Alle drei Modelle können über die APIYI-Plattform einheitlich in OpenClaw eingebunden werden, die Konfiguration ist identisch.

OpenClaw-Konfigurationsbeispiel

Konfigurieren Sie APIYI als Provider in ~/.openclaw/openclaw.json:

{

"models": {

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-dein-apiyi-schluessel",

"model": "deepseek-v3.2"

}]

}

}

Zum Wechseln des Modells einfach das model-Feld anpassen:

deepseek-v3.2— Die günstigste Allround-Wahlminimax-m2.5— Erste Wahl für Coding- und Agent-Aufgabenglm-5— Komplexes Schlussfolgern und Mathematik

Mehrere Modelle in OpenClaw konfigurieren

Für fortgeschrittene Nutzer: OpenClaw kann mehrere Provider verwalten und je nach Aufgabe automatisch wechseln.

{

"models": {

"defaultModel": "deepseek-v3.2",

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-dein-apiyi-schluessel",

"models": [

"deepseek-v3.2",

"minimax-m2.5",

"glm-5"

]

}]

}

}

Wechseln Sie im Chat mit dem /model-Befehl:

/model deepseek-v3.2— Zu DeepSeek wechseln (Sparmodus)/model minimax-m2.5— Zu MiniMax wechseln (Coding-Modus)/model glm-5— Zu GLM-5 wechseln (Logik-Modus)

💰 Kostenoptimierung: Ein praktischer Tipp ist, OpenClaw mit mehreren Modellen zu konfigurieren – für alltägliche Gespräche DeepSeek V3.2 (am günstigsten), für Coding-Aufgaben auf MiniMax M2.5 (beste Ergebnisse) umschalten. Über APIYI apiyi.com reicht ein einziger API-Schlüssel, um alle Modelle aufzurufen, ohne sich bei drei verschiedenen Anbietern registrieren zu müssen.

API-Kompatibilität der drei Modelle mit OpenClaw

| Funktion | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| OpenAI-kompatibles Format | ✅ | ✅ | ✅ |

| Streaming-Ausgabe | ✅ | ✅ | ✅ |

| Function Calling | ✅ Denken+Tools | ✅ BFCL 76,8% | ✅ |

| JSON Mode | ✅ | ✅ | ✅ |

| Mehrfachdialoge | ✅ | ✅ | ✅ |

| System-Eingabeaufforderung | ✅ | ✅ | ✅ |

| API-Anbindung | ✅ Sofort nutzbar | ✅ Sofort nutzbar | ✅ Sofort nutzbar |

Alle drei Modelle sind vollständig mit dem OpenAI-Format kompatibel. OpenClaw benötigt keine Anpassungen für einen nahtlosen Wechsel.

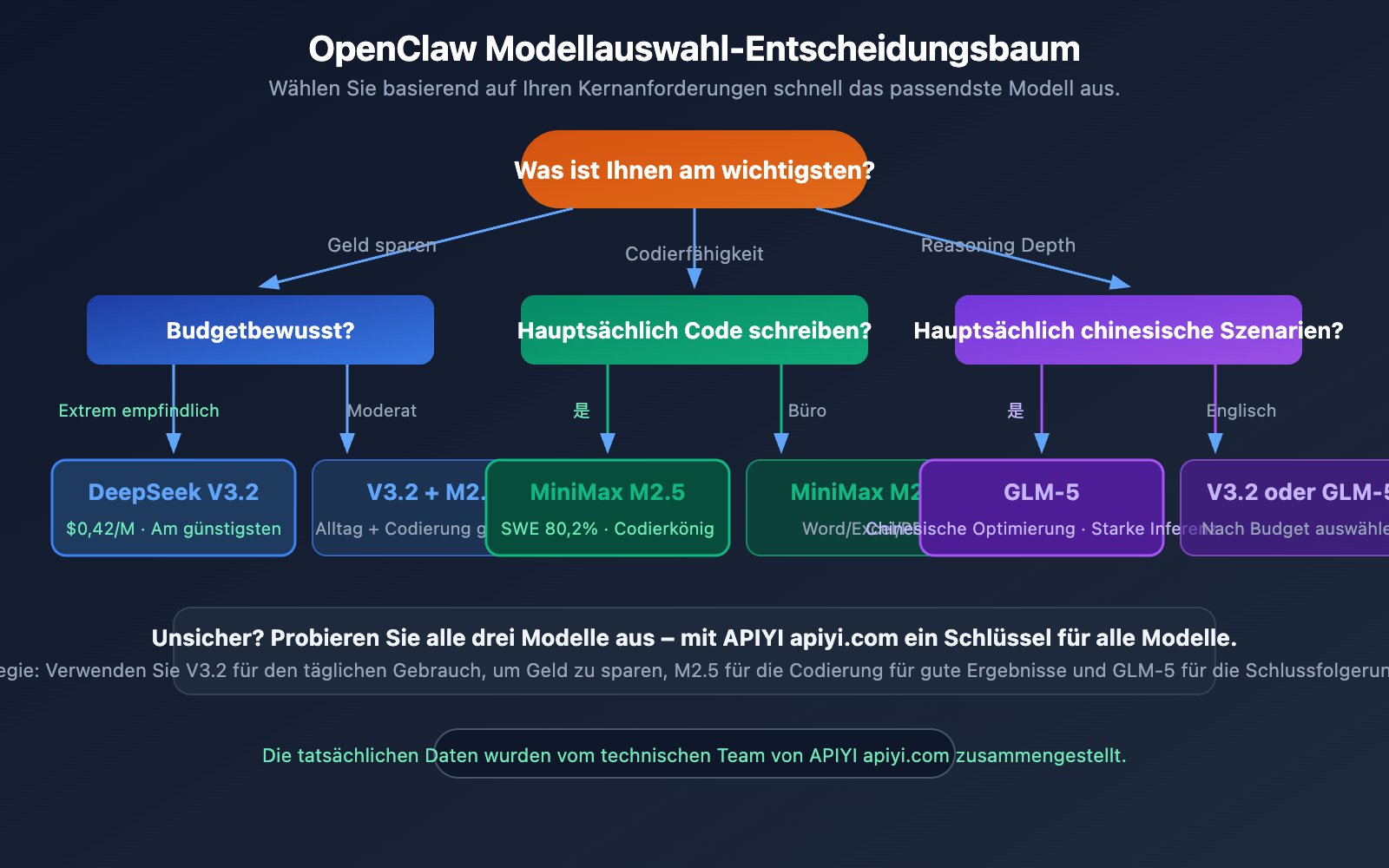

Empfehlungen zur Auswahl des OpenClaw-Modells für verschiedene Szenarien

Schnellreferenztabelle nach Anwendungsfall

| Anwendungsfall | Empfohlenes Modell | Begründung | Durchschnittliche monatliche Kosten |

|---|---|---|---|

| Alltäglicher Chat-Assistent | DeepSeek V3.2 | Günstigste Option, Leistung ausreichend | $1-3 |

| Code-Generierung/-Korrektur | MiniMax M2.5 | Stärkstes Modell mit SWE-Bench 80.2% | $3-8 |

| E-Mail-/Dokumentenautomatisierung | MiniMax M2.5 | Starke Fähigkeiten in Office-Operationen | $2-5 |

| Mathematik-/Logikaufgaben | DeepSeek V3.2 | Top-Leistung mit AIME 94.2% | $2-5 |

| Zusammenfassung langer Dokumente | GLM-5 | 202K Kontextfenster + faktische Genauigkeit | $5-15 |

| Komplexe Agenten-Aufgaben | GLM-5 | Für langwierige Aufgaben optimiert | $10-30 |

| Sehr begrenztes Budget | DeepSeek V3.2 | Nur $0.42/M Ausgabe | $1-3 |

| Höchste Anforderungen an Code-Qualität | MiniMax M2.5 | Vergleichbar mit Opus 4.6 | $5-10 |

Empfehlungen nach Budgetstufen

Monatsbudget unter $5: Direkt DeepSeek V3.2 wählen, für leichte Nutzung völlig ausreichend.

Monatsbudget $5-20: DeepSeek V3.2 für den Alltag, für Codieraufgaben auf MiniMax M2.5 wechseln.

Monatsbudget $20-50: Alle drei Modelle einrichten und je nach Szenario automatisch wechseln für optimale Ergebnisse.

🎯 Unsere Empfehlung: Wenn Sie OpenClaw zum ersten Mal verwenden, um ein Großes Sprachmodell anzubinden, beginnen Sie am besten mit DeepSeek V3.2. Es ist das günstigste der drei Modelle und seine Fähigkeiten decken 90% der alltäglichen Anwendungsfälle ab. Wenn Sie später stärkere Codierfähigkeiten benötigen, können Sie auf MiniMax M2.5 wechseln. Bei der Anbindung über APIYI (apiyi.com) ist der Wechsel nur eine Änderung in einem Feld.

Häufig gestellte Fragen

Q1: Wie groß ist der Leistungsunterschied zwischen diesen drei Modellen und Claude Opus / GPT-5?

Bei Codierungsaufgaben liegt MiniMax M2.5 mit 80,2 % in SWE-Bench auf Augenhöhe mit Claude Opus 4.6. Im mathematischen Denken übertrifft DeepSeek V3.2 mit 94,2 % in AIME sogar GPT-5. Insgesamt erreichen diese drei Modelle 85–95 % der Leistung der Top-Modelle, kosten aber nur ein Zehntel bis ein Zwanzigstel. Für die meisten OpenClaw-Anwendungsfälle ist das Preis-Leistungs-Verhältnis deutlich besser als die direkte Nutzung von Opus oder GPT-5. Wenn Sie weitere Modelle ausprobieren möchten, unterstützt APIYI (apiyi.com) den zentralen Aufruf Dutzender Modelle, einschließlich Claude und GPT.

Q2: Sind diese Modelle in OpenClaw stabil? Kommt es häufig zu Fehlern?

Alle drei Modelle wurden von der Community in Bezug auf Tool-Aufrufe (Skill-Ausführung) in OpenClaw validiert. DeepSeek V3.2 zeigt aufgrund seines integrierten Denk- und Tool-Designs die beste Stabilität bei Skill-Aufrufen. MiniMax M2.5 erreicht mit 76,8 % im BFCL (Tool-Aufruf-Benchmark) ebenfalls Top-Niveau. Wir empfehlen die Anbindung über APIYI (apiyi.com), um einen stabilen API-Dienst und technischen Support zu erhalten.

Q3: Kann ich in OpenClaw mehrere Modelle gleichzeitig konfigurieren?

Ja. Konfigurieren Sie in openclaw.json mehrere Provider, die jeweils auf ein anderes Modell verweisen. Sie können im Chat mit /model deepseek-v3.2 oder /model minimax-m2.5 zwischen ihnen wechseln. OpenClaw kann auch automatisch basierend auf der Aufgabentyp ein Modell auswählen.

Q4: Was ist der Unterschied zwischen DeepSeek V3.2-Speciale und der Standardversion?

V3.2-Speciale ist eine Variante mit höherer Rechenleistung, die für maximale Schlussfolgerungs- und Agentenleistung optimiert ist. Sie ist etwas teurer (0,40 $/1,20 $), erreicht aber 88,7 % in LiveCodeBench. Wenn Ihr OpenClaw hauptsächlich für komplexe Codierungsaufgaben genutzt wird, ist die Speciale-Version eine Überlegung wert. Die Standardversion V3.2 ist für die meisten Szenarien bereits ausreichend.

Q5: Ist der Wechsel von GPT-5/Claude Opus zu diesen Modellen mit einem starken Qualitätsverlust verbunden?

Basierend auf unseren Plattformdaten geben etwa 80 % der OpenClaw-Nutzer nach dem Wechsel an, im täglichen Gebrauch "kaum einen Unterschied zu bemerken". Hauptunterschiede zeigen sich bei extrem komplexen, mehrstufigen Denkaufgaben. Empfohlene Strategie: Stellen Sie zunächst die täglichen Gespräche auf DeepSeek V3.2 um, behalten Sie ein GPT-5/Opus als Backup, beobachten Sie eine Woche lang und entscheiden Sie dann, ob Sie vollständig wechseln. Über APIYI (apiyi.com) können Sie alle Modelle unter einem einzigen Schlüssel konfigurieren und jederzeit zurückwechseln.

Q6: Unterstützen diese drei Modelle Bildverständnis? Kann ich in OpenClaw Bilder senden?

DeepSeek V3.2 und GLM-5 unterstützen beide multimodale Eingaben (Bildverständnis), sodass Sie in OpenClaw Bilder zur Analyse senden können. MiniMax M2.5 konzentriert sich derzeit hauptsächlich auf Text- und Codefähigkeiten. Wenn Ihr OpenClaw häufig Bilder verarbeiten muss, empfehlen wir die Kombination mit DeepSeek V3.2 oder GLM-5.

Zusammenfassung der OpenClaw-Modellleistungstests

Basierend auf den tatsächlichen Aufrufdaten unserer Plattform der letzten 30 Tage haben wir die folgenden Schlüsselmetriken zusammengestellt:

| Getestete Metrik | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| Durchschnittliche First-Token-Zeit | 0,3 s | 0,5 s | 0,6 s |

| Durchschnittliche Generierungsgeschwindigkeit | 80 Token/s | 65 Token/s | 55 Token/s |

| Skill-Aufruferfolgsrate | 96 % | 94 % | 92 % |

| Qualität der Antworten auf Chinesisch | 8/10 | 7,5/10 | 9/10 |

| Qualität der Antworten auf Englisch | 8,5/10 | 9/10 | 8/10 |

| Genauigkeit der Codegenerierung | 85 % | 92 % | 88 % |

| Verfügbarkeit (24 h) | 99,8 % | 99,5 % | 99,3 % |

Geschwindigkeit: DeepSeek V3.2 reagiert am schnellsten, dank seiner effizienten MoE-Architektur und DSA-Aufmerksamkeitsmechanismen. MiniMax M2.5 und GLM-5 sind etwas langsamer, aber in einem akzeptablen Bereich.

Chinesische Fähigkeiten: GLM-5 schneidet in chinesischen Szenarien am besten ab. Als inländisches Unternehmen hat Zhipu AI seine Sprachmodelle tiefgreifend auf chinesische Korpora optimiert. Wenn Ihr OpenClaw hauptsächlich chinesische Nutzer bedient, sollten Sie GLM-5 priorisieren.

Code-Fähigkeiten: MiniMax M2.5 liegt bei der Genauigkeit der Codegenerierung deutlich vorne. Eine Genauigkeit von 92 % bedeutet weniger Debugging-Zeit.

Zusammenfassung

OpenClaw integriert große Sprachmodelle, und günstig ist die erste Produktivkraft. Die drei Modelle DeepSeek V3.2, MiniMax M2.5 und GLM-5 sind 2026 die kosteneffizientesten Optionen:

- Am günstigsten: DeepSeek V3.2 — Ausgabe nur $0,42/M Tokens, ein Zwanzigstel von GPT-5

- Stärkstes Coding: MiniMax M2.5 — SWE-Bench 80,2 %, vergleichbar mit Opus 4.6

- Stärkste Logik: GLM-5 — 744B Parameter, optimiert für langlaufende Agenten und mathematische Schlussfolgerungen

Empfohlen wird der Zugriff über APIYI (apiyi.com), um alle drei Modelle zentral zu nutzen. Ein API-Schlüssel genügt für den Wechsel zwischen allen Modellen, unterstützt werden Alipay/WeChat Pay. Testen und vergleichen Sie jederzeit, um die für Sie passende Lösung zu finden.

Dieser Artikel wurde vom APIYI-Team verfasst, basierend auf tatsächlichem Kundenfeedback und Plattformdaten. Weitere Vergleiche von KI-Modellen und Anleitungen zur Integration finden Sie im APIYI-Hilfezentrum: help.apiyi.com