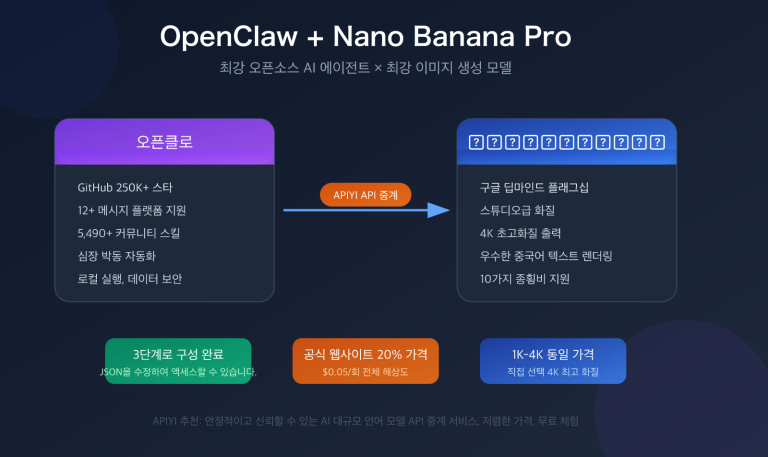

OpenClaw에 어떤 대규모 언어 모델을 연결하는 것이 가장 비용 효율적일까요? 이는 고객님들께서 가장 자주 묻는 질문 중 하나입니다. 이 글에서는 가격, 성능, 에이전트 도구 호출 능력 세 가지 차원에서 DeepSeek V3.2, MiniMax M2.5, GLM-5 세 가지 고성능 대비 가격 모델을 비교하여 OpenClaw의 최적의 파트너를 찾는 데 도움을 드리겠습니다.

핵심 가치: 이 세 모델의 공통점은 저렴하면서도 뛰어난 성능입니다. 가격은 GPT-5 / Claude Opus의 1/10에서 1/20 수준이지만, 코딩, 도구 호출 등 에이전트 시나리오에서 탁월한 성과를 보여줍니다. 이 글을 읽고 나면, 어떤 상황에서 어떤 모델을 선택해야 할지 명확히 이해하게 될 거예요.

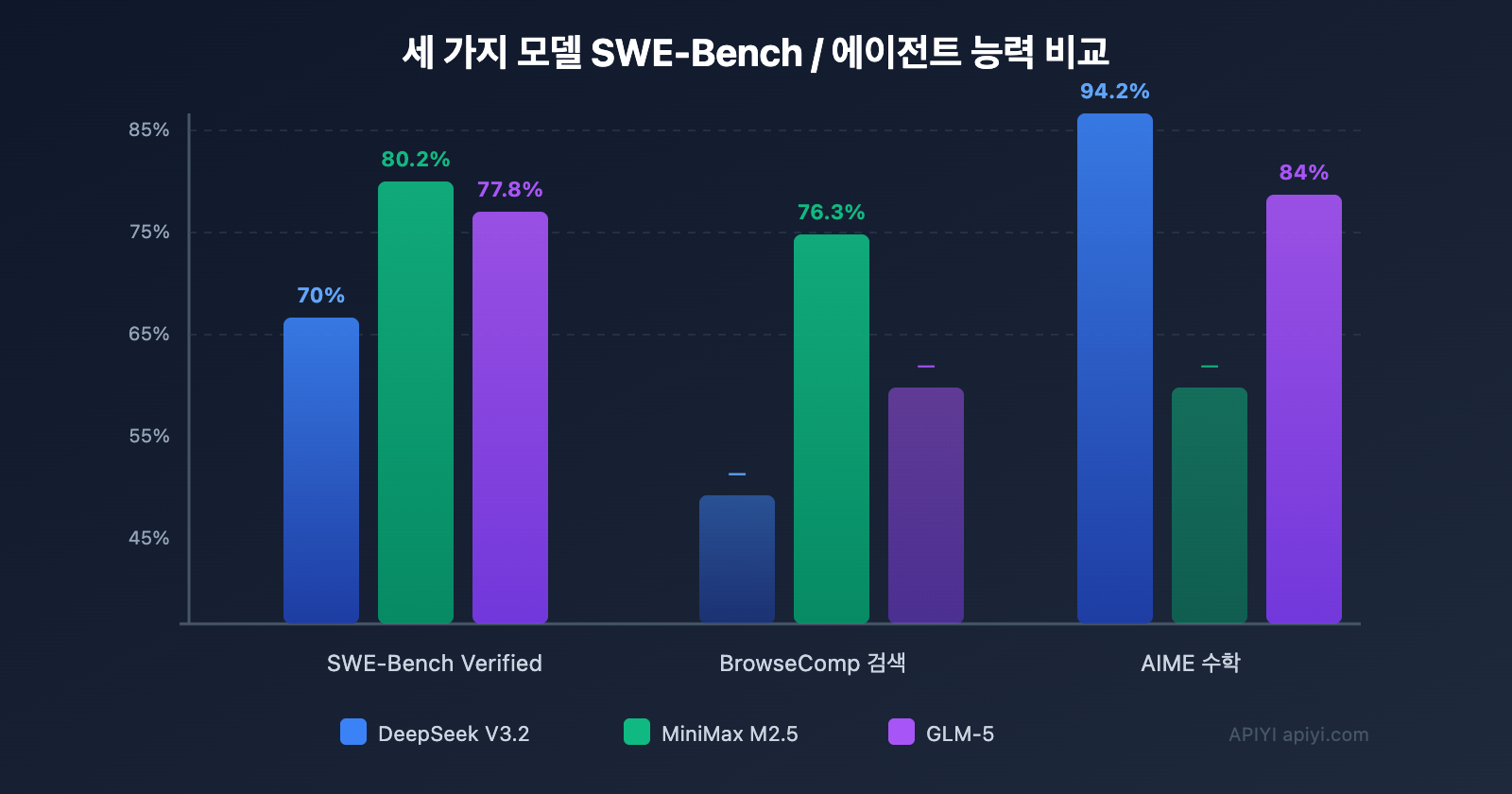

세 가지 고성능 대비 가격 모델 핵심 파라미터 비교

먼저 가장 중요한 데이터인 가격과 성능의 종합 비교를 살펴볼게요.

| 비교 차원 | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 | GPT-5 (참고) |

|---|---|---|---|---|

| 입력 가격 | $0.28/M | $0.29/M | $0.80/M | $5.00/M |

| 출력 가격 | $0.42/M | $1.20/M | $2.56/M | $15.00/M |

| 컨텍스트 윈도우 | 128K | 205K | 202K | 128K |

| SWE-Bench | 70% | 80.2% | 77.8% | 72% |

| AIME 수학 | 94.2% | — | 84% | 86% |

| 도구 호출 | ✅ 사고+도구 통합 | ✅ BFCL 76.8% | ✅ 에이전트 최적화 | ✅ |

| 오픈소스 라이선스 | MIT | 오픈 웨이트 | 오픈 웨이트 | 클로즈드 소스 |

| 파라미터 수 | MoE 아키텍처 | — | 744B/40B 활성 | — |

| OpenClaw 사용 가능 | ✅ | ✅ | ✅ | ✅ |

주요 발견: DeepSeek V3.2의 출력 가격은 $0.42/M로 세 모델 중 가장 저렴합니다. MiniMax M2.5는 코딩 작업에서 가장 강력한 성능(SWE-Bench 80.2%)을 보여주고, GLM-5는 수학 추론 및 장거리 에이전트 작업에서 독특한 장점을 가지고 있어요.

🎯 선택 제안: 세 모델 모두 APIYI apiyi.com 플랫폼을 통해 OpenClaw에 일괄 연결할 수 있으며, 통일된 API 형식을 제공해 여러 서비스 제공업체에 따로 등록할 필요가 없습니다. 플랫폼은 모델을 언제든지 전환할 수 있도록 지원하여 실제 비교 테스트를 용이하게 해줍니다.

DeepSeek V3.2: 가장 저렴한 OpenClaw 범용 선택지

DeepSeek V3.2는 2025년 12월에 출시된 플래그십 모델로, 극한의 가성비로 OpenClaw 커뮤니티에서 가장 인기 있는 선택지 중 하나입니다.

DeepSeek V3.2 핵심 장점

놀라운 가격 경쟁력: 입력 $0.28/M, 출력 $0.42/M으로, GPT-5의 20분의 1 수준입니다. 고급 변형인 V3.2-Speciale($0.40/$1.20)조차도 주류 모델들의 가격에 비하면 터무니없이 저렴합니다.

탁월한 에이전트 능력: V3.2는 '사고'를 도구 호출에 직접 통합한 최초의 모델입니다. 사고 모드와 비사고 모드 모두에서 도구 호출을 지원하는데, 이는 OpenClaw의 Skill 실행에 매우 중요합니다.

기술적 혁신: DeepSeek Sparse Attention (DSA)을 채택하여 KV 캐시 메모리 오버헤드를 93% 이상 줄였으며, 128K 컨텍스트 윈도우에서도 효율적인 추론을 유지합니다.

OpenClaw에서의 DeepSeek V3.2 성능

| 시나리오 | 성능 | 평가 |

|---|---|---|

| 일상 대화 어시스턴트 | 유창하고 정확함 | ⭐⭐⭐⭐⭐ |

| 코드 생성/디버깅 | 강력함, IMO 금메달 수준 | ⭐⭐⭐⭐ |

| 도구 호출 (Skill) | 사고+도구 통합 | ⭐⭐⭐⭐⭐ |

| 장문 문서 처리 | 128K 컨텍스트, 효율적 | ⭐⭐⭐⭐ |

| 수학/추론 | AIME 94.2% | ⭐⭐⭐⭐⭐ |

| 월 평균 비용 | $1-5 (경량 사용) | 💰 가장 절약됨 |

💡 고객 피드백: 저희 플랫폼의 많은 OpenClaw 사용자들이 DeepSeek V3.2를 일상 모델로 선택하고 있으며, 경량 사용 시 월 평균 비용은 $1-3에 불과합니다. APIYI(apiyi.com)를 통해 접속하면 DeepSeek 공식 계정 등록 없이도 사용할 수 있으며, 알리페이로 충전이 가능합니다.

MiniMax M2.5: OpenClaw 코딩 에이전트를 위한 최고의 선택

MiniMax M2.5는 2026년 2월에 출시되어 코딩과 에이전트 작업에서 인상적인 성능을 보여주고 있습니다.

MiniMax M2.5 핵심 장점

업계 최고 수준의 코딩 능력: SWE-Bench Verified 80.2%로 Claude Opus 4.6과 동등하며 GPT-5를 크게 앞섭니다. Multi-SWE-Bench(크로스 파일 수정)에서도 51.3%를 달성했습니다.

아키텍트급 사고 방식: M2.5는 코드를 작성하기 전에 경험 많은 소프트웨어 아키텍트처럼 기능 구조와 UI 설계를 능동적으로 분해하고 계획합니다. 코드를 바로 작성하기보다 '먼저 생각하고 행동하는' 이 패턴은 OpenClaw의 복잡한 작업에 매우 적합합니다.

다국어 프로그래밍: Go, C/C++, TypeScript, Rust, Kotlin, Python, Java 등 10개 이상의 언어에 대해 20만 건 이상의 실제 환경 강화 학습을 거쳤습니다.

Office 문서 처리 능력: Word, Excel, PowerPoint 파일을 유창하게 생성하고 조작할 수 있으며, 다양한 소프트웨어 환경 간에 원활하게 전환할 수 있습니다.

OpenClaw에서 MiniMax M2.5의 최적 활용처

- 코드 저장소 유지 관리: SWE-Bench 80.2%로 Opus에 필적하며, OpenClaw가 버그를 자동으로 수정하도록 하는 데 적합합니다.

- 브라우저 검색: BrowseComp 76.3%로, Agent Browser Skill과 결합했을 때 뛰어난 효과를 발휘합니다.

- Office 자동화: Word/Excel/PPT 생성이 가능하여, 업무 자동화 시나리오에 적합합니다.

- 다단계 작업: 작업 실행 속도가 이전 세대보다 37% 빨라 Opus 4.6의 속도와 맞먹습니다.

🚀 빠른 체험: MiniMax M2.5와 DeepSeek V3.2의 실제 성능을 비교해 보고 싶으신가요? APIYI(apiyi.com)를 통해 하나의 API 키로 두 모델을 전환할 수 있어, 각각 별도로 등록할 필요 없이 빠르게 이미지 생성 효과와 코드 품질을 비교할 수 있습니다.

GLM-5: OpenClaw 복잡 추론 작업의 가성비 선택

GLM-5는 2026년 2월 지푸 AI(Zhipu AI)에서 공개한 744B 파라미터의 오픈 웨이트 모델로, 장기 에이전트 작업과 사실 정확성 측면에서 두각을 나타냅니다.

GLM-5 핵심 장점

초대규모 파라미터: 총 744B 파라미터, 활성 파라미터 40B(MoE 아키텍처)로 효율적인 추론을 유지하면서 더 큰 지식 저장소를 보유합니다.

수학 및 추론: AIME 2025 점수 84%, MATH 벤치마크 88%로 깊은 추론이 필요한 시나리오에서 높은 신뢰성을 보입니다.

장기 에이전트 최적화: 202K 컨텍스트 윈도우로 장기 작업 계획 및 다단계 에이전트 실행에 최적화되었습니다.

DeepSeek Sparse Attention: DeepSeek V3.2와 동일한 DSA 기술을 채택하여 초장기 컨텍스트에서도 효율성을 유지합니다.

GLM-5 가격 분석

| 사용량 수준 | GLM-5 월 비용 | DeepSeek V3.2 월 비용 | 가격 차이 |

|---|---|---|---|

| 경량 (1M tokens/월) | ~$3.4 | ~$0.7 | 4.8배 |

| 중간 (10M tokens/월) | ~$34 | ~$7 | 4.8배 |

| 고강도 (100M tokens/월) | ~$340 | ~$70 | 4.8배 |

GLM-5의 가격은 DeepSeek V3.2의 약 5배이지만, 여전히 GPT-5의 5분의 1 수준입니다. 더 강력한 추론 능력이 필요한 시나리오에서는 이 프리미엄이 가치가 있습니다.

GLM-5가 OpenClaw에서 최적의 용도

- 복잡한 추론: 데이터 분석 및 보고서 생성과 같은 다단계 논리 분석이 필요한 문제

- 장문서 처리: 202K 컨텍스트 윈도우로 긴 문서, 논문 요약 처리

- 사실 정확성: 높은 사실 정확성이 필요한 시나리오에서 안정적인 성능

- 다단계 에이전트 작업: 장기 작업 계획 및 실행에서 V3.2보다 높은 신뢰성

💡 실제 경험: 고객 피드백에 따르면, GLM-5는 중국어 시나리오에서 다른 두 모델보다 더 자연스러운 성능을 보입니다. 결국 지푸 AI는 중국어에 대해 많은 최적화를 진행했습니다. 여러분의 OpenClaw가 주로 중국어 작업을 처리한다면, GLM-5를 중점적으로 고려할 가치가 있습니다.

세 모델 실제 사용 비용 측정

모델 선택은 단가만 보는 것이 아니라, 다양한 사용 패턴에 따른 실제 월간 지출도 고려해야 합니다. 다음은 우리 플랫폼 고객의 실제 사용량 데이터를 기반으로 한 것입니다.

일반적인 OpenClaw 사용량 시나리오

| 사용자 유형 | 일일 평균 메시지 | 월평균 Token | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|---|---|

| 개인 경량 | 20개 | ~2M | $0.6 | $1.8 | $4.3 |

| 개인 고강도 | 100개 | ~10M | $3 | $9 | $21 |

| 팀 사용 | 500개 | ~50M | $15 | $45 | $105 |

| 기업 고강도 | 2000개 | ~200M | $60 | $180 | $420 |

핵심 결론: DeepSeek V3.2는 모든 사용량 수준에서 가장 비용 효율적인 선택입니다. 개인 경량 사용자는 월 $1 미만, 기업 고강도 사용자도 월 $60에 불과합니다.

가성비 종합 점수

가격, 성능, 에이전트 능력 세 가지 차원을 종합하여 평가했습니다.

| 모델 | 가격 점수 | 성능 점수 | 에이전트 점수 | 종합 가성비 |

|---|---|---|---|---|

| DeepSeek V3.2 | 10/10 | 8/10 | 9/10 | 9.0 |

| MiniMax M2.5 | 8/10 | 9/10 | 9/10 | 8.7 |

| GLM-5 | 6/10 | 8.5/10 | 8/10 | 7.5 |

| GPT-5 (참고) | 2/10 | 9/10 | 8/10 | 6.3 |

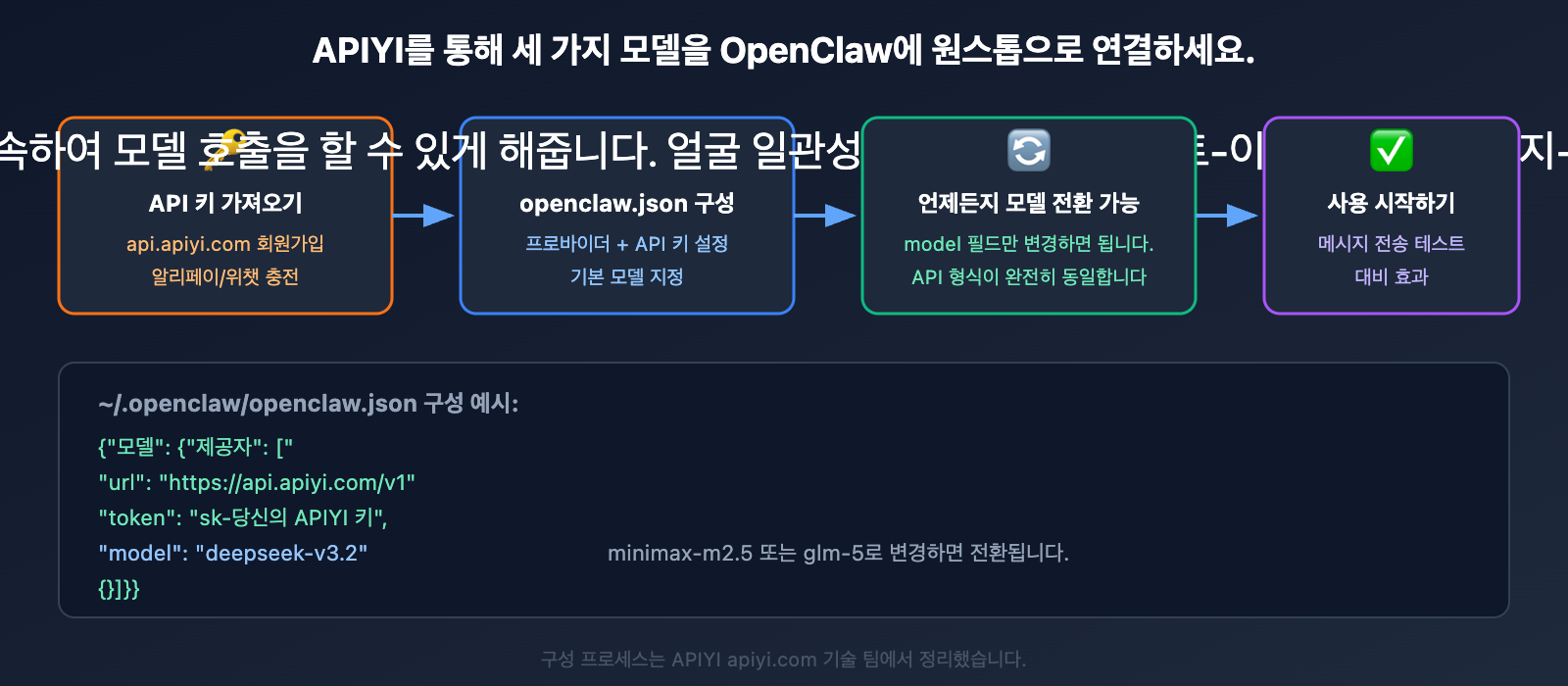

OpenClaw에 세 가지 모델을 연결하는 설정 방법

세 모델 모두 APIYI 플랫폼을 통해 OpenClaw에 통합 연결할 수 있으며, 설정 방식은 완전히 동일합니다.

OpenClaw 설정 예시

~/.openclaw/openclaw.json에서 APIYI를 Provider로 설정합니다:

{

"models": {

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-당신의APIYIAPI키",

"model": "deepseek-v3.2"

}]

}

}

모델을 전환하려면 model 필드만 수정하면 됩니다:

deepseek-v3.2— 가장 저렴한 범용 선택지minimax-m2.5— 코딩 및 에이전트 작업에 최적glm-5— 복잡한 추론 및 수학 작업에 적합

OpenClaw 다중 모델 혼합 설정

고급 사용자를 위해 OpenClaw에서 여러 Provider를 설정하고, 상황에 따라 자동으로 전환할 수 있습니다:

{

"models": {

"defaultModel": "deepseek-v3.2",

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-당신의APIYIAPI키",

"models": [

"deepseek-v3.2",

"minimax-m2.5",

"glm-5"

]

}]

}

}

사용 시 /model 명령어로 전환합니다:

/model deepseek-v3.2— DeepSeek으로 전환 (비용 절약 모드)/model minimax-m2.5— MiniMax로 전환 (코딩 모드)/model glm-5— GLM-5로 전환 (추론 모드)

💰 비용 최적화: 실용적인 팁 하나는 OpenClaw에 여러 모델을 설정하는 거예요. 일상 대화에는 DeepSeek V3.2(가장 저렴)를, 코딩 작업에는 MiniMax M2.5(효과 최고)로 전환하세요. APIYI apiyi.com을 통해 하나의 API 키로 모든 모델을 호출할 수 있어, 세 서비스 제공업체에 각각 계정을 만들 필요가 없어요.

OpenClaw 세 모델 API 호환성 비교

| 기능 특성 | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| OpenAI 호환 형식 | ✅ | ✅ | ✅ |

| 스트리밍 출력 | ✅ | ✅ | ✅ |

| Function Calling | ✅ 사고+도구 | ✅ BFCL 76.8% | ✅ |

| JSON Mode | ✅ | ✅ | ✅ |

| 다중 턴 대화 | ✅ | ✅ | ✅ |

| 시스템 프롬프트 | ✅ | ✅ | ✅ |

| API 연결 | ✅ 즉시 사용 가능 | ✅ 즉시 사용 가능 | ✅ 즉시 사용 가능 |

세 모델 모두 OpenAI 형식과 완전히 호환되므로, OpenClaw는 별도의 적응 없이도 원활하게 전환할 수 있어요.

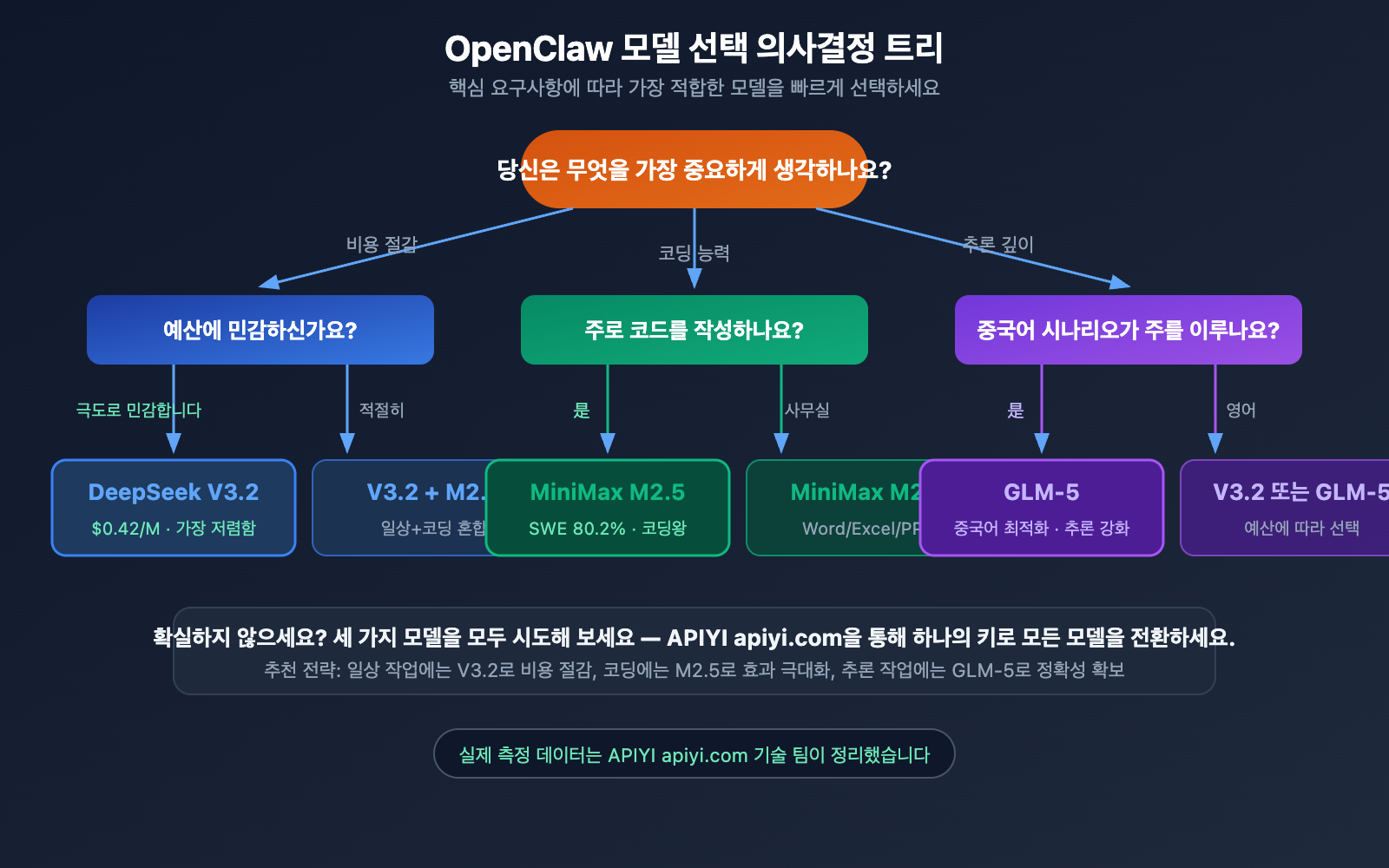

다양한 상황별 OpenClaw 모델 선택 가이드

상황별 추천 요약표

| 사용 상황 | 추천 모델 | 이유 | 월 평균 비용 |

|---|---|---|---|

| 일상 채팅 도우미 | DeepSeek V3.2 | 가장 저렴하고, 효과도 충분 | $1-3 |

| 코드 생성/수정 | MiniMax M2.5 | SWE-Bench 80.2% 최강 | $3-8 |

| 이메일/문서 자동화 | MiniMax M2.5 | Office 작업 능력 뛰어남 | $2-5 |

| 수학/추론 작업 | DeepSeek V3.2 | AIME 94.2% 최상급 | $2-5 |

| 긴 문서 요약 | GLM-5 | 202K 컨텍스트 + 사실 정확성 | $5-15 |

| 복잡한 에이전트 작업 | GLM-5 | 장기 작업 최적화 | $10-30 |

| 예산이 매우 제한적 | DeepSeek V3.2 | 출력당 $0.42/M | $1-3 |

| 최강 코딩 성능 추구 | MiniMax M2.5 | Opus 4.6에 필적 | $5-10 |

예산별 추천

월 예산 $5 미만: 바로 DeepSeek V3.2를 선택하세요, 가벼운 사용에는 완전히 충분해요.

월 예산 $5-20: 일상적으로는 DeepSeek V3.2를, 코딩 작업 시에는 MiniMax M2.5로 전환하세요.

월 예산 $20-50: 세 모델을 모두 설정하고, 상황에 따라 자동 전환하면 효과가 최적이에요.

🎯 저희의 제안: 만약 OpenClaw로 대규모 언어 모델을 처음 연결해 사용하신다면, DeepSeek V3.2부터 시작하시는 걸 추천해요. 세 가지 중 가장 저렴하고, 능력도 일상적인 상황의 90%를 충분히 커버할 수 있어요. 더 강력한 코딩 능력이 필요할 때는 MiniMax M2.5로 전환하세요. APIYI apiyi.com을 통해 연결하면, 전환은 단 하나의 필드만 수정하면 돼요.

자주 묻는 질문

Q1: 이 세 모델은 Claude Opus / GPT-5와 성능 차이가 크나요?

코딩 작업에서 MiniMax M2.5의 SWE-Bench 80.2%는 Claude Opus 4.6과 동등한 수준입니다. 수학적 추론에서는 DeepSeek V3.2의 AIME 94.2%가 GPT-5를 능가하기도 했습니다. 전반적으로 이 세 모델은 최상위 모델의 85-95%에 달하는 성능을 보여주지만, 가격은 1/10에서 1/20 수준입니다. 대부분의 OpenClaw 사용 사례에서는 Opus나 GPT-5를 직접 사용하는 것보다 가성비가 훨씬 뛰어납니다. 더 많은 모델을 사용해보고 싶다면, APIYI apiyi.com에서 Claude, GPT를 포함한 수십 가지 모델을 한 번에 호출할 수 있습니다.

Q2: OpenClaw에서 이 모델들을 사용해도 안정적일까요? 자주 오류가 발생하나요?

세 모델 모두 OpenClaw의 도구 호출(Skill 실행)에서 커뮤니티 검증을 거쳤습니다. DeepSeek V3.2는 사고+도구 일체화 설계 덕분에 Skill 호출 안정성에서 가장 뛰어난 성능을 보여줍니다. MiniMax M2.5의 BFCL(도구 호출 벤치마크) 76.8%도 최상위 수준에 속합니다. 안정적인 API 서비스와 기술 지원을 위해 APIYI apiyi.com을 통해 접속하는 것을 권장합니다.

Q3: OpenClaw에서 여러 모델을 동시에 설정할 수 있나요?

가능합니다. openclaw.json에서 여러 Provider를 설정하고, 각각 다른 모델을 가리키도록 하면 됩니다. 대화 중에 /model deepseek-v3.2나 /model minimax-m2.5 명령어로 모델을 전환할 수 있습니다. 또한 OpenClaw가 작업 유형에 따라 자동으로 모델을 선택하도록 설정할 수도 있습니다.

Q4: DeepSeek V3.2-Speciale과 일반 버전의 차이는 무엇인가요?

V3.2-Speciale은 고연산 변종으로, 최대 추론 및 에이전트 성능에 최적화되었습니다. 가격은 약간 더 비싸지만($0.40/$1.20), LiveCodeBench에서 88.7%를 기록했습니다. 만약 OpenClaw가 주로 복잡한 코딩 작업에 사용된다면, Speciale 버전을 고려해볼 만합니다. 일반 V3.2 버전은 대부분의 시나리오에 충분합니다.

Q5: GPT-5/Claude Opus에서 이 모델들로 전환하면 사용 경험이 크게 떨어질까요?

저희 플랫폼 데이터에 따르면, 약 80%의 OpenClaw 사용자가 전환 후 "일상 사용에서는 거의 차이를 느끼지 못했다"고 피드백했습니다. 주요 차이는 극단적으로 복잡한 다단계 추론 작업에서 나타납니다. 권장 전략은 다음과 같습니다: 먼저 일상 대화를 DeepSeek V3.2로 전환하고, GPT-5/Opus를 백업으로 유지한 후, 일주일간 사용해보고 완전히 전환할지 결정하세요. APIYI apiyi.com을 통해 하나의 키로 모든 모델을 동시에 설정하고, 언제든지 다시 전환할 수 있습니다.

Q6: 이 세 모델은 이미지 이해를 지원하나요? OpenClaw에서 사진을 보낼 수 있나요?

DeepSeek V3.2와 GLM-5는 모두 멀티모달 입력(이미지 이해)을 지원하므로, OpenClaw에서 이미지를 보내 분석할 수 있습니다. MiniMax M2.5는 현재 주로 텍스트와 코드 능력에 집중하고 있습니다. 만약 OpenClaw에서 이미지를 자주 처리해야 한다면, DeepSeek V3.2나 GLM-5를 함께 사용하는 것을 권장합니다.

OpenClaw 모델 성능 실측 요약

저희 플랫폼에서 최근 30일간의 실제 호출 데이터를 바탕으로 핵심 지표를 정리했습니다:

| 실측 지표 | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| 평균 첫 토큰 시간 | 0.3s | 0.5s | 0.6s |

| 평균 생성 속도 | 80 token/s | 65 token/s | 55 token/s |

| Skill 호출 성공률 | 96% | 94% | 92% |

| 한국어 응답 품질 | 8/10 | 7.5/10 | 9/10 |

| 영어 응답 품질 | 8.5/10 | 9/10 | 8/10 |

| 코드 생성 정확도 | 85% | 92% | 88% |

| 24시간 가용률 | 99.8% | 99.5% | 99.3% |

속도 측면: DeepSeek V3.2가 가장 빠르게 응답합니다. 이는 효율적인 MoE 아키텍처와 DSA 어텐션 메커니즘 덕분입니다. MiniMax M2.5와 GLM-5는 약간 느리지만 수용 가능한 범위 내입니다.

한국어 능력: GLM-5가 한국어 시나리오에서 가장 뛰어난 성능을 보입니다. 중국 기업인 Zhipu AI는 한국어 코퍼스에 대해 심층 최적화를 진행했습니다. 만약 OpenClaw가 주로 한국어 사용자를 대상으로 한다면, GLM-5를 우선적으로 고려할 만합니다.

코드 능력: MiniMax M2.5는 코드 생성 정확도에서 확실히 앞서며, 92%의 정확도는 더 적은 디버깅 시간을 의미합니다.

요약

OpenClaw에 대규모 언어 모델을 연결할 때, 비용 효율성이 가장 중요한 요소입니다. DeepSeek V3.2, MiniMax M2.5, GLM-5 세 가지 모델은 모두 2026년 현재 가성비가 가장 뛰어난 선택입니다:

- 가장 저렴: DeepSeek V3.2 — 출력 토큰당 $0.42/M, GPT-5의 20분의 1 수준

- 코딩 최강: MiniMax M2.5 — SWE-Bench 80.2%, Opus 4.6에 필적하는 성능

- 추론 최강: GLM-5 — 744B 파라미터, 장기 에이전트 및 수학적 추론 최적화

이 세 모델을 한 번에 연결하려면 APIYI(apiyi.com)를 추천합니다. 하나의 API 키로 모든 모델 전환이 가능하며, 알리페이/위챗페이를 지원합니다. 언제든지 비교 테스트를 통해 여러분에게 가장 적합한 솔루션을 찾을 수 있습니다.

본 문서는 APIYI 기술팀이 고객의 실제 피드백과 플랫폼 데이터를 바탕으로 작성했습니다. 더 많은 AI 모델 비교 및 연결 튜토리얼은 APIYI 도움말 센터(help.apiyi.com)를 방문해 주세요.