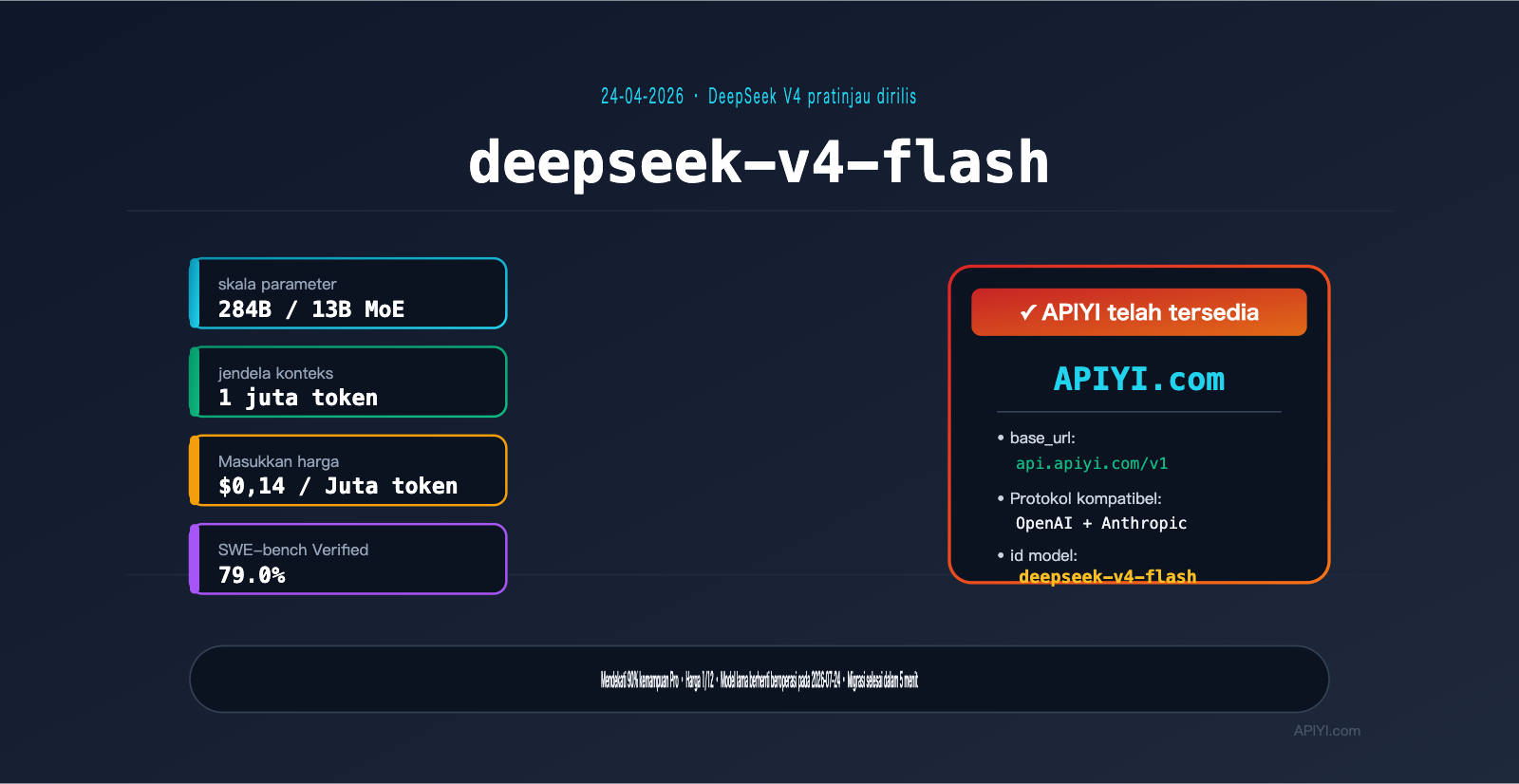

24 April 2026, DeepSeek merilis model pratinjau V4-Pro dan V4-Flash secara open-source di Hugging Face. V4-Pro adalah raksasa MoE dengan 1,6T parameter untuk performa mutakhir, sementara V4-Flash adalah pilihan ekonomis dengan "kemampuan 90% dari Pro, namun harga hanya 1/12-nya".

Jika Anda hanya perlu melirik satu model, pilihlah deepseek-v4-flash. Alasannya sederhana:

- Arsitektur MoE 284B / 13B + Hybrid Attention, FLOPs inferensi pada jendela konteks 1M hanya 27% dari V3.2.

- Konteks 1M token / Output maksimum 384K token, mendukung pemrosesan dokumen panjang secara native tanpa perlu memotong bagian (chunking).

- Input $0,14 / Output $0,28 per juta token, satu tingkat lebih murah dibandingkan versi Pro.

- SWE-bench Verified 79,0%, Artificial Analysis Intelligence Index 45–47, sudah sangat mumpuni untuk sebagian besar skenario.

- Kompatibel dengan protokol ganda OpenAI ChatCompletions dan Anthropic API, siap digunakan di Claude Code / OpenClaw / OpenCode tanpa modifikasi.

Satu hal yang lebih penting: Model lama deepseek-chat dan deepseek-reasoner akan resmi dihentikan pada 24 Juli 2026. Semua layanan online harus bermigrasi sebelum tanggal tersebut. Ini adalah batas waktu akhir untuk hitung mundur 90 hari.

Kabar baiknya: deepseek-v4-flash sudah tersedia di APIYI (apiyi.com). Anda tidak perlu membuat akun DeepSeek sendiri, tidak perlu mengubah SDK, dan tidak perlu pusing dengan pembayaran internasional—cukup ubah kolom model dan arahkan base_url ke api.apiyi.com, dan Anda siap menggunakannya.

Artikel ini adalah panduan 3+5: 3 menit untuk memahami peningkatan inti V4-Flash + 5 menit untuk menyelesaikan migrasi penuh dari model lama.

I. 5 Peningkatan Utama deepseek-v4-flash

1.1 Ringkasan Spesifikasi Inti

Mari kita lihat gambaran besarnya sebelum masuk ke detail:

| Dimensi | deepseek-v4-flash |

|---|---|

| Tanggal Rilis | 24 April 2026 (Pratinjau) |

| Repositori Open Source | huggingface.co/deepseek-ai/DeepSeek-V4-Flash |

| Total Parameter | 284B (Mixture of Experts) |

| Parameter Aktif | 13B |

| Jendela Konteks | 1M token |

| Output Maksimum | 384K token |

| Arsitektur Attention | Hybrid Attention (CSA + HCA) |

| Mode Inferensi | Mode Berpikir / Tanpa Berpikir (Dual Mode) |

| Function Calling | ✅ Didukung |

| Mode JSON | ✅ Didukung |

| Chat Prefix Completion | Dukungan Beta |

| Protokol API | Kompatibel dengan OpenAI ChatCompletions + Anthropic |

| Harga Input | $0,14 / Juta token |

| Harga Output | $0,28 / Juta token |

Berikut adalah penjelasan mendalam untuk 5 peningkatan tersebut.

1.2 Peningkatan 1: Konteks 1M + Output 384K (Native Ultra-Long)

deepseek-v4-flash mendukung input 1M token dan output 384K token secara native. Ini adalah spesifikasi standar untuk seri V4, di mana versi Flash tidak mengurangi kapasitas konteks demi harga yang lebih murah.

Skenario apa saja yang bisa menangani 1M token?

| Tipe Konten | Perkiraan Jumlah Token |

|---|---|

| Naskah buku 100.000 karakter | ≈ 150K token |

| Dokumen teknis PDF 200 halaman | ≈ 300K token |

| Repositori kode menengah (~50 file) | ≈ 500K–800K token |

| Satu buku lengkap "Impian Paviliun Merah" | ≈ 1M token |

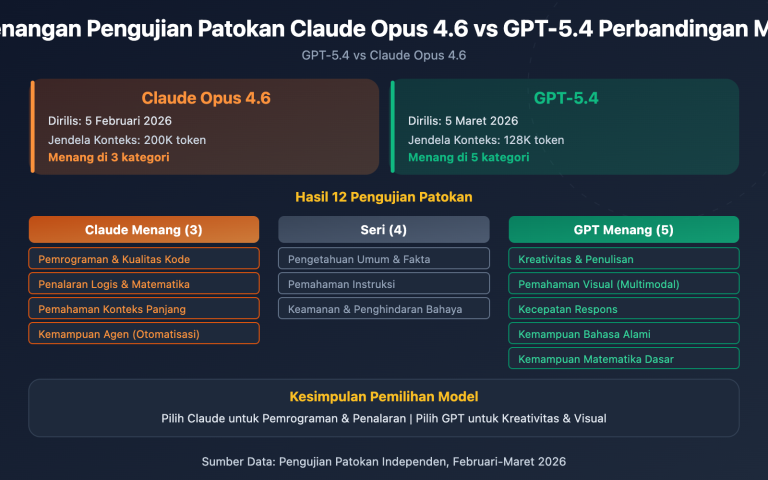

Dibandingkan dengan GPT-5.4 (400K), Claude Opus 4.6 (1M + paket konteks 1M), dan Gemini 3.1-Pro (2M), kapasitas 1M V4-Flash sudah menjadi standar industri, namun dengan harga 5–20 kali lebih murah.

1.3 Peningkatan 2: MoE 284B/13B + Hybrid Attention

V4-Flash menggunakan dua inovasi arsitektur utama yang diperkenalkan DeepSeek pada 2026:

- MoE: Total 284B parameter, hanya 13B yang aktif per token. Efeknya mendekati model padat 13B, namun dengan basis pengetahuan yang mendekati model padat 200B+.

- Hybrid Attention (CSA Compressed Sparse Attention + HCA Highly Compressed Attention): Dirancang khusus untuk konteks panjang.

Data efisiensi (dari DeepSeek resmi):

| Indikator | V3.2 | V4-Flash | Peningkatan |

|---|---|---|---|

| FLOPs inferensi per token (konteks 1M) | 100% | 27% | -73% |

| Penggunaan KV cache (konteks 1M) | 100% | 10% | -90% |

Dua angka ini menjelaskan mengapa Flash bisa menekan harga hingga $0,14: biaya komputasi dasar benar-benar turun, bukan sekadar subsidi.

1.4 Peningkatan 3: Mode Berpikir / Tanpa Berpikir (Dual Mode)

Satu ID model V4-Flash dapat menjalankan dua mode:

- Tanpa Berpikir (Default): Cepat, cocok untuk obrolan santai, tanya jawab, klasifikasi, dan ringkasan.

- Berpikir: Model akan mengeluarkan penalaran internal terlebih dahulu (mirip seri o OpenAI) sebelum memberikan jawaban akhir. Cocok untuk penalaran kompleks, pemanggilan alat multi-langkah, dan debugging kode.

Anda bisa beralih mode melalui parameter permintaan (bukan ID model yang berbeda), sehingga perubahan di sisi pengembang sangat minim. Saat memanggil melalui APIYI api.apiyi.com, nama parameter ini sepenuhnya konsisten dengan DeepSeek resmi.

1.5 Peningkatan 4: $0,14 / $0,28 per Juta Token

Ini adalah angka yang paling mengejutkan dari rilis kali ini:

| Model | Input ($/Juta) | Output ($/Juta) | Relatif terhadap V4-Flash |

|---|---|---|---|

| deepseek-v4-flash | 0,14 | 0,28 | 1× (Basis) |

| deepseek-v4-pro | 1,74 | 3,48 | 12× |

| GPT-5.4 (Referensi) | 2,50 | 10,00 | 17×–35× |

| Claude Sonnet 4.6 (Referensi) | 3,00 | 15,00 | 21×–53× |

Untuk permintaan "500 token input + 500 token output":

- V4-Flash: $0,000 21 ≈ Rp3,3

- GPT-5.4: $0,006 25 ≈ Rp98

- Claude Sonnet 4.6: $0,009 ≈ Rp142

Flash 30–40 kali lebih murah. Bagi produk dengan volume panggilan jutaan token per bulan, ini secara langsung menentukan margin keuntungan.

1.6 Peningkatan 5: Kompatibilitas Protokol Ganda OpenAI + Anthropic

V4-Flash mengimplementasikan dua set protokol di lapisan API:

POST /v1/chat/completions→ Format OpenAIPOST /v1/messages→ Format Anthropic

Artinya:

| Klien | Biaya Migrasi |

|---|---|

| OpenAI Python/Node SDK | Tanpa modifikasi, cukup ubah base_url dan model |

| Anthropic Python/Node SDK | Tanpa modifikasi, cukup ubah base_url dan model |

| Claude Code | Cukup ganti endpoint Anthropic |

| OpenClaw / OpenCode | Dukungan native |

| LangChain / LlamaIndex | Cukup ganti base_url |

Ini adalah keputusan cerdas DeepSeek: tidak memaksa Anda mempelajari protokol baru, sehingga ekosistem yang sudah ada dapat terhubung tanpa biaya.

1.7 Tabel Perbandingan Benchmark

| Benchmark | V4-Flash | V4-Pro | Selisih |

|---|---|---|---|

| SWE-bench Verified (Perbaikan Kode) | 79,0% | 82,1% | -3,1 |

| Terminal-Bench 2.0 (Alat Multi-langkah) | 56,9% | 67,9% | -11,0 |

| SimpleQA-Verified (Recall Fakta) | 34,1% | 57,9% | -23,8 |

| Artificial Analysis Intelligence Index | 45 / 47 | 58 | -11 ~ -13 |

Interpretasi: Flash hampir menyamai Pro dalam tugas kode satu langkah (SWE-bench), tetapi ada kesenjangan yang jelas dalam tugas yang membutuhkan rantai alat multi-langkah (Terminal-Bench) dan memori fakta (SimpleQA). Kedua kesenjangan inilah yang menjadi dasar keputusan untuk memilih antara Flash atau Pro.

2. DeepSeek-V4-Flash vs V4-Pro: Panduan Pengambilan Keputusan

2.1 Matriks Keputusan: Lihat di Sini

| Skenario | Rekomendasi | Alasan |

|---|---|---|

| Percakapan harian, obrolan, tanya jawab | Flash | Kemampuan sudah sangat cukup, harga 1/12 |

| Bot layanan pelanggan, sistem FAQ | Flash | Throughput tinggi, latensi rendah |

| Pelengkapan kode, modifikasi satu file | Flash | SWE-bench 79%, mendekati Pro |

| Ringkasan dokumen panjang, membaca buku | Flash | Jendela konteks 1M penuh tersedia |

| Agent rantai alat multi-langkah | Pro | Selisih 11 poin di Terminal-Bench |

| Riset mendalam, verifikasi multi-putaran | Pro | Selisih 24 poin di SimpleQA |

| Pembuatan laporan bisnis bernilai tinggi | Pro | Intelligence Index lebih tinggi 11+ |

| Eksperimen R&D / eksplorasi | Flash | 12x lebih murah, iterasi cepat |

Aturan Umum: Gunakan Flash secara default, tingkatkan ke Pro jika menemui hambatan. Ini sejalan dengan prinsip pemilihan teknologi: "Gunakan solusi sederhana terlebih dahulu, tingkatkan jika ada kendala."

2.2 Perhitungan Efisiensi Biaya: Kapan Flash Lebih Hemat?

Misalkan produk Anda melakukan 100 juta token panggilan per hari (60 juta input + 40 juta output):

| Model | Biaya Harian | Biaya Bulanan | Biaya Tahunan |

|---|---|---|---|

| V4-Flash | $19,6 | $588 | $7.056 |

| V4-Pro | $243,6 | $7.308 | $87.696 |

| GPT-5.4 (Referensi) | $550 | $16.500 | $198.000 |

Flash menghemat lebih dari $80K per tahun dibandingkan Pro. Uang ini cukup untuk membiayai setengah gaji pengembang tambahan.

2.3 Perutean Hibrida: Praktik Terbaik di Lingkungan Produksi

Solusi optimal bagi sebagian besar produk bukanlah memilih salah satu, melainkan melakukan perutean dinamis berdasarkan jenis permintaan:

def route_model(request_type: str) -> str:

# Mengarahkan permintaan umum ke Flash

if request_type in ("chat", "faq", "summarize", "classify"):

return "deepseek-v4-flash"

# Mengarahkan tugas kompleks ke Pro

if request_type in ("deep_research", "multi_step_agent"):

return "deepseek-v4-pro"

return "deepseek-v4-flash" # Default ke Flash

🎯 Saran Implementasi: Kami menyarankan Anda untuk memiliki izin pemanggilan model V4-Flash dan V4-Pro sekaligus di platform APIYI (apiyi.com). Keduanya menggunakan satu kunci API yang sama, Anda hanya perlu mengubah kolom

modeluntuk beralih. Untuk tugas batch, kami merekomendasikan jalur konkurensi tinggivip.apiyi.com, sedangkan tugas kompleks Pro dapat menggunakan situs utamaapi.apiyi.com. Bisnis yang berbeda dapat melakukan alokasi lalu lintas A/B dalam konfigurasi yang sama.

Tiga, 5 Menit Memanggil deepseek-v4-flash di APIYI apiyi.com

3.1 Langkah 1: Persiapan Lingkungan dan Mendapatkan Kunci API

| Item | Persyaratan |

|---|---|

| Python atau Node.js | Python 3.8+ / Node.js 18+ |

| SDK Klien | OpenAI Python openai >= 1.0 atau SDK Node resmi |

| Jaringan | Dapat mengakses api.apiyi.com |

| Kunci API | Dibuat di dasbor APIYI apiyi.com, diawali dengan sk- |

Mendapatkan Kunci API:

- Kunjungi

apiyi.com, daftar/masuk lalu masuk ke dasbor. - Menu kiri → API Keys → Buat kunci baru.

- Disarankan untuk mengatur "Batas Penggunaan" sebesar ¥50–100 untuk verifikasi awal.

- Salin string kunci yang diawali dengan

sk-.

3.2 Langkah 2: Memilih Jalur (base_url)

APIYI menyediakan tiga jalur yang menggunakan kunci API yang sama:

| base_url | Posisi | Skenario yang Direkomendasikan |

|---|---|---|

https://api.apiyi.com/v1 |

Situs Utama | Pilihan default, pemanggilan harian |

https://vip.apiyi.com/v1 |

Konkurensi Tinggi | Pemrosesan/inferensi batch, antrean malam hari |

https://b.apiyi.com/v1 |

Cadangan | Fallback otomatis saat situs utama tidak stabil |

Untuk pengembangan harian, gunakan situs utama. Jika di lingkungan produksi menemui limitasi 429 atau gangguan 5xx, baru beralih ke VIP/cadangan.

3.3 Langkah 3: Contoh Pemanggilan Minimal Python (Non-Thinking)

from openai import OpenAI

client = OpenAI(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com/v1",

)

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "system", "content": "Anda adalah asisten yang ringkas"},

{"role": "user", "content": "Ringkaslah peningkatan inti DeepSeek V4-Flash dalam tiga poin"},

],

max_tokens=512,

)

print(resp.choices[0].message.content)

Hanya ada dua perubahan:

base_urldiarahkan keapi.apiyi.commodeldiubah menjadideepseek-v4-flash

Kode SDK OpenAI lainnya tetap sama.

3.4 Langkah 4: Mengaktifkan Mode Inferensi Thinking

Jika memerlukan inferensi mendalam, tambahkan parameter reasoning ke dalam permintaan:

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "user", "content": "Buktikan: Diberikan n titik, berapa jumlah garis lurus minimum yang diperlukan untuk menutupi semua pasangan titik?"},

],

extra_body={

"reasoning": {"enabled": True, "effort": "high"},

},

max_tokens=8192,

)

# Respons akan menyertakan kolom reasoning_content

print("Proses berpikir:", resp.choices[0].message.reasoning_content)

print("Jawaban akhir:", resp.choices[0].message.content)

Dalam mode Thinking, waktu pemrosesan akan meningkat 2–5 kali lipat (tergantung kompleksitas masalah), namun akurasi untuk soal kode/matematika meningkat secara signifikan.

3.5 Langkah 5: Contoh Pemanggilan Minimal Node.js

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_API_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const resp = await client.chat.completions.create({

model: "deepseek-v4-flash",

messages: [

{ role: "user", content: "Tulis haiku tentang AI tahun 2026" },

],

max_tokens: 256,

});

console.log(resp.choices[0].message.content);

3.6 Langkah 6: Contoh Function Calling

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Dapatkan cuaca saat ini untuk sebuah kota",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"],

},

},

}]

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[{"role": "user", "content": "Bagaimana cuaca di Shanghai hari ini?"}],

tools=tools,

)

print(resp.choices[0].message.tool_calls)

V4-Flash memiliki stabilitas yang sangat baik dalam skenario pemanggilan alat tunggal. Untuk rantai alat kompleks multi-langkah (5+ langkah), disarankan untuk meningkatkan ke V4-Pro.

3.7 Langkah 7: Pemanggilan Protokol Anthropic

Jika proyek Anda dikembangkan berdasarkan SDK Anthropic (misalnya terintegrasi dengan Claude Code), Anda tetap bisa menggunakannya:

from anthropic import Anthropic

client = Anthropic(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com",

)

resp = client.messages.create(

model="deepseek-v4-flash",

max_tokens=1024,

messages=[{"role": "user", "content": "Hai"}],

)

print(resp.content[0].text)

🎯 Saran Protokol Ganda: Untuk model deepseek-v4-flash yang sama, protokol OpenAI menggunakan

api.apiyi.com/v1, sedangkan protokol Anthropic menggunakanapi.apiyi.com(tanpa/v1). Saat beralih, cukup ubah kolom base_url saja. Detail protokol lebih lanjut dapat merujuk pada kolom DeepSeek di dokumentasi resmi APIYIdocs.apiyi.com.

Empat, Jalur Lengkap Migrasi dari Model Lama ke deepseek-v4-flash

4.1 Mengapa Harus Migrasi: Hitung Mundur 90 Hari

Pengumuman resmi DeepSeek menyatakan:

Model lama

deepseek-chatdandeepseek-reasonerakan dipensiunkan pada 24 Juli 2026.

Harap perbarui model Anda kedeepseek-v4-proataudeepseek-v4-flash.

Setelah 24-07-2026, permintaan yang terus menggunakan ID model lama akan langsung mengembalikan kesalahan. Dihitung dari tanggal rilis 24-04-2026, terdapat total 90 hari masa tenggang.

4.2 Tabel Keputusan Migrasi

Berdasarkan model yang Anda gunakan saat ini, berikut model barunya:

| ID model lama | ID model baru | Kesulitan Migrasi |

|---|---|---|

deepseek-chat |

deepseek-v4-flash (mode Non-Thinking) |

⭐ Ubah 1 kolom saja |

deepseek-reasoner |

deepseek-v4-flash + mode Thinking |

⭐⭐ Ubah model + tambahkan parameter reasoning |

deepseek-reasoner (skenario bernilai tinggi) |

deepseek-v4-pro + mode Thinking |

⭐⭐ Ubah model + tambahkan parameter reasoning |

deepseek-v3.x |

deepseek-v4-flash |

⭐ Ubah model saja |

deepseek-coder dll. |

deepseek-v4-flash |

⭐ Ubah model saja (kemampuan umum sudah tercakup) |

4.3 Diff Kode: Hampir Tanpa Perubahan

Sebelum migrasi:

resp = client.chat.completions.create(

model="deepseek-chat", # ← Model lama

messages=[...],

)

Setelah migrasi:

resp = client.chat.completions.create(

model="deepseek-v4-flash", # ← Ubah baris ini

messages=[...],

)

Jika sekaligus bermigrasi dari deepseek-reasoner:

resp = client.chat.completions.create(

- model="deepseek-reasoner",

+ model="deepseek-v4-flash",

messages=[...],

+ extra_body={"reasoning": {"enabled": True}},

)

4.4 Daftar Periksa Migrasi

Disarankan untuk menjalankan daftar ini sebelum migrasi:

- Identifikasi semua lokasi hardcode

model=di dalam kode - Evaluasi apakah pemanggilan

deepseek-reasonerperlu ditingkatkan ke V4-Pro - Siapkan sekumpulan prompt uji regresi (20–50 prompt, mencakup bisnis inti)

- Di dasbor APIYI

apiyi.com, perketat batas harian untuk permintaan lama agar migrasi terpaksa dilakukan - Jalankan AB testing selama 1 minggu untuk model baru dan lama, bandingkan kualitas output

- Pantau kurva konsumsi token, pastikan biaya tidak melonjak secara tak terduga

- Perbarui dokumentasi internal dan Runbook

4.5 Saran Peluncuran Bertahap

Dibagi menjadi 3 tahap:

| Tahap | Lalu Lintas | Periode | Tujuan |

|---|---|---|---|

| Tahap 1 | 5% | Minggu ke-1 | Verifikasi protokol dan output dasar |

| Tahap 2 | 30% | Minggu ke-2 hingga ke-3 | Bandingkan metrik utama (kualitas + biaya) |

| Tahap 3 | 100% | Minggu ke-4 | Migrasi penuh, simpan kunci lama untuk rollback darurat |

💡 Rollback Darurat: Rute model lama di APIYI apiyi.com tetap kompatibel hingga 24-07-2026. Jika selama migrasi ditemukan masalah serius, cukup ubah

modelkembali kedeepseek-chat/deepseek-reasoneruntuk pemulihan instan. Namun, jangan menunda hingga akhir Juli untuk memulai.

V. FAQ Pertanyaan Umum deepseek-v4-flash

Q1: Bagaimana cara memilih antara Flash dan Pro?

Aturan praktisnya: Gunakan Flash secara default, upgrade ke Pro jika menemui hambatan. Berikut detail skenarionya:

- Percakapan tunggal, FAQ, klasifikasi, ringkasan, pelengkapan kode → Flash

- Alur kerja Agen multi-langkah (5+ langkah pemanggilan alat) → Pro

- Tugas penelitian mendalam → Pro

- Jika ragu, jalankan Flash terlebih dahulu untuk melihat hasilnya, jika kurang memuaskan, baru upgrade.

Q2: Apakah jendela konteks 1M benar-benar bisa digunakan sepenuhnya?

Bisa, namun perhatikan hal berikut:

- 100K–300K pertama: Perhatian model paling terfokus, hasil terbaik.

- 300K–800K: Hasil tetap stabil.

- 800K–1M: Recall marjinal akan menurun, disarankan menaruh informasi penting di awal atau akhir.

- Pengingat biaya: Input 1M token ≈ $0,14, tidak mahal tapi juga tidak gratis.

Untuk dokumen panjang, disarankan menggunakan struktur: "Pertanyaan di awal + materi di tengah + ulangi pertanyaan di akhir".

Q3: Bagaimana cara memicu mode Thinking?

Pada protokol OpenAI, picu dengan extra_body.reasoning.enabled=true. Parameter effort bisa diatur ke low / medium / high, dengan default medium. Di APIYI api.apiyi.com, parameternya sama dengan versi resmi.

Q4: Apakah Function Calling stabil di Flash?

Pemanggilan tunggal sangat stabil (tingkat keberhasilan 95%+). Untuk rantai alat multi-langkah (5+ langkah), disarankan menggunakan Pro—perbedaan skor 11 poin pada Terminal-Bench 2.0 terutama terlihat di sini.

Q5: Berapa konkurensi yang wajar?

Untuk pengembang individu, 10–20 konkurensi tidak masalah. Untuk lingkungan produksi, disarankan:

- Default: Gunakan 50 konkurensi melalui

api.apiyi.com. - Tugas Batch/Malam: Pindah ke

vip.apiyi.com, bisa mencapai 200+ konkurensi. - Lonjakan Darurat: Lakukan fallback sementara ke

b.apiyi.com.

Untuk batas maksimal spesifik, silakan cek penjelasan kuota terbaru di docs.apiyi.com.

Q6: Bagaimana cara mengevaluasi risiko migrasi?

Gunakan metode tiga langkah:

- Kualitas Output: Lakukan pengujian AB dengan 20–50 petunjuk bisnis yang umum, evaluasi secara manual atau menggunakan model penilai.

- Kurva Biaya: Amati konsumsi token harian, output token Flash biasanya sedikit lebih banyak (terutama dalam mode Thinking).

- Latensi: TTFT Flash mendekati V3.5, mode Thinking akan 2–5 kali lebih lambat.

Jika penurunan kualitas melebihi 10%, pertimbangkan untuk upgrade ke Pro, jika tidak, silakan migrasi dengan tenang.

Q7: Bagaimana cara menggunakan kompatibilitas protokol Anthropic?

base_url tidak perlu menyertakan /v1, langsung panggil POST /v1/messages. Cukup isi kolom model pada SDK Anthropic dengan deepseek-v4-flash. Ini adalah jalan pintas untuk migrasi tanpa perubahan bagi proyek yang sudah menggunakan SDK Claude.

Q8: Apakah ada diskon untuk cache jendela konteks?

V4-Flash telah mengaktifkan context caching otomatis, sehingga permintaan dengan awalan yang sama akan dikenakan biaya lebih rendah. Untuk skenario dengan petunjuk sistem yang panjang, Anda bisa menghemat 30–50%. Diskon ini aktif secara default di platform APIYI apiyi.com, tidak memerlukan parameter tambahan.

VI. Kesimpulan Peluncuran deepseek-v4-flash

Peluncuran DeepSeek V4 ini membawa dua fakta kunci bagi pengembang:

- Lebih Murah: V4-Flash memberikan kemampuan yang mendekati Pro dengan harga 1/12-nya, input $0,14/M mencetak rekor harga terendah di industri.

- Batas Waktu Migrasi: Model lama akan resmi dihentikan pada 24-07-2026, masa tenggang 90 hari dihitung mundur sejak hari peluncuran.

Kabar baiknya, deepseek-v4-flash sudah tersedia di APIYI apiyi.com. Anda tidak perlu membuat akun luar negeri, tidak perlu mengubah SDK, dan tidak perlu khawatir soal metode pembayaran. Selesaikan dalam tiga langkah:

- ✅ Dapatkan kunci API di dasbor

apiyi.com. - ✅ Arahkan

base_urlkeapi.apiyi.com/v1(cadanganvip.apiyi.com/b.apiyi.com). - ✅ Atur

modelkedeepseek-v4-flash, kode lainnya tetap sama.

🎯 Saran Tindakan: Sangat disarankan untuk memulai pengujian AB deepseek-v4-flash hari ini. Buka kunci API khusus di APIYI apiyi.com, jalankan 20–50 petunjuk bisnis yang umum, dan bandingkan kualitas output serta biaya dengan model sebelumnya. Jika tidak ada penurunan kualitas yang signifikan, Anda bisa mengalihkan 5% trafik minggu ini dan menyelesaikan migrasi penuh dalam 4 minggu—jauh lebih santai daripada terburu-buru di bulan Juli. Untuk contoh migrasi dan skrip benchmark yang lebih detail, silakan merujuk ke kolom DeepSeek V4 di

docs.apiyi.com.

Nilai dari deepseek-v4-flash bukanlah sekadar "model murah lainnya", melainkan "membawa skenario yang dulunya hanya bisa dilayani oleh raksasa teknologi ke tingkat harga yang bisa dijangkau semua orang"—jendela konteks 1M untuk membaca seluruh buku, mode Thinking untuk penalaran kompleks, dan Function Calling untuk menghubungkan rangkaian alat lengkap, semua dengan biaya per panggilan yang sangat rendah. Ini akan membuka peluang produk baru, siapa yang bermigrasi lebih dulu, dialah yang memimpin.

Penulis: Tim Teknis APIYI

Sumber Terkait:

- Pengumuman Resmi DeepSeek: api-docs.deepseek.com/news/news260424

- Repositori Open Source Hugging Face: huggingface.co/deepseek-ai/DeepSeek-V4-Flash

- Situs Resmi APIYI: apiyi.com

- Dokumentasi APIYI: docs.apiyi.com

- Situs Utama APIYI: api.apiyi.com (cadangan vip.apiyi.com / b.apiyi.com)