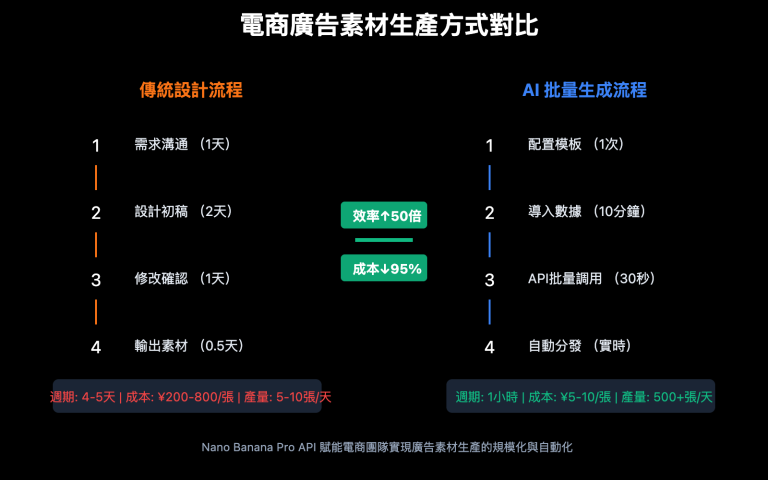

OpenClaw 接入哪個大模型性價比最高?這是我們客戶問得最多的問題之一。本文將從 價格、性能、Agent 工具調用能力三個維度,對比 DeepSeek V3.2、MiniMax M2.5、GLM-5 三款高性價比模型,幫你找到 OpenClaw 的最佳搭檔。

核心價值: 這三款模型的共同特點是便宜且好用——價格只有 GPT-5 / Claude Opus 的十分之一到二十分之一,但在編碼、工具調用等 Agent 場景中表現出色。讀完本文,你將清楚在不同場景下該選擇哪個模型。

三款高性價比模型核心參數對比

先看最關鍵的數據——價格和性能的綜合對比。

| 對比維度 | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 | GPT-5 (參考) |

|---|---|---|---|---|

| 輸入價格 | $0.28/M | $0.29/M | $0.80/M | $5.00/M |

| 輸出價格 | $0.42/M | $1.20/M | $2.56/M | $15.00/M |

| 上下文窗口 | 128K | 205K | 202K | 128K |

| SWE-Bench | 70% | 80.2% | 77.8% | 72% |

| AIME 數學 | 94.2% | — | 84% | 86% |

| 工具調用 | ✅ 思考+工具集成 | ✅ BFCL 76.8% | ✅ Agent 優化 | ✅ |

| 開源協議 | MIT | 開放權重 | 開放權重 | 閉源 |

| 參數量 | MoE 架構 | — | 744B/40B 活躍 | — |

| OpenClaw 可用 | ✅ | ✅ | ✅ | ✅ |

關鍵發現: DeepSeek V3.2 的輸出價格僅 $0.42/M,是三者中最便宜的;MiniMax M2.5 在編碼任務上表現最強(SWE-Bench 80.2%);GLM-5 在數學推理和長程 Agent 任務上有獨特優勢。

🎯 選擇建議: 三款模型都可以通過 API易 apiyi.com 平臺一站式接入 OpenClaw,統一 API 格式,無需分別註冊多個服務商。平臺支持隨時切換模型,便於實際對比測試。

DeepSeek V3.2:最便宜的 OpenClaw 通用選擇

DeepSeek V3.2 是 2025 年 12 月發佈的旗艦模型,憑藉極致的性價比成爲 OpenClaw 社區最受歡迎的選擇之一。

DeepSeek V3.2 核心優勢

價格優勢驚人: 輸入 $0.28/M、輸出 $0.42/M,相當於 GPT-5 的二十分之一。即使是高級變體 V3.2-Speciale($0.40/$1.20),也只是主流模型的零頭。

Agent 能力突出: V3.2 是第一個將「思考」直接集成到工具調用中的模型。它支持在思考模式和非思考模式中都使用工具調用,這對 OpenClaw 的 Skill 執行非常重要。

技術創新: 採用 DeepSeek Sparse Attention (DSA),將 KV Cache 內存開銷降低超過 93%,在 128K 上下文窗口下依然保持高效推理。

DeepSeek V3.2 在 OpenClaw 中的表現

| 場景 | 表現 | 評價 |

|---|---|---|

| 日常對話助手 | 流暢、準確 | ⭐⭐⭐⭐⭐ |

| 代碼生成/調試 | 強,IMO 金牌水平 | ⭐⭐⭐⭐ |

| 工具調用 (Skill) | 思考+工具一體化 | ⭐⭐⭐⭐⭐ |

| 長文檔處理 | 128K 上下文,高效 | ⭐⭐⭐⭐ |

| 數學/推理 | AIME 94.2% | ⭐⭐⭐⭐⭐ |

| 月均成本 | $1-5(輕度使用) | 💰 最省錢 |

💡 客戶反饋: 我們平臺上大量 OpenClaw 用戶選擇 DeepSeek V3.2 作爲日常模型,輕度使用月均成本僅 $1-3。通過 API易 apiyi.com 接入,無需註冊 DeepSeek 官方賬號,支持支付寶充值。

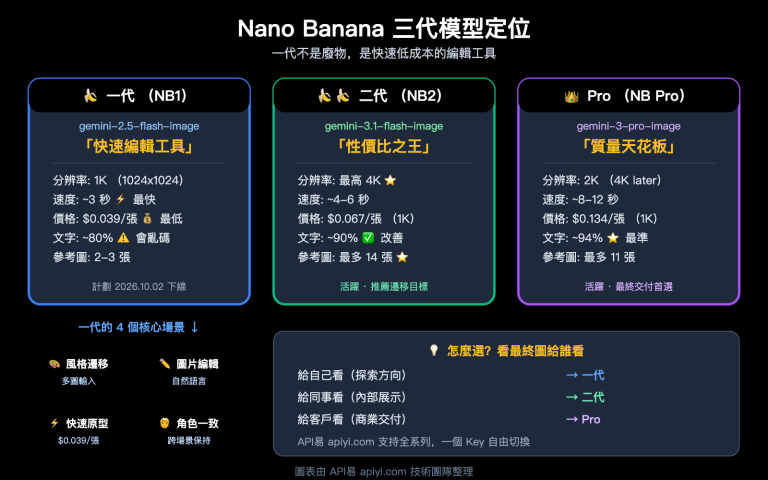

MiniMax M2.5:OpenClaw 編碼 Agent 的最佳選擇

MiniMax M2.5 於 2026 年 2 月發佈,在編碼和 Agent 任務上的表現令人印象深刻。

MiniMax M2.5 核心優勢

編碼能力業界頂尖: SWE-Bench Verified 80.2%,與 Claude Opus 4.6 持平,遠超 GPT-5。在 Multi-SWE-Bench(跨文件修復)上也達到 51.3%。

架構師級思維: M2.5 在寫代碼之前會像經驗豐富的軟件架構師一樣主動分解和規劃功能結構、UI 設計,而不是直接開始寫代碼。這種「先想後做」的模式非常適合 OpenClaw 的複雜任務。

多語言編程: 在 Go、C/C++、TypeScript、Rust、Kotlin、Python、Java 等 10+ 語言上經過了 20 萬+ 真實環境強化學習訓練。

Office 辦公能力: 可以流暢生成和操作 Word、Excel、PowerPoint 文件,在不同軟件環境間無縫切換。

MiniMax M2.5 在 OpenClaw 中的最佳用途

- 代碼倉庫維護: SWE-Bench 80.2%,堪比 Opus,適合讓 OpenClaw 自動修 Bug

- 瀏覽器搜索: BrowseComp 76.3%,配合 Agent Browser Skill 效果優秀

- Office 自動化: 生成 Word/Excel/PPT,適合辦公自動化場景

- 多步驟任務: 任務執行速度比上一代快 37%,匹配 Opus 4.6 的速度

🚀 快速體驗: 想對比 MiniMax M2.5 和 DeepSeek V3.2 的實際表現?通過 API易 apiyi.com 可以在同一個 API Key 下切換兩個模型,無需分別註冊,快速對比出圖效果和代碼質量。

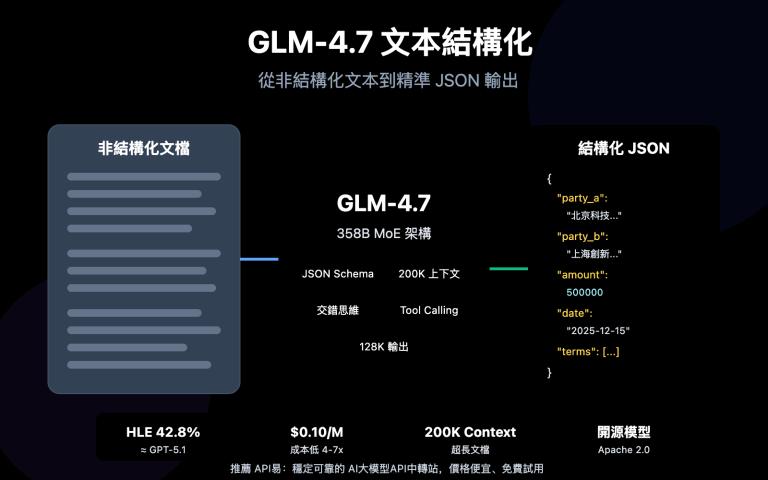

GLM-5:OpenClaw 複雜推理任務的性價比之選

GLM-5 由智譜 AI (Zhipu AI) 於 2026 年 2 月發佈,是一個 744B 參數的開放權重模型,在長程 Agent 任務和事實準確性方面表現突出。

GLM-5 核心優勢

超大參數量: 744B 總參數,40B 活躍參數(MoE 架構),在保持高效推理的同時擁有更大的知識儲備。

數學和推理: AIME 2025 得分 84%,MATH 基準 88%,在需要深度推理的場景中可靠性高。

長程 Agent 優化: 202K 上下文窗口,專爲長期任務規劃和多步驟 Agent 執行優化。

DeepSeek Sparse Attention: 和 DeepSeek V3.2 一樣採用 DSA 技術,在超長上下文下保持高效。

GLM-5 定價分析

| 用量級別 | GLM-5 月成本 | DeepSeek V3.2 月成本 | 差價 |

|---|---|---|---|

| 輕度 (1M tokens/月) | ~$3.4 | ~$0.7 | 4.8x |

| 中度 (10M tokens/月) | ~$34 | ~$7 | 4.8x |

| 重度 (100M tokens/月) | ~$340 | ~$70 | 4.8x |

GLM-5 的價格約是 DeepSeek V3.2 的 5 倍,但仍然只有 GPT-5 的五分之一。在需要更強推理能力的場景中,這個溢價是值得的。

GLM-5 在 OpenClaw 中的最佳用途

- 複雜推理: 需要多步邏輯分析的問題,如數據分析和報告生成

- 長文檔處理: 202K 上下文窗口處理長篇文檔、論文總結

- 事實準確性: 在需要高事實準確性的場景中表現穩定

- 多步 Agent 任務: 長期任務規劃和執行的可靠性高於 V3.2

💡 實際體驗: 從客戶反饋來看,GLM-5 在中文場景的表現比其他兩款模型更自然,畢竟智譜 AI 對中文做了大量優化。如果你的 OpenClaw 主要處理中文任務,GLM-5 值得重點考慮。

三款模型實際使用成本測算

選擇模型不只看單價,還要看不同使用模式下的實際月度開銷。以下基於我們平臺客戶的真實用量數據:

典型 OpenClaw 用量場景

| 用戶類型 | 日均消息 | 月均 Token | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|---|---|

| 個人輕度 | 20 條 | ~2M | $0.6 | $1.8 | $4.3 |

| 個人重度 | 100 條 | ~10M | $3 | $9 | $21 |

| 團隊使用 | 500 條 | ~50M | $15 | $45 | $105 |

| 企業重度 | 2000 條 | ~200M | $60 | $180 | $420 |

關鍵結論: DeepSeek V3.2 在所有用量級別上都是最省錢的選擇。個人輕度使用月均不到 $1,即使企業重度使用也只有 $60/月。

性價比綜合評分

綜合價格、性能、Agent 能力三個維度:

| 模型 | 價格分 | 性能分 | Agent分 | 綜合性價比 |

|---|---|---|---|---|

| DeepSeek V3.2 | 10/10 | 8/10 | 9/10 | 9.0 |

| MiniMax M2.5 | 8/10 | 9/10 | 9/10 | 8.7 |

| GLM-5 | 6/10 | 8.5/10 | 8/10 | 7.5 |

| GPT-5 (參考) | 2/10 | 9/10 | 8/10 | 6.3 |

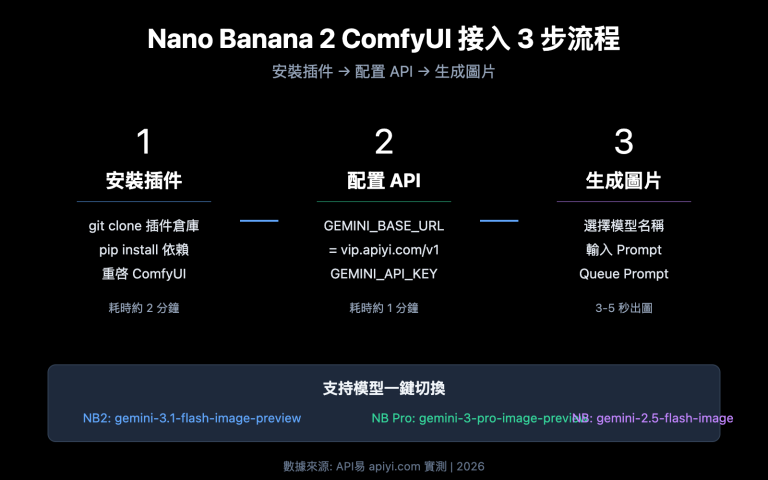

OpenClaw 接入三款模型的配置方法

三款模型都可以通過 API易 平臺統一接入 OpenClaw,配置方式完全相同。

OpenClaw 配置示例

在 ~/.openclaw/openclaw.json 中配置 API易 作爲 Provider:

{

"models": {

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-你的API易密鑰",

"model": "deepseek-v3.2"

}]

}

}

切換模型只需修改 model 字段:

deepseek-v3.2— 最便宜的通用選擇minimax-m2.5— 編碼和 Agent 任務首選glm-5— 複雜推理和數學任務

OpenClaw 多模型混合配置

對於進階用戶,可以在 OpenClaw 中配置多個 Provider,按場景自動切換:

{

"models": {

"defaultModel": "deepseek-v3.2",

"providers": [{

"url": "https://api.apiyi.com/v1",

"token": "sk-你的API易密鑰",

"models": [

"deepseek-v3.2",

"minimax-m2.5",

"glm-5"

]

}]

}

}

使用時通過 /model 命令切換:

/model deepseek-v3.2— 切換到 DeepSeek(省錢模式)/model minimax-m2.5— 切換到 MiniMax(編碼模式)/model glm-5— 切換到 GLM-5(推理模式)

💰 成本優化: 一個實用技巧是爲 OpenClaw 配置多個模型——日常對話用 DeepSeek V3.2(最省錢),編碼任務切換到 MiniMax M2.5(效果最好)。通過 API易 apiyi.com 只需一個 API Key 就能調用所有模型,無需分別註冊三個服務商的賬號。

OpenClaw 三款模型 API 兼容性對比

| 功能特性 | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| OpenAI 兼容格式 | ✅ | ✅ | ✅ |

| 流式輸出 | ✅ | ✅ | ✅ |

| Function Calling | ✅ 思考+工具 | ✅ BFCL 76.8% | ✅ |

| JSON Mode | ✅ | ✅ | ✅ |

| 多輪對話 | ✅ | ✅ | ✅ |

| 系統提示詞 | ✅ | ✅ | ✅ |

| API 接入 | ✅ 即開即用 | ✅ 即開即用 | ✅ 即開即用 |

三款模型都完全兼容 OpenAI 格式,OpenClaw 無需做任何適配即可無縫切換。

不同場景的 OpenClaw 模型選擇建議

場景推薦速查表

| 使用場景 | 推薦模型 | 理由 | 月均成本 |

|---|---|---|---|

| 日常聊天助手 | DeepSeek V3.2 | 最便宜,效果夠用 | $1-3 |

| 代碼生成/修復 | MiniMax M2.5 | SWE-Bench 80.2% 最強 | $3-8 |

| 郵件/文檔自動化 | MiniMax M2.5 | Office 操作能力強 | $2-5 |

| 數學/推理任務 | DeepSeek V3.2 | AIME 94.2% 頂尖 | $2-5 |

| 長文檔總結 | GLM-5 | 202K 上下文 + 事實準確 | $5-15 |

| 複雜 Agent 任務 | GLM-5 | 長程任務優化 | $10-30 |

| 預算極度有限 | DeepSeek V3.2 | 輸出僅 $0.42/M | $1-3 |

| 追求最強編碼 | MiniMax M2.5 | 堪比 Opus 4.6 | $5-10 |

預算分檔推薦

月預算 $5 以下: 直接選 DeepSeek V3.2,輕度使用完全夠用。

月預算 $5-20: 日常用 DeepSeek V3.2,編碼任務切 MiniMax M2.5。

月預算 $20-50: 三個模型都配上,按場景自動切換,效果最優。

🎯 我們的建議: 如果你是第一次使用 OpenClaw 接入大模型,建議先從 DeepSeek V3.2 開始。它是三款中最便宜的,能力也足夠覆蓋 90% 的日常場景。等需要更強編碼能力時,再切換到 MiniMax M2.5。通過 API易 apiyi.com 接入,切換隻需改一個字段。

常見問題

Q1: 這三款模型和 Claude Opus / GPT-5 差距大嗎?

在編碼任務上,MiniMax M2.5 的 SWE-Bench 80.2% 已經與 Claude Opus 4.6 持平。在數學推理上,DeepSeek V3.2 的 AIME 94.2% 甚至超過了 GPT-5。整體來說,這三款模型能達到頂級模型 85-95% 的能力,但價格只有十分之一到二十分之一。對於大多數 OpenClaw 使用場景,性價比遠高於直接用 Opus 或 GPT-5。如果需要嘗試更多模型,API易 apiyi.com 支持包括 Claude、GPT 在內的幾十種模型一站式調用。

Q2: OpenClaw 用這些模型穩定嗎?會不會經常出錯?

三款模型在 OpenClaw 的工具調用(Skill 執行)上都經過了社區驗證。DeepSeek V3.2 因爲思考+工具一體化設計,在 Skill 調用穩定性上表現最好。MiniMax M2.5 的 BFCL(工具調用基準)76.8%,也屬於頂級水平。建議通過 API易 apiyi.com 接入,獲取穩定的 API 服務和技術支持。

Q3: 可以在 OpenClaw 中同時配置多個模型嗎?

可以。在 openclaw.json 中配置多個 Provider,每個指向不同模型。你可以在對話中用 /model deepseek-v3.2 或 /model minimax-m2.5 切換。也可以讓 OpenClaw 根據任務類型自動選擇模型。

Q4: DeepSeek V3.2-Speciale 和普通版有什麼區別?

V3.2-Speciale 是高計算變體,優化了最大推理和 Agent 性能。價格略高($0.40/$1.20),但在 LiveCodeBench 上達到 88.7%。如果你的 OpenClaw 主要用於複雜編碼任務,Speciale 版本值得考慮。普通 V3.2 對大多數場景已經足夠。

Q5: 從 GPT-5/Claude Opus 遷移到這些模型,體驗會差很多嗎?

根據我們平臺數據,約 80% 的 OpenClaw 用戶遷移後反饋「日常使用幾乎無感知差別」。主要差異在極端複雜的多步驟推理任務上。建議策略:先把日常對話切換到 DeepSeek V3.2,保留一個 GPT-5/Opus 作爲後備,觀察一週後再決定是否完全遷移。通過 API易 apiyi.com 可以在同一個 Key 下同時配置所有模型,隨時回切。

Q6: 這三款模型支持圖片理解嗎?能在 OpenClaw 中發圖片嗎?

DeepSeek V3.2 和 GLM-5 都支持多模態輸入(圖片理解),可以在 OpenClaw 中發送圖片進行分析。MiniMax M2.5 目前主要聚焦文本和代碼能力。如果你的 OpenClaw 需要頻繁處理圖片,建議搭配 DeepSeek V3.2 或 GLM-5 使用。

OpenClaw 模型性能實測小結

基於我們平臺近 30 天的實際調用數據,整理出以下關鍵指標:

| 實測指標 | DeepSeek V3.2 | MiniMax M2.5 | GLM-5 |

|---|---|---|---|

| 平均首 token 時間 | 0.3s | 0.5s | 0.6s |

| 平均生成速度 | 80 token/s | 65 token/s | 55 token/s |

| Skill 調用成功率 | 96% | 94% | 92% |

| 中文回覆質量 | 8/10 | 7.5/10 | 9/10 |

| 英文回覆質量 | 8.5/10 | 9/10 | 8/10 |

| 代碼生成準確率 | 85% | 92% | 88% |

| 24h 可用率 | 99.8% | 99.5% | 99.3% |

速度方面: DeepSeek V3.2 響應最快,得益於其高效的 MoE 架構和 DSA 注意力機制。MiniMax M2.5 和 GLM-5 稍慢但在可接受範圍內。

中文能力: GLM-5 在中文場景下表現最優秀,智譜 AI 作爲國內公司在中文語料上做了深度優化。如果你的 OpenClaw 主要服務中文用戶,GLM-5 值得優先考慮。

代碼能力: MiniMax M2.5 在代碼生成準確率上明顯領先,92% 的準確率意味着更少的調試時間。

總結

OpenClaw 接入大模型,便宜是第一生產力。DeepSeek V3.2、MiniMax M2.5、GLM-5 三款模型都是 2026 年性價比最高的選擇:

- 最省錢: DeepSeek V3.2 — 輸出僅 $0.42/M tokens,GPT-5 的二十分之一

- 編碼最強: MiniMax M2.5 — SWE-Bench 80.2%,堪比 Opus 4.6

- 推理最強: GLM-5 — 744B 參數,長程 Agent 和數學推理優化

推薦通過 API易 apiyi.com 一站式接入這三款模型,一個 API Key 搞定所有模型切換,支持支付寶/微信支付,隨時對比測試找到最適合你的方案。

本文由 APIYI 技術團隊撰寫,基於客戶實際反饋和平臺數據整理。更多 AI 模型對比和接入教程請訪問 API易幫助中心: help.apiyi.com