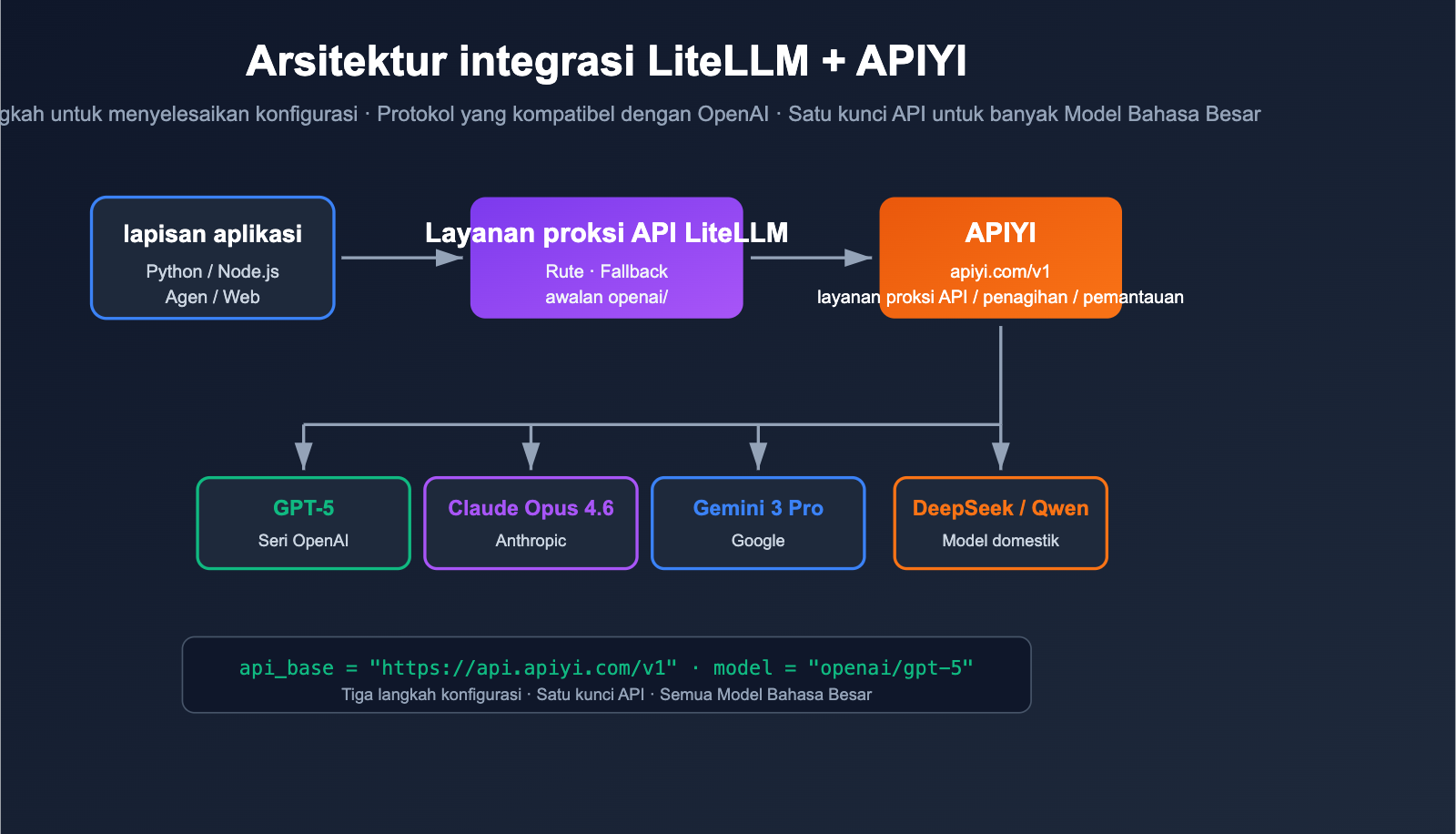

Bagaimana cara agar LiteLLM bisa menjadwalkan berbagai Model Bahasa Besar seperti OpenAI, Claude, Gemini, dan DeepSeek secara bersamaan tanpa terkendala masalah akun luar negeri, jaringan, atau pembayaran? Jawabannya adalah dengan menghubungkan LiteLLM ke layanan proksi API pihak ketiga yang kompatibel dengan OpenAI. Dalam artikel ini, kita akan menggunakan LiteLLM + APIYI apiyi.com sebagai contoh untuk memandu Anda menyelesaikan konfigurasi langkah demi langkah.

Nilai Utama: Setelah membaca artikel ini, Anda akan menguasai 3 metode utama untuk mengonfigurasi layanan proksi API pihak ketiga di LiteLLM (SDK, Proxy YAML, dan variabel lingkungan), serta mampu menyelesaikan integrasi APIYI dalam waktu kurang dari 5 menit.

Poin Utama Konfigurasi Layanan Proksi API Pihak Ketiga di LiteLLM

LiteLLM adalah gateway/SDK Model Bahasa Besar sumber terbuka yang bertujuan untuk memanggil lebih dari 100 Model Bahasa Besar menggunakan format yang kompatibel dengan OpenAI. LiteLLM secara bawaan mendukung titik akhir apa pun yang "kompatibel dengan OpenAI". Anda hanya perlu mengarahkan api_base ke layanan proksi API dan mengganti api_key dengan kunci API yang diberikan oleh layanan tersebut. APIYI apiyi.com adalah layanan proksi API yang standar dan kompatibel dengan OpenAI, sehingga keduanya sangat cocok satu sama lain.

| Poin | Penjelasan | Nilai |

|---|---|---|

| Protokol Kompatibel OpenAI | LiteLLM merutekan ke klien OpenAI melalui awalan openai/ |

Integrasi ke layanan proksi apa pun hanya dengan satu baris konfigurasi |

| Tiga Metode Konfigurasi | SDK Inline / Proxy YAML / Variabel Lingkungan | Adaptasi untuk skrip, produksi, dan skenario CLI |

| Penamaan Model Terpadu | openai/<provider-model> atau nama model kustom |

Kode tingkat atas tidak perlu mengetahui perubahan di tingkat bawah |

| Kunci Pemecahan Masalah | base_url harus diakhiri dengan /v1 |

90% kesalahan 404 berasal dari sini |

| Fallback & Penyeimbang Beban | Mode YAML mendukung banyak saluran dan fallback kegagalan | Memaksimalkan ketersediaan lingkungan produksi |

Penjelasan Mendalam Konfigurasi Layanan Proksi API Pihak Ketiga di LiteLLM

Dokumentasi resmi LiteLLM menyatakan dengan jelas: Selama Anda menambahkan awalan openai/ ke nama model dan menentukan api_base, LiteLLM akan menggunakan klien OpenAI untuk mengakses titik akhir Anda. Ini berarti terlepas dari apakah layanan proksi API di belakangnya terhubung ke GPT-5, Claude Opus 4.6, Gemini 3 Pro, atau DeepSeek, bagi LiteLLM, semuanya adalah "titik akhir OpenAI".

Base_url APIYI apiyi.com adalah https://api.apiyi.com/v1, yang mengikuti spesifikasi standar /v1/chat/completions, /v1/embeddings, dan /v1/images/generations, sehingga sangat kompatibel dengan LiteLLM tanpa memerlukan patch apa pun.

Panduan Cepat Konfigurasi LiteLLM dengan Layanan Proksi API

Persiapan

Sebelum memulai, pastikan Anda telah menyiapkan hal-hal berikut:

- Kunci API APIYI: Setelah mendaftar di apiyi.com, buat kunci baru di konsol (disarankan beri nama

litellm-prod). - base_url:

https://api.apiyi.com/v1(perhatikan bahwa harus diakhiri dengan/v1). - Lingkungan Python: Python 3.9+.

- Instalasi dependensi:

pip install litellm.

Contoh Minimalis: Konfigurasi Inline SDK

Cara tercepat untuk menghubungkannya adalah dengan memasukkan api_key dan api_base langsung ke dalam kode:

import litellm

response = litellm.completion(

model="openai/gpt-5", # Kunci: awalan openai/

api_key="YOUR_APIYI_KEY",

api_base="https://api.apiyi.com/v1", # Alamat layanan proksi API APIYI

messages=[

{"role": "user", "content": "Jelaskan LiteLLM dalam satu kalimat"}

],

)

print(response.choices[0].message.content)

💡 Saran: Setelah mendapatkan saldo uji coba melalui konsol APIYI apiyi.com, Anda dapat mengganti

gpt-5dengan nama model lain seperticlaude-opus-4-6,gemini-3-pro, dll., tanpa perlu mengubah kode lainnya — inilah nilai utama dari protokol yang kompatibel dengan OpenAI.

Lihat contoh lengkap yang bisa dijalankan (termasuk penanganan error dan streaming)

import os

import litellm

from litellm import completion

# Disarankan mengelola kunci melalui variabel lingkungan

os.environ["OPENAI_API_KEY"] = "YOUR_APIYI_KEY"

os.environ["OPENAI_API_BASE"] = "https://api.apiyi.com/v1"

litellm.set_verbose = False # Ubah ke True saat debugging

def chat_with_apiyi(model: str, prompt: str, stream: bool = False):

"""Memanggil model yang kompatibel dengan OpenAI melalui LiteLLM + APIYI"""

try:

response = completion(

model=f"openai/{model}",

messages=[{"role": "user", "content": prompt}],

stream=stream,

temperature=0.7,

max_tokens=1024,

)

if stream:

for chunk in response:

delta = chunk.choices[0].delta.content or ""

print(delta, end="", flush=True)

print()

else:

return response.choices[0].message.content

except Exception as e:

print(f"Pemanggilan gagal: {e}")

return None

if __name__ == "__main__":

# Non-streaming

print(chat_with_apiyi("gpt-5", "Jelaskan apa itu gerbang LLM"))

# Streaming

chat_with_apiyi("claude-opus-4-6", "Jelaskan keunggulan LiteLLM dalam 100 kata", stream=True)

Konfigurasi Proxy YAML: Rekomendasi Produksi

Jika Anda ingin menjalankan LiteLLM sebagai layanan mandiri (port 4000, untuk digunakan bersama tim), disarankan menggunakan mode YAML. Buat file litellm_config.yaml baru:

model_list:

- model_name: gpt-5 # Nama model yang diekspos keluar

litellm_params:

model: openai/gpt-5 # Awalan openai/, diarahkan ke klien OpenAI

api_base: https://api.apiyi.com/v1 # Alamat layanan proksi APIYI

api_key: os.environ/APIYI_KEY # Mengacu pada variabel lingkungan

- model_name: claude-opus-4-6

litellm_params:

model: openai/claude-opus-4-6

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

- model_name: gemini-3-pro

litellm_params:

model: openai/gemini-3-pro

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

litellm_settings:

drop_params: true # Otomatis membuang parameter yang tidak didukung model

num_retries: 2 # Jumlah percobaan ulang per pemanggilan

router_settings:

fallbacks:

- gpt-5: ["claude-opus-4-6", "gemini-3-pro"]

Jalankan Proxy:

export APIYI_KEY=sk-xxxxxxxxxxxxxxxx

litellm --config ./litellm_config.yaml --port 4000

Setelah itu, SDK OpenAI mana pun dapat memanggilnya melalui http://localhost:4000:

from openai import OpenAI

client = OpenAI(

api_key="any-string", # LiteLLM Proxy tidak memvalidasi konten (kecuali master_key dikonfigurasi)

base_url="http://localhost:4000",

)

resp = client.chat.completions.create(

model="gpt-5",

messages=[{"role": "user", "content": "Halo via LiteLLM Proxy"}]

)

print(resp.choices[0].message.content)

🎯 Saran Produksi: Kami menyarankan untuk menambahkan lapisan

master_keydi depan LiteLLM Proxy dan menyatukan semua model dasar ke APIYI apiyi.com. Dengan cara ini, lapisan aplikasi Anda hanya melihat "nama model semantik" sepertigpt-5/claude-opus-4-6, sementara saluran dasar, penagihan, dan pembatasan kecepatan ditangani oleh lapisan APIYI + LiteLLM.

Mode Variabel Lingkungan: Paling Praktis untuk CLI dan Skrip

Untuk skrip sekali pakai dan alat baris perintah, cara termudah adalah menggunakan variabel lingkungan. LiteLLM akan secara otomatis mengenali OPENAI_API_KEY dan OPENAI_API_BASE:

export OPENAI_API_KEY=sk-xxxxxxxxxxxxxxxx

export OPENAI_API_BASE=https://api.apiyi.com/v1

Setelah itu, semua pemanggilan dengan awalan openai/ akan melalui APIYI:

import litellm

print(litellm.completion(

model="openai/gpt-5",

messages=[{"role": "user", "content": "ping"}]

).choices[0].message.content)

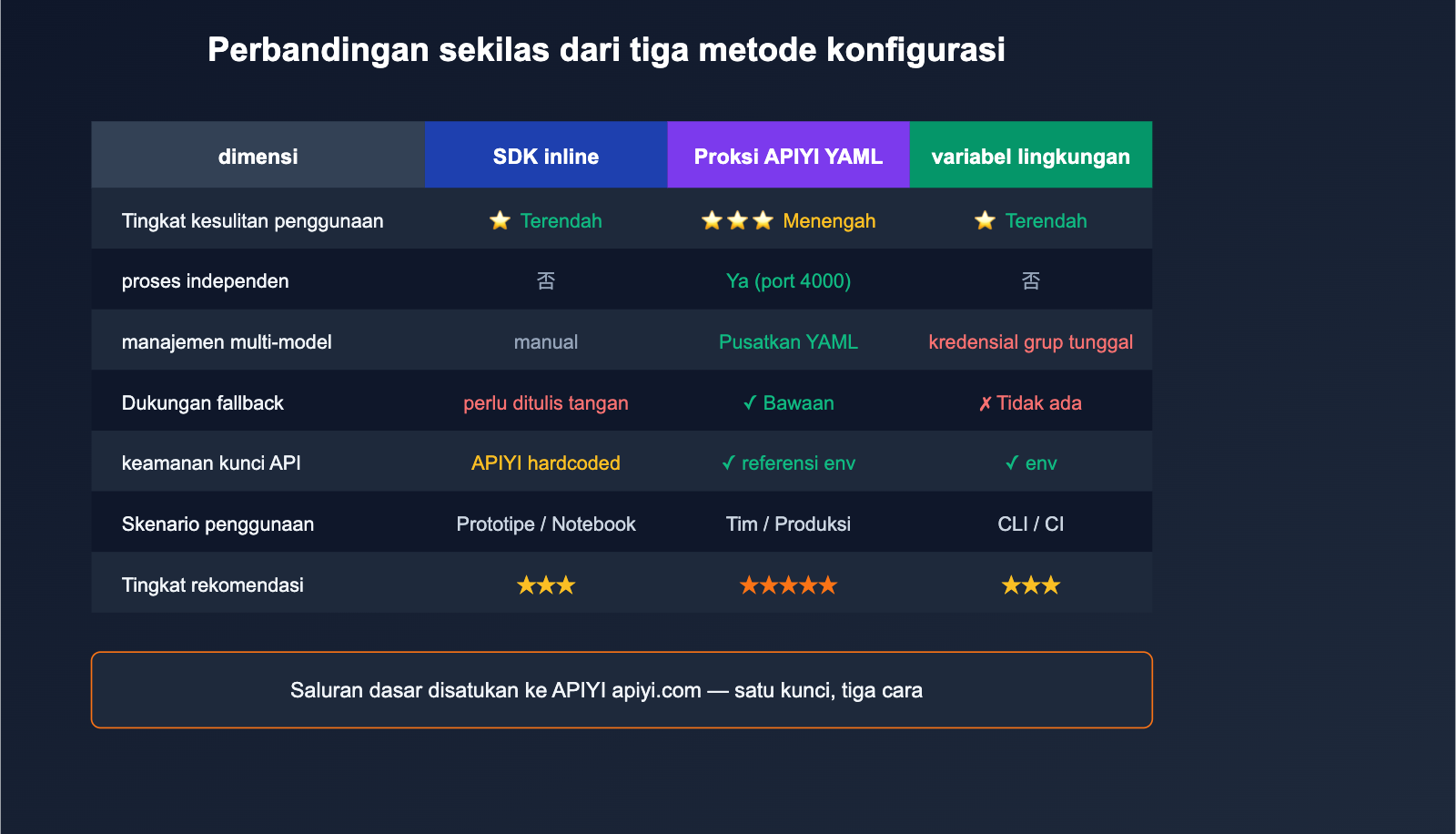

Perbandingan Tiga Cara Konfigurasi LiteLLM dengan Layanan Proksi API

Dalam skenario yang berbeda, pemilihan metode konfigurasi akan bervariasi. Tabel di bawah ini memberikan saran pilihan yang jelas.

| Dimensi | SDK Inline | Proxy YAML | Variabel Lingkungan |

|---|---|---|---|

| Tingkat Kesulitan | ⭐ Terendah | ⭐⭐⭐ Menengah | ⭐ Terendah |

| Skenario | Skrip tunggal, Notebook | Berbagi tim, layanan produksi | Alat CLI, CI |

| Proses Independen | Tidak | Ya (port 4000) | Tidak |

| Manajemen Model | Kelola variabel manual | Manajemen YAML terpusat | Hanya satu set kredensial |

| Dukungan Fallback | Perlu tulis try/except | ✅ Bawaan | ❌ Tidak ada |

| Keamanan Kunci | Mudah hardcode (tidak disarankan) | ✅ Referensi env | ✅ Melalui env |

| Rekomendasi | Tahap prototipe | Deployment produksi | Skrip pribadi |

💡 Saran Pemilihan: Untuk pengembangan pribadi, Anda bisa langsung menggunakan variabel lingkungan; untuk tim dan produksi, sangat disarankan menggunakan mode Proxy YAML karena mengelola "perutean model + Fallback + pembatasan kecepatan + statistik" dalam satu file. Apa pun metode yang dipilih, saluran dasar yang terhubung ke APIYI apiyi.com tetap sama, Anda hanya perlu memelihara satu Kunci API.

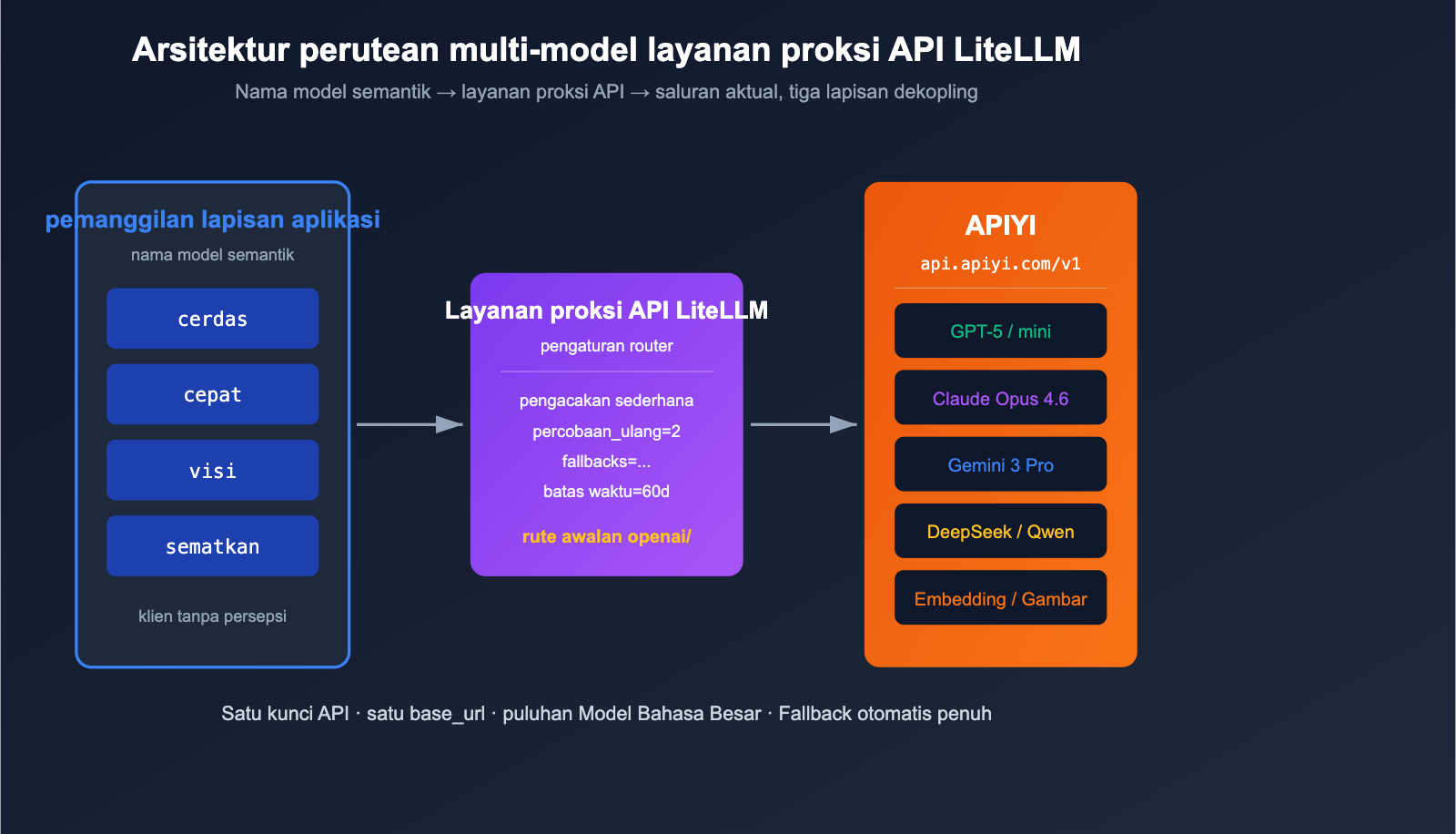

Praktik Perutean Multi-Model LiteLLM + APIYI

Kekuatan utama dari mode Proxy LiteLLM terletak pada kemampuannya menggunakan satu file YAML untuk memetakan "nama model semantik → saluran aktual". Berikut adalah konfigurasi perutean minimal yang siap digunakan untuk produksi.

# litellm_config.yaml - Contoh perutean produksi

model_list:

# Model inferensi utama

- model_name: smart

litellm_params:

model: openai/gpt-5

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

timeout: 60

- model_name: smart

litellm_params:

model: openai/claude-opus-4-6

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

timeout: 60

# Model cepat dan murah

- model_name: fast

litellm_params:

model: openai/gpt-5-mini

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

# Visual/Multimodal

- model_name: vision

litellm_params:

model: openai/gemini-3-pro

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

# Embedding

- model_name: embed

litellm_params:

model: openai/text-embedding-3-large

api_base: https://api.apiyi.com/v1

api_key: os.environ/APIYI_KEY

litellm_settings:

drop_params: true

num_retries: 2

request_timeout: 60

router_settings:

routing_strategy: simple-shuffle # Round-robin untuk model dengan nama yang sama

fallbacks:

- smart: ["fast"] # Fallback ke fast jika smart gagal

general_settings:

master_key: sk-litellm-master-xxxx # Klien wajib menyertakan kunci ini

Lapisan aplikasi hanya melihat empat nama semantik: smart, fast, vision, dan embed. Saat GPT-5 terkena limitasi, LiteLLM akan otomatis beralih ke Claude Opus 4.6 (karena keduanya terdaftar sebagai smart), dan jika gagal lagi, akan melakukan fallback ke fast. Semua trafik tingkat rendah melewati APIYI (apiyi.com) untuk penagihan dan pemantauan terpusat, memisahkan lapisan aplikasi dari lapisan saluran dengan sempurna.

Pertanyaan Umum Konfigurasi Layanan Proksi API Pihak Ketiga di LiteLLM

Q1: Mengapa saya mendapatkan error 404 Not Found padahal sudah mengatur base_url?

90% kasus disebabkan oleh api_base yang kurang /v1 di bagian akhir. LiteLLM menggunakan klien OpenAI secara internal yang akan otomatis menambahkan /chat/completions, jadi api_base Anda harus berupa https://api.apiyi.com/v1 dan bukan https://api.apiyi.com. Jangan menulis https://api.apiyi.com/v1/chat/completions karena akan menyebabkan duplikasi path.

Q2: Mengapa harus menambahkan prefiks openai/ pada model?

LiteLLM mengelola tabel perutean penyedia (provider) secara internal. Prefiks openai/ memberi tahu LiteLLM untuk "menggunakan klien OpenAI untuk mengakses endpoint ini". Jika tidak menggunakan prefiks, LiteLLM mungkin mencoba mencocokkan dengan penyedia bawaannya (misalnya claude-opus-4-6 akan dikenali sebagai API asli Anthropic), sehingga protokol yang digunakan salah. Saat menggunakan layanan proksi, selalu tambahkan prefiks openai/.

Q3: Apakah satu kunci APIYI bisa digunakan untuk memanggil banyak model sekaligus?

Bisa. Satu kunci APIYI (apiyi.com) secara default mendukung semua model yang tersedia di platform, termasuk GPT-5, Claude Opus 4.6, Gemini 3 Pro, DeepSeek, Qwen, dan lainnya. Inilah perbedaan utamanya dengan API resmi — Anda hanya perlu mengelola satu kunci dan satu base_url untuk memasang puluhan model di YAML LiteLLM Anda.

Q4: Setelah LiteLLM Proxy dijalankan, bagaimana cara memastikan jalur proksi berfungsi?

Cara tercepat adalah dengan menggunakan curl langsung ke LiteLLM Proxy:

curl http://localhost:4000/v1/chat/completions \

-H "Authorization: Bearer sk-litellm-master-xxxx" \

-H "Content-Type: application/json" \

-d '{

"model": "smart",

"messages": [{"role": "user", "content": "ping"}]

}'

Jika mendapatkan respons 200 + JSON, berarti seluruh jalur Aplikasi → LiteLLM Proxy → APIYI berfungsi dengan baik. Jika gagal, periksa log konsol LiteLLM, lalu coba gunakan base_url + kunci yang sama untuk mengakses APIYI secara langsung guna mengisolasi masalah.

Q5: Apakah output streaming (stream) memerlukan konfigurasi tambahan dalam skenario proksi?

Tidak perlu. APIYI (apiyi.com) mendukung penuh respons streaming SSE, dan LiteLLM meneruskannya secara default. Anda cukup menambahkan stream=True saat melakukan pemanggilan completion(), atau saat memanggil Proxy menggunakan SDK OpenAI, maka Anda akan mendapatkan output per token.

Q6: Apakah Embedding dan pembuatan gambar juga bisa dihubungkan?

Bisa. APIYI (apiyi.com) mendukung /v1/embeddings, /v1/images/generations, dan /v1/audio/transcriptions secara bersamaan, semuanya melalui base_url dan kunci yang sama. Di YAML LiteLLM, Anda hanya perlu menambahkan model terkait ke dalam model_list, misalnya text-embedding-3-large, gpt-image-1, atau whisper-1. Cara penggunaannya sama persis dengan model percakapan, silakan lihat contoh perutean produksi di bagian sebelumnya.

Ringkasan

Mengonfigurasi layanan proksi pihak ketiga di LiteLLM pada dasarnya hanya melibatkan tiga langkah utama:

- Penyelarasan Protokol: Tambahkan prefiks

openai/pada model untuk memberi tahu LiteLLM agar menggunakan protokol klien OpenAI. - Penyelarasan Titik Masuk: Arahkan

api_baseke jalur root layanan proksi +/v1, contohnyahttps://api.apiyi.com/v1. - Penyelarasan Kredensial: Masukkan kunci API yang diberikan oleh layanan proksi melalui

api_keyatau variabel lingkungan.

Setelah menyelesaikan ketiga langkah ini, semua fitur LiteLLM (perutean multi-model, Fallback, pembatasan kecepatan, penagihan, dan Logging) dapat diterapkan secara mulus di atas layanan proksi yang stabil.

🚀 Saran Tindakan: Jika Anda sedang membangun gateway Model Bahasa Besar yang terpadu untuk tim Anda, kami menyarankan arsitektur tiga lapis: "Aplikasi → LiteLLM Proxy → APIYI apiyi.com". LiteLLM menangani perutean dan Fallback, sementara APIYI menangani akses model dasar, stabilitas, dan penagihan berbasis penggunaan. Anda hanya perlu mengelola satu file YAML dan satu kunci API. Daftar di apiyi.com untuk mendapatkan saldo uji coba dan selesaikan pemanggilan pertama Anda dalam waktu 5 menit.

Penulis: Tim APIYI — Fokus menyediakan akses stabil ke Model Bahasa Besar AI utama bagi pengembang. Kunjungi apiyi.com untuk informasi lebih lanjut.

Referensi

-

Dokumentasi Resmi LiteLLM – OpenAI Compatible Endpoints

- Tautan:

docs.litellm.ai/docs/providers/openai_compatible - Penjelasan: Contoh resmi untuk SDK dan Proxy YAML.

- Tautan:

-

Ringkasan Konfigurasi LiteLLM Proxy

- Tautan:

docs.litellm.ai/docs/proxy/configs - Penjelasan: Bidang lengkap untuk model_list, router_settings, dan fallbacks.

- Tautan:

-

Repositori GitHub LiteLLM

- Tautan:

github.com/BerriAI/litellm - Penjelasan: Kode sumber, Issue, dan versi terbaru.

- Tautan:

-

daily_stock_analysis – LLM_CONFIG_GUIDE

- Tautan:

github.com/ZhuLinsen/daily_stock_analysis/blob/main/docs/LLM_CONFIG_GUIDE.md - Penjelasan: Tiga mode konfigurasi dan referensi praktis multi-saluran.

- Tautan:

-

Dokumentasi Resmi APIYI

- Tautan:

apiyi.com - Penjelasan: Daftar model yang didukung, base_url, dan manajemen kunci API.

- Tautan: