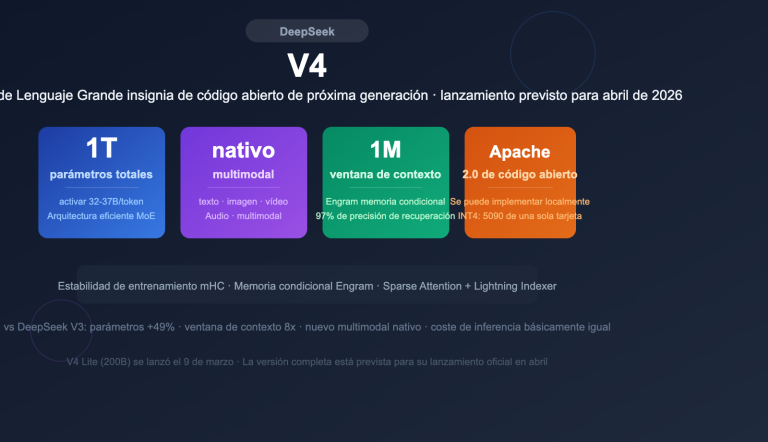

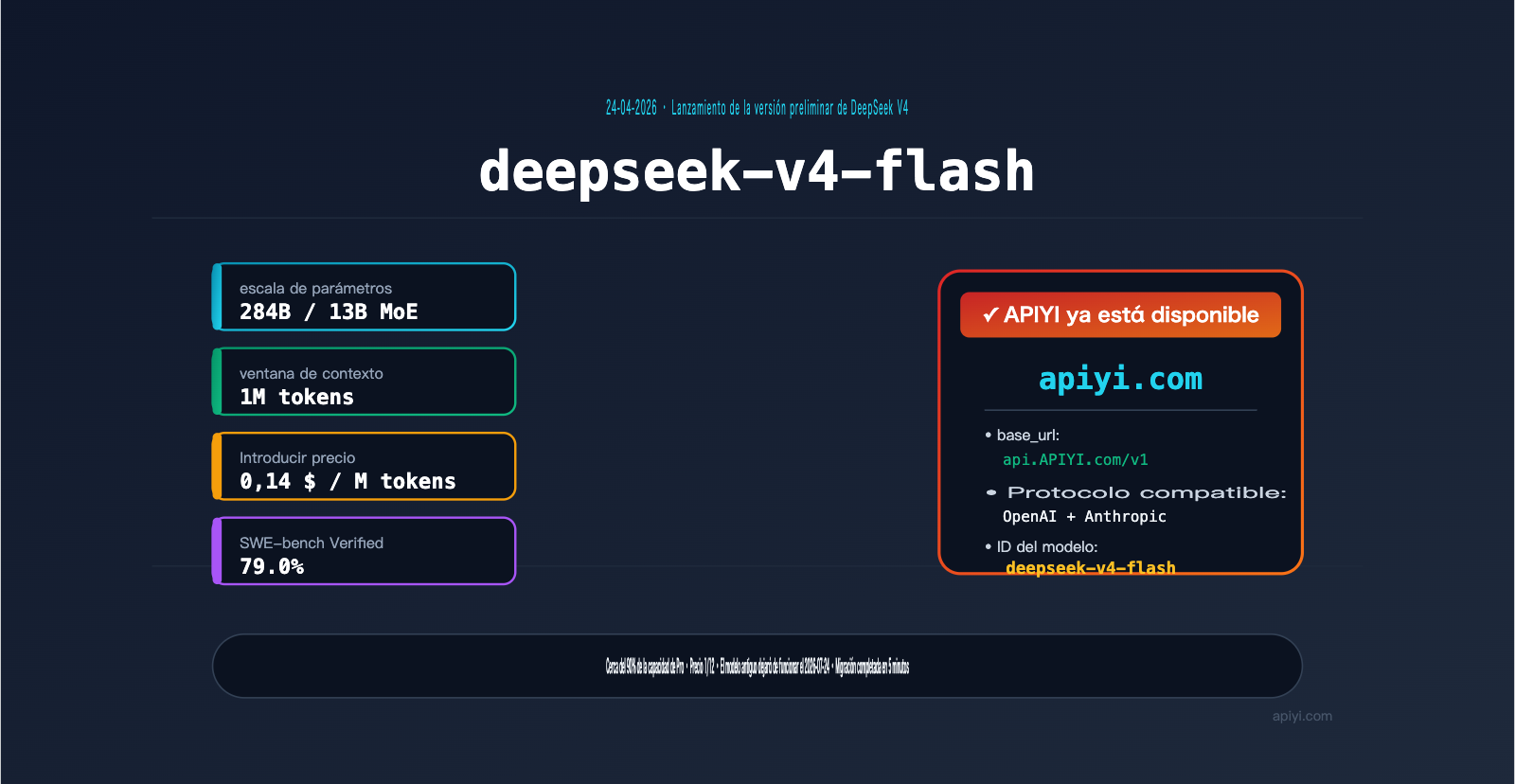

El 24-04-2026, DeepSeek lanzó en código abierto en Hugging Face dos modelos de vista previa: V4-Pro y V4-Flash. El primero es un gigante MoE de 1.6T de parámetros orientado al rendimiento de vanguardia, mientras que el segundo es una opción equilibrada con "cerca del 90% de la capacidad de Pro, pero a 1/12 del precio".

Si solo vas a probar un modelo, elige deepseek-v4-flash. La razón es sencilla:

- Arquitectura MoE de 284B / 13B + Hybrid Attention, con un consumo de FLOPs en inferencia de 1M de contexto que es solo el 27% del de V3.2.

- 1M de tokens de contexto / 384K de tokens de salida máxima, procesa textos largos de forma nativa sin necesidad de fragmentación (chunking).

- $0.14 por entrada / $0.28 por salida por cada millón de tokens, un orden de magnitud más barato que el modelo Pro.

- 79.0% en SWE-bench Verified, 45–47 en el índice de inteligencia de Artificial Analysis, suficiente para la gran mayoría de escenarios.

- Compatible simultáneamente con los protocolos OpenAI ChatCompletions y Anthropic API, funciona sin modificaciones en Claude Code, OpenClaw y OpenCode.

Un punto aún más importante: los modelos antiguos deepseek-chat y deepseek-reasoner dejarán de funcionar oficialmente el 24-07-2026. Todos los servicios en línea deben completarse su migración antes de esa fecha. Es una cuenta regresiva estricta de 90 días.

La buena noticia es que: deepseek-v4-flash ya está disponible en APIYI (apiyi.com). No necesitas crear una cuenta de DeepSeek, no necesitas cambiar tu SDK, ni gestionar pagos internacionales; simplemente cambia el campo model y apunta el base_url a api.apiyi.com para empezar a usarlo.

Este artículo es una guía 3+5: 3 minutos para entender las mejoras clave de V4-Flash + 5 minutos para completar la migración desde los modelos antiguos.

I. Las 5 mejoras clave de deepseek-v4-flash

1.1 Tabla de especificaciones principales

Primero, veamos el panorama general antes de entrar en detalles:

| Dimensión | deepseek-v4-flash |

|---|---|

| Fecha de lanzamiento | 24-04-2026 (versión preliminar) |

| Repositorio | huggingface.co/deepseek-ai/DeepSeek-V4-Flash |

| Parámetros totales | 284B (Mixture of Experts) |

| Parámetros activos | 13B |

| Ventana de contexto | 1M tokens |

| Salida máxima | 384K tokens |

| Arquitectura de atención | Hybrid Attention (CSA + HCA) |

| Modo de inferencia | Modo dual Thinking / Non-Thinking |

| Function Calling | ✅ Compatible |

| Modo JSON | ✅ Compatible |

| Chat Prefix Completion | Soporte Beta |

| Protocolo API | Compatible con OpenAI ChatCompletions + Anthropic |

| Precio de entrada | $0.14 / M tokens |

| Precio de salida | $0.28 / M tokens |

A continuación, desglosamos estas 5 mejoras.

1.2 Mejora 1: 1M de contexto + 384K de salida (Ultra largo nativo)

deepseek-v4-flash admite de forma nativa 1M de tokens de entrada y 384K de tokens de salida. Esta es la especificación unificada para toda la serie V4; Flash no ha reducido el contexto para abaratar costos.

¿Qué tipo de contenido puede procesar 1M?

| Tipo de contenido | Cantidad aproximada de tokens |

|---|---|

| Manuscrito de 100,000 caracteres chinos | ≈ 150K tokens |

| Documento técnico PDF de 200 páginas | ≈ 300K tokens |

| Repositorio de código mediano (~50 archivos) | ≈ 500K–800K tokens |

| El libro completo "Sueño en el pabellón rojo" | ≈ 1M tokens |

En comparación con GPT-5.4 (400K), Claude Opus 4.6 (1M + paquete de contexto de 1M) y Gemini 3.1-Pro (2M), el 1M de V4-Flash ya es la configuración estándar de la industria, y su precio es de 5 a 20 veces menor que los tres anteriores.

1.3 Mejora 2: 284B/13B MoE + Hybrid Attention

V4-Flash utiliza dos innovaciones arquitectónicas clave introducidas por DeepSeek en 2026:

- MoE: 284B de parámetros totales, solo 13B activados por token. El efecto es similar al de un modelo denso de 13B, pero con un alcance de conocimiento cercano a uno de más de 200B.

- Hybrid Attention (Atención dispersa comprimida CSA + Atención altamente comprimida HCA): diseñado específicamente para contextos largos.

Datos de eficiencia (de la fuente oficial de DeepSeek):

| Indicador | V3.2 | V4-Flash | Mejora |

|---|---|---|---|

| FLOPs de inferencia por token en contexto de 1M | 100% | 27% | -73% |

| Uso de caché KV en contexto de 1M | 100% | 10% | -90% |

Estos dos grupos de números explican por qué Flash puede reducir el precio a $0.14: los costos de computación subyacentes realmente han disminuido, no es solo un subsidio agresivo.

1.4 Mejora 3: Modo dual Thinking / Non-Thinking

V4-Flash permite cambiar entre dos modos con el mismo ID de modelo:

- Non-Thinking (predeterminado): rápido, ideal para chats, preguntas y respuestas, clasificación y resúmenes.

- Thinking: el modelo genera primero un razonamiento interno (similar a la serie o de OpenAI) antes de dar la respuesta final. Ideal para razonamientos complejos, llamadas a herramientas de varios pasos y depuración de código.

El cambio se realiza mediante parámetros de solicitud (no son IDs de modelo distintos), por lo que el cambio del lado del desarrollador es mínimo. Al realizar la llamada en APIYI api.apiyi.com, el nombre de este parámetro es exactamente igual al oficial de DeepSeek.

1.5 Mejora 4: $0.14 / $0.28 por cada millón de tokens

Esta es la cifra más sorprendente de este lanzamiento:

| Modelo | Entrada ($/M) | Salida ($/M) | Relativo a V4-Flash |

|---|---|---|---|

| deepseek-v4-flash | 0.14 | 0.28 | 1× (base) |

| deepseek-v4-pro | 1.74 | 3.48 | 12× |

| GPT-5.4 (referencia) | 2.50 | 10.00 | 17×–35× |

| Claude Sonnet 4.6 (referencia) | 3.00 | 15.00 | 21×–53× |

Para una solicitud típica de "500 tokens de entrada + 500 tokens de salida":

- V4-Flash: $0.000 21

- GPT-5.4: $0.006 25

- Claude Sonnet 4.6: $0.009

Flash es entre 30 y 40 veces más barato. Para productos con un volumen mensual de cientos de millones de tokens, esto determina directamente el margen bruto.

1.6 Mejora 5: Compatibilidad con protocolo dual OpenAI + Anthropic

V4-Flash implementa dos conjuntos de protocolos en la capa de API:

POST /v1/chat/completions→ Formato OpenAIPOST /v1/messages→ Formato Anthropic

Esto significa:

| Cliente | Costo de migración |

|---|---|

| SDK de Python/Node de OpenAI | Cero cambios, solo actualizar base_url y model |

| SDK de Python/Node de Anthropic | Cero cambios, solo actualizar base_url y model |

| Claude Code | Solo cambiar el endpoint de Anthropic |

| OpenClaw / OpenCode | Soporte nativo |

| LangChain / LlamaIndex | Solo cambiar la base_url |

Esta es una decisión muy inteligente de DeepSeek en esta versión: no obligar a aprender un nuevo protocolo, permitiendo que el ecosistema existente se integre sin costos.

1.7 Tabla comparativa de Benchmarks

| Benchmark | V4-Flash | V4-Pro | Diferencia |

|---|---|---|---|

| SWE-bench Verified (corrección de código) | 79.0% | 82.1% | -3.1 |

| Terminal-Bench 2.0 (uso de herramientas) | 56.9% | 67.9% | -11.0 |

| SimpleQA-Verified (recuperación de hechos) | 34.1% | 57.9% | -23.8 |

| Artificial Analysis Intelligence Index | 45 / 47 | 58 | -11 ~ -13 |

Interpretación: Flash casi iguala a Pro en tareas de código de un solo paso (SWE-bench), pero la diferencia es notable en tareas que requieren cadenas de herramientas de varios pasos (Terminal-Bench) y memoria de hechos (SimpleQA). Estas diferencias son la base para decidir si elegir Flash o Pro.

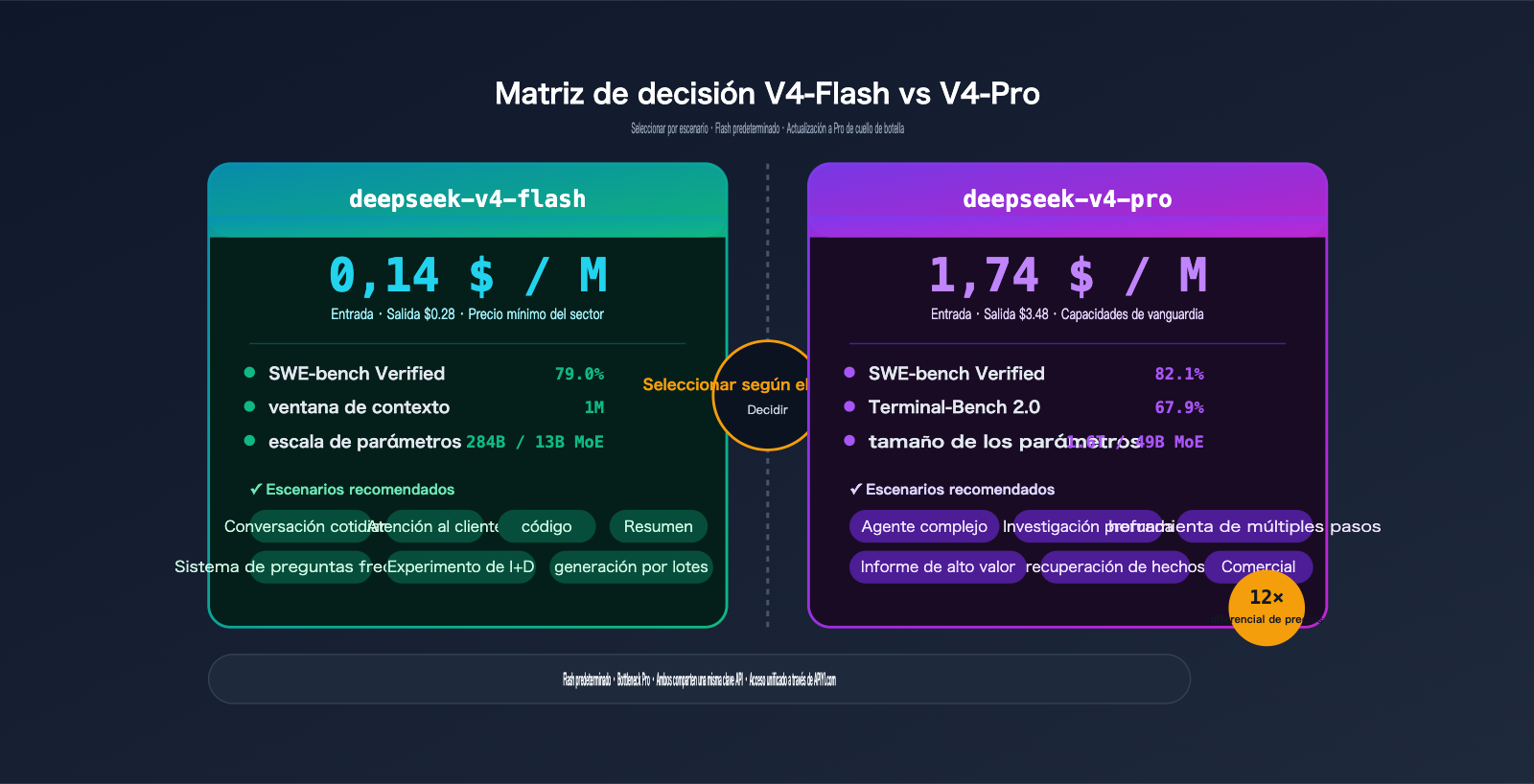

二、Análisis de escenarios: deepseek-v4-flash vs V4-Pro

2.1 Matriz de decisión: un vistazo rápido

| Escenario | Recomendación | Motivo |

|---|---|---|

| Conversación diaria, chat, preguntas | Flash | Capacidad suficiente, precio 1/12 |

| Chatbots de atención al cliente, FAQ | Flash | Alto rendimiento, baja latencia |

| Autocompletado de código, edición de archivos | Flash | 79% en SWE-bench, cerca del Pro |

| Resumen de documentos largos, lectura | Flash | Ventana de contexto de 1M completa |

| Agentes con cadenas de herramientas | Pro | Diferencia de 11 puntos en Terminal-Bench |

| Investigación profunda, verificación | Pro | Diferencia de 24 puntos en SimpleQA |

| Informes comerciales de alto valor | Pro | Índice de inteligencia superior en 11+ |

| Experimentación / I+D | Flash | 12 veces más barato, iteración rápida |

Regla general: Usa Flash por defecto y escala a Pro solo si encuentras cuellos de botella. Esto sigue el principio de selección técnica de "empezar con la solución sencilla y escalar solo cuando sea necesario".

2.2 Cálculo de rentabilidad: ¿cuándo ahorra más Flash?

Supongamos que tu producto consume 100 millones de tokens diarios (60M entrada + 40M salida):

| Modelo | Coste diario | Coste mensual | Coste anual |

|---|---|---|---|

| V4-Flash | $19.6 | $588 | $7 056 |

| V4-Pro | $243.6 | $7 308 | $87 696 |

| GPT-5.4 (Ref) | $550 | $16 500 | $198 000 |

Flash ahorra más de $80K al año frente a Pro. Ese dinero es suficiente para financiar a medio desarrollador adicional.

2.3 Enrutamiento híbrido: mejores prácticas en producción

Para la mayoría de los productos, la mejor solución no es elegir uno u otro, sino enrutar dinámicamente según el tipo de solicitud:

def route_model(request_type: str) -> str:

if request_type in ("chat", "faq", "summarize", "classify"):

return "deepseek-v4-flash"

if request_type in ("deep_research", "multi_step_agent"):

return "deepseek-v4-pro"

return "deepseek-v4-flash" # Flash por defecto

🎯 Consejo de implementación: Te recomendamos mantener permisos de invocación del modelo tanto para V4-Flash como para V4-Pro en la plataforma APIYI (apiyi.com). Ambos comparten la misma clave API; solo necesitas cambiar el campo

modelpara alternar entre ellos. Para tareas por lotes, recomendamos usar la línea de alta concurrenciavip.apiyi.com, mientras que para tareas complejas del Pro, usa el sitio principalapi.apiyi.com. Puedes gestionar la distribución de tráfico AB en una misma configuración.

III. 5 minutos para invocar deepseek-v4-flash en APIYI apiyi.com

3.1 Paso 1: Entorno previo y obtención de la clave

| Ítem | Requisito |

|---|---|

| Python o Node.js | Python 3.8+ / Node.js 18+ |

| SDK del cliente | OpenAI Python openai >= 1.0 o SDK oficial de Node |

| Red | Acceso a api.apiyi.com |

| Clave | Generada en el panel de control de APIYI apiyi.com, comienza con sk- |

Obtención de la clave:

- Visita

apiyi.com, regístrate/inicia sesión y accede al panel de control. - Menú lateral → API Keys → Crear nueva clave.

- Se recomienda establecer un "límite de uso" de ¥50–100 para la verificación inicial.

- Copia la cadena de la clave que comienza con

sk-.

3.2 Paso 2: Selección de ruta (base_url)

APIYI ofrece tres rutas que comparten la misma clave:

| base_url | Posicionamiento | Escenario recomendado |

|---|---|---|

https://api.apiyi.com/v1 |

Sitio principal | Predeterminado, uso diario |

https://vip.apiyi.com/v1 |

Alta concurrencia | Generación/inferencia por lotes, colas nocturnas |

https://b.apiyi.com/v1 |

Respaldo | Fallback automático si el sitio principal fluctúa |

Para el desarrollo diario basta con el sitio principal; si en producción encuentras límites 429 o inestabilidad 5xx, cambia a VIP o respaldo.

3.3 Paso 3: Ejemplo mínimo de invocación en Python (Sin razonamiento)

from openai import OpenAI

client = OpenAI(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com/v1",

)

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "system", "content": "Eres un asistente conciso"},

{"role": "user", "content": "Resume las mejoras clave de DeepSeek V4-Flash en tres puntos"},

],

max_tokens=512,

)

print(resp.choices[0].message.content)

Solo hay dos cambios:

base_urlapunta aapi.apiyi.commodelse cambia adeepseek-v4-flash

El resto del código del SDK de OpenAI se mantiene igual.

3.4 Paso 4: Habilitar el modo de razonamiento (Thinking)

Cuando necesites razonamiento profundo, añade el parámetro reasoning en la solicitud:

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "user", "content": "Demuestra: dados n puntos, ¿cuántas líneas rectas se necesitan como mínimo para cubrir todos los pares de puntos?"},

],

extra_body={

"reasoning": {"enabled": True, "effort": "high"},

},

max_tokens=8192,

)

# La respuesta incluirá el campo reasoning_content

print("Proceso de pensamiento:", resp.choices[0].message.reasoning_content)

print("Respuesta final:", resp.choices[0].message.content)

En el modo de razonamiento, el tiempo de respuesta aumenta de 2 a 5 veces (según la complejidad), pero la precisión en problemas de código/matemáticas aumenta significativamente.

3.5 Paso 5: Ejemplo mínimo de invocación en Node.js

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_API_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const resp = await client.chat.completions.create({

model: "deepseek-v4-flash",

messages: [

{ role: "user", content: "Escribe un haiku sobre la IA en 2026" },

],

max_tokens: 256,

});

console.log(resp.choices[0].message.content);

3.6 Paso 6: Ejemplo de Function Calling

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Obtener el clima actual de una ciudad",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"],

},

},

}]

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[{"role": "user", "content": "¿Cómo está el clima hoy en Shanghái?"}],

tools=tools,

)

print(resp.choices[0].message.tool_calls)

V4-Flash es muy estable en escenarios de una sola llamada a herramienta. Para cadenas de herramientas complejas de varios pasos (más de 5), se recomienda actualizar a V4-Pro.

3.7 Paso 7: Invocación mediante protocolo Anthropic

Si tu proyecto está desarrollado basado en el SDK de Anthropic (por ejemplo, integrado con Claude Code), también puedes usarlo:

from anthropic import Anthropic

client = Anthropic(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com",

)

resp = client.messages.create(

model="deepseek-v4-flash",

max_tokens=1024,

messages=[{"role": "user", "content": "Hola"}],

)

print(resp.content[0].text)

🎯 Consejo de doble protocolo: Para el mismo modelo deepseek-v4-flash, el protocolo OpenAI utiliza

api.apiyi.com/v1, mientras que el protocolo Anthropic utilizaapi.apiyi.com(sin/v1). Al cambiar, solo ajusta el campo base_url. Para más detalles sobre protocolos, consulta la sección de DeepSeek en la documentación oficial de APIYIdocs.apiyi.com.

IV. Ruta completa de migración de modelos antiguos a deepseek-v4-flash

4.1 Por qué debes migrar: Cuenta regresiva de 90 días

El anuncio oficial de DeepSeek es claro:

Los modelos heredados

deepseek-chatydeepseek-reasonerse retirarán el 24 de julio de 2026.

Por favor, actualiza tu modelo adeepseek-v4-proodeepseek-v4-flash.

Después del 24-07-2026, las solicitudes que sigan utilizando el ID de modelo antiguo devolverán un error directamente. Desde la fecha de lanzamiento, el 24-04-2026, hay un período de gracia total de 90 días.

4.2 Tabla de decisión de migración

Según el modelo que utilices actualmente, este es el nuevo modelo correspondiente:

| ID de modelo antiguo | ID de modelo nuevo | Dificultad de migración |

|---|---|---|

deepseek-chat |

deepseek-v4-flash (modo sin razonamiento) |

⭐ Cambiar 1 campo |

deepseek-reasoner |

deepseek-v4-flash + modo razonamiento |

⭐⭐ Cambiar modelo + añadir parámetro reasoning |

deepseek-reasoner (alto valor) |

deepseek-v4-pro + modo razonamiento |

⭐⭐ Cambiar modelo + añadir parámetro reasoning |

deepseek-v3.x |

deepseek-v4-flash |

⭐ Cambiar modelo |

deepseek-coder y otros |

deepseek-v4-flash |

⭐ Cambiar modelo (capacidad general cubierta) |

4.3 Diferencia de código: Casi cero cambios

Antes de la migración:

resp = client.chat.completions.create(

model="deepseek-chat", # ← Modelo antiguo

messages=[...],

)

Después de la migración:

resp = client.chat.completions.create(

model="deepseek-v4-flash", # ← Cambia esta línea

messages=[...],

)

Si también necesitas migrar desde deepseek-reasoner:

resp = client.chat.completions.create(

- model="deepseek-reasoner",

+ model="deepseek-v4-flash",

messages=[...],

+ extra_body={"reasoning": {"enabled": True}},

)

4.4 Lista de verificación de migración

Se recomienda seguir esta lista antes de migrar:

- Revisar todas las ubicaciones donde

model=está codificado en el código. - Evaluar si la invocación de

deepseek-reasonernecesita actualizarse a V4-Pro. - Preparar un conjunto de prompts de prueba de regresión (20–50, cubriendo el negocio principal).

- Reducir temporalmente el límite diario de las solicitudes antiguas en el panel de control de APIYI

apiyi.compara forzar la migración. - Ejecutar los modelos antiguo y nuevo en AB durante 1 semana para comparar la calidad de salida.

- Monitorear la curva de consumo de tokens para confirmar que los costos no hayan aumentado inesperadamente.

- Actualizar la documentación interna y el Runbook.

4.5 Sugerencias para el lanzamiento gradual

En 3 fases:

| Fase | Tráfico | Período | Objetivo |

|---|---|---|---|

| Fase 1 | 5% | 1ª semana | Verificar protocolo y salida básica |

| Fase 2 | 30% | 2ª-3ª semana | Comparar indicadores clave (calidad + costo) |

| Fase 3 | 100% | 4ª semana | Migración total, mantener clave antigua para rollback de emergencia |

💡 Rollback de emergencia: El enrutamiento de modelos antiguos en APIYI apiyi.com se mantendrá compatible hasta el 24-07-2026. Si descubres problemas graves durante la migración, simplemente cambia el

modelde vuelta adeepseek-chat/deepseek-reasonerpara restaurar el servicio inmediatamente. Pero no esperes hasta finales de julio para actuar.

V. FAQ sobre deepseek-v4-flash

Q1: ¿Cómo elegir entre Flash y Pro?

La regla de oro: usa Flash por defecto y sube a Pro si encuentras cuellos de botella. En términos prácticos:

- Conversaciones simples, FAQ, clasificación, resúmenes, autocompletado de código → Flash

- Flujos de trabajo de agentes de varios pasos (más de 5 llamadas a herramientas) → Pro

- Tareas de investigación profunda → Pro

- Si no estás seguro, prueba primero con Flash; si el resultado no es satisfactorio, cambia a Pro.

Q2: ¿Es posible aprovechar realmente el 1M de ventana de contexto?

Sí, pero ten en cuenta lo siguiente:

- Primeros 100K–300K: donde el modelo tiene mayor atención y mejor rendimiento.

- 300K–800K: el rendimiento sigue siendo estable.

- 800K–1M: la recuperación marginal disminuye; se recomienda colocar la información clave al principio o al final.

- Costo: 1M de tokens de entrada ≈ $0.14, no es caro, pero no es gratuito.

Para textos largos, recomiendo la estructura: "pregunta al inicio + materiales en medio + reafirmación de la pregunta al final".

Q3: ¿Cómo se activa el modo Thinking?

Bajo el protocolo de OpenAI, se activa mediante extra_body.reasoning.enabled=true. El parámetro effort puede ser low, medium o high (por defecto es medium). En APIYI api.apiyi.com, los parámetros son idénticos a los oficiales.

Q4: ¿Es estable el Function Calling en Flash?

La llamada única es muy estable (tasa de éxito superior al 95%). Para cadenas de herramientas de varios pasos (más de 5), se recomienda usar Pro; la diferencia de 11 puntos en Terminal-Bench 2.0 se nota principalmente en estos casos.

Q5: ¿Cuál es la concurrencia razonable?

Para desarrolladores individuales, 10–20 de concurrencia está bien. Para entornos de producción, sugerimos:

- Por defecto: usar 50 de concurrencia a través de

api.apiyi.com. - Tareas por lotes/nocturnas: cambiar a

vip.apiyi.com, donde se puede llegar a más de 200 de concurrencia. - Picos de emergencia: fallback temporal a

b.apiyi.com.

Consulta los límites específicos en docs.apiyi.com para ver las cuotas más recientes.

Q6: ¿Cómo evaluar el riesgo de migración?

Método de tres pasos:

- Calidad de salida: realiza un test A/B con 20–50 prompts típicos de tu negocio y evalúalos manualmente o mediante un modelo de calificación.

- Curva de costos: observa el consumo diario de tokens; la salida de Flash suele ser ligeramente mayor (más notable en modo Thinking).

- Latencia: el TTFT de Flash es cercano al de V3.5, pero el modo Thinking es de 2 a 5 veces más lento.

Si la degradación de calidad supera el 10%, considera subir a Pro; de lo contrario, migra con confianza.

Q7: ¿Cómo se usa la compatibilidad con el protocolo de Anthropic?

No incluyas /v1 en la base_url, llama directamente a POST /v1/messages. Simplemente rellena el campo model del SDK de Anthropic con deepseek-v4-flash. Es la vía rápida para migrar proyectos que ya usan el SDK de Claude sin realizar cambios.

Q8: ¿Hay descuentos por caché de contexto?

V4-Flash ya tiene activado el caché de contexto (context caching) automático; las solicitudes con prefijos repetidos tienen un costo menor. En escenarios con prompts de sistema largos, puedes ahorrar entre un 30% y un 50%. Este descuento está activado por defecto en la plataforma APIYI apiyi.com, sin necesidad de parámetros adicionales.

VI. Resumen del lanzamiento de deepseek-v4-flash

El lanzamiento de DeepSeek V4 trae dos hechos clave para los desarrolladores:

- Es más barato: V4-Flash ofrece capacidades cercanas a Pro por 1/12 del precio, marcando un nuevo mínimo en la industria con $0.14/M de entrada.

- Migración obligatoria: el 24 de julio de 2026 se retirarán los modelos antiguos; el periodo de gracia de 90 días ya ha comenzado.

La buena noticia es que deepseek-v4-flash ya está disponible en APIYI apiyi.com. No necesitas crear cuentas en el extranjero, ni cambiar tu SDK, ni preocuparte por los métodos de pago. Tres pasos y listo:

- ✅ Obtén una clave en el panel de control de

apiyi.com. - ✅ Apunta la

base_urlaapi.apiyi.com/v1(o usavip.apiyi.com/b.apiyi.comcomo respaldo). - ✅ Configura

modelcomodeepseek-v4-flashy mantén el resto de tu código igual.

🎯 Recomendación: Te sugiero encarecidamente iniciar hoy mismo las pruebas A/B con deepseek-v4-flash. Abre una clave dedicada en APIYI apiyi.com, ejecuta 20–50 prompts típicos y compara la calidad y el costo con tu modelo actual. Si no hay una degradación significativa, esta semana podrías migrar el 5% del tráfico y completar la migración total en 4 semanas, lo cual es mucho más cómodo que esperar a julio. Para casos de migración más detallados y scripts de benchmark, consulta la sección de DeepSeek V4 en

docs.apiyi.com.

El valor de deepseek-v4-flash no es ser "otro modelo barato", sino "poner al alcance de todos capacidades que antes solo estaban reservadas para gigantes tecnológicos": leer libros enteros con 1M de contexto, razonamiento complejo con el modo Thinking y el uso de herramientas completas mediante Function Calling, todo a un costo mínimo por solicitud. Esto abrirá nuevas oportunidades de producto; quien migre primero, llevará la delantera.

Autor: Equipo técnico de APIYI

Recursos relacionados:

- Anuncio oficial de DeepSeek: api-docs.deepseek.com/news/news260424

- Repositorio de código abierto en Hugging Face: huggingface.co/deepseek-ai/DeepSeek-V4-Flash

- Sitio web de APIYI: apiyi.com

- Documentación de APIYI: docs.apiyi.com

- Sitio principal de APIYI: api.apiyi.com (respaldos: vip.apiyi.com / b.apiyi.com)