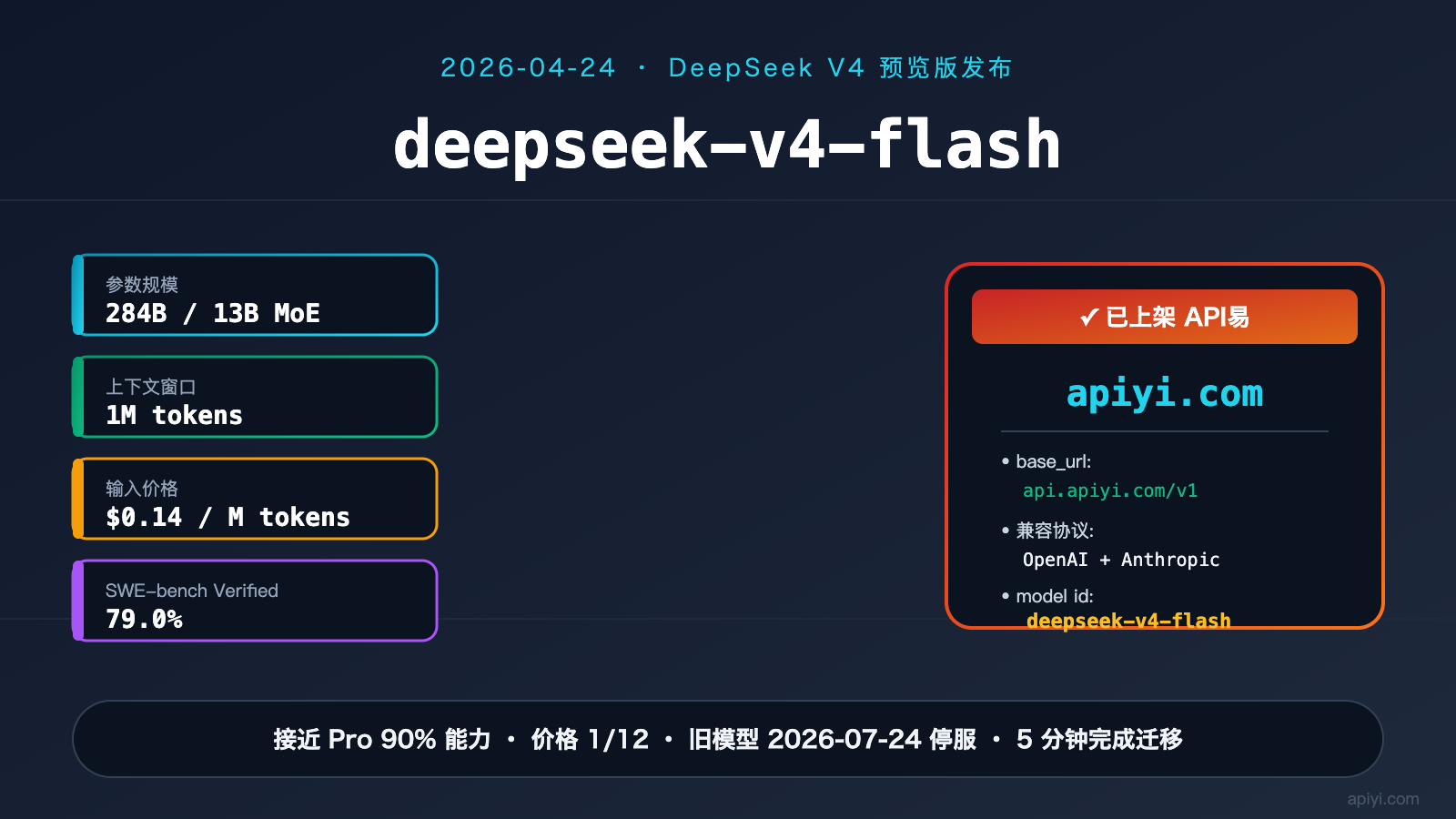

2026-04-24,DeepSeek 在 Hugging Face 同时开源了 V4-Pro 和 V4-Flash 两个预览版模型。前者是面向最前沿性能的 1.6T 参数 MoE 巨兽,后者是"接近 Pro 90% 能力、价格只有 1/12"的性价比甜点。

如果你只看一个模型,就看 deepseek-v4-flash。原因也简单:

- 284B / 13B MoE 架构 + Hybrid Attention,1M 上下文下推理 FLOPs 仅 V3.2 的 27%

- 1M tokens 上下文 / 384K tokens 最大输出,原生跑长文不用再切 chunk

- 输入 $0.14、输出 $0.28 每百万 tokens,比 Pro 便宜一个数量级

- SWE-bench Verified 79.0%、Artificial Analysis Intelligence Index 45–47,够用绝大多数场景

- 同时兼容 OpenAI ChatCompletions 和 Anthropic API 双协议,Claude Code / OpenClaw / OpenCode 零改造可用

更重要的一条:旧模型 deepseek-chat 和 deepseek-reasoner 将于 2026-07-24 正式停服,所有线上业务必须在此之前完成迁移。这是 90 天倒计时的硬截止。

好消息是:deepseek-v4-flash 已在 API易 apiyi.com 上架。你不需要自建 DeepSeek 账号、不需要改 SDK、不需要处理海外支付——把 model 字段改一下、base_url 指到 api.apiyi.com 就能用上。

本文是一份 3+5 的组合:3 分钟读懂 V4-Flash 核心升级 + 5 分钟完成从旧模型的完整迁移。

一、deepseek-v4-flash 的 5 大核心升级

1.1 核心规格一览表

先看全貌,再展开细节:

| 维度 | deepseek-v4-flash |

|---|---|

| 发布日期 | 2026-04-24(预览版) |

| 开源仓库 | huggingface.co/deepseek-ai/DeepSeek-V4-Flash |

| 总参数 | 284B(Mixture of Experts) |

| 激活参数 | 13B |

| 上下文窗口 | 1M tokens |

| 最大输出 | 384K tokens |

| 注意力架构 | Hybrid Attention(CSA + HCA) |

| 推理模式 | Thinking / Non-Thinking 双模式 |

| Function Calling | ✅ 支持 |

| JSON 模式 | ✅ 支持 |

| Chat Prefix Completion | Beta 支持 |

| API 协议 | OpenAI ChatCompletions + Anthropic 双兼容 |

| 输入价格 | $0.14 / M tokens |

| 输出价格 | $0.28 / M tokens |

下面把这 5 项升级逐一拆开讲。

1.2 升级 1:1M 上下文 + 384K 输出(原生超长)

deepseek-v4-flash 原生支持 1M tokens 输入、384K tokens 输出。这是整个 V4 系列的统一规格,Flash 并没有为了便宜而缩水上下文。

什么场景能吃下 1M?

| 内容类型 | 大致 token 数 |

|---|---|

| 10 万字中文书稿 | ≈ 150K tokens |

| 200 页 PDF 技术文档 | ≈ 300K tokens |

| 一个中型代码仓库(~50 个文件) | ≈ 500K–800K tokens |

| 整本《红楼梦》 | ≈ 1M tokens |

对比 GPT-5.4(400K)、Claude Opus 4.6(1M + 1M 上下文包)、Gemini 3.1-Pro(2M),V4-Flash 的 1M 已经是行业主流配置,而它的价格比前三者便宜 5–20 倍。

1.3 升级 2:284B/13B MoE + Hybrid Attention

V4-Flash 用了 DeepSeek 2026 引入的两个关键架构创新:

- MoE:总参数 284B,每 token 只激活 13B。效果接近一个 13B 密集模型但知识面接近 200B+ 密集模型

- Hybrid Attention(CSA 压缩稀疏注意力 + HCA 高度压缩注意力):专门为长上下文设计

效率实测数据(来自 DeepSeek 官方):

| 指标 | V3.2 | V4-Flash | 提升 |

|---|---|---|---|

| 1M 上下文单 token 推理 FLOPs | 100% | 27% | -73% |

| 1M 上下文 KV 缓存占用 | 100% | 10% | -90% |

这两组数字解释了为什么 Flash 能把价格压到 $0.14:底层算力成本真的降下来了,不是硬补贴。

1.4 升级 3:Thinking / Non-Thinking 双模式

V4-Flash 一个模型 ID 就能切两种模式:

- Non-Thinking(默认):快,适合闲聊、问答、分类、摘要

- Thinking:模型会先输出一段内部推理(类似 OpenAI o 系列),然后再给出最终答案。适合复杂推理、多步工具调用、代码调试

调用时通过请求参数切换(不是两个 model id),开发者侧改动极小。在 API易 api.apiyi.com 上调用时,这个参数名和 DeepSeek 官方完全一致。

1.5 升级 4:$0.14 / $0.28 每 M tokens

这是本次发布最惊人的一组数字:

| 模型 | 输入 ($/M) | 输出 ($/M) | 相对 V4-Flash |

|---|---|---|---|

| deepseek-v4-flash | 0.14 | 0.28 | 1×(基准) |

| deepseek-v4-pro | 1.74 | 3.48 | 12× |

| GPT-5.4(参考) | 2.50 | 10.00 | 17×–35× |

| Claude Sonnet 4.6(参考) | 3.00 | 15.00 | 21×–53× |

一个典型的 "500 tokens 输入 + 500 tokens 输出" 请求:

- V4-Flash:$0.000 21 ≈ ¥0.0015

- GPT-5.4:$0.006 25 ≈ ¥0.045

- Claude Sonnet 4.6:$0.009 ≈ ¥0.065

Flash 便宜了 30–40 倍。对月调用量上亿 tokens 的产品来说,这直接决定毛利率。

1.6 升级 5:OpenAI + Anthropic 双协议兼容

V4-Flash 在 API 层同时实现了两套协议:

POST /v1/chat/completions→ OpenAI 格式POST /v1/messages→ Anthropic 格式

这意味着:

| 客户端 | 迁移成本 |

|---|---|

| OpenAI Python/Node SDK | 零修改,只改 base_url 和 model |

| Anthropic Python/Node SDK | 零修改,只改 base_url 和 model |

| Claude Code | 换个 Anthropic endpoint 即可 |

| OpenClaw / OpenCode | 原生支持 |

| LangChain / LlamaIndex | 换 base_url 即可 |

这是 DeepSeek 本次版本一个非常聪明的决策:不逼你学新协议,让存量生态零成本接入。

1.7 Benchmark 实测对比表

| Benchmark | V4-Flash | V4-Pro | 差距 |

|---|---|---|---|

| SWE-bench Verified(代码修复) | 79.0% | 82.1% | -3.1 |

| Terminal-Bench 2.0(多步工具用) | 56.9% | 67.9% | -11.0 |

| SimpleQA-Verified(事实召回) | 34.1% | 57.9% | -23.8 |

| Artificial Analysis Intelligence Index | 45 / 47 | 58 | -11 ~ -13 |

解读:Flash 在单步代码任务(SWE-bench)上几乎追平 Pro,但在需要多步工具链(Terminal-Bench)和事实记忆(SimpleQA)上差距明显。这两个差距正是判断"选 Flash 还是 Pro"的决策依据。

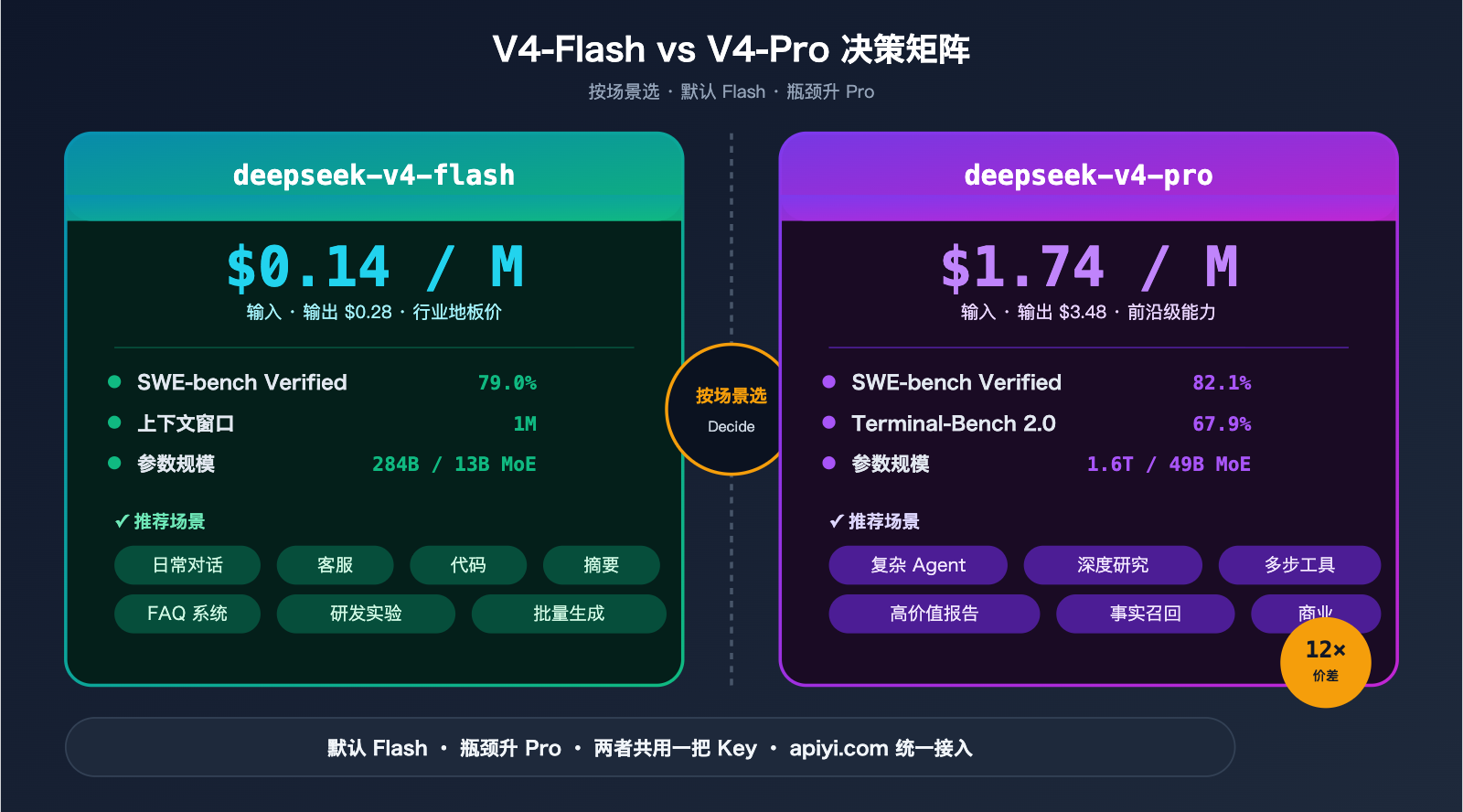

二、deepseek-v4-flash vs V4-Pro 场景决策

2.1 一张决策矩阵:先看这里

| 场景 | 推荐 | 理由 |

|---|---|---|

| 日常对话、闲聊、问答 | Flash | 能力完全够用,价格 1/12 |

| 客服机器人、FAQ 系统 | Flash | 吞吐高、延迟低 |

| 代码补全、单文件修改 | Flash | SWE-bench 79%,接近 Pro |

| 长文档摘要、读一本书 | Flash | 1M 上下文全给到 |

| 多步工具链 Agent | Pro | Terminal-Bench 差 11 分 |

| 深度研究、多轮查证 | Pro | SimpleQA 差 24 分 |

| 高价值商业报告生成 | Pro | Intelligence Index 高 11+ |

| 研发 / 探索型实验 | Flash | 便宜 12 倍,迭代快 |

通用法则:默认用 Flash,遇到瓶颈再升 Pro。这和做技术选型时"先用简单方案、有瓶颈再升级"的原则一致。

2.2 性价比测算:什么规模下 Flash 省钱更狠

假设你的产品每日调用 1 亿 tokens(输入 6 千万 + 输出 4 千万):

| 模型 | 日成本 | 月成本 | 年成本 |

|---|---|---|---|

| V4-Flash | $19.6 | $588 | $7 056 |

| V4-Pro | $243.6 | $7 308 | $87 696 |

| GPT-5.4(参考) | $550 | $16 500 | $198 000 |

Flash 一年省 $80K+ vs Pro。这笔钱够再养半个开发了。

2.3 混合路由:生产环境的最佳实践

大多数产品的最优解不是二选一,而是按请求类型动态路由:

def route_model(request_type: str) -> str:

if request_type in ("chat", "faq", "summarize", "classify"):

return "deepseek-v4-flash"

if request_type in ("deep_research", "multi_step_agent"):

return "deepseek-v4-pro"

return "deepseek-v4-flash" # 默认走 Flash

🎯 落地建议:我们建议你在 API易 apiyi.com 平台同时保留 V4-Flash 和 V4-Pro 两个模型调用权限。两者共用一把 Key,只要改

model字段就能切换。批量任务推荐走vip.apiyi.com高并发线路,Pro 的复杂任务走主站api.apiyi.com,不同业务可以在同一个配置里做 AB 流量分配。

三、5 分钟在 API易 apiyi.com 调用 deepseek-v4-flash

3.1 Step 1:前置环境与拿 Key

| 项 | 要求 |

|---|---|

| Python 或 Node.js | Python 3.8+ / Node.js 18+ |

| 客户端 SDK | OpenAI Python openai >= 1.0 或 官方 Node SDK |

| 网络 | 可访问 api.apiyi.com |

| Key | 在 API易 apiyi.com 控制台生成,以 sk- 开头 |

拿 Key:

- 访问

apiyi.com,注册/登录后进入控制台 - 左侧菜单 → API Keys → 新建密钥

- 建议设置「使用额度上限」为 ¥50–100 做初期验证

- 复制以

sk-开头的密钥字符串

3.2 Step 2:选择线路(base_url)

API易提供三条线路,共用同一把 Key:

| base_url | 定位 | 推荐场景 |

|---|---|---|

https://api.apiyi.com/v1 |

主站 | 默认首选,日常调用 |

https://vip.apiyi.com/v1 |

高并发 | 批量跑图/推理、夜间队列 |

https://b.apiyi.com/v1 |

备用 | 主站波动时自动 fallback |

日常开发用主站即可,生产环境遇到 429 限流或 5xx 抖动再切 VIP/备用。

3.3 Step 3:Python 最小调用示例(Non-Thinking)

from openai import OpenAI

client = OpenAI(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com/v1",

)

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "system", "content": "你是一个简洁的助手"},

{"role": "user", "content": "用三点总结 DeepSeek V4-Flash 的核心升级"},

],

max_tokens=512,

)

print(resp.choices[0].message.content)

改动点只有两处:

base_url指向api.apiyi.commodel改成deepseek-v4-flash

其他 OpenAI SDK 代码原样保留。

3.4 Step 4:启用 Thinking 推理模式

需要深度推理时,在请求里加 reasoning 参数:

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "user", "content": "证明:给定 n 个点,最少需要多少条直线覆盖所有点对?"},

],

extra_body={

"reasoning": {"enabled": True, "effort": "high"},

},

max_tokens=8192,

)

# 返回里会带 reasoning_content 字段

print("思考过程:", resp.choices[0].message.reasoning_content)

print("最终答案:", resp.choices[0].message.content)

Thinking 模式下耗时会增加 2–5 倍(取决于问题复杂度),但代码/数学题的准确率显著上升。

3.5 Step 5:Node.js 最小调用示例

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_API_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const resp = await client.chat.completions.create({

model: "deepseek-v4-flash",

messages: [

{ role: "user", content: "Write a haiku about 2026 AI" },

],

max_tokens: 256,

});

console.log(resp.choices[0].message.content);

3.6 Step 6:Function Calling 示例

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current weather for a city",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"],

},

},

}]

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[{"role": "user", "content": "今天上海天气怎么样?"}],

tools=tools,

)

print(resp.choices[0].message.tool_calls)

V4-Flash 在单次工具调用场景里稳定性非常好。多步复杂工具链(5+ 步)时建议升级到 V4-Pro。

3.7 Step 7:Anthropic 协议调用

如果你的项目是基于 Anthropic SDK 开发的(比如集成了 Claude Code),照样能用:

from anthropic import Anthropic

client = Anthropic(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com",

)

resp = client.messages.create(

model="deepseek-v4-flash",

max_tokens=1024,

messages=[{"role": "user", "content": "Hi"}],

)

print(resp.content[0].text)

🎯 双协议建议:同一个 deepseek-v4-flash 模型,OpenAI 协议走

api.apiyi.com/v1,Anthropic 协议走api.apiyi.com(无/v1)。切换时只动 base_url 一个字段。更多协议细节可参考 API易官方文档docs.apiyi.com的 DeepSeek 专栏。

四、从旧模型迁移到 deepseek-v4-flash 的完整路径

4.1 为什么必须迁移:90 天倒计时

DeepSeek 官方公告明确:

Legacy models

deepseek-chatanddeepseek-reasonerretire July 24, 2026.

Please update your model todeepseek-v4-proordeepseek-v4-flash.

2026-07-24 之后,继续使用旧 model id 的请求将直接返回错误。从发布日 2026-04-24 算起,总共 90 天缓冲期。

4.2 迁移决策表

按你当前使用的模型,对应新模型:

| 旧 model id | 新 model id | 迁移难度 |

|---|---|---|

deepseek-chat |

deepseek-v4-flash(Non-Thinking 模式) |

⭐ 只改 1 个字段 |

deepseek-reasoner |

deepseek-v4-flash + Thinking 模式 |

⭐⭐ 改 model + 加 reasoning 参数 |

deepseek-reasoner(高价值场景) |

deepseek-v4-pro + Thinking 模式 |

⭐⭐ 改 model + 加 reasoning 参数 |

deepseek-v3.x |

deepseek-v4-flash |

⭐ 只改 model |

deepseek-coder 等专用 |

deepseek-v4-flash |

⭐ 只改 model(通用能力已覆盖) |

4.3 代码 Diff:几乎零改动

迁移前:

resp = client.chat.completions.create(

model="deepseek-chat", # ← 旧模型

messages=[...],

)

迁移后:

resp = client.chat.completions.create(

model="deepseek-v4-flash", # ← 改这一行

messages=[...],

)

如果同时要从 deepseek-reasoner 迁移:

resp = client.chat.completions.create(

- model="deepseek-reasoner",

+ model="deepseek-v4-flash",

messages=[...],

+ extra_body={"reasoning": {"enabled": True}},

)

4.4 迁移 Checklist

建议在迁移前跑一遍这份清单:

- 梳理所有代码里的

model=硬编码位置 - 评估

deepseek-reasoner的调用是否需要升级到 V4-Pro - 准备一组回归测试 prompt(20–50 条,覆盖核心业务)

- 在 API易

apiyi.com控制台把旧请求的每日上限临时收紧,强制触发迁移 - 新老模型 AB 跑 1 周,对比输出质量

- 监控 token 消耗曲线,确认成本没有意外上涨

- 更新内部文档和 Runbook

4.5 灰度发布建议

分 3 期:

| 期次 | 流量 | 周期 | 目标 |

|---|---|---|---|

| 第 1 期 | 5% | 第 1 周 | 验证协议和基本输出 |

| 第 2 期 | 30% | 第 2-3 周 | 对比关键指标(质量 + 成本) |

| 第 3 期 | 100% | 第 4 周 | 全量迁移,保留旧 Key 做紧急回滚 |

💡 紧急回滚:API易 apiyi.com 的旧模型路由在 2026-07-24 之前保留兼容。迁移期间如果发现严重问题,把

model改回deepseek-chat/deepseek-reasoner即可立即恢复。但千万别拖到 7 月底才动工。

五、deepseek-v4-flash 常见问题 FAQ

Q1:Flash 和 Pro 具体怎么选?

一句话法则:默认 Flash,遇到瓶颈再升 Pro。具体到场景:

- 单次对话、FAQ、分类、摘要、代码补全 → Flash

- 多步 Agent 工作流(5+ 步工具调用)→ Pro

- 深度研究型任务 → Pro

- 不确定时,先跑 Flash 看效果,差再升

Q2:1M 上下文是不是真的能跑满?

能,但要注意:

- 前 100K–300K:模型注意力最集中,效果最好

- 300K–800K:效果仍然稳定

- 800K–1M:边际召回会下降,关键信息建议放在前或后

- 成本提醒:1M token 输入 ≈ $0.14,不算贵但也不免费

建议长文场景用"开头放问题 + 中间放材料 + 结尾再重申问题"的结构。

Q3:Thinking 模式怎么触发?

OpenAI 协议下通过 extra_body.reasoning.enabled=true 触发。effort 参数可选 low / medium / high,默认 medium。在 API易 api.apiyi.com 上参数和官方一致。

Q4:Function Calling 在 Flash 上稳不稳?

单次调用非常稳(95%+ 成功率)。多步工具链(5+ 步)建议用 Pro——Terminal-Bench 2.0 的 11 分差距主要体现在这里。

Q5:合理并发是多少?

个人开发者 10–20 并发没问题。生产环境建议:

- 默认:通过

api.apiyi.com走 50 并发 - 批量/夜间任务:切到

vip.apiyi.com,可到 200+ 并发 - 紧急抖动:临时 fallback 到

b.apiyi.com

具体上限建议在 docs.apiyi.com 查看最新配额说明。

Q6:怎么评估迁移风险?

三步法:

- 输出质量:用 20–50 条业务典型 prompt 做 AB,人工或打分模型评估

- 成本曲线:观察每日 token 消耗,Flash 输出 token 通常会略多一点(Thinking 模式下更明显)

- 延迟:Flash 的 TTFT 和 V3.5 接近,Thinking 模式会慢 2–5 倍

超过 10% 质量回退就考虑升级到 Pro,否则放心迁。

Q7:Anthropic 协议兼容具体怎么用?

base_url 不带 /v1,直接调 POST /v1/messages。Anthropic SDK 的 model 字段填 deepseek-v4-flash 即可。这对已经在用 Claude SDK 的项目是零改造迁移的捷径。

Q8:有没有上下文缓存优惠?

V4-Flash 已启用自动上下文缓存(context caching),重复前缀的请求实际计费会更低。长系统提示词场景下能再省 30–50%。这个优惠在 API易 apiyi.com 平台是默认开启的,不需要额外参数。

六、deepseek-v4-flash 上架总结

这次 DeepSeek V4 的发布,对开发者来说有两个关键事实:

- 便宜了:V4-Flash 用 1/12 的价格做到接近 Pro 的能力,$0.14/M 输入创了行业新低

- 逼迁了:2026-07-24 旧模型正式下线,90 天缓冲期从发布日开始倒计时

好消息是 deepseek-v4-flash 已在 API易 apiyi.com 上架,你不用自建海外账号、不用改 SDK、不用担心支付通道。三步搞定:

- ✅ 在

apiyi.com控制台拿一把 Key - ✅

base_url指向api.apiyi.com/v1(备用vip.apiyi.com/b.apiyi.com) - ✅

model设为deepseek-v4-flash,其余代码原样保留

🎯 行动建议:强烈建议今天就启动 deepseek-v4-flash 的 AB 测试。在 API易 apiyi.com 开一把专用 Key,跑 20–50 条业务典型 prompt,对比原有模型的输出质量和成本。如果没有明显回退,本周就可以把 5% 流量切过去,4 周内完成全量迁移——比拖到 7 月再赶工从容得多。更详细的迁移案例和 benchmark 脚本可参考

docs.apiyi.com的 DeepSeek V4 专栏。

deepseek-v4-flash 的价值不是"又一个便宜模型",而是"把原本只有前沿巨头才能服务的场景推到了人人能用的价位"——1M 上下文读整本书、Thinking 模式做复杂推理、Function Calling 接全套工具,这些能力的单次成本压到了几毫钱。这会直接打开一批新的产品机会,谁先迁完谁先跑在前面。

作者: API易技术团队

相关资源:

- DeepSeek 官方公告: api-docs.deepseek.com/news/news260424

- Hugging Face 开源仓库: huggingface.co/deepseek-ai/DeepSeek-V4-Flash

- API易官网: apiyi.com

- API易文档: docs.apiyi.com

- API易主站: api.apiyi.com(备用 vip.apiyi.com / b.apiyi.com)