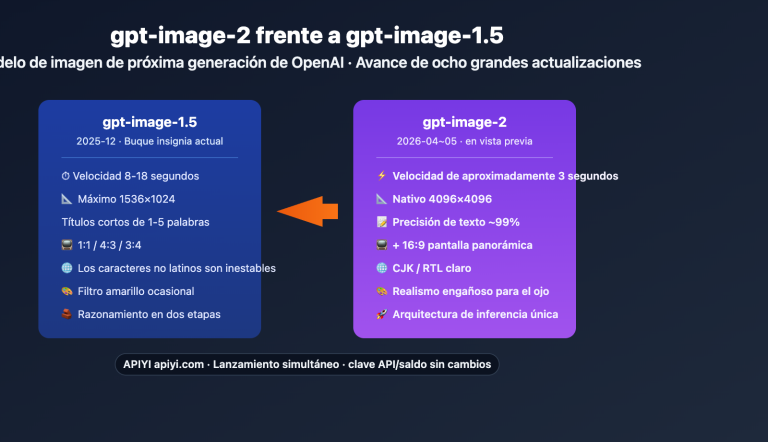

Si quieres que OpenClaw aprenda a invocar directamente el modelo de imagen más potente de OpenAI, gpt-image-2, ¿qué es lo primero que se te ocurre? La mayoría de la gente piensa inmediatamente en abrir el editor, escribir un script de Python con requests.post(...) y encapsularlo como una función de herramienta para el Agente.

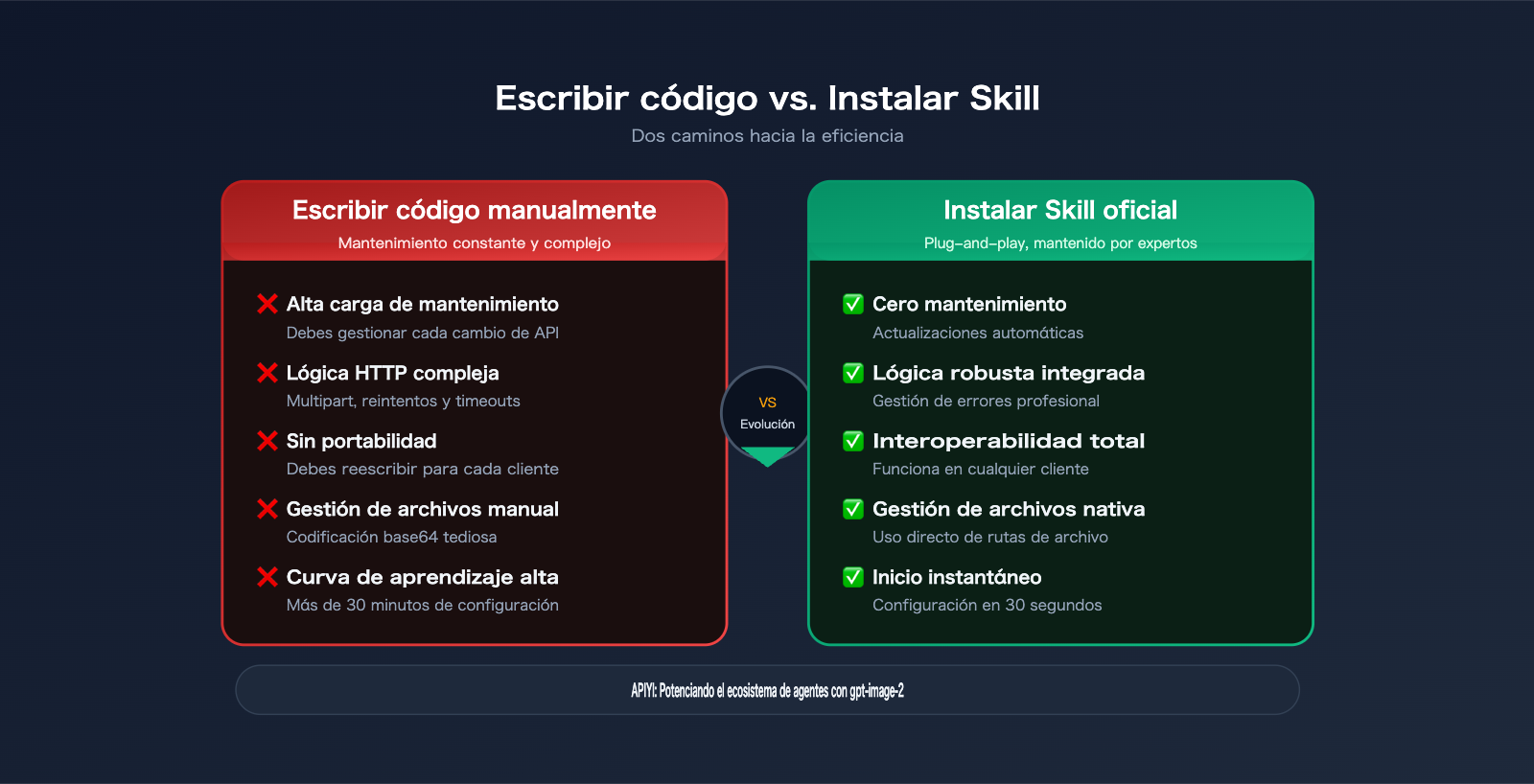

No es que no se pueda hacer así, pero te meterás en cuatro problemas de inmediato:

- Debes gestionar la subida de la imagen de referencia mediante

multipart/form-data. - Tienes que escribir lógica de reintentos, tiempos de espera y gestión de límites de tasa (429).

- Debes escribir una implementación distinta para cada escenario (texto a imagen, imagen a imagen, máscara, procesamiento por lotes).

- Cada vez que cambies de cliente de OpenClaw (o uses Claude Code, Cursor), tendrás que volver a realizar la integración.

La respuesta en 2026 ha cambiado: no escribas código, simplemente instala un Skill.

OpenClaw cuenta con un ecosistema completo de Skills; el registro de ClawHub ya cuenta con más de 5700 Skills aportados por la comunidad. En este artículo, compartiremos dos Skills oficiales para gpt-image-2 aportados por el equipo de APIYI al repositorio expert-skills-hub:

apiyi-gpt-image-2-gen(Directo / Control preciso, recomendado)apiyi-gpt-image-2-all-gen(Inverso / Modo económico)

Instalar un Skill requiere solo una línea de comando, configurar la clave API solo requiere un export, y luego puedes decirle directamente a OpenClaw: "Ayúdame a generar una imagen de producto de una taza de cerámica en 4K". El Agente seleccionará automáticamente el Skill, completará los parámetros y guardará el archivo.

Al terminar este tutorial sobre la integración de OpenClaw con gpt-image-2, obtendrás:

- Una comparativa clara entre "escribir código vs. instalar un Skill", entendiendo por qué lo segundo es mejor.

- Dos Skills oficiales listos para usar, cubriendo escenarios de alta calidad y de procesamiento económico por lotes.

- Un ejemplo mínimo funcional en 5 pasos (tanto para Node.js como para Python).

- Tres comandos prácticos (póster 4K / síntesis con múltiples imágenes de referencia / exploración de bocetos por lotes).

- El método para reutilizar el mismo conjunto de Skills en Claude Code y Cursor.

I. Por qué los Skills son la mejor solución para integrar gpt-image-2 en OpenClaw

1.1 El sistema de Skills de OpenClaw: la forma estándar de potenciar a tu Agente

OpenClaw es un asistente de IA de código abierto multiplataforma (repositorio de GitHub github.com/openclaw/openclaw). Su objetivo no es ser "otro cuadro de chat", sino "proporcionar un conjunto de herramientas combinables para el Agente". La unidad básica de este conjunto de herramientas se llama Skill.

Un Skill es, esencialmente:

skill-package/

├── SKILL.md # Le dice al Agente qué hace este Skill

├── scripts/

│ ├── generate_image.js # Entorno de ejecución Node.js

│ └── generate_image.py # Entorno de ejecución Python

└── requirements.txt / package.json

Cuando dices "ayúdame a dibujar una taza de café", OpenClaw hará lo siguiente:

- Escaneará el resumen en el

SKILL.mdde todos los Skills instalados. - Determinará que la "generación de imágenes" coincide mejor con

apiyi-gpt-image-2-gen. - Extraerá los parámetros de tu lenguaje natural (dimensiones, calidad, formato de salida).

- Invocarás el

generate_image.js/pycorrespondiente. - Te devolverá la ruta de la imagen generada.

Todo el proceso se realiza sin escribir código, sin configurar rutas y sin invocar SDKs. Esta es la ventaja fundamental del ecosistema de OpenClaw frente al modelo tradicional de "escribir plugins".

1.2 Escribir código vs. Instalar un Skill: una tabla comparativa

| Dimensión de comparación | Escribir código HTTP | Instalar Skill oficial |

|---|---|---|

| Coste de inicio | Desde 30 minutos | 1 comando, 30 segundos |

| Detalles HTTP | Gestionar multipart, reintentos, timeouts | Encapsulado dentro del Skill |

| Subida de referencia | Hacer codificación base64 manualmente | Pasar directamente la ruta del archivo |

| Entornos | O Node o Python | Ambos (Node.js + Python) |

| Percepción del Agente | Escribir la descripción de la herramienta | Incluido en SKILL.md |

| Multi-cliente | Reintegrar al cambiar de entorno | Compatible con Claude Code / Cursor / OpenClaw |

| Actualizaciones | Seguir las actualizaciones de la API de OpenAI | npx skills update con un clic |

| Cambio de ruta | Modificar código | Cambiar variable de entorno |

En otras palabras, escribir código te convierte en un trabajador de "pegamento" que siempre está haciendo mantenimiento, mientras que instalar un Skill delega el trabajo de mantenimiento al autor del Skill.

1.3 División de tareas entre los dos Skills: elige la herramienta correcta

El equipo de APIYI ha contribuido con dos Skills para gpt-image-2 al repositorio expert-skills-hub, orientados a escenarios completamente distintos:

| Nombre del Skill | Alias del modelo | Posicionamiento | Modelo de precio | Mejor escenario |

|---|---|---|---|---|

apiyi-gpt-image-2-gen |

gpt-image-2 |

Directo / Control preciso | Pago por token | Pósteres, fotografía comercial, portadas, 4K |

apiyi-gpt-image-2-all-gen |

gpt-image-2-all |

Inverso / Modo económico | Fijo $0.03/imagen | Bocetos conceptuales, prompts en chino, exploración |

Ambos Skills comparten la misma APIYI_API_KEY, y el backend se dirige unificado a la pasarela de APIYI. Puedes instalar ambos a la vez y dejar que el Agente de OpenClaw elija automáticamente según el escenario: si es un póster, usa el directo; si necesitas 100 variantes, usa el económico.

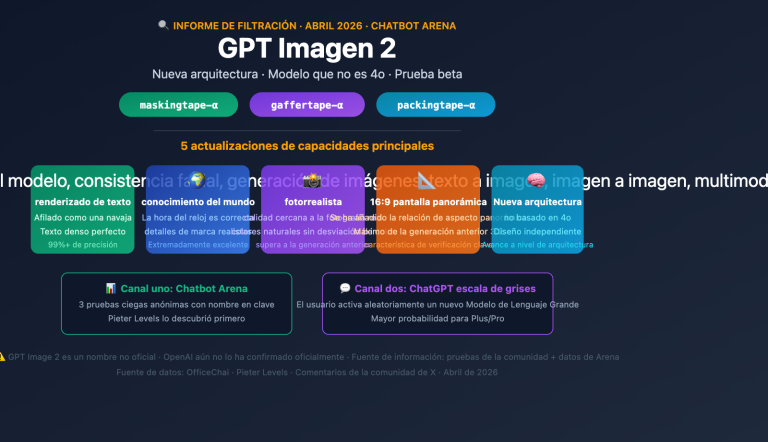

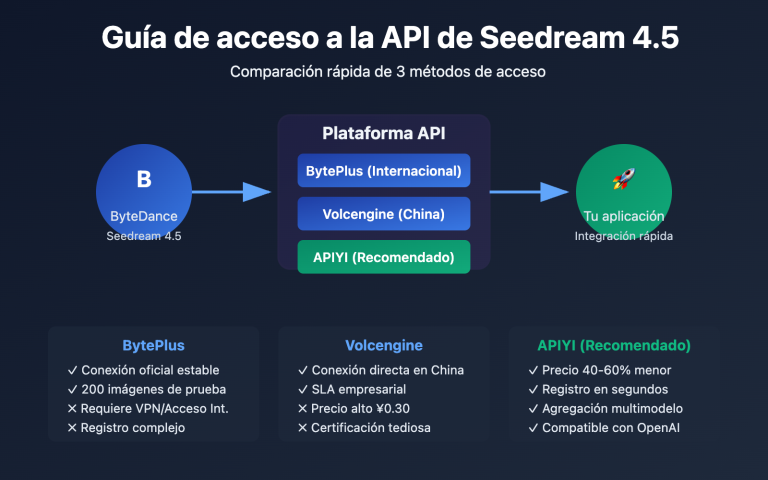

1.4 Backend subyacente: Tres rutas de APIYI (apiyi.com)

Las peticiones HTTP de ambos Skills se dirigen por defecto a api.apiyi.com, el sitio principal de APIYI.

🎯 Recomendación de ruta: Recomendamos cambiar la

APIYI_BASE_URLde OpenClaw en entornos de producción a la ruta de alta concurrencia de APIYI:vip.apiyi.com, especialmente cuando se realicen procesos por lotes. El sitio principalapi.apiyi.comes ideal para llamadas individuales diarias, la ruta VIPvip.apiyi.comes perfecta para colas de procesamiento masivo o nocturno, yb.apiyi.comactúa como respaldo automático. Las tres rutas comparten la misma clave API, por lo que solo necesitas cambiar una variable de entorno para alternar entre ellas.

2. 5 minutos para integrar OpenClaw con gpt-image-2

2.1 Verificación del entorno previo

Antes de integrar OpenClaw con gpt-image-2, asegúrate de que el entorno esté listo:

| Ítem | Requisito | Comando de verificación |

|---|---|---|

| OpenClaw instalado | Última versión | openclaw --version |

| Node.js | 18+ | node --version |

| Python | 3.10+ (opcional) | python3 --version |

| npx | Incluido con Node | npx --version |

| Red | Acceso a github.com y api.apiyi.com | curl -I api.apiyi.com |

| Clave APIYI | Obtenida en el panel de api.apiyi.com |

Busca el prefijo sk- |

⚠️ Nota: Si el comando

npx skillsno aparece en tu versión de OpenClaw, actualiza a la última versión (openclaw update). La CLI de Skills es una capacidad central del ecosistema OpenClaw 2026; las versiones antiguas podrían no incluirla.

2.2 Paso 1: Instalar la Skill con un comando

Abre tu terminal e instala la Skill correspondiente según tu caso de uso. Recomendamos instalar ambas:

# Conversión directa (recomendada para uso diario)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-gen

# Conversión inversa (ideal para lotes/indicaciones en chino)

npx skills add https://github.com/wuchubuzai2018/expert-skills-hub \

--skill apiyi-gpt-image-2-all-gen

Una vez ejecutado, la Skill se ubicará en el directorio predeterminado de OpenClaw (usualmente ~/.openclaw/skills/). Puedes verificarlo con:

npx skills list

# Salida esperada:

# - apiyi-gpt-image-2-gen ✓ instalada

# - apiyi-gpt-image-2-all-gen ✓ instalada

2.3 Paso 2: Configurar la clave API

La integración de OpenClaw con gpt-image-2 solo requiere una variable de entorno:

# macOS / Linux

export APIYI_API_KEY="sk-tu-clave-aqui"

# Windows PowerShell

$env:APIYI_API_KEY = "sk-tu-clave-aqui"

Te sugerimos añadir esta línea a tu ~/.zshrc o ~/.bashrc para que sea permanente.

🎯 Pasos para obtener la clave: Visita APIYI en

apiyi.com, regístrate y entra al panel de control → API Keys → Crear nueva clave. Se recomienda activar el "límite de uso" y establecer un tope diario (por ejemplo, ¥50) para la clave de OpenClaw, evitando consumos excesivos por activaciones accidentales del agente.

Cambio de ruta opcional, si necesitas alta concurrencia para procesamiento por lotes:

export APIYI_BASE_URL="https://vip.apiyi.com/v1" # Ruta VIP

# O

export APIYI_BASE_URL="https://b.apiyi.com/v1" # Ruta de respaldo

Si no se configura, se utiliza por defecto https://api.apiyi.com/v1.

2.4 Paso 3: Generar tu primera imagen (Node.js)

La Skill instalada incluye scripts de ejemplo. El comando de verificación más sencillo es:

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

node scripts/generate_image.js \

-p "A minimalist poster with the text 'HELLO 2026' centered" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

Tras unos 20–40 segundos, la terminal mostrará:

✔ Imagen generada: ./hello_2026.png (1024x1024, png, 312 KB)

Abre hello_2026.png; deberías ver un póster minimalista con el texto "HELLO 2026" claro en el centro. Si el texto se ve nítido, significa que toda la cadena (OpenClaw Skill → APIYI api.apiyi.com → OpenAI gpt-image-2) funciona correctamente.

2.5 Paso 4: Generar tu primera imagen (versión Python)

Si tu proyecto utiliza el stack de Python, la misma Skill incluye scripts para este lenguaje:

cd ~/.openclaw/skills/apiyi-gpt-image-2-gen

python3 scripts/generate_image.py \

-p "A minimalist poster with the text 'HELLO 2026' centered" \

-s "1024x1024" \

-q "medium" \

-o "png" \

-f "./hello_2026.png"

Los parámetros son idénticos a la versión de Node.js, usando los cinco argumentos cortos -p/-s/-q/-o/-f o sus versiones largas (--prompt/--size/--quality/--output-format/--filename).

💡 No es necesario cambiar de entorno: Ambos scripts conviven en el mismo paquete de Skill, lo que significa que puedes usar Node (amigable para frontend) en una parte de tu proyecto y Python (amigable para ciencia de datos) en otra. La Skill de integración de OpenClaw con gpt-image-2 trata a ambos lenguajes como ciudadanos de primera clase.

2.6 Paso 5: Invocación mediante lenguaje natural en OpenClaw

La CLI anterior solo sirve para verificar la Skill. El uso real consiste en dejar que OpenClaw la invoque de forma autónoma. Al iniciar OpenClaw, simplemente da la instrucción en lenguaje natural:

Usuario: Ayúdame a generar una imagen de producto de una taza de cerámica en 4K usando gpt-image-2,

con luz suave de mañana, fondo neutro, formato PNG, y guárdala en ./output/tea_cup.png

OpenClaw: Entendido, seleccionaré la Skill apiyi-gpt-image-2-gen para procesar esta solicitud.

Parámetros: size=3840x2160, quality=high, output-format=png

Generando...

✔ Completado: ./output/tea_cup.png (3840x2160, 2.4 MB)

La capa de razonamiento de OpenClaw hará lo siguiente:

- Identificar el tipo de tarea = generación de imágenes.

- Comparar el

SKILL.mdde ambas Skills y elegirapiyi-gpt-image-2-gen(porque el usuario pidió 4K + PNG). - Traducir "4K" a

3840x2160e integrar "luz suave de mañana" en la indicación. - Ejecutar

generate_image.jsy devolver la ruta del archivo.

Solo tuviste que dar una instrucción, sin escribir código Python o Node. Este es el valor central de utilizar la ruta de Skills para la integración de OpenClaw con gpt-image-2.

III. Referencia rápida de parámetros para invocar gpt-image-2 en OpenClaw

3.1 Skill de avance (Directo): apiyi-gpt-image-2-gen

Este es el modo de control preciso, recomendado para uso general. Tabla de parámetros completa:

| Opción | Opción larga | Rango de valores | Predeterminado | Descripción |

|---|---|---|---|---|

-p |

--prompt |

Texto | Obligatorio | Descripción de la imagen, se recomienda mezclar palabras clave en inglés y español |

-s |

--size |

WIDTHxHEIGHT |

1024x1024 |

Cualquier múltiplo de 16, hasta un máximo de 3840x3840 |

-q |

--quality |

low/medium/high/auto | auto |

high para pósteres, low para bocetos |

-o |

--output-format |

png/jpeg/webp | png |

Se requiere png para fondos transparentes |

-c |

--output-compression |

0-100 | 85 |

Solo efectivo para jpeg/webp |

-i |

--input-image |

Ruta (repetible) | Ninguno | Hasta 5 imágenes de referencia |

-m |

--mask |

Ruta | Ninguno | Máscara en blanco y negro, blanco = área a editar |

-f |

--filename |

Ruta | ./output.png |

Archivo de salida |

Referencia rápida de tamaños comunes:

| Uso | Tamaño recomendado |

|---|---|

| Historias/Feed | 1080x1080 |

| Vertical (Redes sociales) | 1080x1440 |

| Portada de video | 1920x1080 |

| Cabecera de blog | 1600x900 |

| Póster 4K | 3840x2160 |

| Banner horizontal | 2400x800 |

| Fondo de pantalla móvil | 1170x2532 |

3.2 Skill de retroceso (Inverso): apiyi-gpt-image-2-all-gen

Este es el modo económico por lotes, con un coste aproximado de $0.03 por imagen. Parámetros más simplificados:

| Opción | Opción larga | Rango de valores | Descripción |

|---|---|---|---|

-p |

--prompt |

Texto | Descripción, el tamaño/proporción se escribe directamente en el texto |

-r |

--response-format |

url / b64_json | url devuelve un enlace CDN de 24h, b64_json devuelve Base64 |

-i |

--input-image |

Ruta (repetible) | Hasta 5 imágenes de referencia |

-f |

--filename |

Ruta | Archivo de salida (se descarga automáticamente en modo url) |

El Skill de retroceso no expone -s/-q/-o, ya que el modelo subyacente es conversacional y el tamaño debe expresarse mediante la indicación:

# Ejemplo correcto

-p "Genera un fondo de pantalla horizontal 16:9, paisaje urbano de ciencia ficción, luces de neón"

# Ejemplo incorrecto (el modo inverso no admite -s)

-p "Paisaje urbano de ciencia ficción" -s "1920x1080" # ❌

3.3 Tres comandos prácticos

Caso 1: Póster de película 4K (Avance)

node scripts/generate_image.js \

-p "Cinematic poster for sci-fi novel 'NEON HORIZON', \

dark blue and magenta gradient sky, lone silhouette on cliff, \

bold serif title centered at top, subtle tagline bottom, \

35mm film grain" \

-s "3840x5760" \

-q "high" \

-o "png" \

-f "./poster_neon_horizon.png"

- Vertical 2:3 en 4K

quality=highasegura que el texto sea nítido- Tiempo de generación: 3–5 minutos (el tiempo de 4K está fuertemente relacionado con la calidad)

Caso 2: Repintado parcial con máscara (Avance + Imagen + Máscara)

node scripts/generate_image.js \

-p "Replace the background with luxurious white marble countertop, \

soft natural window light from the left, \

keep product subject pixel-stable" \

-i "./coffee_cup.png" \

-m "./coffee_cup_mask.png" \

-s "2048x2048" \

-q "high" \

-f "./coffee_cup_marble.png"

- Píxeles blancos = fondo a reemplazar

- Píxeles negros = objeto del producto (estabilidad de píxeles)

- gpt-image-2 no alterará la forma del producto

Caso 3: Borradores conceptuales por lotes (Retroceso + Bucle)

# 100 conceptos de vestuario, $0.03 cada uno, costo total aprox. $3

for i in $(seq 1 100); do

node scripts/generate_image.js \

-p "Diseño de personaje cyberpunk #${i}, Hanfu mejorado, tonos neón, ilustración de cuerpo completo" \

-r "url" \

-f "./concepts/concept_${i}.png"

done

- El Skill de retroceso tiene un soporte más estable para indicaciones en español

- En modo

-r url, el script descargará automáticamente el archivo localmente - Para escenarios por lotes, se recomienda cambiar a

APIYI_BASE_URL=https://vip.apiyi.com/v1

IV. Combinaciones avanzadas de OpenClaw con gpt-image-2

4.1 Permitir que el Agente elija el Skill de forma autónoma

Una vez instalados ambos Skills, OpenClaw elegirá automáticamente según tu lenguaje. Para ayudar al Agente a elegir con mayor precisión, puedes incluir señales de indicación al hablar:

| Tu frase | Tendencia de elección del Agente |

|---|---|

| "Alta calidad", "4K", "Póster", "Fotografía comercial" | Avance apiyi-gpt-image-2-gen |

| "Boceto", "Lotes", "Concepto", "Español" | Retroceso apiyi-gpt-image-2-all-gen |

| "Saca 10 para probar" | Retroceso (económico) |

| "Cambiar fondo con máscara" | Avance (el retroceso no admite máscaras) |

| "Precio fijo de $0.03" | Retroceso |

🎯 Consejo de indicación: Al incluir términos como "control preciso" o "lotes económicos" en tus palabras clave, OpenClaw acertará casi al 100% con el Skill correspondiente. En la sección del ecosistema de Skills en

docs.apiyi.comencontrarás más ejemplos.

4.2 Cadena de Skills: Generación de imagen → OCR → Traducción

Dado que los Skills pueden ser orquestados libremente por el Agente, la integración de gpt-image-2 en OpenClaw puede encadenarse en flujos de trabajo de varios pasos. Ejemplo: "Generar un póster con un eslogan en inglés y luego traducirlo al japonés":

Usuario: Genera un póster minimalista con el eslogan en inglés "Less is more",

luego genera una versión con la misma composición pero con el eslogan en japonés

OpenClaw:

Paso 1: apiyi-gpt-image-2-gen (versión en inglés)

→ ./en_poster.png

Paso 2: apiyi-gpt-image-2-gen (versión en japonés, usando en_poster.png como referencia)

-i ./en_poster.png

-p "Same layout, replace text with 'より少なく、より豊かに'"

→ ./jp_poster.png

Esta es la mayor fortaleza del ecosistema de Skills: un solo Skill hace una cosa, y el Agente se encarga de encadenarlos en flujos de trabajo de cualquier complejidad.

4.3 Integración de Skills en CI/CD

Los scripts de ambos Skills son esencialmente CLI estándar, lo que significa que pueden integrarse perfectamente en CI/CD:

# .github/workflows/generate-og-image.yml

name: Generate OG image on release

on:

release:

types: [published]

jobs:

og-image:

runs-on: ubuntu-latest

steps:

- uses: actions/checkout@v4

- uses: actions/setup-node@v4

with: { node-version: '20' }

- run: npx skills add https://github.com/wuchubuzai2018/expert-skills-hub --skill apiyi-gpt-image-2-gen

- env:

APIYI_API_KEY: ${{ secrets.APIYI_API_KEY }}

run: |

node ~/.openclaw/skills/apiyi-gpt-image-2-gen/scripts/generate_image.js \

-p "Release ${{ github.event.release.tag_name }} cover image" \

-s "1200x630" \

-q "high" \

-f "./og-image.png"

- uses: actions/upload-artifact@v4

with: { name: og-image, path: ./og-image.png }

Genera automáticamente una imagen OG cada vez que lanzas una versión; el Agente y el CI comparten la misma definición de Skill.

4.4 Reutilización en Claude Code y Cursor

Aunque este artículo se centra en OpenClaw, los dos Skills apiyi-gpt-image-2-gen / apiyi-gpt-image-2-all-gen siguen estrictamente el estándar universal de Skills, por lo que:

| Cliente | ¿Soporta? | Notas |

|---|---|---|

| OpenClaw | ✅ | Escenario principal de este artículo |

| Claude Code | ✅ | Solo colócalo en ~/.claude/skills/ |

| Cursor | ✅ | Referenciado a través de archivos de reglas |

| Windsurf | ✅ | Compatible con la especificación de Skills |

| Agente propio (LangChain, etc.) | ⚠️ | Requiere una capa de adaptador de herramientas |

"Instalar una vez, reutilizar en múltiples clientes" permite que tus capacidades de generación de imágenes te sigan a tus herramientas principales sin necesidad de reescribir nada.

V. Preguntas frecuentes (FAQ) sobre la integración de OpenClaw con gpt-image-2

P1: ¿El comando npx skills add devuelve "command not found"?

Asegúrate de que OpenClaw esté actualizado a la última versión (openclaw update), ya que las versiones antiguas no incluyen el CLI de Skills. Si el error persiste, puedes clonar manualmente el repositorio en el directorio ~/.openclaw/skills/ como medida de respaldo.

P2: ¿El script muestra el error "APIYI_API_KEY is not set"?

Sigue estos tres pasos para verificar:

- Ejecuta

echo $APIYI_API_KEYpara comprobar si la variable se exportó correctamente. - Confirma que la clave tenga el prefijo

sk-. - Si acabas de añadirla a

~/.zshrc, abre una terminal nueva para que los cambios surtan efecto.

P3: ¿Cómo cambio la invocación a la línea de alta concurrencia vip.apiyi.com?

Tienes dos opciones:

# Opción 1: Variable de entorno global

export APIYI_BASE_URL="https://vip.apiyi.com/v1"

# Opción 2: Prefijo para una sola invocación

APIYI_BASE_URL="https://vip.apiyi.com/v1" node scripts/generate_image.js ...

Lo mismo aplica para el dominio de respaldo: b.apiyi.com. Los tres dominios comparten la misma clave; si el sitio principal presenta inestabilidad, cambiar manualmente a VIP suele restaurar el servicio de inmediato. Para estrategias específicas, consulta la guía de cambio de rutas en la documentación oficial de APIYI en docs.apiyi.com.

P4: ¿Cómo elegir entre el modo inverso y el modo directo?

Consulta esta tabla de decisiones:

| Si necesitas… | Elige |

|---|---|

Control preciso de resolución (ej. 1920x1080) |

Directo |

| Usar máscara para repintado local (Inpainting) | Directo |

| Pósteres de alta calidad superiores a 4K | Directo |

| Procesamiento por lotes de más de 50 imágenes | Inverso |

| Indicaciones (prompts) principalmente en chino | Inverso |

| Costos predecibles ($0.03/imagen) | Inverso |

La forma más sencilla: instala ambos y deja que el Agente de OpenClaw elija automáticamente según tu lenguaje natural.

P5: ¿Se puede usar en Claude Code?

Sí. Crea un enlace simbólico o copia el paquete de Skill desde ~/.openclaw/skills/ a ~/.claude/skills/. Claude Code reconocerá automáticamente el archivo SKILL.md y lo registrará como una herramienta invocable. Se comparte la misma APIYI_API_KEY.

P6: ¿Son seguras las Skills?

Debes ser precavido con el ecosistema de Skills de la comunidad. En febrero de 2026, se descubrió que 341 Skills maliciosas distribuían el malware Atomic Stealer a través de ClawHub. Recomendaciones:

- Instala solo Skills de repositorios confiables (el repositorio

wuchubuzai2018/expert-skills-hubmencionado aquí es la fuente oficial de APIYI). - Tras la instalación, revisa el contenido de

SKILL.mdy los scripts, prestando especial atención a comandos comocurl | basho códigos que conecten con dominios desconocidos. - Usa

npx skills inspect <nombre-de-la-skill>para ver a qué direcciones de red accederá la Skill.

Todas las peticiones de las Skills oficiales de APIYI se dirigen únicamente a *.apiyi.com, por lo que son seguras para auditoría.

P7: ¿Qué hacer si la generación de imágenes 4K es muy lenta?

- Es un comportamiento normal.

quality=high+3840x2160suele tardar entre 3 y 5 minutos. - Añade protección contra tiempos de espera (timeout) en la capa externa del script (usando

timeout 360 node ...en Bash). - Si necesitas una vista previa rápida, genera un borrador primero con

size=2048x1152 quality=mediumy, tras confirmar el resultado, escala a 4K.

P8: ¿Cómo realizar el seguimiento de costos?

Activa las "Alertas de presupuesto diario" y las "Estadísticas por clave" en el panel de control de apiyi.com. Asigna un límite específico a la clave dedicada de OpenClaw para monitorear el consumo y detener gastos inesperados.

VI. Resumen de la integración de OpenClaw con gpt-image-2

Mirando hacia atrás, la mejor forma de integrar OpenClaw con gpt-image-2 en 2026 ha pasado de "escribir código" a "instalar una Skill". Las razones son claras:

- Más rápido: Dos comandos,

npx skills add+export KEY, y listo en 30 segundos. - Más estable: Los detalles de HTTP, las estrategias de reintento y la validación de parámetros están encapsulados en la Skill; las actualizaciones dependen del autor de la misma.

- Más versátil: La misma Skill es compatible en OpenClaw, Claude Code y Cursor.

- Más inteligente: El Agente entiende

SKILL.mdy puede decidir por sí mismo cuándo y cuál utilizar.

Las dos Skills aportadas por APIYI, apiyi-gpt-image-2-gen (control preciso) y apiyi-gpt-image-2-all-gen (lotes económicos), cubren perfectamente los escenarios más comunes. Instalar ambas es el punto de partida más sencillo: ya sea para un póster 4K o 100 borradores conceptuales, el Agente de OpenClaw elegirá la Skill correcta automáticamente.

🎯 Consejo de implementación: Primero, solicita una clave de prueba en

apiyi.com(se recomienda establecer un límite diario de ¥20–50) y ejecuta el ejemplo mínimo siguiendo los 5 pasos de la sección §2. Una vez confirmada la conexión, prueba los pósteres 4K y el repintado con máscara de la sección §3. Si hay inestabilidad en la red, cambiaAPIYI_BASE_URLavip.apiyi.comob.apiyi.com. Para combinaciones de Skills más complejas o ejemplos de CI/CD, consulta la sección de ecosistema de Skills en la documentación oficialdocs.apiyi.com.

Con esto, ya tienes una solución completa y reutilizable para la integración de OpenClaw con gpt-image-2. Lo único que queda por hacer es eliminar permanentemente de tu lista de tareas pendientes el "escribir una herramienta de invocación de imágenes": deja que las Skills se encarguen de ello.

Autor: Equipo técnico de APIYI

Recursos relacionados:

- Repositorio de Skills: github.com/wuchubuzai2018/expert-skills-hub

- Página principal de OpenClaw: github.com/openclaw/openclaw

- Sitio web oficial de APIYI: apiyi.com

- Documentación de APIYI: docs.apiyi.com

- Sitio principal de APIYI: api.apiyi.com (respaldos: vip.apiyi.com / b.apiyi.com)