Autoren-Anmerkung: 15. Januar 2026 – Praxistest: Die Videoqualität von Sora 2 hat sich deutlich verbessert. OpenAI hat offenbar seine Rechenkapazität erweitert. Dieser Artikel analysiert vergleichend die Ursachen der Bildqualitätsänderung, den technischen Hintergrund und Best Practices für API-Aufrufe.

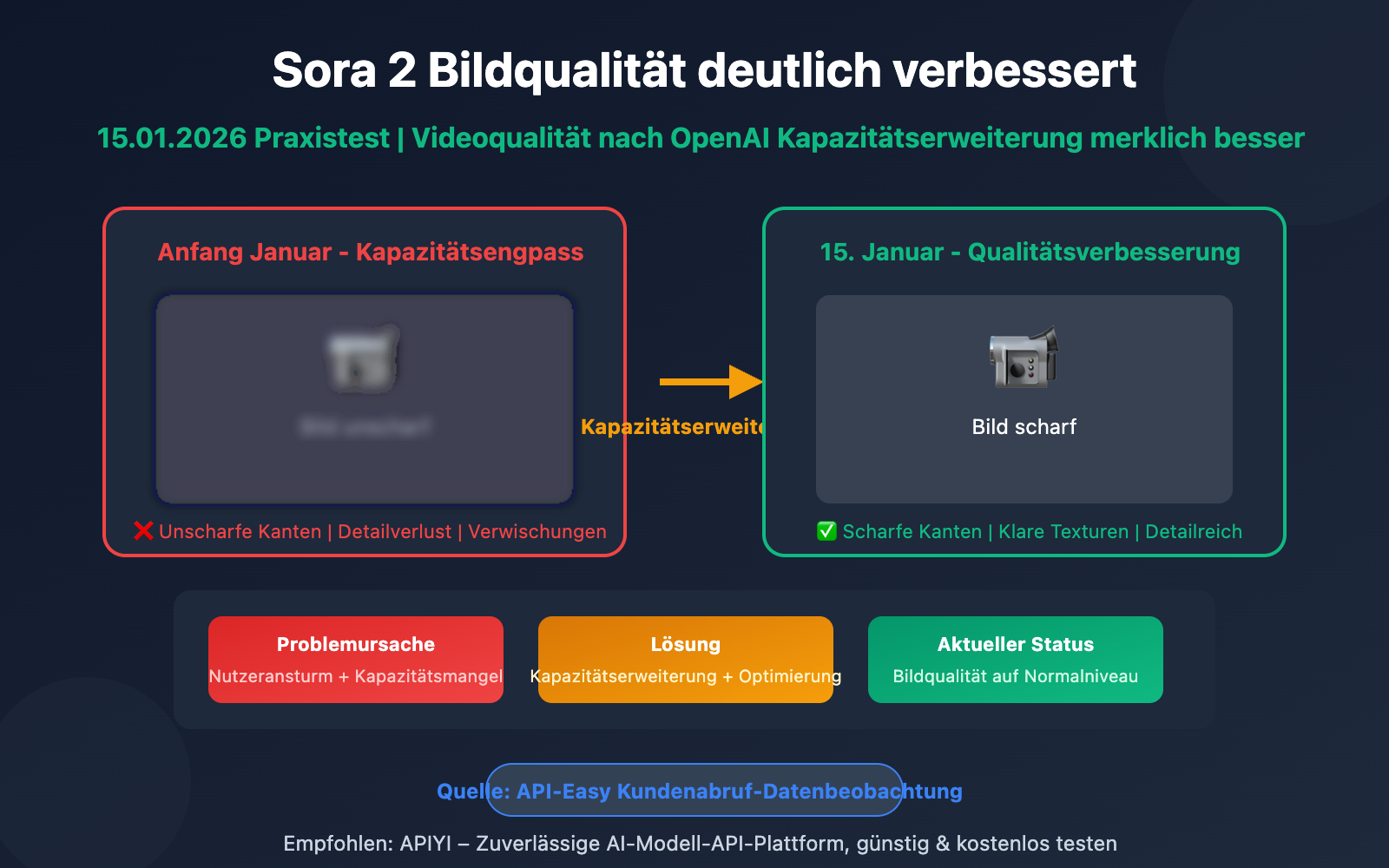

Am 15. Januar 2026 zeigten Beobachtungen der Kundenabrufdaten über die API-Easy-Plattform, dass die Videoqualität von Sora 2 deutlich zugenommen hat. Das wochenlang bestehende "Unschärfe-Problem", das Nutzer plagte, scheint gelöst – OpenAI hat vermutlich stillschweigend seine Rechenkapazität erweitert oder die Ressourcenverwaltung optimiert.

Kernnutzen: In 3 Minuten den Hintergrund der Sora 2 Bildqualitätsänderung verstehen, technische Ursachen analysieren und erfahren, wie Sie über die API die beste Videogenerierungsqualität erzielen.

Sora 2 Bildqualität – Die wichtigsten Fakten

| Zeitpunkt | Status | Nutzerfeedback |

|---|---|---|

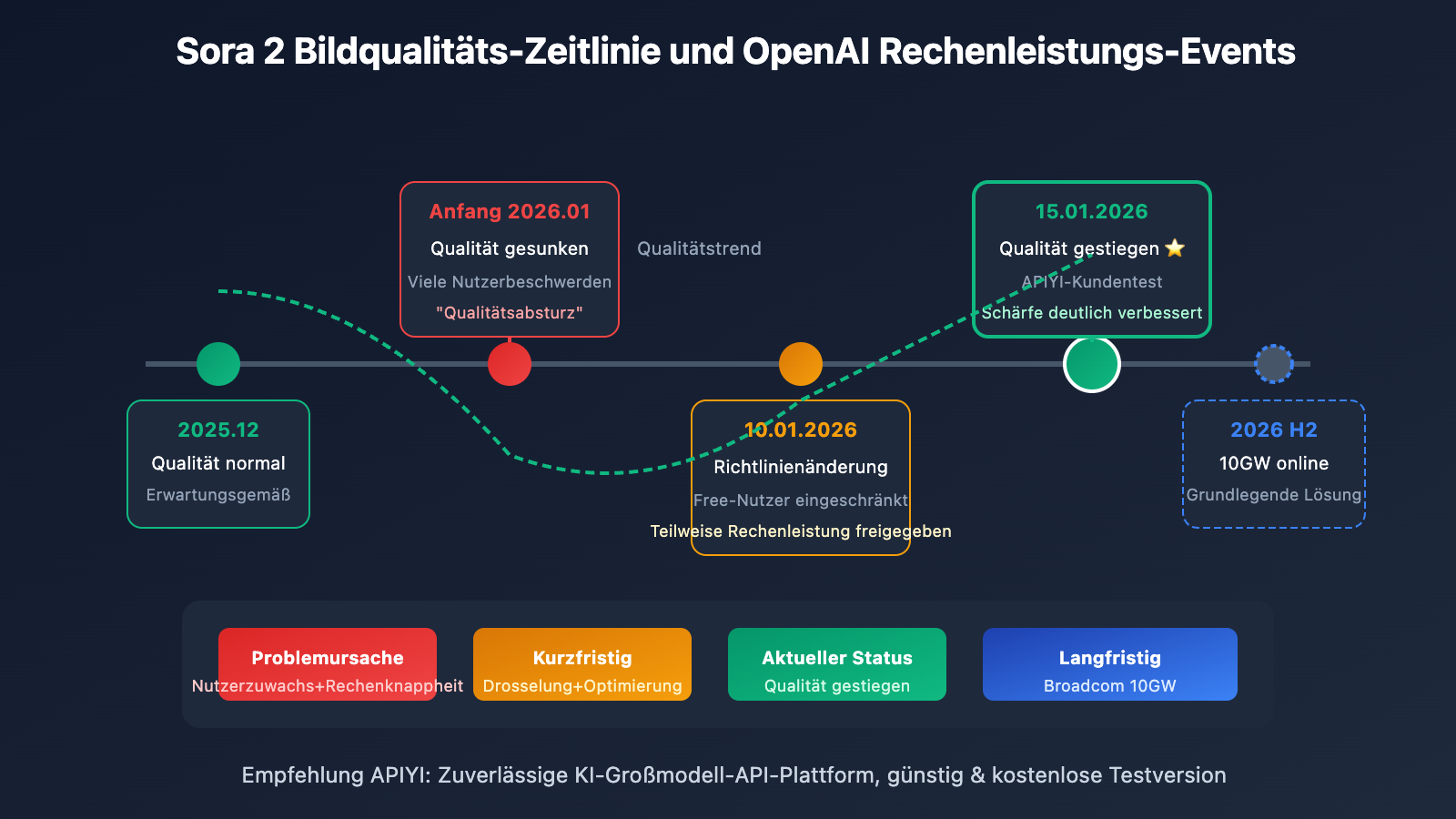

| Dezember 2025 | Normal | Videoqualität wie erwartet |

| Anfang Januar 2026 | Verschlechtert | Viele Nutzer berichten von unscharfen Bildern |

| 10. Januar 2026 | Tiefpunkt | Trotz Einschränkung für Gratisnutzer hohe Auslastung |

| 15. Januar 2026 | Verbessert | API-Aufrufe zeigen deutliche Qualitätsverbesserung |

Hintergründe zur Sora 2 Qualitätsverbesserung

Diese Qualitätsverbesserung ist keine neue Version von OpenAI, sondern eine Verbesserung auf Infrastrukturebene. Um das zu verstehen, sollten wir zunächst das frühere "Unschärfe-Gate" betrachten.

Von Ende 2025 bis Anfang Januar 2026 berichteten zahlreiche Nutzer in internationalen Communities über einen "dramatischen Qualitätsverlust" bei Sora 2. Auf Reddit im OpenAI-Forum häuften sich Beschwerden, Nutzer kritisierten, die "Qualität sei über Nacht abgestürzt" (plummeted overnight).

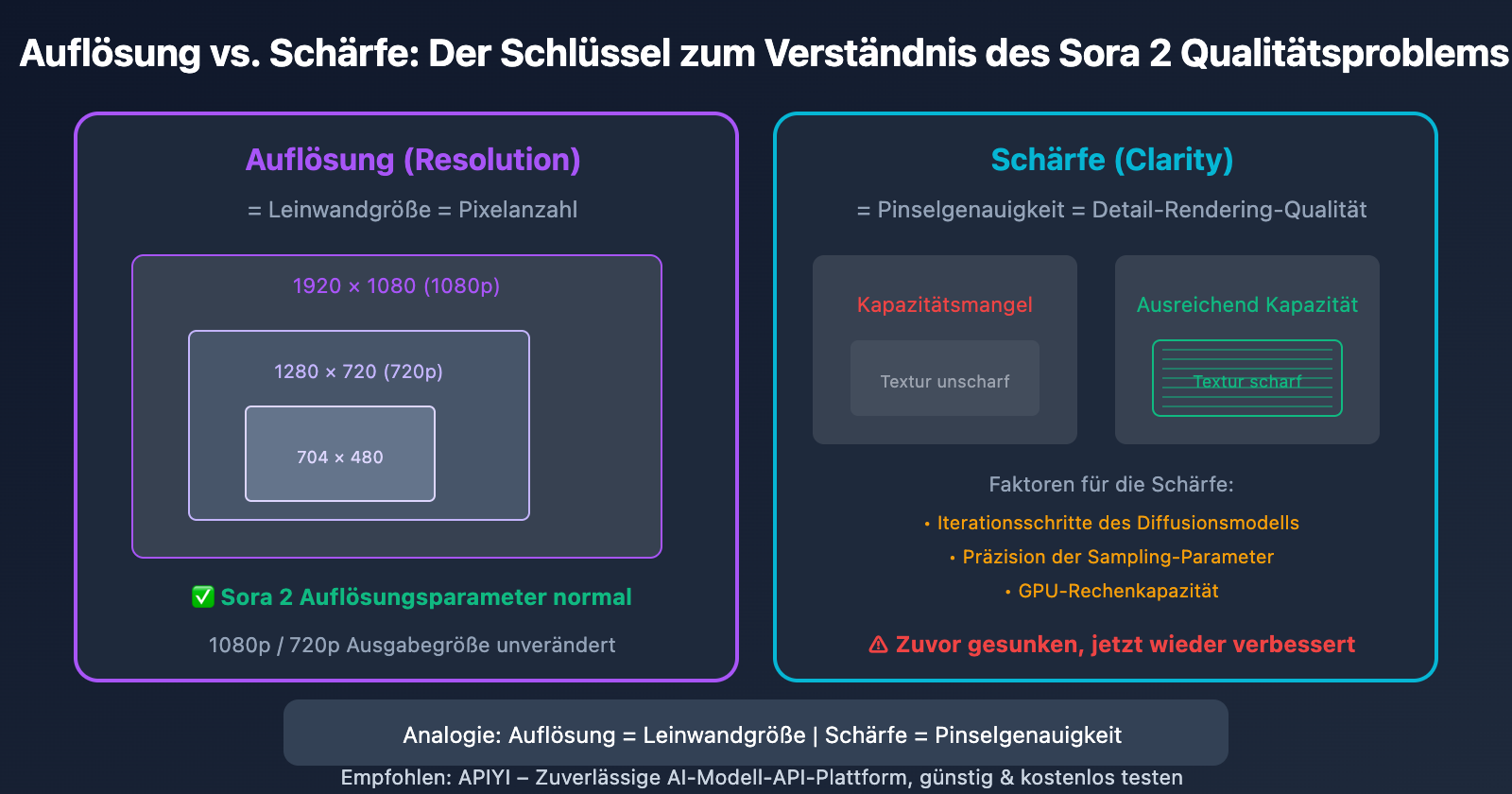

Der Knackpunkt: Die Auflösungsparameter blieben gleich, aber die Bildschärfe nahm ab. Das zeigt, dass das Problem bei der Generierungsqualität lag, nicht bei den Ausgabespezifikationen.

Technische Gründe für Sora 2 Bildqualitätsprobleme

Unterschied zwischen Auflösung und Schärfe

Viele Nutzer verwechseln zwei Konzepte:

| Konzept | Definition | Sora 2 Status |

|---|---|---|

| Auflösung | Pixelgröße (z.B. 704×1280, 1920×1080) | Parameter normal, unverändert |

| Schärfe | Detailwiedergabe, Texturschärfe | Zuvor gesunken, jetzt wieder gestiegen |

Ein Vergleich: Die Auflösung ist die Leinwandgröße, die Schärfe ist die Feinheit des Pinsels. Bei derselben 1080p-Leinwand kann man mit ausreichend Rechenleistung feine Texturen malen, bei mangelnder Rechenleistung nur verschwommene Konturen.

Wie beeinflusst Rechenleistungsknappheit die Bildqualität?

Die Videogenerierung von Sora 2 stellt extrem hohe Anforderungen an die Rechenleistung. Laut OpenAI-Schätzungen:

- Generierung eines 10-Sekunden-Videos = Verbrauch von GPU-Ressourcen entsprechend mehreren tausend ChatGPT-Konversationen

- Direkte Rechenkosten pro Video ca. $0,50 – $2,00

Bei hoher Plattformauslastung hat OpenAI möglicherweise folgende Maßnahmen ergriffen, um die Verfügbarkeit des Dienstes aufrechtzuerhalten:

- Reduzierung der Generierungspräzision: Weniger Iterationsschritte im Diffusionsmodell

- Anpassung der Sampling-Parameter: Details opfern für Geschwindigkeit

- Load-Balancing-Scheduling: Aufgaben auf nicht-optimale Rechenknoten verteilen

Diese Maßnahmen garantierten "Funktionsfähigkeit", opferten aber "gute Nutzbarkeit".

Nachfragespitze im Januar 2026

Die Bildqualitätsprobleme erreichten Anfang Januar ihren Höhepunkt, aus folgenden Gründen:

- Richtlinienänderung: Ab 10. Januar konnten kostenlose Nutzer keine Videos mehr generieren, viele Nutzer nutzten den Dienst konzentriert vor der Deadline

- Feiertagseffekt: Gestiegener Bedarf an Content-Erstellung während der Neujahrsfeiertage

- Virale Verbreitung: Die anhaltende Popularität von Sora 2 zog kontinuierlich neue Nutzer an

Praxisbeobachtung: Durch Monitoring der APIYI apiyi.com Call-Daten haben wir beobachtet, dass nach dem 15. Januar generierte Videos deutlich schärfere Detailtexturen und verbesserte Kantenschärfe aufweisen, was darauf hindeutet, dass OpenAIs Rechenleistungsangebot sich verbessert hat.

Technischer Hintergrund von OpenAIs Rechenleistungsausbau

Broadcom 10GW Kooperationsprojekt

OpenAI hat zuvor mit Broadcom eine großangelegte Kooperationsvereinbarung unterzeichnet, mit dem Plan, 10 Gigawatt (GW) maßgeschneiderte KI-Chips und -Systeme aufzubauen. Diese Zahl entspricht:

- Stromverbrauch von 8 Millionen US-Haushalten

- Energieverbrauch einer Großstadt

Das Projekt soll voraussichtlich in der zweiten Hälfte 2026 mit der Implementierung beginnen und wird grundlegend die Engpässe bei hochrechenintensiven Anwendungen wie Sora 2 lösen.

Vermutete kurzfristige Optimierungsmaßnahmen

Bevor die großangelegte Infrastruktur verfügbar ist, hat OpenAI möglicherweise folgende kurzfristige Maßnahmen ergriffen:

| Optimierungsrichtung | Mögliche Maßnahmen | Effekt |

|---|---|---|

| Rechenplanung | Optimierung der GPU-Cluster-Task-Verteilung | Reduzierung von Ressourcenverschwendung |

| Nutzerverteilung | Einschränkung kostenloser Nutzer | Freigabe von Rechenleistung für Pro-Nutzer |

| Regionale Expansion | Aktivierung weiterer Rechenzentren | Verteilung der Spitzenlast |

| Modelloptimierung | Anpassung der Inferenz-Effizienzparameter | Höhere Qualität bei gleicher Rechenleistung |

Sora 2 API: Best Practices für optimale Ergebnisse

Aktuell verfügbare Auflösungen

| Auflösung | Pixel | Einsatzbereich | API-Parameter |

|---|---|---|---|

| 1080p | 1920×1080 | Kommerzielle Produktion, YouTube | resolution: "1080p" |

| 720p | 1280×720 | Schnelle Vorschau, Social Media | resolution: "720p" |

Tipps für maximale Bildschärfe

from openai import OpenAI

# Stabile API-Anbindung über APIYI

client = OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Prompt-Optimierung für bessere Schärfe

response = client.videos.generate(

model="sora-2",

prompt="""

A young woman walking through Tokyo's Shibuya crossing at night,

neon lights reflecting on wet pavement,

cinematic lighting, sharp focus, highly detailed,

in 4K resolution, professional cinematography

""",

resolution="1080p",

duration=10,

fps=30 # 30fps sind flüssiger als 24fps

)

Schlüsselwörter für bessere Bildqualität in Sora 2

Diese Keywords in deinem Prompt helfen dem Modell, schärfere Videos zu erzeugen:

sharp focus– scharfe Fokussierunghighly detailed– hohe Detailtiefe4K resolution– 4K-Auflösung (verbessert Details, auch bei 1080p-Output)professional cinematography– professionelle Kinematografiecrisp textures– klare Texturencinematic quality– Kinoqualität

Beispiel-Prompt:

A golden retriever running on a beach at sunset,

waves splashing, fur details visible,

sharp focus, highly detailed, cinematic lighting,

professional 4K cinematography

Tipp: Nutze APIYI (apiyi.com) für den Zugriff auf die Sora 2 API. Die Plattform bietet stabile Anbindung und kostenloses Testguthaben, damit du die Ergebnisqualität schnell testen kannst.

Sora 2 Bildqualität im Vergleich: Vorher vs. Nachher

| Vergleichskriterium | Anfang Januar (Serverlast hoch) | 15. Januar (nach Verbesserung) |

|---|---|---|

| Kantenschärfe | Unscharf, mit Lichthöfen | Klar und präzise |

| Texturdetails | Verlust von Details, verwischt | Texturen erhalten, gute Tiefenstaffelung |

| Bewegungsschärfe | Deutliche Bewegungsunschärfe | Klare Bewegungslinien |

| Farbwiedergabe | Gräulich, geringe Sättigung | Lebendige Farben, hoher Kontrast |

| Gesichtsdetails | Verschwommene Gesichtszüge | Klare Gesichtsmerkmale |

Worauf solltest du achten?

- Tageszeit: Nachts in Nordamerika (nachmittags in Peking) ist die Serverlast niedriger – möglicherweise bessere Qualität

- Retry-Strategie: Wenn das Ergebnis nicht überzeugt, einfach nochmal generieren. Zu verschiedenen Zeiten kann die Qualität variieren

- Prompt-Optimierung: Keywords für bessere Schärfe funktionieren tatsächlich

- Pro-Modus nutzen: Das sora-2-pro-Modell liefert durchweg stabilere High-Quality-Ergebnisse

Häufig gestellte Fragen

F1: Ist die Verbesserung der Bildqualität dauerhaft oder vorübergehend?

Basierend auf OpenAIs Plänen zur Kapazitätserweiterung wird sich die Bildqualität langfristig kontinuierlich verbessern. Kurzfristig kann sie jedoch noch von Lastschwankungen beeinflusst werden. Für wichtige Projekte empfehlen wir das sora-2-pro-Modell, da es eine höhere Priorität bei der Ressourcenzuweisung hat und eine stabilere Bildqualität bietet. APIYI apiyi.com unterstützt sowohl die Standard- als auch die Pro-Version.

F2: Warum ist die Bildqualität bei API-Aufrufen stabiler als im Webinterface?

API-Aufrufe laufen normalerweise über dedizierte Service-Kanäle, die von Web-Nutzern isoliert sind. Besonders beim Zugriff über professionelle Plattformen wie APIYI können zusätzliche Caching- und Scheduling-Optimierungen vorhanden sein. Enterprise-API-Kunden haben in der Regel exklusive Rechenkapazitäten und sind nicht von öffentlichen Lasten betroffen.

F3: Wie kann ich den aktuellen Kapazitätsstatus einschätzen?

Derzeit gibt es keine offizielle Statusseite für die Rechenkapazität, aber Sie können den Status indirekt über folgende Wege einschätzen:

- Generierungszeit: Normalerweise dauert ein 10-Sekunden-Video etwa 3-5 Minuten; über 10 Minuten deutet auf hohe Last hin

- Generierungsqualität: Schneller Vergleich der Ergebnisse desselben Prompts zu verschiedenen Zeitpunkten

- Community-Feedback: Verfolgen Sie Diskussionen auf Reddit r/OpenAI und Twitter

Zusammenfassung

Die wichtigsten Punkte zur Verbesserung der Sora 2 Bildqualität:

- Ursache des Problems: Der frühere Qualitätsverlust war auf knappe Rechenkapazitäten zurückzuführen, nicht auf Modellversionsprobleme

- Aktueller Status: Seit dem 15. Januar 2026 deutliche Verbesserung der Bildqualität, OpenAI scheint die Kapazitätserweiterung abgeschlossen zu haben

- Langfristige Aussicht: Das 10GW-Kooperationsprojekt mit Broadcom wird das Kapazitätsproblem grundlegend lösen

- Best Practices: Verwenden Sie Schlüsselwörter für Schärfe, wählen Sie Zeiten mit niedriger Last, bevorzugen Sie das Pro-Modell

Für Nutzer, die eine stabile, hochwertige Ausgabe benötigen, empfehlen wir den Zugriff auf die Sora 2 API über APIYI apiyi.com. Die Plattform bietet professionelle Service-Level-Garantien und kostenloses Testguthaben.

📚 Referenzen

⚠️ Hinweis zum Link-Format: Alle externen Links verwenden das Format

Ressourcenname: domain.com– einfach zu kopieren, aber nicht anklickbar, um SEO-Gewichtsverlust zu vermeiden.

-

OpenAI Offizielle Dokumentation – Sora 2 Modell: API-Schnittstellenspezifikationen und Parametererklärungen

- Link:

platform.openai.com/docs/models/sora-2 - Beschreibung: Technische Spezifikationen von Sora 2 aus offizieller Quelle

- Link:

-

OpenAI Sora 2 Release-Ankündigung: Modellfähigkeiten und Funktionsübersicht

- Link:

openai.com/index/sora-2/ - Beschreibung: Offizielle Release-Informationen zu Sora 2

- Link:

-

CNN Bericht – OpenAI Broadcom Rechenleistungs-Partnerschaft: Details zum 10GW-Infrastrukturprojekt

- Link:

cnn.com/2025/10/13/tech/openai-broadcom-power - Beschreibung: Einblicke in OpenAIs strategische Rechenkapazitätserweiterung

- Link:

-

Skywork AI – Sora 2 Best Practice Guide: Prompt-Techniken und Parameteroptimierung

- Link:

skywork.ai/blog/sora-2-guide-tested-settings-prompts-for-pro-level-quality/ - Beschreibung: Professionelle Tipps für die Nutzung von Sora 2

- Link:

Autor: Tech-Team

Technischer Austausch: Diskussionen sind in den Kommentaren willkommen. Weitere Ressourcen finden Sie in der APIYI apiyi.com Tech-Community