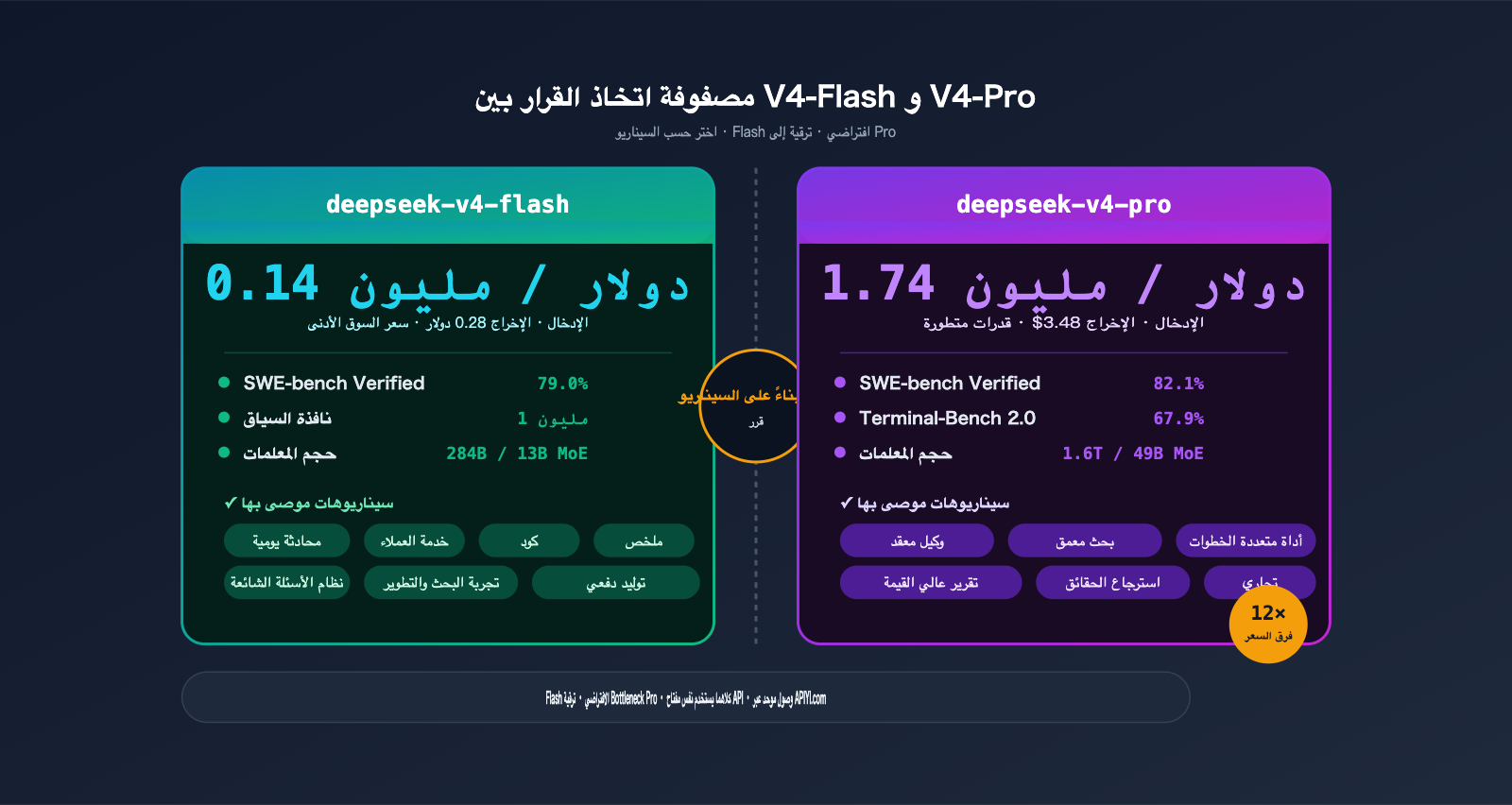

في 24 أبريل 2026، أطلقت DeepSeek نسختين تجريبيتين مفتوحتي المصدر على Hugging Face، وهما V4-Pro و V4-Flash. الأولى عبارة عن نموذج MoE ضخم بـ 1.6 تريليون معامل مصمم لأقصى أداء، بينما الثانية هي "الخيار الأمثل من حيث التكلفة، حيث تقدم 90% من قدرات Pro بسعر 1/12 فقط".

إذا كنت ستختار نموذجاً واحداً فقط، فليكن deepseek-v4-flash. والأسباب واضحة:

- بنية 284B / 13B MoE مع تقنية Hybrid Attention، مما يجعل عمليات الاستنتاج (FLOPs) عند سياق 1M تعادل 27% فقط من نموذج V3.2.

- نافذة سياق 1M tokens / مخرجات تصل إلى 384K tokens، مما يتيح معالجة النصوص الطويلة أصلياً دون الحاجة لتقسيمها.

- تكلفة 0.14 دولار للمدخلات و 0.28 دولار للمخرجات لكل مليون رمز (tokens)، وهو أرخص من إصدار Pro بمرتبة عشرية كاملة.

- حقق 79.0% في اختبار SWE-bench Verified، ومؤشر ذكاء 45–47 في Artificial Analysis، مما يجعله كافياً لمعظم حالات الاستخدام.

- متوافق مع بروتوكولي OpenAI ChatCompletions و Anthropic API، مما يعني إمكانية استخدامه مباشرة مع Claude Code / OpenClaw / OpenCode دون أي تعديلات.

والأهم من ذلك: سيتم إيقاف النماذج القديمة deepseek-chat و deepseek-reasoner رسمياً في 24 يوليو 2026. يجب على جميع الخدمات المباشرة إتمام عملية الترحيل قبل هذا التاريخ. هذا هو الموعد النهائي الصارم مع عد تنازلي لمدة 90 يوماً.

الخبر السار هو: تم إدراج deepseek-v4-flash الآن على منصة APIYI عبر apiyi.com. لست بحاجة لإنشاء حساب خاص في DeepSeek، ولا لتعديل حزمة SDK، ولا للقلق بشأن الدفع الدولي؛ فقط قم بتغيير حقل model وتوجيه base_url إلى api.apiyi.com وستكون جاهزاً للبدء.

هذا المقال عبارة عن دليل شامل: 3 دقائق لفهم التحديثات الجوهرية لنموذج V4-Flash + 5 دقائق لإتمام الترحيل الكامل من النماذج القديمة.

一、deepseek-v4-flash 的 5 大核心升级

1.1 核心规格一览表

先看全貌,再展开细节:

| 维度 | deepseek-v4-flash |

|---|---|

| 发布日期 | 2026-04-24(预览版) |

| 开源仓库 | huggingface.co/deepseek-ai/DeepSeek-V4-Flash |

| 总参数 | 284B(专家混合模型 MoE) |

| 激活参数 | 13B |

| 上下文窗口 | 1M tokens |

| 最大输出 | 384K tokens |

| 注意力架构 | 混合注意力 Hybrid Attention(CSA + HCA) |

| 推理模式 | Thinking / Non-Thinking 双模式 |

| Function Calling | ✅ 支持 |

| JSON 模式 | ✅ 支持 |

| Chat Prefix Completion | Beta 支持 |

| API 协议 | OpenAI ChatCompletions + Anthropic 双兼容 |

| 输入价格 | $0.14 / M tokens |

| 输出价格 | $0.28 / M tokens |

下面把这 5 项升级逐一拆开讲。

1.2 升级 1:1M 上下文 + 384K 输出(原生超长)

deepseek-v4-flash 原生支持 1M tokens 输入、384K tokens 输出。这是整个 V4 系列的统一规格,Flash 并没有为了便宜而缩水上下文。

什么场景能吃下 1M?

| 内容类型 | 大致 token 数 |

|---|---|

| 10 万字中文书稿 | ≈ 150K tokens |

| 200 页 PDF 技术文档 | ≈ 300K tokens |

| 一个中型代码仓库(~50 个文件) | ≈ 500K–800K tokens |

| 整本《红楼梦》 | ≈ 1M tokens |

对比 GPT-5.4(400K)、Claude Opus 4.6(1M + 1M 上下文包)、Gemini 3.1-Pro(2M),V4-Flash 的 1M 已经是行业主流配置,而它的价格比前三者便宜 5–20 倍。

1.3 升级 2:284B/13B MoE + Hybrid Attention

V4-Flash 用了 DeepSeek 2026 引入的两个关键架构创新:

- MoE(专家混合模型):总参数 284B,每 token 只激活 13B。效果接近一个 13B 密集模型但知识面接近 200B+ 密集模型

- Hybrid Attention(混合注意力)(CSA 压缩稀疏注意力 + HCA 高度压缩注意力):专门为长上下文设计

效率实测数据(来自 DeepSeek 官方):

| 指标 | V3.2 | V4-Flash | 提升 |

|---|---|---|---|

| 1M 上下文单 token 推理 FLOPs | 100% | 27% | -73% |

| 1M 上下文 KV 缓存占用 | 100% | 10% | -90% |

这两组数字解释了为什么 Flash 能把价格压到 $0.14:底层算力成本真的降下来了,不是硬补贴。

1.4 升级 3:Thinking / Non-Thinking 双模式

V4-Flash 一个模型 ID 就能切两种模式:

- Non-Thinking(默认):快,适合闲聊、问答、分类、摘要

- Thinking:模型会先输出一段内部推理(类似 OpenAI o 系列),然后再给出最终答案。适合复杂推理、多步工具调用、代码调试

调用时通过请求参数切换(不是两个 model id),开发者侧改动极小。在 APIYI api.apiyi.com 上调用时,这个参数名和 DeepSeek 官方完全一致。

1.5 升级 4:$0.14 / $0.28 每 M tokens

这是本次发布最惊人的一组数字:

| 模型 | 输入 ($/M) | 输出 ($/M) | 相对 V4-Flash |

|---|---|---|---|

| deepseek-v4-flash | 0.14 | 0.28 | 1×(基准) |

| deepseek-v4-pro | 1.74 | 3.48 | 12× |

| GPT-5.4(参考) | 2.50 | 10.00 | 17×–35× |

| Claude Sonnet 4.6(参考) | 3.00 | 15.00 | 21×–53× |

一个典型的 "500 tokens 输入 + 500 tokens 输出" 请求:

- V4-Flash:$0.000 21 ≈ ¥0.0015

- GPT-5.4:$0.006 25 ≈ ¥0.045

- Claude Sonnet 4.6:$0.009 ≈ ¥0.065

Flash 便宜了 30–40 倍。对月调用量上亿 tokens 的产品来说,这直接决定毛利率。

1.6 升级 5:OpenAI + Anthropic 双协议兼容

V4-Flash 在 API 层同时实现了两套协议:

POST /v1/chat/completions→ OpenAI 格式POST /v1/messages→ Anthropic 格式

这意味着:

| 客户端 | 迁移成本 |

|---|---|

| OpenAI Python/Node SDK | 零修改,只改 base_url 和 model |

| Anthropic Python/Node SDK | 零修改,只改 base_url 和 model |

| Claude Code | 换个 Anthropic endpoint 即可 |

| OpenClaw / OpenCode | 原生支持 |

| LangChain / LlamaIndex | 换 base_url 即可 |

这是 DeepSeek 本次版本一个非常聪明的决策:不逼你学新协议,让存量生态零成本接入。

1.7 Benchmark 实测对比表

| Benchmark | V4-Flash | V4-Pro | 差距 |

|---|---|---|---|

| SWE-bench Verified(代码修复) | 79.0% | 82.1% | -3.1 |

| Terminal-Bench 2.0(多步工具用) | 56.9% | 67.9% | -11.0 |

| SimpleQA-Verified(事实召回) | 34.1% | 57.9% | -23.8 |

| Artificial Analysis Intelligence Index | 45 / 47 | 58 | -11 ~ -13 |

解读:Flash 在单步代码任务(SWE-bench)上几乎追平 Pro,但在需要多步工具链(Terminal-Bench)和事实记忆(SimpleQA)上差距明显。这两个差距正是判断"选 Flash 还是 Pro"的决策依据。

二、deepseek-v4-flash vs V4-Pro 场景决策

2.1 一张决策矩阵:先看这里

| 场景 | 推荐 | 理由 |

|---|---|---|

| 日常对话、闲聊、问答 | Flash | 能力完全够用,价格 1/12 |

| 客服机器人、FAQ 系统 | Flash | 吞吐高、延迟低 |

| 代码补全、单文件修改 | Flash | SWE-bench 79%,接近 Pro |

| 长文档摘要、读一本书 | Flash | 1M 上下文全给到 |

| 多步工具链 Agent | Pro | Terminal-Bench 差 11 分 |

| 深度研究、多轮查证 | Pro | SimpleQA 差 24 分 |

| 高价值商业报告生成 | Pro | Intelligence Index 高 11+ |

| 研发 / 探索型实验 | Flash | 便宜 12 倍,迭代快 |

通用法则:默认用 Flash,遇到瓶颈再升 Pro。这和做技术选型时"先用简单方案、有瓶颈再升级"的原则一致。

2.2 性价比测算:什么规模下 Flash 省钱更狠

假设你的产品每日调用 1 亿 tokens(输入 6 千万 + 输出 4 千万):

| 模型 | 日成本 | 月成本 | 年成本 |

|---|---|---|---|

| V4-Flash | $19.6 | $588 | $7 056 |

| V4-Pro | $243.6 | $7 308 | $87 696 |

| GPT-5.4(参考) | $550 | $16 500 | $198 000 |

Flash 一年省 $80K+ vs Pro。这笔钱够再养半个开发了。

2.3 混合路由:生产环境的最佳实践

大多数产品的最优解不是二选一,而是按请求类型动态路由:

def route_model(request_type: str) -> str:

# 根据请求类型自动分发模型

if request_type in ("chat", "faq", "summarize", "classify"):

return "deepseek-v4-flash"

if request_type in ("deep_research", "multi_step_agent"):

return "deepseek-v4-pro"

return "deepseek-v4-flash" # 默认走 Flash

🎯 落地建议:我们建议你在 APIYI apiyi.com 平台同时保留 V4-Flash 和 V4-Pro 两个模型调用权限。两者共用一把 Key,只要改

model字段就能切换。批量任务推荐走vip.apiyi.com高并发线路,Pro 的复杂任务走主站api.apiyi.com,不同业务可以在同一个配置里做 AB 流量分配。

三、5 分钟在 APIYI apiyi.com 调用 deepseek-v4-flash

3.1 Step 1:前置环境与拿 Key

| 项 | 要求 |

|---|---|

| Python 或 Node.js | Python 3.8+ / Node.js 18+ |

| 客户端 SDK | OpenAI Python openai >= 1.0 或 官方 Node SDK |

| 网络 | 可访问 api.apiyi.com |

| Key | 在 APIYI apiyi.com 控制台生成,以 sk- 开头 |

拿 Key:

- 访问

apiyi.com,注册/登录后进入控制台 - 左侧菜单 → API Keys → 新建密钥

- 建议设置「使用额度上限」为 ¥50–100 做初期验证

- 复制以

sk-开头的密钥字符串

3.2 Step 2:选择线路(base_url)

APIYI提供三条线路,共用同一把 Key:

| base_url | 定位 | 推荐场景 |

|---|---|---|

https://api.apiyi.com/v1 |

主站 | 默认首选,日常调用 |

https://vip.apiyi.com/v1 |

高并发 | 批量跑图/推理、夜间队列 |

https://b.apiyi.com/v1 |

备用 | 主站波动时自动 fallback |

日常开发用主站即可,生产环境遇到 429 限流或 5xx 抖动再切 VIP/备用。

3.3 Step 3:Python 最小调用示例(Non-Thinking)

from openai import OpenAI

client = OpenAI(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com/v1",

)

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "system", "content": "你是一个简洁的助手"},

{"role": "user", "content": "用三点总结 DeepSeek V4-Flash 的核心升级"},

],

max_tokens=512,

)

print(resp.choices[0].message.content)

改动点只有两处:

base_url指向api.apiyi.commodel改成deepseek-v4-flash

其他 OpenAI SDK 代码原样保留。

3.4 Step 4:启用 Thinking 推理模式

需要深度推理时,在请求里加 reasoning 参数:

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[

{"role": "user", "content": "证明:给定 n 个点,最少需要多少条直线覆盖所有点对?"},

],

extra_body={

"reasoning": {"enabled": True, "effort": "high"},

},

max_tokens=8192,

)

# 返回里会带 reasoning_content 字段

print("思考过程:", resp.choices[0].message.reasoning_content)

print("最终答案:", resp.choices[0].message.content)

Thinking 模式下耗时会增加 2–5 倍(取决于问题复杂度),但代码/数学题的准确率显著上升。

3.5 Step 5:Node.js 最小调用示例

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_API_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const resp = await client.chat.completions.create({

model: "deepseek-v4-flash",

messages: [

{ role: "user", content: "Write a haiku about 2026 AI" },

],

max_tokens: 256,

});

console.log(resp.choices[0].message.content);

3.6 Step 6:Function Calling 示例

tools = [{

"type": "function",

"function": {

"name": "get_weather",

"description": "Get current weather for a city",

"parameters": {

"type": "object",

"properties": {"city": {"type": "string"}},

"required": ["city"],

},

},

}]

resp = client.chat.completions.create(

model="deepseek-v4-flash",

messages=[{"role": "user", "content": "今天上海天气怎么样?"}],

tools=tools,

)

print(resp.choices[0].message.tool_calls)

V4-Flash 在单次工具调用场景里稳定性非常好。多步复杂工具链(5+ 步)时建议升级到 V4-Pro。

3.7 Step 7:Anthropic 协议调用

如果你的项目是基于 Anthropic SDK 开发的(比如集成了 Claude Code),照样能用:

from anthropic import Anthropic

client = Anthropic(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com",

)

resp = client.messages.create(

model="deepseek-v4-flash",

max_tokens=1024,

messages=[{"role": "user", "content": "Hi"}],

)

print(resp.content[0].text)

🎯 双协议建议:同一个 deepseek-v4-flash 模型,OpenAI 协议走

api.apiyi.com/v1,Anthropic 协议走api.apiyi.com(无/v1)。切换时只动 base_url 一个字段。更多协议细节可参考 APIYI官方文档docs.apiyi.com的 DeepSeek 专栏。

四、从旧模型迁移到 deepseek-v4-flash 的完整路径

4.1 为什么必须迁移:90 天倒计时

DeepSeek 官方公告明确:

Legacy models

deepseek-chatanddeepseek-reasonerretire July 24, 2026.

Please update your model todeepseek-v4-proordeepseek-v4-flash.

2026-07-24 之后,继续使用旧 model id 的请求将直接返回错误。从发布日 2026-04-24 算起,总共 90 天缓冲期。

4.2 迁移决策表

按你当前使用的模型,对应新模型:

| 旧 model id | 新 model id | 迁移难度 |

|---|---|---|

deepseek-chat |

deepseek-v4-flash(Non-Thinking 模式) |

⭐ 只改 1 个字段 |

deepseek-reasoner |

deepseek-v4-flash + Thinking 模式 |

⭐⭐ 改 model + 加 reasoning 参数 |

deepseek-reasoner(高价值场景) |

deepseek-v4-pro + Thinking 模式 |

⭐⭐ 改 model + 加 reasoning 参数 |

deepseek-v3.x |

deepseek-v4-flash |

⭐ 只改 model |

deepseek-coder 等专用 |

deepseek-v4-flash |

⭐ 只改 model(通用能力已覆盖) |

4.3 代码 Diff:几乎零改动

迁移前:

resp = client.chat.completions.create(

model="deepseek-chat", # ← 旧模型

messages=[...],

)

迁移后:

resp = client.chat.completions.create(

model="deepseek-v4-flash", # ← 改这一行

messages=[...],

)

如果同时要从 deepseek-reasoner 迁移:

resp = client.chat.completions.create(

- model="deepseek-reasoner",

+ model="deepseek-v4-flash",

messages=[...],

+ extra_body={"reasoning": {"enabled": True}},

)

4.4 迁移 Checklist

建议在迁移前跑一遍这份清单:

- 梳理所有代码里的

model=硬编码位置 - 评估

deepseek-reasoner的调用是否需要升级到 V4-Pro - 准备一组回归测试 prompt(20–50 条,覆盖核心业务)

- 在 APIYI

apiyi.com控制台把旧请求的每日上限临时收紧,强制触发迁移 - 新老模型 AB 跑 1 周,对比输出质量

- 监控 token 消耗曲线,确认成本没有意外上涨

- 更新内部文档和 Runbook

4.5 灰度发布建议

分 3 期:

| 期次 | 流量 | 周期 | 目标 |

|---|---|---|---|

| 第 1 期 | 5% | 第 1 周 | 验证协议和基本输出 |

| 第 2 期 | 30% | 第 2-3 周 | 对比关键指标(质量 + 成本) |

| 第 3 期 | 100% | 第 4 周 | 全量迁移,保留旧 Key 做紧急回滚 |

💡 紧急回滚:APIYI apiyi.com 的旧模型路由在 2026-07-24 之前保留兼容。迁移期间如果发现严重问题,把

model改回deepseek-chat/deepseek-reasoner即可立即恢复。但千万别拖到 7 月底才动工。

خامساً: الأسئلة الشائعة حول deepseek-v4-flash

س1: كيف أختار بين Flash و Pro؟

قاعدة ذهبية: ابدأ بـ Flash، وإذا واجهت عقبات انتقل إلى Pro. وإليك التفاصيل حسب السيناريو:

- المحادثات الفردية، الأسئلة الشائعة (FAQ)، التصنيف، التلخيص، وإكمال الأكواد البرمجية ← Flash

- سير عمل الوكيل (Agent) متعدد الخطوات (أكثر من 5 خطوات لاستدعاء الأدوات) ← Pro

- مهام البحث العميق ← Pro

- إذا كنت غير متأكد، جرب Flash أولاً، وإذا لم تكن النتائج مرضية، قم بالترقية.

س2: هل يمكنني فعلاً الاستفادة من نافذة سياق بحجم 1M؟

نعم، ولكن انتبه لما يلي:

- أول 100K–300K: يكون تركيز نموذج اللغة الكبير في أعلى مستوياته، وهو الأفضل أداءً.

- 300K–800K: يظل الأداء مستقراً.

- 800K–1M: قد تنخفض دقة استرجاع المعلومات، لذا يُفضل وضع المعلومات الحساسة في بداية أو نهاية السياق.

- تذكير بالتكلفة: 1M من الرموز (tokens) للإدخال تكلف حوالي 0.14 دولار، وهي ليست باهظة ولكنها ليست مجانية.

نوصي باستخدام هيكل: "ضع السؤال في البداية + المواد في المنتصف + أعد التأكيد على السؤال في النهاية" عند التعامل مع النصوص الطويلة.

س3: كيف يتم تفعيل وضع التفكير (Thinking)؟

في بروتوكول OpenAI، يتم تفعيله عبر extra_body.reasoning.enabled=true. يمكنك اختيار قيمة المعامل effort من بين low / medium / high، والقيمة الافتراضية هي medium. على منصة APIYI api.apiyi.com، تتطابق المعاملات مع المواصفات الرسمية.

س4: هل استدعاء الدوال (Function Calling) مستقر في Flash؟

الاستدعاء الفردي مستقر جداً (بنسبة نجاح تزيد عن 95%). أما بالنسبة لسلاسل الأدوات متعددة الخطوات (أكثر من 5 خطوات)، فنوصي باستخدام Pro، حيث يظهر فارق الأداء (11 نقطة في Terminal-Bench 2.0) بوضوح في هذه الحالات.

س5: ما هو معدل التزامن (Concurrency) المعقول؟

بالنسبة للمطورين الأفراد، 10–20 طلباً متزامناً لا يمثل مشكلة. أما في بيئة الإنتاج، فنوصي بما يلي:

- الوضع الافتراضي: عبر

api.apiyi.comيمكنك الوصول إلى 50 طلباً متزامناً. - المهام المجمعة/الليلية: انتقل إلى

vip.apiyi.comللوصول إلى أكثر من 200 طلب متزامن. - حالات الطوارئ: استخدم

b.apiyi.comكخيار احتياطي مؤقت.

يرجى مراجعة أحدث قيود الحصص على docs.apiyi.com.

س6: كيف أقيم مخاطر الترحيل؟

اتبع هذه الخطوات الثلاث:

- جودة المخرجات: قارن بين 20–50 موجه (prompt) نموذجي باستخدام اختبار (AB Testing)، وقم بالتقييم يدوياً أو عبر نموذج تقييم.

- منحنى التكلفة: راقب استهلاك الرموز اليومي؛ عادة ما ينتج Flash رموزاً أكثر قليلاً (يظهر هذا بوضوح في وضع التفكير).

- زمن الاستجابة (Latency): زمن الوصول للرمز الأول (TTFT) في Flash قريب من V3.5، بينما يكون وضع التفكير أبطأ بـ 2–5 مرات.

إذا تجاوز تراجع الجودة 10%، فكر في الترقية إلى Pro، وإلا يمكنك الترحيل بثقة.

س7: كيف أستخدم توافق بروتوكول Anthropic؟

لا تضف /v1 إلى base_url؛ قم باستدعاء POST /v1/messages مباشرة. في حقل model الخاص بـ Anthropic SDK، أدخل deepseek-v4-flash. هذا هو الطريق الأسرع للمشاريع التي تستخدم Claude SDK بالفعل للانتقال دون أي تعديلات برمجية.

س8: هل توجد خصومات على التخزين المؤقت للسياق (Context Caching)؟

تم تفعيل التخزين المؤقت التلقائي للسياق في V4-Flash، مما يعني أن الطلبات التي تحتوي على بادئات متكررة ستكون تكلفتها أقل. في سيناريوهات الموجهات النظامية (System Prompts) الطويلة، يمكنك توفير 30–50% من التكاليف. هذا الخصم مفعل افتراضياً على منصة APIYI apiyi.com دون الحاجة لإعدادات إضافية.

سادساً: ملخص إطلاق deepseek-v4-flash

مع إطلاق DeepSeek V4، هناك حقيقتان أساسيتان للمطورين:

- أصبح أرخص: يقدم V4-Flash أداءً يقارب Pro بجزء بسيط من التكلفة (1/12)، حيث سجل سعر 0.14 دولار لكل مليون رمز إدخال، وهو رقم قياسي جديد في الصناعة.

- الموعد النهائي: سيتم إيقاف النماذج القديمة رسمياً في 24-07-2026، وقد بدأ العد التنازلي لفترة السماح (90 يوماً) من تاريخ الإطلاق.

الخبر السار هو أن deepseek-v4-flash متاح الآن على APIYI apiyi.com، ولن تحتاج إلى إنشاء حسابات خارجية، أو تعديل SDK، أو القلق بشأن بوابات الدفع. يمكنك البدء في ثلاث خطوات:

- ✅ احصل على مفتاح API من لوحة تحكم

apiyi.com. - ✅ وجه

base_urlإلىapi.apiyi.com/v1(أو استخدم الخيارات الاحتياطيةvip.apiyi.com/b.apiyi.com). - ✅ اضبط

modelعلىdeepseek-v4-flashواترك باقي الكود كما هو.

🎯 نصيحة عملية: نوصي بشدة ببدء اختبار AB لـ deepseek-v4-flash اليوم. احصل على مفتاح مخصص من APIYI apiyi.com، وشغل 20–50 موجه (prompt) نموذجي، وقارن جودة المخرجات والتكلفة مع النموذج السابق. إذا لم يكن هناك تراجع ملحوظ، يمكنك تحويل 5% من حركة المرور هذا الأسبوع، وإكمال الترحيل الكامل خلال 4 أسابيع—وهذا أسهل بكثير من الاستعجال قبل حلول شهر يوليو. لمزيد من حالات الترحيل ونصوص الاختبار (benchmark)، راجع قسم DeepSeek V4 على

docs.apiyi.com.

إن قيمة deepseek-v4-flash لا تكمن في كونه "مجرد نموذج رخيص آخر"، بل في كونه "جعل السيناريوهات التي كانت حكراً على الشركات الكبرى متاحة للجميع بسعر معقول"، مثل قراءة كتب كاملة في سياق واحد، أو إجراء استنتاجات معقدة بوضع التفكير، أو ربط الأدوات عبر استدعاء الدوال، كل ذلك بتكلفة زهيدة جداً. هذا سيفتح فرصاً جديدة للمنتجات، ومن يبادر بالترحيل أولاً سيسبق الجميع.

الكاتب: فريق APIYI التقني

موارد ذات صلة:

- الإعلان الرسمي لـ DeepSeek: api-docs.deepseek.com/news/news260424

- مستودع المصادر المفتوحة على Hugging Face: huggingface.co/deepseek-ai/DeepSeek-V4-Flash

- موقع APIYI الرسمي: apiyi.com

- وثائق APIYI: docs.apiyi.com

- الموقع الرئيسي لـ APIYI: api.apiyi.com (الخيار الاحتياطي: vip.apiyi.com / b.apiyi.com)