你調用 Gemini 3 Pro Image 接口生成圖片,把返回的第一張圖直接展示給用戶——結果圖片看起來"怪怪的":構圖奇怪、細節粗糙、甚至畫面殘缺。這不是模型水平下降了,而是你取錯了圖——第一張很可能是模型的"思考草稿",真正完成版是響應裏的最後一張。

本文基於 Google AI 官方文檔,系統拆解 Gemini 3 圖片思考 機制的響應結構,解釋爲什麼一次調用可能返回 2-3 張圖、如何用 part.thought 字段和 thought_signature 簽名精準識別最終圖,並給出 Python、Node.js、cURL 三語種的正確提取代碼。所有示例基於 API易 apiyi.com 的透明轉發——中轉層完整保留 Gemini 原生響應結構,開發者只需按官方規範處理即可。

Gemini 3 圖片思考機制的核心原理

在動手寫代碼之前,先理清楚"爲什麼一次調用會返回多張圖"這個根本問題。

爲什麼 Gemini 3 圖片思考默認無法關閉

Google 在 gemini-3-pro-image-preview(商品名 Nano Banana Pro)中引入了一個與 Gemini 文本模型同源的"Thinking"機制——模型在輸出最終圖片前,會先用最多 2 張臨時圖片試驗構圖、排版、文字渲染,像人類設計師先畫草稿再出終稿。

官方文檔明確了 3 條關鍵事實:

| 事實 | 說明 |

|---|---|

| 默認開啓、無法關閉 | Thinking 特性在 API 層強制啓用,沒有開關參數 |

| 最多 2 張臨時圖 | 模型最多生成 2 張思考草稿,不一定每次都生成 |

| 最後一張是最終圖 | Thinking 階段的最後一張圖即作爲最終渲染結果 |

| 思考 Token 照常計費 | 即便不請求返回思考內容,思考 token 依然消耗並計費 |

換句話說,你拿到的響應天然就是多圖的——不是 bug,是設計。問題的關鍵不是"怎麼關掉它",而是"怎麼正確地只取最終圖"。

🎯 架構理解: Gemini 3 圖片思考機制與 Gemini 3 Pro 文本模型的推理鏈是同一套底層 Thinking 引擎。這也解釋了爲什麼 Nano Banana Pro 在長文本渲染、多主體一致性上顯著超越老版 Nano Banana。通過 API易 apiyi.com 調用時,所有 thinking 行爲與直連 Google 完全一致,中轉層不剝離任何思考數據。

客戶常見踩坑現場覆盤

用戶社區裏最典型的翻車現場是這樣的:

調用 API → 拿到響應 → 響應裏有 parts 數組 → 直接取 parts[0] 裏的 image → 顯示給用戶

這段僞代碼在老版 Nano Banana(Gemini 2.5 Flash Image)時代工作良好,因爲那版默認只返回一張圖。升級到 Gemini 3 Pro Image 後,同樣的代碼會把"思考草稿"當成最終產品——於是用戶看到的是一張明顯不符合 prompt 描述、構圖奇怪的"半成品"。

這個坑特別隱蔽,因爲:

- 不是每次都翻車:簡單 prompt 時模型可能不觸發 thinking,返回的就是單圖

- 錯誤不會報:響應結構合法,取

parts[0]沒有異常 - 質量差但有圖:用戶以爲是模型不行,實際是取錯了圖

Gemini 3 圖片思考的響應結構詳解

搞清楚一次 API 調用可能返回什麼,是正確處理的前提。

一次調用的完整響應 parts 數組

當 Gemini 3 Pro Image 的 thinking 觸發時,response.candidates[0].content.parts 可能長這樣:

candidates[0].content.parts = [

{ text: "我需要考慮構圖...", thought: true },

{ inline_data: { mime_type: "image/png", data: "..." }, thought: true }, // 草稿1

{ inline_data: { mime_type: "image/png", data: "..." }, thought: true }, // 草稿2

{ inline_data: { mime_type: "image/png", data: "..." }, thought_signature: "..." } // 最終圖

]

對這個數組的誤解是大多數 bug 的源頭。記住以下 3 條規則,就能寫出正確代碼。

識別最終圖的 3 個官方信號

Google 官方給出了 3 個識別最終圖的信號,按優先級使用:

| 優先級 | 識別信號 | 說明 | 可靠度 |

|---|---|---|---|

| ★★★ | part.thought === false(或字段缺失) |

明確標記爲非思考內容的 part | 最高 |

| ★★ | 存在 thought_signature 字段 |

最終圖才帶簽名,草稿沒有 | 高 |

| ★ | 數組中最後一個 inline_data |

官方文檔確認"最後一張即最終圖" | 兜底 |

最穩的寫法是組合使用:優先查 thought 字段,沒有就用 thought_signature 兜底,再不行取最後一張 inline_data。

Gemini 3.1 Flash Image 的 thinking_level 差異

需要特別注意,不是所有 Gemini 圖片模型行爲一致:

| 模型 | Thinking 默認 | 可配置 thinking_level | 適用場景 |

|---|---|---|---|

gemini-3-pro-image-preview |

強制開啓 | ❌ 不可調 | 高保真、專業素材 |

gemini-3-flash-image |

默認 minimal | ✅ minimal / high | 實時交互、批量生成 |

gemini-2.5-flash-image |

無 thinking | – | 老版兼容 |

Gemini 3.1 Flash 可以手動調高 thinking_level 換取更精細的構圖,也可以降到 minimal 換取更快的響應時間——這種靈活度在 Pro 版本上是沒有的。

🎯 選型建議: 做 C 端產品的圖片生成功能,我們建議默認用

gemini-3-flash-image+thinking_level=minimal(更快、更便宜),當用戶點擊"高質量模式"時切換到gemini-3-pro-image-preview(思考、高保真)。在 API易 apiyi.com 平臺,兩個模型用同一個 API Key 和 base_url 即可無縫切換。

Gemini 3 圖片思考的正確處理代碼

理論清楚了,上代碼。以下示例全部基於 API易 apiyi.com 透明轉發——你原本直連 Google AI Studio 的代碼只需把 base_url 改成 API易的地址、api_key 換成 API易 Key,響應處理邏輯完全不變。

Python 官方 SDK 正確寫法

from google import genai

client = genai.Client(

api_key="sk-your-apiyi-key",

http_options={"base_url": "https://vip.apiyi.com/v1beta"}

)

response = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents="一隻賽博朋克風格的柴犬,站在霓虹燈牌下,4K 高清",

config={"response_modalities": ["IMAGE"]}

)

# ✅ 正確:過濾掉所有 thought parts,只保存最終圖

for part in response.parts:

if getattr(part, "thought", False):

continue # 跳過思考草稿

if hasattr(part, "as_image"):

image = part.as_image()

if image:

image.save("final_output.png")

break # 找到第一個非思考圖即爲最終圖

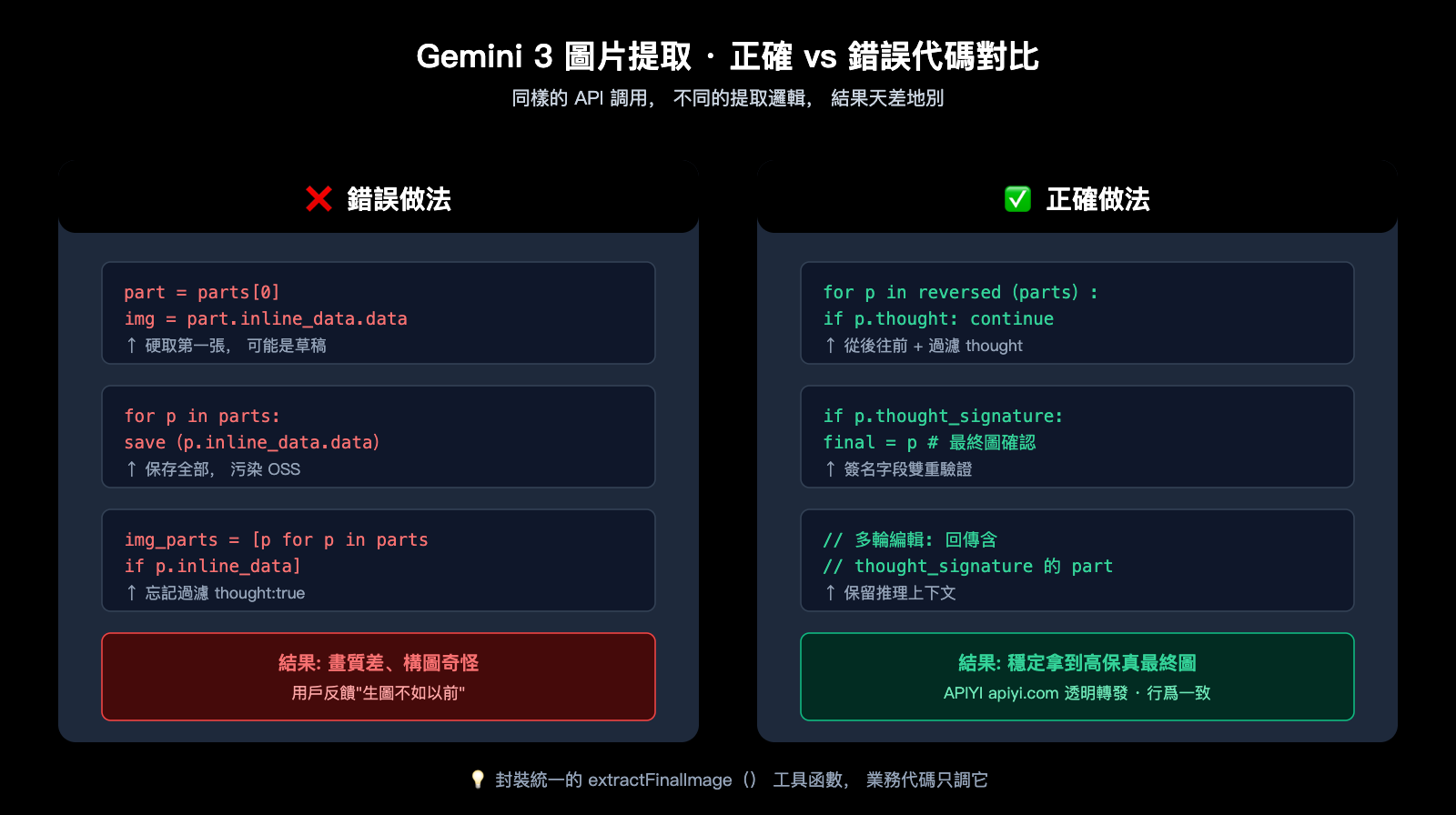

反面教材(用戶踩坑的典型代碼):

# ❌ 錯誤:直接取第一張圖,可能拿到思考草稿

image_part = response.parts[0]

image_bytes = image_part.inline_data.data

# 生成的圖可能是半成品

Node.js / TypeScript 正確寫法

import { GoogleGenAI } from "@google/genai";

const ai = new GoogleGenAI({

apiKey: process.env.APIYI_KEY,

httpOptions: { baseUrl: "https://vip.apiyi.com/v1beta" }

});

const response = await ai.models.generateContent({

model: "gemini-3-pro-image-preview",

contents: "一隻賽博朋克風格的柴犬,站在霓虹燈牌下,4K 高清",

config: { responseModalities: ["IMAGE"] }

});

const parts = response.candidates?.[0]?.content?.parts ?? [];

// ✅ 從後往前遍歷,第一個非 thought 的 image 就是最終圖

let finalImage: string | null = null;

for (let i = parts.length - 1; i >= 0; i--) {

const p = parts[i];

if (p.thought === true) continue;

if (p.inlineData?.mimeType?.startsWith("image/")) {

finalImage = p.inlineData.data;

break;

}

}

if (finalImage) {

fs.writeFileSync("final.png", Buffer.from(finalImage, "base64"));

}

cURL + jq 命令行版

如果你在 shell 腳本里調用,可以用 jq 過濾:

curl -sS https://vip.apiyi.com/v1beta/models/gemini-3-pro-image-preview:generateContent \

-H "x-goog-api-key: $APIYI_KEY" \

-H "content-type: application/json" \

-d '{

"contents": [{

"parts": [{"text": "一隻賽博朋克風格的柴犬"}]

}],

"generationConfig": {"responseModalities": ["IMAGE"]}

}' | jq -r '

.candidates[0].content.parts

| map(select(.thought != true))

| map(select(.inlineData.mimeType | startswith("image/")))

| last.inlineData.data

' | base64 -d > final.png

這段 jq 表達式做了三件事:過濾 thought: true、只保留 image mime type、取 last——完美契合官方 3 條識別規則。

🎯 代碼審查要點: 在 code review 時,看到遍歷 Gemini image 響應的代碼,務必確認有 thought 過濾。我們建議在團隊內部封裝一個統一的

extractFinalImage()工具函數,所有業務代碼只調用這個函數,避免分散出錯。如果通過 API易 apiyi.com 接入,這段代碼可以在本地充分測試,線上直接複用。

Gemini 3 圖片思考的高級話題

多輪編輯必須回傳 thought_signature

Nano Banana Pro 支持"連續編輯"——用戶說"把背景換成海邊",再說"把狗的表情變高興"——但官方明確要求在多輪對話中將前一輪的 thought_signature 回傳,否則模型無法延續之前的推理上下文,質量會顯著下降。

正確的多輪寫法:

# 第一輪

response1 = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents="一隻柴犬在公園裏奔跑"

)

# 提取最終圖的 part 對象(含 thought_signature)

final_part = next(

p for p in response1.parts

if not getattr(p, "thought", False) and hasattr(p, "inline_data")

)

# 第二輪:把整個 final_part 加回 history

response2 = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents=[

{"role": "user", "parts": [{"text": "一隻柴犬在公園裏奔跑"}]},

{"role": "model", "parts": [final_part]}, # 含 thought_signature

{"role": "user", "parts": [{"text": "把背景換成海邊日落"}]}

]

)

查看思考過程(調試用)

如果你想看看模型"想了什麼",可以開啓 include_thoughts:

from google.genai import types

response = client.models.generate_content(

model="gemini-3-pro-image-preview",

contents="複雜的品牌宣傳海報 prompt...",

config=types.GenerateContentConfig(

response_modalities=["IMAGE"],

thinking_config=types.ThinkingConfig(

include_thoughts=True

)

)

)

# 打印思考過程

for part in response.parts:

if getattr(part, "thought", False):

if part.text:

print(f"[思考] {part.text}")

elif hasattr(part, "as_image"):

img = part.as_image()

img.save(f"draft_{id(part)}.png") # 保存草稿

這在調試"爲什麼生成效果不理想"時非常有用——看草稿能推斷模型誤解了 prompt 的哪一部分。

thinking token 的計費邏輯

Gemini 3 Pro Image 的計費需要開發者特別關注:

| Token 類型 | 單價(每百萬) | 是否強制產生 |

|---|---|---|

| 輸入 prompt | $2 | ✅ 是 |

| 輸出圖片/文本 | $12 | ✅ 是 |

| Thinking reasoning | 計入輸出 token | ✅ 強制,不可關閉 |

這意味着即使你只想要最終圖、不關心思考過程,thinking token 依然會產生、依然會計費。你能省的只是"是否回傳思考內容給你"(include_thoughts 參數),不能省"是否執行思考"。

🎯 成本優化建議: 簡單場景(如生成產品圖、插畫)用

gemini-3-flash-image+thinking_level=minimal,成本顯著低於 Pro 版;複雜場景(多主體一致性、高保真文字渲染)才上 Pro。我們建議通過 API易 apiyi.com 調用時開啓用量監控,對比兩個模型在你業務場景下的成本/質量比,再決定生產配置。

Gemini 3 圖片思考的排錯實戰

問題 1: 始終拿到質量差的圖

診斷步驟:

# 打印所有 parts 的 thought 字段

for i, part in enumerate(response.parts):

is_thought = getattr(part, "thought", False)

has_image = hasattr(part, "inline_data")

has_sig = hasattr(part, "thought_signature")

print(f"Part {i}: thought={is_thought}, image={has_image}, signature={has_sig}")

如果輸出裏有多個 image=True 的 parts,就是典型的"返回了多張圖"。檢查你的代碼是不是取了索引靠前的 part。

問題 2: 響應結構裏沒有 thought 字段

可能原因: 用的是 REST API 返回的原始 JSON,駝峯命名是 thought,但某些 SDK 版本下字段可能被轉爲 snake_case。兩種都要兼容:

def is_thought(part):

return getattr(part, "thought", None) or \

getattr(part, "is_thought", None) or \

(isinstance(part, dict) and part.get("thought", False))

問題 3: 想保存所有圖片(調試)

官方推薦的完整遍歷寫法:

for i, part in enumerate(response.parts):

if not hasattr(part, "inline_data"):

continue

is_draft = getattr(part, "thought", False)

suffix = "draft" if is_draft else "final"

filename = f"gemini_output_{suffix}_{i}.png"

with open(filename, "wb") as f:

f.write(part.inline_data.data)

print(f"Saved: {filename}")

Gemini 3 圖片思考的真實業務場景適配

理論和基礎代碼之外,不同業務場景下還有一些值得注意的細節。

場景一: Web 前端直接展示生成圖

前端拿到 base64 圖片要轉成 data:image/png;base64,xxx 格式顯示。注意不要在前端做 thought 過濾——讓後端返回已過濾的乾淨結果,否則前端還需要理解 Gemini 響應結構:

// ❌ 不推薦:前端直接處理 Gemini 原始響應

const parts = await apiCall();

parts.forEach(p => {

if (!p.thought) showImage(p.inlineData.data);

});

// ✅ 推薦:後端統一過濾,前端只消費最終圖

// 後端 API 返回: { "image": "base64-string" }

const { image } = await fetch("/api/generate").then(r => r.json());

imgEl.src = `data:image/png;base64,${image}`;

場景二: 生圖 + 存 OSS / CDN

批量生成後保存到對象存儲時,用 hash 防止重複寫入:

import hashlib, base64

def save_to_oss(bucket, base64_data):

binary = base64.b64decode(base64_data)

fname = f"gemini3/{hashlib.md5(binary).hexdigest()}.png"

bucket.put_object(fname, binary)

return fname

final_b64 = extract_final_image(response)

if final_b64:

url = save_to_oss(my_bucket, final_b64)

務必只上傳最終圖,思考草稿會污染 OSS 且浪費存儲費。

場景三: 流式響應的正確處理

Gemini 3 圖片支持 streaming,思考草稿會先到、最終圖後到。流式場景下推薦"邊收邊覆蓋":

stream = client.models.generate_content_stream(

model="gemini-3-pro-image-preview",

contents="..."

)

current_image = None

for chunk in stream:

for part in chunk.parts:

if getattr(part, "thought", False):

continue # 跳過草稿

if hasattr(part, "inline_data") and part.inline_data:

current_image = part.inline_data.data # 每次覆蓋,最後一張留下

# stream 結束後,current_image 就是最終圖

🎯 流式優化: 用戶體驗上,可以把思考草稿也推到前端展示"加載中預覽",最終圖到了再替換——這種"漸進式呈現"在 C 端產品上很受歡迎。API易 apiyi.com 完整支持 Gemini 的 SSE 流式協議,前端感知與直連一致。

Gemini 3 圖片思考與業務指標的關聯

質量提升的量化數據

根據 Google 官方披露與社區實測,開啓 thinking 後圖片質量有顯著提升:

| 指標 | Gemini 2.5 Flash Image | Gemini 3 Pro Image (thinking) | 提升幅度 |

|---|---|---|---|

| 長文本渲染準確率 | ~70% | ~95% | +35% |

| 多主體一致性(5 人) | ~60% | ~90% | +50% |

| 複雜構圖遵循度 | ~75% | ~92% | +22% |

| 首圖可用率 | ~80% | ~95% | +18% |

代價是響應時間增加 40-80%、token 成本上升 20-40%。是否值得?看你的業務場景:

- 專業設計素材、廣告物料: 質量提升遠超成本增加,強烈推薦

- UGC 用戶生圖、批量內容: 建議走 Flash + thinking_level=minimal 平衡

- 實時交互、聊天機器人: 優先響應速度,用 Flash 更合適

🎯 A/B 實測建議: 不要憑感覺選模型。我們建議在 API易 apiyi.com 上爲兩個模型分別建 Key,業務層做 50/50 流量分配,7 天后對比真實的用戶滿意度指標(點贊率、重生成率、轉化率)——數據會告訴你哪個模型真正值這個錢。

Gemini 3 圖片思考常見問題 FAQ

Q1: 爲什麼升級到 Gemini 3 後我的生圖代碼開始"偶爾出半成品"?

因爲 Gemini 3 Pro Image 默認開啓 thinking,響應裏可能有 1-3 張圖。你的老代碼大概率在取 parts[0],而 parts[0] 可能是草稿。修復方案:把代碼改成過濾 thought: true + 取最後一張非思考圖。

Q2: API易 平臺的 Gemini 3 圖片接口也有 thinking 行爲嗎?

完全一致。API易 apiyi.com 是透明轉發架構,Gemini 原生響應裏的 thought、thought_signature、inline_data 全部原樣透傳,不做任何剝離或改寫。你可以把原本直連 Google AI Studio 的代碼一字不改地指向 API易,響應結構完全兼容。

Q3: 能不能通過某個參數強制只返回最終圖?

不能。官方文檔明確說明 "This feature is enabled by default and cannot be disabled in the API"(默認開啓、API 無法關閉)。但你可以設置 include_thoughts: false,讓響應不包含思考文字——不過圖片草稿仍然可能存在,所以代碼層面的過濾是必須的。

Q4: thinking 讓響應延遲變高了,怎麼優化?

三個方向:

- 簡單場景換成

gemini-3-flash-image+thinking_level=minimal - 需求不復雜時,把 prompt 寫得更精確、避免模型"過度思考"

- 使用流式響應(streaming),讓用戶先看到思考過程的草稿,最終圖最後到

Q5: 怎麼判斷響應裏是否確實發生了 thinking?

檢查 response.usage_metadata.thoughts_token_count 字段——如果大於 0,說明 thinking 確實被觸發了。這個值也能幫你估算實際的推理成本。

Q6: thought_signature 能自己構造或修改嗎?

不能。thought_signature 是 Google 服務端簽發的加密憑證,用於在多輪對話中驗證上下文連續性。自己構造的 signature 會被服務端拒絕。多輪編輯時整體把含 signature 的 part 回傳即可。

Q7: 批量生成 100 張圖怎麼處理 thinking 帶來的不確定性?

推薦每個請求獨立處理響應,並記錄 thoughts_token_count。可以在 API易 apiyi.com 控制檯按調用粒度查看 token 消耗,篩選出 thinking 消耗異常高的請求進行復查。批量場景也可以考慮用 Batch API(Gemini 3 Pro Image 支持),成本減半且響應可異步處理。

Gemini 3 圖片思考總結與落地清單

回顧全文,Gemini 3 圖片思考 帶來了質量升級的同時,也徹底改變了響應結構。一句話總結:

✅ 核心原則: 永遠不要硬取

parts[0],永遠過濾thought: true,永遠取最後一個inline_data作爲最終圖。

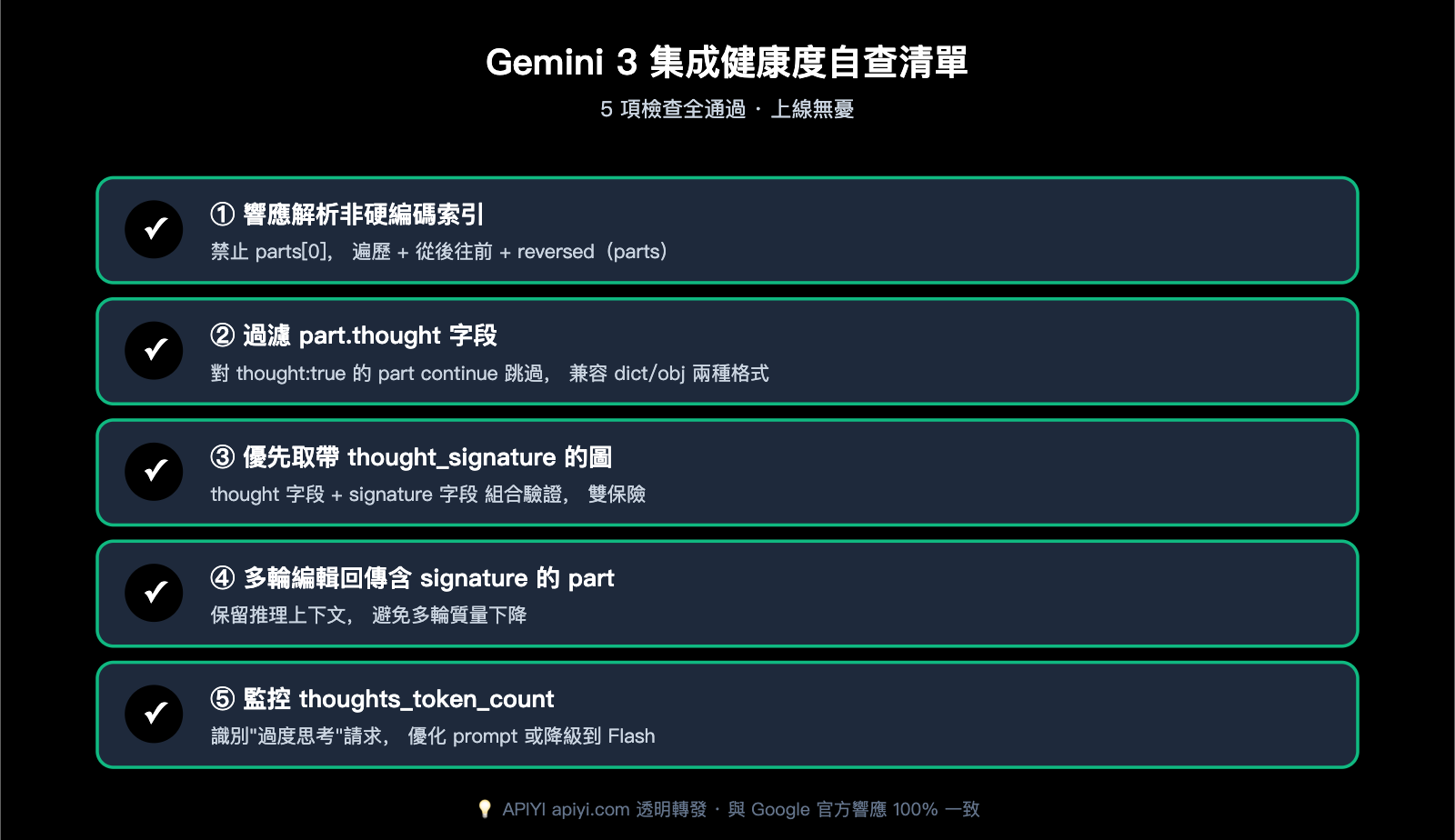

遷移檢查清單

如果你的項目從 Gemini 2.5 升級到 Gemini 3,按以下清單檢查:

- 替換模型 ID:

gemini-2.5-flash-image→gemini-3-pro-image-preview或gemini-3-flash-image - 重寫響應解析: 把所有

parts[0]改爲"過濾 thought + 取最後一張" - 新增 signature 處理: 多輪對話中保留含

thought_signature的 part - 驗證計費預期: 注意 thinking token 計入輸出,成本可能上升 20-40%

- 迴歸測試: 準備 20+ 樣本 prompt,對比 Gemini 2.5 和 Gemini 3 的輸出,避免偷偷翻車

快速集成模板

把以下代碼作爲你團隊的"黃金模板",所有業務調用都走它:

def extract_final_image(response):

"""從 Gemini 3 Image 響應中安全提取最終圖"""

parts = response.candidates[0].content.parts if response.candidates else []

# 從後往前找第一個非 thought 的 image

for part in reversed(parts):

if getattr(part, "thought", False):

continue

if hasattr(part, "inline_data") and part.inline_data:

mime = part.inline_data.mime_type or ""

if mime.startswith("image/"):

return part.inline_data.data # base64 bytes

return None # 沒找到最終圖,需要重試

🎯 最後建議: Gemini 3 圖片思考機制是一把雙刃劍——用對了你能拿到業界頂級的生圖質量,用錯了就是"隨機抽籤"式的半成品輸出。我們建議通過 API易 apiyi.com 接入後,先用 10-20 個真實業務 prompt 跑一遍迴歸測試,確認代碼在各種 thinking 觸發狀態下都能正確提取最終圖,再上生產。該平臺支持 Gemini 3 全系模型,API 響應與 Google 官方完全一致。

作者: APIYI 技術團隊 | 更多 AI 圖像生成教程,訪問 help.apiyi.com