24 апреля 2026 года компания DeepSeek одновременно представила модели V4-Pro и V4-Flash. Если Flash — это «рабочая лошадка» с отличным соотношением цены и качества, то V4-Pro — это продукт совершенно иного уровня:

Это самая мощная большая языковая модель с открытым исходным кодом для написания кода на сегодняшний день.

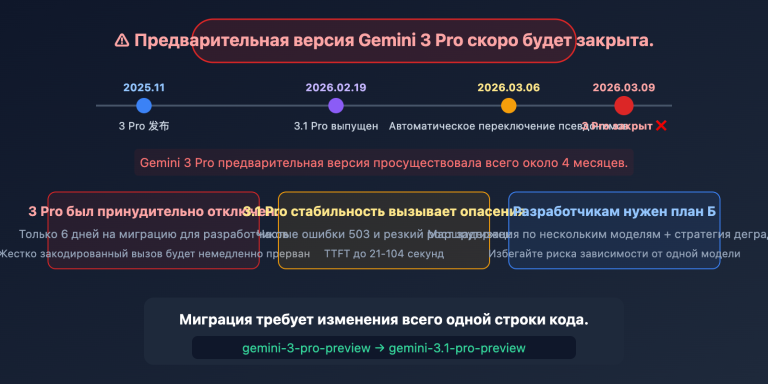

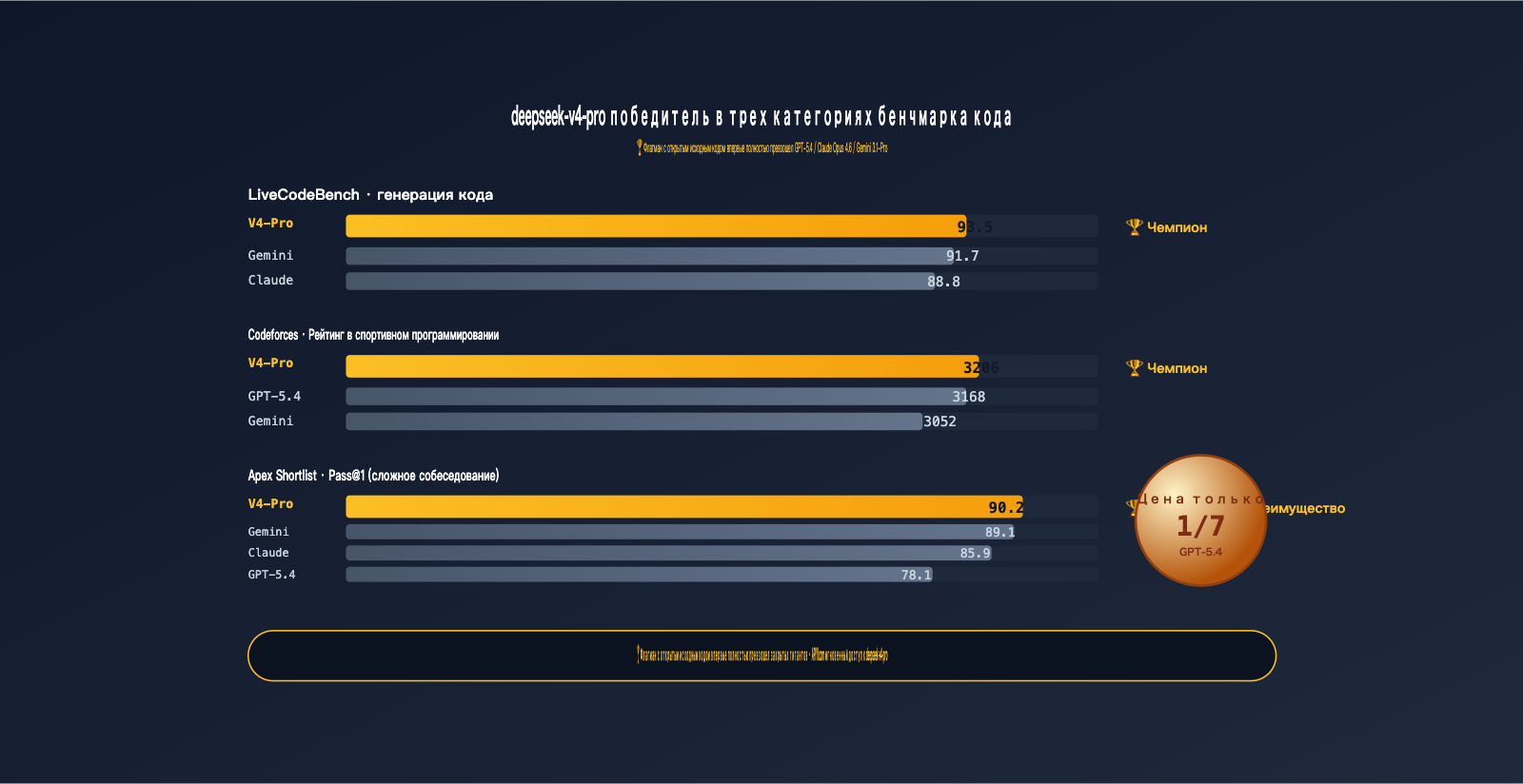

И это не просто вежливое уточнение «лучшая среди открытых моделей», а реальный чемпион, который по «сухим» цифрам обходит GPT-5.4, Claude Opus 4.6 и Gemini 3.1-Pro:

- LiveCodeBench: 93.5 — первое место, опережает Gemini 3.1-Pro (91.7) и Claude Opus 4.6 (88.8).

- Codeforces Rating: 3206 — выше, чем у GPT-5.4 (3168) и Gemini 3.1-Pro (3052).

- Apex Shortlist Pass@1: 90.2 — значительный отрыв от GPT-5.4 (78.1) и Claude (85.9).

- IMOAnswerBench: 89.8 — в задачах математических олимпиад модель опережает Claude Opus 4.6 (75.3) на целых 14 баллов.

Технические характеристики впечатляют: 1.6 трлн общих параметров / 49 млрд активных параметров / 32 трлн токенов для предварительного обучения / контекстное окно 1 млн токенов / 384 тыс. токенов на вывод. Кроме того, в серии V4 DeepSeek реализовала четыре архитектурных инновации: Hybrid Attention, Manifold-Constrained Hyper-Connections (mHC), Engram Conditional Memory и Muon Optimizer.

Модель deepseek-v4-pro уже доступна на платформе APIYI (apiyi.com). Вы можете подключить её без изменения кода, используя SDK для OpenAI или Anthropic, а цена при этом в 7 раз ниже, чем у GPT-5.4.

В этой статье мы не будем повторять основы миграции или выбора бюджетных моделей — это уже было разобрано в обзоре Flash. Это руководство для тех, кто хочет выжать максимум из флагманской deepseek-v4-pro:

- 3 минуты, чтобы понять, почему Pro по праву называется «флагманом» (архитектура + данные + масштаб).

- 4 сравнительные таблицы бенчмарков: где Pro побеждает, а где уступает.

- 5 минут на подключение + 2 практических кейса: написание кода и решение математических задач.

一、 Четыре флагманские возможности deepseek-v4-pro

1.1 Краткий обзор ключевых характеристик

| Параметр | deepseek-v4-pro |

|---|---|

| Дата выпуска | 24.04.2026 (превью-версия) |

| Репозиторий | huggingface.co/deepseek-ai/DeepSeek-V4-Pro |

| Общее количество параметров | 1.6T (Mixture of Experts) |

| Активные параметры | 49B |

| Данные для предобучения | > 32T токенов |

| Контекстное окно | 1M токенов |

| Максимальный вывод | 384K токенов |

| Архитектурные инновации | Hybrid Attention + mHC + Engram Memory + Muon |

| Режим вывода | Двойной режим: Thinking / Non-Thinking |

| Function Calling | ✅ Поддерживается |

| JSON-режим | ✅ Поддерживается |

| API-протокол | Двойная совместимость: OpenAI + Anthropic |

| Цена за вход | $1.74 / M токенов |

| Цена за выход | $3.48 / M токенов |

Запомните 4 главные цифры: 1.6T / 49B / 32T / 1M — это фундамент флагманской производительности.

1.2 1.6T / 49B MoE: «потолок» для open-source

Общее количество параметров DeepSeek-V4-Pro составляет 1.6 триллиона. Модель использует архитектуру Mixture of Experts, при этом на каждый токен активируется всего 49B параметров. Что это значит:

| Модель | Общие параметры | Активные параметры | Тип |

|---|---|---|---|

| Llama 3 70B | 70B | 70B | Dense (полная активация) |

| Mistral Large 2 | 123B | 123B | Dense |

| DeepSeek-V3.2 | 671B | 37B | MoE |

| DeepSeek-V4-Pro | 1.6T | 49B | MoE ⭐ |

| Claude Opus 4.6 | Не разглашается | Не разглашается | Закрытая |

Общие параметры в 1.6T обеспечивают модели базу знаний уровня GPT-5.4 / Claude Opus, а активные параметры в 49B позволяют удерживать стоимость вывода одного токена под контролем — именно в этом секрет того, почему архитектура MoE показывает такие передовые результаты.

1.3 Предобучение на 32T токенах: максимум данных

Данные для предобучения > 32T токенов

Цифра, которая впечатляет:

- Данные для предобучения GPT-4 — около 13T токенов (по оценкам индустрии)

- Llama 3 — 15T токенов

- DeepSeek-V3 — 14.8T токенов

- DeepSeek-V4-Pro: >32T токенов ⭐

Прямой результат удвоения объема данных: более полное покрытие «длинного хвоста» знаний, актуальные программные корпуса и глубокая база математических задач. Именно поэтому V4-Pro лидирует в рейтингах LiveCodeBench и IMOAnswerBench.

1.4 Четыре архитектурные инновации: настоящий «ров» модели Pro

Это то, что отличает V4-Pro от «очередной MoE-модели». Четыре ключевых инновации:

| Инновация | Полное название | Какую проблему решает |

|---|---|---|

| Hybrid Attention | Гибридное внимание CSA + HCA | FLOPs и проблемы с VRAM при работе с длинным контекстом (1M) |

| mHC | Manifold-Constrained Hyper-Connections | Стабильность глубоких остаточных связей, предотвращение затухания/взрыва градиентов |

| Engram | Engram Conditional Memory | Разделение «статических фактов» и «способности к рассуждению», упрощение обновления фактов |

| Muon | Оптимизатор Muon | Скорость сходимости обучения и стабильность, снижение затрат на обучение |

Разберем подробнее:

-

Hybrid Attention (CSA + HCA): Сложность внимания в классическом Transformer составляет O(n²), что при 1M контекста приводит к катастрофе. V4 использует сжатое разреженное внимание (CSA) для грубой фильтрации и высокосжатое внимание (HCA) для детальной фокусировки. В сумме это снижает FLOPs до 27% от уровня V3.2, а KV-кэш — до 10%. Это ключ к тому, что 1M контекста в deepseek-v4-pro реально работает.

-

mHC (Manifold-Constrained Hyper-Connections): При обучении глубоких MoE-моделей сигналы остаточных связей искажаются после нескольких десятков слоев. mHC накладывает ограничения в пространстве многообразий, делая передачу сигнала стабильнее. Проще говоря: модель можно обучать глубже и дольше без «развала».

-

Engram Conditional Memory: Инженерная инновация. Она отделяет «факты в памяти модели» от «способности к рассуждению» — факты хранятся в специальном модуле, а цепочка рассуждений идет по другому пути. Результат: при обновлении мировых знаний не нужно переобучать всю модель, что значительно снизит стоимость будущих обновлений Pro.

-

Muon Optimizer: Оптимизатор собственной разработки DeepSeek. По сравнению с AdamW он сходится быстрее и работает стабильнее. При масштабе в триллионы параметров это значит, что при тех же затратах вычислительных мощностей обучение проходит полнее.

🎯 Технический вывод: deepseek-v4-pro — это не просто масштабирование старой архитектуры, а полная переработка инфраструктуры. Это основа того, как модель в open-source состоянии достигает уровня закрытых гигантов. Если планируете глубокое использование, рекомендую сначала прогнать типичные промпты через APIYI (apiyi.com), чтобы прочувствовать разницу, особенно в задачах с длинным контекстом и многошаговыми рассуждениями.

1.5 Контекст 1M + вывод 384K: новая планка для генерации длинных текстов

Спецификации контекста у Pro и Flash идентичны: 1M токенов на вход, 384K на выход. Но преимущество Pro не в том, «сколько он может прочитать», а в том, «насколько глубоко он может мыслить при 1M токенов».

Практическое значение для работы с длинными текстами:

| Задача | Эра V3.2 | Эра V4-Pro |

|---|---|---|

| Правка рукописи в 500 тыс. знаков | Нужно разбивать на 10+ частей | Обработка целиком в окне 1M |

| Q&A по техдокументации на 200 стр. | Нужно строить RAG | Можно «скормить» целиком |

| Аудит среднего репозитория кода | Анализ через суммаризацию | Проверка согласованности между файлами |

| Связность в написании романа | Самостоятельное управление памятью | Вывод 384K одним махом |

二、 Трон бенчмарков deepseek-v4-pro

2.1 Навыки программирования: deepseek-v4-pro в лидерах

Посмотрим на «жесткие» данные — способности к программированию:

| Бенчмарк | V4-Pro | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1-Pro | Лидер |

|---|---|---|---|---|---|

| LiveCodeBench | 93.5 | — | 88.8 | 91.7 | V4-Pro 🏆 |

| Codeforces Rating | 3206 | 3168 | — | 3052 | V4-Pro 🏆 |

| Apex Shortlist Pass@1 | 90.2 | 78.1 | 85.9 | 89.1 | V4-Pro 🏆 |

| SWE-bench Verified | 80.6–82.1 | — | 80.8 | 80.6 | Ничья |

| Terminal-Bench 2.0 | 67.9 | 75.1 | 65.4 | 68.5 | GPT-5.4 |

Три лидерские позиции, две — «ничья или небольшое отставание». Впервые open-source модель полностью превосходит закрытые флагманы в программировании — это знаковое событие 2026 года.

Разбор:

- LiveCodeBench 93.5: Бенчмарк обновляется ежемесячно, что исключает «зазубривание» задач. Результат 93.5 говорит о том, что навыки V4-Pro — обобщенные, модель способна решать новые задачи.

- Codeforces 3206: Рейтинг соревновательного программирования, уровень IGM (международный гроссмейстер). Для повседневных задач это «избыточная мощность».

- Apex Shortlist Pass@1 90.2 vs GPT-5.4 78.1: Разрыв системный. Apex Shortlist — это сложные вопросы с собеседований, и здесь V4-Pro опережает конкурента на 12 процентных пунктов.

- Terminal-Bench 2.0: Здесь модель чуть слабее. Это работа с многошаговыми инструментами командной строки. GPT-5.4 сохраняет преимущество, что говорит о наличии «рва» в сценариях «сложных многошаговых агентов».

2.2 Математика и рассуждения: deepseek-v4-pro на передовой

В математике Pro и закрытые гиганты идут «ноздря в ноздрю»:

| Бенчмарк | V4-Pro | GPT-5.4 | Claude Opus 4.6 | Gemini 3.1-Pro |

|---|---|---|---|---|

| MMLU-Pro | 87.5 | 87.5 | 89.1 | 91.0 |

| IMOAnswerBench | 89.8 | 91.4 | 75.3 | 81.0 |

| HMMT 2026 | 95.2 | 97.7 | 96.2 | — |

| MATH | 92% | — | — | — |

| HumanEval | 90% | — | — | — |

| MMLU | 89% | — | — | — |

Главный успех — IMOAnswerBench: задачи Международной математической олимпиады. V4-Pro набрал 89.8 баллов, опередив Claude Opus 4.6 на 14.5 баллов и Gemini 3.1-Pro на 8.8 баллов. В задачах на математические рассуждения и формальные доказательства Pro сейчас — потолок для open-source.

Слабое место — MMLU-Pro (общие знания): 87.5 баллов — это уровень GPT-5.4, но на 3.5 балла ниже Gemini 3.1-Pro. В сценариях ответов на общие вопросы Gemini все еще имеет преимущество.

2.3 Карта сражений: где выигрывает и проигрывает deepseek-v4-pro

| Сценарий | Лидер | Позиция V4-Pro |

|---|---|---|

| Генерация кода (LiveCodeBench) | V4-Pro 🏆 | Чемпион |

| Соревновательное программирование | V4-Pro 🏆 | Чемпион |

| Сложные собеседования (Apex) | V4-Pro 🏆 | Чемпион (значительный отрыв) |

| Разработка ПО (SWE-bench) | Ничья | Разделенное первое место |

| Математические олимпиады (IMO) | GPT-5.4 | Второе (намного выше Claude/Gemini) |

| Общие знания (MMLU-Pro) | Gemini 3.1-Pro | Третье |

| Многошаговые инструменты (Terminal-Bench) | GPT-5.4 | Второе |

| Логические рассуждения (HMMT) | GPT-5.4 | Третье |

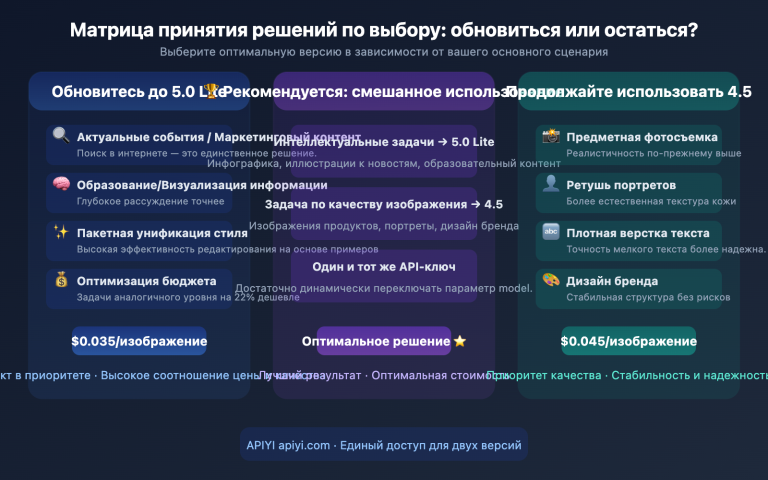

Вывод: Если ваша работа в основном связана с кодом, deepseek-v4-pro — один из сильнейших инструментов на планете. Если приоритет — многошаговые агентские цепочки, у GPT-5.4 есть небольшое преимущество; если общие знания — Gemini 3.1-Pro сильнее.

🎯 Совет по выбору: Рекомендуем прогнать AB-тест (20–50 запросов) ваших типичных промптов через APIYI (apiyi.com) для сравнения V4-Pro с текущей моделью. Не верьте слепо публичным бенчмаркам — ваше собственное распределение промптов является единственным реальным бенчмарком. Для массовых AB-тестов рекомендуем использовать высокопроизводительную линию

vip.apiyi.com.

三、5 分钟在 APIYI apiyi.com 调用 deepseek-v4-pro

3.1 Step 1:获取 API-ключ и выбор маршрута

Предварительные требования: Python 3.8+ или Node.js 18+, официальный SDK OpenAI или Anthropic (на ваш выбор).

Получение ключа:

- Зайдите на APIYI

apiyi.com, перейдите в консоль → API Keys → Создать новый ключ. - Рекомендуем установить отдельный дневной лимит для ключа Pro (¥200–500, в зависимости от масштаба ваших задач).

- Скопируйте ключ, начинающийся с

sk-.

Выбор маршрута (все три маршрута используют один и тот же ключ):

| base_url | Назначение |

|---|---|

https://api.apiyi.com/v1 |

Повседневные вызовы, интерактивные сценарии |

https://vip.apiyi.com/v1 |

Пакетные задачи, высокая нагрузка |

https://b.apiyi.com/v1 |

Резервный канал на случай сбоев основного сайта |

3.2 Step 2:Минимальный вызов на Python (без Thinking)

from openai import OpenAI

client = OpenAI(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com/v1",

)

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a senior Python engineer."},

{"role": "user", "content": "Write a production-ready LRU cache in 30 lines."},

],

max_tokens=2048,

)

print(resp.choices[0].message.content)

Нужно изменить только две вещи: base_url и model — остальной код OpenAI SDK остается без изменений.

3.3 Step 3:Включение режима рассуждения Thinking (главное преимущество Pro)

Истинная мощь deepseek-v4-pro раскрывается только в режиме Thinking. Результаты в тестах, таких как IMOAnswerBench (89.8) и LiveCodeBench (93.5), были получены именно в этом режиме.

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "user", "content": """

Пожалуйста, реализуйте потокобезопасный ограничитель частоты (rate limiter) типа token bucket, требования:

1. Поддержка динамической настройки скорости

2. Поддержка резервирования для пикового трафика

3. Реализация без блокировок (CAS или атомарные операции)

4. Включая полные модульные тесты

"""},

],

extra_body={

"reasoning": {"enabled": True, "effort": "high"},

},

max_tokens=16384,

)

print("--- Процесс рассуждения ---")

print(resp.choices[0].message.reasoning_content)

print("\n--- Итоговый ответ ---")

print(resp.choices[0].message.content)

При effort=high модель Pro проводит глубокое планирование — вы увидите, как она сначала анализирует требования, затем проектирует API, обсуждает различные варианты реализации и только в конце выдает код. Это то, за что стоит доплатить по сравнению с версией Flash.

3.4 Step 4:Практика исправления кода

Реальный бизнес-сценарий: просим Pro исправить баг.

buggy_code = """

def find_kth_largest(nums, k):

nums.sort()

return nums[k] # ОШИБКА здесь

"""

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "system", "content": "You are a senior code reviewer. Identify bugs, explain root cause, and give fixed code."},

{"role": "user", "content": f"Review this code:\n```python\n{buggy_code}\n```"},

],

extra_body={"reasoning": {"enabled": True}},

max_tokens=4096,

)

print(resp.choices[0].message.content)

Pro укажет, что индекс должен быть -k (после сортировки k-й по величине элемент находится на k-й позиции с конца), а также предоставит исправление + обработку граничных условий (k <= 0, k > len(nums)) + тестовые примеры.

Показатель SWE-bench 80%+ в таких сценариях ощущается на практике именно так.

3.5 Step 5:Вызов функций / Использование инструментов (Function Calling)

Pro очень стабилен в одношаговых вызовах инструментов, а в многошаговых цепочках инструментов, хотя и уступает GPT-5.4, все же опережает Claude:

tools = [

{

"type": "function",

"function": {

"name": "run_sql",

"description": "Execute a read-only SQL query on the analytics DB.",

"parameters": {

"type": "object",

"properties": {

"query": {"type": "string", "description": "SELECT-only SQL"},

},

"required": ["query"],

},

},

},

]

resp = client.chat.completions.create(

model="deepseek-v4-pro",

messages=[

{"role": "user", "content": "Топ-5 городов по DAU за последние 30 дней?"},

],

tools=tools,

tool_choice="auto",

)

print(resp.choices[0].message.tool_calls)

3.6 Step 6:Протокол Anthropic (подключение Claude Code к Pro)

Это наиболее недооцененная возможность deepseek-v4-pro: вы можете заменить базовую модель во всех ваших существующих проектах на Claude SDK / Claude Code на V4-Pro, не меняя ни строчки бизнес-логики.

from anthropic import Anthropic

client = Anthropic(

api_key="sk-your-apiyi-key",

base_url="https://api.apiyi.com", # Обратите внимание: без /v1

)

resp = client.messages.create(

model="deepseek-v4-pro",

max_tokens=4096,

messages=[

{"role": "user", "content": "Рефактори этот Python код в стиле async/await..."},

],

)

print(resp.content[0].text)

Терминал Claude Code: в настройках укажите ANTHROPIC_BASE_URL=https://api.apiyi.com + ANTHROPIC_API_KEY=sk-... и смените модель на deepseek-v4-pro, чтобы мгновенно получить терминального агента с превосходными навыками программирования.

3.7 Step 7:Подключение deepseek-v4-pro в Cursor

В Cursor перейдите в Settings → Models → Custom OpenAI-Compatible:

- Base URL:

https://api.apiyi.com/v1 - API Key:

sk-... - Model Name:

deepseek-v4-pro

После этого в чате Cursor, Cmd+K и Composer будет использоваться V4-Pro, что заметно улучшит качество автодополнения и рефакторинга кода.

🎯 Совет по настройке IDE: Cursor, Windsurf, Cline, Continue и другие популярные AI-инструменты для программирования совместимы с протоколом OpenAI. Просто укажите

base_urlна APIYIapi.apiyi.com/v1и смените модель наdeepseek-v4-proдля бесшовного перехода. Подробные примеры настройки IDE можно найти в разделе DeepSeek V4 в официальной документации APIYIdocs.apiyi.com.

Четвертое: когда выбирать deepseek-v4-pro, а когда нет

4.1 Условия выбора Pro

✅ Выбирайте deepseek-v4-pro для следующих задач:

| Сценарий | Почему |

|---|---|

| Генерация, рефакторинг и аудит кода | Лидер LiveCodeBench с результатом 93.5 |

| Спортивное программирование, решение алгоритмических задач | Уровень Codeforces 3206 (эквивалент IGM) |

| Пакетное решение задач для собеседований | Apex Shortlist 90.2, значительный отрыв |

| Математические рассуждения, формальные доказательства | IMOAnswerBench 89.8, опережает Claude на 14 баллов |

| Понимание больших кодовых баз | Контекстное окно 1M + 49B активных параметров |

| Написание и редактирование длинных текстов | Вывод 384K за один проход |

| Локальное развертывание / дообучение | Открытые веса + модуль Engram для удобного файн-тюнинга |

| Замена базовой модели в Cursor / Claude Code | Подключение через протокол Anthropic без доработок |

4.2 Когда Pro не нужен

❌ Не тратьте вычислительные мощности Pro в этих случаях:

| Сценарий | Рекомендация |

|---|---|

| Повседневные диалоги, FAQ | Используйте Flash (дешевле в 12 раз) |

| Классификация коротких текстов, извлечение данных | Используйте Flash или более легкие модели |

| Сложные многошаговые цепочки агентов | Отдайте предпочтение GPT-5.4 (лидер в Terminal-Bench) |

| Общие справочные вопросы | Gemini 3.1-Pro сильнее |

| Интерактив, чувствительный к задержкам | Используйте Flash (режим Non-Thinking) или кэширование |

4.3 Рекомендации по гибридной маршрутизации

Оптимальное решение для продакшена — это многоуровневая маршрутизация:

def pick_model(request_type: str, complexity: str) -> str:

# Сложные задачи по коду → Pro

if request_type in ("code_gen", "code_review", "refactor") and complexity == "hard":

return "deepseek-v4-pro"

# Математические рассуждения → Pro

if request_type in ("math_proof", "competitive_programming"):

return "deepseek-v4-pro"

# Глубокое понимание длинных документов → Pro

if request_type == "long_doc_analysis":

return "deepseek-v4-pro"

# Остальное → Flash

return "deepseek-v4-flash"

На APIYI apiyi.com обе модели используют один и тот же ключ, для переключения достаточно изменить поле model, не меняя остальные настройки.

V. Часто задаваемые вопросы (FAQ) по deepseek-v4-pro

Q1: Почему у Pro такие мощные способности к написанию кода?

Здесь работают три фактора одновременно:

- Предварительное обучение на 32T токенах, включающее огромное количество качественных корпусов кода.

- Архитектура 1.6T MoE / 49B активных параметров, позволяющая хранить и эффективно извлекать знания о коде.

- Режим Thinking (мышления) + Engram Memory, которые разделяют «запоминание паттернов кода» и «логический вывод нового кода».

Ни один из этих факторов по отдельности не дал бы такого результата, но вместе они обеспечили 93.5 балла в LiveCodeBench.

Q2: Не будет ли модель с 1.6T параметров работать слишком медленно?

Скорость ответа зависит от активных параметров, а не от общего количества. Pro активирует всего 49B на токен, а благодаря оптимизации FLOPs в Hybrid Attention задержка первого токена близка к Flash-версии. Режим Thinking работает медленнее (из-за вывода процесса рассуждения), но это осознанный компромисс — вы платите временем за качество логики.

Q3: Обязательно ли включать режим Thinking?

Не обязательно. Для обычных диалогов, простого кода или повседневных вопросов его можно отключить. Однако большая часть ценности Pro заключается именно в режиме Thinking — для сложного кода, математических задач и многошаговой логики обязательно используйте reasoning.enabled=true + effort=high.

Q4: Как использовать в Cursor / Claude Code?

- Cursor: Settings → Models → Custom OpenAI-Compatible, в поле Base URL введите

https://api.apiyi.com/v1, в поле Model —deepseek-v4-pro. - Claude Code: установите переменные окружения

ANTHROPIC_BASE_URL=https://api.apiyi.com+ANTHROPIC_API_KEY=sk-..., при запуске укажите модельdeepseek-v4-pro.

Пошаговые скриншоты можно найти в разделе интеграции с IDE на docs.apiyi.com.

Q5: Что выгоднее: Pro или GPT-5.4?

Если выбирать что-то одно:

- Повседневный код / соревнования / математика / чувствительность к цене → deepseek-v4-pro (лидер в коде, цена в 7 раз ниже).

- Многошаговые агентные цепочки / общие знания → GPT-5.4.

- Комбинированное использование — оптимальный вариант (используйте один API-ключ от APIYI apiyi.com для переключения между моделями).

Q6: Можно ли развернуть локально?

Да, полные веса V4-Pro выложены в открытый доступ на Hugging Face (deepseek-ai/DeepSeek-V4-Pro). Но для самостоятельного развертывания требуется:

- Оборудование: ≥ 8×H200 или эквивалентные GPU.

- Дополнительный KV-кэш для контекста 1M (хотя Pro уже сжал кэш до 10% от уровня V3.2).

- Инженерные ресурсы для поддержки работы сервиса вывода.

Расчет затрат: если ваш ежемесячный объем вызовов не превышает 50 млрд токенов, использование хостинга APIYI apiyi.com будет экономичнее, чем самостоятельная поддержка.

Q7: Какой лимит по количеству одновременных запросов?

Рекомендации для продакшена:

- Основной сайт

api.apiyi.com: 50 одновременных запросов. - Линия с высокой пропускной способностью

vip.apiyi.com: 200+ запросов. - Резервный адрес

b.apiyi.com: автоматический переход при сбоях на основной линии.

Учитывая высокую задержку Pro при сложных задачах Thinking, не всегда стоит гнаться за максимальным количеством потоков — лучше рассчитывать окно параллелизма исходя из формулы QPS × среднее время ответа.

Q8: Скоро ли выйдет официальная версия Pro?

Модель, выпущенная 24.04.2026, является предварительной версией (Preview). Судя по темпам DeepSeek, финальная версия обычно выходит через 1–2 месяца после превью и может иметь небольшие улучшения в бенчмарках. Использовать превью на APIYI apiyi.com можно уже сейчас — идентификатор модели deepseek-v4-pro с высокой вероятностью останется неизменным для обратной совместимости.

VI. Итоги запуска deepseek-v4-pro

Если вы пропустили основную часть, вот главные выводы:

- ✅ deepseek-v4-pro — самая мощная модель для кода с открытыми весами — она превзошла GPT-5.4 / Claude Opus 4.6 / Gemini 3.1-Pro в трех жестких бенчмарках: LiveCodeBench, Codeforces и Apex.

- ✅ Четыре архитектурных инновации (Hybrid Attention, mHC, Engram Memory, Muon) делают её не «еще одной большой языковой моделью», а новым видом, построенным на обновленной инфраструктуре.

- ✅ Масштаб 1.6T / 49B MoE + 32T токенов обучения + 1M контекста достигает потолка возможностей для открытых моделей.

- ✅ Уже доступна на APIYI apiyi.com, поддерживает двойной протокол OpenAI + Anthropic, подключается без доработок к Cursor, Claude Code, Cline и другим популярным инструментам.

- ✅ Цена в 7 раз ниже, чем у GPT-5.4, а режим Thinking раскрывает её истинный потенциал.

Для команд, работающих преимущественно с кодом, deepseek-v4-pro стоит протестировать немедленно — это не просто «более дешевая альтернатива», а флагманская модель, которая может стать новым стандартом.

🎯 Рекомендация к действию: получите API-ключ на APIYI

apiyi.comсегодня (выделите его специально для Pro, установите дневной лимит ¥200–500). Запустите 20 промптов, которые лучше всего отражают ваши задачи (код / математика / длинные тексты), и проведите AB-тестирование V4-Pro (в режиме Thinking) против вашей текущей основной модели. Если качество кода заметно вырастет, переключайте Cursor / Claude Code на эту модель. Если нужно распределить нагрузку на более дешевые модели, добавьте V4-Flash (см. предыдущее руководство по миграции). Для массового тестирования используйтеvip.apiyi.com, а для автоматического резервирования при сбоях —b.apiyi.com. Примеры интеграции и скрипты для бенчмарков можно найти наdocs.apiyi.com.

Значение deepseek-v4-pro выходит за рамки «еще одной дешевой SOTA-модели». Это знак того, что впервые открытая модель полностью подавляет закрытые флагманы в ключевой задаче программирования — и это стоит того, чтобы каждая серьезная AI-команда провела тщательное тестирование.

Автор: Техническая команда APIYI

Ресурсы:

- Официальный анонс DeepSeek: api-docs.deepseek.com/news/news260424

- Репозиторий на Hugging Face: huggingface.co/deepseek-ai/DeepSeek-V4-Pro

- Сайт APIYI: apiyi.com

- Документация APIYI: docs.apiyi.com

- Основной сайт APIYI: api.apiyi.com (резервные: vip.apiyi.com / b.apiyi.com)