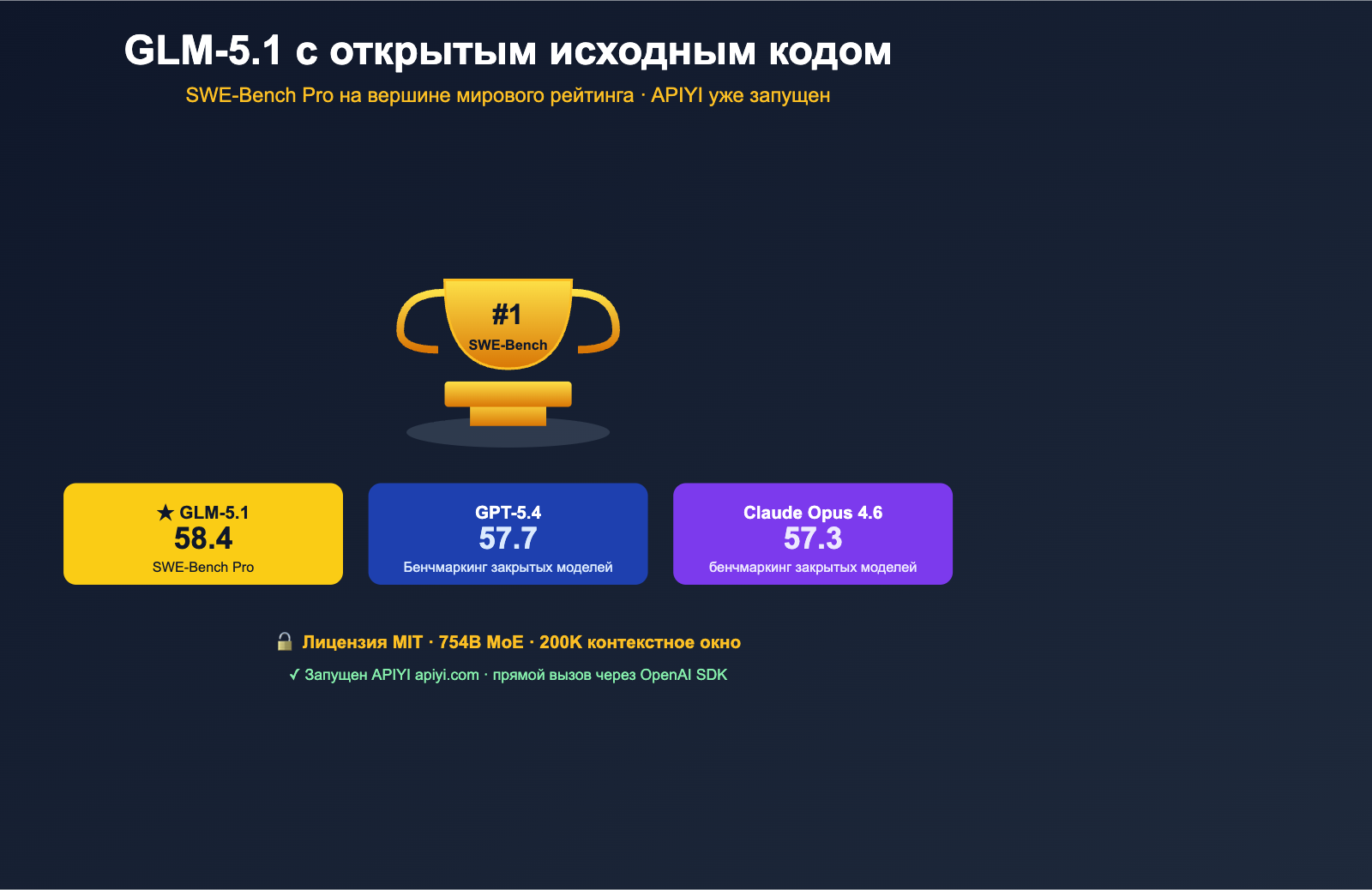

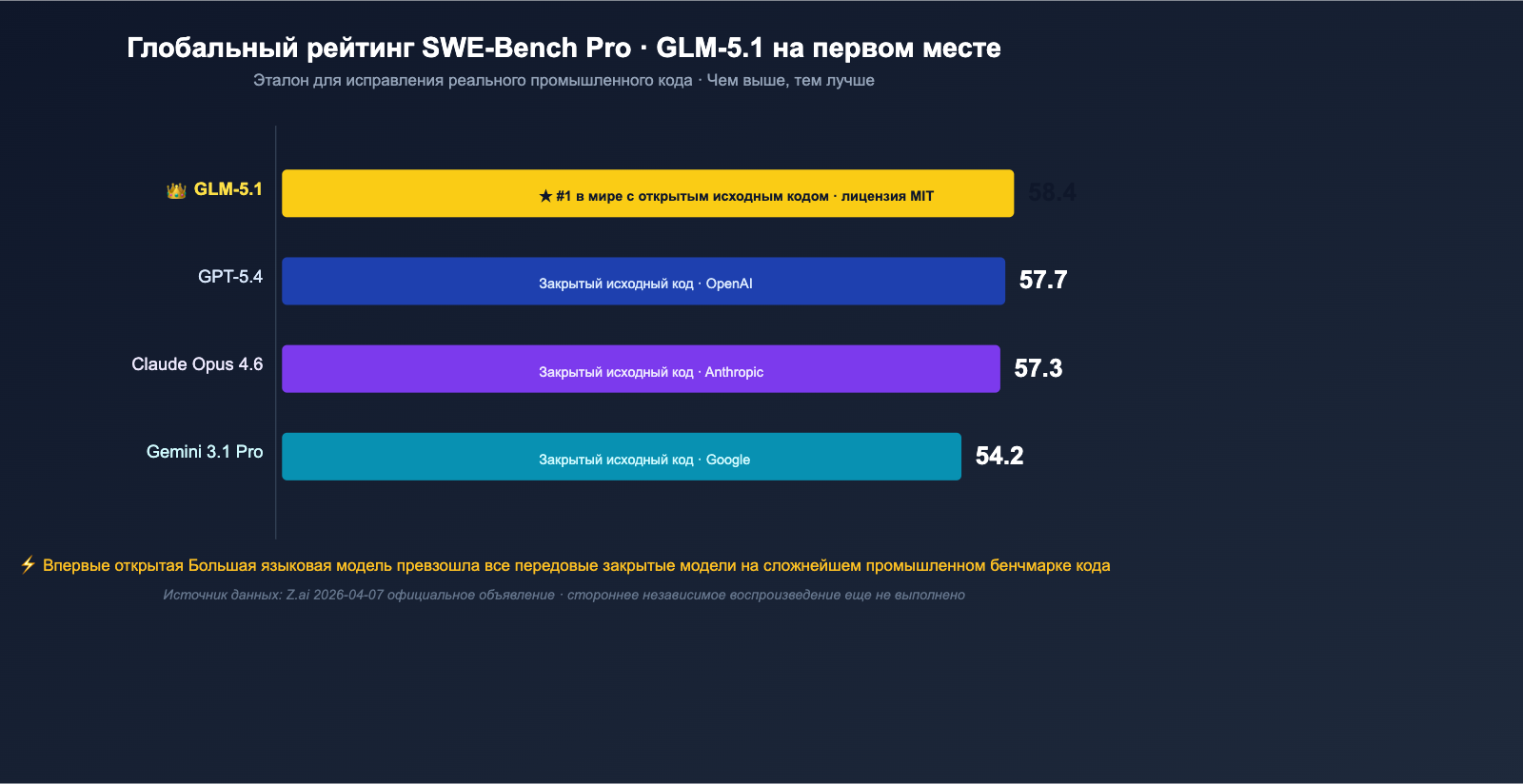

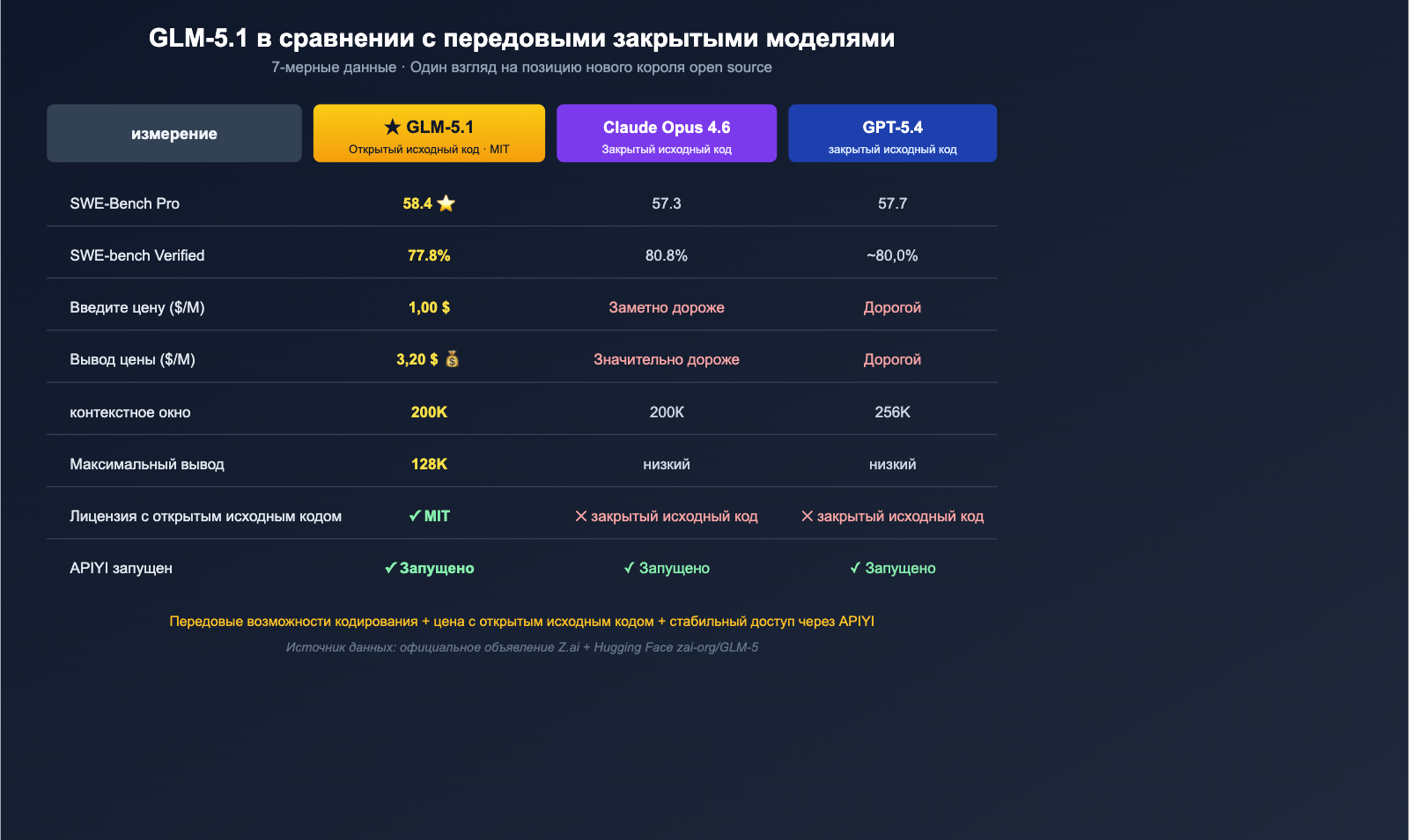

7 апреля 2026 года компания Z.ai (ранее известная как Zhipu AI) официально выложила полные веса модели GLM-5.1 в репозиторий Hugging Face zai-org/GLM-5 под лицензией MIT. Этот релиз произвел настоящий фурор в англоязычном AI-сообществе — и не потому, что это «просто еще одна открытая большая языковая модель», а потому, что она заняла первое место в мировом рейтинге SWE-Bench Pro с результатом 58,4 балла, обогнав GPT-5.4 (57,7 балла), Claude Opus 4.6 (57,3 балла) и Gemini 3.1 Pro (54,2 балла). Это первый случай, когда открытая модель превзошла все передовые закрытые решения в бенчмарке, который индустрия широко использует для оценки «реального исправления программного кода».

Для разработчиков из материкового Китая особенно важно, что API GLM-5.1 стал доступен практически мгновенно — сервис-прокси API APIYI (apiyi.com) уже завершил интеграцию. Вам больше не нужно самостоятельно скачивать веса с 754 млрд параметров с Hugging Face или подавать заявку на официальный аккаунт Z.ai. Достаточно просто изменить base_url в существующем OpenAI SDK, чтобы начать вызов модели. В этой статье мы подробно разберем GLM-5.1 по 7 параметрам: архитектура, бенчмарки, аппаратное обеспечение для обучения, ценообразование и способы подключения, а также приведем пример минимального кода для вызова GLM-5.1 через APIYI.

Краткий обзор ключевой информации о GLM-5.1 (версия за апрель 2026 г.)

Прежде чем углубляться в детали, давайте соберем все ключевые факты о GLM-5.1 в одной таблице.

| Параметр | Информация о GLM-5.1 |

|---|---|

| Разработчик | Z.ai (ранее Zhipu AI, вышла на биржу в Гонконге в январе 2026 г., оценка около $31,3 млрд) |

| Дата релиза | 7 апреля 2026 г. |

| Лицензия | MIT (разрешено коммерческое использование + модификация + создание закрытых производных моделей) |

| Репозиторий | huggingface.co/zai-org/GLM-5 |

| Архитектура | MoE (смесь экспертов), 754 млрд параметров всего / 40 млрд активных параметров |

| Контекстное окно | 200 000 токенов |

| Макс. выход | 128 000 токенов |

| Данные обучения | 28,5 трлн токенов (увеличение с 23 трлн в GLM-5) |

| Оборудование | Полностью на Huawei Ascend 910B + фреймворк MindSpore (без Nvidia / AMD) |

| Фреймворки развертывания | vLLM / SGLang / KTransformers |

| Ключевая способность | Агентное программирование с длинным контекстом (до 8 часов непрерывной работы над одной задачей) |

| Цена (прямой API) | $1,00 за 1 млн токенов на вход, $3,20 за 1 млн токенов на выход |

| Пакет для кодинга | GLM Coding Plan от $3/мес |

| Доступ через APIYI | ✅ Подключено, доступно через https://api.apiyi.com/v1 |

| Совместимые инструменты | Claude Code / OpenClaw / Cline / любой редактор с поддержкой OpenAI |

🎯 Совет по быстрому старту: Модель GLM-5.1 уже доступна через APIYI (apiyi.com). Вам нужно лишь изменить

base_urlв вашем текущем OpenAI SDK наhttps://api.apiyi.com/v1и указать соответствующее имя моделиmodel— и вы сможете сразу использовать её в своих рабочих процессах с Агентами, Cursor или Cline, не переписывая бизнес-логику.

Почему GLM-5.1 — это «поворотный момент» в мире Open Source

Чтобы понять, почему в англоязычном AI-сообществе GLM-5.1 называют «поворотным моментом» для открытого ПО, нужно взглянуть на несколько ключевых фактов в совокупности.

Факт первый: лидерство открытой модели в SWE-Bench Pro

SWE-Bench Pro — один из самых сложных и признанных в индустрии бенчмарков для проверки навыков исправления реального кода. Задачи здесь берутся из промышленных репозиториев, и модель должна понимать контекст, находить баги и писать исправления, которые проходят все тесты. Это совсем не то же самое, что «решать задачки на LeetCode». До выхода GLM-5.1 этот рейтинг практически монопольно удерживали серии GPT-5.x и Claude Opus, а открытые модели даже близко не подбирались к первой тройке.

И вот результат: GLM-5.1 с 58,4 баллами вырывается в лидеры:

| Модель | Оценка SWE-Bench Pro | Open Source |

|---|---|---|

| GLM-5.1 | 58,4 ⭐ | ✅ MIT |

| GPT-5.4 | 57,7 | ❌ |

| Claude Opus 4.6 | 57,3 | ❌ |

| Gemini 3.1 Pro | 54,2 | ❌ |

Это не «победа с минимальным отрывом», а полное стирание границы между «открытым» и «закрытым» ПО на самом сложном промышленном бенчмарке. Даже с учетом того, что это данные самой Z.ai и независимые тесты еще впереди, значимость этого события для индустрии невозможно переоценить: у Open Source сообщества впервые появилась бесплатная модель, способная на равных конкурировать с передовыми закрытыми решениями в области исправления реального кода.

Факт второй: по-настоящему коммерческая лицензия MIT

Еще один критический момент — лицензия GLM-5.1. Это MIT, а не привычная Apache 2.0 и уж тем более не ограничительные лицензии типа «только для исследований». Суть MIT предельно проста: кто угодно может скачивать, изменять, дообучать, развертывать, использовать в коммерческих целях, закрывать код производных продуктов и продавать их без каких-либо ограничений, нужно лишь сохранить уведомление об авторских правах.

Для корпоративных пользователей это означает, что GLM-5.1 можно без опасений использовать для:

- создания собственных внутренних Coding Agent;

- модулей генерации и проверки кода в коммерческих SaaS-решениях;

- локально развернутых IDE-плагинов;

- любых сценариев, где по требованиям безопасности нельзя зависеть от API сторонних вендоров.

На апрель 2026 года GLM-5.1 — практически единственный выбор, который одновременно сочетает в себе «передовую производительность + лицензию MIT + лидерство в промышленных бенчмарках».

Архитектура и обучение GLM-5.1: 754B MoE + полный стек Huawei

Второй факт, выделяющий GLM-5.1, — это его «стек обучения».

Архитектура MoE: 754 млрд параметров / 40 млрд активных

GLM-5.1 использует архитектуру «смесь экспертов» (MoE) с общим количеством параметров 754 млрд, из которых при каждом выводе активируется около 40 млрд. Такой дизайн — «большая языковая модель + разреженная активация» — уже неоднократно доказал свою эффективность в DeepSeek, Qwen, Mixtral и других открытых моделях. Его главные плюсы:

- Большая емкость модели при обучении, что позволяет усвоить больше знаний (28,5 трлн токенов данных для претрейна);

- При выводе активируется лишь малая часть экспертов, поэтому требования к видеопамяти и задержки близки к модели 40B Dense;

- Диалоговые задачи и задачи по программированию могут обрабатываться разными экспертами, что улучшает связность в длинных цепочках рассуждений.

| Характеристика | GLM-5 (предыдущая) | GLM-5.1 (текущая) |

|---|---|---|

| Общие параметры | 355B | 754B |

| Активные параметры | 32B | 40B |

| Данные претрейна | 23T tokens | 28.5T tokens |

| Контекстное окно | Ограничено | 200K |

| Макс. выход | Ограничено | 128K |

| Специализация Coding | Есть | ✅ Значительно усилена |

| Длинные задачи Agent | Есть | ✅ До 8 часов на задачу |

Ключевая инженерная фишка: 8-часовой Agent

В анонсе Z.ai делает упор на способность GLM-5.1 выполнять задачи длительностью до 8 часов. Это значит, что вы можете доверить модели реальную инженерную задачу (например, исправить баг, затрагивающий несколько файлов, мигрировать старую библиотеку или написать набор тестов), и она будет самостоятельно планировать → выполнять → тестировать → исправлять → оптимизировать без вмешательства человека до получения готового результата. Раньше такую «выносливость» агентов в индустрии стабильно показывала только серия Claude Opus — GLM-5.1 стала первой открытой моделью, вышедшей на этот уровень.

Аппаратное обеспечение: полностью стек Huawei, без чипов США

Третий факт, который стоит выделить отдельно: GLM-5.1 обучалась полностью на чипах Huawei Ascend 910B с использованием фреймворка MindSpore, без единого GPU от Nvidia или AMD. Это вызвало бурную дискуссию в англоязычном сообществе, так как доказало: в условиях ограничений на поставки Hopper/Blackwell команды из Китая способны обучать модели уровня 754B MoE на собственном «железе». Это не просто техническая победа модели, а демонстрация индустриальной мощи инфраструктуры обучения ИИ в Китае.

Полный отчет по бенчмаркам GLM-5.1

Чтобы не упустить ни одной важной детали, мы собрали результаты бенчмарков GLM-5.1, опубликованные Z.ai, в таблицу ниже.

| Бенчмарк | Результат GLM-5.1 | Значение |

|---|---|---|

| SWE-Bench Pro | 58.4 ⭐ | Реальное исправление кода, №1 в мире (Open Source) |

| SWE-bench Verified | 77.8% | Общее исправление кода, ~94.6% от уровня Claude Opus 4.6 (80.8%) |

| CyberGym | 68.7 | Безопасность/CTF-рассуждения (один прогон, 1507 задач) |

| MCP-Atlas | 71.8 | Бенчмарк вызова инструментов MCP |

| T3-Bench | 70.6 | Использование инструментов и задачи для агентов |

| Humanity's Last Exam | 31.0 / 52.3 | Сложные рассуждения (без инструментов / с инструментами) |

| AIME 2026 | 95.3 | Уровень математической олимпиады США |

| GPQA-Diamond | 86.2 | Экспертные научные рассуждения |

Краткий разбор ключевых моментов:

- Уровень кода: SWE-Bench Pro на вершине, а SWE-bench Verified достигает 94.6% от показателей Claude Opus 4.6 — это значит, что в большинстве повседневных инженерных задач способности GLM-5.1 к написанию кода находятся на одном уровне с топовым Claude Opus;

- Математические рассуждения: 95.3 в AIME 2026 и 86.2 в GPQA-Diamond — это показатели «передового уровня»;

- Агенты и использование инструментов: 71.8 в MCP-Atlas и 70.6 в T3-Bench подтверждают эффективность модели в долгосрочных задачах;

- Честность оценки: Все эти данные на данный момент предоставлены самой компанией Z.ai. На момент публикации независимые лаборатории еще не успели провести полную проверку, поэтому воспринимайте эти цифры как ориентир, а не как «абсолютную истину».

🎯 Совет по проверке: Лучший способ оценить бенчмарки — запустить свои реальные рабочие задачи. GLM-5.1 уже доступна на APIYI (apiyi.com). Вы можете взять 5-10 типичных промптов вашей команды и прогнать их через GLM-5.1, Claude Opus 4.6 и GPT-5.4, чтобы на своих данных проверить выводы SWE-Bench Pro.

Структура цен GLM-5.1: почему это «темная лошадка» по соотношению цена-качество

Еще одна особенность GLM-5.1, которую нельзя игнорировать, — это цена. Давайте сравним её с другими передовыми моделями.

Сравнение стоимости токенов

| Модель | Вход ($/млн) | Выход ($/млн) | Open Source |

|---|---|---|---|

| GLM-5.1 | $1.00 | $3.20 | ✅ MIT |

| Claude Opus 4.6 | Значительно дороже | Значительно дороже | ❌ |

| GPT-5.4 | Дороже | Дороже | ❌ |

| Gemini 3.1 Pro | Средне | Средне | ❌ |

Цифры $1.00 / $3.20 в сегменте «передовых моделей для кодинга» — это минимум рынка. По сравнению с закрытыми моделями уровня Claude Opus 4.6, реальная цена GLM-5.1 в несколько раз ниже, при этом Z.ai заявляет, что производительность кодинга составляет 94.6% от уровня Opus.

Тарифы GLM Coding Plan

Помимо оплаты за токены, Z.ai представила GLM Coding Plan — фиксированный тариф для «тяжелых сценариев кодинга» (Cursor, Cline, Claude Code). Цена начинается от ~$3/мес за 120 промптов, что значительно дешевле аналогичных предложений для закрытых моделей. Такие планы часто комбинируются с уровнями Max / Pro / Lite, позволяя в повседневной работе разработчика использовать «мощности уровня Opus по почти бесплатной цене».

🎯 Совет по выбору: Если ваша команда хочет «кодинг уровня Claude Opus, но не хочет переплачивать», рекомендуем вызывать GLM-5.1 через APIYI (apiyi.com). Вы получите единый интерфейс, оплату в рублях и возможность в любой момент переключаться между GPT-5.4 / Claude Opus 4.6 для A/B-тестирования, чтобы на основе реальных счетов понять, какая модель выгоднее именно для вас.

GLM-5.1 уже доступна на APIYI: минимальный пример вызова

И наконец, то, что больше всего волнует китайских разработчиков: GLM-5.1 уже доступна на APIYI (apiyi.com). Вы можете вызывать её напрямую через существующий SDK, совместимый с OpenAI, — вам совершенно не нужно разворачивать веса модели с 754 млрд параметров самостоятельно на Hugging Face.

Минимальный пример на Python

Ниже приведен минимальный пример вызова GLM-5.1 на Python с использованием официального SDK OpenAI:

from openai import OpenAI

# Замените base_url на APIYI, а api_key — на ваш ключ APIYI

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_APIYI_KEY"

)

resp = client.chat.completions.create(

model="glm-5.1", # Укажите ID модели GLM-5.1 напрямую

messages=[

{"role": "system", "content": "You are an expert software engineer."},

{"role": "user", "content": "Напиши на Python LRU-кэш с поддержкой времени жизни (TTL) и ограничением по объему."}

],

max_tokens=4096

)

print(resp.choices[0].message.content)

Ваш бизнес-код остается прежним — логика, которую вы использовали для GPT-4, Claude или DeepSeek, отлично сработает и с GLM-5.1.

Интеграция с Cursor / Cline / Claude Code

Официальные представители Z.ai подтвердили, что GLM-5.1 совместима со всеми инструментами для программирования, поддерживающими стандарт OpenAI, включая Claude Code, OpenClaw и Cline. В этих инструментах просто укажите адрес совместимого API https://api.apiyi.com/v1 и выберите модель GLM-5.1. Это позволит вам переключить основную модель для кодинга с Opus / GPT-5 на GLM-5.1 без изменения рабочих процессов. Для IDE вроде Cursor, которые также поддерживают пользовательские эндпоинты OpenAI, процедура точно такая же.

Пример потоковой передачи и длинного контекста

GLM-5.1 на APIYI полностью сохраняет поддержку контекстного окна в 200 тыс. токенов и вывод до 128 тыс. токенов. Для длительных задач агентов можно включить режим stream, чтобы сократить задержку получения первого токена:

stream = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "user", "content": "Проведи полный аудит этого Python-репозитория на 5000 строк, перечисли потенциальные баги и дай рекомендации по рефакторингу."}

],

stream=True,

max_tokens=128000

)

for chunk in stream:

delta = chunk.choices[0].delta

if delta.content:

print(delta.content, end="", flush=True)

🎯 Совет по подключению: GLM-5.1 на APIYI (apiyi.com) уже поддерживает совместимый интерфейс OpenAI, потоковую передачу (stream) и полное контекстное окно в 200 тыс. токенов. Мы рекомендуем уже сегодня перенаправить ваши инструменты (Cursor / Cline / Claude Code) на APIYI и попробовать GLM-5.1 в качестве основной модели для кодинга в течение недели, чтобы на реальных задачах проверить, сможет ли она заменить Opus или GPT-5.

Кому подходит GLM-5.1, а кому нет

Кому подходит

| Группа пользователей | Почему подходит |

|---|---|

| Активные пользователи Coding Agent | Лидерство в SWE-Bench Pro, работа с задачами длительностью до 8 часов |

| Команды с ограниченным бюджетом | Цена $1.00/$3.20 значительно ниже, чем у Opus / GPT-5 |

| Компании, которым нужна коммерческая лицензия MIT | Полная свобода: коммерческое использование и создание закрытых производных моделей |

| Пользователи Cursor / Cline / Claude Code | Нативная совместимость с интерфейсом OpenAI, замена в один клик |

| Исследователи стека ИИ | Обучено полностью на Huawei Ascend 910B + MindSpore |

| Задачи на математику / научные рассуждения | AIME 2026: 95.3 / GPQA-Diamond: 86.2 |

Кому не подходит

| Группа пользователей | Причина |

|---|---|

| Те, кто доверяет только независимым бенчмаркам | Текущие данные предоставлены Z.ai, требуется самостоятельная проверка |

| Задачи, ориентированные на мультимодальность | GLM-5.1 специализируется на тексте и коде, мультимодальность — не её сильная сторона |

| Полная зависимость от экосистемы Anthropic / OpenAI | Некоторые продвинутые функции по-прежнему привязаны к оригинальным API |

FAQ по GLM-5.1: Часто задаваемые вопросы

Q1: GLM-5.1 действительно с открытым исходным кодом? Можно ли использовать его в коммерческих целях?

Да. GLM-5.1 был полностью открыт компанией Z.ai 7 апреля 2026 года на Hugging Face (zai-org/GLM-5) под лицензией MIT. Это означает, что разрешено коммерческое использование, создание закрытых производных продуктов и дообучение (fine-tuning) — достаточно лишь сохранить уведомление об авторских правах. Это одна из самых лояльных лицензий, поэтому вы можете смело внедрять GLM-5.1 в свои коммерческие продукты, SaaS-решения или использовать в закрытых контурах без каких-либо лицензионных отчислений.

Q2: GLM-5.1 действительно мощнее GPT-5.4 и Claude Opus 4.6?

В бенчмарке SWE-Bench Pro заявленный результат Z.ai (58.4) действительно превосходит показатели GPT-5.4 (57.7) и Claude Opus 4.6 (57.3). Однако важно помнить: эти данные предоставлены самой Z.ai и еще не были полностью подтверждены независимыми лабораториями. Мы советуем не воспринимать эти цифры как «истину в последней инстанции», а протестировать модель на реальных задачах вашего бизнеса. Это можно сделать прямо сейчас через APIYI (apiyi.com) с использованием GLM-5.1, без необходимости самостоятельного развертывания.

Q3: Появился ли API GLM-5.1 на APIYI? Как его подключить?

Да, модель уже доступна. Вам достаточно изменить base_url в официальном SDK OpenAI на https://api.apiyi.com/v1, заменить api_key на ваш ключ от APIYI и указать ID модели GLM-5.1. Вызов сработает мгновенно, переписывать бизнес-логику не нужно. В статье приведен «минимальный пример вызова» на Python, который также применим для SDK на Node.js, Go или Rust.

Q4: Сильнее ли GLM-5.1 других отечественных открытых моделей, таких как DeepSeek, Qwen или Kimi?

Главное преимущество GLM-5.1 — это «длинные цепочки рассуждений для агентов + лидерство в SWE-Bench Pro». Это направление, в котором DeepSeek, Qwen и Kimi пока не достигли таких же результатов. Если ваша задача — «повседневный диалог + RAG», то DeepSeek и Qwen остаются крайне конкурентоспособными. Но если ваш фокус — Coding Agent / интеграция в IDE / исправление кода, то GLM-5.1 — лучший выбор в мире open-source на данный момент. На APIYI вы можете сравнить эти модели в одном тесте и составить собственное мнение буквально за 15 минут.

Q5: Какое оборудование нужно для локального развертывания GLM-5.1?

GLM-5.1 — это MoE-архитектура с 754 млрд параметров (40 млрд активных). Для локального запуска требуется профессиональный кластер GPU, что практически недостижимо для обычных команд. Официально Z.ai рекомендует использовать vLLM, SGLang или KTransformers для масштабного инференса. Если вам нужно просто использовать модель, а не заниматься её глубоким изучением, самый эффективный способ — вызов через APIYI (apiyi.com). Никаких GPU, никакой поддержки инфраструктуры — просто платите за фактическое использование.

Q6: Правда ли, что при обучении GLM-5.1 не использовались GPU Nvidia?

Да. Z.ai официально подтвердила, что GLM-5.1 обучалась исключительно на чипах Huawei Ascend 910B с использованием фреймворка MindSpore, без привлечения GPU Nvidia или AMD. Это первый случай в 2026 году, когда большая языковая модель с 754 млрд параметров (MoE) была полностью обучена на отечественном «железе», что имеет огромное значение для индустрии.

Резюме: GLM-5.1 — поворотный момент для Open Source ИИ в 2026 году

Если собрать воедино архитектуру, бенчмарки, ценообразование, стек обучения и пути подключения API, то позиция GLM-5.1 на апрель 2026 года становится предельно ясной: это не просто очередное обновление модели с открытым исходным кодом, а знаковое событие, доказывающее, что «Open Source действительно может превзойти закрытые передовые модели». Первое место в мире в SWE-Bench Pro с результатом 58.4, полная открытость по лицензии MIT, крайне низкая цена в $1.00/$3.20, контекстное окно 200K + 128K на вывод, возможности долгосрочного агента на 8 часов и стек обучения полностью на Huawei Ascend 910B — любой из этих фактов достоин отдельной статьи, а вместе они знаменуют собой «точку перегиба» для Open Source.

Еще лучшая новость для разработчиков: API GLM-5.1 уже доступен в APIYI: вам не нужно разворачивать веса 754B самостоятельно, не нужны зарубежные кредитные карты и не нужно ждать никаких одобрений. Просто измените base_url на https://api.apiyi.com/v1, укажите модель GLM-5.1, и уже сегодня вы сможете заменить свою основную модель для кодинга в Cursor, Cline или Claude Code на этого нового короля Open Source. Если вас все еще пугают счета за Opus или GPT-5, это отличная возможность потратить один вечер на тестирование.

🎯 Итоговая рекомендация: Если вы хотите первыми оценить «передовые возможности кодинга + цену Open Source + стабильный доступ через APIYI» в GLM-5.1, мы советуем прямо сегодня создать API-ключ на apiyi.com, изменить

base_urlвашего текущего OpenAI SDK наhttps://api.apiyi.com/v1, установить модель GLM-5.1 и поработать с ней неделю над самыми обычными задачами вашей команды. Независимо от того, решите ли вы в итоге сделать ее своей основной моделью, этот недельный тест даст вам представление из первых рук о реальном уровне Open Source ИИ в 2026 году.

Автор: Команда APIYI | Мы следим за внедрением больших языковых моделей и экосистемой Open Source. Больше информации о практическом использовании и сравнении GLM-5.1 / Claude / GPT-5 можно найти на APIYI (apiyi.com).