2026 年 4 月 7 日,Z.ai(原智譜 AI)正式把 GLM-5.1 的完整權重以 MIT 協議 推上了 Hugging Face 倉庫 zai-org/GLM-5。這次發佈在英文 AI 圈瞬間引爆——不是因爲它"又一個開源大模型",而是因爲它在 SWE-Bench Pro 軟件工程基準上以 58.4 分直接登頂全球榜首,正面超過了 GPT-5.4 的 57.7 分、Claude Opus 4.6 的 57.3 分以及 Gemini 3.1 Pro 的 54.2 分。這是開源模型第一次在一項被工業界廣泛引用的"真實代碼修復"基準上把閉源前沿全部壓在身後。

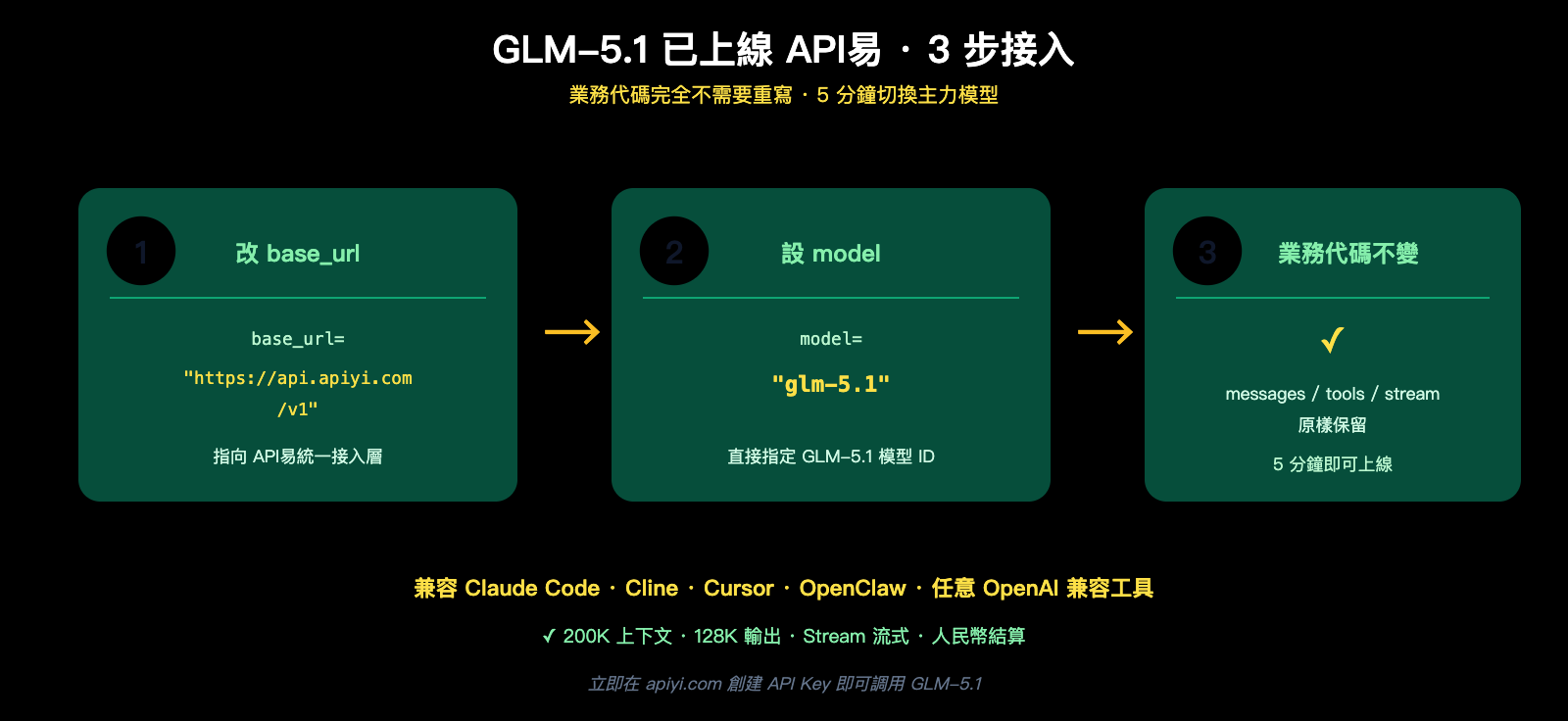

更讓中國大陸開發者關心的是,這次 GLM-5.1 API 的上線節奏非常快——API易 apiyi.com 已經在第一時間完成接入,你不再需要自己去 Hugging Face 拉 754B 參數的權重、也不需要申請 Z.ai 官方賬號,直接用現有的 OpenAI SDK 改一個 base_url 就能調用。本文將從架構、基準、訓練硬件、定價、接入方式 7 個維度,完整介紹 GLM-5.1,並給出在 API易 上調用 GLM-5.1 的最小代碼示例。

GLM-5.1 核心信息一覽(2026 年 4 月版)

在拆解之前,我們先用一張表把"GLM-5.1" 這件事的所有關鍵事實壓到一屏之內。

| 維度 | GLM-5.1 已知信息 |

|---|---|

| 發佈廠商 | Z.ai(原智譜 AI,2026 年 1 月港股上市,估值約 313 億美元) |

| 開源時間 | 2026 年 4 月 7 日 |

| 開源協議 | MIT(允許商用 + 二次修改 + 閉源衍生) |

| 倉庫地址 | huggingface.co/zai-org/GLM-5 |

| 模型架構 | MoE(混合專家),754B 總參數 / 40B 激活參數 |

| 上下文窗口 | 200,000 tokens |

| 最大輸出 | 128,000 tokens |

| 訓練數據 | 28.5T tokens(GLM-5 基礎上從 23T 提升) |

| 訓練硬件 | 全部使用 Huawei Ascend 910B + MindSpore 框架(無 Nvidia / AMD) |

| 部署框架 | vLLM / SGLang / KTransformers |

| 旗艦能力 | 長程 Agent 編碼(單任務可持續工作約 8 小時) |

| 定價(API 直採) | 輸入 $1.00 / 百萬 token,輸出 $3.20 / 百萬 token |

| 編碼套餐 | GLM Coding Plan 起價約 $3/月 |

| API易接入 | ✅ 已上線,通過 https://api.apiyi.com/v1 即可調用 |

| 兼容工具 | Claude Code / OpenClaw / Cline / 任意 OpenAI 兼容編輯器 |

🎯 快速上手建議:GLM-5.1 已經在 API易 apiyi.com 完成接入,你只需要把現有 OpenAI SDK 的

base_url改成https://api.apiyi.com/v1、model改成對應的 GLM-5.1 模型名,就能立刻在你的 Agent / Cursor / Cline 工作流裏替換主力模型,無需重寫任何業務代碼。

GLM-5.1 爲什麼是一次"開源拐點"

要理解 GLM-5.1 爲什麼被英文 AI 圈稱爲"開源拐點",必須把它的幾個關鍵事實對照在一起看。

第一次:開源模型在 SWE-Bench Pro 登頂

SWE-Bench Pro 是目前業界公認最難的真實代碼修復基準之一,任務全部來自工業級代碼倉庫,模型必須理解上下文、定位 bug、寫出可以通過測試的修復——和"刷一個 LeetCode" 完全不是一個量級。在這次 GLM-5.1 發佈之前,這個榜單幾乎被 GPT-5.x 與 Claude Opus 系列輪流霸佔,開源模型從未真正接近過前三名。

而這一次,GLM-5.1 以 58.4 分直接登頂:

| 模型 | SWE-Bench Pro 分數 | 是否開源 |

|---|---|---|

| GLM-5.1 | 58.4 ⭐ | ✅ MIT 開源 |

| GPT-5.4 | 57.7 | ❌ |

| Claude Opus 4.6 | 57.3 | ❌ |

| Gemini 3.1 Pro | 54.2 | ❌ |

這不是 0.x 的擦邊球,而是把"開源 vs 閉源"在最難的工業基準上的差距徹底抹平。即便考慮到"基準是 Z.ai 自報、獨立評測尚未跟進"的免責聲明,這件事本身的產業意義已經無法忽視:開源社區第一次擁有了一個在"真實代碼修復"上能跟前沿閉源同臺競爭的免費模型。

第二次:真正可商用的 MIT 協議

GLM-5.1 的另一項關鍵事實是它的開源協議——MIT,而不是常見的 Apache 2.0,更不是某些"研究專用 / 不可商用"的限制性協議。MIT 的含義非常直白:任何人可以下載、修改、微調、部署、商用、閉源衍生、賣錢,完全沒有限制,只需要保留版權聲明。

對企業用戶來說,這意味着 GLM-5.1 可以毫無顧慮地用於:

- 自研產品的內部 Coding Agent;

- 商業 SaaS 中的代碼生成 / 審查模塊;

- 私有化部署的 IDE 插件;

- 任何需要"模型權重不能依賴某家廠商 API"的合規場景。

在 2026 年 4 月這個時間點,能同時滿足"前沿性能 + MIT 開源 + 工業級基準登頂"的模型,GLM-5.1 幾乎是唯一選擇。

GLM-5.1 架構與訓練:754B MoE + Huawei 全棧

第二個讓 GLM-5.1 與衆不同的事實,是它的訓練棧。

MoE 架構:754B 總參數 / 40B 激活

GLM-5.1 採用混合專家(MoE)架構,總參數 754B,每次推理只激活約 40B。這種"大模型 + 稀疏激活" 的設計已經被 DeepSeek、Qwen、Mixtral 等開源大模型反覆驗證過,核心好處是:

- 訓練時模型容量大,能吸收更多知識(28.5T token 預訓練數據);

- 推理時只激活一小部分專家,顯存與延遲接近一個 40B Dense 模型;

- 對話與代碼任務可以走不同專家路徑,長程任務的連貫性更好。

| 維度 | GLM-5(前代) | GLM-5.1(本次) |

|---|---|---|

| 總參數 | 355B | 754B |

| 激活參數 | 32B | 40B |

| 預訓練數據 | 23T tokens | 28.5T tokens |

| 上下文窗口 | 受限 | 200K |

| 最大輸出 | 受限 | 128K |

| Coding 專項 | 有 | ✅ 顯著增強 |

| Agent 長程任務 | 有 | ✅ 單任務約 8 小時 |

關鍵工程亮點:8 小時長程 Agent

Z.ai 在公告裏反覆強調 GLM-5.1 的"8 小時單任務"能力。它的含義是:你可以把一個真實工程任務(比如修一個跨文件的 bug、遷移一個老庫、補一組測試)交給 GLM-5.1,它能在不需要人爲干預的情況下持續 規劃 → 執行 → 測試 → 修復 → 二次優化,直到給出生產可用的結果,整個過程長達約 8 小時。這種"耐力型 Agent"的能力曲線,過去只在 Claude Opus 系列上被工業界穩定復現過——GLM-5.1 是開源世界第一個把這條能力線打到同一檔位的模型。

訓練硬件:全 Huawei 棧,無任何美國芯片

第三個值得專門拎出來的事實,是 GLM-5.1 的訓練硬件——全部使用 Huawei Ascend 910B 芯片 + MindSpore 框架完成,完全沒有用任何 Nvidia 或 AMD GPU。這件事在英文 AI 圈引起了相當大的討論,因爲它直接證明了:在 Hopper / Blackwell 受限的環境下,中國大陸團隊已經能夠在國產硬件上完成 754B MoE 這一量級模型的預訓練。這不只是模型本身的技術勝利,更是一次中國大陸 AI 訓練基礎設施的產業級展示。

GLM-5.1 完整基準成績單

爲了不遺漏任何重要數據點,我們把 Z.ai 公佈的 GLM-5.1 基準成績單整理成下表。

| 基準 | GLM-5.1 分數 | 含義 |

|---|---|---|

| SWE-Bench Pro | 58.4 ⭐ | 真實代碼修復,#1 全球(開源) |

| SWE-bench Verified | 77.8% | 通用代碼修復,接近 Claude Opus 4.6 (80.8%) 的 ~94.6% |

| CyberGym | 68.7 | 安全/CTF 推理(單跑 1507 任務) |

| MCP-Atlas | 71.8 | MCP 工具調用基準 |

| T3-Bench | 70.6 | 工具使用與 Agent 任務 |

| Humanity's Last Exam | 31.0 / 52.3 | 極難推理(無工具 / 有工具) |

| AIME 2026 | 95.3 | 美國奧數競賽級別 |

| GPQA-Diamond | 86.2 | 專家級科學推理 |

簡單解讀一下重點:

- 代碼層面:SWE-Bench Pro 已經登頂,SWE-bench Verified 達到 Claude Opus 4.6 的 94.6%——意味着對絕大多數日常工程任務,GLM-5.1 的代碼能力已經和當今最強的 Claude Opus 處在同一檔;

- 數學推理:AIME 2026 拿下 95.3,GPQA-Diamond 86.2,屬於"前沿水平";

- Agent 與工具使用:MCP-Atlas 71.8、T3-Bench 70.6,長程任務能力已經被基準證實;

- 誠實評估:這套數據當前全部來自 Z.ai 自報,截至發稿時尚未有完全獨立的第三方評測室復現,使用時可以參考但不要當作"絕對值"看待。

🎯 基準驗證建議:面對自報基準,最務實的態度是用自己業務的真實任務跑一次。GLM-5.1 已經在 API易 apiyi.com 完成上線,你可以直接用你團隊最常見的 5-10 個真實編碼 prompt 在 GLM-5.1、Claude Opus 4.6、GPT-5.4 上各跑一遍,用自己的業務數據反向驗證 SWE-Bench Pro 的結論。

GLM-5.1 價格結構:爲什麼說是"性價比黑馬"

GLM-5.1 的另一個讓人無法忽視的特點是價格。我們把它直接放到主流前沿模型的同一張表裏對比。

Token 單價對比

| 模型 | 輸入($/M) | 輸出($/M) | 是否開源 |

|---|---|---|---|

| GLM-5.1 | $1.00 | $3.20 | ✅ MIT |

| Claude Opus 4.6 | 顯著更貴 | 顯著更貴 | ❌ |

| GPT-5.4 | 較貴 | 較貴 | ❌ |

| Gemini 3.1 Pro | 中等 | 中等 | ❌ |

$1.00 / $3.20 這一對數字,在"前沿編碼模型"的價格區間裏屬於地板價:對照 Claude Opus 4.6 這一檔閉源模型,GLM-5.1 的實際單價大約只有它的幾分之一,而 Z.ai 自己把"94.6% 的 Claude Opus 4.6 編碼性能"作爲核心宣傳賣點之一。

GLM Coding Plan 與套餐玩法

除了按 token 計費,Z.ai 還推出了 GLM Coding Plan——一種面向 Cursor、Cline、Claude Code 這類"重度編碼場景"的固定套餐,起價約 $3/月,包含 120 個 prompt 提示,遠低於同類閉源 Coding 套餐。這類套餐通常會與 Max / Pro / Lite 多個檔位綁定,在"日常碼農工作流" 這種"調用頻繁但單次便宜"的場景下,可以做到"用 Opus 級編碼能力 + 接近免費的成本"。

🎯 價格選型建議:對於希望"用 Claude Opus 級別的代碼能力,但又不想被 Opus 價格壓垮"的團隊,我們建議直接通過 API易 apiyi.com 調用 GLM-5.1:既能享受統一接口與人民幣結算,也能在同一份業務代碼裏隨時切換 GPT-5.4 / Claude Opus 4.6 做橫向 A/B,用真實賬單數據反推哪個模型性價比最高。

GLM-5.1 已上線 API易:最小調用示例

最後,也是中文開發者最關心的一段——GLM-5.1 已經上線 API易 apiyi.com,通過現有 OpenAI 兼容 SDK 即可直接調用,完全不需要去 Hugging Face 自己部署 754B 參數的權重。

Python 最小示例

下面是一個最小的 Python 調用示例,展示如何用官方 OpenAI SDK 調用 GLM-5.1:

from openai import OpenAI

# 把 base_url 改成 API易,api_key 換成你的 APIYI Key

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_APIYI_KEY"

)

resp = client.chat.completions.create(

model="glm-5.1", # 直接指定 GLM-5.1 模型 ID

messages=[

{"role": "system", "content": "You are an expert software engineer."},

{"role": "user", "content": "用 Python 寫一個 LRU 緩存,帶過期時間和容量上限。"}

],

max_tokens=4096

)

print(resp.choices[0].message.content)

業務代碼完全不變——之前調 GPT-4 / Claude / DeepSeek 用的什麼邏輯,現在調 GLM-5.1 還是同一套。

接入 Cursor / Cline / Claude Code

Z.ai 官方明確寫出 GLM-5.1 兼容所有 OpenAI 標準的 Coding 工具,包括 Claude Code、OpenClaw、Cline。在這些工具裏把 OpenAI 兼容入口指向 https://api.apiyi.com/v1 並選擇 GLM-5.1 模型,即可在不修改任何工作流的情況下,把主力 Coding 模型從 Opus / GPT-5 切到 GLM-5.1。對於 Cursor 這類同樣支持 OpenAI Custom Endpoint 的 IDE,流程也完全一致。

流式調用與長上下文示例

GLM-5.1 在 API易 上完整保留了 200K 上下文與 128K 輸出能力。對長程 Agent 任務,可以打開 stream 模式獲得更低的首 token 延遲:

stream = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "user", "content": "完整審查這份 5000 行的 Python 倉庫,列出潛在 bug 與重構建議。"}

],

stream=True,

max_tokens=128000

)

for chunk in stream:

delta = chunk.choices[0].delta

if delta.content:

print(delta.content, end="", flush=True)

🎯 接入建議:GLM-5.1 在 API易 apiyi.com 已經支持 OpenAI 兼容接口、Stream 流式輸出與完整 200K 上下文。我們建議你今天就把團隊的 Cursor / Cline / Claude Code 工具入口指向 API易,把 GLM-5.1 作爲新的主力編碼模型試用一週,用真實工程任務驗證它能不能取代你正在用的 Opus / GPT-5。

GLM-5.1 適合誰、不適合誰

適合的人羣

| 人羣 | 適合理由 |

|---|---|

| 重度 Coding Agent 用戶 | SWE-Bench Pro 登頂,8 小時長程任務能力 |

| 想用前沿模型但預算有限的團隊 | $1.00/$3.20 的單價遠低於 Opus / GPT-5 |

| 需要 MIT 協議商用部署的企業 | 完全無限制,可商用、可閉源衍生 |

| Cursor / Cline / Claude Code 用戶 | 原生兼容 OpenAI 接口,一鍵替換 |

| 對國產 AI 訓練棧感興趣的研究者 | 全 Huawei Ascend 910B + MindSpore 訓練 |

| 數學 / 科學推理重度場景 | AIME 2026 95.3 / GPQA-Diamond 86.2 |

不太適合的人羣

| 人羣 | 原因 |

|---|---|

| 極度看重"獨立第三方基準"的用戶 | 當前數據全部爲 Z.ai 自報,需自行復現 |

| 任務以多模態(圖像/視頻)爲主 | GLM-5.1 主打文本與代碼,多模態非強項 |

| 完全依賴 Anthropic / OpenAI 工具生態 | 部分高級特性仍以原廠接口爲準 |

GLM-5.1 常見問題 FAQ

Q1:GLM-5.1 真的開源了嗎?可以商用嗎?

是的。GLM-5.1 在 2026 年 4 月 7 日由 Z.ai 在 Hugging Face(zai-org/GLM-5)上以 MIT 協議 完整開源,允許商用、允許閉源衍生、允許二次微調,只需保留版權聲明。這是目前最寬鬆的開源協議之一,意味着你可以把 GLM-5.1 直接放進自己的商業產品、SaaS、私有化部署,不需要支付任何授權費。

Q2:GLM-5.1 真的比 GPT-5.4 和 Claude Opus 4.6 強嗎?

在 SWE-Bench Pro 這一項基準上,Z.ai 公佈的成績(58.4)確實超過了 GPT-5.4(57.7)和 Claude Opus 4.6(57.3)。但需要注意:這套數據目前爲 Z.ai 自報,尚未被獨立第三方評測室完全復現。我們建議你不要把這些數字當成"絕對真理",而是用自己業務的真實任務跑一次——這件事現在可以直接在 API易 apiyi.com 上的 GLM-5.1 完成,無需自己部署。

Q3:GLM-5.1 的 API 已經上線 API易了嗎?怎麼調?

已經上線。你只需要把 OpenAI 官方 SDK 的 base_url 改成 https://api.apiyi.com/v1、api_key 替換爲你的 APIYI Key、model 設爲 GLM-5.1 對應的模型 ID,就能立刻調用,業務代碼完全不需要重寫。文章的"最小調用示例"裏給出了 Python 版本,Node / Go / Rust SDK 同樣適用。

Q4:GLM-5.1 比 DeepSeek、Qwen、Kimi 這些其他國產開源模型強嗎?

GLM-5.1 的最大差異化在 "長程 Agent 編碼 + SWE-Bench Pro 登頂"——這是過去 DeepSeek、Qwen、Kimi 都沒有正面拿下的方向。如果你的業務是"日常對話 + RAG",DeepSeek 與 Qwen 仍然非常有競爭力;如果你的業務是 Coding Agent / IDE 集成 / 代碼修復,GLM-5.1 是當前開源世界的第一選擇。在 API易 上你可以把這幾家放進同一個對比測試裏,15 分鐘形成自己的判斷。

Q5:本地部署 GLM-5.1 需要什麼硬件?

GLM-5.1 是 754B 總參數 / 40B 激活的 MoE 架構,本地部署需要專業級多卡 GPU 集羣,普通團隊幾乎不現實。Z.ai 官方推薦使用 vLLM / SGLang / KTransformers 進行大規模推理服務化部署。如果你只是想用 GLM-5.1 而不是研究它,最高效的方式是直接通過 API易 apiyi.com 調用 —— 不需要 GPU、不需要運維、按用量付費。

Q6:GLM-5.1 的訓練是不是真的沒有用 Nvidia GPU?

是的。Z.ai 公開披露 GLM-5.1 完全在 Huawei Ascend 910B 芯片 + MindSpore 框架上完成訓練,沒有使用任何 Nvidia / AMD GPU。這是 2026 年開源大模型領域第一個在公開層面完成"全國產硬件 + 754B MoE 大模型"訓練的案例,具有相當的產業象徵意義。

總結:GLM-5.1 是 2026 年開源 AI 的拐點事件

把架構、基準、價格、訓練棧與 API 接入路徑全部串起來之後,GLM-5.1 在 2026 年 4 月這個時間點上的位置已經非常清晰:它不是又一個普通的開源模型升級,而是一次"開源真的能打過閉源前沿"的標誌性事件。SWE-Bench Pro 58.4 的全球第一、MIT 協議的徹底開放、$1.00/$3.20 的極低價格、200K 上下文 + 128K 輸出、8 小時長程 Agent 能力,以及全 Huawei Ascend 910B 訓練棧——這些事實任何一個單獨拿出來都值得寫一篇報道,疊加在一起就成了"開源拐點"。

對中國大陸開發者更好的消息是,GLM-5.1 API 已經上線 API易:你不需要自己部署 754B 權重、不需要海外信用卡、不需要等任何審批,只要把 base_url 改成 https://api.apiyi.com/v1、把 model 改成 GLM-5.1,今天就能在 Cursor / Cline / Claude Code 裏把主力編碼模型替換成這個新的開源王者。如果你還在爲 Opus / GPT-5 的賬單頭疼,這是一個非常值得花一個下午測試的機會窗口。

🎯 最終建議:想要第一時間體驗 GLM-5.1 的"前沿編碼能力 + 開源價格 + API易穩定接入",我們建議你今天就在 apiyi.com 創建一個 API Key,把現有 OpenAI SDK 的 base_url 改成

https://api.apiyi.com/v1、model 改成 GLM-5.1,用你團隊最日常的代碼任務跑一週。無論你最終是否決定切換主力模型,這一週的實測都會讓你對 2026 年開源 AI 的真實水平形成第一手認知。

作者:APIYI Team | 關注 AI 大模型落地與開源生態,更多 GLM-5.1 / Claude / GPT-5 實戰調用與對比請訪問 API易 apiyi.com。