في 7 أبريل 2026، أطلقت شركة Z.ai (المعروفة سابقاً باسم Zhipu AI) رسمياً الأوزان الكاملة لنموذج GLM-5.1 تحت رخصة MIT عبر مستودع Hugging Face تحت اسم zai-org/GLM-5. أحدث هذا الإطلاق ضجة كبيرة في أوساط الذكاء الاصطناعي العالمية؛ ليس فقط لأنه "نموذج لغة كبير مفتوح المصدر آخر"، بل لأنه تصدر الترتيب العالمي في معيار هندسة البرمجيات SWE-Bench Pro محققاً 58.4 نقطة، متفوقاً بذلك على GPT-5.4 (57.7 نقطة)، وClaude Opus 4.6 (57.3 نقطة)، وGemini 3.1 Pro (54.2 نقطة). هذه هي المرة الأولى التي يتفوق فيها نموذج مفتوح المصدر على جميع النماذج الرائدة مغلقة المصدر في معيار "إصلاح الأكواد البرمجية الحقيقية" الذي يستشهد به قطاع الصناعة على نطاق واسع.

وما يهم المطورين في الصين بشكل خاص هو سرعة توفير API الخاص بـ GLM-5.1؛ حيث قامت منصة APIYI (apiyi.com) بدمج الخدمة فور إطلاقها. لن تحتاج بعد الآن إلى سحب أوزان النموذج التي تبلغ 754 مليار بارامتر من Hugging Face، ولا إلى تقديم طلب للحصول على حساب رسمي من Z.ai. يمكنك ببساطة استخدام OpenAI SDK الحالي وتغيير base_url للبدء في استدعاء النموذج مباشرة. ستتناول هذه المقالة نموذج GLM-5.1 من 7 أبعاد: البنية، المعايير، أجهزة التدريب، التسعير، وطرق الوصول، مع تقديم نموذج برمجي مصغر لاستدعاء GLM-5.1 عبر APIYI.

نظرة عامة على المعلومات الأساسية لـ GLM-5.1 (إصدار أبريل 2026)

قبل الخوض في التفاصيل، دعنا نلخص الحقائق الرئيسية حول GLM-5.1 في جدول واحد:

| البعد | معلومات GLM-5.1 |

|---|---|

| الشركة المطورة | Z.ai (سابقاً Zhipu AI، أُدرجت في بورصة هونغ كونغ يناير 2026، تقييم 31.3 مليار دولار) |

| تاريخ الإصدار | 7 أبريل 2026 |

| رخصة المصدر | MIT (تسمح بالاستخدام التجاري + التعديل + الاشتقاق المغلق) |

| رابط المستودع | huggingface.co/zai-org/GLM-5 |

| بنية النموذج | MoE (خليط من الخبراء)، 754 مليار بارامتر إجمالي / 40 مليار بارامتر نشط |

| نافذة السياق | 200,000 توكن |

| الحد الأقصى للمخرجات | 128,000 توكن |

| بيانات التدريب | 28.5 تريليون توكن (زيادة من 23 تريليون في GLM-5) |

| أجهزة التدريب | تعتمد بالكامل على Huawei Ascend 910B + إطار عمل MindSpore (بدون Nvidia / AMD) |

| إطار النشر | vLLM / SGLang / KTransformers |

| القدرة الرائدة | البرمجة كوكيل (Agent) طويل المدى (عمل مستمر لمدة 8 ساعات للمهمة الواحدة) |

| التسعير (مباشر) | 1.00 دولار لكل مليون توكن مدخل، 3.20 دولار لكل مليون توكن مخرج |

| باقات البرمجة | تبدأ من 3 دولارات شهرياً |

| الوصول عبر APIYI | ✅ متاح، يمكن الاستدعاء عبر https://api.apiyi.com/v1 |

| الأدوات المتوافقة | Claude Code / OpenClaw / Cline / أي محرر متوافق مع OpenAI |

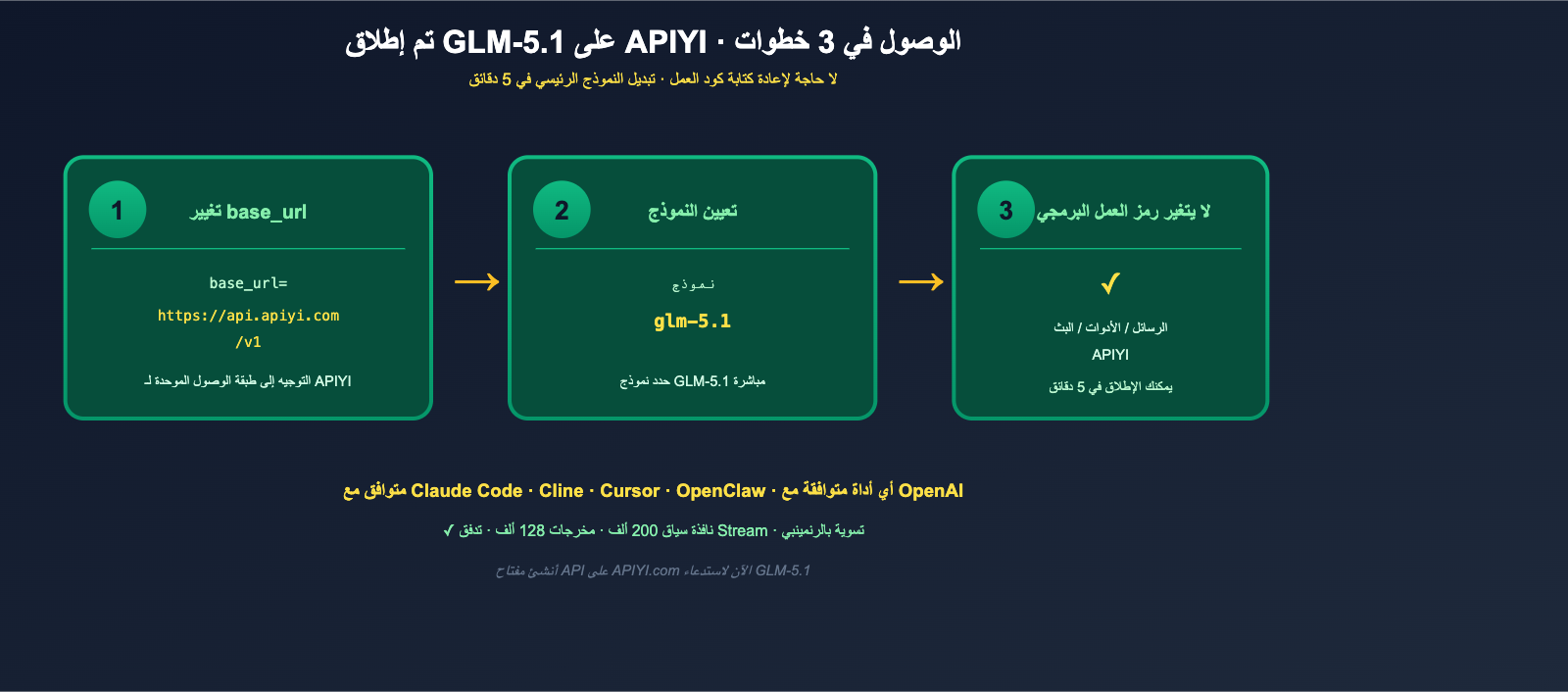

🎯 نصيحة للبدء السريع: تم دمج GLM-5.1 بالفعل في منصة APIYI (apiyi.com). ما عليك سوى تغيير

base_urlفي OpenAI SDK الخاص بك إلىhttps://api.apiyi.com/v1وتغييرmodelإلى اسم نموذج GLM-5.1 المقابل، وستتمكن فوراً من استبدال النموذج الرئيسي في سير عملك (Agent / Cursor / Cline) دون الحاجة لإعادة كتابة أي كود برمجي.

لماذا يُعد GLM-5.1 "نقطة تحول" في عالم المصادر المفتوحة؟

لفهم سبب وصف مجتمع الذكاء الاصطناعي الناطق بالإنجليزية لنموذج GLM-5.1 بأنه "نقطة تحول" في البرمجيات مفتوحة المصدر، يجب علينا النظر في عدة حقائق جوهرية معاً.

أولاً: تصدر نموذج مفتوح المصدر لاختبار SWE-Bench Pro

يُعد اختبار SWE-Bench Pro حالياً أحد أصعب معايير إصلاح الأكواد البرمجية الواقعية في الصناعة. المهام فيه مستمدة بالكامل من مستودعات برمجية صناعية، حيث يجب على النموذج فهم السياق، وتحديد الأخطاء البرمجية (bugs)، وكتابة إصلاحات تجتاز الاختبارات؛ وهو أمر لا يقارن إطلاقاً بـ "حل مسألة على LeetCode". قبل إطلاق GLM-5.1، كانت هذه القائمة تسيطر عليها بالتناوب نماذج GPT-5.x وClaude Opus، ولم تقترب النماذج مفتوحة المصدر يوماً من المراكز الثلاثة الأولى.

ولكن هذه المرة، تصدر GLM-5.1 القائمة برصيد 58.4 نقطة:

| النموذج | درجة SWE-Bench Pro | مفتوح المصدر؟ |

|---|---|---|

| GLM-5.1 | 58.4 ⭐ | ✅ نعم (رخصة MIT) |

| GPT-5.4 | 57.7 | ❌ |

| Claude Opus 4.6 | 57.3 | ❌ |

| Gemini 3.1 Pro | 54.2 | ❌ |

هذا ليس تفوقاً هامشياً، بل هو محو كامل للفجوة بين "المفتوح" و"المغلق" في أصعب المعايير الصناعية. وحتى مع الأخذ في الاعتبار إخلاء المسؤولية بأن "المعايير معلنة من قبل Z.ai ولم يتم التحقق منها بشكل مستقل بعد"، فإن الأهمية الصناعية لهذا الحدث لا يمكن تجاهلها: فلأول مرة يمتلك مجتمع المصادر المفتوحة نموذجاً مجانياً يمكنه منافسة النماذج المغلقة الرائدة في "إصلاح الأكواد البرمجية الواقعية".

ثانياً: رخصة MIT القابلة للاستخدام التجاري الفعلي

حقيقة جوهرية أخرى تتعلق بـ GLM-5.1 هي رخصة المصادر المفتوحة الخاصة به، وهي MIT، وليست رخصة Apache 2.0 الشائعة، وبالتأكيد ليست تلك الرخص التقييدية التي تمنع الاستخدام التجاري. معنى رخصة MIT واضح ومباشر: يمكن لأي شخص تنزيل النموذج، وتعديله، وضبطه بدقة (Fine-tuning)، ونشره، واستخدامه تجارياً، واشتقاق نماذج مغلقة منه، وبيعه، دون أي قيود، بشرط الاحتفاظ بإشعار حقوق النشر.

بالنسبة للمستخدمين من الشركات، هذا يعني أن GLM-5.1 يمكن استخدامه دون أي قلق في:

- تطوير وكلاء برمجة (Coding Agents) داخليين للمنتجات.

- وحدات توليد/مراجعة الأكواد البرمجية في برمجيات SaaS التجارية.

- إضافات IDE للنشر الخاص (Private Deployment).

- أي سيناريو امتثال يتطلب "عدم الاعتماد على واجهة برمجة تطبيقات (API) خاصة بشركة معينة".

في أبريل 2026، يُعد GLM-5.1 الخيار الوحيد تقريباً الذي يجمع بين "الأداء الرائد + رخصة MIT مفتوحة المصدر + تصدر المعايير الصناعية".

بنية وتدريب GLM-5.1: نموذج MoE بحجم 754B + منظومة Huawei المتكاملة

الحقيقة الثانية التي تجعل GLM-5.1 فريداً هي بنية التدريب الخاصة به.

بنية MoE: إجمالي 754 مليار بارامتر / 40 مليار بارامتر نشط

يستخدم GLM-5.1 بنية "خليط الخبراء" (MoE)، بإجمالي 754 مليار بارامتر، بينما يتم تفعيل حوالي 40 مليار بارامتر فقط في كل عملية استدلال. هذا التصميم الذي يجمع بين "نموذج لغة كبير + تفعيل متفرق" تم التحقق منه مراراً وتكراراً بواسطة نماذج مفتوحة المصدر مثل DeepSeek وQwen وMixtral، وتتلخص فوائده في:

- سعة نموذج كبيرة أثناء التدريب: مما يسمح باستيعاب المزيد من المعرفة (28.5 تريليون رمز (token) من بيانات التدريب المسبق).

- تفعيل جزء صغير من الخبراء أثناء الاستدلال: مما يجعل استهلاك ذاكرة الفيديو (VRAM) وزمن الاستجابة قريباً من نموذج كثيف (Dense) بحجم 40 مليار بارامتر.

- مسارات خبراء مختلفة للمحادثة والمهام البرمجية: مما يحسن من تماسك المهام طويلة المدى.

| البعد | GLM-5 (الجيل السابق) | GLM-5.1 (الحالي) |

|---|---|---|

| إجمالي البارامترات | 355B | 754B |

| البارامترات النشطة | 32B | 40B |

| بيانات التدريب المسبق | 23T tokens | 28.5T tokens |

| نافذة السياق | محدودة | 200K |

| الحد الأقصى للمخرجات | محدود | 128K |

| مهام البرمجة المتخصصة | موجود | ✅ تحسن ملحوظ |

| مهام الوكيل طويلة المدى | موجود | ✅ حوالي 8 ساعات للمهمة الواحدة |

أبرز الميزات الهندسية: وكيل (Agent) بمهام طويلة المدى تصل لـ 8 ساعات

أكدت Z.ai في إعلانها مراراً على قدرة GLM-5.1 في تنفيذ "مهام تستغرق 8 ساعات". وهذا يعني: يمكنك تكليف GLM-5.1 بمهمة هندسية حقيقية (مثل إصلاح خطأ برمجية يمتد عبر ملفات متعددة، أو ترحيل مكتبة قديمة، أو إضافة مجموعة اختبارات)، وسيقوم النموذج بالاستمرار في عمليات التخطيط ← التنفيذ ← الاختبار ← الإصلاح ← التحسين الثانوي دون تدخل بشري، حتى يقدم نتيجة جاهزة للإنتاج، حيث تستغرق العملية بأكملها حوالي 8 ساعات. هذا النوع من قدرة "الوكيل ذو النفس الطويل" لم يسبق أن تم توثيقه صناعياً بشكل مستقر إلا في سلسلة Claude Opus — وGLM-5.1 هو أول نموذج في عالم المصادر المفتوحة يصل إلى هذا المستوى من القدرة.

أجهزة التدريب: منظومة Huawei المتكاملة، بدون أي رقائق أمريكية

الحقيقة الثالثة التي تستحق الذكر بشكل خاص هي أجهزة التدريب الخاصة بـ GLM-5.1، حيث تم التدريب بالكامل باستخدام رقائق Huawei Ascend 910B + إطار عمل MindSpore، دون استخدام أي وحدات معالجة رسومية (GPU) من Nvidia أو AMD. أثار هذا الأمر نقاشاً واسعاً في مجتمع الذكاء الاصطناعي الناطق بالإنجليزية، لأنه يثبت مباشرة أن: في بيئة تعاني من قيود على رقائق Hopper / Blackwell، تمكن فريق من الصين من إكمال التدريب المسبق لنموذج MoE بهذا الحجم (754B) على أجهزة محلية. هذا ليس مجرد انتصار تقني للنموذج نفسه، بل هو عرض صناعي لقوة البنية التحتية لتدريب الذكاء الاصطناعي في الصين.

قائمة النتائج الكاملة لنموذج GLM-5.1

لكي لا نغفل أي نقطة بيانات مهمة، قمنا بتنظيم قائمة النتائج المعيارية لنموذج GLM-5.1 التي أعلنت عنها Z.ai في الجدول التالي:

| المعيار | نتيجة GLM-5.1 | المعنى |

|---|---|---|

| SWE-Bench Pro | 58.4 ⭐ | إصلاح الأكواد البرمجية الحقيقية، المركز الأول عالمياً (مفتوح المصدر) |

| SWE-bench Verified | 77.8% | إصلاح الأكواد العام، يقترب من ~94.6% من أداء Claude Opus 4.6 (80.8%) |

| CyberGym | 68.7 | الاستنتاج الأمني/CTF (تشغيل فردي لـ 1507 مهمة) |

| MCP-Atlas | 71.8 | معيار استدعاء أدوات MCP |

| T3-Bench | 70.6 | استخدام الأدوات ومهام الوكيل (Agent) |

| Humanity's Last Exam | 31.0 / 52.3 | استنتاج فائق الصعوبة (بدون أدوات / مع أدوات) |

| AIME 2026 | 95.3 | مستوى مسابقات الرياضيات الأولمبية الأمريكية |

| GPQA-Diamond | 86.2 | استنتاج علمي بمستوى الخبراء |

إليك قراءة سريعة لأهم النقاط:

- على مستوى البرمجة: تصدّر النموذج معيار SWE-Bench Pro، ووصل في SWE-bench Verified إلى 94.6% من أداء Claude Opus 4.6؛ مما يعني أنه بالنسبة لغالبية مهام البرمجة اليومية، أصبحت قدرات GLM-5.1 البرمجية في نفس مستوى أقوى النماذج الحالية مثل Claude Opus.

- الاستنتاج الرياضي: حقق 95.3 في AIME 2026 و86.2 في GPQA-Diamond، وهو ما يضعه في "المستوى الرائد".

- الوكلاء (Agents) واستخدام الأدوات: أثبتت المعايير قدرته على المهام طويلة المدى بـ 71.8 في MCP-Atlas و70.6 في T3-Bench.

- تقييم النزاهة: هذه البيانات حالياً صادرة بالكامل عن Z.ai، وحتى لحظة كتابة هذا التقرير، لم تكن هناك مراجعات مستقلة تماماً من مختبرات طرف ثالث، لذا يمكن اعتبارها مرجعاً ولكن لا يجب التعامل معها كـ "قيم مطلقة".

🎯 نصيحة للتحقق من المعايير: عند التعامل مع معايير معلنة ذاتياً، فإن النهج الأكثر واقعية هو تجربتها بمهام حقيقية من عملك. لقد أصبح GLM-5.1 متاحاً الآن عبر خدمة وكيل API من APIYI (apiyi.com)، يمكنك تجربة 5-10 موجهات برمجية حقيقية من عمل فريقك على كل من GLM-5.1 وClaude Opus 4.6 وGPT-5.4، والتحقق بنفسك من نتائج SWE-Bench Pro باستخدام بياناتك الخاصة.

هيكل تسعير GLM-5.1: لماذا يعتبر "الحصان الأسود" من حيث القيمة مقابل السعر؟

ميزة أخرى لا يمكن تجاهلها في GLM-5.1 هي السعر. لنضعه في جدول مقارنة مباشر مع النماذج الرائدة الحالية.

مقارنة سعر التوكن (Token)

| النموذج | المدخلات ($/مليون) | المخرجات ($/مليون) | مفتوح المصدر؟ |

|---|---|---|---|

| GLM-5.1 | $1.00 | $3.20 | ✅ MIT |

| Claude Opus 4.6 | أغلى بكثير | أغلى بكثير | ❌ |

| GPT-5.4 | أغلى | أغلى | ❌ |

| Gemini 3.1 Pro | متوسط | متوسط | ❌ |

سعر $1.00 / $3.20 يعتبر "سعر القاع" في فئة "نماذج البرمجة الرائدة": مقارنة بنموذج مغلق مثل Claude Opus 4.6، فإن التكلفة الفعلية لـ GLM-5.1 هي جزء بسيط منها، بينما تروج Z.ai لكونه يقدم "94.6% من أداء Claude Opus 4.6 في البرمجة".

خطط GLM البرمجية (GLM Coding Plan)

بالإضافة إلى الدفع حسب الاستخدام، أطلقت Z.ai خطة GLM Coding Plan، وهي باقة ثابتة موجهة لسيناريوهات "البرمجة المكثفة" مثل Cursor وCline وClaude Code، تبدأ من حوالي $3 شهرياً وتتضمن 120 موجه، وهو سعر أقل بكثير من باقات البرمجة المغلقة المماثلة. تتيح هذه الباقات، التي غالباً ما ترتبط بمستويات Max / Pro / Lite، للمبرمجين في سير عملهم اليومي الحصول على "قدرات برمجة بمستوى Opus + تكلفة تقترب من المجانية".

🎯 نصيحة لاختيار النموذج: للفرق التي ترغب في "استخدام قدرات برمجة بمستوى Claude Opus دون أن تثقل كاهلها تكاليف Opus"، ننصح بالاستدعاء المباشر لنموذج GLM-5.1 عبر APIYI (apiyi.com): حيث يمكنك الاستمتاع بواجهة موحدة، والتبديل في أي وقت بين GPT-5.4 / Claude Opus 4.6 لإجراء مقارنة A/B على نفس الكود البرمجي، واستخدام فواتيرك الحقيقية لتحديد النموذج الأكثر جدوى اقتصادية.

تم إطلاق GLM-5.1 على APIYI: نموذج استدعاء مبسط

وأخيراً، الجزء الأكثر أهمية للمطورين العرب: تم إطلاق نموذج GLM-5.1 على منصة APIYI (apiyi.com). يمكنك الآن استدعاء النموذج مباشرة عبر حزمة تطوير البرمجيات (SDK) المتوافقة مع OpenAI، دون الحاجة إلى نشر أوزان النموذج ذات الـ 754 مليار بارامتر بنفسك على Hugging Face.

نموذج استدعاء Python مبسط

فيما يلي نموذج مبسط لاستدعاء GLM-5.1 باستخدام مكتبة OpenAI الرسمية:

from openai import OpenAI

# قم بتغيير base_url إلى APIYI، واستبدل api_key بمفتاح APIYI الخاص بك

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_APIYI_KEY"

)

resp = client.chat.completions.create(

model="glm-5.1", # حدد معرف نموذج GLM-5.1 مباشرة

messages=[

{"role": "system", "content": "أنت مهندس برمجيات خبير."},

{"role": "user", "content": "اكتب كود Python لتنفيذ ذاكرة تخزين مؤقت من نوع LRU، مع دعم وقت انتهاء الصلاحية وحد أقصى للسعة."}

],

max_tokens=4096

)

print(resp.choices[0].message.content)

لن تحتاج إلى تغيير أي شيء في كود عملك؛ فالمنطق الذي كنت تستخدمه لاستدعاء GPT-4 أو Claude أو DeepSeek هو نفسه تماماً الذي ستستخدمه مع GLM-5.1.

الربط مع Cursor / Cline / Claude Code

أكد فريق Z.ai رسمياً أن GLM-5.1 متوافق مع جميع أدوات البرمجة التي تدعم معيار OpenAI، بما في ذلك Claude Code و OpenClaw و Cline. في هذه الأدوات، ما عليك سوى توجيه نقطة اتصال OpenAI إلى https://api.apiyi.com/v1 واختيار نموذج GLM-5.1، وبذلك يمكنك تحويل نموذج البرمجة الرئيسي لديك من Opus أو GPT-5 إلى GLM-5.1 دون تعديل أي سير عمل. وبالنسبة لبيئات التطوير مثل Cursor التي تدعم نقاط اتصال OpenAI المخصصة، فإن العملية متطابقة تماماً.

مثال على الاستدعاء المتدفق (Streaming) والسياق الطويل

يحتفظ GLM-5.1 على APIYI بكامل قدرات نافذة السياق البالغة 200 ألف رمز (token) ومخرجات تصل إلى 128 ألف رمز. بالنسبة لمهام الوكلاء (Agents) طويلة المدى، يمكنك تفعيل وضع التدفق (stream) للحصول على زمن استجابة أقل للرمز الأول:

stream = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "user", "content": "قم بمراجعة شاملة لمستودع Python هذا المكون من 5000 سطر، وأدرج الأخطاء المحتملة واقتراحات إعادة الهيكلة."}

],

stream=True,

max_tokens=128000

)

for chunk in stream:

delta = chunk.choices[0].delta

if delta.content:

print(delta.content, end="", flush=True)

🎯 نصيحة للربط: يدعم GLM-5.1 على APIYI (apiyi.com) واجهات OpenAI المتوافقة، ومخرجات التدفق (Stream)، ونافذة سياق كاملة تصل إلى 200 ألف رمز. ننصحك اليوم بتوجيه أدوات الفريق مثل Cursor أو Cline أو Claude Code إلى APIYI، وتجربة GLM-5.1 كنموذج برمجة رئيسي لمدة أسبوع، والتحقق من خلال مهام هندسية حقيقية ما إذا كان بإمكانه استبدال Opus أو GPT-5 الذي تستخدمه حالياً.

لمن يصلح GLM-5.1 ولمن لا يصلح؟

الفئات المستهدفة

| الفئة | سبب الملاءمة |

|---|---|

| مستخدمو وكلاء البرمجة (Coding Agents) المكثفون | تصدر قائمة SWE-Bench Pro، قدرة عالية على المهام الطويلة لمدة 8 ساعات |

| الفرق التي ترغب في نماذج متطورة بميزانية محدودة | سعر 1.00$ / 3.20$ أقل بكثير من Opus / GPT-5 |

| الشركات التي تحتاج إلى نشر تجاري برخصة MIT | لا توجد قيود، قابل للاستخدام التجاري والاشتقاق المغلق |

| مستخدمو Cursor / Cline / Claude Code | توافق أصلي مع واجهة OpenAI، استبدال بضغطة زر |

| الباحثون المهتمون بمكدس تدريب الذكاء الاصطناعي المحلي | تدريب كامل على Huawei Ascend 910B + MindSpore |

| سيناريوهات الرياضيات / الاستدلال العلمي المكثف | AIME 2026 بنتيجة 95.3 / GPQA-Diamond بنتيجة 86.2 |

الفئات غير المستهدفة

| الفئة | السبب |

|---|---|

| من يهتم بشدة بـ "المعايير المستقلة لطرف ثالث" | جميع البيانات الحالية صادرة عن Z.ai، يلزم التحقق منها ذاتياً |

| المهام التي تعتمد بشكل أساسي على الوسائط المتعددة (صور/فيديو) | GLM-5.1 يركز على النصوص والأكواد، والوسائط المتعددة ليست نقطة قوته |

| الاعتماد الكلي على منظومة أدوات Anthropic / OpenAI | بعض الميزات المتقدمة لا تزال تعتمد على الواجهات الأصلية للشركات المصنعة |

الأسئلة الشائعة حول GLM-5.1

س1: هل GLM-5.1 مفتوح المصدر حقاً؟ وهل يمكن استخدامه تجارياً؟

نعم. في 7 أبريل 2026، قامت شركة Z.ai بإصدار GLM-5.1 بالكامل كمصدر مفتوح على منصة Hugging Face (zai-org/GLM-5) بموجب رخصة MIT، مما يسمح بالاستخدام التجاري، واشتقاق نماذج مغلقة المصدر، وإعادة الضبط الدقيق (Fine-tuning)، بشرط الاحتفاظ بإشعار حقوق النشر. تُعد هذه واحدة من أكثر رخص المصادر المفتوحة مرونة، مما يعني أنه يمكنك دمج GLM-5.1 مباشرة في منتجاتك التجارية، أو خدمات SaaS، أو عمليات النشر الخاصة، دون دفع أي رسوم ترخيص.

س2: هل GLM-5.1 أقوى حقاً من GPT-5.4 وClaude Opus 4.6؟

في معيار SWE-Bench Pro، تفوقت النتائج التي أعلنت عنها Z.ai (58.4) بالفعل على GPT-5.4 (57.7) وClaude Opus 4.6 (57.3). ولكن تجدر الإشارة إلى أن: هذه البيانات صادرة عن Z.ai نفسها ولم يتم التحقق منها بالكامل من قبل مختبرات تقييم مستقلة بعد. ننصحك بعدم اعتبار هذه الأرقام "حقيقة مطلقة"، بل جربها بنفسك في مهام عملك الحقيقية؛ يمكنك القيام بذلك الآن مباشرة عبر GLM-5.1 على منصة APIYI (apiyi.com) دون الحاجة إلى إجراء عمليات نشر خاصة بك.

س3: هل تم إدراج API الخاص بـ GLM-5.1 في APIYI؟ وكيف يمكن استخدامه؟

نعم، تم إدراجه. ما عليك سوى تغيير base_url في حزمة تطوير البرمجيات (SDK) الرسمية لـ OpenAI إلى https://api.apiyi.com/v1 واستبدال api_key بمفتاح APIYI الخاص بك، وتعيين model إلى معرف النموذج المقابل لـ GLM-5.1، وستتمكن من استدعاء النموذج فوراً دون الحاجة لإعادة كتابة كود العمل الخاص بك. يتضمن المقال "نموذج استدعاء مصغر" بلغة Python، وهو ينطبق أيضاً على حزم SDK للغات Node، Go، وRust.

س4: هل GLM-5.1 أقوى من النماذج المحلية مفتوحة المصدر الأخرى مثل DeepSeek وQwen وKimi؟

يكمن الاختلاف الأكبر في GLM-5.1 في قدرته على "ترميز الوكلاء (Agents) طويل المدى + تصدر قائمة SWE-Bench Pro"، وهو مجال لم تنجح فيه نماذج DeepSeek أو Qwen أو Kimi بشكل مباشر حتى الآن. إذا كان عملك يركز على "المحادثات اليومية + RAG"، فإن DeepSeek وQwen لا يزالان يتمتعان بتنافسية عالية؛ أما إذا كان عملك يركز على وكلاء البرمجة (Coding Agents) / تكامل IDE / إصلاح الأكواد، فإن GLM-5.1 هو الخيار الأول في عالم المصادر المفتوحة حالياً. يمكنك على منصة APIYI وضع هذه النماذج في اختبار مقارنة واحد وتكوين حكمك الخاص خلال 15 دقيقة.

س5: ما هي الأجهزة المطلوبة للنشر المحلي لـ GLM-5.1؟

يتميز GLM-5.1 ببنية MoE بإجمالي 754 مليار معلمة (754B) و40 مليار معلمة نشطة (40B)، ويتطلب النشر المحلي مجموعات GPU احترافية متعددة البطاقات، وهو أمر غير واقعي للفرق العادية. توصي Z.ai رسمياً باستخدام vLLM أو SGLang أو KTransformers لنشر خدمات الاستدلال على نطاق واسع. إذا كنت ترغب فقط في استخدام GLM-5.1 وليس دراسته، فإن الطريقة الأكثر كفاءة هي استدعاؤه مباشرة عبر APIYI (apiyi.com)، حيث لا تحتاج إلى GPU، ولا صيانة، وتدفع فقط مقابل الاستخدام.

س6: هل صحيح أن تدريب GLM-5.1 لم يستخدم أي وحدات معالجة رسومات (GPU) من Nvidia؟

نعم. كشفت Z.ai علناً أن GLM-5.1 تم تدريبه بالكامل على رقائق Huawei Ascend 910B وإطار عمل MindSpore، دون استخدام أي وحدات معالجة رسومات من Nvidia أو AMD. هذه هي الحالة الأولى في مجال النماذج الكبيرة مفتوحة المصدر لعام 2026 التي تكمل تدريب "نموذج MoE ضخم بحجم 754B باستخدام أجهزة محلية بالكامل"، مما يحمل دلالة صناعية كبيرة.

ملخص: GLM-5.1 يمثل نقطة تحول للذكاء الاصطناعي مفتوح المصدر في عام 2026

بعد ربط البنية التحتية، والمعايير، والأسعار، ومكدس التدريب، ومسارات الوصول إلى API، أصبح موقع GLM-5.1 في أبريل 2026 واضحاً تماماً: إنه ليس مجرد ترقية عادية لنموذج مفتوح المصدر، بل هو حدث أيقوني يثبت أن "المصادر المفتوحة يمكنها حقاً التفوق على النماذج المغلقة الرائدة". إن تحقيق المركز الأول عالمياً في اختبار SWE-Bench Pro بنتيجة 58.4، والترخيص الكامل بموجب اتفاقية MIT، والسعر المنخفض جداً (1.00 دولار / 3.20 دولار)، ونافذة سياق تصل إلى 200 ألف رمز (مع 128 ألف للمخرجات)، وقدرات الوكيل (Agent) طويلة المدى لمدة 8 ساعات، بالإضافة إلى مكدس تدريب يعتمد بالكامل على رقائق Huawei Ascend 910B؛ كل هذه الحقائق تستحق تقريراً منفصلاً، ولكن اجتماعها معاً جعل من هذا النموذج "نقطة تحول للمصادر المفتوحة".

والخبر الأفضل للمطورين في الصين هو أن API الخاص بـ GLM-5.1 أصبح متاحاً الآن على APIYI: لست بحاجة إلى نشر أوزان بحجم 754 مليار معلمة بنفسك، ولا تحتاج إلى بطاقة ائتمان دولية، ولا انتظار أي موافقات. فقط قم بتغيير base_url إلى https://api.apiyi.com/v1 وتغيير model إلى GLM-5.1؛ ويمكنك اليوم استبدال نموذج البرمجة الرئيسي الخاص بك في Cursor أو Cline أو Claude Code بهذا الملك الجديد مفتوح المصدر. إذا كنت لا تزال تعاني من فواتير Opus أو GPT-5، فهذه فرصة ذهبية تستحق قضاء فترة بعد الظهيرة في تجربتها.

🎯 نصيحة نهائية: لتجربة "قدرات البرمجة الرائدة + سعر المصادر المفتوحة + الوصول المستقر عبر APIYI" لنموذج GLM-5.1 فوراً، ننصحك بإنشاء مفتاح API على apiyi.com اليوم، وتغيير

base_urlالخاص بـ OpenAI SDK إلىhttps://api.apiyi.com/v1وتعيينmodelإلىGLM-5.1، ثم اختباره لمدة أسبوع على مهام البرمجة اليومية لفريقك. بغض النظر عما إذا كنت ستقرر الانتقال إليه كنموذج أساسي أم لا، فإن هذا الاختبار العملي سيمنحك رؤية مباشرة للمستوى الحقيقي للذكاء الاصطناعي مفتوح المصدر في عام 2026.

بقلم: فريق APIYI | نركز على تطبيق نماذج اللغة الكبيرة والأنظمة البيئية مفتوحة المصدر. للمزيد من التجارب العملية والمقارنات حول GLM-5.1 / Claude / GPT-5، تفضل بزيارة APIYI عبر apiyi.com.