Nota do autor: Análise profunda da aplicação do Sora 2 na indústria de AI Comic Drama, incluindo manutenção da consistência de personagens, fluxos de trabalho de geração em lote via API, limitações técnicas e melhores práticas.

O AI Comic Drama está se tornando uma nova fronteira no campo da criação de conteúdo. Como utilizar o recurso de Personagem (Character Cameo) do Sora 2 para garantir a consistência dos personagens e gerar cenas em lote através de interfaces API é o principal desafio técnico dos criadores atualmente.

Valor Central: Ao ler este artigo, você aprenderá a usar a função de personagem do Sora 2 para criar personagens reutilizáveis, realizar a geração em lote de cenas de Comic Drama via API e entender as limitações técnicas e estratégias de otimização na produção de dramas gerados por IA.

Pontos Chave da Produção de Comic Drama no Sora 2

| Ponto Chave | Descrição | Valor |

|---|---|---|

| Recurso de Personagem (Character Cameo) | Cria personagens reutilizáveis com um Character ID único | Mantém a aparência do personagem em vários vídeos |

| Geração em Lote via API | Chamada da API do Sora 2 através de uma interface unificada | Automação da geração de cenas para o drama |

| 95%+ Consistência | Modelo de difusão avançado garante consistência entre tomadas | Reduz oscilações e mudanças de forma do personagem |

| Suporte Multi-personagem | Suporta até 2 personagens simultâneos no mesmo vídeo | Ideal para cenas de diálogo e interação |

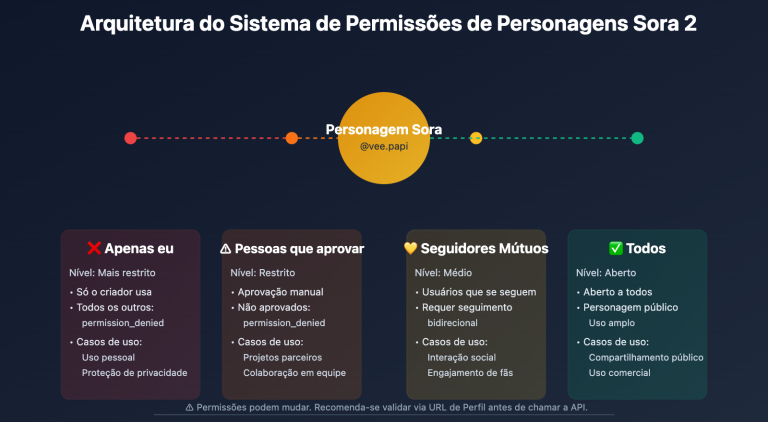

| Sistema de Controle de Permissões | Personagens podem ser privados, apenas para amigos ou públicos | Protege os direitos de IP de personagens originais |

Detalhamento da Produção de Comic Drama no Sora 2

O que é AI Comic Drama?

AI Comic Drama refere-se a séries de vídeos curtos produzidas com modelos de geração de vídeo por IA (como o Sora 2), geralmente adotando uma estética visual de quadrinhos, acompanhada de legendas e narração. A produção tradicional de quadrinhos exige planejamento da história, roteirização, design de personagens, storyboards, arte-final, colorização, efeitos e diagramação, com ciclos de produção que levam de dias a semanas por episódio.

Com modelos como o Sora 2, esse processo pode ser comprimido para algumas horas. O criador só precisa preparar o roteiro, projetar a imagem do personagem e, em seguida, gerar as cenas em lote através de comandos e da função de personagem, finalizando com uma edição simples e dublagem.

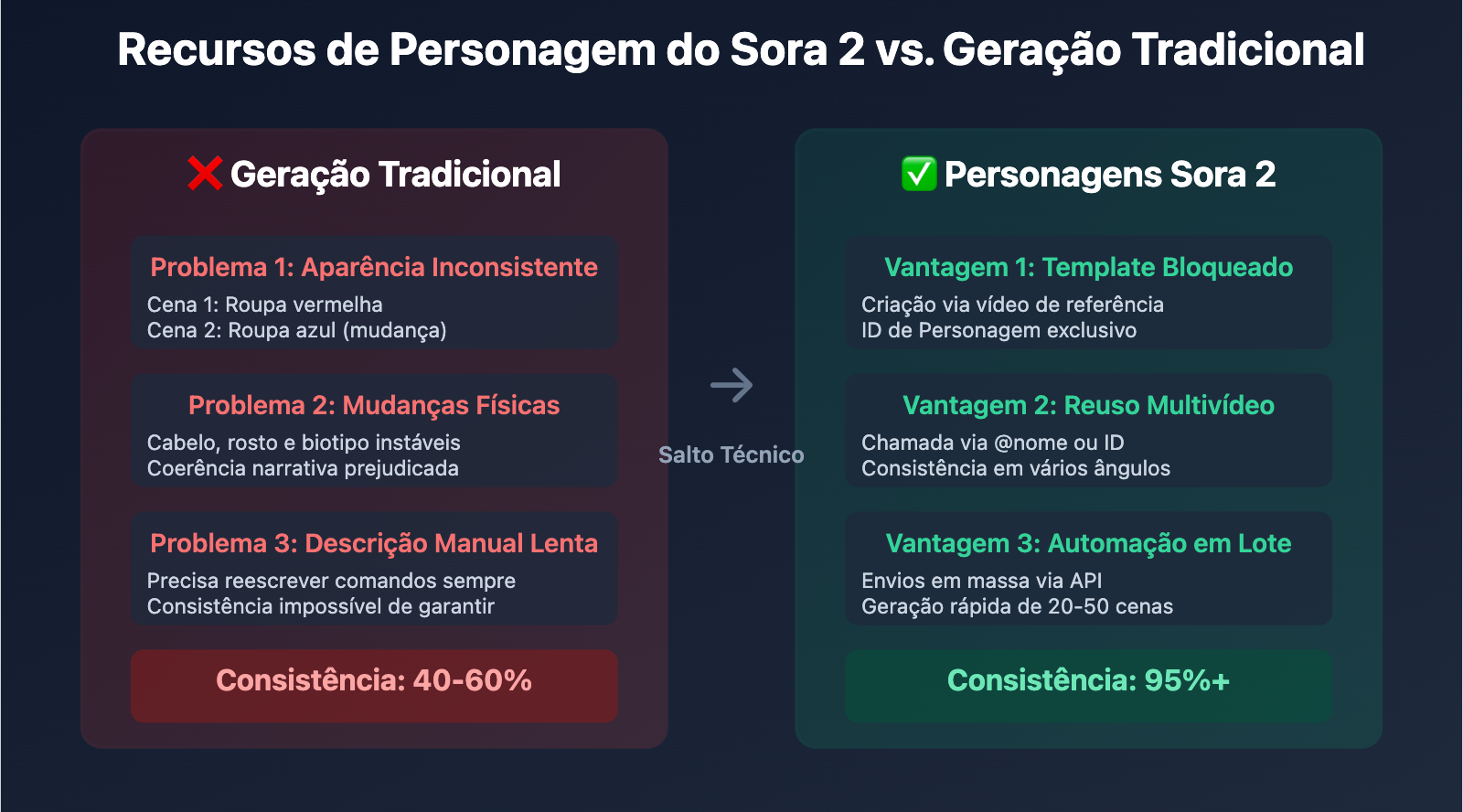

Por que a consistência do personagem é o problema central?

Na geração tradicional de vídeo por IA, a maior dor de cabeça é a inconsistência visual do personagem em diferentes cenas. Por exemplo, em uma tomada o personagem veste vermelho e, na seguinte, a roupa muda para azul; o cabelo, as feições e o tipo físico também costumam oscilar. Essa inconsistência quebra seriamente a continuidade narrativa.

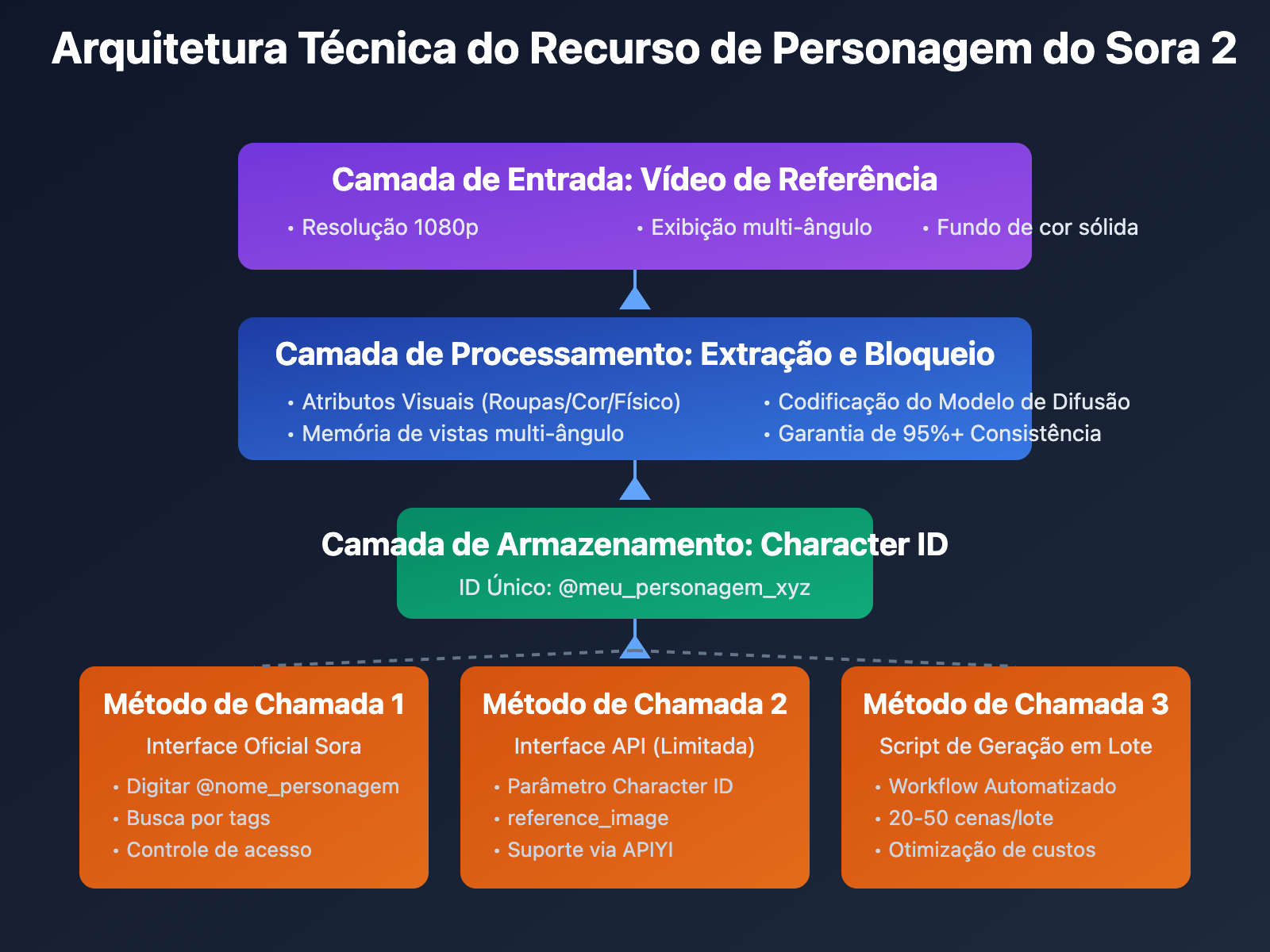

O recurso Character Cameo do Sora 2 resolve isso através dos seguintes mecanismos:

- Bloqueio de Modelo de Personagem: Ao fazer o upload de um vídeo de referência, o sistema extrai as características visuais (aparência, vestuário, porte físico) e as salva sob um Character ID.

- Reutilização entre Vídeos: Em qualquer nova solicitação de vídeo, o modelo é chamado usando

@nome_do_personagemou a tag do Character ID. - Manutenção Multi-ângulo: O sistema memoriza a aparência do personagem sob diferentes ângulos de câmera, mantendo mais de 95% de consistência.

- Continuidade Multi-tomada: Suporta a construção de sequências onde o personagem transita suavemente entre diferentes planos.

O papel da API na produção de Comic Drama

Para um episódio de alguns minutos, pode ser necessário gerar de 20 a 50 cenas. Gerar cada uma manualmente na interface do ChatGPT Plus ou no site oficial do Sora é extremamente ineficiente. Através da interface API, os criadores podem:

- Submeter solicitações em lote: Enviar várias tarefas de geração de cena de uma só vez.

- Fluxos de trabalho automatizados: Integrar a análise de roteiro, geração de comandos, chamadas de API e download de vídeos em um script automático.

- Otimização de custos: O preço por chamada de API costuma ser mais econômico do que modelos de assinatura para produção em alta escala.

- Comparação entre plataformas: Utilizar plataformas agregadoras de API para comparar rapidamente os resultados de diferentes modelos.

Guia Rápido dos Recursos de Personagem do Sora 2

Criando personagens reutilizáveis (Character Cameo)

O Sora 2 permite que você crie templates de personagens a partir de vídeos. Confira o fluxo completo:

Passo 1: Prepare o vídeo de referência do personagem

- Você pode usar vídeos gerados pelo próprio Sora ou fazer o upload de vídeos gravados com sua câmera.

- O vídeo deve mostrar claramente a aparência do personagem, seja de corpo inteiro ou meio corpo.

- Tipos de personagens suportados: pets, brinquedos, personagens desenhados à mão, avatares virtuais (proibido o uso de pessoas reais sem autorização).

Passo 2: Crie o personagem

No aplicativo do Sora:

- Clique no botão

⋯no canto superior direito do vídeo ou rascunho. - Selecione

Create character(Criar personagem). - Insira o nome de exibição (Display Name) e o nome de usuário (Handle).

- Configure as permissões:

Only me– Apenas para uso pessoal.People I approve– Apenas para usuários aprovados.Mutuals– Para usuários que se seguem mutuamente.Everyone– Disponível para todos.

Passo 3: Chame o personagem em um novo vídeo

Use as seguintes formas de citar o personagem no seu comando:

@nome_do_personagem(ex:@meugato_fluffy)- Ou digite diretamente o nome de exibição (ex:

Fluffy o gato)

Limitações:

- Máximo de 2 personagens no mesmo quadro por vídeo.

- O personagem deve ser um objeto não humano (pets, brinquedos, desenhos, etc.).

- Personagens de pessoas reais exigem o fluxo de "Personal Character" e autorização do próprio indivíduo.

Sora 2 API: Prática de Geração de Vídeo-Histórias em Lote

Exemplo Minimalista: Geração de uma única cena

Abaixo está o código mais simples para chamar a API do Sora 2 usando o SDK oficial da OpenAI:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 生成单个漫剧场景

response = client.videos.generate(

model="sora-2-1080p",

prompt="A cartoon cat wearing a red scarf walks into a cozy living room, animated style",

duration=5

)

print(f"视频生成任务已提交: {response.id}")

Ver código completo para geração em lote

import openai

import time

from typing import List, Dict

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def batch_generate_scenes(

scenes: List[Dict[str, str]],

model: str = "sora-2-1080p",

character_id: str = None

) -> List[str]:

"""

批量生成漫剧场景

Args:

scenes: 场景列表,每个场景包含 prompt 和 duration

model: 模型名称

character_id: 可选的角色 ID

Returns:

视频任务 ID 列表

"""

task_ids = []

for i, scene in enumerate(scenes):

prompt = scene["prompt"]

# 如果提供了角色 ID,在 prompt 中引用

if character_id:

prompt = f"{prompt} @{character_id}"

try:

response = client.videos.generate(

model=model,

prompt=prompt,

duration=scene.get("duration", 5)

)

task_ids.append(response.id)

print(f"✅ 场景 {i+1} 提交成功: {response.id}")

# 避免请求过快

time.sleep(1)

except Exception as e:

print(f"❌ 场景 {i+1} 提交失败: {str(e)}")

return task_ids

# 使用示例: 定义漫剧场景

scenes = [

{

"prompt": "A cartoon cat with red scarf enters a living room, excited expression",

"duration": 5

},

{

"prompt": "The cat discovers a mysterious gift box on the table, curious",

"duration": 5

},

{

"prompt": "The cat opens the box, surprised expression, sparkles emerge",

"duration": 6

}

]

# 批量生成 (假设已创建角色 ID)

task_ids = batch_generate_scenes(

scenes=scenes,

model="sora-2-1080p",

character_id="mycat_fluffy"

)

print(f"\n共提交 {len(task_ids)} 个生成任务")

Dica Técnica: Para a produção real de vídeo-histórias, recomendamos testar as chamadas de interface através da plataforma APIYI (apiyi.com). Ela oferece uma interface de API unificada com suporte ao Sora 2 e a vários outros modelos líderes de geração de vídeo, o que ajuda a validar rapidamente a viabilidade técnica e o custo-benefício do seu projeto.

Limitações Técnicas e Otimizações na Produção de Vídeos com Sora 2

Limitações Principais

| Tipo de Limitação | Descrição Detalhada | Impacto | Estratégia de Solução |

|---|---|---|---|

| Quantidade de personagens | Máximo de 2 personagens por vídeo | Impossível gerar cenas com multidões | Dividir o storyboard, gerar várias vezes e editar depois |

| Tipo de personagem | Suporta apenas objetos não reais | Não é possível usar personagens humanos reais diretamente | Usar avatares virtuais em estilo artístico (como mangá/3D) |

| Duração da geração | 5 a 20 segundos por geração | Cenas longas precisam ser geradas em partes | Usar a função Stitch para emendar os clipes |

| Disponibilidade da API | Função Character Cameo pode ser limitada na API | Necessidade de usar reference_image como alternativa |

Testar a disponibilidade através de plataformas de agregação |

| Moderação de conteúdo | Imagens de pessoas reais são bloqueadas | Impossível usar fotos reais como referência | Usar apenas ilustrações ou personagens 3D |

Dicas para Otimizar a Consistência dos Personagens

1. Otimização da qualidade do vídeo de referência

Ao criar o modelo do personagem, a qualidade do vídeo de referência influencia diretamente a consistência das gerações futuras:

- Nitidez: Use vídeos com resolução 1080p ou superior.

- Diversidade de ângulos: Forneça referências de vários ângulos: frente, lado, costas (é recomendável gerar de 3 a 5 vídeos de referência).

- Iluminação estável: Evite contrastes fortes de luz e sombra ou efeitos de iluminação complexos.

- Fundo simples: Um fundo de cor sólida ou simples ajuda o sistema a extrair as características do personagem com mais precisão.

2. Estratégias de otimização de comandos (Prompts)

Ao chamar um personagem, a forma como o comando é escrito afeta a fidelidade da reprodução:

- Citação explícita: Sempre use

@NomeDoPersonagempara referenciar claramente, não dependa apenas da descrição da aparência. - Detalhamento de ações: Descreva ações e expressões com detalhes; por exemplo,

caminha devagaré muito mais preciso quese move. - Bloqueio de estilo: Reforce o estilo repetidamente no comando, como

estilo cartoon, animação 2D. - Evite conflitos: Não descreva características no comando que entrem em conflito com o modelo original do personagem (como cores ou roupas diferentes).

3. Lidando com cenas de múltiplos personagens

Como cada vídeo suporta no máximo 2 personagens, cenas com mais pessoas exigem um tratamento especial:

- Divisão de tomadas: Divida a cena em vários cortes focando em apenas um ou dois personagens por vez.

- Edição paralela: Use a edição para simular que várias pessoas estão no mesmo ambiente através de cortes rápidos.

- Sobreposição de camadas: Utilize softwares de edição de vídeo para sobrepor personagens gerados separadamente em um mesmo cenário de fundo.

Comparativo de Soluções de Interface API para Sora 2

| Solução | Características Principais | Cenário Ideal | Suporte a Funções de Personagem |

|---|---|---|---|

| API Oficial da OpenAI | Interface oficial, alta estabilidade | Aplicações corporativas, orçamento disponível | Suporte completo (requer assinatura Plus) |

| Plataforma de Agregação APIYI | Interface unificada, comparação entre modelos | Equipes pequenas/médias, necessidade de trocar de modelo facilmente | Suporte parcial, depende da implementação da plataforma |

| API Mirror de Terceiros | Preços mais acessíveis, pagamento sob demanda | Criadores individuais, sensíveis ao custo | Suporte limitado, pode aceitar apenas reference_image |

Nota Comparativa: Cada solução acima tem seus prós e contras. Sugerimos realizar testes práticos primeiro através da plataforma APIYI (apiyi.com). Ela oferece uma interface unificada para o Sora 2 e diversos outros modelos de geração de vídeo, facilitando a comparação rápida de resultados e custos.

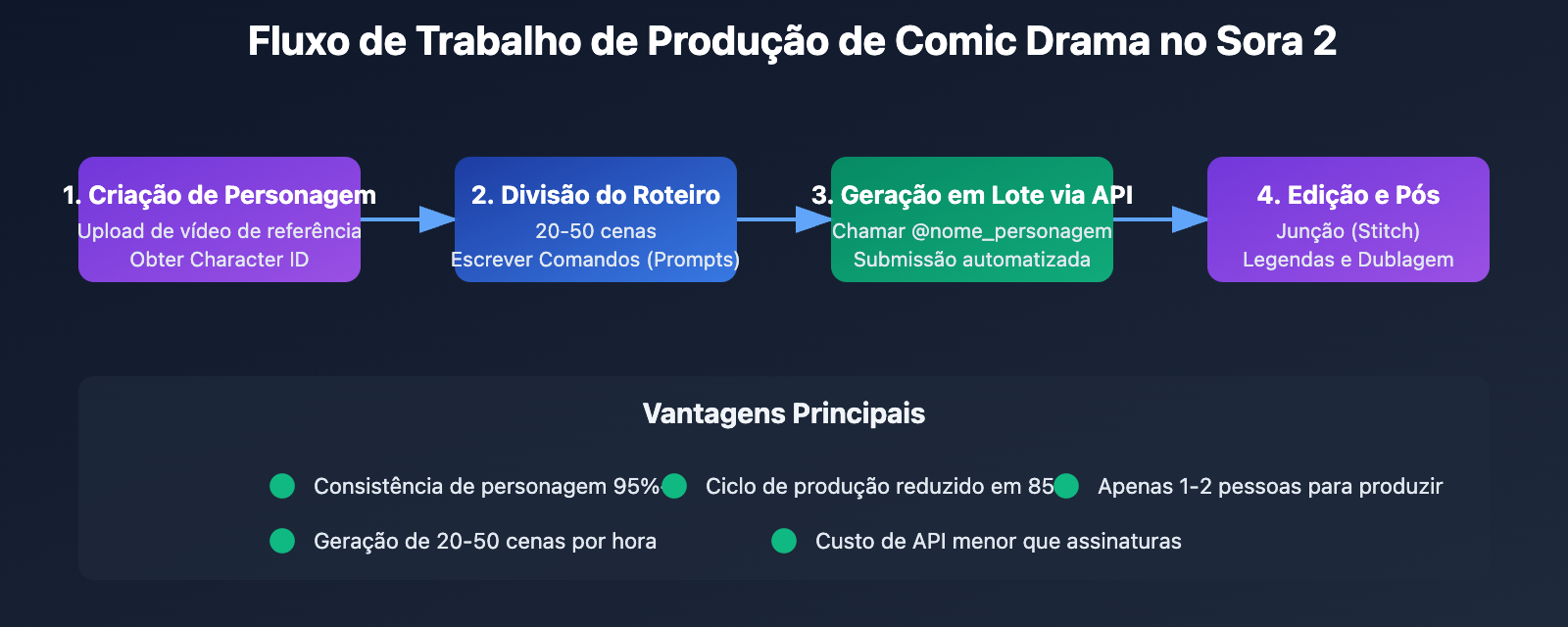

Fluxo de Trabalho Completo para Produção de Dramas Animados com Sora 2

Fases do Fluxo de Trabalho

Fase 1: Preparação Inicial

- Escrever o roteiro completo, incluindo diálogos, descrições de cenários e ações dos personagens.

- Criar o design visual dos personagens, desenhando ou gerando imagens de referência.

- Usar o Sora 2 para gerar vídeos de referência dos personagens (3 a 5 ângulos diferentes).

- Criar o Character Cameo para obter o Character ID.

Fase 2: Geração de Cenas

- Dividir o roteiro em cenas curtas de 5 a 10 segundos.

- Escrever um comando (prompt) detalhado para cada cena (incluindo referência de personagem, ação, expressão e enquadramento).

- Enviar as tarefas de geração em lote via API.

- Baixar os clipes de vídeo gerados.

Fase 3: Pós-produção

- Usar a função Stitch do Sora ou um software de edição de vídeo para unir as cenas.

- Adicionar legendas e narração.

- Ajustar efeitos sonoros e trilha sonora.

- Realizar a gradação de cor e otimização de efeitos especiais.

Fase 4: Iteração e Otimização

- Regerar cenas que não ficaram satisfatórias (ajustando o comando ou usando a função Remix).

- Adicionar cenas de transição complementares.

- Exportação final e publicação.

Estimativa de Custos e Eficiência

| Métrica | Produção Tradicional | Produção com Sora 2 | Grau de Otimização |

|---|---|---|---|

| Design de Personagem | 1-3 dias | 2-4 horas | 80% ↓ |

| Produção por Episódio | 5-7 dias | 6-12 horas | 85% ↓ |

| Custo de Mão de Obra | Equipe de 3-5 pessoas | 1-2 pessoas | 60% ↓ |

| Custo de Ferramentas | Softwares + Hardware | Assinatura Sora + API | Custo equivalente |

| Consistência de Qualidade | Depende do fator humano | 95%+ Garantida por algoritmo | Consistência superior |

Otimização de custos: Para criadores individuais sensíveis ao orçamento, considere utilizar a plataforma APIYI (apiyi.com) para chamar a API do Sora 2. A plataforma oferece um sistema flexível de pagamento sob demanda (pay-as-you-go), sem a necessidade de uma assinatura mensal do ChatGPT Plus, o que é ideal para testes e produções de pequena escala.

Perguntas Frequentes

Q1: A função de personagem do Sora 2 suporta pessoas reais?

A função Character Cameo do Sora 2 suporta apenas objetos não humanos, como animais de estimação, brinquedos, personagens desenhados à mão, avatares virtuais 3D, etc. Personagens baseados em pessoas reais exigem o fluxo separado de Personal Character, que necessita obrigatoriamente da autorização da pessoa. Se você tentar usar uma imagem de referência de uma pessoa real na API, ela será bloqueada pelo sistema de moderação de conteúdo.

Solução: Para produções de dramas animados, recomendamos o uso de estilos de ilustração ou personagens virtuais 3D. Isso evita problemas de moderação e combina perfeitamente com o estilo visual das animações.

Q2: Como lidar com o limite de apenas 2 personagens por vídeo?

Essa é uma limitação técnica atual do Sora 2. Para cenas que exigem várias pessoas presentes, você pode adotar as seguintes estratégias:

- Divisão de enquadramento: Divida cenas de grupo em vários cortes de diálogo entre duas pessoas e junte-as na edição.

- Variação de planos: Use close-ups que mostrem apenas alguns personagens de cada vez.

- Composição em pós-produção: Sobreponha personagens gerados em diferentes passagens sobre o mesmo fundo usando um software de edição.

Na verdade, essa limitação acaba incentivando o criador a usar técnicas de narrativa mais cinematográficas, focando na troca de planos em vez de planos abertos estáticos.

Q3: Como usar as funções de personagem em chamadas de API?

Atualmente, o suporte oficial da API da OpenAI para a função Character Cameo ainda não está totalmente claro. Alguns relatórios indicam que a API suporta apenas os parâmetros reference_image e reference_video, e o uso de imagens humanas reais é bloqueado.

Abordagem recomendada:

- Acesse o site APIYI (apiyi.com), registre sua conta e obtenha uma chave de API.

- Teste se a plataforma já suporta a passagem do parâmetro

Character ID. - Caso não suporte, utilize o parâmetro

reference_imagepara enviar a imagem estática de referência do personagem. - No seu comando, descreva detalhadamente as características visuais do personagem para reforçar a consistência.

Resumo

Pontos-chave da produção de mangás animados com o Sora 2:

- A função de personagem é o diferencial: O recurso Character Cameo permite, por meio de modelos de personagens reutilizáveis, alcançar mais de 95% de consistência entre os vídeos. Isso resolve o maior obstáculo na produção de mangás com IA.

- Geração em lote via API aumenta a eficiência: Ao desenvolver scripts de automação, o tempo necessário para gerar de 20 a 50 cenas de um único episódio pode ser reduzido de várias horas para menos de 60 minutos.

- Entenda as limitações técnicas: Limites como o máximo de 2 personagens por vídeo, suporte apenas para objetos não humanos e a disponibilidade restrita da API exigem soluções criativas e ajustes na pós-produção.

- Otimização do fluxo de trabalho: Um processo padronizado — que vai do roteiro e design de personagens à geração em lote e edição final — pode encurtar o ciclo de produção de um episódio de 5-7 dias para apenas 6-12 horas.

O mangá animado por IA é um cenário fundamental para a aplicação prática das tecnologias de geração de vídeo. Com o amadurecimento das funções de personagem do Sora 2 e a evolução das interfaces de API, este nicho deve passar por um crescimento explosivo. Recomendamos usar o APIYI (apiyi.com) para validar rapidamente suas ideias de mangá; a plataforma oferece créditos gratuitos e uma interface unificada para diversos modelos, suportando Sora 2, Kling, Runway e outros modelos de geração de vídeo de ponta.

📚 Referências

⚠️ Nota sobre os links: Todos os links externos utilizam o formato

Nome da Fonte: domain.compara facilitar a cópia, sem links clicáveis, preservando a integridade da página.

-

Documentação Oficial do OpenAI Sora: Guia de uso da função de personagem

- Link:

help.openai.com/en/articles/12435986-generating-content-with-characters - Descrição: Guia oficial sobre o fluxo de criação, configurações de permissão e restrições do recurso Character Cameo.

- Link:

-

Notas de Lançamento do Sora: Registro de atualizações de funções

- Link:

help.openai.com/en/articles/12593142-sora-release-notes - Descrição: Histórico de atualizações do Sora 2, incluindo as datas de lançamento dos recursos Character Cameo e Stitch.

- Link:

-

Relatório do Setor AI Manga Maker: Como a IA revoluciona a produção de mangás

- Link:

aimangamaker.com/blog/how-ai-revolutionizes-manga-manhwa-production-in-2025 - Descrição: Análise profunda do uso de ferramentas de IA na produção de mangás e manhwas, incluindo dados sobre ganho de eficiência e redução de custos.

- Link:

-

Plataforma Tooning AI: Soluções de consistência para personagens de mangá

- Link:

skywork.ai/skypage/en/Tooning-Your-AI-Co-Pilot-for-Creating-Webtoons-and-Comics - Descrição: Uma alternativa que utiliza modelagem 3D para garantir a consistência dos personagens, ideal para estudos comparativos.

- Link:

Autor: Equipe Técnica

Troca de Conhecimento: Sinta-se à vontade para discutir suas experiências na produção de mangás com IA na seção de comentários. Para mais materiais técnicos sobre o Sora 2, acesse a comunidade técnica APIYI em apiyi.com.