Note de l'auteur : Analyse approfondie de l'application de Sora 2 dans l'industrie du drama AI (AI Comic Drama), incluant le maintien de la cohérence des personnages, les flux de travail de génération par lots via API, ainsi que les limitations techniques et les meilleures pratiques.

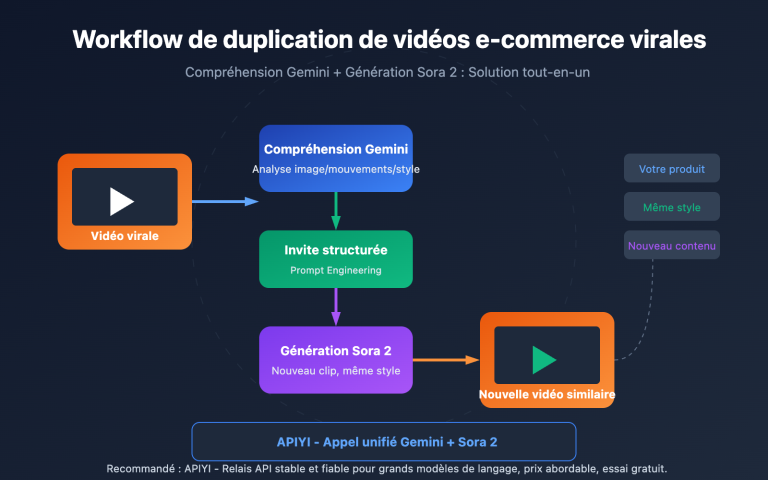

Le drama AI (AI Comic Drama) est en train de devenir un nouveau segment phare dans la création de contenu. Comment exploiter la fonctionnalité de personnage de Sora 2 (Character Cameo) pour assurer la cohérence des personnages et générer des scènes en masse via l'interface API est aujourd'hui la problématique technique majeure pour les créateurs.

Valeur centrale : À la fin de cet article, vous saurez comment utiliser la fonction personnage de Sora 2 pour créer des personnages réutilisables, générer des scènes de drama en masse via l'API, et vous comprendrez les limites techniques ainsi que les stratégies d'optimisation pour la production.

Les points clés de la production de dramas avec Sora 2

| Point clé | Explication | Valeur |

|---|---|---|

| Fonction Personnage (Character Cameo) | Crée des personnages réutilisables avec un Character ID unique | Maintient l'apparence physique sur plusieurs vidéos |

| Génération par lots via API | Appel de l'API Sora 2 via une interface unifiée | Automatise la production des scènes de drama |

| Cohérence à 95%+ | Modèle de diffusion avancé assurant la stabilité entre les plans | Réduit les problèmes de scintillement et de déformation |

| Support multi-personnages | Jusqu'à 2 personnages simultanément à l'écran | Idéal pour les scènes de dialogue et d'interaction |

| Système de contrôle des droits | Personnage paramétrable en privé / amis / public | Protège les droits de propriété intellectuelle (IP) originaux |

Analyse détaillée de la production avec Sora 2

C'est quoi exactement un drama AI ?

Un drama AI (ou "AI Comic Drama") désigne des épisodes de vidéos courtes créés à l'aide de modèles de génération vidéo (comme Sora 2). Ils adoptent souvent une esthétique proche de la bande dessinée, accompagnée de sous-titres et d'une voix off pour raconter une histoire. Traditionnellement, créer une BD ou un dessin animé demande énormément d'étapes : scénario, script, design de perso, storyboard, encrage, colorisation, effets, mise en page… Le cycle de production d'un seul épisode peut prendre des jours, voire des semaines.

Avec des modèles comme Sora 2, ce processus est compressé en quelques heures. Le créateur n'a plus qu'à préparer son script, définir le look du personnage, puis générer les scènes en masse via des invites (prompts) et la fonction personnage, pour enfin finir par un montage simple et un doublage.

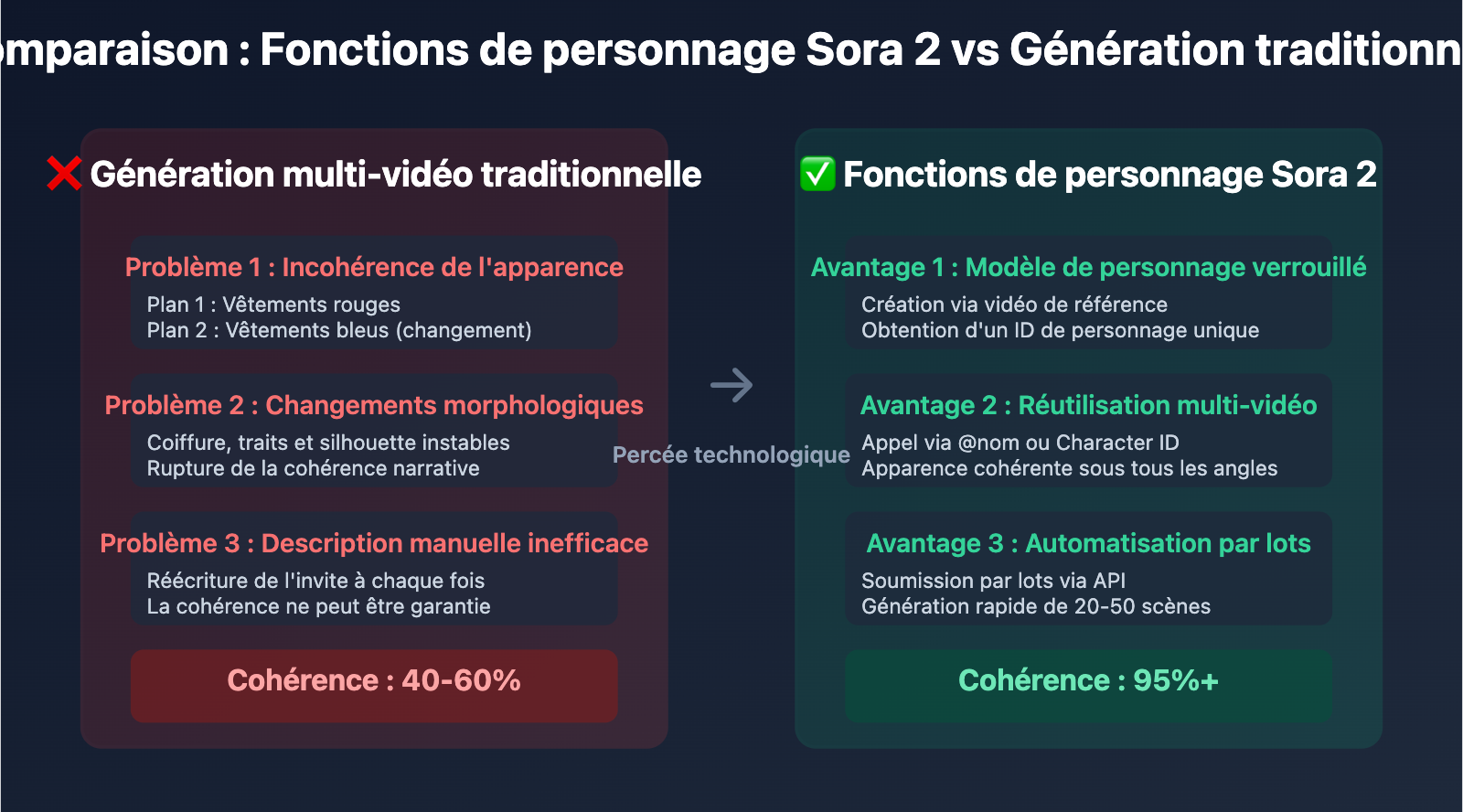

Pourquoi la cohérence des personnages est-elle le "boss final" ?

En génération vidéo IA classique, le plus gros point noir, c'est que le personnage change d'apparence d'une scène à l'autre. Par exemple, il peut porter un vêtement rouge dans le premier plan, puis bleu dans le second ; sa coiffure, ses traits ou sa stature peuvent varier. Cette inconsistance casse complètement l'immersion narrative.

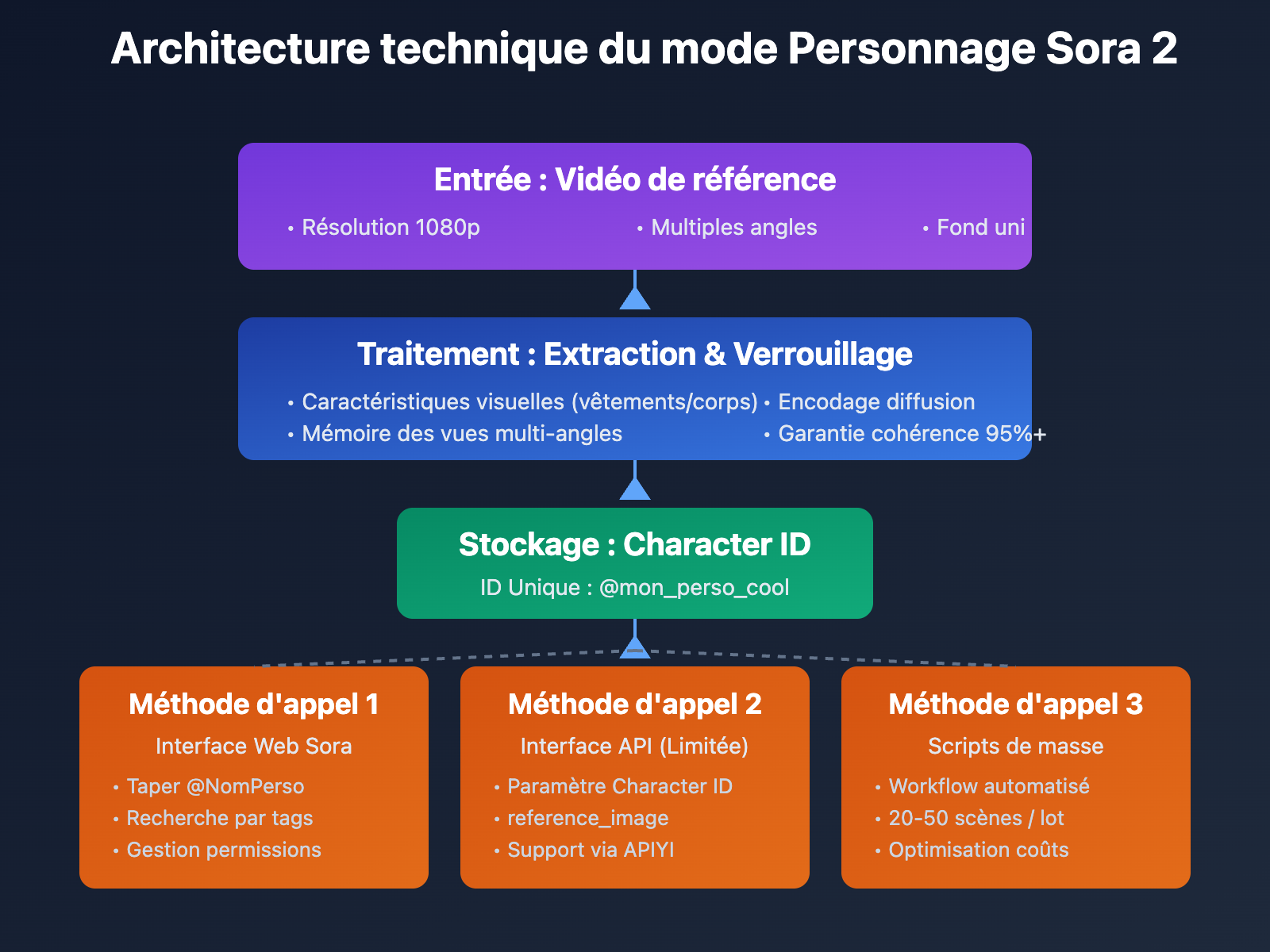

La fonction Character Cameo de Sora 2 résout ce problème grâce à plusieurs mécanismes :

- Verrouillage du modèle de personnage : On télécharge une vidéo de référence pour créer un modèle. Le système extrait les traits visuels (look, vêtements, corpulence) et les sauvegarde sous un Character ID.

- Réutilisation inter-vidéos : Dans toute nouvelle requête de génération, il suffit d'utiliser

@NomDuPersonnageou le tag Character ID pour appeler le modèle. - Maintien multi-angles : Le système "mémorise" l'apparence sous différents angles de caméra, garantissant plus de 95 % de cohérence.

- Continuité multi-plans : Permet de construire des séquences où le personnage transitionne de manière fluide entre différents plans.

Le rôle de l'API dans la production de dramas

Pour un épisode de quelques minutes, il faut parfois générer entre 20 et 50 scènes. Faire cela manuellement via l'interface de ChatGPT Plus ou le site officiel de Sora est d'une lenteur exaspérante. En passant par une interface API, les créateurs peuvent :

- Soumettre des requêtes en masse : Lancer toutes les tâches de génération de scènes d'un coup.

- Automatiser le flux de travail : Intégrer l'analyse du script, la génération des invites, l'appel API et le téléchargement des vidéos dans un script automatisé.

- Optimiser les coûts : Le prix via API est souvent plus avantageux que l'abonnement fixe, car on ne paie que ce qu'on consomme.

- Comparer les plateformes : Utiliser des plateformes d'agrégation comme APIYI pour comparer rapidement les résultats de différents modèles.

Prise en main rapide des fonctions de personnage de Sora 2

Créer un personnage réutilisable (Character Cameo)

Sora 2 vous permet de créer des modèles de personnages à partir de vidéos. Voici le processus complet :

Étape 1 : Préparer la vidéo de référence du personnage

- Vous pouvez utiliser une vidéo générée par Sora ou uploader une vidéo que vous avez filmée vous-même.

- La vidéo doit montrer clairement l'apparence du personnage, en plan large ou en plan moyen.

- Types de personnages pris en charge : animaux de compagnie, jouets, personnages dessinés à la main, avatars virtuels (les personnes réelles non autorisées sont interdites).

Étape 2 : Créer le personnage

Dans l'application Sora :

- Cliquez sur le bouton

⋯en haut à droite de la vidéo ou du brouillon. - Sélectionnez

Create character(Créer un personnage). - Saisissez le nom d'affichage (Display Name) et l'identifiant (Handle) du personnage.

- Définissez les permissions :

Only me– Uniquement pour vous.People I approve– Uniquement pour les utilisateurs approuvés.Mutuals– Pour les utilisateurs qui se suivent mutuellement.Everyone– Pour tout le monde.

Étape 3 : Appeler le personnage dans une nouvelle vidéo

Utilisez l'une des méthodes suivantes dans votre invite pour faire référence au personnage :

@identifiant_personnage(par exemple :@monchat_fluffy)- Ou saisissez directement le nom d'affichage (par exemple :

Fluffy le chat)

Limitations et remarques :

- Un maximum de 2 personnages peut apparaître simultanément dans une même vidéo.

- Le personnage doit être un objet non-humain (animal, jouet, dessin, etc.).

- Pour les personnages humains réels, vous devez utiliser le processus "Personal Character" distinct et obtenir l'autorisation de la personne concernée.

Cas pratique : Génération par lots de séries animées via l'API Sora 2

Exemple minimaliste : Génération d'une scène unique

Voici le code le plus simple pour appeler l'API Sora 2 en utilisant le SDK officiel d'OpenAI :

import openai

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://vip.apiyi.com/v1"

)

# Générer une scène unique de série animée

response = client.videos.generate(

model="sora-2-1080p",

prompt="Un chat de dessin animé portant une écharpe rouge entre dans un salon chaleureux, style animation",

duration=5

)

print(f"Tâche de génération soumise : {response.id}")

Voir le code complet pour la génération par lots

import openai

import time

from typing import List, Dict

client = openai.OpenAI(

api_key="VOTRE_CLÉ_API",

base_url="https://vip.apiyi.com/v1"

)

def batch_generate_scenes(

scenes: List[Dict[str, str]],

model: str = "sora-2-1080p",

character_id: str = None

) -> List[str]:

"""

Génère par lots des scènes de séries animées

Args:

scenes: Liste des scènes, chaque scène contient une invite et une durée

model: Nom du modèle

character_id: ID optionnel du personnage

Returns:

Liste des ID de tâches vidéo

"""

task_ids = []

for i, scene in enumerate(scenes):

prompt = scene["prompt"]

# Si un ID de personnage est fourni, on le référence dans l'invite

if character_id:

prompt = f"{prompt} @{character_id}"

try:

response = client.videos.generate(

model=model,

prompt=prompt,

duration=scene.get("duration", 5)

)

task_ids.append(response.id)

print(f"✅ Scène {i+1} soumise avec succès : {response.id}")

# Éviter des requêtes trop rapprochées

time.sleep(1)

except Exception as e:

print(f"❌ Échec de la soumission pour la scène {i+1} : {str(e)}")

return task_ids

# Exemple d'utilisation : Définir les scènes de la série

scenes = [

{

"prompt": "Un chat de dessin animé avec une écharpe rouge entre dans un salon, expression excitée",

"duration": 5

},

{

"prompt": "Le chat découvre une boîte cadeau mystérieuse sur la table, il est curieux",

"duration": 5

},

{

"prompt": "Le chat ouvre la boîte, expression surprise, des étincelles en sortent",

"duration": 6

}

]

# Génération par lots (en supposant qu'un ID de personnage a été créé)

task_ids = batch_generate_scenes(

scenes=scenes,

model="sora-2-1080p",

character_id="mycat_fluffy"

)

print(f"\nAu total, {len(task_ids)} tâches de génération ont été soumises")

Conseil technique : Pour vos productions réelles de séries animées, il est recommandé d'effectuer vos tests d'appels via la plateforme APIYI (apiyi.com). Cette plateforme propose une interface API unifiée prenant en charge Sora 2 ainsi que d'autres modèles de génération vidéo majeurs, ce qui facilite la validation rapide de la faisabilité technique et du rapport coût-efficacité de votre projet.

Limites techniques et optimisation de la production de BD/mangas avec Sora 2

Limites principales

| Type de limite | Détails spécifiques | Impact | Stratégie de contournement |

|---|---|---|---|

| Nombre de personnages | Maximum 2 personnages par vidéo | Impossible de générer des scènes de groupe | Découpage du storyboard, montage après plusieurs générations |

| Type de personnages | Uniquement des sujets non-réels | Impossible d'utiliser directement des personnages humains réels | Utiliser des avatars virtuels de style BD/manga |

| Durée de génération | 5 à 20 secondes par clip | Les plans longs nécessitent plusieurs étapes | Utiliser la fonction "Stitch" pour l'assemblage |

| Disponibilité de l'API | La fonction Character Cameo peut être limitée via API | Nécessite l'utilisation de reference_image en alternative |

Tester la disponibilité via des plateformes d'agrégation |

| Modération de contenu | Les images humaines réelles sont bloquées par le système | Impossible d'utiliser des photos réelles comme référence | Utiliser uniquement des illustrations ou des personnages 3D |

Astuces d'optimisation pour la cohérence des personnages

1. Optimisation de la qualité de la vidéo de référence

Lors de la création d'un modèle de personnage, la qualité de la vidéo de référence influence directement la cohérence des générations suivantes :

- Netteté : Utilisez des vidéos en 1080p ou avec une résolution supérieure.

- Diversité des angles : Fournissez des références sous plusieurs angles : face, profil, dos (vous pouvez générer 3 à 5 vidéos de référence).

- Éclairage stable : Évitez les contrastes trop marqués ou les jeux d'ombre et de lumière complexes.

- Arrière-plan épuré : Un fond uni ou simple aide le système à extraire plus précisément les caractéristiques du personnage.

2. Stratégie d'optimisation des invites (Prompts)

Lors de l'appel d'un personnage, la rédaction de l'invite impacte la fidélité du rendu :

- Référence explicite : Utilisez toujours

@NomDuPersonnagepour citer clairement le modèle, ne vous contentez pas de décrire l'apparence. - Détails des actions : Décrivez précisément les mouvements et les expressions. Par exemple,

walks slowly(marche lentement) est plus précis quemoves(bouge). - Verrouillage du style : Répétez le style dans l'invite, par exemple :

cartoon style, 2D animation. - Éviter les conflits : Ne décrivez pas dans l'invite des caractéristiques qui contredisent le modèle de base (comme la couleur des yeux ou les vêtements).

3. Gestion des scènes multi-personnages

Comme une vidéo ne peut supporter que deux personnages au maximum, les scènes de groupe nécessitent un traitement spécial :

- Découpage des plans : Divisez la scène de groupe en plusieurs plans individuels ou en duos.

- Montage alterné : Utilisez le montage pour simuler la présence de plusieurs personnes sur un même lieu.

- Incrustation sur fond : Utilisez un logiciel de montage vidéo pour superposer les personnages générés séparément sur un même décor.

Comparaison des solutions d'API Sora 2

| Solution | Caractéristiques clés | Cas d'usage | Support des fonctions de personnage |

|---|---|---|---|

| API officielle OpenAI | Interface officielle, haute stabilité | Applications d'entreprise, budget confortable | Support complet (nécessite un abonnement Plus) |

| Plateforme d'agrégation APIYI | Interface unifiée, comparaison de plusieurs modèles | Équipes de taille moyenne, besoin de flexibilité | Support partiel, selon l'implémentation de la plateforme |

| API miroirs tierces | Tarifs avantageux, paiement à l'usage | Créateurs indépendants, budget serré | Support limité, parfois uniquement via reference_image |

Note comparative : Chaque solution a ses avantages et ses inconvénients. Nous vous conseillons de commencer par effectuer des tests réels sur la plateforme APIYI (apiyi.com). Elle permet d'accéder via une interface unique à Sora 2 et à divers autres grands modèles de langage et de génération vidéo, ce qui facilite grandement la comparaison des résultats et des coûts.

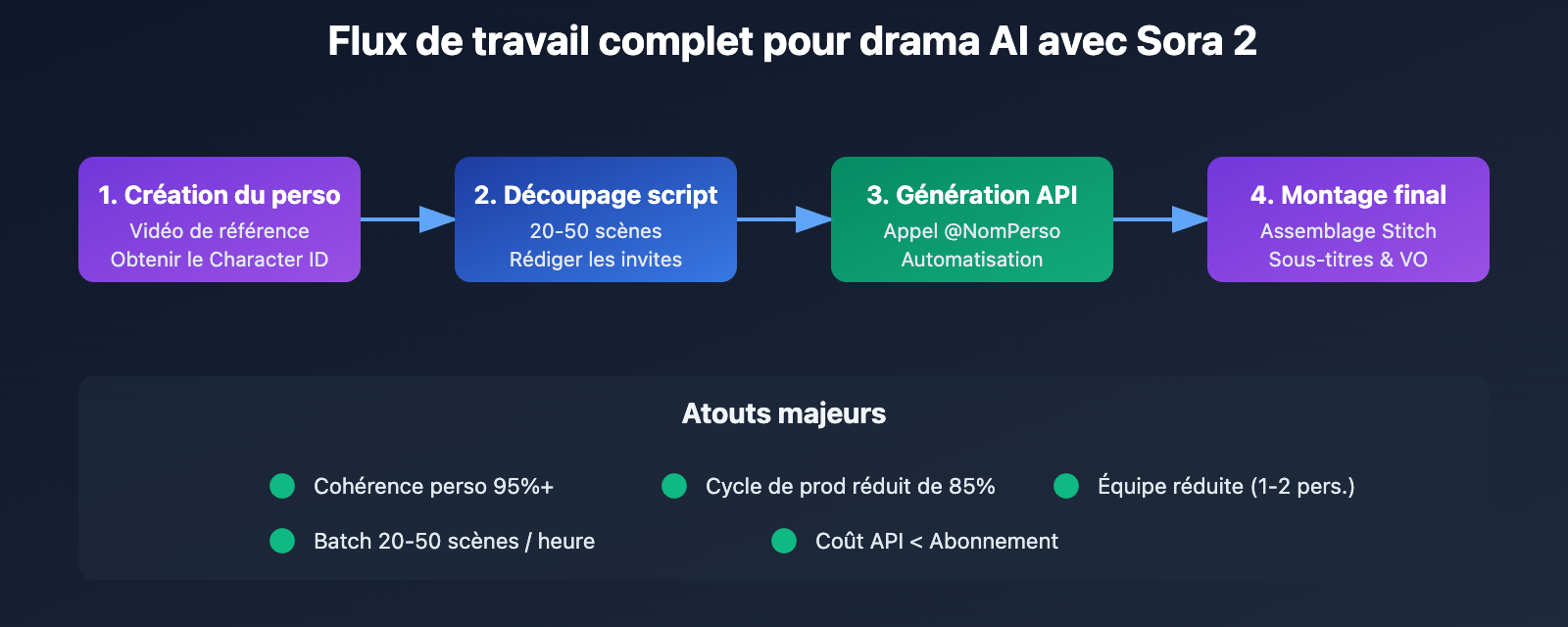

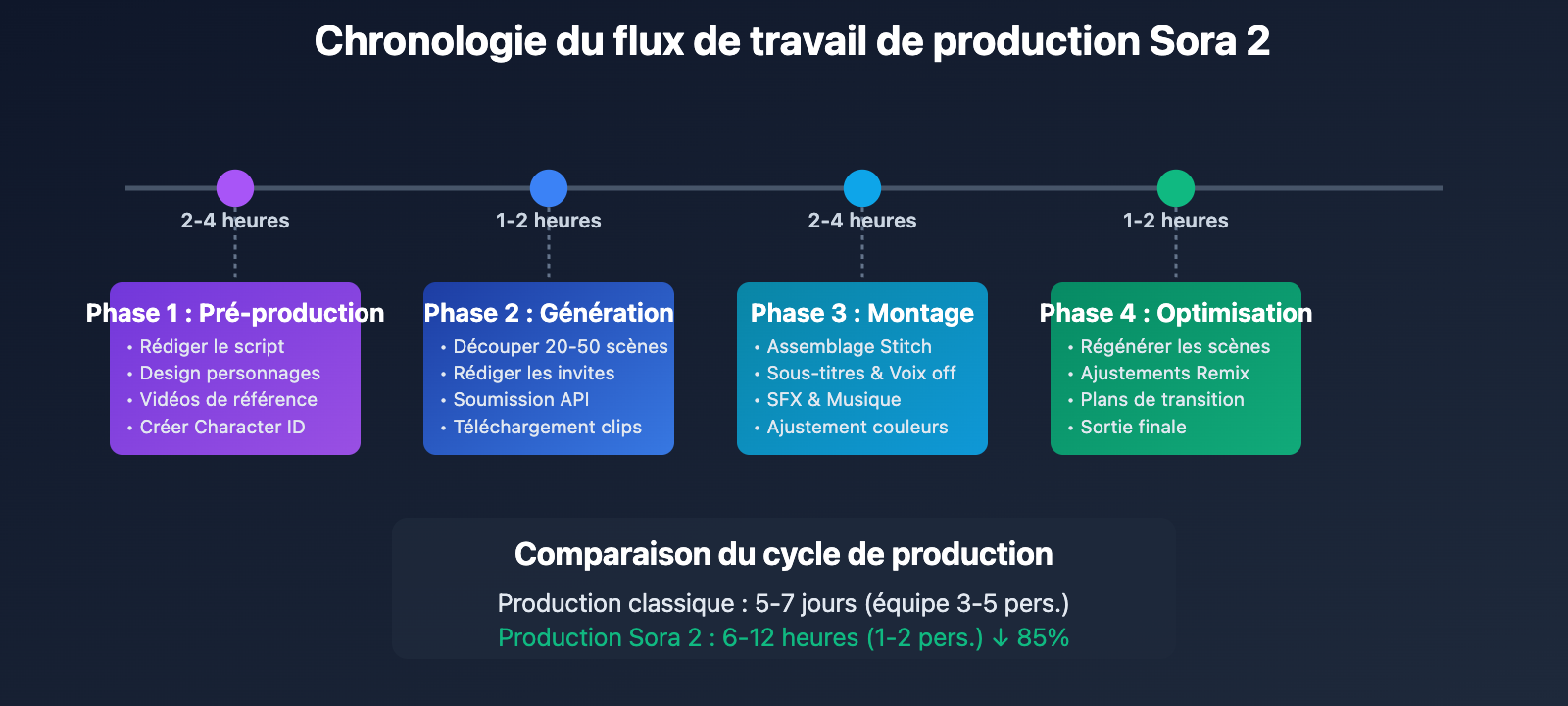

Flux de travail complet pour la production de mini-séries avec Sora 2

Étapes du flux de travail

Phase 1 : Pré-production

- Rédiger le script complet, incluant les dialogues, les descriptions de scènes et les mouvements des personnages.

- Concevoir l'apparence des personnages et dessiner ou générer des images de référence.

- Utiliser Sora 2 pour générer des vidéos de référence des personnages (3 à 5 angles différents).

- Créer un "Character Cameo" pour obtenir un Character ID unique.

Phase 2 : Génération des scènes

- Découper le script en courtes scènes de 5 à 10 secondes.

- Rédiger une invite (prompt) détaillée pour chaque scène (incluant les références de personnages, les actions, les expressions et les angles de caméra).

- Soumettre les tâches de génération en masse via l'API.

- Télécharger les séquences vidéo générées.

Phase 3 : Post-production

- Utiliser la fonction Stitch de Sora ou un logiciel de montage vidéo pour assembler les scènes.

- Ajouter les sous-titres et la narration (voix off).

- Ajuster les effets sonores et la musique de fond.

- Étalonnage des couleurs et optimisation des effets spéciaux.

Phase 4 : Itération et optimisation

- Régénérer les scènes non satisfaisantes (en ajustant l'invite ou en utilisant la fonction Remix).

- Ajouter des plans de transition si nécessaire.

- Exportation finale et publication.

Estimation des coûts et de l'efficacité

| Indicateur | Production classique | Production Sora 2 | Amélioration |

|---|---|---|---|

| Design personnages | 1-3 jours | 2-4 heures | 80% ↓ |

| Production d'un épisode | 5-7 jours | 6-12 heures | 85% ↓ |

| Coût main-d'œuvre | Équipe de 3-5 pers. | 1-2 pers. | 60% ↓ |

| Coût des outils | Logiciels + Matériel | Abonnement Sora + API | Équivalent |

| Cohérence qualité | Dépend de l'humain | 95%+ via algorithme | Cohérence accrue |

Optimisation des coûts : Pour les créateurs individuels attentifs à leur budget, vous pouvez passer par la plateforme APIYI (apiyi.com) pour appeler l'API Sora 2. Elle propose un paiement à l'usage flexible, sans besoin d'abonnement ChatGPT Plus, idéal pour les tests et les petites productions.

Questions fréquentes

Q1 : La fonction personnage de Sora 2 supporte-t-elle les personnages réels ?

La fonction Character Cameo de Sora 2 ne supporte que les objets non humains, incluant les animaux de compagnie, les jouets, les personnages dessinés à la main, les avatars 3D, etc. Pour les personnages réels, il faut utiliser le flux spécifique "Personal Character", qui nécessite impérativement l'autorisation de la personne concernée. Si vous tentez d'utiliser une image de référence d'une personne réelle via l'API, elle sera bloquée par le système de modération de contenu.

Solution : Pour la production de mini-séries, il est recommandé d'utiliser des styles d'illustration ou des avatars 3D. Cela permet d'éviter les problèmes de modération tout en correspondant parfaitement à l'esthétique visuelle du genre.

Q2 : Comment gérer la limite de 2 personnages par vidéo ?

C'est une limitation technique actuelle de Sora 2. Pour les scènes nécessitant plusieurs personnes, vous pouvez adopter les stratégies suivantes :

- Découpage des plans : Transformez une scène de groupe en plusieurs plans de dialogues à deux, reliés par le montage.

- Variation d'échelle : Utilisez des gros plans pour ne montrer qu'une partie des personnages à chaque fois.

- Composition en post-production : Superposez plusieurs personnages générés séparément sur un même arrière-plan à l'aide d'un logiciel de montage.

Cette contrainte pousse finalement les créateurs à adopter une narration plus cinématographique, en privilégiant le découpage technique plutôt qu'une mise en scène statique.

Q3 : Comment utiliser la fonction personnage via l’API ?

Actuellement, le support officiel de l'API OpenAI pour la fonction Character Cameo n'est pas encore totalement explicite. Certains rapports indiquent que l'API ne supporte que les paramètres reference_image et reference_video, et que l'usage d'images humaines est filtré.

Méthode recommandée :

- Créez un compte sur APIYI (apiyi.com) et récupérez votre clé API.

- Testez si la plateforme supporte le passage du paramètre

character_id. - Si ce n'est pas le cas, utilisez le paramètre

reference_imagepour transmettre une image de référence statique du personnage. - Décrivez précisément les caractéristiques physiques du personnage dans votre invite (prompt) pour renforcer la cohérence visuelle.

Résumé

Les points clés de la production de drames AI avec Sora 2 :

- La fonctionnalité de personnage est centrale : La fonction Character Cameo, via des modèles de personnages réutilisables, permet d'atteindre une cohérence de plus de 95 % entre les vidéos, résolvant ainsi le plus gros point de blocage de la création de drames AI.

- Efficacité accrue grâce à la génération par lots via API : L'écriture de scripts d'automatisation permet de réduire le temps de génération d'un épisode (20 à 50 scènes) de plusieurs heures à moins d'une heure.

- Comprendre les limites techniques : Un maximum de 2 personnages par vidéo, le support exclusif d'objets non-humains pour le moment, et une disponibilité limitée de l'API sont des contraintes qu'il faut contourner par la créativité et la post-production.

- Optimisation du flux de travail : Un processus standardisé — du scénario et du design des personnages à la génération par lots et la post-production — peut réduire le cycle de production d'un épisode de 5 à 7 jours à seulement 6 à 12 heures.

Le drame AI est une application majeure de la technologie de génération vidéo par IA. Avec la maturation des fonctions de personnages de Sora 2 et l'amélioration des interfaces API, ce secteur va connaître une croissance explosive. Nous vous recommandons d'utiliser APIYI (apiyi.com) pour valider rapidement vos idées de drames AI. La plateforme offre des crédits gratuits et une interface unifiée pour plusieurs modèles, supportant Sora 2, Kling, Runway et d'autres modèles de génération vidéo de premier plan.

📚 Références

⚠️ Format des liens : Tous les liens externes utilisent le format

Nom de la ressource : domain.com. Ils sont faciles à copier mais ne sont pas cliquables pour préserver le référencement.

-

Documentation officielle d'OpenAI Sora : Guide d'utilisation des fonctionnalités de personnages

- Lien :

help.openai.com/en/articles/12435986-generating-content-with-characters - Description : Présentation officielle du processus de création, des paramètres de permissions et des limitations de la fonction Character Cameo.

- Lien :

-

Notes de mise à jour de Sora : Historique des mises à jour des fonctionnalités

- Lien :

help.openai.com/en/articles/12593142-sora-release-notes - Description : Journal des mises à jour de Sora 2, incluant les dates de sortie des fonctions Character Cameo et Stitch.

- Lien :

-

Rapport sectoriel AI Manga Maker : Comment l'IA révolutionne la création de mangas

- Lien :

aimangamaker.com/blog/how-ai-revolutionizes-manga-manhwa-production-in-2025 - Description : Analyse approfondie de l'application des outils d'IA dans la production de mangas et de drames AI, avec des données sur l'amélioration de l'efficacité et les économies de coûts.

- Lien :

-

Plateforme Tooning AI : Solutions de cohérence des personnages de manga

- Lien :

skywork.ai/skypage/en/Tooning-Your-AI-Co-Pilot-for-Creating-Webtoons-and-Comics - Description : Solution alternative utilisant la modélisation 3D pour assurer la cohérence des personnages, idéale pour une étude comparative.

- Lien :

Auteur : Équipe technique

Échanges techniques : N'hésitez pas à partager votre expérience de production de drames AI dans les commentaires. Pour plus de ressources techniques sur Sora 2, visitez la communauté technique d'APIYI sur apiyi.com.