作者注:Sora 2のAIマン劇業界における活用方法を深掘りします。キャラクターの一貫性維持、APIを活用した一括生成ワークフロー、そしてマン劇制作における技術的制限とベストプラクティスについて解説します。

AIマン劇(AI Comic Drama)は、コンテンツ制作における新たな成長分野として注目されています。Sora 2のキャラクター機能 (Character Cameo) を利用してキャラクターの一貫性を実現し、API経由でマン劇のシーンを一括生成する方法は、現在のクリエイターが最も関心を寄せている技術的課題です。

核心的な価値: 本記事を読み終える頃には、Sora 2のキャラクター機能を使用して再利用可能なキャラクターを作成する方法、APIを通じたマン劇シーンの一括生成、そしてAIマン劇制作における技術的な制限と最適化戦略を習得できるでしょう。

Sora 2 マン劇制作の重要ポイント

| ポイント | 説明 | メリット |

|---|---|---|

| キャラクター機能 (Character Cameo) | 再利用可能なキャラクターを作成し、固有のCharacter IDを取得 | 複数の動画間でキャラクターの外見を一定に保つ |

| API一括生成 | 統合されたインターフェースを通じてSora 2 APIを呼び出し | マン劇シーン生成の自動化と効率化を実現 |

| 95%以上のキャラクター一貫性 | 高度な拡散モデルによりカットを跨いでも同一人物を維持 | キャラクターのチラつきや形態変化を抑制 |

| マルチキャラクター対応 | 1つの動画内で最大2キャラクターの同時登場をサポート | 対話や交流シーンの制作に最適 |

| 権限管理システム | キャラクターをプライベート/友人限定/公開に設定可能 | オリジナルキャラクターのIP権利を保護 |

Sora 2 マン劇制作の詳細解説

AIマン劇とは?

AIマン劇とは、Sora 2などのAI動画生成モデルを利用して制作された短編動画シリーズです。通常、漫画のような視覚スタイルを採用し、字幕やナレーションを添えて物語を展開します。従来の漫画制作では、ストーリー立案、脚本作成、キャラクターデザイン、ネーム(分鏡)、線画、着色、エフェクト、写植など多くの工程が必要で、1話の制作に数日から数週間を要していました。

しかし、Sora 2などの生成モデルを活用することで、このプロセスを数時間にまで短縮できます。クリエイターは脚本を準備し、キャラクターのビジュアルを設計するだけで、あとはプロンプトとキャラクター機能を使ってシーンを一括生成し、最後に簡単な編集とアフレコを行うだけで作品を完成させることができます。

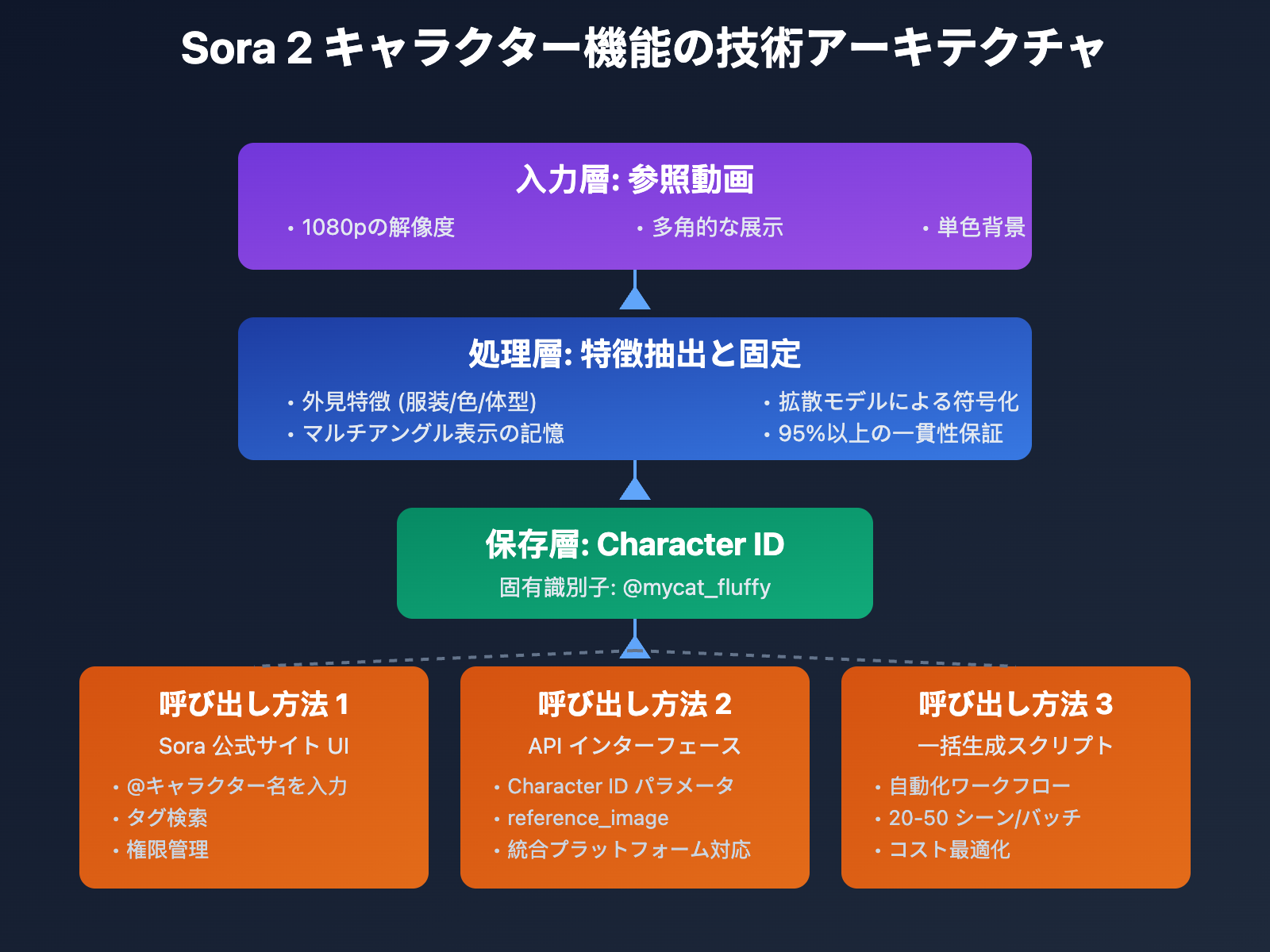

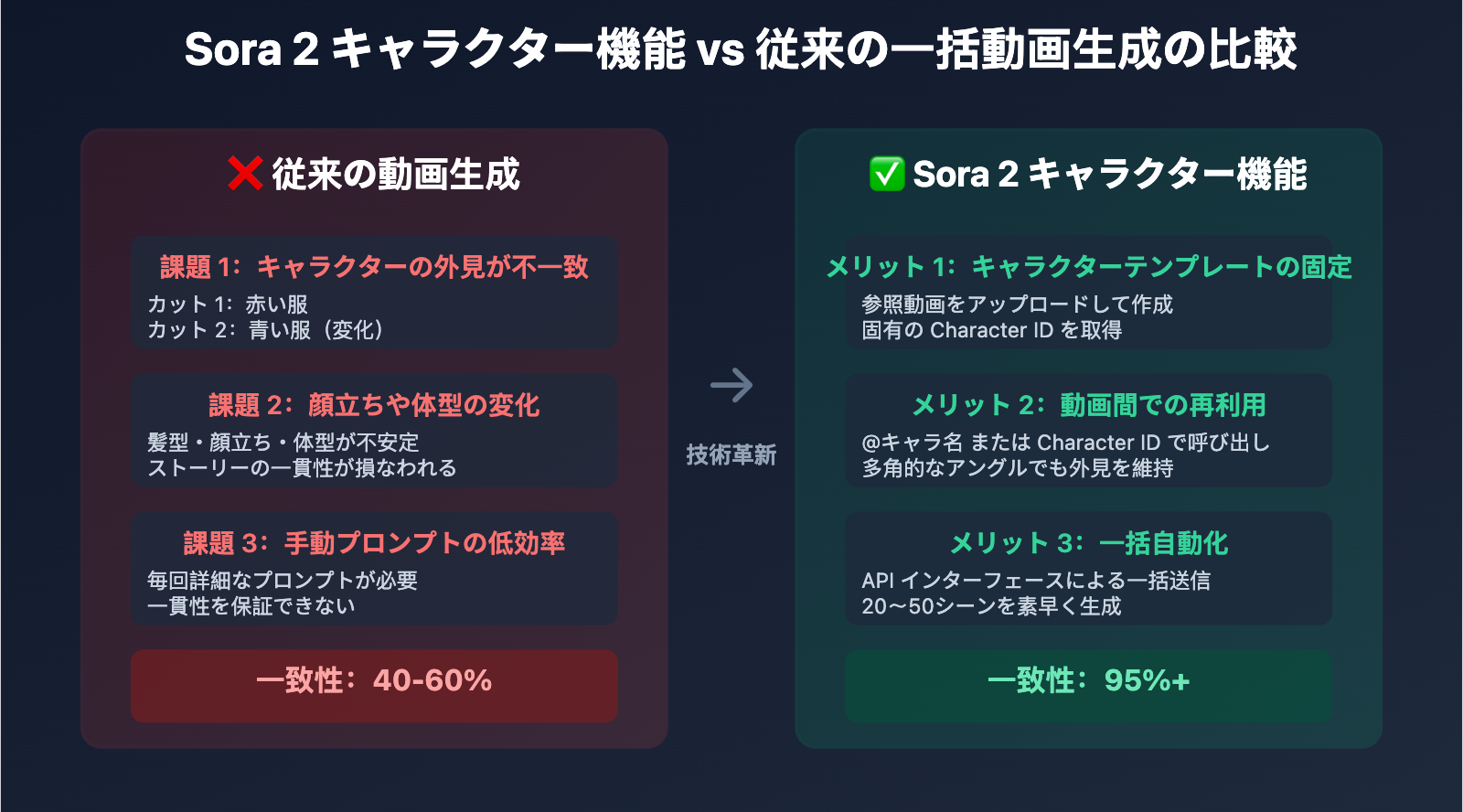

なぜキャラクターの一貫性が最大の課題なのか?

従来のAI動画生成において、最大の悩みはシーンごとにキャラクターの外見が変わってしまうことでした。例えば、最初のカットでは赤い服を着ていたキャラクターが、次のカットでは青い服になっていたり、髪型、顔立ち、体型が変わってしまったりすることがありました。このような不一致は、物語の連続性を著しく損ないます。

Sora 2のCharacter Cameo機能は、以下のメカニズムでこの問題を解決しています:

- キャラクターテンプレートの固定: 参照動画をアップロードしてキャラクターテンプレートを作成すると、システムがビジュアル特徴(外見、服装、体型など)を抽出し、Character IDとして保存します。

- 動画を跨いだ再利用: 新しい動画生成リクエストの際に、

@キャラクター名または Character ID タグを使用することでテンプレートを呼び出せます。 - マルチアングルの維持: 異なるカメラアングルからでもキャラクターの外見を記憶し、95%以上の一貫性を保ちます。

- マルチカットの連続性: 複数のカットにわたるシーケンスの構築をサポートし、カット間でキャラクターがスムーズに遷移します。

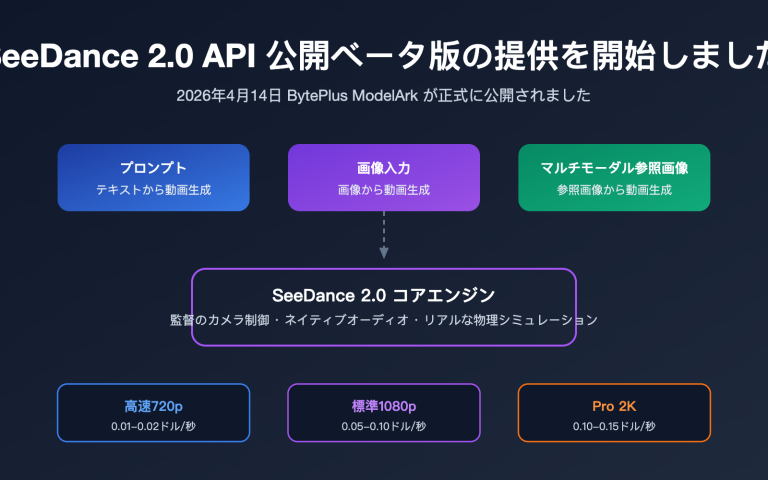

マン劇制作におけるAPIの役割

数分間のマン劇1本を制作するには、20〜50個のシーンを生成する必要があります。これをChatGPT PlusやSoraの公式サイト上で手動で一つずつ生成するのは非常に効率が悪いです。API経由で呼び出すことで、クリエイターは以下のことが可能になります:

- リクエストの一括送信: 複数のシーンの生成タスクを一度に送信できます。

- 自動化ワークフロー: 脚本の解析、プロンプト生成、API呼び出し、動画ダウンロードを自動化スクリプトで統合できます。

- コストの最適化: API呼び出しの価格は通常サブスクリプション制よりも安価で、従量課金制のため経済的です。

- マルチプラットフォーム比較: APIアグリゲーターなどを通じて、異なるモデルの効果を素早く比較検討できます。

Sora 2 キャラクター機能クイックスタート

再利用可能なキャラクターの作成 (Character Cameo)

Sora 2 では、動画からキャラクターテンプレートを作成できます。以下はその全手順です:

ステップ 1:キャラクター参照動画の準備

- Sora で生成した動画、またはカメラロールからアップロードした自撮り動画を使用できます。

- キャラクターの全身または上半身の外見がはっきりと映っている必要があります。

- サポートされているキャラクタータイプ:ペット、おもちゃ、手描きキャラクター、アバター(許可のない実在の人物は禁止されています)。

ステップ 2:キャラクターの作成

Sora アプリ内での操作:

- 動画またはドラフトの右上にある

⋯ボタンをクリックします。 Create character(キャラクターを作成)を選択します。- キャラクターの表示名(Display Name)とユーザー名(Handle)を入力します。

- 権限を設定します:

Only me– 自分のみ使用可能People I approve– 承認したユーザーのみ使用可能Mutuals– 相互フォローのユーザーのみ使用可能Everyone– 全員に使用可能

ステップ 3:新しい動画でキャラクターを呼び出す

プロンプト内で以下の方法を使用してキャラクターを引用します:

@キャラクターユーザー名(例:@mycat_fluffy)- または、キャラクターの表示名を直接入力(例:

Fluffy the cat)

制限事項:

- 1つの動画に登場させることができるキャラクターは最大 2 つまでです。

- キャラクターは非実在の対象(ペット、おもちゃ、手描きなど)である必要があります。

- 実在の人物キャラクターについては、別途 Personal Character のフローを使用し、本人の同意を得る必要があります。

Sora 2 API マンガ動画一括生成の実践

最小構成のサンプル:単一シーンの生成

以下は、OpenAI 公式 SDK を使用して Sora 2 API を呼び出す最もシンプルなコードです:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 生成单个漫剧场景

response = client.videos.generate(

model="sora-2-1080p",

prompt="A cartoon cat wearing a red scarf walks into a cozy living room, animated style",

duration=5

)

print(f"视频生成任务已提交: {response.id}")

一括生成の完全なコードを表示

import openai

import time

from typing import List, Dict

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

def batch_generate_scenes(

scenes: List[Dict[str, str]],

model: str = "sora-2-1080p",

character_id: str = None

) -> List[str]:

"""

批量生成漫剧场景

Args:

scenes: 场景列表,每个场景包含 prompt 和 duration

model: 模型名称

character_id: 可选的角色 ID

Returns:

视频任务 ID 列表

"""

task_ids = []

for i, scene in enumerate(scenes):

prompt = scene["prompt"]

# 如果提供了角色 ID,在 prompt 中引用

if character_id:

prompt = f"{prompt} @{character_id}"

try:

response = client.videos.generate(

model=model,

prompt=prompt,

duration=scene.get("duration", 5)

)

task_ids.append(response.id)

print(f"✅ 场景 {i+1} 提交成功: {response.id}")

# 避免请求过快

time.sleep(1)

except Exception as e:

print(f"❌ 场景 {i+1} 提交失败: {str(e)}")

return task_ids

# 使用示例: 定义漫剧场景

scenes = [

{

"prompt": "A cartoon cat with red scarf enters a living room, excited expression",

"duration": 5

},

{

"prompt": "The cat discovers a mysterious gift box on the table, curious",

"duration": 5

},

{

"prompt": "The cat opens the box, surprised expression, sparkles emerge",

"duration": 6

}

]

# 批量生成 (假设已创建角色 ID)

task_ids = batch_generate_scenes(

scenes=scenes,

model="sora-2-1080p",

character_id="mycat_fluffy"

)

print(f"\n共提交 {len(task_ids)} 个生成任务")

技術的なアドバイス: 実際のマンガ動画制作では、APIYI(apiyi.com)プラットフォームを通じてインターフェース呼び出しのテストを行うことをお勧めします。このプラットフォームは統一された API インターフェースを提供しており、Sora 2 を含む複数の主要な動画生成モデルをサポートしています。これにより、技術案の実現可能性とコストパフォーマンスを迅速に検証することができます。

Sora 2によるマンガ・ドラマ制作の技術的制限と最適化

主な制限

| 制限の種類 | 詳細 | 影響 | 対策 |

|---|---|---|---|

| キャラクター数 | 1つの動画につき最大2名まで | 大人数が登場するシーンが生成不可 | カットを分割し、複数回生成した後に編集で繋ぐ |

| キャラクターの種類 | 非実在のキャラクターのみサポート | 実写キャラクターを直接使用できない | 漫画スタイルの仮想アバターを使用する |

| 生成時間 | 1回あたり5〜20秒 | 長回しのショットは分割生成が必要 | Stitch(ステッチ)機能を使用して結合する |

| APIの可用性 | Character Cameo機能がAPIで制限される可能性あり | reference_imageでの代用が必要 | 統合プラットフォームを通じて可用性をテストする |

| コンテンツモデレーション | 実写画像は検閲システムでブロックされる | 実在の人物を参考画像に使えない | イラストや3Dキャラクターのみを使用する |

キャラクターの一貫性を最適化するテクニック

1. 参考動画のクオリティ最適化

キャラクターテンプレートを作成する際、参考動画のクオリティは生成される動画の一貫性に直接影響します。

- 解像度: 1080p以上の高解像度ビデオを使用してください。

- アングルの多様性: 正面、横、背面など、多角的なリファレンスを提供します(3〜5個の参考動画を生成するのが理想的です)。

- 安定したライティング: 極端な明暗差や複雑な光影エフェクトは避けてください。

- シンプルな背景: 無地やシンプルな背景にすることで、システムがキャラクターの特徴をより正確に抽出できるようになります。

2. プロンプトの最適化戦略

キャラクターを呼び出す際のプロンプトの書き方は、再現度に大きく影響します。

- 明確な参照: 常に

@キャラクター名を使用して明確に指定し、外見の説明だけで済ませないようにします。 - 動作の具体化: 動作や表情を詳細に記述します。例えば、単に

moves(動く)とするよりもwalks slowly(ゆっくり歩く)の方がより正確です。 - スタイルの固定: プロンプト内でスタイルを繰り返し強調します(例:

cartoon style, 2D animation)。 - 矛盾の回避: キャラクターテンプレートと矛盾する特徴(色や服装など)をプロンプトに含めないでください。

3. 複数キャラクターシーンの処理

1つの動画でサポートされるキャラクターは最大2名までであるため、多人数が登場するシーンでは工夫が必要です。

- カットの分割: 群衆シーンを複数の1人または2人のショットに分割します。

- クロスブラウズ編集: 編集によって複数の人物がその場にいるような演出を行います。

- 背景合成: 動画編集ソフトを使用して、複数回に分けて生成したキャラクターを同一の背景上に重ね合わせます。

Sora 2 API接続プランの比較

| プラン | 主な特徴 | 推奨シーン | キャラクター機能の対応状況 |

|---|---|---|---|

| OpenAI公式API | 公式インターフェースで安定性が高い | 予算が十分にある企業向けアプリケーション | フルサポート(Plusの購読が必要) |

| APIアグリゲーター | 統合インターフェース、複数モデルの比較が可能 | モデルを柔軟に切り替えたい中小チーム | 一部サポート(プラットフォームの実装に依存) |

| サードパーティ製ミラーAPI | 低価格、従量課金制 | コストを抑えたい個人クリエイター | 限定的なサポート(reference_imageのみの場合あり) |

比較のポイント: 上記の各プランにはそれぞれメリットとデメリットがあります。まずは APIYI (apiyi.com) プラットフォームで実際のテストを行うことをお勧めします。このプラットフォームはSora 2を含む多様な動画生成モデルの統合API呼び出しに対応しており、効果とコストを素早く比較するのに適しています。

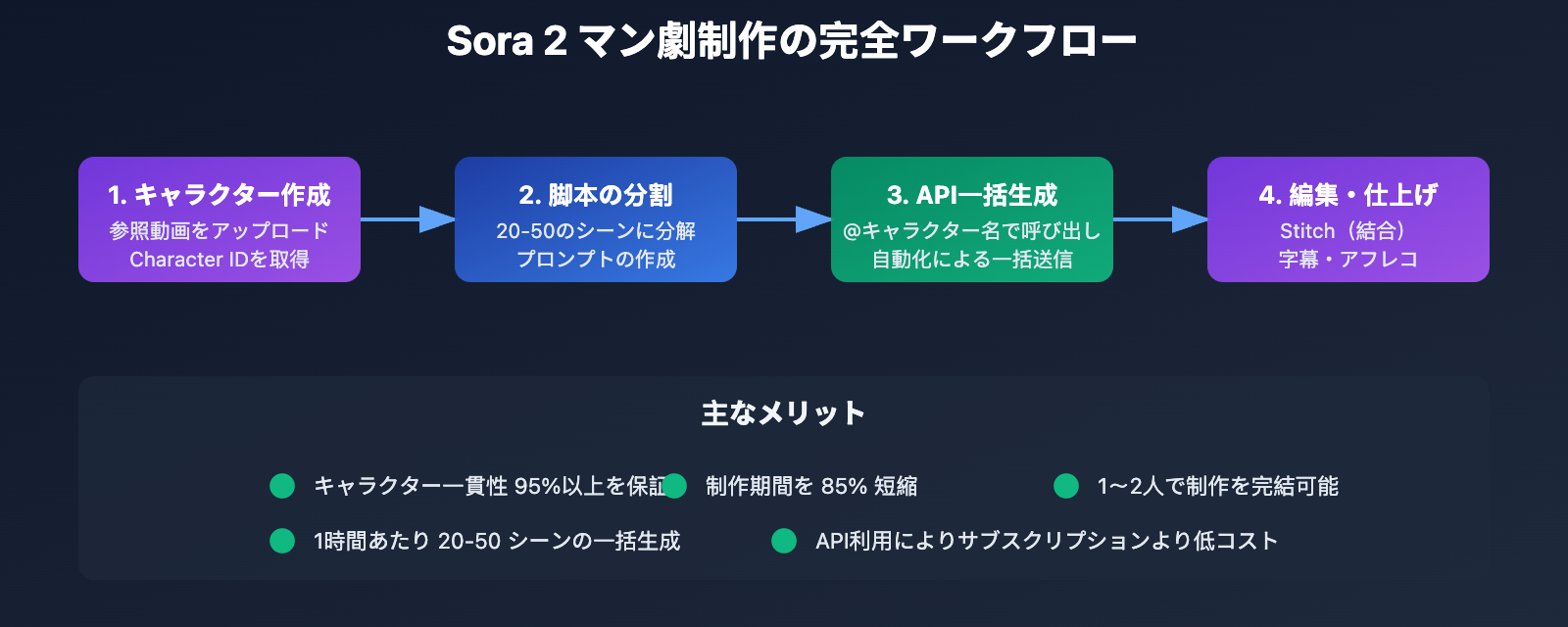

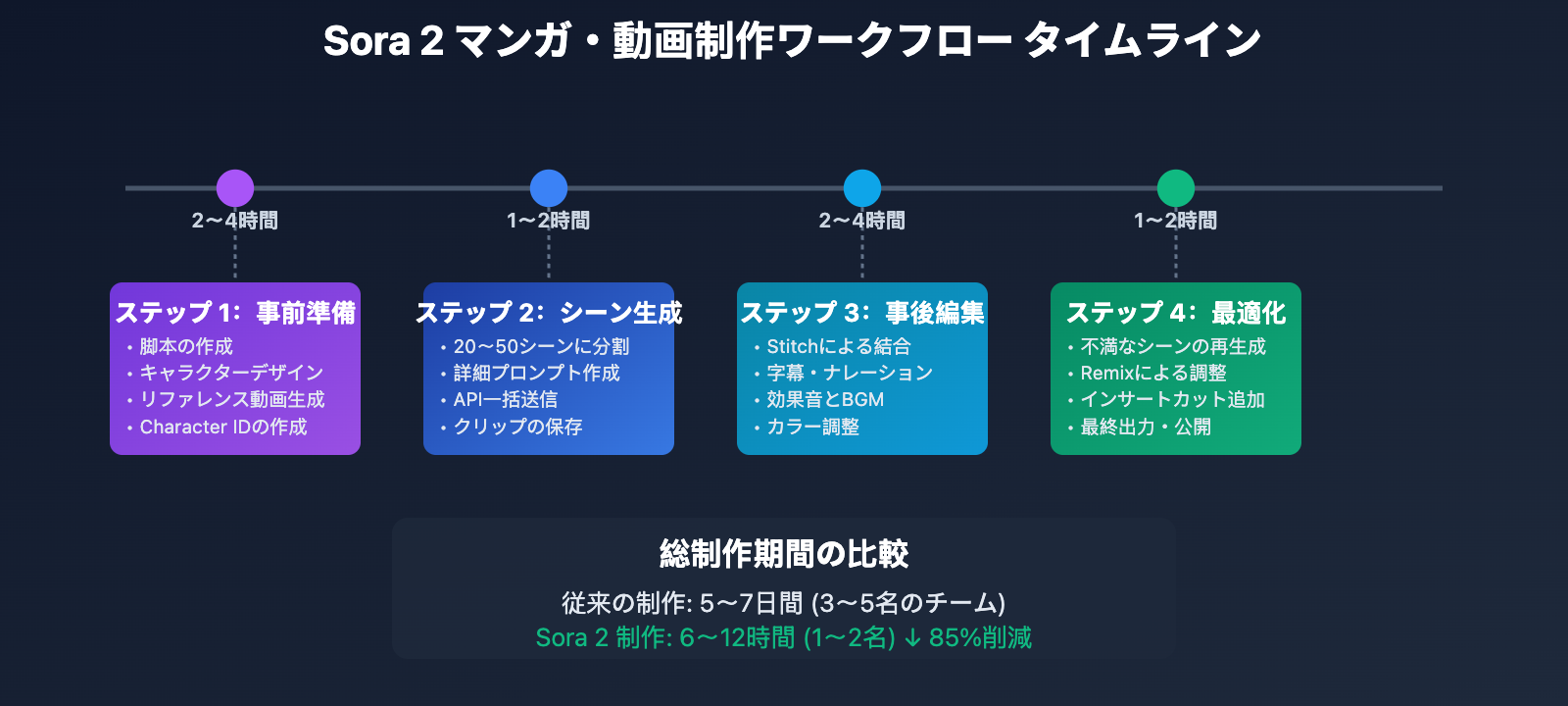

Sora 2 マンガ・動画制作の完全ワークフロー

ワークフローの各ステップ

ステップ 1:事前準備

- 対話、シーン描写、キャラクターの動作を含む完全な脚本を作成する

- キャラクターのデザインを行い、キャラクターリファレンス画像を生成または描画する

- Sora 2 を使用してキャラクターリファレンス動画を生成する(3〜5つの異なるアングル)

- Character Cameo を作成し、Character ID を取得する

ステップ 2:シーン生成

- 脚本を5〜10秒の短いシーンに分割する

- 各シーンに対して詳細なプロンプトを作成する(キャラクター参照、アクション、表情、カメラワークを含む)

- API を通じて生成タスクを一括送信する

- 生成された動画クリップをダウンロードする

ステップ 3:ポストプロダクション

- Sora の Stitch(スティッチ)機能または動画編集ソフトを使用してシーンを繋ぎ合わせる

- 字幕とナレーションを追加する

- 効果音とバックグラウンドミュージック(BGM)を調整する

- カラーグレーディングとエフェクトの最適化を行う

ステップ 4:イテレーションと最適化

- 納得のいかないシーンを再生成する(プロンプトの調整または Remix 機能を使用)

- インサートカット(挿入ショット)を補充する

- 最終出力と公開

コストと効率の推定

| 指標 | 従来の制作 | Sora 2 による制作 | 改善率 |

|---|---|---|---|

| キャラデザイン | 1〜3日間 | 2〜4時間 | 80% ↓ |

| 1エピソード制作 | 5〜7日間 | 6〜12時間 | 85% ↓ |

| 人件費 | 3〜5名のチーム | 1〜2名 | 60% ↓ |

| ツール費用 | ペイントソフト + デバイス | Sora サブスク + API | ほぼ同等 |

| クオリティの一貫性 | 人手への依存度が高い | 95%以上をアルゴリズムで保証 | 一貫性の向上 |

コストの最適化: 予算を抑えたい個人クリエイターの方は、APIYI (apiyi.com) プラットフォームを通じて Sora 2 API を呼び出すことを検討してみてください。このプラットフォームは柔軟な従量課金制を採用しており、ChatGPT Plus のサブスクリプションなしで利用できるため、小規模なテストや制作に適しています。

よくある質問(FAQ)

Q1: Sora 2 のキャラクター機能は実写の人物に対応していますか?

Sora 2 の Character Cameo 機能は、ペット、玩具、手書きキャラクター、3Dアバターなどの非実在のオブジェクトのみをサポートしています。実在の人物のキャラクターには、別途「Personal Character」ワークフローが必要であり、本人の許諾が必須となります。API で実在の人物のリファレンス画像を使用しようとすると、コンテンツモデレーションシステムによってブロックされます。

解決策: マンガ動画制作では、イラストスタイルや 3D アバターを使用することをお勧めします。これにより、審査の問題を回避しつつ、作品の視覚的なスタイルにもマッチさせることができます。

Q2: 1つの動画にキャラクターを2人までしか配置できない制限にはどう対処すればいいですか?

これは現在の Sora 2 における技術的な制限です。多人数が登場するシーンが必要な場合は、以下の戦略をとることができます。

- カット割り: 群像劇を複数の2人対話シーンに分割し、編集で繋ぎ合わせる。

- アングルの変更: クローズアップを多用し、一度に画面に映るキャラクターを限定する。

- 事後合成: 動画編集ソフトを使用して、複数回生成したキャラクターを同一の背景に重ね合わせる。

この制限は、むしろクリエイターに映画的なナラティブ手法(単純な説明ではなく、カット割りによる演出)を促すきっかけにもなります。

Q3: API 呼び出しでキャラクター機能を使用するにはどうすればいいですか?

現在、OpenAI 公式 API の Character Cameo 機能への対応状況は完全には明確ではありません。一部の報告では、API は reference_image と reference_video パラメータのみをサポートしており、実在の人物の画像を使用すると審査でブロックされることが示されています。

推奨プラン:

- APIYI (apiyi.com) にアクセスしてアカウントを登録し、API キーを取得する。

- そのプラットフォームが Character ID によるパラメータ伝送をサポートしているかテストする。

- サポートされていない場合は、

reference_imageパラメータを使用してキャラクターの静止画リファレンスを送る。 - プロンプト内でキャラクターの外見的特徴を詳細に記述し、一貫性を強化する。

まとめ

Sora 2 マン劇制作の核心的なポイント:

- キャラクター機能が核心: Character Cameo 機能により、再利用可能なキャラクターテンプレートを通じて 95% 以上の動画間の一貫性を実現し、AI マン劇制作における最大の課題を解決しました。

- API による一括生成で効率を向上: 自動化スクリプトを作成することで、1 エピソードあたり 20〜50 シーンの生成時間を数時間から 1 時間以内に短縮できます。

- 技術的制限の理解: 1 つの動画につき最大 2 キャラクターまで、実在しない人物オブジェクトのみ対応、API の利用可能性に制限があるといった制約は、クリエイティブな工夫や編集(ポストプロダクション)によって回避する必要があります。

- ワークフローの最適化: 脚本、キャラクターデザイン、一括生成から編集までの標準化されたプロセスにより、1 エピソードの制作期間を 5〜7 日から 6〜12 時間にまで短縮可能です。

AI マン劇は AI 動画生成技術の社会実装における重要な応用シーンであり、Sora 2 のキャラクター機能の成熟と API インターフェースの整備に伴い、この分野は爆発的な成長を遂げるでしょう。APIYI(apiyi.com)を通じて、あなたのマン劇のアイデアを素早く検証することをお勧めします。このプラットフォームは無料枠とマルチモデル統合インターフェースを提供しており、Sora 2、Kling、Runway などの主要な動画生成モデルをサポートしています。

📚 参考文献

⚠️ リンク形式の説明: すべての外部リンクは

資料名: domain.com形式を使用しています。コピーには便利ですが、SEO ウェイトの流出を避けるためクリックによる遷移はできません。

-

OpenAI Sora 公式ドキュメント: キャラクター機能使用ガイド

- リンク:

help.openai.com/en/articles/12435986-generating-content-with-characters - 説明: Character Cameo 機能の作成フロー、権限設定、使用制限に関する公式紹介

- リンク:

-

Sora リリースノート: 機能更新ログ

- リンク:

help.openai.com/en/articles/12593142-sora-release-notes - 説明: Sora 2 の機能アップデート(Character Cameo や Stitch 機能のリリース時期など)の記録

- リンク:

-

AI Manga Maker 業界レポート: AI はいかに漫画制作を革新するか

- リンク:

aimangamaker.com/blog/how-ai-revolutionizes-manga-manhwa-production-in-2025 - 説明: 漫画およびマン劇制作における AI ツールの活用について、効率向上やコスト削減のデータを含む深い分析

- リンク:

-

Tooning AI プラットフォーム: 漫画キャラクターの一貫性ソリューション

- リンク:

skywork.ai/skypage/en/Tooning-Your-AI-Co-Pilot-for-Creating-Webtoons-and-Comics - 説明: 3D モデリングによってキャラクターの一貫性を実現する代替案であり、比較学習に適しています。

- リンク:

著者: 技術チーム

技術交流: コメント欄での AI マン劇制作に関する経験談をお待ちしています。さらなる Sora 2 の技術資料については、APIYI(apiyi.com)技術コミュニティをご覧ください。