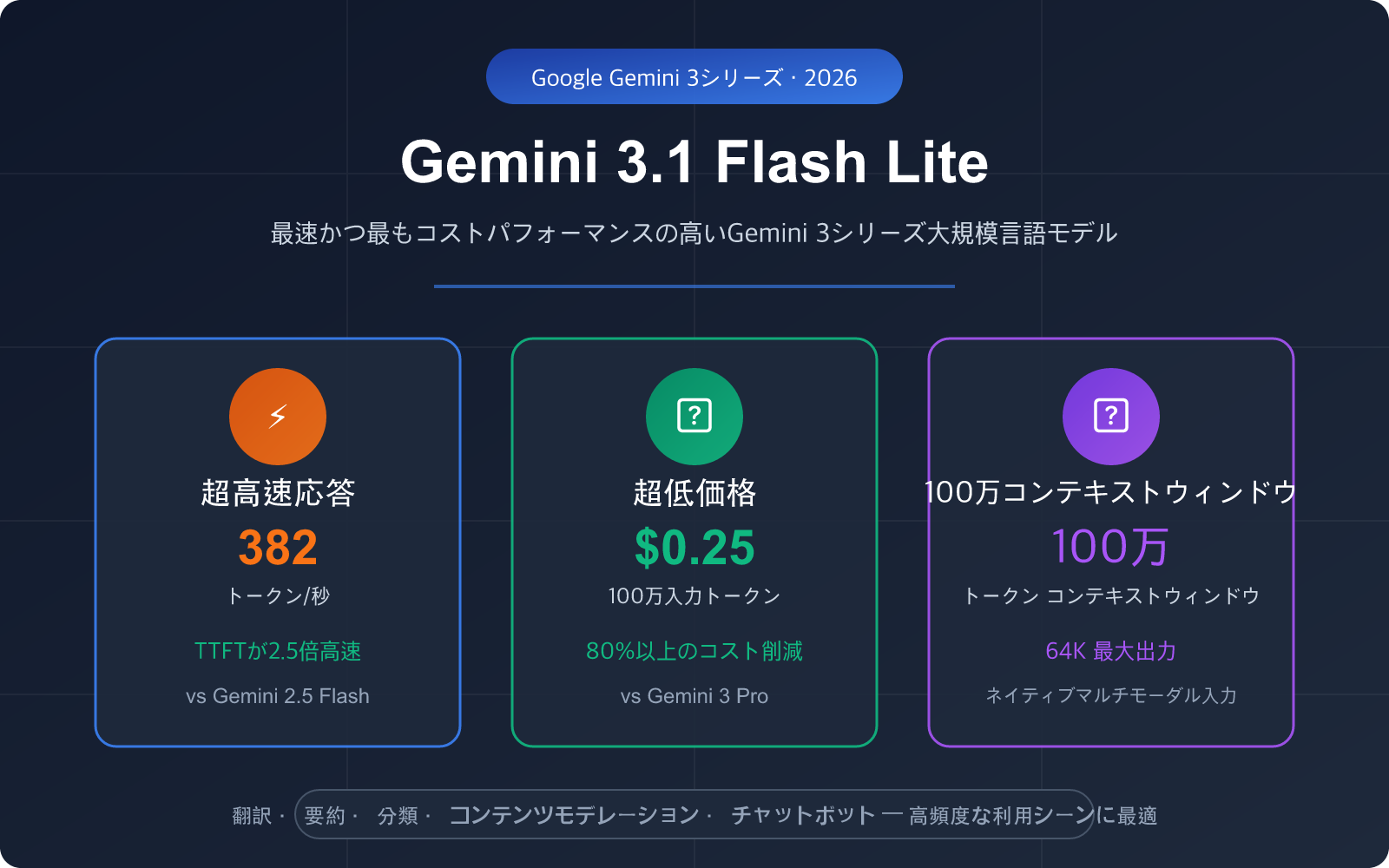

高速かつ低コストなAIモデルの選択は、高頻度でAPIを呼び出す開発者にとって避けては通れない重要な課題です。Googleは2026年3月3日、Gemini 3シリーズの中で最も高速かつ高いコストパフォーマンスを誇る Gemini 3.1 Flash Lite Preview を正式に発表しました。このモデルは、翻訳、要約、分類といった高スループットが求められるタスクに最適化されています。

核心的な価値: 本記事では、Gemini 3.1 Flash Liteの技術仕様、性能上のメリット、最適な活用シーンを網羅的に解説します。また、実際のコードを通じて迅速に実装する方法もご紹介します。

Gemini 3.1 Flash Lite 主要パラメータ概要

Gemini 3.1 Flash Liteの詳細に入る前に、このモデルの主要な技術仕様を確認しておきましょう。

| パラメータ | Gemini 3.1 Flash Lite 仕様 | 備考 |

|---|---|---|

| モデルID | gemini-3.1-flash-lite-preview |

現在はプレビュー版 |

| コンテキストウィンドウ | 1,000,000 トークン | 大規模なコンテキストに対応 |

| 最大出力 | 64,000 トークン | 長文生成をサポート |

| 入力価格 | 0.25ドル / 100万トークン | 非常に低コスト |

| 出力価格 | 1.50ドル / 100万トークン | 高いコストパフォーマンス |

| 出力速度 | 約382 トークン/秒 | 超高速レスポンス |

| 入力モダリティ | テキスト、画像、音声、動画 | ネイティブ・マルチモーダル |

| 出力モダリティ | テキスト | テキスト生成 |

| リリース日 | 2026年3月3日 | 最新リリース |

🚀 クイックスタート: Gemini 3.1 Flash Lite Previewは、APIYI (apiyi.com) プラットフォームですでに利用可能です。OpenAI互換インターフェースをサポートしているため、追加設定なしで素早く導入できます。

Gemini 3.1 Flash Lite の5つの核心的な強み

強み1:速度が2.5倍に向上

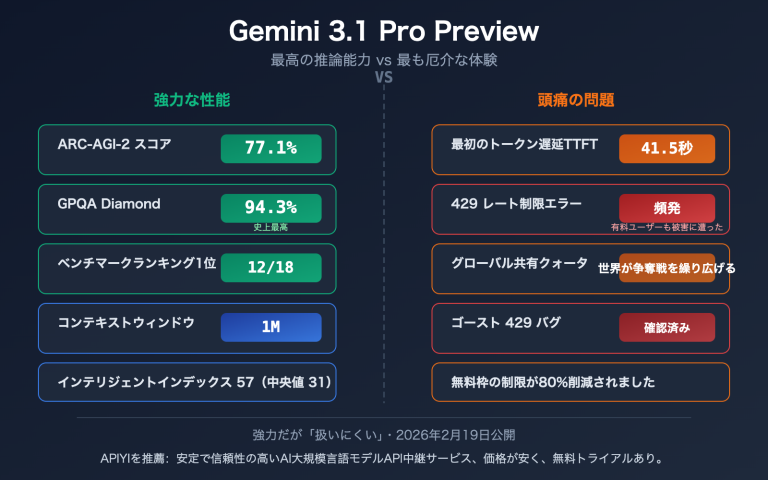

Gemini 3.1 Flash Lite は、速度面で飛躍的な進化を遂げました。Artificial Analysis のベンチマークデータによると、以下の通りです:

- 最初のトークンまでの時間 (TTFT): Gemini 2.5 Flash より 2.5倍 高速化

- 出力速度: 382 tokens/秒 に到達。Gemini 2.5 Flash の 232 tokens/秒から 64% 向上

- 全体的なスループット: 約 45% 向上

これにより、リアルタイム翻訳、チャットボット、コンテンツ要約など、遅延が重視されるシーンにおいて、ユーザーはほぼ瞬時のレスポンスを体験できます。

強み2:圧倒的なコストパフォーマンス

Gemini 3.1 Flash Lite の価格戦略は非常に競争力があります:

| 価格比較 | 入力価格 ($/1M tokens) | 出力価格 ($/1M tokens) | 総合コスト |

|---|---|---|---|

| Gemini 3.1 Flash Lite | $0.25 | $1.50 | ⭐ 最低 |

| Gemini 3 Flash | $1.00 | $4.00 | 中程度 |

| Gemini 3 Pro | $2.50 | $15.00 | 高め |

| Claude 4.5 Haiku | $0.80 | $4.00 | 中程度 |

| GPT-5 mini | $0.60 | $2.40 | 中程度 |

1日あたり100万トークンを処理する場合、Gemini 3.1 Flash Lite の月間コストは約 $52.50 となり、Gemini 3 Pro と比較して 80%以上 のコスト削減が可能です。

強み3:100万トークンのコンテキストウィンドウ

Gemini 3.1 Flash Lite は 1M tokens のコンテキストウィンドウをサポートしており、同価格帯のモデルとしては非常に稀です。これにより、以下のようなことが可能になります:

- 書籍一冊分の翻訳や要約を一括処理

- 数時間の会議録音の書き起こしテキストを分析

- 大規模なコードベースの理解とドキュメント生成

- 長文ドキュメントの多言語対照翻訳

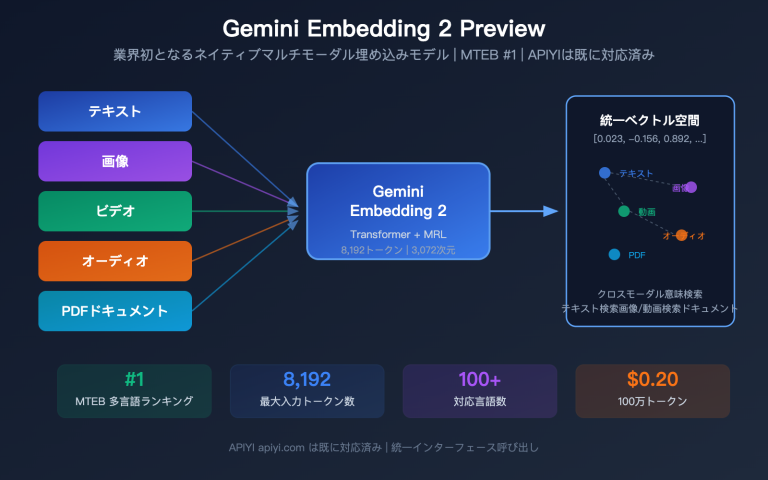

強み4:ネイティブなマルチモーダル対応

軽量モデルでありながら、Gemini 3.1 Flash Lite は完全なマルチモーダル入力能力を維持しています:

- テキスト: 標準的なテキスト理解と生成

- 画像: 画像認識と理解

- 音声: 音声コンテンツの処理

- 動画: 動画コンテンツの理解

これにより、純粋なテキストタスクだけでなく、画像とテキストを組み合わせた翻訳や、動画の字幕生成といったマルチモーダルなシーンにも適しています。

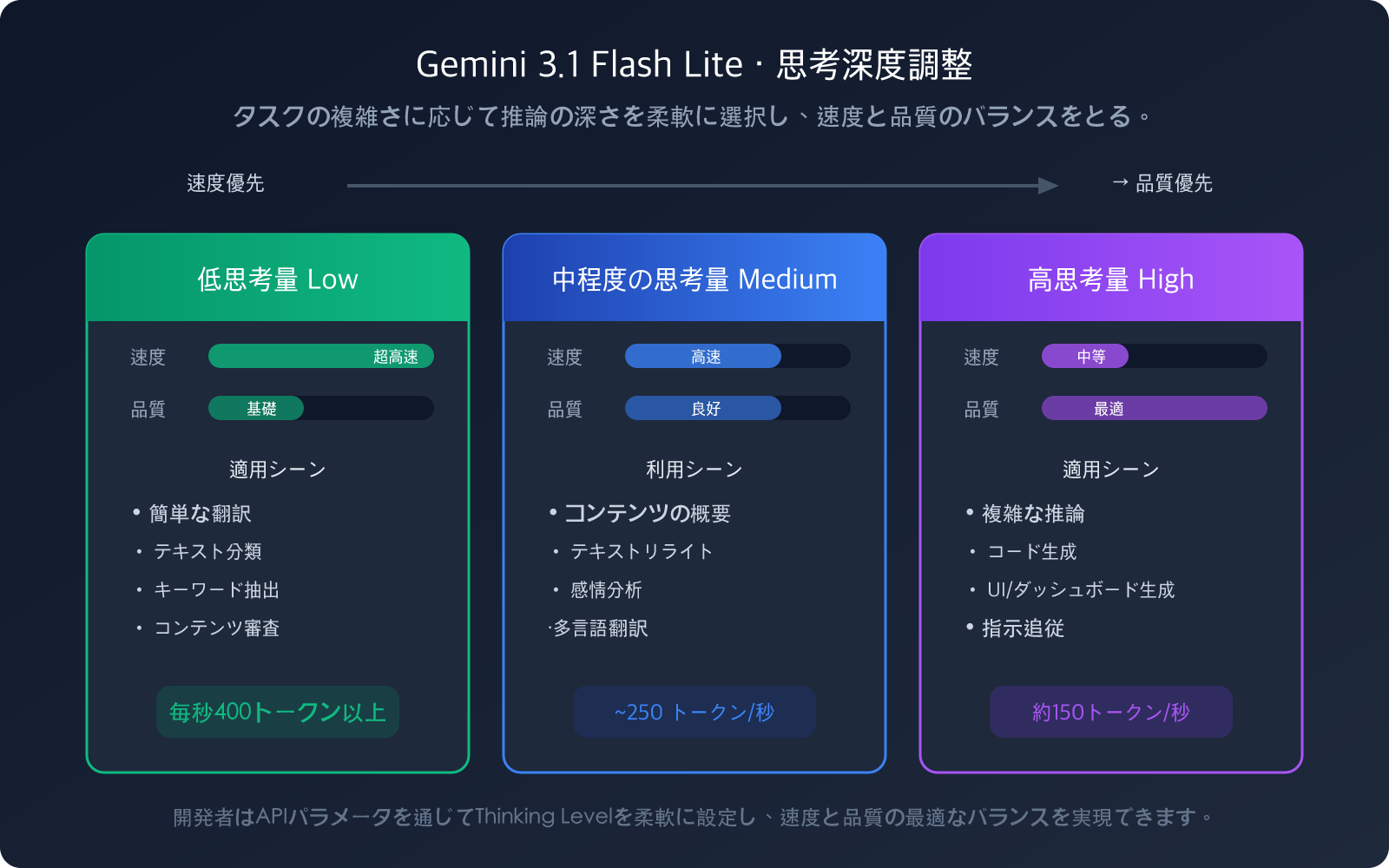

強み5:思考深度の調整機能

Gemini 3.1 Flash Lite は Thinking Levels 機能をサポートしており、開発者はタスクの複雑さに応じてモデルの推論深度を柔軟に調整できます:

- 低思考量: 単純な翻訳や分類タスク向け。究極の速度を追求

- 中思考量: 要約やコンテンツのリライトなど、一定の理解が必要なタスク向け

- 高思考量: 複雑な推論やコード生成など、深い思考が必要なタスク向け

Gemini 3.1 Flash Lite パフォーマンスベンチマーク

Gemini 3.1 Flash Lite は、Arena.ai のランキングで 1432点 という Elo レーティングを獲得し、同クラスのモデルの中でも際立ったパフォーマンスを見せています。

| ベンチマーク | Gemini 3.1 Flash Lite | 説明 |

|---|---|---|

| GPQA Diamond | 86.9% | 科学的知識の推論 |

| MMMU-Pro | 76.8% | マルチモーダル推論 |

| MMMLU | 88.9% | 多言語Q&A |

| LiveCodeBench | 72.0% | コード生成 |

| Video-MMMU | 84.8% | 動画理解 |

| SimpleQA | 43.3% | パラメータ化された知識 |

| MRCR v2 (128k) | 60.1% | 長文コンテキスト理解 |

注目すべきは、GPQA Diamond や MMMLU を含む6つのベンチマークにおいて、Gemini 3.1 Flash Lite が GPT-5 mini や Claude 4.5 Haiku を上回った ことです。これは、軽量モデルであっても最先端レベルの知能を備えられることを証明しています。

🎯 技術的なアドバイス: 上記のベンチマークデータが示す通り、Gemini 3.1 Flash Lite は多言語処理において非常に優れた性能(MMMLU 88.9%)を発揮するため、多言語翻訳のタスクに最適です。APIYI (apiyi.com) を通じて、このモデルを迅速に呼び出し、多言語タスクのテストを行うことができます。

Gemini 3.1 Flash Lite クイックスタート

シンプルなコード例

OpenAI 互換インターフェースを使用すれば、わずか数行のコードで Gemini 3.1 Flash Lite を呼び出せます。

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 統一インターフェース

)

# 翻訳タスクの例

response = client.chat.completions.create(

model="gemini-3.1-flash-lite-preview",

messages=[

{"role": "system", "content": "あなたはプロの翻訳家です。ユーザーが入力した中国語を英語に翻訳してください。元の意味とトーンを維持してください。"},

{"role": "user", "content": "人工智能正在深刻改变我们的工作方式和生活方式。"}

],

temperature=0.3

)

print(response.choices[0].message.content)

完全なコードを表示:一括翻訳 + 要約タスク

import openai

import time

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://api.apiyi.com/v1" # APIYI 統一インターフェース

)

MODEL = "gemini-3.1-flash-lite-preview"

def translate_text(text, target_lang="English"):

"""テキストをターゲット言語に翻訳する"""

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"Translate the following text to {target_lang}. Keep the original meaning and tone."},

{"role": "user", "content": text}

],

temperature=0.3

)

return response.choices[0].message.content

def summarize_text(text, max_words=100):

"""テキストの要約を生成する"""

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"以下の内容の核心的なポイントを{max_words}文字以内で要約してください。"},

{"role": "user", "content": text}

],

temperature=0.5

)

return response.choices[0].message.content

def classify_text(text, categories):

"""テキスト分類"""

cats = "、".join(categories)

response = client.chat.completions.create(

model=MODEL,

messages=[

{"role": "system", "content": f"以下のテキストを次のカテゴリのいずれかに分類してください: {cats}。カテゴリ名のみを返してください。"},

{"role": "user", "content": text}

],

temperature=0.1

)

return response.choices[0].message.content

# 使用例

texts = [

"量子計算将在未来十年彻底改变密码学领域",

"新款电动汽车续航里程突破1000公里",

"央行宣布下调基准利率25个基点"

]

categories = ["テクノロジー", "自動車", "金融", "スポーツ", "エンタメ"]

for text in texts:

# 翻訳

translated = translate_text(text)

# 分類

category = classify_text(text, categories)

# 要約

summary = summarize_text(text, max_words=30)

print(f"原文: {text}")

print(f"翻訳: {translated}")

print(f"分類: {category}")

print(f"要約: {summary}")

print("---")

💰 コスト最適化: 翻訳、要約、分類などの高頻度な呼び出しタスクにおいて、Gemini 3.1 Flash Lite の超低価格(入力単価はわずか $0.25/100万トークン)は、運用コストを大幅に削減します。APIYI (apiyi.com) プラットフォーム経由で利用すれば、さらなる価格的メリットや無料のテストクレジットも受け取れます。

Gemini 3.1 Flash Lite の最適な利用シーン

シーン1:高頻度な一括翻訳

Gemini 3.1 Flash Lite は、多言語QAベンチマーク「MMMLU」で88.9%という高スコアを記録しました。非常に低い呼び出しコストと高速なレスポンスを兼ね備えており、一括翻訳タスクに最適です。

- ECサイトの商品説明翻訳: 毎日数万件の商品情報を多言語へ翻訳

- ユーザーレビューの翻訳: 海外ユーザーからのフィードバックをリアルタイムで翻訳

- 技術ドキュメントの国際化: 大規模なドキュメントの多言語版生成

- 字幕翻訳: 動画字幕の迅速な多言語変換

シーン2:リアルタイムなコンテンツ要約

382トークン/秒という出力速度により、リアルタイムな要約シーンで真価を発揮します。

- ニュース要約の生成: 大量のニュースから自動的に要約を抽出

- 会議議事録: 長時間の会議録音を素早く要約

- 文献レビュー: 学術論文の一括要約生成

- メール要約: 企業メールの自動要約と分類

シーン3:大規模なコンテンツ審査と分類

低遅延かつ低コストという特性から、コンテンツ審査パイプラインの理想的な選択肢となります。

- ユーザー生成コンテンツ(UGC)の審査: ソーシャルプラットフォームでのコンテンツ安全フィルタリング

- チケットの自動分類: カスタマーサポートシステムのインテリジェントなルーティング

- 感情分析: ブランド評判のリアルタイム監視

- タグの自動生成: コンテンツ管理システムの自動タグ付け

シーン選択ガイド

| 利用シーン | 推奨理由 | 主なメリット | 月間コスト目安 |

|---|---|---|---|

| 一括翻訳 | MMMLU 88.9% の高い多言語能力 | 低価格 + 高品質 | ~$50 (100万トークン/日) |

| リアルタイム要約 | 382トークン/秒の超高速出力 | 低遅延 + 高速 | ~$30 (50万トークン/日) |

| コンテンツ審査 | 分類精度が高く、応答が速い | 低コスト + 一括処理 | ~$20 (30万トークン/日) |

| チャットボット | TTFT(最初のトークンまでの時間)が2.5倍速い | 即時応答 | ~$80 (200万トークン/日) |

| 長文処理 | 1Mトークンのコンテキストウィンドウ | 本1冊分を一度に処理 | 従量課金 |

💡 選択のアドバイス: 高頻度、大量、コスト重視のテキスト処理タスクであれば、Gemini 3.1 Flash Lite が現時点で最も費用対効果の高い選択肢です。APIYI (apiyi.com) プラットフォームを通じて実際のシナリオでテストすることをお勧めします。同プラットフォームでは、ワンクリックで他のモデルに切り替えて効果を比較することが可能です。

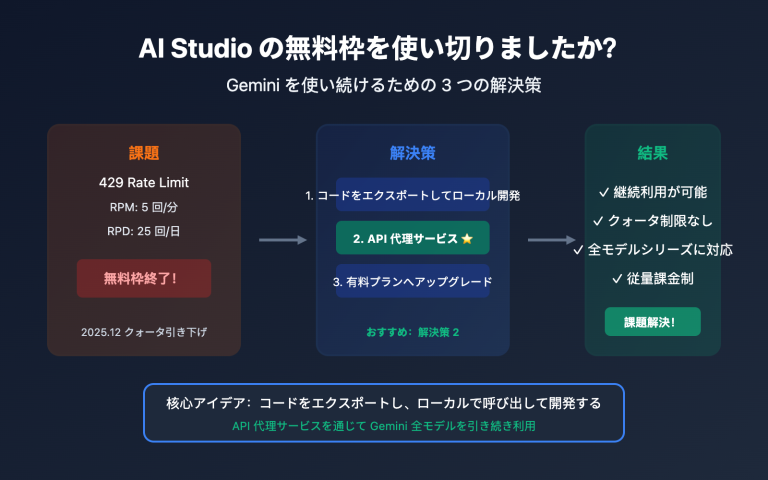

Gemini 3.1 Flash Lite 利用時の注意点

現在の制限事項

プレビュー版モデルであるため、以下の点にご注意ください。

- プレビュー段階: モデルは現在プレビュー状態であり、APIインターフェースや動作が変更される可能性があります。

- 出力制限: 最大出力は64Kトークンです。非常に長い生成タスクは分割処理が必要です。

- 超長文コンテキストの性能: 1Mトークンの極めて長いコンテキストシナリオ(MRCR v2 1Mテストでわずか12.3%)ではパフォーマンスが安定しないため、最適な結果を得るには128K以内での利用を推奨します。

- 安全性の境界: 画像からテキストへの安全性スコアは改善の余地があり、機密性の高いコンテンツを扱う場合は審査レイヤーを追加する必要があります。

利用のアドバイス

- 温度パラメータ(Temperature): 翻訳タスクには

temperature=0.3、要約タスクにはtemperature=0.5を推奨します。 - システムプロンプト: 明確な役割定義と出力形式の要件を提供することで、出力品質が大幅に向上します。

- 一括処理: 非同期呼び出しを活用してスループットを向上させ、モデルの速度性能を最大限に引き出してください。

- コンテキスト制御: 1Mトークンのコンテキストをサポートしていますが、最高の費用対効果を得るために、通常のタスクは128K以内に収めることを推奨します。

よくある質問

Q1: Gemini 3.1 Flash Lite と Gemini 3 Flash の違いは何ですか?

Gemini 3.1 Flash Lite は、Gemini 3 シリーズの中でも高頻度かつ低コストなユースケース向けに最適化された軽量モデルです。Gemini 3 Flash と比較すると、入力コストが75%削減($1.00 対 $0.25)され、出力速度は約64%向上していますが、複雑な推論タスクにおける能力はやや控えめです。簡単に言うと、極限のコストパフォーマンスを求めるなら Flash Lite を、より強力な推論能力が必要なら Flash を選ぶのがおすすめです。APIYI (apiyi.com) プラットフォームでは両方のモデルを同時にテストできるため、ご自身の用途に最適なモデルを素早く見つけることができます。

Q2: Gemini 3.1 Flash Lite は翻訳作業に適していますか?

非常に適しています。Gemini 3.1 Flash Lite は多言語ベンチマーク MMMLU で 88.9% という高スコアを記録しており、同クラスのモデルの中でもトップクラスの性能を誇ります。さらに、100万トークンあたり $0.25 という非常に安価な入力コストと、382トークン/秒という出力速度を兼ね備えており、現在、大量の翻訳タスクを行う上で最もコストパフォーマンスに優れたモデルの一つです。APIYI (apiyi.com) で無料のテスト枠を取得し、実際の翻訳品質を検証してみることをおすすめします。

Q3: OpenAI 互換インターフェース経由で Gemini 3.1 Flash Lite を呼び出すにはどうすればよいですか?

base_url を APIYI のインターフェースアドレスに設定し、model パラメータに gemini-3.1-flash-lite-preview を指定するだけです。既存の OpenAI SDK のコード構造を変更することなく、シームレスに切り替えが可能です。詳細は本記事の「クイックスタート」セクションにあるコード例をご覧ください。

Q4: Gemini 3.1 Flash Lite の 1M コンテキストウィンドウは実用的ですか?

128K トークンの範囲内では非常に優れたパフォーマンス(MRCR v2 128K スコア 60.1%)を発揮しますが、極端な 1M トークンのシナリオでは性能が著しく低下します(MRCR v2 1M スコア 12.3%)。日常的な使用では 128K 以内に収めることを推奨します。超長文のドキュメントを処理する必要がある場合は、分割して処理する戦略をとるのが良いでしょう。

まとめ

Gemini 3.1 Flash Lite Preview は、100万入力トークンあたり $0.25 という超低価格、382トークン/秒 の高速出力、1M トークン のコンテキストウィンドウに加え、多言語処理(MMMLU 88.9%)や科学的推論(GPQA Diamond 86.9%)といったベンチマークでの優れた性能により、2026年における翻訳、要約、分類などの高頻度タスクにおけるコストパフォーマンスの王者となりました。

毎日数百万トークンを処理する大量翻訳が必要な場合でも、低遅延のリアルタイム要約サービスを構築する場合でも、Gemini 3.1 Flash Lite は優先的に検討すべき選択肢です。

APIYI (apiyi.com) を通じて Gemini 3.1 Flash Lite Preview に素早く接続することをおすすめします。同プラットフォームは OpenAI 互換インターフェースを提供しており、主要なモデルをワンクリックで切り替えられるため、効果の検証やモデルの比較選定が容易に行えます。

参考資料

-

Google DeepMind – Gemini 3.1 Flash-Lite モデルカード: 公式モデルの技術仕様およびベンチマークデータ

- リンク:

deepmind.google/models/model-cards/gemini-3-1-flash-lite/

- リンク:

-

Google AI for Developers – Gemini 3.1 Flash-Lite プレビュー: 公式 API ドキュメントおよび開発ガイド

- リンク:

ai.google.dev/gemini-api/docs/models/gemini-3.1-flash-lite-preview

- リンク:

-

Artificial Analysis – パフォーマンス評価: 第三者機関による独立した速度およびパフォーマンスのベンチマーク

- リンク:

artificialanalysis.ai/models/gemini-3-1-flash-lite-preview

- リンク:

📝 著者: APIYI 技術チーム | AI モデルの利用ガイドや技術チュートリアルについては、APIYI ヘルプセンター(help.apiyi.com)をご覧ください。