Pengumuman resmi dari xAI baru saja dirilis, 8 model Grok versi lama akan resmi dipensiunkan pada 15 Mei 2026 pukul 12:00 PT. Permintaan akan secara otomatis dialihkan ke grok-4.3, namun penagihan akan mengikuti harga model baru. Artikel ini mengulas dampak nyata dari perubahan ini bagi pengembang AI dan pengguna korporat.

Nilai Utama: Pahami dalam 3 menit daftar model Grok yang dipensiunkan, aturan pengalihan, perubahan biaya, serta cara mengubah kode pemanggilan di bawah strategi sinkronisasi APIYI.

Sekilas Informasi Utama Pensiunnya Model Grok

xAI telah memberikan garis waktu dan cakupan dampak yang jelas dalam dokumentasi migrasi mereka. Pemensiunan ini bukan sekadar pembersihan model yang jarang digunakan, melainkan mencakup model reasoning, non-reasoning, kode, dan pembuatan gambar yang menjadi andalan selama enam bulan terakhir. Bagi tim yang sangat bergantung pada slug ini dalam lingkungan produksi, 15 Mei adalah tenggat waktu mutlak untuk menyelesaikan peralihan kode.

| Informasi | Detail |

|---|---|

| Tanggal Rilis | 15-05-2026 12:00 PT |

| Penerbit | xAI Resmi (docs.x.ai) |

| Jumlah Model Pensiun | 8 Model |

| Target Pengalihan | grok-4.3 / grok-imagine-image-quality |

| Harga Model Baru | $1,25 / 1M input, $2,50 / 1M output |

| Jendela Konteks | 1.000.000 token |

| Sumber Data | docs.x.ai/developers/migration/may-15-retirement |

Penjelasan Daftar Pensiun Model Grok

8 model yang akan dihentikan mencakup 4 kategori beban kerja utama: seri fast-reasoning (termasuk grok-4-1-fast-reasoning, grok-4-fast-reasoning) untuk inferensi throughput tinggi; seri fast-non-reasoning (termasuk grok-4-1-fast-non-reasoning, grok-4-fast-non-reasoning) untuk percakapan latensi rendah; grok-4-0709 dan grok-3 sebagai model umum unggulan awal; serta grok-code-fast-1 dan grok-imagine-image-pro yang masing-masing mencakup pembuatan kode dan pembuatan gambar.

| Slug Model | Kategori | Penggunaan Umum | Target Pengalihan |

|---|---|---|---|

| grok-4-1-fast-reasoning | reasoning | Inferensi throughput tinggi | grok-4.3 (low effort) |

| grok-4-1-fast-non-reasoning | non-reasoning | Percakapan latensi rendah | grok-4.3 (none effort) |

| grok-4-fast-reasoning | reasoning | Inferensi cepat | grok-4.3 (low effort) |

| grok-4-fast-non-reasoning | non-reasoning | Tanya jawab real-time | grok-4.3 (none effort) |

| grok-4-0709 | reasoning | Unggulan umum | grok-4.3 (low effort) |

| grok-code-fast-1 | coding | Pengodean cerdas | grok-4.3 (low effort) |

| grok-3 | non-reasoning | Lingkungan produksi jangka panjang | grok-4.3 (none effort) |

| grok-imagine-image-pro | image | Gambar berkualitas tinggi | grok-imagine-image-quality |

Menurut dokumentasi resmi, semua model kategori reasoning akan dilayani oleh grok-4.3 dengan low reasoning effort, sementara semua model non-reasoning akan diubah menjadi none effort untuk memastikan latensi tetap sedekat mungkin dengan model aslinya. Permintaan pembuatan gambar akan dialihkan sepenuhnya ke grok-imagine-image-quality.

Analisis Aturan Pengalihan (Redirect) Pensiunnya Model Grok

Setelah pukul 12:00 PT tanggal 15 Mei, slug lama tidak akan langsung mengembalikan status 404, melainkan akan dialihkan secara otomatis oleh gateway ke grok-4.3. "Transisi mulus" ini sangat ramah terhadap kompatibilitas, namun juga menjadi jebakan biaya yang tersembunyi—banyak tim mengira "permintaan berhasil berarti aman", padahal mereka baru menyadari di tagihan akhir bulan bahwa harga satuan telah naik secara diam-diam.

Perubahan Perilaku Reasoning pada Pensiunnya Model Grok

Perbedaan terbesar antara grok-4.3 dan seri fast-reasoning lama terletak pada desain "always-on reasoning". Grok-4.3 mengubah penalaran (chain-of-thought) dari sakelar opsional menjadi perilaku standar model. Pengembang dapat memilih tingkat intensitas penalaran low, medium, atau high, tanpa opsi untuk mematikan penalaran sepenuhnya. Model fast-non-reasoning lama langsung melewati proses penalaran, sedangkan none effort setelah pengalihan akan membuat grok-4.3 mensimulasikan pengalaman "jawaban langsung" yang lama, namun dalam alur kerja sebenarnya, model ini tetap akan mengonsumsi sejumlah kecil token penalaran internal.

Perlu dicatat bahwa xAI kali ini tidak menyediakan "parameter mode kompatibilitas" di tingkat SDK. Artinya, kode yang secara kaku menulis model="grok-4-fast-reasoning" mungkin tetap berfungsi, tetapi tidak dapat mengontrol intensitas penalaran secara presisi. Jika bisnis Anda sensitif terhadap latensi dan konsistensi, Anda wajib menyertakan kolom reasoning_effort secara eksplisit. Jika tidak, Anda hanya akan mendapatkan tingkat default dan tidak dapat mereplikasi kurva perilaku model lama.

Untuk aplikasi real-time yang mengejar kecepatan respons ekstrem, kami menyarankan untuk menguji perbedaan latensi dari kedua effort tersebut menggunakan APIYI (apiyi.com) sebelum memutuskan apakah akan menyesuaikan desain petunjuk di sisi bisnis. Setelah beralih ke antarmuka terpadu, kode yang sama dapat digunakan untuk membandingkan throughput dan latensi time-to-first-token dari berbagai reasoning effort dengan cepat tanpa perlu mengubah parameter tambahan.

Perubahan Model Gambar pada Pensiunnya Model Grok

grok-imagine-image-pro adalah model pembuatan gambar yang diunggulkan oleh xAI selama setengah tahun terakhir, dengan fokus pada hasil gambar beresolusi tinggi. Dengan beralih ke grok-imagine-image-quality, model baru ini memiliki optimasi lebih lanjut pada detail gambar dan kepatuhan terhadap petunjuk, namun karakteristik biaya per gambar dan latensi juga mengalami perubahan.

🎯 Saran Migrasi: Kami menyarankan proyek yang saat ini menggunakan grok-imagine-image-pro untuk segera melakukan pengujian regresi pada petunjuk yang sering digunakan di lingkungan sandbox. Bandingkan perbedaan visual, kecepatan pembuatan, dan perubahan biaya per gambar antara model baru dan lama untuk menghindari peralihan paksa di sisi bisnis.

Analisis Dampak Biaya Pensiunnya Model Grok

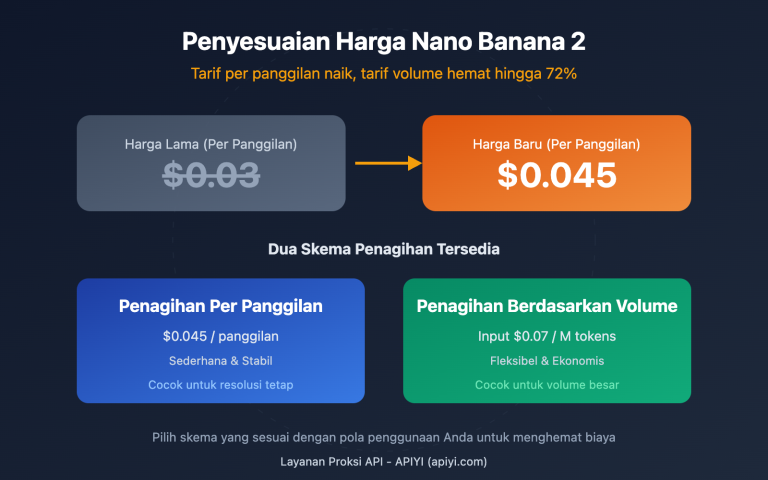

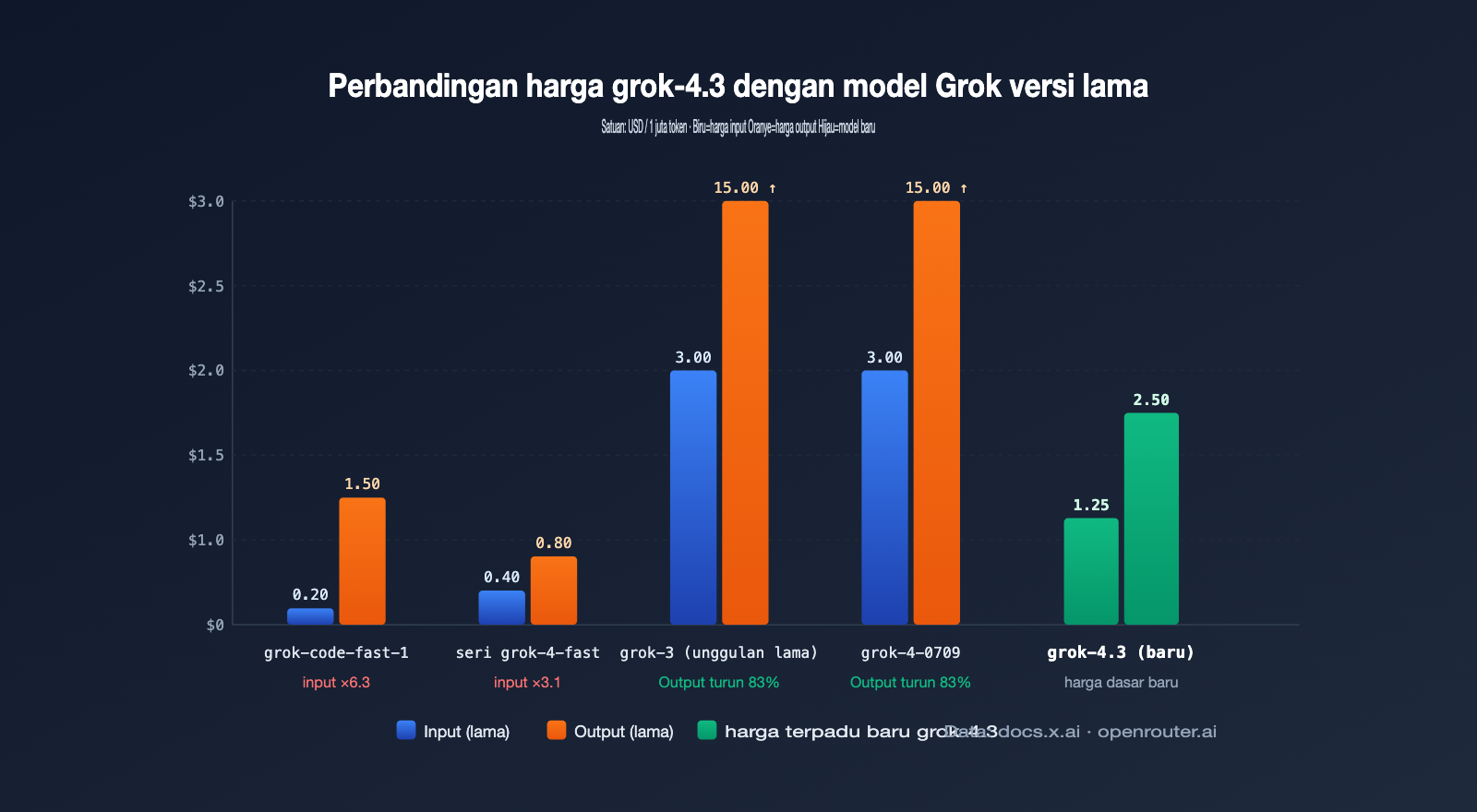

Perubahan biaya adalah poin krusial yang sering diremehkan dalam pengumuman pensiun model ini. Harga seragam untuk grok-4.3 adalah $1,25/1 juta token input dan $2,50/1 juta token output. Bagi tim yang sudah menggunakan grok-4-0709 atau grok-3, perubahan ini mungkin tidak terlalu terasa. Namun, bagi proyek yang mengandalkan slug berbiaya rendah seperti fast-reasoning, fast-non-reasoning, dan grok-code-fast-1, harga per unit akan mengalami kenaikan yang signifikan.

5 Perubahan Biaya Utama Akibat Pensiunnya Model Grok

Tabel di bawah ini merangkum 5 poin perubahan biaya yang paling mungkin berdampak setelah 15 Mei. Kami sarankan untuk melakukan pengecekan mandiri sebelum melakukan migrasi.

| Poin Perubahan Biaya | Performa Model Lama | Performa grok-4.3 | Tingkat Risiko |

|---|---|---|---|

| Harga Unit Input | Seri fast umumnya < $0,5/1M | Seragam $1,25/1M | Tinggi |

| Harga Unit Output | grok-code-fast-1 hanya $1,50/1M | Seragam $2,50/1M | Tinggi |

| Penagihan token penalaran | Beberapa model tidak dihitung | Token penalaran dihitung seharga output | Sedang |

| Jendela konteks | 256K~512K | 1M dihitung penuh | Sedang |

| Cache & pemanggilan alat | Strategi harga tersebar | 0,20/1M prompt cache + biaya per pemanggilan | Rendah |

Perlu diingat bahwa grok-4.3 secara default mengaktifkan penalaran (always-on reasoning). Bahkan jika Anda memilih low effort, setiap permintaan akan mengonsumsi token penalaran lebih banyak dibandingkan model fast-non-reasoning lama. Bagian ini akan ditagih sesuai harga output, yang merupakan "kenaikan tersembunyi" yang paling mudah terlewatkan dalam tagihan bulanan. Dalam pengujian internal, kami mengamati bahwa untuk kelompok prompt tanya jawab singkat yang sama, setelah beralih ke grok-4.3 (low effort), jumlah token output rata-rata meningkat 20%~35%. Ini berarti meskipun harga per unit terlihat sama, tagihan bulanan akan tetap membengkak secara alami.

Sebagai contoh, pada skenario Agent layanan pelanggan dengan 1 juta panggilan per hari, masing-masing 800 input + 400 output token, biaya bulanan menggunakan grok-4-fast-non-reasoning adalah sekitar $4.000. Jika beban yang sama dialihkan ke grok-4.3, biaya bulanan berdasarkan harga resmi akan naik menjadi sekitar $13.500. Ditambah dengan peningkatan token penalaran, tagihan aktual bisa mendekati $17.000. Perbedaan skala ini cukup besar bagi tim operasional dan keuangan untuk melakukan peninjauan anggaran secara formal di bulan Mei.

Biaya lain yang sering diremehkan adalah beban kerja modifikasi prompt. Perilaku penalaran grok-4.3 cenderung "memberikan jawaban setelah melakukan langkah-langkah deduksi". Template prompt yang dioptimalkan untuk grok-3 di masa lalu mungkin akan menghasilkan "output yang bertele-tele dan tidak ada kesimpulan di paragraf pertama". Untuk mengembalikan gaya respons "jawaban langsung + kesimpulan singkat" seperti model lama, Anda harus menggunakan system prompt untuk membatasi struktur output secara eksplisit atau mengatur reasoning effort ke none. Keduanya akan memerlukan jam kerja tambahan untuk pengujian regresi dan iterasi pustaka prompt.

💰 Kontrol Biaya: Kami menyarankan selama tahap migrasi, gunakan panel log permintaan APIYI (apiyi.com) untuk memantau penggunaan token berdasarkan slug model. Gabungkan dengan analisis skenario aktual untuk menentukan apakah perlu beralih ke medium effort untuk meningkatkan kualitas, atau mengunci ke none effort untuk mengendalikan biaya.

Analisis Dampak Pensiunnya Model Grok

Dampak bagi Pengembang

Dampak paling langsung dari pensiunnya model-model ini bagi pengembang di lapisan aplikasi adalah bagi pengguna grok-code-fast-1. Sebelumnya, model ini menawarkan rasio harga-performa yang luar biasa dengan skor 80,0% di LiveCodeBench pada harga $0,20/$1,50. Setelah migrasi ke grok-4.3, harga per unit naik dua kali lipat. Tim perlu mengevaluasi kembali anggaran biaya untuk tugas-tugas intensif seperti pelengkapan kode, peninjauan PR, dan orkestrasi agen. Kombinasi "pelengkapan dalam baris + pengambilan konteks panjang" yang sebelumnya berjalan lancar mungkin perlu dipecah menjadi beberapa langkah untuk mengontrol konsumsi token.

Bagi pengguna kerangka kerja Agen, alur yang sebelumnya mengandalkan seri fast untuk pengambilan keputusan pemanggilan alat juga akan terpengaruh. Kemampuan pemanggilan alat grok-4.3 memang lebih kuat, namun latensi karakter pertama sedikit lebih tinggi. Insinyur perlu melakukan penyesuaian ulang pada parameter timeout, retry, dan konkurensi. Kami menyarankan untuk melakukan pengujian regresi terlebih dahulu di lingkungan staging APIYI (apiyi.com) guna memastikan tingkat keberhasilan, distribusi latensi, dan perbedaan alur daring yang ada masih dalam batas yang dapat diterima sebelum melakukan peralihan penuh.

Dampak bagi Pengguna Perusahaan

Fokus utama pengguna perusahaan adalah SLA dan kepatuhan. Peningkatan ke grok-4.3 mencakup semua skenario dari 8 model sebelumnya, yang justru menyederhanakan matriks pemilihan model dan berdampak positif bagi tata kelola perusahaan (registri model, audit, dan kepatuhan keamanan). Namun, dari sisi keuangan, perlu dilakukan peninjauan kembali terhadap anggaran dan aturan potongan harga yang ada, terutama paket token bulanan dan ketentuan diskon komitmen, apakah akan tetap berlaku dengan adanya unifikasi harga. Dari sisi operasional, ambang batas peringatan harus diperbarui untuk menghindari lonjakan tagihan bulan Mei yang tidak terduga tanpa adanya notifikasi.

Untuk skenario pemanggilan lintas model, disarankan untuk mengagregasi model seperti Grok, Claude, dan GPT ke dalam tampilan penagihan terpadu, serta melakukan atribusi biaya berdasarkan departemen atau lini bisnis untuk mengurangi dampak perubahan model yang sering terjadi terhadap kontrol anggaran. Pensiun massal ini juga menjadi pengingat bagi perusahaan bahwa risiko ketergantungan pada satu pemasok tidak hanya soal penghentian layanan, tetapi juga biaya tersembunyi yang muncul akibat "perubahan inti di balik slug yang sama".

Dampak bagi Industri

Keputusan xAI untuk mempensiunkan 8 model sekaligus memberi sinyal bahwa kombinasi "always-on reasoning + 1M context" pada grok-4.3 sudah cukup universal untuk menangani beban kerja penalaran, percakapan, kode, dan pemanggilan alat secara bersamaan. Hal ini sejalan dengan arah Claude dan OpenAI dalam beberapa tahun terakhir yang secara bertahap menyatukan "model penalaran" dan "model instruksi". Ini menunjukkan bahwa komersialisasi Model Bahasa Besar sedang memasuki tahap "satu model unggulan untuk semua", di mana matriks model yang dihadapi pengembang akan lebih ramping, namun batas kemampuan dan elastisitas harga dari setiap model akan diperluas.

Tren lain yang perlu diperhatikan adalah "penalaran aktif secara default + tingkatan effort" yang menjadi standar industri baru. Desain ini mengembalikan pilihan antara latensi dan biaya kepada pengembang, dengan syarat SDK dan platform pemantauan harus mendukung bidang effort secara bawaan. Bagi layanan proksi API dan platform agregasi, manajemen siklus hidup model akan menjadi kemampuan inti yang baru. APIYI (apiyi.com) telah menyinkronkan dokumentasi migrasi model Grok ke konsol produk dan mengirimkan pemberitahuan penghentian untuk slug yang terdampak guna membantu pengembang agar tidak terlewat.

Penjelasan Penghentian Layanan APIYI

Untuk menjaga konsistensi dengan kebijakan resmi xAI dan menghindari kebingungan dalam penagihan, APIYI (apiyi.com) telah menyusun rencana penghentian layanan dan menyediakan jalur transisi yang mulus bagi pengguna yang masih memanggil slug lama. Konsol akan menghitung jumlah panggilan dan persentase biaya untuk setiap slug yang dipensiunkan selama 30 hari terakhir berdasarkan akun, sehingga pimpinan tim memiliki gambaran global yang jelas tentang modul bisnis yang terdampak sebelum melakukan migrasi.

| Tahap | Waktu | Tindakan APIYI |

|---|---|---|

| Periode Peringatan | Sebelum 15-05-2026 | Spanduk peringatan di konsol, notifikasi email ke akun terdampak |

| Periode Pengalihan | Mulai 15-05-2026 12:00 PT | Slug lama otomatis diteruskan ke grok-4.3, dan ditandai deprecated di header respons |

| Penghentian Total | Sesuai jadwal xAI | Opsi slug lama dihapus dari konsol |

Pengembang tidak perlu mengubah base_url, cukup ganti bidang model dalam parameter permintaan menjadi grok-4.3. Jika bisnis Anda memiliki panggilan tipe reasoning dan non-reasoning secara bersamaan, disarankan untuk menambahkan konfigurasi effort pada lapisan enkapsulasi SDK agar lebih mudah dikelola saat pengujian beban dan eksperimen A/B. Contoh panggilan lengkap di bawah ini dapat langsung disalin ke proyek Anda untuk verifikasi.

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "user", "content": "Jelaskan always-on reasoning dalam 200 kata"}

],

extra_body={"reasoning_effort": "low"}

)

print(response.choices[0].message.content)

Lihat versi Node.js / TypeScript

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const completion = await client.chat.completions.create({

model: "grok-4.3",

messages: [{ role: "user", content: "Ringkas poin penting migrasi grok-4.3" }],

// @ts-expect-error xAI extra field

reasoning_effort: "low",

});

console.log(completion.choices[0].message.content);

🚀 Saran Migrasi: Sebelum migrasi, kami menyarankan Anda menggunakan panel "Perbandingan Model" di APIYI (apiyi.com) untuk mengirimkan prompt yang sama ke

grok-4.3dan model lama. Bandingkan kualitas respons dan latensi karakter pertama sebelum menentukan tingkat reasoning effort yang akan digunakan.

Pertanyaan Umum

Q1: Apakah slug lama masih bisa digunakan setelah 15 Mei?

Bisa, namun model yang dijalankan secara aktual adalah grok-4.3, dan penagihan akan mengikuti harga baru grok-4.3 sebesar $1.25/$2.50. Kami menyarankan untuk segera memperbarui kolom model di kode Anda menjadi grok-4.3 agar tagihan bulanan Anda tidak mengalami kenaikan yang tidak terduga.

Q2: Apakah grok-code-fast-1 masih cocok untuk pelengkapan kode setelah migrasi?

grok-4.3 memiliki performa yang lebih baik daripada grok-code-fast-1 pada LiveCodeBench dan SWE-bench, dengan kemampuan pengkodean yang lebih kuat secara keseluruhan, namun latensi dan harga per unitnya lebih tinggi. Kami menyarankan untuk melakukan pengujian latensi P95 dan konsumsi token rata-rata per PR menggunakan sampel bisnis nyata sebelum memutuskan apakah model ini masih cocok untuk pelengkapan kode baris demi baris.

Q3: Apakah saya perlu mengajukan kunci API baru di platform APIYI?

Tidak perlu. Kunci APIYI yang lama sudah kompatibel dengan model baru seperti grok-4.3, dan base_url tetap sama. Anda hanya perlu menyesuaikan nama model dalam body permintaan. Daftar lengkap model dan statusnya dapat dilihat di konsol APIYI apiyi.com.

Q4: Apa saja yang perlu diperhatikan saat migrasi model pembuatan gambar grok-imagine-image-pro?

Permintaan akan dialihkan ke grok-imagine-image-quality. Terdapat perbedaan pada gaya gambar, seed sampling, dan parameter default. Kami menyarankan Anda untuk menjalankan petunjuk lama di lingkungan sandbox terlebih dahulu guna memastikan hasilnya stabil sebelum diterapkan ke produksi, agar tidak terjadi perubahan gambar yang mendadak pada sisi bisnis Anda.

Kesimpulan

xAI telah mempensiunkan 8 model utama termasuk fast-reasoning, fast-non-reasoning, grok-code-fast-1, grok-3, dan grok-imagine-image-pro. Mulai 15 Mei pukul 12:00 PT, semua akan dialihkan ke grok-4.3 dan grok-imagine-image-quality. Migrasi ini sendiri tidak memerlukan upaya teknis yang besar, namun perubahan harga satuan dan penagihan token reasoning berdampak signifikan pada bisnis yang sensitif terhadap biaya. Kami menyarankan untuk memprioritaskan tiga hal: memperbarui kolom model di kode produksi menjadi grok-4.3, menyertakan reasoning_effort secara eksplisit untuk mengontrol latensi dan biaya, serta melakukan perhitungan biaya end-to-end dengan sampel bisnis nyata.

Saran kami adalah menjadikan peningkatan model ini sebagai kesempatan untuk melakukan tata kelola: jalankan perbandingan latensi dan biaya antara berbagai model seperti grok-4.3, Claude, dan GPT di APIYI apiyi.com. Ubahlah strategi pemilihan model dari "mengikuti ritme penyedia" menjadi "memilih berdasarkan metrik bisnis". Dalam jangka panjang, cara ini akan lebih stabil dan memungkinkan Anda menekan biaya peralihan hingga hitungan jam saja saat pengumuman pensiun model serupa muncul di masa depan.

Penulis: Tim APIYI — APIYI apiyi.com, layanan proksi API Model Bahasa Besar tingkat perusahaan, mendukung integrasi terpadu untuk model utama seperti Grok, Claude, GPT, dan Gemini.