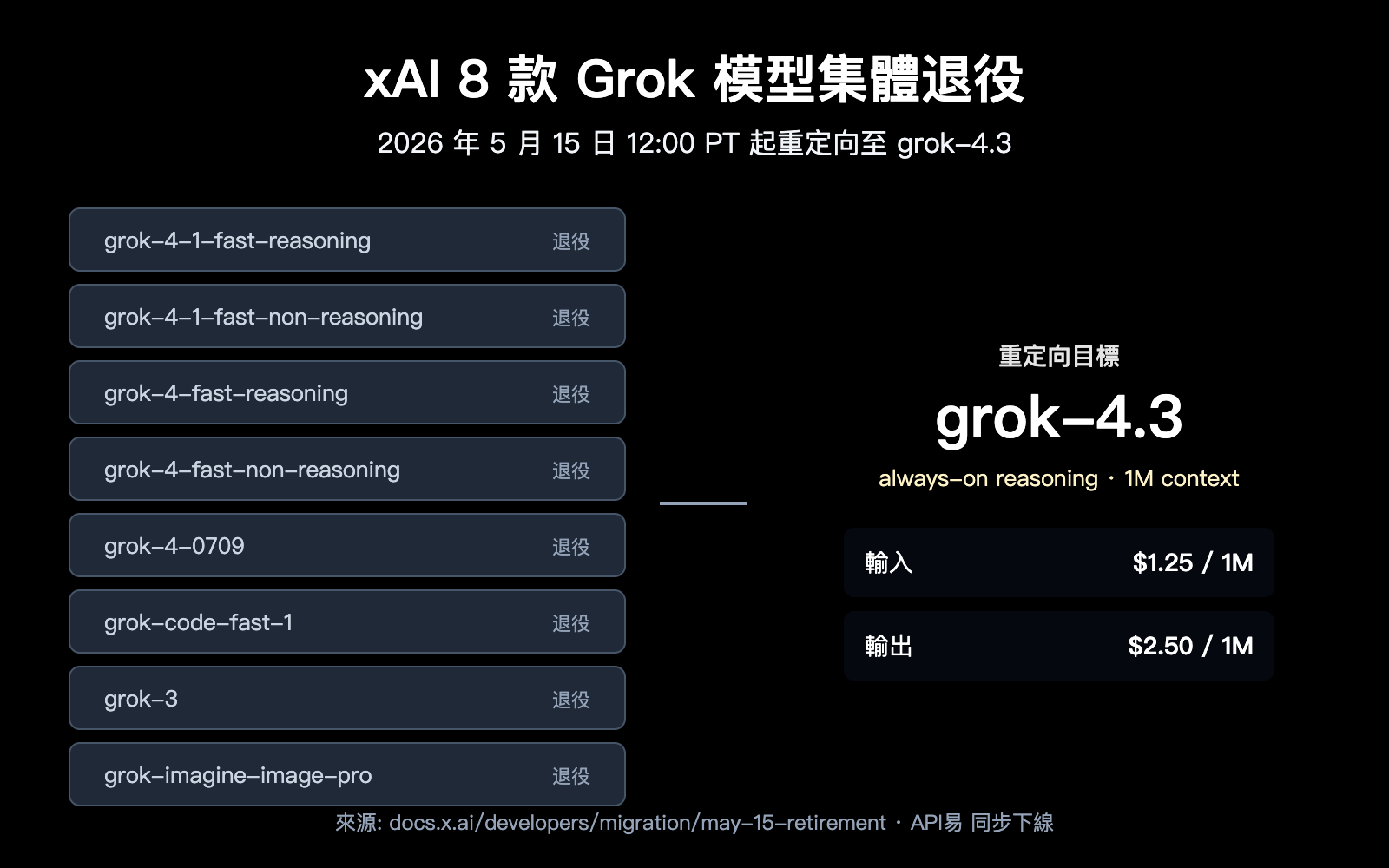

xAI 官方公告剛剛發佈,8 款舊版 Grok 模型將於 2026 年 5 月 15 日 12:00 PT 集體退役,請求會自動重定向至 grok-4.3,但計費將按新模型價格執行。本文快速解讀這一動態對 AI 開發者與企業用戶的真實影響。

核心價值: 3 分鐘搞懂 Grok 模型退役名單、重定向規則、成本變化,以及 API易同步下線策略下應該如何切換調用代碼。

Grok 模型退役 核心信息速覽

xAI 在遷移文檔中明確給出了完整時間線和影響範圍,本次退役不是某一兩款冷門模型的清理,而是覆蓋了過去半年內主力的 reasoning、非 reasoning、代碼與圖像生成模型。對於在生產環境長期依賴這些 slug 的團隊,5 月 15 日就是必須完成代碼切換的硬截止日期。

| 信息項 | 詳情 |

|---|---|

| 發佈時間 | 2026-05-15 12:00 PT |

| 發佈方 | xAI 官方(docs.x.ai) |

| 退役模型數量 | 8 款 |

| 重定向目標 | grok-4.3 / grok-imagine-image-quality |

| 新模型價格 | $1.25 / 1M 輸入,$2.50 / 1M 輸出 |

| 上下文窗口 | 1,000,000 tokens |

| 資料來源 | docs.x.ai/developers/migration/may-15-retirement |

Grok 模型退役名單詳解

本次集體下線的 8 款模型涵蓋了 4 類典型工作負載:fast-reasoning 系列(含 grok-4-1-fast-reasoning、grok-4-fast-reasoning)面向高吞吐推理;fast-non-reasoning 系列(含 grok-4-1-fast-non-reasoning、grok-4-fast-non-reasoning)面向低延遲對話;grok-4-0709 與 grok-3 是早期的旗艦通用模型;grok-code-fast-1 與 grok-imagine-image-pro 則分別覆蓋代碼生成與圖像生成。

| 模型 slug | 類別 | 典型用途 | 重定向目標 |

|---|---|---|---|

| grok-4-1-fast-reasoning | reasoning | 高吞吐推理 | grok-4.3(low effort) |

| grok-4-1-fast-non-reasoning | non-reasoning | 低延遲對話 | grok-4.3(none effort) |

| grok-4-fast-reasoning | reasoning | 快速推理 | grok-4.3(low effort) |

| grok-4-fast-non-reasoning | non-reasoning | 實時問答 | grok-4.3(none effort) |

| grok-4-0709 | reasoning | 通用旗艦 | grok-4.3(low effort) |

| grok-code-fast-1 | coding | 智能編碼 | grok-4.3(low effort) |

| grok-3 | non-reasoning | 長期生產環境 | grok-4.3(none effort) |

| grok-imagine-image-pro | image | 高質量圖像 | grok-imagine-image-quality |

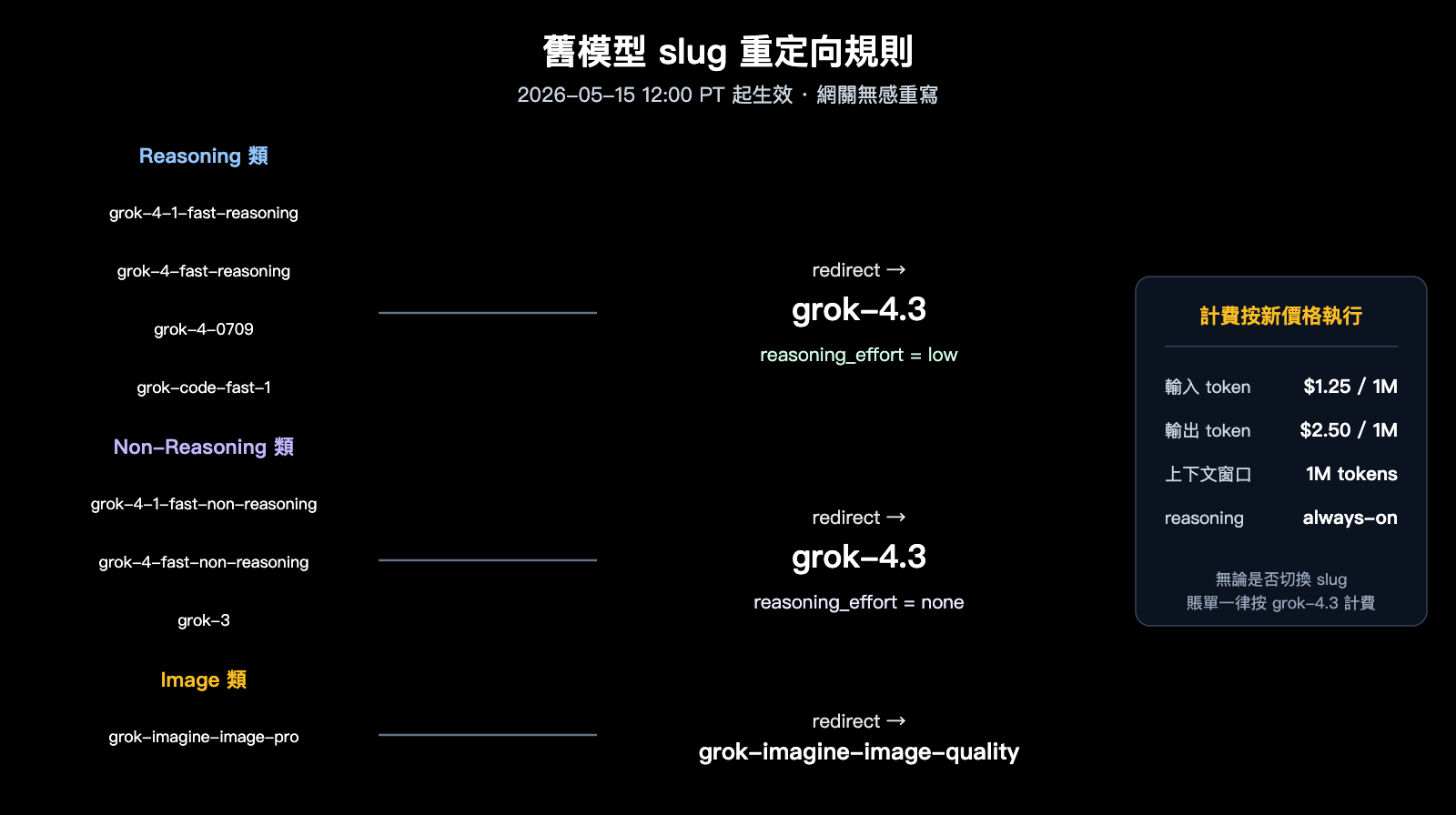

按官方文檔說明,所有 reasoning 類模型會以 grok-4.3 配合 low reasoning effort 提供服務,所有 non-reasoning 類模型則改爲 none effort,確保延遲與原模型儘量接近;圖像生成請求統一切換至 grok-imagine-image-quality 處理。

Grok 模型退役 重定向規則解析

5 月 15 日 12:00 PT 之後,舊 slug 不會立刻返回 404,而是會被網關無感重寫到 grok-4.3。這種「平滑過渡」對兼容性非常友好,但同時也是潛在的成本陷阱——很多團隊會以爲「請求成功就是沒事」,結果在月末賬單裏才發現單價已經悄悄上漲。

Grok 模型退役 reasoning 行爲變化

grok-4.3 與舊版 fast-reasoning 系列最大的差別在於「always-on reasoning」設計。grok-4.3 把推理(chain-of-thought)從可選開關變成了模型的常態行爲,開發者可以選擇 low、medium、high 三檔推理強度,沒有完全關閉推理的選項;舊版 fast-non-reasoning 模型則是直接跳過推理過程,重定向後的 none effort 會讓 grok-4.3 模擬原有的「直答」體驗,但實際鏈路中仍然會消耗少量內部推理 token。

值得注意的是,xAI 這次沒有在 SDK 層提供「兼容模式參數」,也就是說原本寫死 model="grok-4-fast-reasoning" 的代碼即便能夠繼續工作,也無法精確控制推理強度。如果業務對延遲與一致性敏感,必須顯式傳入 reasoning_effort 字段,否則只能拿到默認檔位,無法復現舊模型的行爲曲線。

對於追求極致響應速度的實時應用,我們建議結合 API易 apiyi.com 實測兩種 effort 的延遲差異,再決定是否調整業務側的 prompt 設計。同一份代碼切換到統一接口後,可以快速對比不同 reasoning effort 的吞吐與首字延遲,無需修改額外參數。

Grok 模型退役 image 模型變化

grok-imagine-image-pro 是過去半年裏 xAI 主推的圖像生成模型,主打高分辨率出圖。本次將其切換到 grok-imagine-image-quality 後,新模型在畫面細節和提示詞遵從度上有進一步優化,但單次出圖成本與延遲特性也有所變化。

🎯 遷移建議: 我們建議正在使用 grok-imagine-image-pro 的項目,立即在沙箱環境對常用 prompt 做一輪迴歸測試,對比新舊兩個模型下的畫面差異、出圖速度與單張成本變化,避免業務端直接被迫切換。

Grok 模型退役 成本影響分析

成本變化是本次退役公告裏被低估的關鍵點。grok-4.3 的統一價格是 $1.25/1M 輸入、$2.50/1M 輸出,對原本就在使用 grok-4-0709 或 grok-3 的團隊基本無感,但對依賴 fast-reasoning、fast-non-reasoning 與 grok-code-fast-1 這三類低價 slug 的項目來說,單價會有顯著上漲。

Grok 模型退役 5 個關鍵成本變化

下表彙總了開發者在 5 月 15 日之後最容易踩到的 5 個成本變化點,建議在遷移前對照自查。

| 成本變化點 | 舊模型表現 | grok-4.3 表現 | 風險等級 |

|---|---|---|---|

| 輸入單價 | fast 系列普遍 < $0.5/1M | 統一 $1.25/1M | 高 |

| 輸出單價 | grok-code-fast-1 僅 $1.50/1M | 統一 $2.50/1M | 高 |

| reasoning token 計費 | 部分模型不計入 | 推理 token 按 output 價計費 | 中 |

| 上下文窗口 | 256K~512K | 1M 全量計費 | 中 |

| Cache 與工具調用 | 價格策略零散 | 0.20/1M prompt cache + 工具調用按次 | 低 |

特別要提醒的是,grok-4.3 默認 always-on reasoning,即便選擇 low effort,每次請求也會比舊版 fast-non-reasoning 多消耗一定的 reasoning token,這部分會按 output 價格計費,是月度賬單上最容易被忽略的「隱形漲幅」。我們在內部測試中觀察到,同一組短問答 prompt 切換到 grok-4.3(low effort)後,平均 output token 數比 fast-non-reasoning 增加 20%~35%,這意味着即便單價持平,月度賬單也會自然上浮。

以一個典型的客服 Agent 場景爲例:原本日均 100 萬次調用、每次 800 輸入 + 400 輸出 token,使用 grok-4-fast-non-reasoning 大致月成本在 4,000 美元上下;同樣負載切換到 grok-4.3 後,按官方價格直接換算月成本會升至約 13,500 美元,再疊加 reasoning token 增量,實際賬單接近 17,000 美元。這種量級的差異,足以讓運營和財務團隊在 5 月份做一次正式預算覆盤。

另一類容易被低估的成本是 prompt 改造工作量。grok-4.3 的 reasoning 行爲偏向「分步驟推導後給答案」,過去針對 grok-3 調優的 prompt 模板會出現「輸出冗長、首段無結論」的現象。要恢復舊模型那種「直答 + 短結論」的回應風格,要麼用 system prompt 顯式約束輸出結構,要麼把 reasoning effort 調到 none,但兩者都會帶來回歸測試與 prompt 庫迭代的額外工時。

💰 成本控制: 我們建議在遷移階段,通過 API易 apiyi.com 的請求日誌面板按模型 slug 聚合查看 token 用量,結合實際場景判斷是否需要切換到 medium effort 提升質量、或鎖定 none effort 控制成本。

Grok 模型退役 影響分析

對開發者的影響

集體退役對應用層開發者影響最直接的是 grok-code-fast-1 用戶,因爲 grok-code-fast-1 此前以 $0.20/$1.50 的價格在 LiveCodeBench 上做到 80.0% 的得分,性價比極高。遷移到 grok-4.3 後單價直接翻倍,團隊需要重新評估代碼補全、PR 審查、Agent 編排等高頻任務的成本預算,原本能跑通的「行內補全 + 長上下文檢索」組合,可能需要拆分成多步驟以控制 token 消耗。

對 Agent 框架使用者來說,原本依賴 fast 系列做工具調用決策的鏈路也會受影響。grok-4.3 的工具調用能力更強,但首字延遲略高,工程師需要重新調優 timeout、retry 與併發參數。我們建議先在 API易 apiyi.com 的灰度環境完成迴歸測試,確認成功率、延遲分佈與原線上鏈路差異在可接受範圍內,再啓動全量切換。

對企業用戶的影響

企業用戶的關注重點是 SLA 與合規。grok-4.3 一次升級覆蓋了原有 8 款模型的全部場景,簡化了模型選型矩陣,對企業治理(model registry、審計、安全合規)反而是好事。但財務側需要重新審視既有的預算與抵扣規則,特別是按月簽訂的 Token 包套餐與 commit 價折扣條款,是否會因爲統一計價而失效;運維側也要更新告警閾值,避免 5 月份賬單出現非預期漲幅卻沒有觸發預警。

對於跨模型組合調用的場景,建議把 Grok、Claude、GPT 等模型聚合到統一的計費視圖,按部門、按業務線維度做成本歸因,緩解模型頻繁迭代對預算管控的衝擊。這次集體退役也提醒企業方,單一供應商綁定的風險不止於斷供,更體現在「同一個 slug 背後悄悄換芯」帶來的隱性成本變化。

對行業的影響

xAI 選擇一次性退役 8 款模型,背後的信號是 grok-4.3 的「always-on reasoning + 1M context」組合已經足夠通用,可以同時承擔推理、對話、代碼和工具調用四類工作負載。這與 Claude、OpenAI 近年來把「reasoning 模型」與「instruct 模型」逐步統一的方向一致,說明大模型產品化正在進入「單一旗艦打天下」的階段,開發者面對的模型矩陣會更精簡,但單個模型的能力邊界與價格彈性都會被放大。

另一個值得關注的趨勢是「reasoning 默認開啓 + effort 分檔」正在成爲新行業默認。這種設計把延遲與成本的取捨交還給開發者,但前提是 SDK 與監控平臺都要原生支持 effort 字段。對中轉服務和聚合平臺來說,模型生命週期管理會成爲新的核心能力。API易 apiyi.com 已經把 Grok 模型遷移文檔同步到產品控制檯,並對受影響的 slug 推送了下線提醒,幫助開發者避免遺漏。

API易 同步下線說明

爲了與 xAI 官方策略保持一致並避免計費混亂,API易 apiyi.com 已經同步制定了下線計劃,對仍在調用舊 slug 的用戶提供平滑過渡通道。控制檯會按賬號維度統計過去 30 天內對每個退役 slug 的調用次數與花費佔比,讓團隊負責人在遷移前對受影響的業務模塊有清晰的全局視圖。

| 階段 | 時間 | API易動作 |

|---|---|---|

| 預警期 | 2026-05-15 之前 | 控制檯橫幅提醒,郵件通知受影響賬號 |

| 重定向期 | 2026-05-15 12:00 PT 起 | 舊 slug 自動轉發到 grok-4.3,並在響應頭標記 deprecated |

| 完全下線 | 後續按 xAI 節奏 | 控制檯移除舊 slug 選項 |

開發者無需切換 base_url,只需要把請求參數裏的 model 字段替換成 grok-4.3 即可。如果業務裏同時存在 reasoning 與 non-reasoning 兩類調用,建議同步在 SDK 封裝層加上一個 effort 配置項,便於在壓測和 A/B 實驗時統一調度。完整調用示例如下,可直接複製到現有項目驗證。

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "user", "content": "用 200 字解釋 always-on reasoning"}

],

extra_body={"reasoning_effort": "low"}

)

print(response.choices[0].message.content)

查看 Node.js / TypeScript 版本

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const completion = await client.chat.completions.create({

model: "grok-4.3",

messages: [{ role: "user", content: "總結 grok-4.3 遷移要點" }],

// @ts-expect-error xAI extra field

reasoning_effort: "low",

});

console.log(completion.choices[0].message.content);

🚀 遷移建議: 我們建議在遷移前,通過 API易 apiyi.com 的「模型對比」面板把同一組 prompt 分別發給 grok-4.3 與原模型,對比響應質量與首字延遲,再決定 reasoning effort 的最終檔位。

常見問題

Q1: 5 月 15 日之後舊 slug 還能繼續調用嗎?

可以,但實際執行模型是 grok-4.3,計費按 grok-4.3 的新價格 $1.25/$2.50 進行,建議儘快把代碼中的 model 字段更新爲 grok-4.3,以避免月度賬單出現非預期漲幅。

Q2: grok-code-fast-1 遷移後還適合做代碼補全嗎?

grok-4.3 在 LiveCodeBench、SWE-bench 上的成績較 grok-code-fast-1 有所提升,整體編碼能力更強,但延遲與單價更高。建議結合真實業務樣本實測 P95 延遲與單 PR 平均 token 消耗,再決定是否仍然適合做行內補全。

Q3: APIYI 平臺需要重新申請密鑰嗎?

不需要,原有 APIYI Key 直接兼容 grok-4.3 等新模型,base_url 也保持不變,只需調整請求體中的 model 名稱即可。完整模型列表與狀態可在 API易 apiyi.com 控制檯查看。

Q4: 圖像生成模型 grok-imagine-image-pro 的遷移有什麼注意事項?

請求會被重定向到 grok-imagine-image-quality,畫面風格、採樣種子與默認參數都有差異。我們建議先在沙箱環境跑一遍歷史 prompt,確認效果穩定後再上線,避免業務端圖像突然變化。

總結

xAI 把 fast-reasoning、fast-non-reasoning、grok-code-fast-1、grok-3、grok-imagine-image-pro 等 8 款主力模型集體退役,5 月 15 日 12:00 PT 起統一切換到 grok-4.3 與 grok-imagine-image-quality。遷移本身工程量不大,但單價與 reasoning token 計費的變化對成本敏感型業務影響顯著,建議優先完成三件事:把生產代碼中的 model 字段統一更新爲 grok-4.3、顯式傳入 reasoning_effort 控制延遲與成本、用真實業務樣本完成一次端到端的成本測算。

我們的建議是把這次模型升級當成一次治理機會:在 API易 apiyi.com 上同時跑 grok-4.3、Claude、GPT 等多家模型對比延遲與成本,把模型選型從「跟着供應商節奏走」改成「按業務指標選型」,長期看會更穩,也能在下一次類似的集體退役公告出現時,把切換成本控制在數小時之內。

作者: APIYI Team — API易 apiyi.com,企業級 AI 大模型 API 中轉服務,支持 Grok、Claude、GPT、Gemini 等主流模型統一接入。