xAI 官方公告刚刚发布,8 款旧版 Grok 模型将于 2026 年 5 月 15 日 12:00 PT 集体退役,请求会自动重定向至 grok-4.3,但计费将按新模型价格执行。本文快速解读这一动态对 AI 开发者与企业用户的真实影响。

核心价值: 3 分钟搞懂 Grok 模型退役名单、重定向规则、成本变化,以及 API易同步下线策略下应该如何切换调用代码。

Grok 模型退役 核心信息速览

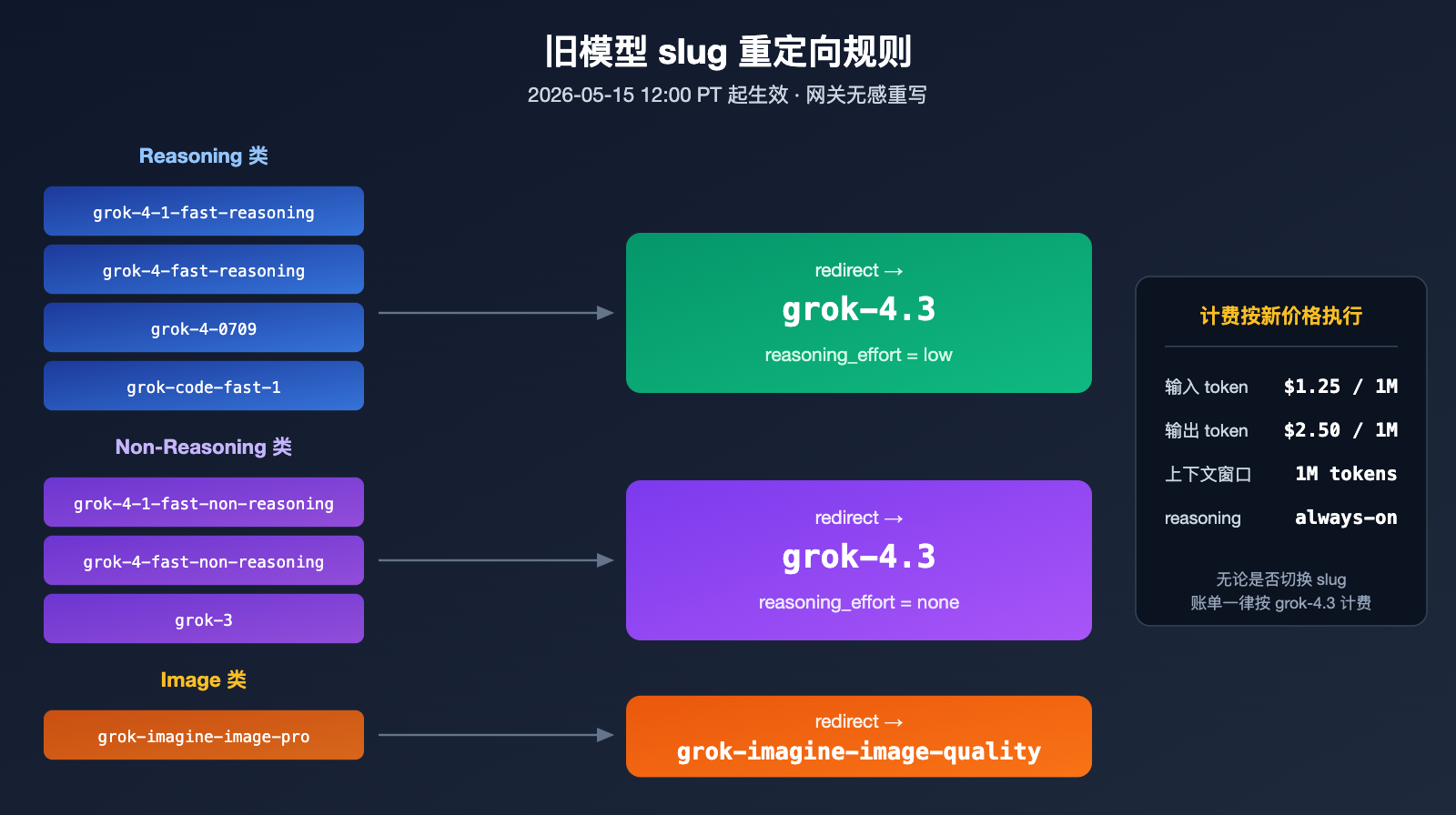

xAI 在迁移文档中明确给出了完整时间线和影响范围,本次退役不是某一两款冷门模型的清理,而是覆盖了过去半年内主力的 reasoning、非 reasoning、代码与图像生成模型。对于在生产环境长期依赖这些 slug 的团队,5 月 15 日就是必须完成代码切换的硬截止日期。

| 信息项 | 详情 |

|---|---|

| 发布时间 | 2026-05-15 12:00 PT |

| 发布方 | xAI 官方(docs.x.ai) |

| 退役模型数量 | 8 款 |

| 重定向目标 | grok-4.3 / grok-imagine-image-quality |

| 新模型价格 | $1.25 / 1M 输入,$2.50 / 1M 输出 |

| 上下文窗口 | 1,000,000 tokens |

| 资料来源 | docs.x.ai/developers/migration/may-15-retirement |

Grok 模型退役名单详解

本次集体下线的 8 款模型涵盖了 4 类典型工作负载:fast-reasoning 系列(含 grok-4-1-fast-reasoning、grok-4-fast-reasoning)面向高吞吐推理;fast-non-reasoning 系列(含 grok-4-1-fast-non-reasoning、grok-4-fast-non-reasoning)面向低延迟对话;grok-4-0709 与 grok-3 是早期的旗舰通用模型;grok-code-fast-1 与 grok-imagine-image-pro 则分别覆盖代码生成与图像生成。

| 模型 slug | 类别 | 典型用途 | 重定向目标 |

|---|---|---|---|

| grok-4-1-fast-reasoning | reasoning | 高吞吐推理 | grok-4.3(low effort) |

| grok-4-1-fast-non-reasoning | non-reasoning | 低延迟对话 | grok-4.3(none effort) |

| grok-4-fast-reasoning | reasoning | 快速推理 | grok-4.3(low effort) |

| grok-4-fast-non-reasoning | non-reasoning | 实时问答 | grok-4.3(none effort) |

| grok-4-0709 | reasoning | 通用旗舰 | grok-4.3(low effort) |

| grok-code-fast-1 | coding | 智能编码 | grok-4.3(low effort) |

| grok-3 | non-reasoning | 长期生产环境 | grok-4.3(none effort) |

| grok-imagine-image-pro | image | 高质量图像 | grok-imagine-image-quality |

按官方文档说明,所有 reasoning 类模型会以 grok-4.3 配合 low reasoning effort 提供服务,所有 non-reasoning 类模型则改为 none effort,确保延迟与原模型尽量接近;图像生成请求统一切换至 grok-imagine-image-quality 处理。

Grok 模型退役 重定向规则解析

5 月 15 日 12:00 PT 之后,旧 slug 不会立刻返回 404,而是会被网关无感重写到 grok-4.3。这种「平滑过渡」对兼容性非常友好,但同时也是潜在的成本陷阱——很多团队会以为「请求成功就是没事」,结果在月末账单里才发现单价已经悄悄上涨。

Grok 模型退役 reasoning 行为变化

grok-4.3 与旧版 fast-reasoning 系列最大的差别在于「always-on reasoning」设计。grok-4.3 把推理(chain-of-thought)从可选开关变成了模型的常态行为,开发者可以选择 low、medium、high 三档推理强度,没有完全关闭推理的选项;旧版 fast-non-reasoning 模型则是直接跳过推理过程,重定向后的 none effort 会让 grok-4.3 模拟原有的「直答」体验,但实际链路中仍然会消耗少量内部推理 token。

值得注意的是,xAI 这次没有在 SDK 层提供「兼容模式参数」,也就是说原本写死 model="grok-4-fast-reasoning" 的代码即便能够继续工作,也无法精确控制推理强度。如果业务对延迟与一致性敏感,必须显式传入 reasoning_effort 字段,否则只能拿到默认档位,无法复现旧模型的行为曲线。

对于追求极致响应速度的实时应用,我们建议结合 API易 apiyi.com 实测两种 effort 的延迟差异,再决定是否调整业务侧的 prompt 设计。同一份代码切换到统一接口后,可以快速对比不同 reasoning effort 的吞吐与首字延迟,无需修改额外参数。

Grok 模型退役 image 模型变化

grok-imagine-image-pro 是过去半年里 xAI 主推的图像生成模型,主打高分辨率出图。本次将其切换到 grok-imagine-image-quality 后,新模型在画面细节和提示词遵从度上有进一步优化,但单次出图成本与延迟特性也有所变化。

🎯 迁移建议: 我们建议正在使用 grok-imagine-image-pro 的项目,立即在沙箱环境对常用 prompt 做一轮回归测试,对比新旧两个模型下的画面差异、出图速度与单张成本变化,避免业务端直接被迫切换。

Grok 模型退役 成本影响分析

成本变化是本次退役公告里被低估的关键点。grok-4.3 的统一价格是 $1.25/1M 输入、$2.50/1M 输出,对原本就在使用 grok-4-0709 或 grok-3 的团队基本无感,但对依赖 fast-reasoning、fast-non-reasoning 与 grok-code-fast-1 这三类低价 slug 的项目来说,单价会有显著上涨。

Grok 模型退役 5 个关键成本变化

下表汇总了开发者在 5 月 15 日之后最容易踩到的 5 个成本变化点,建议在迁移前对照自查。

| 成本变化点 | 旧模型表现 | grok-4.3 表现 | 风险等级 |

|---|---|---|---|

| 输入单价 | fast 系列普遍 < $0.5/1M | 统一 $1.25/1M | 高 |

| 输出单价 | grok-code-fast-1 仅 $1.50/1M | 统一 $2.50/1M | 高 |

| reasoning token 计费 | 部分模型不计入 | 推理 token 按 output 价计费 | 中 |

| 上下文窗口 | 256K~512K | 1M 全量计费 | 中 |

| Cache 与工具调用 | 价格策略零散 | 0.20/1M prompt cache + 工具调用按次 | 低 |

特别要提醒的是,grok-4.3 默认 always-on reasoning,即便选择 low effort,每次请求也会比旧版 fast-non-reasoning 多消耗一定的 reasoning token,这部分会按 output 价格计费,是月度账单上最容易被忽略的「隐形涨幅」。我们在内部测试中观察到,同一组短问答 prompt 切换到 grok-4.3(low effort)后,平均 output token 数比 fast-non-reasoning 增加 20%~35%,这意味着即便单价持平,月度账单也会自然上浮。

以一个典型的客服 Agent 场景为例:原本日均 100 万次调用、每次 800 输入 + 400 输出 token,使用 grok-4-fast-non-reasoning 大致月成本在 4,000 美元上下;同样负载切换到 grok-4.3 后,按官方价格直接换算月成本会升至约 13,500 美元,再叠加 reasoning token 增量,实际账单接近 17,000 美元。这种量级的差异,足以让运营和财务团队在 5 月份做一次正式预算复盘。

另一类容易被低估的成本是 prompt 改造工作量。grok-4.3 的 reasoning 行为偏向「分步骤推导后给答案」,过去针对 grok-3 调优的 prompt 模板会出现「输出冗长、首段无结论」的现象。要恢复旧模型那种「直答 + 短结论」的回应风格,要么用 system prompt 显式约束输出结构,要么把 reasoning effort 调到 none,但两者都会带来回归测试与 prompt 库迭代的额外工时。

💰 成本控制: 我们建议在迁移阶段,通过 API易 apiyi.com 的请求日志面板按模型 slug 聚合查看 token 用量,结合实际场景判断是否需要切换到 medium effort 提升质量、或锁定 none effort 控制成本。

Grok 模型退役 影响分析

对开发者的影响

集体退役对应用层开发者影响最直接的是 grok-code-fast-1 用户,因为 grok-code-fast-1 此前以 $0.20/$1.50 的价格在 LiveCodeBench 上做到 80.0% 的得分,性价比极高。迁移到 grok-4.3 后单价直接翻倍,团队需要重新评估代码补全、PR 审查、Agent 编排等高频任务的成本预算,原本能跑通的「行内补全 + 长上下文检索」组合,可能需要拆分成多步骤以控制 token 消耗。

对 Agent 框架使用者来说,原本依赖 fast 系列做工具调用决策的链路也会受影响。grok-4.3 的工具调用能力更强,但首字延迟略高,工程师需要重新调优 timeout、retry 与并发参数。我们建议先在 API易 apiyi.com 的灰度环境完成回归测试,确认成功率、延迟分布与原线上链路差异在可接受范围内,再启动全量切换。

对企业用户的影响

企业用户的关注重点是 SLA 与合规。grok-4.3 一次升级覆盖了原有 8 款模型的全部场景,简化了模型选型矩阵,对企业治理(model registry、审计、安全合规)反而是好事。但财务侧需要重新审视既有的预算与抵扣规则,特别是按月签订的 Token 包套餐与 commit 价折扣条款,是否会因为统一计价而失效;运维侧也要更新告警阈值,避免 5 月份账单出现非预期涨幅却没有触发预警。

对于跨模型组合调用的场景,建议把 Grok、Claude、GPT 等模型聚合到统一的计费视图,按部门、按业务线维度做成本归因,缓解模型频繁迭代对预算管控的冲击。这次集体退役也提醒企业方,单一供应商绑定的风险不止于断供,更体现在「同一个 slug 背后悄悄换芯」带来的隐性成本变化。

对行业的影响

xAI 选择一次性退役 8 款模型,背后的信号是 grok-4.3 的「always-on reasoning + 1M context」组合已经足够通用,可以同时承担推理、对话、代码和工具调用四类工作负载。这与 Claude、OpenAI 近年来把「reasoning 模型」与「instruct 模型」逐步统一的方向一致,说明大模型产品化正在进入「单一旗舰打天下」的阶段,开发者面对的模型矩阵会更精简,但单个模型的能力边界与价格弹性都会被放大。

另一个值得关注的趋势是「reasoning 默认开启 + effort 分档」正在成为新行业默认。这种设计把延迟与成本的取舍交还给开发者,但前提是 SDK 与监控平台都要原生支持 effort 字段。对中转服务和聚合平台来说,模型生命周期管理会成为新的核心能力。API易 apiyi.com 已经把 Grok 模型迁移文档同步到产品控制台,并对受影响的 slug 推送了下线提醒,帮助开发者避免遗漏。

API易 同步下线说明

为了与 xAI 官方策略保持一致并避免计费混乱,API易 apiyi.com 已经同步制定了下线计划,对仍在调用旧 slug 的用户提供平滑过渡通道。控制台会按账号维度统计过去 30 天内对每个退役 slug 的调用次数与花费占比,让团队负责人在迁移前对受影响的业务模块有清晰的全局视图。

| 阶段 | 时间 | API易动作 |

|---|---|---|

| 预警期 | 2026-05-15 之前 | 控制台横幅提醒,邮件通知受影响账号 |

| 重定向期 | 2026-05-15 12:00 PT 起 | 旧 slug 自动转发到 grok-4.3,并在响应头标记 deprecated |

| 完全下线 | 后续按 xAI 节奏 | 控制台移除旧 slug 选项 |

开发者无需切换 base_url,只需要把请求参数里的 model 字段替换成 grok-4.3 即可。如果业务里同时存在 reasoning 与 non-reasoning 两类调用,建议同步在 SDK 封装层加上一个 effort 配置项,便于在压测和 A/B 实验时统一调度。完整调用示例如下,可直接复制到现有项目验证。

import openai

client = openai.OpenAI(

api_key="YOUR_APIYI_KEY",

base_url="https://api.apiyi.com/v1"

)

response = client.chat.completions.create(

model="grok-4.3",

messages=[

{"role": "user", "content": "用 200 字解释 always-on reasoning"}

],

extra_body={"reasoning_effort": "low"}

)

print(response.choices[0].message.content)

查看 Node.js / TypeScript 版本

import OpenAI from "openai";

const client = new OpenAI({

apiKey: process.env.APIYI_KEY,

baseURL: "https://api.apiyi.com/v1",

});

const completion = await client.chat.completions.create({

model: "grok-4.3",

messages: [{ role: "user", content: "总结 grok-4.3 迁移要点" }],

// @ts-expect-error xAI extra field

reasoning_effort: "low",

});

console.log(completion.choices[0].message.content);

🚀 迁移建议: 我们建议在迁移前,通过 API易 apiyi.com 的「模型对比」面板把同一组 prompt 分别发给 grok-4.3 与原模型,对比响应质量与首字延迟,再决定 reasoning effort 的最终档位。

常见问题

Q1: 5 月 15 日之后旧 slug 还能继续调用吗?

可以,但实际执行模型是 grok-4.3,计费按 grok-4.3 的新价格 $1.25/$2.50 进行,建议尽快把代码中的 model 字段更新为 grok-4.3,以避免月度账单出现非预期涨幅。

Q2: grok-code-fast-1 迁移后还适合做代码补全吗?

grok-4.3 在 LiveCodeBench、SWE-bench 上的成绩较 grok-code-fast-1 有所提升,整体编码能力更强,但延迟与单价更高。建议结合真实业务样本实测 P95 延迟与单 PR 平均 token 消耗,再决定是否仍然适合做行内补全。

Q3: APIYI 平台需要重新申请密钥吗?

不需要,原有 APIYI Key 直接兼容 grok-4.3 等新模型,base_url 也保持不变,只需调整请求体中的 model 名称即可。完整模型列表与状态可在 API易 apiyi.com 控制台查看。

Q4: 图像生成模型 grok-imagine-image-pro 的迁移有什么注意事项?

请求会被重定向到 grok-imagine-image-quality,画面风格、采样种子与默认参数都有差异。我们建议先在沙箱环境跑一遍历史 prompt,确认效果稳定后再上线,避免业务端图像突然变化。

总结

xAI 把 fast-reasoning、fast-non-reasoning、grok-code-fast-1、grok-3、grok-imagine-image-pro 等 8 款主力模型集体退役,5 月 15 日 12:00 PT 起统一切换到 grok-4.3 与 grok-imagine-image-quality。迁移本身工程量不大,但单价与 reasoning token 计费的变化对成本敏感型业务影响显著,建议优先完成三件事:把生产代码中的 model 字段统一更新为 grok-4.3、显式传入 reasoning_effort 控制延迟与成本、用真实业务样本完成一次端到端的成本测算。

我们的建议是把这次模型升级当成一次治理机会:在 API易 apiyi.com 上同时跑 grok-4.3、Claude、GPT 等多家模型对比延迟与成本,把模型选型从「跟着供应商节奏走」改成「按业务指标选型」,长期看会更稳,也能在下一次类似的集体退役公告出现时,把切换成本控制在数小时之内。

作者: APIYI Team — API易 apiyi.com,企业级 AI 大模型 API 中转服务,支持 Grok、Claude、GPT、Gemini 等主流模型统一接入。