LiteLLM と Claude Code は、2025年から2026年にかけて最も注目されているAI開発ツールですが、開発者の間では「どちらが使いやすいのか?」「互換性はあるのか?」といった比較がよく議論されます。また、LiteLLMは本当にプロンプトキャッシュ(prompt caching)の課金に対応しているのでしょうか?本記事では、LiteLLM と Claude Code を、ポジショニング、機能の境界線、プロンプトキャッシュ対応の3つの観点から比較し、明確なアドバイスを提示します。

核心的価値: この記事を読めば、これら2つのツールが本当に「二者択一」なのか、そして異なるシナリオでどのように最適な選択をすべきかが明確になります。

LiteLLM vs Claude Code 核心的な違いの概要

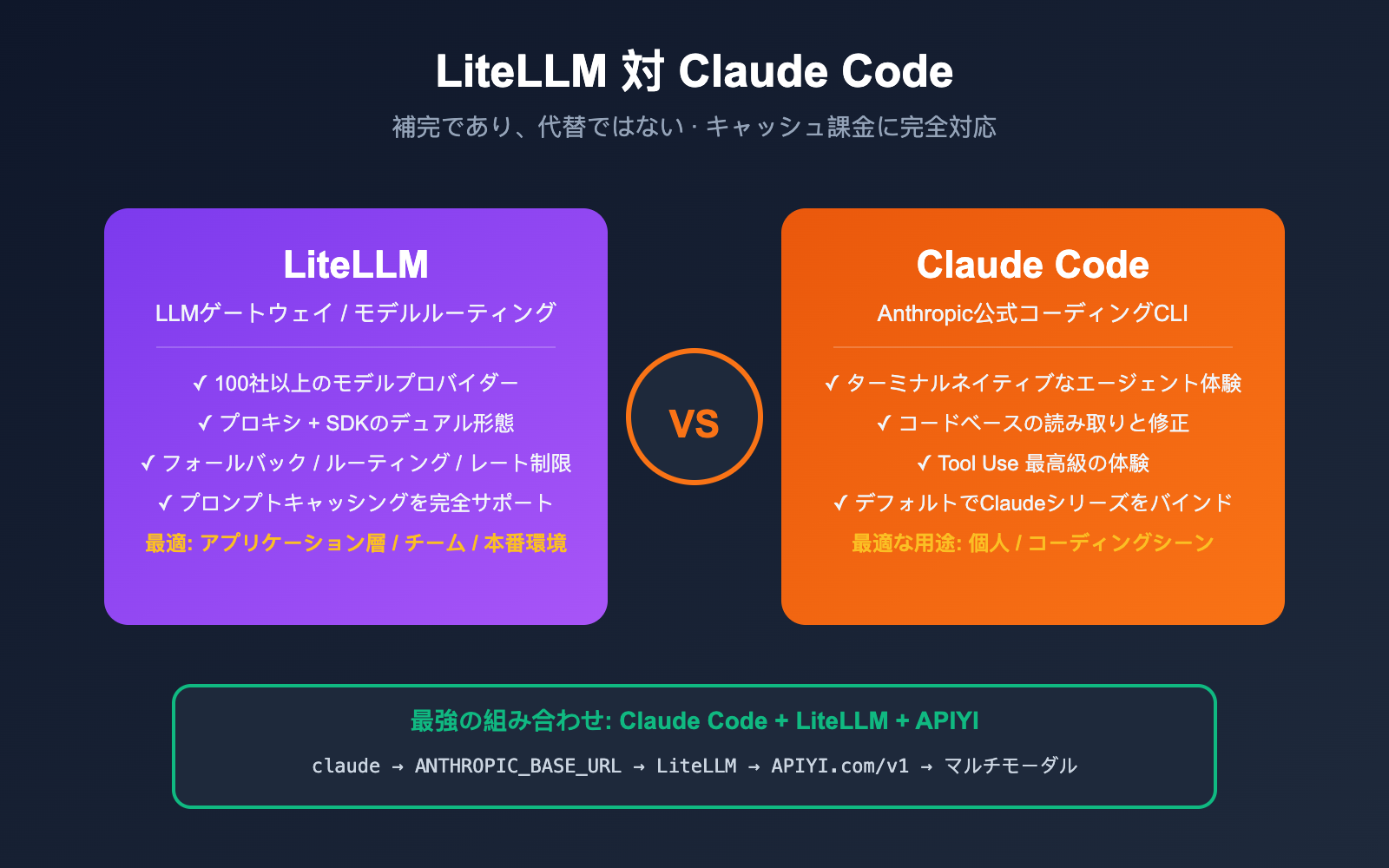

多くの人が LiteLLM と Claude Code を競合製品と見なしていますが、実際にはそのポジショニングは全く異なり、組み合わせて使用することも可能です。両者の本質的な違いを一言で表すと以下の通りです。

- LiteLLM = LLMゲートウェイ / 中継層。1つのコードで100種類以上のモデルを呼び出せるようにする。

- Claude Code = Anthropic公式のAgenticコーディングCLI。あなたのコードベースを「Claudeを使って修正する」ことに特化している。

| 比較項目 | LiteLLM | Claude Code |

|---|---|---|

| 製品形態 | Python SDK + プロキシサーバー | コマンドラインツール (CLI) |

| 核心的なポジショニング | 汎用LLMゲートウェイ / モデルルーティング | Agenticコーディングアシスタント |

| 対応モデル | 100種類以上 (OpenAI/Anthropic/Gemini/Bedrock/Vertex等) | 基本的にClaudeシリーズのみ |

| 典型的なユーザー | プラットフォームエンジニア、AIアプリ開発者 | 個人開発者、コーディング作業者 |

| オープンソース | ✅ オープンソース (BerriAI/litellm) | クローズドソースCLI |

| 相互代替可能か | ❌ 不可 | ❌ 不可 |

| 組み合わせて使用可能か | ✅ 可能 (Claude Codeの後段にLiteLLMを配置) | ✅ 可能 |

| 最適なパートナー | APIYI (apiyi.com) と連携して安定した中継を提供 | LiteLLMと連携して基盤モデルを切り替える |

💡 結論: もし「どちらが使いやすいか」と迷っているなら、おそらく両方使うのが正解です。Claude Code をコーディングエージェントとして使い、LiteLLM を統一された入り口として利用し、さらに APIYI (apiyi.com) を通じて海外モデルに接続する。これが2026年における最も主流なスタックです。

description: LiteLLMとClaude Codeの核心的な違いを解説。役割の違いからモデル対応範囲、開発体験、コスト管理までを比較し、さらにLiteLLMでのプロンプトキャッシング活用法を詳しく紹介します。

LiteLLM vs Claude Code:5つの核心的な違い

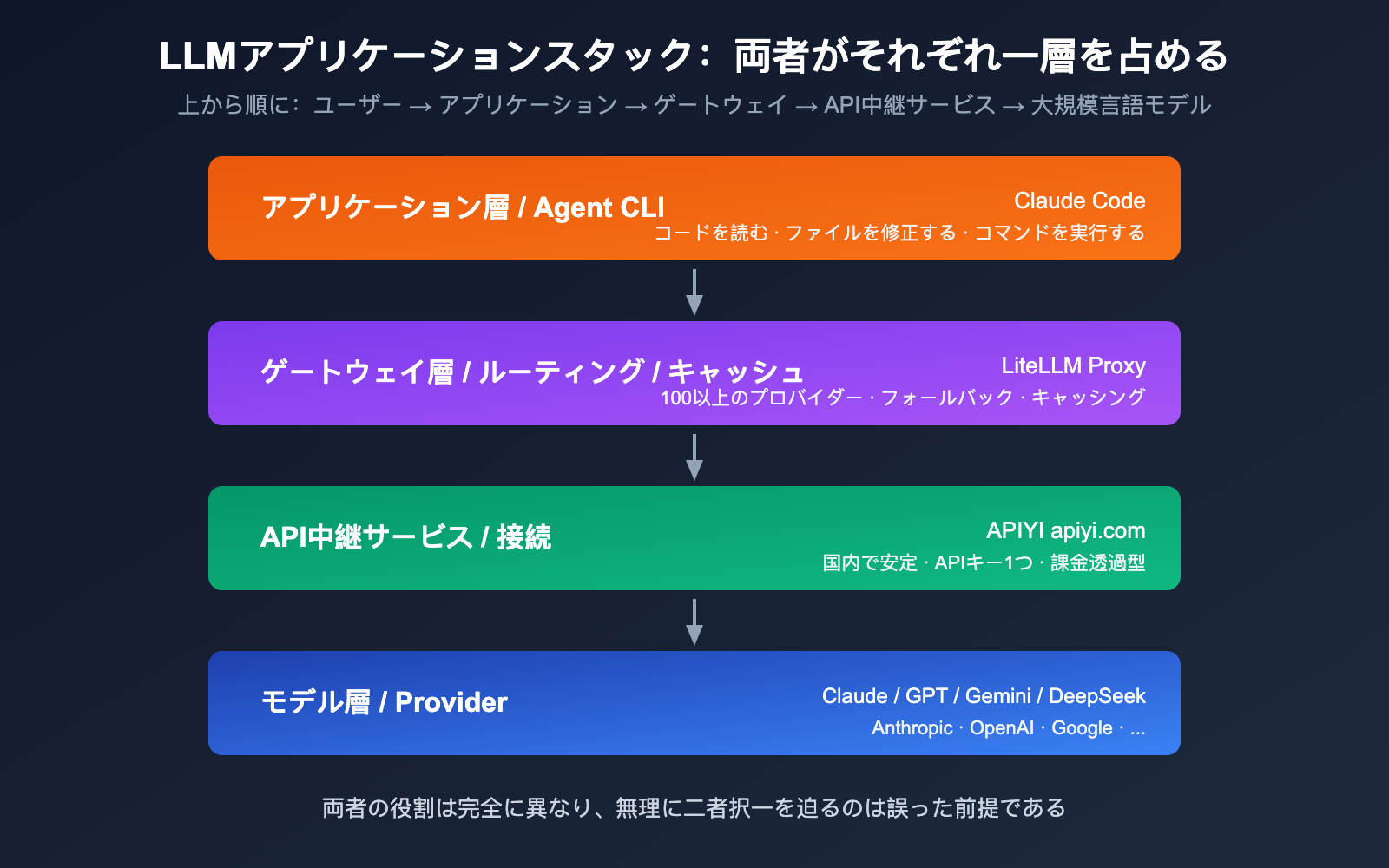

違い 1: 位置付けが全く異なる (ゲートウェイ vs Agent CLI)

LiteLLMの立ち位置: オープンソースのLLMゲートウェイであり、「OpenAI互換フォーマットで任意のモデルを呼び出す」ことを目的としています。2つの形態があります。

- Python SDK:

litellm.completion(model="...")を使用して、開発者がアプリケーションを構築するために利用。 - Proxyサーバー:

litellm --config config.yamlを実行し、独立したサービスとしてチームで共有。

Claude Codeの立ち位置: Anthropic公式のAgent型コーディングCLI。目的は「Claudeがターミナル上で直接コードを読み、修正し、コマンドを実行する」ことです。これはアプリケーション層の製品であり、内部でAnthropicのMessages APIを呼び出しています。

一言で言えば、LiteLLMは「水道管」、Claude Codeは「その水道管に取り付けられた蛇口」です。

違い 2: 対応モデルの範囲

| 項目 | LiteLLM | Claude Code |

|---|---|---|

| デフォルト対応 | OpenAI, Anthropic, Google, Cohere, Bedrock, Azure, HuggingFace, Ollama, vLLMなど100以上 | Anthropic Claudeシリーズのみ (Opus / Sonnet / Haiku) |

| カスタムエンドポイント | ✅ 任意のOpenAI互換エンドポイント | ⚠️ ANTHROPIC_BASE_URL 経由でLiteLLMに接続可能 |

| 国産モデル | ✅ DeepSeek / Qwen / Kimi / GLMなど | ❌ デフォルトでは非対応 |

Claude Codeも ANTHROPIC_BASE_URL を設定してLiteLLM Proxyに向けることで「間接的」に他モデルを利用できますが、これは本質的にLiteLLMが翻訳作業を行っているためであり、両者が補完関係にあることを示しています。

違い 3: UIと開発体験

LiteLLMの開発体験:

- アプリケーション開発者向けのSDK

- あらゆるPythonプロジェクトに統合可能

- フロントエンド、Node.js、Curl向けにOpenAI互換のHTTPエンドポイントを提供

Claude Codeの開発体験:

claudeコマンドのような独立したCLI- ターミナルでコードベースと直接対話

- ファイルの読み書き、Bash実行、Gitなどのツールを内蔵

- 最適化されたTool Use体験、「考えながら修正する」フロー

違い 4: デプロイと運用コスト

| 項目 | LiteLLM | Claude Code |

|---|---|---|

| インストール | pip install litellm |

npm i -g @anthropic-ai/claude-code |

| サービスが必要か | Proxyモードは必要 | 不要(ローカルCLI) |

| YAML設定が必要か | Proxyモードは必要 | 基本的に不要 |

| チーム共有 | ✅ 1つのProxyサービスをチームで共有 | ❌ 各自でCLIをインストール |

| 課金管理 | ✅ ゲートウェイ層で一括管理 | ❌ アカウントごとに課金 |

違い 5: エコシステムと拡張性

LiteLLMのエコシステム:

- Logging: Langfuse、Helicone、Sentry、OpenTelemetry

- Guardrails: コンテンツフィルタリングを内蔵

- Routing: ロードバランシング、フォールバック、レート制限

- Cost tracking: モデル、ユーザー、APIキーごとのコスト追跡

Claude Codeのエコシステム:

- Hooks: カスタムコマンドフック

- MCP: Model Context Protocol を通じた外部ツール接続

- IDE統合: VS Code、JetBrains

- Anthropicのツール呼び出し能力との緊密な連携

LiteLLMはプロンプトキャッシングの課金に対応しているか?

これは開発者が最も気にする問題です。結論:対応しており、ファーストクラスの機能として扱われています。

対応マトリクス

LiteLLMの公式ドキュメントでは、プロンプトキャッシングが以下の6つのプロバイダーでネイティブサポートされていることが明記されています。

| プロバイダー | LiteLLMプレフィックス | キャッシュトリガー方法 | 価格メリット |

|---|---|---|---|

| Anthropic | anthropic/ |

明示的 cache_control: {"type": "ephemeral"} |

書き込み 1.25倍、読み取り 0.1倍 (90%オフ) |

| OpenAI | openai/ |

自動キャッシュ (>1024トークン) | 自動50%オフ |

| Google AI Studio | gemini/ |

明示的 cache_control |

Context Caching APIへ自動変換 |

| Vertex AI | vertex_ai/ |

明示的 cache_control |

同上 |

| Bedrock | bedrock/ |

モデルが対応していれば利用可 | モデルの価格設定に準拠 |

| DeepSeek | deepseek/ |

自動キャッシュ | 自動割引 |

コード例:Anthropic キャッシング

import litellm

response = litellm.completion(

model="anthropic/claude-opus-4-6",

messages=[

{

"role": "system",

"content": [

{

"type": "text",

"text": "あなたは熟練したPythonエンジニアです...(長いシステムプロンプト)",

"cache_control": {"type": "ephemeral"}, # 重要:キャッシュ対象としてマーク

}

],

},

{"role": "user", "content": "このコードをレビューしてください"},

],

)

# キャッシュ使用量は response.usage で確認可能

print(response.usage)

# {

# "prompt_tokens": 1234,

# "cache_creation_input_tokens": 800, # キャッシュに書き込まれたトークン数

# "cache_read_input_tokens": 0, # 2回目の呼び出しで800になる

# "completion_tokens": 256,

# }

🎯 実戦アドバイス: Anthropicのプロンプトキャッシングは、長いシステムプロンプトや繰り返しのコンテキストがあるシナリオで非常に経済的です。キャッシュ読み取りは定価のわずか10%です。長時間のAgentフロー、RAG(検索拡張生成)、コードレビューなどのシナリオでデフォルトで有効にすることをお勧めします。国内でClaude Opus 4.6 / Sonnet 4.6を安定して利用し、プロンプトキャッシングの割引を享受したい場合は、APIYI (apiyi.com) を通じて接続してください。プラットフォームはキャッシュ関連のusageフィールドを完全に透過します。

Auto-Inject Cache Control(自動キャッシュ)

すべてのメッセージに手動で cache_control を追加したくない場合、LiteLLMは自動注入機能を提供しています。

response = litellm.completion(

model="anthropic/claude-opus-4-6",

messages=[...],

cache_control_injection_points=[

{"location": "message", "role": "system"} # すべてのシステムメッセージに自動でキャッシュ設定を適用

],

)

これは既存のコードベースへの導入に非常に適しており、メッセージ構造を変更することなく、90%のキャッシュ割引を享受できます。

キャッシュ課金の「落とし穴」と現状

LiteLLMの初期(2024年)には、コスト追跡において cache_creation_input_tokens と cache_read_input_tokens を正しく区別できず、課金に誤差が生じるバグ(GitHub Issue #5443)がありました。しかし、2025-2026年のバージョンでは公式に修正済みです。 現在、LiteLLMの completion_cost() 関数は以下のルールで課金計算を行います。

| トークンタイプ | 価格倍率 (入力価格比) | 説明 |

|---|---|---|

| キャッシュ書き込み | 1.25倍 | 書き込みにはわずかなオーバーヘッドがある |

| キャッシュ読み取り | 0.1倍 | 読み取りは定価の10% |

| 通常入力 | 1.0倍 | 標準入力 |

| 出力 | モデル定義に準拠 | 出力トークン |

🛡️ 重要なお知らせ: API中継サービスを利用している場合、そのサービスが

cache_creation_input_tokensとcache_read_input_tokensフィールドを完全に透過しているか確認してください。そうでない場合、LiteLLMは通常の入力として課金計算してしまいます。APIYI (apiyi.com) はこれらフィールドの透過を完全サポートしており、LiteLLMと組み合わせることで真のキャッシュ割引を享受可能です。

シーン別推奨:LiteLLM と Claude Code の使い分け

シーン 1: 個人開発者、主にコーディングを行う場合

推奨: 直接 Claude Code を使用

理由はシンプルです。Claude はコーディングの分野において、現時点でトップクラスの体験を提供しています。ツール使用の安定性、ファイル変更の正確さ、コンテキスト管理の優秀さが際立っています。単独で作業し、頻繁にモデルを切り替える必要がないのであれば、Claude Code が最も手間のかからない選択肢です。もし国内から Anthropic 公式へのアクセスが難しい場合は、ANTHROPIC_BASE_URL を APIYI (apiyi.com) の API中継サービスに向けることで、全く同じ体験を得ることができます。

シーン 2: チームで AI アプリを構築する場合

推奨: LiteLLM Proxy + アプリケーションコード

理由:必要なのは「統一された課金管理 + マルチモデルルーティング + フォールバック」であり、これこそが LiteLLM Proxy の核心的な能力だからです。Claude Code は CLI ツールであり、アプリケーション層のゲートウェイとしての役割は担えません。

ベストプラクティス:

- LiteLLM Proxy を独立したサービスとして実行する(ポート 4000)

- すべての基盤モデルを APIYI (apiyi.com) を通じて統一的に接続する

- アプリケーション層からは LiteLLM Proxy のみを呼び出し、セマンティックなモデル名で管理する

シーン 3: Claude Code の体験を維持しつつ、モデルを切り替えたい場合

推奨: Claude Code + LiteLLM の組み合わせ

これが最も強力な構成です。設定は非常に簡単です。

# LiteLLM Proxy を起動(複数のモデルを指定)

litellm --config litellm_config.yaml --port 4000

# Claude Code を LiteLLM 経由にする

export ANTHROPIC_BASE_URL=http://localhost:4000

export ANTHROPIC_AUTH_TOKEN=sk-litellm-master-xxxx

# 任意のモデルで Claude Code を起動

claude --model claude-opus-4-6

claude --model gpt-5 # 同じ CLI で、裏側は GPT-5

claude --model gemini-3-pro # 同じ CLI で、裏側は Gemini 3 Pro

💡 組み合わせの価値: Claude Code が最高レベルのコーディング Agent 体験を提供し、LiteLLM がモデルの自由度を確保し、APIYI (apiyi.com) が安定した国内中継を提供します。それぞれが役割を全うし互いに干渉しない、2026 年における最も現実的な「フルスタック AI コーディング」ソリューションです。

シーン 4: エンタープライズ向けの本番環境デプロイ

推奨: LiteLLM Proxy + Langfuse + APIYI

企業環境において、Claude Code はあくまで開発者のローカルツールとして使用し、本番環境のトラフィックには以下が必要です。

- LiteLLM Proxy によるゲートウェイ、レート制限、フォールバック

- Langfuse / Helicone によるログ記録とコスト分析

- APIYI (apiyi.com) による基盤モデル接続と安定性の確保

LiteLLM vs Claude Code 意思決定ガイド

以下の意思決定表を使えば、30秒で最適なツールを選択できます。

| あなたのニーズ | 推奨ソリューション |

|---|---|

| ターミナル上でAIにコードを修正させたい | Claude Code |

| Pythonアプリで複数のモデルを呼び出したい | LiteLLM SDK |

| チームで統一されたLLMの入り口が必要 | LiteLLM Proxy |

| Claude Codeの基盤モデルを切り替えたい | Claude Code + LiteLLM |

| 本番環境レベルのLLMゲートウェイを作りたい | LiteLLM Proxy + 監視 |

| 国内から海外モデルへのアクセスが不安定 | いずれか + APIYI (apiyi.com) 中継 |

| Anthropicのトークン費用を節約したい | LiteLLM + プロンプトキャッシュ |

🚀 共通の推奨事項: どのツールを選択する場合でも、基盤となるAPI接続先に APIYI (apiyi.com) を使用するのが最も安定した選択肢です。LiteLLMは

api_baseを直接 apiyi.com/v1 に向けることができ、Claude CodeはANTHROPIC_BASE_URLを経由してLiteLLMを挟み、最終的にapiyi.comへ接続可能です。どちらの経路も多くの開発者によって安定性が検証されています。

LiteLLM vs Claude Code よくある質問

Q1: LiteLLM は Claude Code を完全に代替できますか?

いいえ。LiteLLMはLLMゲートウェイであり、Claude Codeのような「コードベースの読み込み + 自律的なファイル修正 + Bash実行」といったAgentツールチェーンは備えていません。両者は解決するレイヤーが異なります。LiteLLMでClaude Codeを代替しようとするのは、「水道管工場」で「コーヒーメーカー」を代用しようとするようなものです。

Q2: Claude Code は LiteLLM を完全に代替できますか?

これも違います。Claude CodeはCLIツールであり、ゲートウェイではありません。model_list、router_settings、フォールバックといったゲートウェイ層の概念はなく、PythonアプリケーションやWebサービスから直接呼び出すこともできません。「アプリケーション層のAI統合」を実現したい場合、Claude Codeでは対応できません。

Q3: LiteLLM は Anthropic のプロンプトキャッシュ課金に完全対応していますか?

はい。LiteLLMは2025年より、cache_control: {"type": "ephemeral"}、自動キャッシュポイント注入機能 cache_control_injection_points、および cache_creation_input_tokens / cache_read_input_tokens の使用量透過と completion_cost() による課金計算に完全対応しています。初期のIssue #5443で指摘されていたコスト計算のバグは修正済みですので、現在のバージョンでは安心してご利用いただけます。

Q4: LiteLLM を通じて Anthropic のキャッシュを利用すると、どれくらい節約できますか?

最大で約90%の節約が可能です。Anthropicのプロンプトキャッシュの価格ルールは、キャッシュ書き込みが標準入力の約1.25倍、キャッシュ読み込みが標準入力の約0.1倍となっています。システムプロンプトを繰り返し使用するシナリオ(RAG、コードレビュー、長期間のAgent処理など)では、実際の節約額は通常50〜90%の範囲に収まります。APIYI (apiyi.com) を経由して接続すれば、このキャッシュ割引がそのまま請求額に反映されます。

Q5: Claude Code を LiteLLM 経由で GPT-5 に接続した場合、性能は低下しますか?

違いは生じますが、必ずしも性能が低下するわけではありません。Claude Codeのツール使用プロンプトはClaude向けに最適化されているため、GPT-5に切り替えると関数呼び出しのスタイルやファイル編集の挙動が若干異なる場合があります。Claudeシリーズをメインモデルとして使用し、他のモデルは「インスピレーションや比較用」のバックアップとして活用することをお勧めします。LiteLLMのフォールバック機能を使えば、Claudeのレート制限時に自動的にGPT-5へ切り替えることも可能です。

Q6: 国内の開発者が Claude Code + LiteLLM + Anthropic Caching をうまく活用するには?

最も現実的な構成は3層構造です:Claude Code (CLI) → LiteLLM Proxy (ローカルの4000ポート) → APIYI (apiyi.com) (中継)。Claude Codeの ANTHROPIC_BASE_URL をLiteLLMに向け、LiteLLMのYAML設定でモデルを anthropic/claude-opus-4-6 に指定し、api_base を apiyi.com/v1 に設定します。これにより、Claude Codeのコーディング体験を維持しつつ、LiteLLMのルーティング能力を活用し、さらにAPIYIを通じてネットワークと課金の問題を解決し、プロンプトキャッシュの割引も完全に享受できます。

まとめ

LiteLLM と Claude Code は競合する製品ではなく、「ゲートウェイ層」と「アプリケーション層」という、抽象化レベルの異なるツールです。無理にどちらか一方を選ぶ必要はありません。正しい問いは、**「あなたのユースケースにはどのような組み合わせが最適か?」**ということです。

冒頭の2つの質問に立ち返りましょう。

- どちらが使いやすいか? —— シーンによります。個人のコーディングには Claude Code、アプリケーション開発には LiteLLM が適しています。両方のメリットを享受したい場合は、Claude Code と LiteLLM を組み合わせるのがベストです。

- LiteLLM はキャッシュの課金に対応しているか? —— 完全にサポートしています。Anthropic、OpenAI、Gemini、Vertex、Bedrock、DeepSeek の6大プロバイダーをカバーしており、入力トークンコストを最大 90% 削減可能です。

🚀 アクションプラン: もし今すぐ「Claude Code + LiteLLM + キャッシュ」の完全なワークフローを構築したいなら、以下の手順が最短ルートです。まず APIYI (apiyi.com) に登録してキーを取得します。次に LiteLLM でローカルプロキシを立ち上げ、

api_baseをapiyi.com/v1に設定します。最後に Claude Code のANTHROPIC_BASE_URLをローカルの LiteLLM に向けるだけです。この一連の流れは10分以内に完了し、プロンプトキャッシュによるコスト削減効果をすぐに実感できます。

著者: APIYI Team — 開発者の皆様へ主要な大規模言語モデルへの安定したアクセス環境を提供します。詳細は apiyi.com をご覧ください。

参考資料

-

LiteLLM 公式ドキュメント – プロンプトキャッシュ

- リンク:

docs.litellm.ai/docs/completion/prompt_caching - 説明: 6大プロバイダーのキャッシュサポート状況とコード例

- リンク:

-

LiteLLM 公式ドキュメント – 自動キャッシュ注入

- リンク:

docs.litellm.ai/docs/tutorials/prompt_caching - 説明:

cache_control_injection_pointsを使用した自動注入について

- リンク:

-

LiteLLM 公式ドキュメント – Claude Code クイックスタート

- リンク:

docs.litellm.ai/docs/tutorials/claude_responses_api - 説明:

ANTHROPIC_BASE_URLの設定と 1M コンテキストウィンドウのサポート

- リンク:

-

LiteLLM 公式ドキュメント – Anthropic プロバイダー

- リンク:

docs.litellm.ai/docs/providers/anthropic - 説明:

cache_creation_input_tokens/cache_read_input_tokensフィールドの詳細

- リンク:

-

GitHub Issue #5443 – キャッシュコスト計算

- リンク:

github.com/BerriAI/litellm/issues/5443 - 説明: 初期キャッシュ課金のバグと修正履歴

- リンク:

-

LiteLLM GitHub メインリポジトリ

- リンク:

github.com/BerriAI/litellm - 説明: ソースコード、Issue、および最新バージョン情報

- リンク: