LiteLLM и Claude Code — одни из самых популярных инструментов для разработки с использованием ИИ в 2025–2026 годах. Разработчики часто сравнивают их между собой: что лучше? Могут ли они заменить друг друга? Поддерживает ли LiteLLM кеширование промптов? В этой статье мы сравним LiteLLM и Claude Code, разобрав их позиционирование, границы возможностей и поддержку кеширования, чтобы дать вам четкие рекомендации.

Основная ценность: Прочитав статью, вы поймете, нужно ли выбирать что-то одно, и как сделать оптимальный выбор для ваших задач.

Краткий обзор ключевых различий LiteLLM и Claude Code

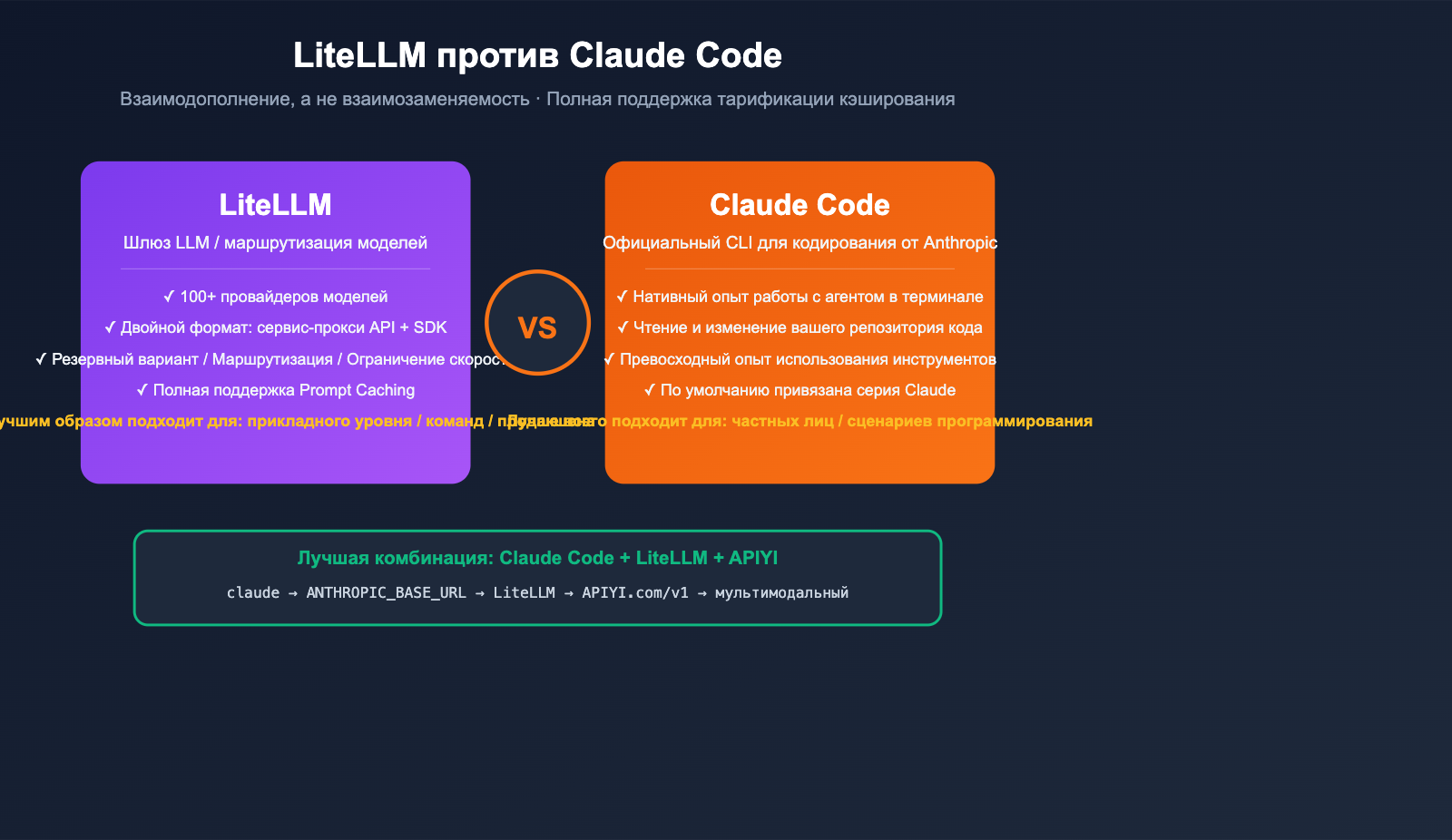

Многие воспринимают LiteLLM и Claude Code как конкурентов, но на самом деле их позиционирование совершенно разное, и их можно использовать вместе. Если коротко:

- LiteLLM = ИИ-шлюз / прослойка, позволяющая вызывать 100+ моделей через единый интерфейс.

- Claude Code = Официальный CLI-инструмент от Anthropic для работы в режиме агента, специализирующийся на «изменении вашей кодовой базы с помощью Claude».

| Параметр сравнения | LiteLLM | Claude Code |

|---|---|---|

| Формат продукта | Python SDK + Proxy-сервер | CLI-инструмент |

| Основное позиционирование | Универсальный ИИ-шлюз / маршрутизатор моделей | Агентный помощник по написанию кода |

| Поддержка моделей | 100+ (OpenAI, Anthropic, Gemini, Bedrock, Vertex и др.) | По умолчанию только семейство Claude |

| Целевая аудитория | Платформенные инженеры, разработчики ИИ-приложений | Индивидуальные разработчики, задачи кодинга |

| Open Source | ✅ Да (BerriAI/litellm) | ❌ Нет (закрытый CLI) |

| Взаимозаменяемость | ❌ Нет | ❌ Нет |

| Возможность совместного использования | ✅ Да (LiteLLM за Claude Code) | ✅ Да (LiteLLM для смены модели) |

| Лучший партнер | APIYI (apiyi.com) для стабильного проксирования | LiteLLM для гибкого выбора моделей |

💡 Быстрый вывод: Если вы задаетесь вопросом «что лучше», скорее всего, вам нужны оба. Используйте Claude Code как агента для написания кода, а LiteLLM — как единую точку входа, подключенную через APIYI (apiyi.com) для доступа к зарубежным моделям. Это и есть самый актуальный стек в 2026 году.

5 ключевых различий между LiteLLM и Claude Code

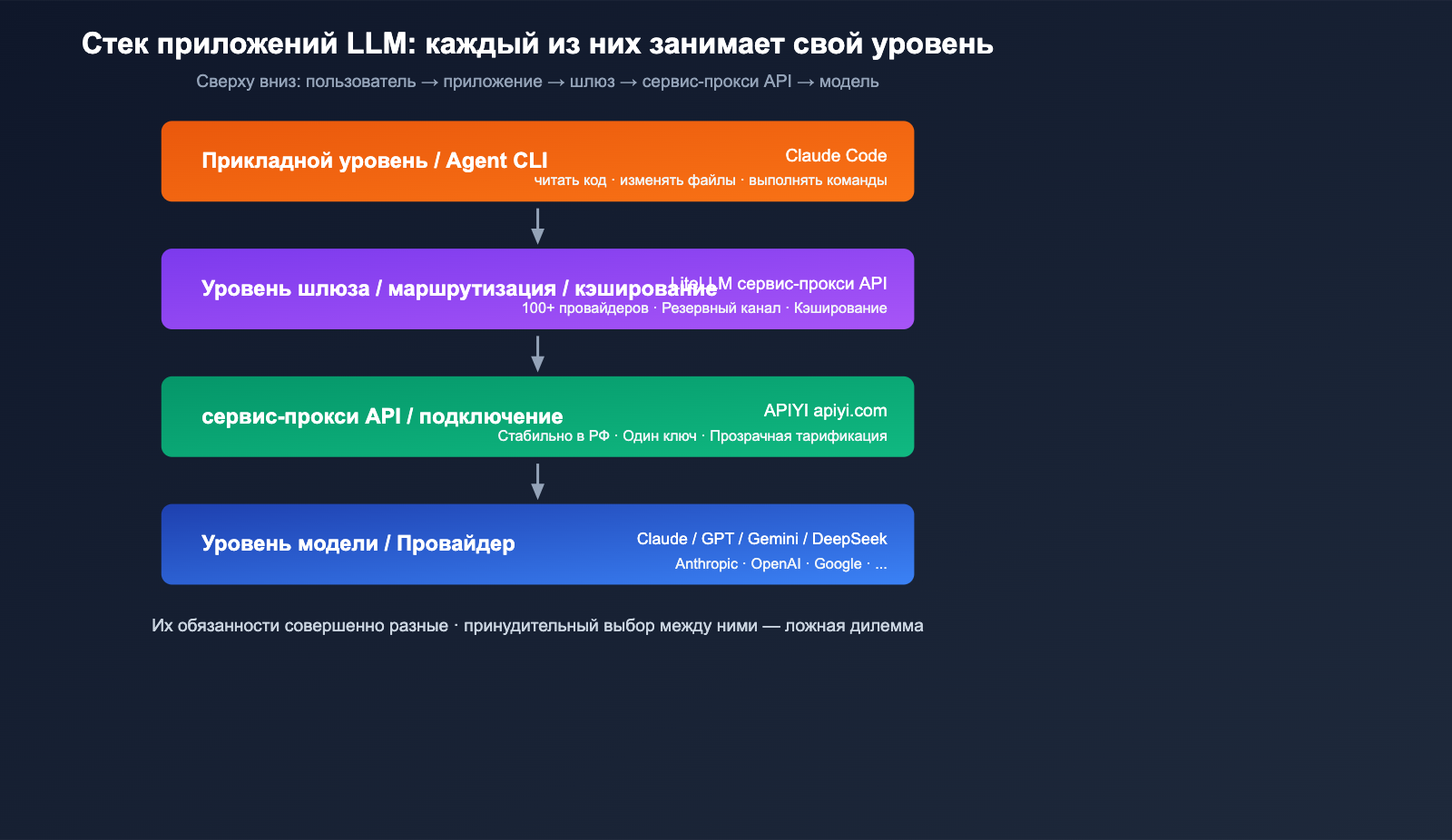

Различие 1: Совершенно разное позиционирование (шлюз vs Agent CLI)

Позиционирование LiteLLM: это open-source шлюз для больших языковых моделей, цель которого — «вызывать любую модель через формат, совместимый с OpenAI». Существует в двух видах:

- Python SDK:

litellm.completion(model="...")для разработки приложений. - Proxy-сервер:

litellm --config config.yaml— запускается как отдельный сервис для совместного использования командой.

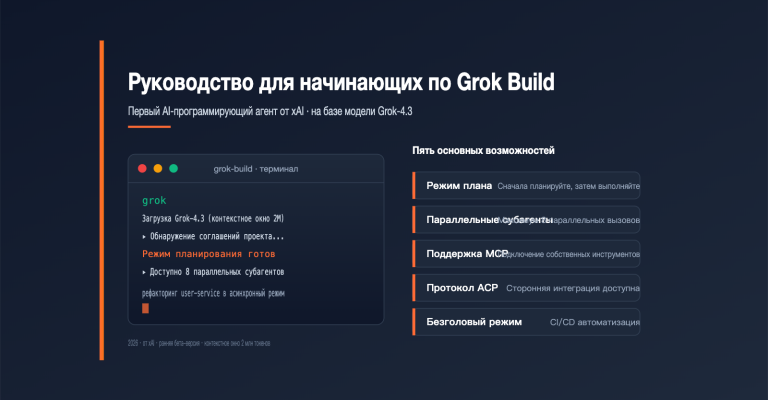

Позиционирование Claude Code: это официальный агентный CLI для кодинга от Anthropic. Его цель — «позволить Claude напрямую читать ваш код, изменять его и выполнять команды в терминале». Это прикладной продукт, который под капотом использует Messages API от Anthropic.

Короче говоря: LiteLLM — это «водопроводная труба», а Claude Code — это «кран, установленный на эту трубу».

Различие 2: Поддерживаемые модели

| Параметр | LiteLLM | Claude Code |

|---|---|---|

| Поддержка из коробки | OpenAI, Anthropic, Google, Cohere, Bedrock, Azure, HuggingFace, Ollama, vLLM и др. (100+) | Только семейство Anthropic Claude (Opus / Sonnet / Haiku) |

| Кастомный эндпоинт | ✅ Любой, совместимый с OpenAI | ⚠️ Через ANTHROPIC_BASE_URL к LiteLLM |

| Китайские модели | ✅ DeepSeek / Qwen / Kimi / GLM и др. | ❌ По умолчанию не поддерживаются |

Заметьте, что Claude Code можно «косвенно» заставить работать с другими моделями, указав ANTHROPIC_BASE_URL на прокси LiteLLM, но по сути это LiteLLM выполняет роль переводчика — что лишь доказывает, что они дополняют друг друга.

Различие 3: Интерфейс и опыт разработки

Опыт с LiteLLM:

- SDK для разработчиков приложений.

- Можно интегрировать в любой Python-проект.

- Предоставляет HTTP-эндпоинт, совместимый с OpenAI, для фронтенда, Node.js или cURL.

Опыт с Claude Code:

- Отдельный CLI, похожий на команду

claude. - Прямое общение с кодовой базой в терминале.

- Встроенные инструменты для чтения/записи файлов, выполнения Bash, работы с Git.

- Оптимизированный опыт использования инструментов (Tool Use), «думает и правит одновременно».

Различие 4: Стоимость развертывания и эксплуатации

| Проект | LiteLLM | Claude Code |

|---|---|---|

| Установка | pip install litellm |

npm i -g @anthropic-ai/claude-code |

| Нужен ли сервер | Да, для режима Proxy | Нет, это локальный CLI |

| Нужен ли YAML-конфиг | Да, для режима Proxy | Обычно нет |

| Совместная работа | ✅ Один прокси-сервер на команду | ❌ У каждого свой CLI |

| Биллинг | ✅ Централизованно на уровне шлюза | ❌ У каждого аккаунта свой |

Различие 5: Экосистема и расширяемость

Экосистема LiteLLM:

- Логирование: Langfuse, Helicone, Sentry, OpenTelemetry.

- Guardrails: встроенная модерация контента.

- Маршрутизация: балансировка нагрузки, fallback, ограничение скорости (rate limiting).

- Отслеживание затрат: по моделям, пользователям и ключам.

Экосистема Claude Code:

- Хуки: пользовательские команды-хуки.

- MCP: подключение внешних инструментов через Model Context Protocol.

- Интеграция с IDE: VS Code, JetBrains.

- Тесная привязка к возможностям вызова инструментов Anthropic.

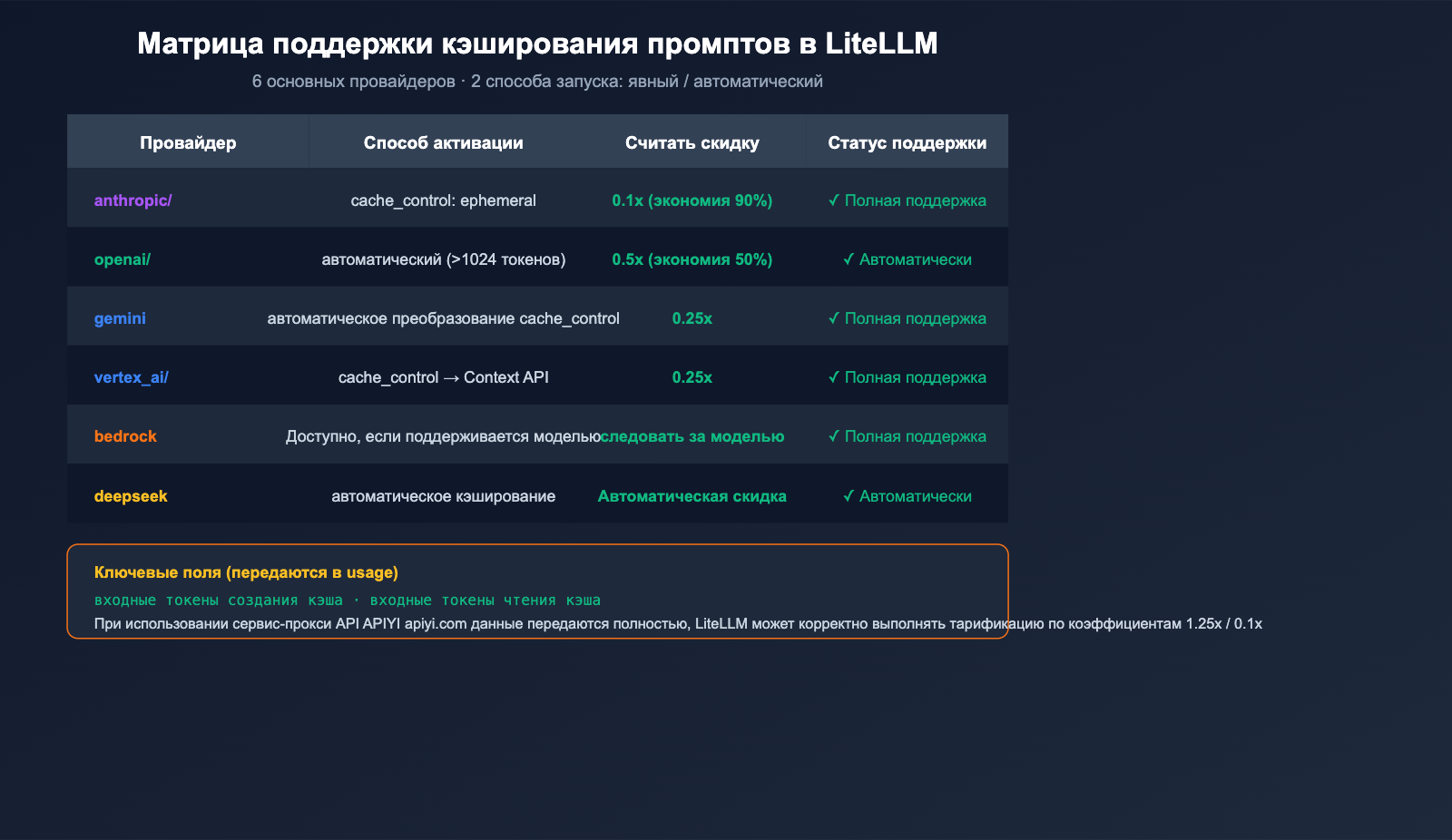

Поддерживает ли LiteLLM кеширование промптов (Prompt Caching)?

Это один из самых частых вопросов от разработчиков. Короткий ответ: да, поддерживается, и это функция первого класса.

Матрица поддержки

В официальной документации LiteLLM четко указано, что кеширование промптов (prompt caching) нативно поддерживается у следующих 6 крупных провайдеров:

| Провайдер | Префикс LiteLLM | Способ активации | Ценовое преимущество |

|---|---|---|---|

| Anthropic | anthropic/ |

Явный cache_control: {"type": "ephemeral"} |

Запись 1.25x, чтение 0.1x (скидка 90%) |

| OpenAI | openai/ |

Автоматически (>1024 токенов) | Автоматическая скидка 50% |

| Google AI Studio | gemini/ |

Явный cache_control |

Автоматическая конвертация в Context Caching API |

| Vertex AI | vertex_ai/ |

Явный cache_control |

Аналогично |

| Bedrock | bedrock/ |

Доступно, если модель поддерживает | Согласно прайсу модели |

| DeepSeek | deepseek/ |

Автоматически | Автоматическая скидка |

Пример кода: Кеширование Anthropic

import litellm

response = litellm.completion(

model="anthropic/claude-opus-4-6",

messages=[

{

"role": "system",

"content": [

{

"type": "text",

"text": "Ты — опытный Python-инженер... (длинный системный промпт)",

"cache_control": {"type": "ephemeral"}, # Ключевой момент: помечаем для кеширования

}

],

},

{"role": "user", "content": "Пожалуйста, проведи ревью этого кода"},

],

)

# Использование кеша видно в response.usage

print(response.usage)

# {

# "prompt_tokens": 1234,

# "cache_creation_input_tokens": 800, # Токены, записанные в кеш

# "cache_read_input_tokens": 0, # При втором вызове здесь будет 800

# "completion_tokens": 256,

# }

🎯 Совет: Кеширование промптов у Anthropic невероятно выгодно при использовании длинных системных промптов и повторяющегося контекста — чтение из кеша стоит всего 10% от обычной цены. Мы рекомендуем включать его по умолчанию в длинных цепочках агентов, RAG-системах и при ревью кода. Если вы хотите стабильно вызывать Claude Opus 4.6 / Sonnet 4.6 и получать скидки на кеширование, вы можете подключиться через APIYI (apiyi.com) — платформа полностью передает поля

usage, связанные с кешированием.

Автоматическое кеширование (Auto-Inject Cache Control)

Если вы не хотите вручную добавлять cache_control к каждому сообщению, LiteLLM предлагает автоматическую вставку:

response = litellm.completion(

model="anthropic/claude-opus-4-6",

messages=[...],

cache_control_injection_points=[

{"location": "message", "role": "system"} # Автоматически кешировать все системные сообщения

],

)

Это очень удобно для интеграции в старый код — не нужно менять структуру messages, чтобы получить скидку 90%.

Нюансы и текущее состояние биллинга

На ранних этапах (в 2024 году) у LiteLLM действительно был баг (GitHub Issue #5443): отслеживание затрат неверно разделяло cache_creation_input_tokens и cache_read_input_tokens, что приводило к ошибкам в расчетах. Но в версиях 2025-2026 годов это исправлено. Сейчас LiteLLM в функции completion_cost() считает по следующим правилам:

| Тип токенов | Множитель цены (относительно input) | Примечание |

|---|---|---|

| Cache Write | 1.25x | Есть небольшие накладные расходы на запись |

| Cache Read | 0.1x | Чтение стоит всего 10% |

| Обычный Input | 1.0x | Стандартный ввод |

| Output | Зависит от модели | Выходные токены |

🛡️ Важное примечание: Если вы используете сервис-прокси API, убедитесь, что он корректно передает поля

cache_creation_input_tokensиcache_read_input_tokens. В противном случае LiteLLM посчитает их как обычный ввод. APIYI (apiyi.com) полностью поддерживает передачу этих полей, что в связке с LiteLLM позволит вам реально экономить на кешировании.

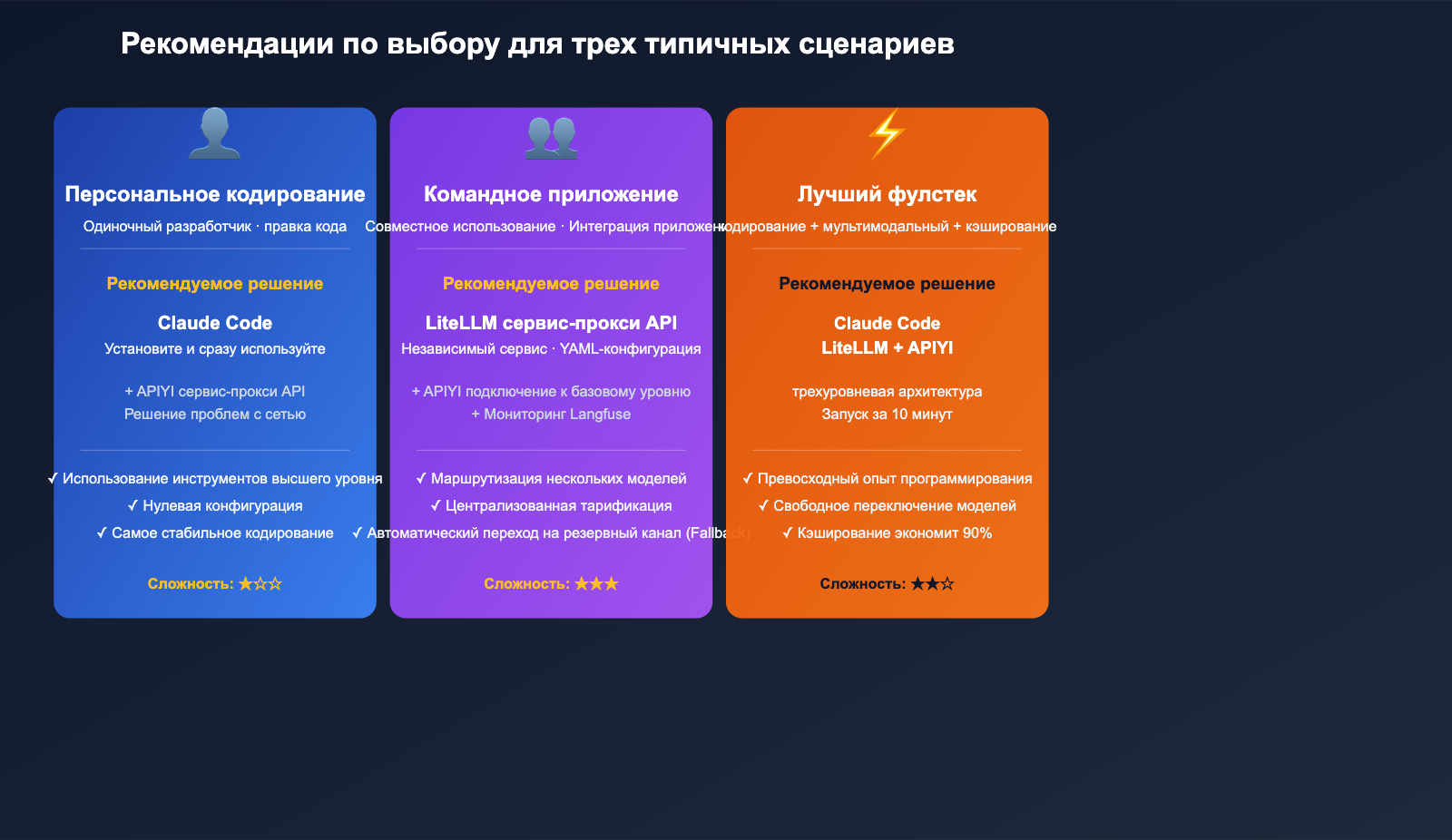

Сценарии использования: когда выбирать LiteLLM, а когда Claude Code

Сценарий 1: Индивидуальный разработчик, основной фокус на кодинге

Рекомендация: Используйте Claude Code напрямую.

Причина проста: Claude на текущий момент остается в топе по качеству написания кода. Он отлично работает с инструментами (Tool Use), точно вносит изменения в файлы и грамотно управляет контекстом. Если вы работаете в одиночку и вам не нужно постоянно переключаться между моделями, Claude Code — самый беспроблемный вариант. Если есть сложности с доступом к официальному API Anthropic, можно направить ANTHROPIC_BASE_URL через сервис-прокси APIYI (apiyi.com) — опыт использования будет идентичным.

Сценарий 2: Командная разработка AI-приложений

Рекомендация: LiteLLM Proxy + код вашего приложения.

Причина: вам нужны «единый биллинг + маршрутизация между моделями + отработка отказов (fallback)», что является ключевыми возможностями LiteLLM Proxy. Claude Code — это CLI-инструмент, он не предназначен для роли шлюза на уровне приложения.

Лучшие практики:

- Запустите LiteLLM Proxy как отдельный сервис (порт 4000).

- Подключите все базовые модели через APIYI (apiyi.com).

- На уровне приложения обращайтесь только к LiteLLM Proxy, используя семантические имена моделей.

Сценарий 3: Нужен опыт Claude Code, но с возможностью смены моделей

Рекомендация: Связка Claude Code + LiteLLM.

Это мощнейшая комбинация. Настройка элементарна:

# Запуск LiteLLM Proxy (с доступом к разным моделям)

litellm --config litellm_config.yaml --port 4000

# Настройка Claude Code для работы через LiteLLM

export ANTHROPIC_BASE_URL=http://localhost:4000

export ANTHROPIC_AUTH_TOKEN=sk-litellm-master-xxxx

# Запуск Claude Code с любой моделью

claude --model claude-opus-4-6

claude --model gpt-5 # Тот же CLI, но под капотом GPT-5

claude --model gemini-3-pro # Тот же CLI, но под капотом Gemini 3 Pro

💡 Ценность связки: Claude Code обеспечивает топовый опыт AI-агента для кодинга, LiteLLM дает свободу выбора моделей, а APIYI (apiyi.com) гарантирует стабильный доступ. Все три компонента работают слаженно, не мешая друг другу — это самое рациональное решение для «Full-stack AI кодинга» в 2026 году.

Сценарий 4: Промышленное развертывание (Enterprise)

Рекомендация: LiteLLM Proxy + Langfuse + APIYI.

В корпоративной среде Claude Code используется только как локальный инструмент разработчика, а для реального продакшн-трафика требуется:

- LiteLLM Proxy в качестве шлюза с лимитами (rate limiting) и отказоустойчивостью.

- Langfuse / Helicone для логирования и анализа затрат.

- APIYI (apiyi.com) для надежного подключения базовых моделей.

Рекомендации по выбору: LiteLLM или Claude Code

Эта таблица поможет вам определиться с выбором всего за 30 секунд.

| Ваша задача | Рекомендуемое решение |

|---|---|

| Хочу, чтобы ИИ правил код прямо в терминале | Claude Code |

| Хочу вызывать разные модели в приложении на Python | LiteLLM SDK |

| Команде нужен единый шлюз для LLM | LiteLLM Proxy |

| Хочу сменить базовую модель в Claude Code | Claude Code + LiteLLM |

| Нужен LLM-шлюз промышленного уровня | LiteLLM Proxy + мониторинг |

| Нестабильный доступ к зарубежным моделям из РФ | Любой вариант + сервис-прокси API APIYI (apiyi.com) |

| Хочу сэкономить на токенах Anthropic | LiteLLM + prompt caching |

🚀 Единый совет: какой бы инструмент вы ни выбрали, подключение через APIYI (apiyi.com) — самый надежный вариант. LiteLLM можно направить напрямую на

apiyi.com/v1через параметрapi_base, а Claude Code — черезANTHROPIC_BASE_URL(сначала на LiteLLM, затем на APIYI). Оба пути проверены множеством разработчиков и работают стабильно.

Часто задаваемые вопросы по LiteLLM и Claude Code

Q1: Может ли LiteLLM полностью заменить Claude Code?

Нет. LiteLLM — это LLM-шлюз, в нем нет инструментов агента, которые есть в Claude Code: «читать репозиторий + самостоятельно править файлы + запускать Bash». Они решают задачи на разных уровнях. Использовать LiteLLM вместо Claude Code — это как пытаться заменить кофемашину водопроводной трубой.

Q2: Может ли Claude Code полностью заменить LiteLLM?

Тоже нет. Claude Code — это CLI-инструмент, а не шлюз. В нем нет таких концепций, как model_list, router_settings или fallbacks, и его нельзя вызвать напрямую из вашего Python-приложения или веб-сервиса. Если вам нужна интеграция ИИ на уровне приложения, Claude Code здесь не поможет.

Q3: Действительно ли LiteLLM поддерживает тарификацию prompt caching от Anthropic?

Да. Начиная с 2025 года, LiteLLM полностью поддерживает cache_control: {"type": "ephemeral"}, автоматическую вставку точек кэширования cache_control_injection_points, а также передачу данных об использовании cache_creation_input_tokens / cache_read_input_tokens и расчет стоимости через completion_cost(). Баг с расчетом стоимости, упомянутый в старом Issue #5443, уже исправлен — в текущей версии можно работать без опасений.

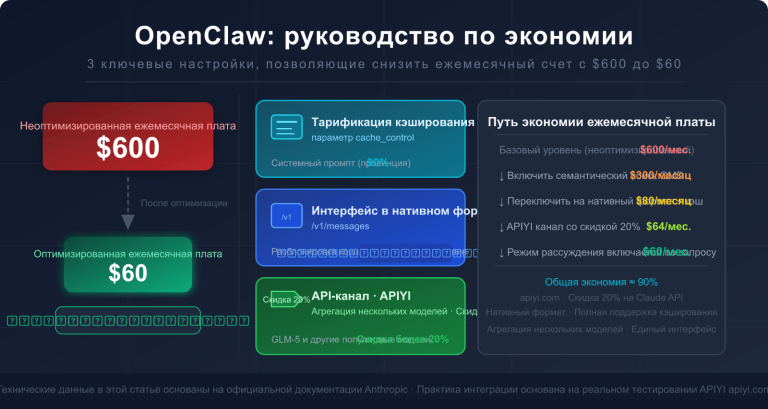

Q4: Сколько можно сэкономить при использовании кэширования Anthropic через LiteLLM?

До ~90%. Правила ценообразования Anthropic для prompt caching таковы: запись в кэш стоит примерно 1.25x от стандартного входного токена, а чтение — около 0.1x. В сценариях с часто повторяющимся длинным системным промптом (например, RAG, проверка кода, длинные цепочки агентов) реальная экономия обычно составляет от 50% до 90%. Если вы подключаетесь через APIYI (apiyi.com), эта скидка за кэширование будет полностью отражена в вашем счете.

Q5: Станет ли хуже работать Claude Code, если подключить его к GPT-5 через LiteLLM?

Разница будет, но не обязательно в худшую сторону. Промпты для использования инструментов (Tool Use) в Claude Code оптимизированы под Claude, поэтому при переключении на GPT-5 стиль вызова функций и редактирования файлов может немного отличаться. Рекомендую использовать модели семейства Claude как основные, а остальные — для сравнения или как запасные. Механизм Fallback в LiteLLM позволит автоматически переключаться на GPT-5, если у Claude возникнут лимиты.

Q6: Как разработчикам из РФ лучше всего совместить Claude Code + LiteLLM + Anthropic Caching?

Самый прагматичный вариант — трехуровневая структура: Claude Code (CLI) → LiteLLM Proxy (локальный порт 4000) → APIYI (apiyi.com) (прокси). Claude Code через ANTHROPIC_BASE_URL указывает на LiteLLM, в YAML-конфиге LiteLLM модель настраивается как anthropic/claude-opus-4-6, а api_base ведет на apiyi.com/v1. Так вы сохраняете удобство кодинга в Claude Code, получаете возможности маршрутизации LiteLLM, решаете проблемы с доступом и оплатой через APIYI, а также полностью используете скидки на prompt caching.

Резюме

LiteLLM и Claude Code — это не конкуренты, а инструменты на разных уровнях абстракции: «шлюзовой уровень» (gateway) и «уровень приложений». Выбор между ними — ложная дилемма. Правильный вопрос звучит так: какая комбинация лучше подходит для вашего сценария?

Вернемся к двум вопросам, поставленным в начале статьи:

- Что лучше использовать? — Зависит от задачи. Для индивидуального программирования выбирайте Claude Code, для разработки приложений — LiteLLM. Если нужно и то, и другое, используйте связку Claude Code + LiteLLM.

- Поддерживает ли LiteLLM тарификацию кэширования? — Да, полная поддержка для 6 основных провайдеров: Anthropic, OpenAI, Gemini, Vertex, Bedrock и DeepSeek. Это позволяет сэкономить до 90% затрат на входные токены.

🚀 Совет к действию: Если вы хотите прямо сегодня настроить полноценный рабочий процесс «Claude Code + LiteLLM + Caching», самый быстрый путь таков: во-первых, зарегистрируйтесь на APIYI (apiyi.com) и получите ключ; во-вторых, разверните локальный прокси с помощью LiteLLM, указав

api_baseнаapiyi.com/v1; в-третьих, настройте в Claude Code переменнуюANTHROPIC_BASE_URL, указав её на ваш локальный LiteLLM. Вся цепочка настраивается менее чем за 10 минут, и вы сразу сможете оценить экономию благодаря кэшированию промптов.

Автор: Команда APIYI — мы специализируемся на предоставлении разработчикам стабильного доступа к ведущим большим языковым моделям. Узнайте больше на сайте apiyi.com.

Справочные материалы

-

Официальная документация LiteLLM — Кэширование промптов (Prompt Caching)

- Ссылка:

docs.litellm.ai/docs/completion/prompt_caching - Описание: Матрица поддержки кэширования для 6 основных провайдеров и примеры кода.

- Ссылка:

-

Официальная документация LiteLLM — Автоматическое внедрение кэша

- Ссылка:

docs.litellm.ai/docs/tutorials/prompt_caching - Описание: Использование

cache_control_injection_pointsдля автоматической вставки.

- Ссылка:

-

Официальная документация LiteLLM — Быстрый старт с Claude Code

- Ссылка:

docs.litellm.ai/docs/tutorials/claude_responses_api - Описание: Настройка

ANTHROPIC_BASE_URLи поддержка контекстного окна в 1 млн токенов.

- Ссылка:

-

Официальная документация LiteLLM — Провайдер Anthropic

- Ссылка:

docs.litellm.ai/docs/providers/anthropic - Описание: Описание полей

cache_creation_input_tokensиcache_read_input_tokens.

- Ссылка:

-

GitHub Issue #5443 — Расчет стоимости кэширования

- Ссылка:

github.com/BerriAI/litellm/issues/5443 - Описание: История исправления ранних багов в расчете стоимости кэша.

- Ссылка:

-

Основной репозиторий LiteLLM на GitHub

- Ссылка:

github.com/BerriAI/litellm - Описание: Исходный код, обсуждение проблем (Issues) и последние версии.

- Ссылка: