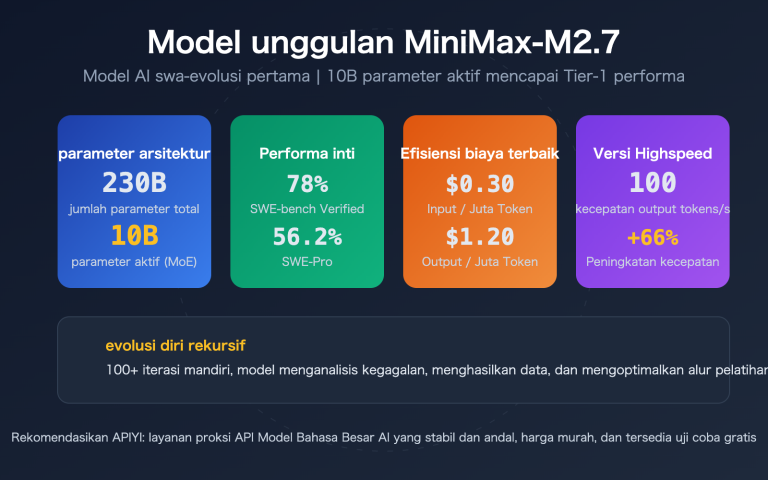

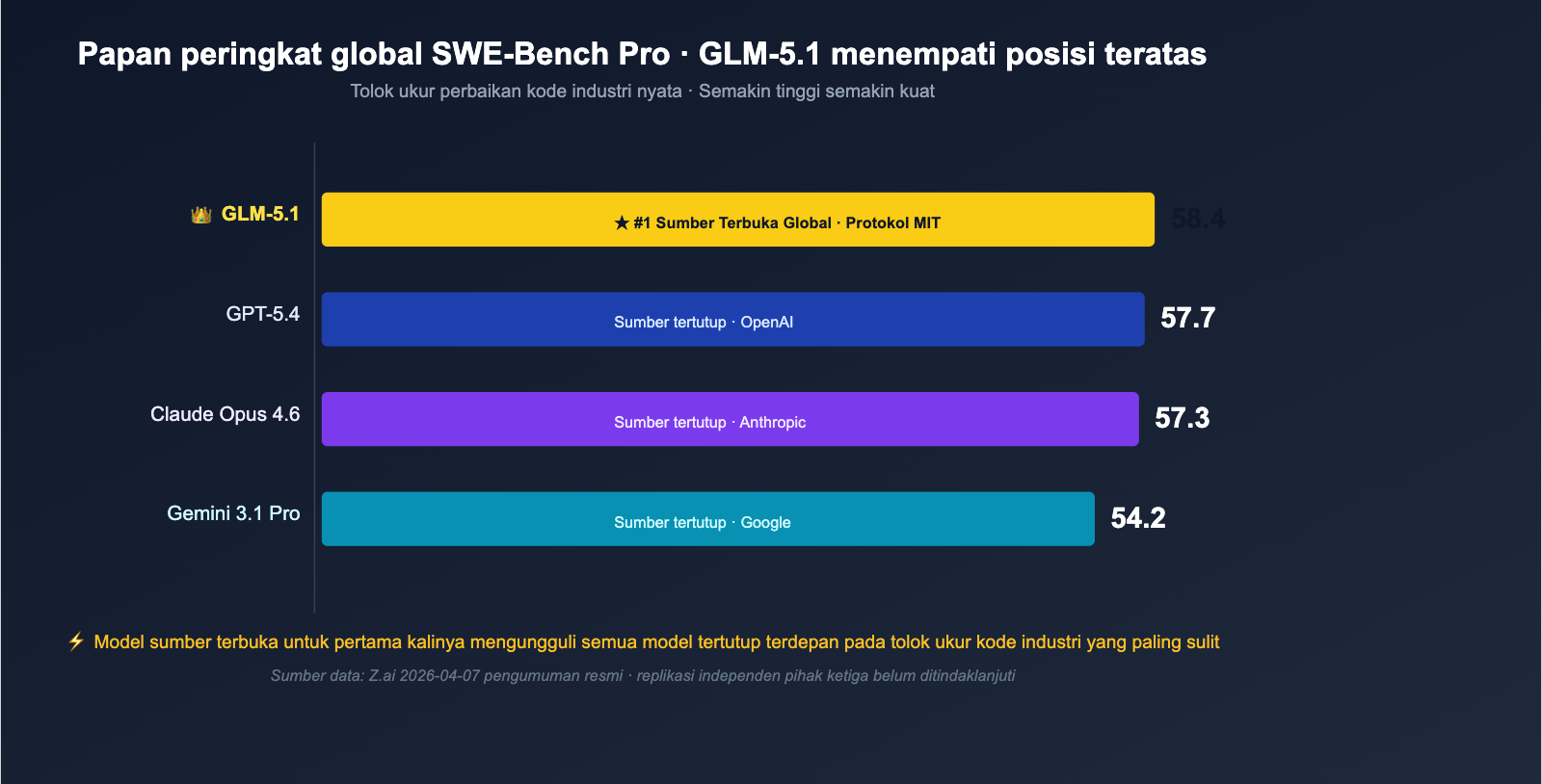

Pada 7 April 2026, Z.ai (sebelumnya dikenal sebagai Zhipu AI) secara resmi merilis bobot lengkap GLM-5.1 di bawah lisensi MIT ke repositori Hugging Face zai-org/GLM-5. Peluncuran ini langsung menggemparkan komunitas AI global—bukan sekadar karena ini adalah "satu lagi Model Bahasa Besar open-source", melainkan karena model ini berhasil menduduki peringkat pertama di dunia pada tolok ukur rekayasa perangkat lunak SWE-Bench Pro dengan skor 58,4, melampaui GPT-5.4 (57,7), Claude Opus 4.6 (57,3), dan Gemini 3.1 Pro (54,2). Ini adalah pertama kalinya model open-source berhasil mengungguli semua model tertutup terdepan dalam tolok ukur "perbaikan kode nyata" yang diakui secara luas oleh industri.

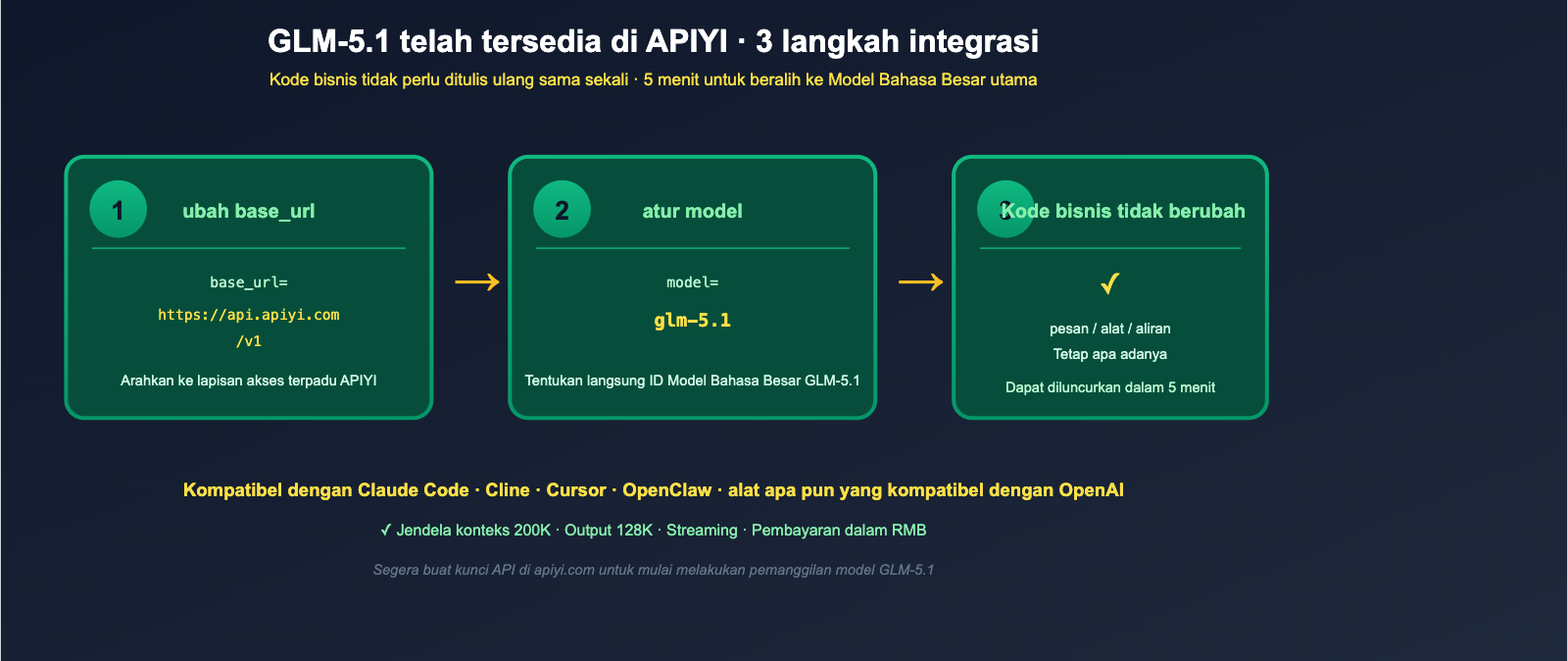

Yang lebih menarik bagi pengembang di Tiongkok adalah kecepatan peluncuran API GLM-5.1—APIYI (apiyi.com) telah menyelesaikan integrasi sejak awal. Anda tidak perlu lagi mengunduh bobot dengan parameter 754B dari Hugging Face atau mendaftar akun resmi Z.ai. Cukup gunakan SDK OpenAI yang sudah ada dan ubah base_url-nya untuk langsung melakukan pemanggilan. Artikel ini akan membahas GLM-5.1 secara lengkap dari 7 dimensi: arsitektur, tolok ukur, perangkat keras pelatihan, harga, dan metode akses, serta memberikan contoh kode minimal untuk memanggil GLM-5.1 melalui APIYI.

Sekilas Informasi Inti GLM-5.1 (Edisi April 2026)

Sebelum kita membedahnya, mari kita rangkum semua fakta kunci mengenai GLM-5.1 dalam satu tabel.

| Dimensi | Informasi GLM-5.1 |

|---|---|

| Pengembang | Z.ai (sebelumnya Zhipu AI, melantai di bursa Hong Kong Jan 2026, valuasi ~$31,3 miliar) |

| Tanggal Rilis | 7 April 2026 |

| Lisensi | MIT (mengizinkan komersial + modifikasi + turunan tertutup) |

| Alamat Repositori | huggingface.co/zai-org/GLM-5 |

| Arsitektur Model | MoE (Mixture of Experts), 754B total parameter / 40B parameter aktif |

| Jendela Konteks | 200.000 token |

| Output Maksimum | 128.000 token |

| Data Pelatihan | 28,5T token (ditingkatkan dari 23T pada GLM-5) |

| Perangkat Keras Pelatihan | Sepenuhnya menggunakan Huawei Ascend 910B + kerangka kerja MindSpore (tanpa Nvidia/AMD) |

| Kerangka Kerja Deployment | vLLM / SGLang / KTransformers |

| Kemampuan Unggulan | Pengodean Agen jangka panjang (tugas tunggal dapat bekerja terus-menerus selama ~8 jam) |

| Harga (API Langsung) | Input $1,00 / juta token, Output $3,20 / juta token |

| Paket Pengodean | Paket GLM Coding mulai dari ~$3/bulan |

| Akses APIYI | ✅ Sudah tersedia, dapat dipanggil melalui https://api.apiyi.com/v1 |

| Alat Kompatibel | Claude Code / OpenClaw / Cline / editor apa pun yang kompatibel dengan OpenAI |

🎯 Saran Memulai Cepat: GLM-5.1 telah tersedia di APIYI (apiyi.com). Anda hanya perlu mengubah

base_urlpada SDK OpenAI Anda menjadihttps://api.apiyi.com/v1danmodelmenjadi nama model GLM-5.1 yang sesuai. Anda bisa langsung mengganti model utama dalam alur kerja Agent / Cursor / Cline Anda tanpa perlu menulis ulang kode bisnis apa pun.

Mengapa GLM-5.1 Menjadi "Titik Balik Open Source"

Untuk memahami mengapa GLM-5.1 disebut sebagai "titik balik open source" oleh komunitas AI internasional, kita harus melihat beberapa fakta kunci yang menyertainya.

Pertama: Model Open Source Memuncaki SWE-Bench Pro

SWE-Bench Pro saat ini diakui sebagai salah satu tolok ukur perbaikan kode dunia nyata yang paling sulit. Semua tugas berasal dari repositori kode tingkat industri, di mana model harus memahami konteks, menemukan bug, dan menulis perbaikan yang lulus pengujian—ini bukan sekadar "menyelesaikan LeetCode". Sebelum GLM-5.1 dirilis, daftar ini hampir selalu didominasi oleh seri GPT-5.x dan Claude Opus, sementara model open source belum pernah benar-benar mendekati tiga besar.

Namun kali ini, GLM-5.1 langsung memuncaki daftar dengan skor 58,4:

| Model | Skor SWE-Bench Pro | Open Source |

|---|---|---|

| GLM-5.1 | 58,4 ⭐ | ✅ Open Source MIT |

| GPT-5.4 | 57,7 | ❌ |

| Claude Opus 4.6 | 57,3 | ❌ |

| Gemini 3.1 Pro | 54,2 | ❌ |

Ini bukan sekadar pencapaian tipis, melainkan penghapusan total kesenjangan antara "open source vs closed source" pada tolok ukur industri yang paling sulit. Meskipun ada catatan bahwa "tolok ukur ini dilaporkan sendiri oleh Z.ai dan belum diverifikasi secara independen", signifikansi industri dari peristiwa ini tidak bisa diabaikan: untuk pertama kalinya, komunitas open source memiliki model gratis yang mampu bersaing dengan model closed source terdepan dalam "perbaikan kode dunia nyata".

Kedua: Lisensi MIT yang Benar-benar Komersial

Fakta kunci lain dari GLM-5.1 adalah lisensi open source-nya—MIT, bukan Apache 2.0 yang umum, apalagi lisensi restriktif "hanya untuk riset / tidak untuk komersial". Arti dari lisensi MIT sangat lugas: siapa pun dapat mengunduh, memodifikasi, melakukan fine-tuning, menyebarkan, menggunakan secara komersial, membuat turunan tertutup, dan menjualnya tanpa batasan apa pun, selama tetap menyertakan pemberitahuan hak cipta.

Bagi pengguna perusahaan, ini berarti GLM-5.1 dapat digunakan tanpa keraguan untuk:

- Coding Agent internal untuk produk yang dikembangkan sendiri;

- Modul pembuatan/peninjauan kode dalam SaaS komersial;

- Plugin IDE yang disebarkan secara privat (on-premise);

- Skenario kepatuhan apa pun yang mengharuskan "bobot model tidak bergantung pada API vendor tertentu".

Pada April 2026, GLM-5.1 hampir menjadi satu-satunya pilihan yang mampu memenuhi kriteria "performa mutakhir + open source MIT + memuncaki tolok ukur industri" secara bersamaan.

Arsitektur dan Pelatihan GLM-5.1: 754B MoE + Huawei Full Stack

Fakta kedua yang membuat GLM-5.1 berbeda adalah tumpukan pelatihannya.

Arsitektur MoE: Total 754B Parameter / 40B Aktif

GLM-5.1 menggunakan arsitektur Mixture of Experts (MoE) dengan total 754B parameter, di mana setiap inferensi hanya mengaktifkan sekitar 40B parameter. Desain "Model Bahasa Besar + aktivasi jarang" ini telah berulang kali divalidasi oleh model open source seperti DeepSeek, Qwen, dan Mixtral, dengan manfaat utama:

- Kapasitas model besar saat pelatihan, mampu menyerap lebih banyak pengetahuan (28,5T token data pra-pelatihan);

- Hanya mengaktifkan sebagian kecil pakar saat inferensi, sehingga penggunaan VRAM dan latensi mendekati model Dense 40B;

- Tugas percakapan dan kode dapat menempuh jalur pakar yang berbeda, memberikan koherensi yang lebih baik pada tugas jangka panjang.

| Dimensi | GLM-5 (Generasi Sebelumnya) | GLM-5.1 (Saat Ini) |

|---|---|---|

| Total Parameter | 355B | 754B |

| Parameter Aktif | 32B | 40B |

| Data Pra-pelatihan | 23T token | 28,5T token |

| Jendela Konteks | Terbatas | 200K |

| Output Maksimum | Terbatas | 128K |

| Spesialisasi Coding | Ada | ✅ Ditingkatkan secara signifikan |

| Tugas Jangka Panjang Agent | Ada | ✅ Sekitar 8 jam per tugas |

Sorotan Teknikal: Agent Jangka Panjang 8 Jam

Z.ai berulang kali menekankan kemampuan "tugas tunggal 8 jam" pada GLM-5.1. Artinya: Anda dapat memberikan tugas rekayasa nyata (seperti memperbaiki bug lintas file, memigrasikan pustaka lama, atau melengkapi serangkaian pengujian) kepada GLM-5.1, dan model ini dapat terus melakukan perencanaan → eksekusi → pengujian → perbaikan → optimasi sekunder tanpa intervensi manusia hingga memberikan hasil yang siap produksi, dengan durasi proses mencapai 8 jam. Kurva kemampuan "Agent berdaya tahan tinggi" ini sebelumnya hanya terlihat stabil pada seri Claude Opus—GLM-5.1 adalah model pertama di dunia open source yang mencapai level kemampuan tersebut.

Perangkat Keras Pelatihan: Full Stack Huawei, Tanpa Chip AS

Fakta ketiga yang patut disoroti adalah perangkat keras pelatihan GLM-5.1—sepenuhnya menggunakan chip Huawei Ascend 910B + kerangka kerja MindSpore, tanpa menggunakan GPU Nvidia atau AMD sama sekali. Hal ini memicu diskusi besar di komunitas AI internasional karena membuktikan bahwa: dalam lingkungan dengan pembatasan chip Hopper/Blackwell, tim di Tiongkok mampu menyelesaikan pra-pelatihan model skala 754B MoE pada perangkat keras domestik. Ini bukan sekadar kemenangan teknis model itu sendiri, melainkan demonstrasi tingkat industri dari infrastruktur pelatihan AI di Tiongkok.

Laporan Skor Benchmark Lengkap GLM-5.1

Agar tidak ada poin data penting yang terlewat, kami telah merangkum laporan benchmark GLM-5.1 yang dirilis oleh Z.ai ke dalam tabel berikut.

| Benchmark | Skor GLM-5.1 | Arti |

|---|---|---|

| SWE-Bench Pro | 58.4 ⭐ | Perbaikan kode nyata, #1 Global (Open Source) |

| SWE-bench Verified | 77,8% | Perbaikan kode umum, mendekati ~94,6% dari Claude Opus 4.6 (80,8%) |

| CyberGym | 68,7 | Penalaran keamanan/CTF (1507 tugas) |

| MCP-Atlas | 71,8 | Benchmark pemanggilan alat MCP |

| T3-Bench | 70,6 | Penggunaan alat & tugas Agent |

| Humanity's Last Exam | 31,0 / 52,3 | Penalaran tingkat lanjut (tanpa alat / dengan alat) |

| AIME 2026 | 95,3 | Tingkat kompetisi olimpiade matematika AS |

| GPQA-Diamond | 86,2 | Penalaran ilmiah tingkat ahli |

Berikut poin-poin pentingnya:

- Sisi Pemrograman: SWE-Bench Pro telah mencapai puncak, dan SWE-bench Verified mencapai 94,6% dari kemampuan Claude Opus 4.6—artinya untuk sebagian besar tugas rekayasa sehari-hari, kemampuan pemrograman GLM-5.1 sudah setara dengan model terkuat saat ini, Claude Opus;

- Penalaran Matematika: Mencapai 95,3 pada AIME 2026 dan 86,2 pada GPQA-Diamond, yang tergolong "tingkat terdepan";

- Agent & Penggunaan Alat: MCP-Atlas 71,8 dan T3-Bench 70,6 membuktikan kemampuan tugas jangka panjangnya;

- Evaluasi Jujur: Data ini saat ini sepenuhnya berasal dari klaim Z.ai. Hingga artikel ini ditulis, belum ada pengujian pihak ketiga yang sepenuhnya independen. Gunakan data ini sebagai referensi, bukan sebagai "nilai mutlak".

🎯 Saran Validasi Benchmark: Menghadapi benchmark yang diklaim sendiri, sikap paling pragmatis adalah mencobanya langsung dengan tugas nyata bisnis Anda. GLM-5.1 sudah tersedia di APIYI apiyi.com. Anda bisa langsung menjalankan 5-10 prompt pemrograman yang paling sering digunakan tim Anda pada GLM-5.1, Claude Opus 4.6, dan GPT-5.4 untuk memvalidasi kesimpulan SWE-Bench Pro dengan data bisnis Anda sendiri.

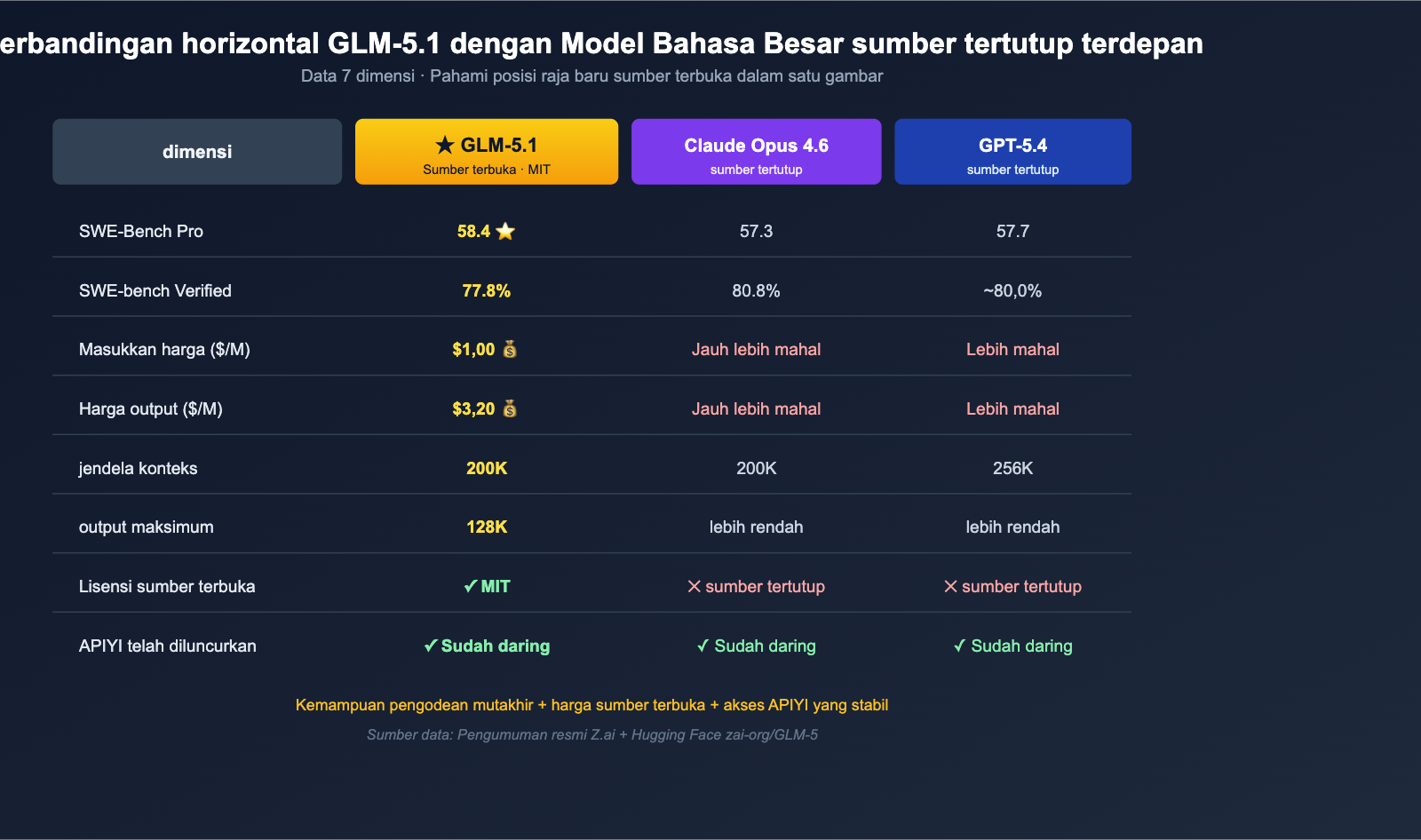

Struktur Harga GLM-5.1: Mengapa Disebut "Kuda Hitam dengan Nilai Terbaik"

Fitur lain dari GLM-5.1 yang tidak bisa diabaikan adalah harganya. Mari kita bandingkan langsung dengan model-model terdepan lainnya.

Perbandingan Harga per Token

| Model | Input ($/M) | Output ($/M) | Open Source |

|---|---|---|---|

| GLM-5.1 | $1,00 | $3,20 | ✅ MIT |

| Claude Opus 4.6 | Jauh lebih mahal | Jauh lebih mahal | ❌ |

| GPT-5.4 | Lebih mahal | Lebih mahal | ❌ |

| Gemini 3.1 Pro | Menengah | Menengah | ❌ |

Angka $1,00 / $3,20 ini termasuk harga dasar dalam kategori "model pemrograman terdepan". Dibandingkan dengan model closed-source seperti Claude Opus 4.6, harga satuan aktual GLM-5.1 hanya sebagian kecil darinya, sementara Z.ai menjadikan "94,6% performa pemrograman Claude Opus 4.6" sebagai salah satu nilai jual utamanya.

Rencana Coding GLM dan Paket Langganan

Selain penagihan per token, Z.ai juga meluncurkan GLM Coding Plan—paket tetap yang ditujukan untuk skenario "pemrograman intensif" seperti Cursor, Cline, dan Claude Code. Harga mulai dari sekitar $3/bulan, mencakup 120 prompt, jauh lebih murah daripada paket pemrograman closed-source serupa. Paket ini biasanya dipadukan dengan berbagai tingkatan (Max / Pro / Lite), sehingga dalam alur kerja "coding harian" yang sering memanggil API namun murah per pemanggilan, Anda bisa mendapatkan "kemampuan pemrograman setingkat Opus + biaya yang hampir gratis".

🎯 Saran Pemilihan Harga: Bagi tim yang ingin "menggunakan kemampuan pemrograman setingkat Claude Opus, namun tidak ingin terbebani oleh harga Opus", kami sarankan untuk langsung memanggil GLM-5.1 melalui APIYI apiyi.com: Anda bisa menikmati antarmuka terpadu dan pembayaran dalam Rupiah, serta dapat beralih antara GPT-5.4 / Claude Opus 4.6 kapan saja dalam kode bisnis yang sama untuk melakukan A/B testing, guna menentukan model mana yang paling hemat biaya berdasarkan tagihan nyata.

GLM-5.1 Kini Hadir di APIYI: Contoh Pemanggilan Minimal

Terakhir, bagian yang paling dinantikan oleh para pengembang di Indonesia—GLM-5.1 kini telah tersedia di APIYI apiyi.com. Anda bisa langsung memanggilnya menggunakan SDK OpenAI yang sudah ada, tanpa perlu repot melakukan deployment bobot 754B parameter sendiri di Hugging Face.

Contoh Minimal Python

Berikut adalah contoh pemanggilan Python paling sederhana untuk menunjukkan cara menggunakan GLM-5.1 dengan SDK resmi OpenAI:

from openai import OpenAI

# Ubah base_url ke APIYI, dan ganti api_key dengan kunci APIYI Anda

client = OpenAI(

base_url="https://api.apiyi.com/v1",

api_key="YOUR_APIYI_KEY"

)

resp = client.chat.completions.create(

model="glm-5.1", # Langsung tentukan ID model GLM-5.1

messages=[

{"role": "system", "content": "Anda adalah seorang insinyur perangkat lunak ahli."},

{"role": "user", "content": "Tuliskan cache LRU dalam Python dengan waktu kedaluwarsa dan batas kapasitas."}

],

max_tokens=4096

)

print(resp.choices[0].message.content)

Kode bisnis Anda tidak perlu diubah sama sekali—logika yang sebelumnya digunakan untuk memanggil GPT-4 / Claude / DeepSeek tetap sama saat menggunakan GLM-5.1.

Integrasi dengan Cursor / Cline / Claude Code

Pihak Z.ai telah mengonfirmasi bahwa GLM-5.1 kompatibel dengan semua alat pemrograman standar OpenAI, termasuk Claude Code, OpenClaw, dan Cline. Di alat-alat tersebut, cukup arahkan endpoint yang kompatibel dengan OpenAI ke https://api.apiyi.com/v1 dan pilih model GLM-5.1. Anda bisa beralih dari model utama seperti Opus / GPT-5 ke GLM-5.1 tanpa mengubah alur kerja apa pun. Untuk IDE seperti Cursor yang juga mendukung Custom Endpoint OpenAI, prosedurnya pun sama persis.

Contoh Pemanggilan Streaming dan Konteks Panjang

GLM-5.1 di APIYI mempertahankan jendela konteks 200K dan kemampuan output 128K secara penuh. Untuk tugas Agent jangka panjang, Anda bisa mengaktifkan mode stream agar mendapatkan latensi token pertama yang lebih rendah:

stream = client.chat.completions.create(

model="glm-5.1",

messages=[

{"role": "user", "content": "Tinjau repositori Python 5000 baris ini secara menyeluruh, sebutkan potensi bug dan saran refaktorisasi."}

],

stream=True,

max_tokens=128000

)

for chunk in stream:

delta = chunk.choices[0].delta

if delta.content:

print(delta.content, end="", flush=True)

🎯 Saran Integrasi: GLM-5.1 di APIYI apiyi.com sudah mendukung antarmuka yang kompatibel dengan OpenAI, output streaming, dan jendela konteks 200K penuh. Kami menyarankan Anda untuk segera mengarahkan alat Cursor / Cline / Claude Code tim Anda ke APIYI hari ini. Cobalah GLM-5.1 sebagai model coding utama selama seminggu dan buktikan melalui tugas teknis nyata apakah ia mampu menggantikan Opus / GPT-5 yang Anda gunakan saat ini.

Untuk Siapa GLM-5.1 Cocok (dan Tidak Cocok)

Target Pengguna

| Pengguna | Alasan Kecocokan |

|---|---|

| Pengguna berat Coding Agent | Peringkat teratas SWE-Bench Pro, mampu menangani tugas 8 jam |

| Tim dengan anggaran terbatas yang ingin model canggih | Harga $1.00/$3.20 jauh lebih murah dari Opus / GPT-5 |

| Perusahaan yang butuh deployment komersial lisensi MIT | Sepenuhnya tanpa batasan, bisa untuk komersial dan turunan tertutup |

| Pengguna Cursor / Cline / Claude Code | Kompatibel secara native dengan antarmuka OpenAI, ganti dalam sekali klik |

| Peneliti yang tertarik dengan stack pelatihan AI domestik | Dilatih sepenuhnya di Huawei Ascend 910B + MindSpore |

| Skenario penalaran matematika / sains berat | AIME 2026 95.3 / GPQA-Diamond 86.2 |

Pengguna yang Kurang Cocok

| Pengguna | Alasan |

|---|---|

| Sangat mementingkan "tolok ukur pihak ketiga independen" | Data saat ini berasal dari klaim Z.ai, perlu verifikasi mandiri |

| Tugas yang didominasi multimodal (gambar/video) | GLM-5.1 fokus pada teks dan kode, multimodal bukan keunggulan utamanya |

| Bergantung sepenuhnya pada ekosistem alat Anthropic / OpenAI | Beberapa fitur lanjutan tetap mengacu pada antarmuka asli penyedia |

FAQ Pertanyaan Umum GLM-5.1

Q1: Apakah GLM-5.1 benar-benar open source? Bisakah digunakan untuk komersial?

Ya. GLM-5.1 dirilis secara resmi oleh Z.ai pada 7 April 2026 di Hugging Face (zai-org/GLM-5) di bawah lisensi MIT. Ini mengizinkan penggunaan komersial, turunan tertutup, serta fine-tuning sekunder, selama Anda mencantumkan pernyataan hak cipta. Ini adalah salah satu lisensi open source paling longgar, yang berarti Anda dapat langsung mengintegrasikan GLM-5.1 ke dalam produk komersial, SaaS, atau deployment privat Anda tanpa perlu membayar biaya lisensi apa pun.

Q2: Apakah GLM-5.1 benar-benar lebih kuat dari GPT-5.4 dan Claude Opus 4.6?

Pada benchmark SWE-Bench Pro, skor yang diumumkan Z.ai (58,4) memang melampaui GPT-5.4 (57,7) dan Claude Opus 4.6 (57,3). Namun perlu dicatat: Data ini saat ini berasal dari klaim Z.ai dan belum sepenuhnya direplikasi oleh laboratorium pengujian pihak ketiga yang independen. Kami sarankan Anda tidak menganggap angka-angka ini sebagai "kebenaran mutlak", melainkan cobalah dengan tugas nyata bisnis Anda—hal ini sekarang bisa langsung dilakukan di GLM-5.1 melalui APIYI apiyi.com, tanpa perlu melakukan deployment sendiri.

Q3: Apakah API GLM-5.1 sudah tersedia di APIYI? Bagaimana cara memanggilnya?

Sudah tersedia. Anda hanya perlu mengubah base_url pada SDK resmi OpenAI menjadi https://api.apiyi.com/v1, ganti api_key dengan kunci API APIYI Anda, dan atur model ke ID model GLM-5.1. Anda bisa langsung melakukan pemanggilan tanpa perlu menulis ulang kode bisnis Anda. "Contoh pemanggilan minimal" dalam artikel ini memberikan versi Python, dan SDK untuk Node / Go / Rust juga dapat digunakan dengan cara yang sama.

Q4: Apakah GLM-5.1 lebih kuat daripada model open source domestik lainnya seperti DeepSeek, Qwen, atau Kimi?

Perbedaan utama GLM-5.1 terletak pada "pengodean Agent jangka panjang + posisi puncak di SWE-Bench Pro"—ini adalah arah yang belum pernah dicapai secara langsung oleh DeepSeek, Qwen, atau Kimi sebelumnya. Jika bisnis Anda berfokus pada "percakapan harian + RAG", DeepSeek dan Qwen masih sangat kompetitif. Namun, jika bisnis Anda berfokus pada Coding Agent / integrasi IDE / perbaikan kode, GLM-5.1 adalah pilihan utama di dunia open source saat ini. Di APIYI, Anda dapat memasukkan model-model ini ke dalam pengujian perbandingan yang sama dan mendapatkan penilaian Anda sendiri dalam 15 menit.

Q5: Perangkat keras apa yang dibutuhkan untuk deployment lokal GLM-5.1?

GLM-5.1 adalah arsitektur MoE dengan total 754B parameter / 40B aktif. Deployment lokal memerlukan klaster GPU multi-kartu tingkat profesional, yang hampir tidak realistis bagi tim biasa. Z.ai secara resmi merekomendasikan penggunaan vLLM / SGLang / KTransformers untuk deployment layanan inferensi skala besar. Jika Anda hanya ingin menggunakan GLM-5.1 dan bukan menelitinya, cara paling efisien adalah langsung memanggilnya melalui APIYI apiyi.com — tidak perlu GPU, tidak perlu pemeliharaan, dan bayar sesuai penggunaan.

Q6: Apakah benar pelatihan GLM-5.1 tidak menggunakan GPU Nvidia?

Ya. Z.ai mengungkapkan secara terbuka bahwa GLM-5.1 sepenuhnya dilatih menggunakan chip Huawei Ascend 910B + framework MindSpore, tanpa menggunakan GPU Nvidia / AMD apa pun. Ini adalah kasus pertama di bidang model bahasa besar open source tahun 2026 yang berhasil menyelesaikan pelatihan "model besar MoE 754B + perangkat keras domestik" secara terbuka, yang memiliki makna simbolis industri yang signifikan.

Kesimpulan: GLM-5.1 adalah Titik Balik AI Open Source Tahun 2026

Setelah menghubungkan arsitektur, benchmark, harga, tumpukan pelatihan, dan jalur akses API, posisi GLM-5.1 pada titik waktu April 2026 sudah sangat jelas: Ini bukan sekadar peningkatan model open source biasa, melainkan peristiwa penting di mana "open source benar-benar mampu mengalahkan model tertutup terdepan". Peringkat pertama global SWE-Bench Pro 58,4, keterbukaan penuh lisensi MIT, harga sangat rendah $1,00/$3,20, konteks 200K + output 128K, kemampuan Agent jangka panjang 8 jam, serta tumpukan pelatihan Huawei Ascend 910B—fakta-fakta ini masing-masing layak untuk dijadikan berita, dan jika digabungkan, itu menjadi "titik balik open source".

Kabar yang lebih baik bagi pengembang di Indonesia adalah API GLM-5.1 telah tersedia di APIYI: Anda tidak perlu melakukan deployment bobot 754B sendiri, tidak perlu kartu kredit luar negeri, dan tidak perlu menunggu persetujuan apa pun. Cukup ubah base_url menjadi https://api.apiyi.com/v1 dan ubah model menjadi GLM-5.1, hari ini Anda sudah bisa mengganti model pengodean utama di Cursor / Cline / Claude Code dengan raja open source baru ini. Jika Anda masih pusing dengan tagihan Opus / GPT-5, ini adalah jendela kesempatan yang sangat layak untuk diuji selama satu sore.

🎯 Saran Akhir: Jika ingin merasakan "kemampuan pengodean terdepan + harga open source + akses stabil APIYI" dari GLM-5.1 sesegera mungkin, kami sarankan Anda membuat kunci API di apiyi.com hari ini, ubah

base_urlSDK OpenAI Anda menjadihttps://api.apiyi.com/v1, ubahmodelmenjadi GLM-5.1, dan jalankan tugas kode harian tim Anda selama seminggu. Terlepas dari apakah Anda akhirnya memutuskan untuk beralih ke model utama, pengujian langsung selama seminggu ini akan memberi Anda pemahaman tangan pertama tentang tingkat nyata AI open source tahun 2026.

Penulis: Tim APIYI | Fokus pada penerapan Model Bahasa Besar AI dan ekosistem open source. Untuk praktik penggunaan dan perbandingan GLM-5.1 / Claude / GPT-5 lainnya, silakan kunjungi APIYI apiyi.com.