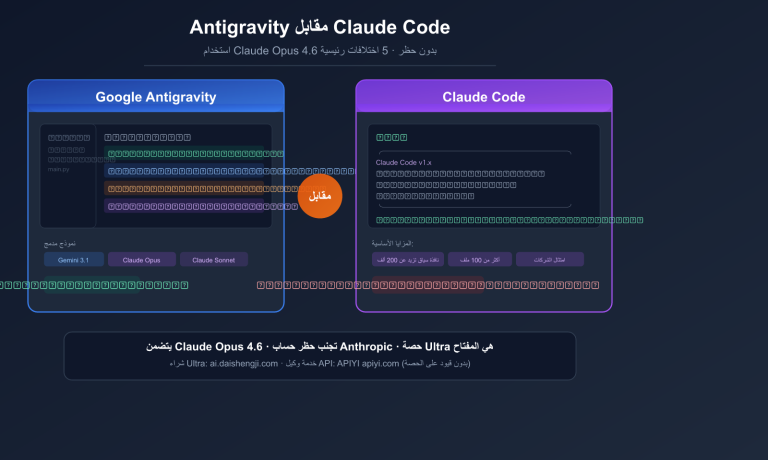

تُعد كل من LiteLLM و Claude Code من أكثر أدوات تطوير الذكاء الاصطناعي رواجاً في الفترة 2025-2026، وغالباً ما يضع المطورون مقارنة بينهما: أيهما أفضل؟ وهل يمكن لأحدهما أن يحل محل الآخر؟ وهل تدعم LiteLLM حقاً فوترة التخزين المؤقت للموجه (prompt caching)؟ في هذا المقال، نقارن بين LiteLLM و Claude Code، ونقدم نصائح واضحة بناءً على ثلاثة أبعاد: التموضع، حدود القدرات، ودعم فوترة التخزين المؤقت.

القيمة الجوهرية: بعد قراءة هذا المقال، ستعرف بوضوح ما إذا كان عليك الاختيار بينهما حقاً، وكيف تتخذ القرار الأمثل في سيناريوهات مختلفة.

نظرة سريعة على الاختلافات الجوهرية بين LiteLLM و Claude Code

يعتبر الكثيرون LiteLLM و Claude Code منافسين، لكن في الواقع تموضعهما مختلف تماماً، بل ويمكن استخدامهما معاً. إليك الفرق الجوهري في جملة واحدة:

- LiteLLM = بوابة نماذج لغة كبيرة (LLM Gateway) / طبقة وسيطة، تتيح لك استدعاء أكثر من 100 نموذج برمجياً.

- Claude Code = أداة سطر أوامر (CLI) للبرمجة الوكيلة من Anthropic، تركز على "استخدام Claude لتعديل مستودع الأكواد الخاص بك".

| أبعاد المقارنة | LiteLLM | Claude Code |

|---|---|---|

| شكل المنتج | حزمة Python + خادم وكيل | أداة سطر أوامر (CLI) |

| التموضع الجوهري | بوابة نماذج لغة كبيرة عامة / توجيه النماذج | مساعد برمجة وكيل |

| دعم النماذج | 100+ (OpenAI/Anthropic/Gemini/Bedrock/Vertex إلخ) | سلسلة Claude فقط افتراضياً |

| المستخدم النموذجي | مهندسو المنصات، مطورو تطبيقات الذكاء الاصطناعي | المطورون الأفراد، سيناريوهات البرمجة |

| هل هو مفتوح المصدر | ✅ نعم (BerriAI/litellm) | ❌ لا (CLI مغلق المصدر) |

| هل يمكن استبدال أحدهما بالآخر | ❌ لا | ❌ لا |

| هل يمكن استخدامهما معاً | ✅ نعم (LiteLLM خلف Claude Code) | ✅ نعم (Claude Code مع LiteLLM) |

| أفضل شريك | مع APIYI apiyi.com لتوفير وسيط مستقر | مع LiteLLM لتبديل النماذج الأساسية |

💡 خلاصة سريعة: إذا كنت تتساءل "أيهما أفضل"، فالأرجح أنك بحاجة إلى استخدام كليهما؛ حيث يعمل Claude Code كوكيل للبرمجة، وLiteLLM كبوابة موحدة، ثم الاتصال بالنماذج العالمية عبر APIYI apiyi.com. هذا هو التوجه الأكثر شيوعاً في عام 2026.

الفروقات الجوهرية الخمسة بين LiteLLM و Claude Code

الفرق 1: التموضع مختلف تماماً (بوابة API مقابل واجهة سطر أوامر للوكيل)

تموضع LiteLLM: هي بوابة (Gateway) مفتوحة المصدر لنماذج اللغة الكبيرة، تهدف إلى "استدعاء أي نموذج باستخدام تنسيق متوافق مع OpenAI". وتأتي في شكلين:

- مكتبة Python:

litellm.completion(model="...")، لاستخدامها من قبل المطورين في تطبيقاتهم. - خادم وكيل (Proxy):

litellm --config config.yaml، حيث يتم تشغيله كخدمة مستقلة لمشاركتها بين أعضاء الفريق.

تموضع Claude Code: هي واجهة سطر أوامر (CLI) برمجية ذكية (Agentic) أطلقتها Anthropic رسمياً، تهدف إلى "تمكين Claude من قراءة الكود الخاص بك، وتعديله، وتنفيذ الأوامر مباشرة داخل الطرفية (Terminal)". إنه منتج على مستوى التطبيق، يعتمد في عمله على استدعاء واجهة برمجة تطبيقات الرسائل (Messages API) الخاصة بـ Anthropic.

باختصار: LiteLLM هو "أنبوب المياه"، بينما Claude Code هو "الصنبور المثبت على هذا الأنبوب".

الفرق 2: نطاق النماذج المدعومة

| البعد | LiteLLM | Claude Code |

|---|---|---|

| الدعم الافتراضي | OpenAI, Anthropic, Google, Cohere, Bedrock, Azure, HuggingFace, Ollama, vLLM وأكثر من 100 نموذج آخر | سلسلة Anthropic Claude فقط (Opus / Sonnet / Haiku) |

| نقاط النهاية المخصصة | ✅ أي نقطة نهاية متوافقة مع OpenAI | ⚠️ عبر ربط ANTHROPIC_BASE_URL بـ LiteLLM |

| النماذج المحلية | ✅ DeepSeek / Qwen / Kimi / GLM وغيرها | ❌ غير مدعومة افتراضياً |

لاحظ أنه يمكن لـ Claude Code استخدام نماذج أخرى "بشكل غير مباشر" عن طريق توجيه ANTHROPIC_BASE_URL إلى خادم LiteLLM Proxy، ولكن في جوهر الأمر، LiteLLM هو من يقوم بعملية الترجمة هنا، وهذا يثبت أن العلاقة بينهما تكاملية.

الفرق 3: واجهة الاستخدام وتجربة التطوير

تجربة تطوير LiteLLM:

- مكتبة برمجية (SDK) مخصصة لمطوري التطبيقات.

- يمكن دمجها في أي مشروع Python.

- توفر نقاط نهاية HTTP متوافقة مع OpenAI للاستخدام في الواجهات الأمامية، Node.js، أو عبر Curl.

تجربة تطوير Claude Code:

- واجهة سطر أوامر (CLI) مستقلة، تشبه أمر

claude. - تتيح لك التحدث مع مستودع الكود الخاص بك مباشرة من الطرفية.

- تأتي مع أدوات مدمجة لقراءة وكتابة الملفات، تنفيذ أوامر Bash، والتعامل مع Git.

- تجربة محسنة لاستخدام الأدوات (Tool Use)، حيث يقوم الوكيل بـ "التفكير والتعديل في آن واحد".

الفرق 4: تكاليف النشر والتشغيل

| المشروع | LiteLLM | Claude Code |

|---|---|---|

| التثبيت | pip install litellm |

npm i -g @anthropic-ai/claude-code |

| هل يحتاج لخدمة؟ | نعم في وضع Proxy | لا، يعمل كـ CLI محلي |

| هل يحتاج إعداد YAML؟ | نعم في وضع Proxy | لا يحتاج عادةً |

| المشاركة الجماعية | ✅ خدمة Proxy واحدة للفريق | ❌ نسخة CLI لكل مستخدم |

| مركزية الفواتير | ✅ فواتير موحدة على مستوى البوابة | ❌ فواتير منفصلة لكل حساب |

الفرق 5: النظام البيئي وقدرات التوسع

النظام البيئي لـ LiteLLM:

- التسجيل (Logging): Langfuse, Helicone, Sentry, OpenTelemetry.

- حواجز الحماية (Guardrails): فحص المحتوى مدمج.

- التوجيه (Routing): موازنة الأحمال، التراجع (Fallback)، وتحديد معدل الاستخدام.

- تتبع التكاليف: على مستوى النماذج، المستخدمين، والمفاتيح.

النظام البيئي لـ Claude Code:

- الخطافات (Hooks): أوامر مخصصة.

- بروتوكول سياق النموذج (MCP): للاتصال بأدوات خارجية.

- التكامل مع بيئات التطوير (IDE): VS Code, JetBrains.

- ارتباط وثيق بقدرات استدعاء الأدوات الخاصة بـ Anthropic.

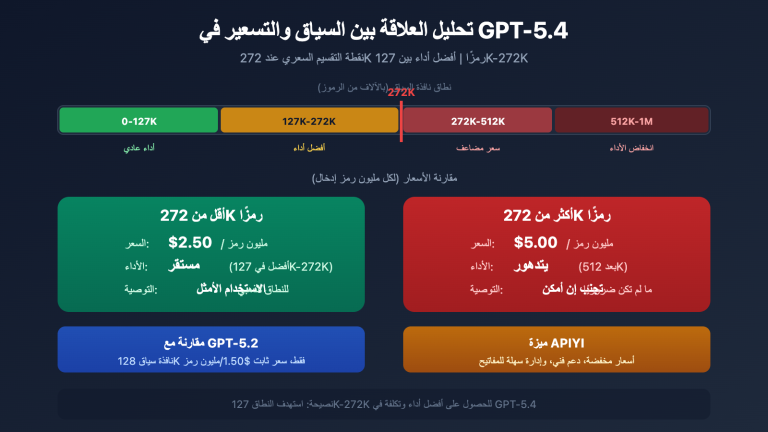

هل يدعم LiteLLM فوترة التخزين المؤقت للموجه (Prompt Caching)؟

هذا أحد أكثر الأسئلة التي تهم المطورين. الخلاصة المباشرة: نعم، وهو مدعوم كأولوية قصوى.

مصفوفة الدعم

توضح وثائق LiteLLM الرسمية أن التخزين المؤقت للموجه (Prompt Caching) مدعوم أصلياً لدى 6 مزودين رئيسيين:

| المزود | بادئة LiteLLM | طريقة تفعيل التخزين المؤقت | ميزة السعر |

|---|---|---|---|

| Anthropic | anthropic/ |

صريح cache_control: {"type": "ephemeral"} |

الكتابة 1.25x، القراءة 0.1x (خصم 90%) |

| OpenAI | openai/ |

تخزين مؤقت تلقائي (>1024 توكن) | خصم تلقائي 50% |

| Google AI Studio | gemini/ |

صريح cache_control |

تحويل تلقائي إلى Context Caching API |

| Vertex AI | vertex_ai/ |

صريح cache_control |

كما سبق |

| Bedrock | bedrock/ |

متاح إذا كان النموذج يدعمه | يتبع تسعير النموذج |

| DeepSeek | deepseek/ |

تخزين مؤقت تلقائي | خصم تلقائي |

مثال برمجي: التخزين المؤقت لـ Anthropic

import litellm

response = litellm.completion(

model="anthropic/claude-opus-4-6",

messages=[

{

"role": "system",

"content": [

{

"type": "text",

"text": "أنت مهندس بايثون خبير... (موجه نظام طويل)",

"cache_control": {"type": "ephemeral"}, # هام: تحديد الجزء المراد تخزينه

}

],

},

{"role": "user", "content": "يرجى مراجعة هذا الكود"},

],

)

# يمكن رؤية استخدام التخزين المؤقت في response.usage

print(response.usage)

# {

# "prompt_tokens": 1234,

# "cache_creation_input_tokens": 800, # عدد التوكنز المكتوبة في التخزين

# "cache_read_input_tokens": 0, # في الاستدعاء الثاني ستصبح 800

# "completion_tokens": 256,

# }

🎯 نصيحة عملية: يعد التخزين المؤقت للموجه في Anthropic فعالاً للغاية في سيناريوهات موجه النظام الطويل والسياق المتكرر — حيث تبلغ تكلفة قراءة التخزين 10% فقط من السعر الأصلي. ننصح بتفعيله افتراضياً في الوكلاء (Agents) ذوي العمليات الطويلة، وفي عمليات الاسترجاع المعزز (RAG)، ومراجعة الكود. إذا كنت ترغب في استدعاء Claude Opus 4.6 / Sonnet 4.6 بثبات داخل الدولة والاستمتاع بخصومات التخزين المؤقت، يمكنك الربط عبر APIYI (apiyi.com)، حيث تقوم المنصة بتمرير حقول الاستخدام المتعلقة بالتخزين المؤقت بالكامل.

التحكم التلقائي في التخزين المؤقت (Auto-Inject Cache Control)

إذا كنت لا ترغب في إضافة cache_control يدوياً لكل رسالة، يوفر LiteLLM ميزة الحقن التلقائي:

response = litellm.completion(

model="anthropic/claude-opus-4-6",

messages=[...],

cache_control_injection_points=[

{"location": "message", "role": "system"} # إضافة التخزين المؤقت تلقائياً لجميع رسائل النظام

],

)

هذا الخيار مناسب جداً لتحديث الكود القديم — حيث يمكنك الاستمتاع بخصم 90% دون الحاجة لتعديل هيكلية الرسائل (messages).

"فخاخ" وواقع فوترة التخزين المؤقت

في بدايات LiteLLM (عام 2024)، كان هناك خطأ تقني (GitHub Issue #5443): لم تكن عملية تتبع التكلفة تميز بشكل صحيح بين cache_creation_input_tokens و cache_read_input_tokens، مما أدى إلى انحراف في الفوترة. ولكن في إصدارات 2025-2026، تم إصلاح ذلك رسمياً. حالياً، يقوم LiteLLM بالفوترة في دالة completion_cost() وفقاً للقواعد التالية:

| نوع التوكن | مضاعف السعر (نسبة إلى سعر الإدخال) | ملاحظات |

|---|---|---|

| كتابة التخزين (Cache Write) | 1.25x | توجد تكلفة إضافية بسيطة للكتابة |

| قراءة التخزين (Cache Read) | 0.1x | القراءة تتطلب 10% فقط من السعر |

| الإدخال العادي (Input) | 1.0x | الإدخال القياسي |

| المخرجات (Output) | يحددها النموذج | توكنز المخرجات |

🛡️ تنبيه هام: إذا كنت تستخدم خدمة وكيل API، يرجى التأكد من أنها تمرر حقول

cache_creation_input_tokensوcache_read_input_tokensبالكامل، وإلا سيقوم LiteLLM بحساب التكلفة بناءً على الإدخال العادي. تدعم منصة APIYI (apiyi.com) تمرير هذه الحقول بالكامل، مما يضمن لك الحصول على خصومات التخزين المؤقت الحقيقية عند استخدامها مع LiteLLM.

توصيات السيناريوهات: متى تستخدم LiteLLM ومتى تستخدم Claude Code

السيناريو 1: مطور فردي، التركيز على البرمجة

التوصية: استخدم Claude Code مباشرة.

السبب بسيط؛ تجربة Claude في البرمجة لا تزال في الصدارة حالياً، حيث يتميز باستخدامه الفعال للأدوات (Tool Use)، ودقة تعديلات الملفات، وإدارة ممتازة لنافذة السياق. إذا كنت تعمل بمفردك ولا تحتاج إلى التبديل بين نماذج مختلفة، فإن Claude Code هو الخيار الأكثر راحة. وإذا واجهت صعوبة في الوصول إلى خدمات Anthropic الرسمية، يمكنك توجيه ANTHROPIC_BASE_URL إلى خدمة وكيل API من APIYI (apiyi.com)، وستحصل على نفس التجربة تماماً.

السيناريو 2: فريق يبني تطبيقاً يعتمد على الذكاء الاصطناعي

التوصية: استخدام LiteLLM Proxy + كود التطبيق الخاص بك.

السبب: ما تحتاجه هو "فوترة موحدة + توجيه بين نماذج متعددة + خاصية التبديل الاحتياطي (Fallback)"، وهي القدرات الجوهرية لـ LiteLLM Proxy. أما Claude Code فهو أداة سطر أوامر (CLI) ولا يمكنه القيام بدور بوابة (Gateway) على مستوى التطبيق.

أفضل الممارسات:

- قم بتشغيل خدمة مستقلة لـ LiteLLM Proxy (على المنفذ 4000).

- اربط جميع النماذج الأساسية عبر خدمة APIYI (apiyi.com).

- اجعل طبقة التطبيق تستدعي LiteLLM Proxy فقط، حيث ستتعامل مع أسماء نماذج دلالية موحدة.

السيناريو 3: تريد تجربة Claude Code مع إمكانية تبديل النماذج

التوصية: الجمع بين Claude Code و LiteLLM.

هذا هو المزيج الأقوى، والإعداد بسيط للغاية:

# تشغيل LiteLLM Proxy (مع توجيهه لعدة نماذج)

litellm --config litellm_config.yaml --port 4000

# جعل Claude Code يعمل عبر LiteLLM

export ANTHROPIC_BASE_URL=http://localhost:4000

export ANTHROPIC_AUTH_TOKEN=sk-litellm-master-xxxx

# تشغيل Claude Code باستخدام أي نموذج

claude --model claude-opus-4-6

claude --model gpt-5 # نفس الـ CLI، لكن في الخلفية يعمل GPT-5

claude --model gemini-3-pro # نفس الـ CLI، لكن في الخلفية يعمل Gemini 3 Pro

💡 قيمة هذا المزيج: يوفر Claude Code تجربة وكيل برمجة (Coding Agent) من الطراز الأول، بينما يمنحك LiteLLM حرية اختيار النموذج، وتوفر APIYI (apiyi.com) استقراراً في الوصول للخدمات. كل طرف يقوم بدوره دون تداخل، مما يجعله الحل الأكثر عملية لـ "البرمجة بالذكاء الاصطناعي الكامل" في عام 2026.

السيناريو 4: النشر في بيئة الإنتاج للمؤسسات

التوصية: LiteLLM Proxy + Langfuse + APIYI.

في بيئة المؤسسات، يُستخدم Claude Code كأداة محلية للمطورين فقط، أما حركة بيانات الإنتاج الحقيقية فتحتاج إلى:

- LiteLLM Proxy للعمل كبوابة (Gateway) + تحديد معدل الاستخدام + التبديل الاحتياطي.

- Langfuse أو Helicone لتسجيل البيانات (Logging) وتحليل التكاليف.

- APIYI (apiyi.com) لضمان الوصول للنماذج الأساسية واستقرار الخدمة.

نصائح لاتخاذ القرار: LiteLLM مقابل Claude Code

يمكن لهذا الجدول مساعدتك في اتخاذ قرارك خلال 30 ثانية فقط.

| احتياجاتك | الحل الموصى به |

|---|---|

| أريد أن يقوم الذكاء الاصطناعي بتعديل الكود في الطرفية (Terminal) | Claude Code |

| أريد استدعاء نماذج متعددة داخل تطبيق Python | LiteLLM SDK |

| يحتاج فريقي إلى بوابة موحدة لنماذج اللغة الكبيرة (LLM) | LiteLLM Proxy |

| أريد تغيير النموذج الأساسي لـ Claude Code | Claude Code + LiteLLM |

| أريد بناء بوابة LLM بمستوى إنتاجي | LiteLLM Proxy + مراقبة |

| الوصول إلى النماذج الخارجية غير مستقر في الصين | أي خيار + خدمة وكيل APIYI (apiyi.com) |

| أريد توفير تكاليف الـ Tokens الخاصة بـ Anthropic | LiteLLM + التخزين المؤقت للموجه (prompt caching) |

🚀 نصيحة موحدة: بغض النظر عن الأداة التي تختارها، فإن استخدام خدمة وكيل APIYI (apiyi.com) كطبقة أساسية هو الخيار الأكثر استقراراً. يمكن لـ LiteLLM التوجيه مباشرة إلى

apiyi.com/v1عبرapi_base، بينما يمكن لـ Claude Code المرور عبر LiteLLM باستخدامANTHROPIC_BASE_URLوصولاً إلى APIYI. كلاهما مساران تم التحقق من استقرارهما وكفاءتهما من قبل العديد من المطورين.

الأسئلة الشائعة حول LiteLLM و Claude Code

س1: هل يمكن لـ LiteLLM استبدال Claude Code بالكامل؟

لا. LiteLLM هي بوابة لـ LLM، ولا تحتوي على سلسلة أدوات الوكيل (Agent) التي يمتلكها Claude Code مثل "قراءة مستودع الكود + تعديل الملفات ذاتياً + تشغيل أوامر Bash". كلاهما يحل مشاكل في مستويات مختلفة؛ استخدام LiteLLM لاستبدال Claude Code يشبه استخدام "مصنع أنابيب مياه" لاستبدال "ماكينة قهوة".

س2: هل يمكن لـ Claude Code استبدال LiteLLM بالكامل؟

لا أيضاً. Claude Code هي أداة CLI وليست بوابة. فهي لا تمتلك مفاهيم طبقة البوابة مثل model_list أو router_settings أو fallbacks (النماذج الاحتياطية)، ولا يمكن استدعاؤها مباشرة من تطبيق Python أو خدمة الويب الخاصة بك. إذا كنت ترغب في "دمج الذكاء الاصطناعي في مستوى التطبيق"، فلن يساعدك Claude Code في ذلك.

س3: هل يدعم LiteLLM فعلياً محاسبة التخزين المؤقت للموجه (prompt caching) من Anthropic؟

نعم. بدءاً من عام 2025، يدعم LiteLLM بشكل كامل cache_control: {"type": "ephemeral"}، والحقن التلقائي لنقاط التخزين المؤقت cache_control_injection_points، بالإضافة إلى تمرير بيانات الاستخدام cache_creation_input_tokens / cache_read_input_tokens وحساب التكلفة عبر completion_cost(). تم إصلاح خطأ حساب التكلفة الذي ذُكر سابقاً في Issue #5443، ويمكنك استخدامه بثقة في الإصدار الحالي.

س4: كم يمكنني توفير المال عند استخدام التخزين المؤقت لـ Anthropic عبر LiteLLM؟

يمكنك توفير ما يصل إلى ~90%. قواعد أسعار التخزين المؤقت للموجه من Anthropic هي: سعر كتابة الذاكرة المؤقتة (cache write) يعادل تقريباً 1.25 ضعف المدخلات القياسية، بينما سعر قراءة الذاكرة المؤقتة (cache read) يعادل تقريباً 0.1 ضعف المدخلات القياسية. في سيناريوهات استخدام الموجه النظامي (system prompt) الطويل والمتكرر (مثل RAG، مراجعة الكود، والوكلاء ذوي المسارات الطويلة)، عادة ما تتراوح التوفيرات الفعلية بين 50% و90%. إذا قمت بالاتصال عبر APIYI (apiyi.com)، فسيتم عكس خصم التخزين المؤقت هذا بالكامل في فاتورتك.

س5: هل ستنخفض الجودة عند استخدام Claude Code مع GPT-5 عبر LiteLLM؟

ستكون هناك اختلافات، لكن ليس بالضرورة أن تكون أسوأ. تم تحسين موجهات استخدام الأدوات (Tool Use) في Claude Code خصيصاً لـ Claude، لذا قد يختلف أسلوب استدعاء الوظائف وإجراءات تعديل الملفات قليلاً عند التبديل إلى GPT-5. نوصي باستخدام نماذج عائلة Claude كنموذج أساسي، واستخدام النماذج الأخرى كبديل "للإلهام/المقارنة". يمكن لآلية الـ Fallback في LiteLLM أن تجعلك تنتقل تلقائياً إلى GPT-5 عند حدوث قيود على معدل الاستخدام (Rate Limit) في Claude.

س6: كيف يمكن للمطورين في الصين استخدام Claude Code + LiteLLM + Anthropic Caching بشكل جيد معاً؟

الحل الأكثر واقعية هو هيكل من ثلاث طبقات: Claude Code (CLI) ← LiteLLM Proxy (المنفذ المحلي 4000) ← APIYI (apiyi.com) (وكيل). يقوم Claude Code بتوجيه ANTHROPIC_BASE_URL إلى LiteLLM، ويقوم LiteLLM في ملف YAML بضبط النموذج على anthropic/claude-opus-4-6 مع توجيه api_base إلى apiyi.com/v1. بهذه الطريقة، يمكنك الاستمتاع بتجربة البرمجة مع Claude Code، والاستفادة من قدرات التوجيه في LiteLLM، وحل مشاكل الشبكة والمحاسبة عبر APIYI، مع الاحتفاظ الكامل بخصومات التخزين المؤقت للموجه.

ملخص

إن LiteLLM و Claude Code ليسا منتجين متنافسين، بل هما أداتان تقعان في مستويين مختلفين من التجريد: "طبقة البوابة" (Gateway Layer) و"طبقة التطبيق" (Application Layer). لذا، فإن محاولة الاختيار بينهما هي مسألة مغلوطة، والسؤال الصحيح هو: ما هو المزيج المناسب لسيناريو عملك؟

بالعودة إلى السؤالين اللذين طرحناهما في بداية المقال:

- أيهما أفضل للاستخدام؟ — يعتمد ذلك على السيناريو. استخدم Claude Code للبرمجة الشخصية، وLiteLLM لتطوير التطبيقات، أما إذا كنت بحاجة إلى كليهما، فاستخدم مزيج Claude Code + LiteLLM.

- هل يدعم LiteLLM محاسبة التخزين المؤقت (Caching)؟ — نعم، يدعمها بشكل كامل، وتغطي 6 مزودين رئيسيين: Anthropic وOpenAI وGemini وVertex وBedrock وDeepSeek، مما يتيح توفيرًا في تكاليف رموز الإدخال (Input Tokens) يصل إلى 90%.

🚀 اقتراح عملي: إذا كنت ترغب اليوم في بناء سير عمل متكامل يعتمد على "Claude Code + LiteLLM + Caching"، فإن أسرع مسار هو: الخطوة الأولى، التسجيل في APIYI عبر apiyi.com والحصول على مفتاح API؛ الخطوة الثانية، إعداد وكيل محلي (Local Proxy) باستخدام LiteLLM، وتوجيه

api_baseإلىapiyi.com/v1؛ الخطوة الثالثة، ضبطANTHROPIC_BASE_URLفي Claude Code ليشير إلى LiteLLM المحلي. يمكنك تشغيل هذه السلسلة بالكامل في أقل من 10 دقائق، والاستمتاع فورًا بمزايا التكلفة التي يوفرها التخزين المؤقت للموجهات (Prompt Caching).

المؤلف: فريق APIYI — متخصصون في توفير وصول مستقر للمطورين إلى نماذج اللغة الكبيرة الرائدة. تفضل بزيارة apiyi.com لمعرفة المزيد.

المراجع

-

وثائق LiteLLM الرسمية – التخزين المؤقت للموجهات (Prompt Caching)

- الرابط:

docs.litellm.ai/docs/completion/prompt_caching - الوصف: مصفوفة دعم التخزين المؤقت لـ 6 مزودين رئيسيين مع أمثلة برمجية.

- الرابط:

-

وثائق LiteLLM الرسمية – الحقن التلقائي للتخزين المؤقت (Auto-Inject Cache)

- الرابط:

docs.litellm.ai/docs/tutorials/prompt_caching - الوصف: شرح نقاط حقن التحكم في التخزين المؤقت

cache_control_injection_points.

- الرابط:

-

وثائق LiteLLM الرسمية – دليل البدء السريع لـ Claude Code

- الرابط:

docs.litellm.ai/docs/tutorials/claude_responses_api - الوصف: إعداد

ANTHROPIC_BASE_URLودعم نافذة السياق بحجم 1 مليون رمز.

- الرابط:

-

وثائق LiteLLM الرسمية – مزود Anthropic

- الرابط:

docs.litellm.ai/docs/providers/anthropic - الوصف: شرح حقول

cache_creation_input_tokensوcache_read_input_tokens.

- الرابط:

-

GitHub Issue #5443 – حساب تكلفة التخزين المؤقت

- الرابط:

github.com/BerriAI/litellm/issues/5443 - الوصف: سجل الأخطاء السابقة في حساب تكاليف التخزين المؤقت وتاريخ إصلاحها.

- الرابط:

-

مستودع LiteLLM الرئيسي على GitHub

- الرابط:

github.com/BerriAI/litellm - الوصف: الكود المصدري، تتبع المشكلات (Issues)، وأحدث الإصدارات.

- الرابط: