作者注:深度解析 MiniMax-M2.7 與 M2.7-highspeed 兩款模型的核心能力、性能基準和 API 接入方式,幫助開發者以極低成本獲得旗艦級 AI 能力

MiniMax 於 2026 年 3 月 18 日發佈了 MiniMax-M2.7 旗艦大模型,這是首個深度參與自身進化過程的 AI 模型。僅用 10B 激活參數就達到了與 Claude Opus 4.6、GPT-5 同級的 Tier-1 性能,同時價格低至主流旗艦的 1/50。同步推出的 MiniMax-M2.7-highspeed 版本更將輸出速度提升 66%,達到 100 tps。

核心價值: 通過真實基準數據和接入教程,幫你判斷 MiniMax-M2.7 是否是當前性價比最高的旗艦模型選擇。

<!– SVG_COVER: 文章封面圖 – 展示 MiniMax-M2.7 的核心賣點:10B參數、旗艦性能、極低價格 –>

MiniMax-M2.7 核心要點

| 要點 | 說明 | 價值 |

|---|---|---|

| 230B 總參數 / 10B 激活 | 稀疏混合專家架構(MoE),每次推理僅激活 10B 參數 | 旗艦性能 + 極低推理成本 |

| 遞歸自進化訓練 | 模型自主運行 100+ 輪迭代優化自身訓練流程 | 無需人工干預即可提升 30% 性能 |

| SWE-bench 78% | 軟件工程基準大幅領先 Opus 4.6 的 55% | 編程和工程任務首選 |

| 價格僅爲 Opus 的 1/50 | 輸入 $0.30/M,輸出 $1.20/M tokens | 企業級大規模部署成本驟降 |

MiniMax-M2.7 技術架構詳解

MiniMax-M2.7 採用稀疏混合專家(Sparse Mixture-of-Experts)Transformer 架構,總參數量達到 230B,但每個 Token 僅激活 10B 參數。這一設計讓 M2.7 成爲同性能級別中體積最小的模型——用最低的計算資源實現了與 Claude Opus 4.6、GPT-5 同級別的 Tier-1 表現。

上下文窗口達到 205K tokens(約 307 頁 A4 文檔),支持長文檔分析、大型代碼庫理解等場景。在 Artificial Analysis Intelligence Index 評測中,M2.7 以滿分 50 分位列 136 個同級模型第一。

MiniMax-M2.7 遞歸自進化機制

"遞歸自進化"是 M2.7 最具突破性的技術亮點。模型在訓練過程中自主執行了一個完整的迭代循環:分析失敗軌跡 → 規劃修改 → 修改訓練腳手架代碼 → 運行評估 → 對比結果 → 決定保留或回退。這個過程完全自主運行了 100+ 輪。

其核心組件"Agentic Researcher"承擔了 30-50% 的強化學習工作流,包括日誌分析與調試、合成數據生成以及訓練環境優化。最終實現了無人工干預下 30% 的性能提升。

<!– SVG_DIAGRAM: MiniMax-M2.7 遞歸自進化訓練流程圖 –>

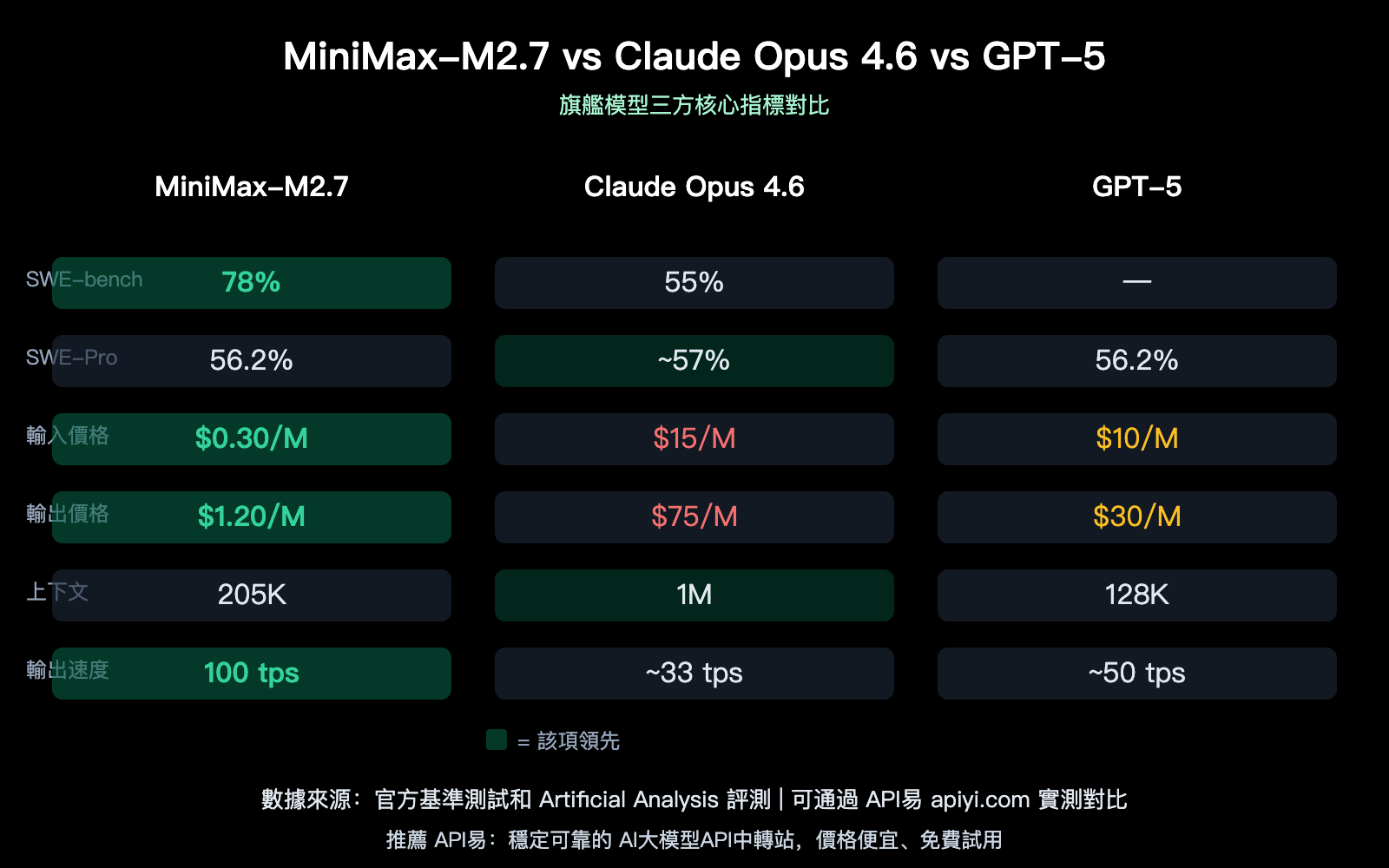

MiniMax-M2.7 性能基準與模型對比

MiniMax-M2.7 基準測試成績

| 基準測試 | M2.7 得分 | Claude Opus 4.6 | GPT-5 系列 | 說明 |

|---|---|---|---|---|

| SWE-bench Verified | 78% | 55% | — | 軟件工程實戰,大幅領先 |

| SWE-Pro | 56.2% | ~57% | 56.2% (Codex) | 接近旗艦水準 |

| VIBE-Pro | 55.6% | — | — | 端到端項目交付 |

| Terminal Bench 2 | 57.0% | — | — | 複雜工程系統 |

| MLE-Bench Lite | 66.6% | 75.7% | 71.2% (5.4) | ML 競賽,9金5銀1銅 |

| GDPval-AA ELO | 1495 | — | — | 辦公生產力第一 |

MiniMax-M2.7 價格對比

M2.7 的定價策略極具衝擊力,在幾乎同等性能水平下,成本僅爲主流旗艦模型的幾十分之一:

| 指標 | MiniMax-M2.7 | Claude Opus 4.6 | GPT-5 | 倍數差異 |

|---|---|---|---|---|

| 輸入價格 | $0.30/M | $15/M | $10/M | 50x / 33x 更便宜 |

| 輸出價格 | $1.20/M | $75/M | $30/M | 62x / 25x 更便宜 |

| 上下文窗口 | 205K | 1M | 128K | 介於兩者之間 |

| 激活參數 | 10B | — | — | 最小的 Tier-1 模型 |

🎯 選擇建議: MiniMax-M2.7 在編程和工程任務上表現出色,性價比極高。我們建議通過 API易 apiyi.com 平臺快速接入測試,該平臺支持 MiniMax-M2.7 和 M2.7-highspeed 的統一接口調用,便於與其他旗艦模型進行實際對比。

MiniMax-M2.7-highspeed 高速版詳解

MiniMax-M2.7-highspeed 是 M2.7 旗艦系列的性能優化版本,與標準版產出完全相同的結果——兩者智能水平一致,highspeed 版本專爲對延遲敏感的應用場景而設計。

MiniMax-M2.7-highspeed 核心優勢

- 輸出速度: 達到 100 tokens/s,比標準版提升 66%

- 亞秒級延遲: 優化了首 Token 響應時間,適合實時交互

- 增強推理骨幹架構: 底層推理引擎專門優化,非簡單量化降級

- 結果一致性: 與標準版輸出完全相同,不犧牲智能水平

MiniMax-M2.7-highspeed 適用場景

| 場景 | 說明 | 爲何選擇 highspeed |

|---|---|---|

| 交互式編程助手 | IDE 內實時代碼補全和重構 | 亞秒級響應提升編碼體驗 |

| 實時智能體循環 | Agent Loop 多步推理執行 | 減少每步等待,加速整體流程 |

| 高吞吐企業流水線 | 批量文檔處理、數據提取 | 100 tps 大幅縮短完成時間 |

| 在線客服系統 | 實時對話和問題解答 | 用戶無感知的快速響應 |

建議: 如果你的應用對響應速度有嚴格要求,MiniMax-M2.7-highspeed 是目前旗艦級模型中速度最快的選擇之一。通過 API易 apiyi.com 可以直接調用該模型。

MiniMax-M2.7 API 快速上手

極簡示例

以下是通過 API易平臺調用 MiniMax-M2.7 的最簡代碼,10 行即可運行:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

response = client.chat.completions.create(

model="MiniMax-M2.7",

messages=[{"role": "user", "content": "分析這段代碼的性能瓶頸並給出優化建議"}]

)

print(response.choices[0].message.content)

查看完整實現代碼(含 highspeed 版本切換)

import openai

from typing import Optional

def call_minimax_m27(

prompt: str,

model: str = "MiniMax-M2.7",

system_prompt: Optional[str] = None,

max_tokens: int = 2000,

use_highspeed: bool = False

) -> str:

"""

調用 MiniMax-M2.7 或 M2.7-highspeed

Args:

prompt: 用戶輸入

model: 模型名稱

system_prompt: 系統提示詞

max_tokens: 最大輸出 token 數

use_highspeed: 是否使用 highspeed 版本

"""

if use_highspeed:

model = "MiniMax-M2.7-highspeed"

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

messages = []

if system_prompt:

messages.append({"role": "system", "content": system_prompt})

messages.append({"role": "user", "content": prompt})

response = client.chat.completions.create(

model=model,

messages=messages,

max_tokens=max_tokens

)

return response.choices[0].message.content

# 標準版調用

result = call_minimax_m27(

prompt="用 Python 實現一個高效的 LRU 緩存",

system_prompt="你是一位資深的 Python 工程師"

)

# highspeed 版調用(適合實時場景)

fast_result = call_minimax_m27(

prompt="快速解釋這段代碼的作用",

use_highspeed=True

)

建議: 通過 API易 apiyi.com 獲取免費測試額度,快速驗證 MiniMax-M2.7 在你的業務場景中的表現。平臺支持標準版和 highspeed 版的一鍵切換。

MiniMax-M2.7 與競品模型方案對比

<!– SVG_COMPARISON: MiniMax-M2.7 vs Claude Opus 4.6 vs GPT-5 核心差異對比 –>

| 方案 | 核心特點 | 適用場景 | 性價比 |

|---|---|---|---|

| MiniMax-M2.7 | 10B 激活參數,SWE-bench 78% | 編程、Agent 工作流、大規模部署 | 極高($0.30/$1.20) |

| M2.7-highspeed | 100 tps,66% 速度提升 | 實時交互、IDE 集成、Agent Loop | 極高 + 快 |

| Claude Opus 4.6 | 1M 上下文,綜合能力最強 | 超長文檔、複雜推理、全能任務 | 中等($15/$75) |

| GPT-5 | 成熟生態,多模態支持 | 通用場景、多模態應用 | 中等($10/$30) |

對比說明: 上述數據來源於官方基準測試和 Artificial Analysis 第三方評測,可通過 API易 apiyi.com 平臺進行實際對比驗證。

常見問題

Q1: MiniMax-M2.7 和 M2.7-highspeed 輸出結果有區別嗎?

兩者輸出完全一致。highspeed 版本通過優化推理引擎實現更快的 Token 生成速度(100 tps),但不改變模型的智能水平和輸出質量。如果你的場景對延遲不敏感,使用標準版即可。

Q2: MiniMax-M2.7 的”遞歸自進化”意味着模型會持續變化嗎?

不會。遞歸自進化是 MiniMax 在訓練階段採用的技術方法——模型自主迭代優化了訓練流程和參數。一旦發佈,模型權重就是固定的。你調用的 API 會得到穩定一致的輸出。

Q3: 如何快速開始測試 MiniMax-M2.7?

推薦使用支持多模型的 API 聚合平臺進行測試:

- 訪問 API易 apiyi.com 註冊賬號

- 獲取 API Key 和免費額度

- 使用本文的代碼示例快速驗證

- 切換 model 參數即可在標準版和 highspeed 版之間切換

總結

MiniMax-M2.7 API 調用的核心要點:

- 極致性價比: 10B 激活參數達到 Tier-1 性能,價格僅爲 Opus 的 1/50,是大規模部署的首選

- 編程能力突出: SWE-bench Verified 78% 大幅領先競品,軟件工程任務表現卓越

- highspeed 版本: 100 tps 輸出速度適合實時交互和 Agent 循環場景,智能水平與標準版完全一致

對於追求性價比的開發者和企業用戶,MiniMax-M2.7 是當前市場上最值得關注的旗艦模型之一。

推薦通過 API易 apiyi.com 快速驗證效果,平臺提供免費額度和多模型統一接口,支持 MiniMax-M2.7 標準版和 highspeed 版的一鍵切換。

📚 參考資料

-

MiniMax M2.7 官方發佈: 模型架構和自進化技術詳情

- 鏈接:

minimax.io/news/minimax-m27-en - 說明: 官方技術博客,包含基準測試和架構細節

- 鏈接:

-

MiniMax M2.7 模型頁面: 技術規格和 API 文檔

- 鏈接:

minimax.io/models/text/m27 - 說明: 模型參數、定價和接入方式

- 鏈接:

-

Artificial Analysis 評測: 第三方獨立性能評測

- 鏈接:

artificialanalysis.ai/models/minimax-m2-7 - 說明: 獨立的速度和智能指數評測數據

- 鏈接:

-

API易平臺文檔: 快速接入 MiniMax-M2.7

- 鏈接:

docs.apiyi.com - 說明: API Key 獲取、模型列表和調用示例

- 鏈接:

作者: APIYI 技術團隊

技術交流: 歡迎在評論區討論,更多資料可訪問 API易 docs.apiyi.com 文檔中心