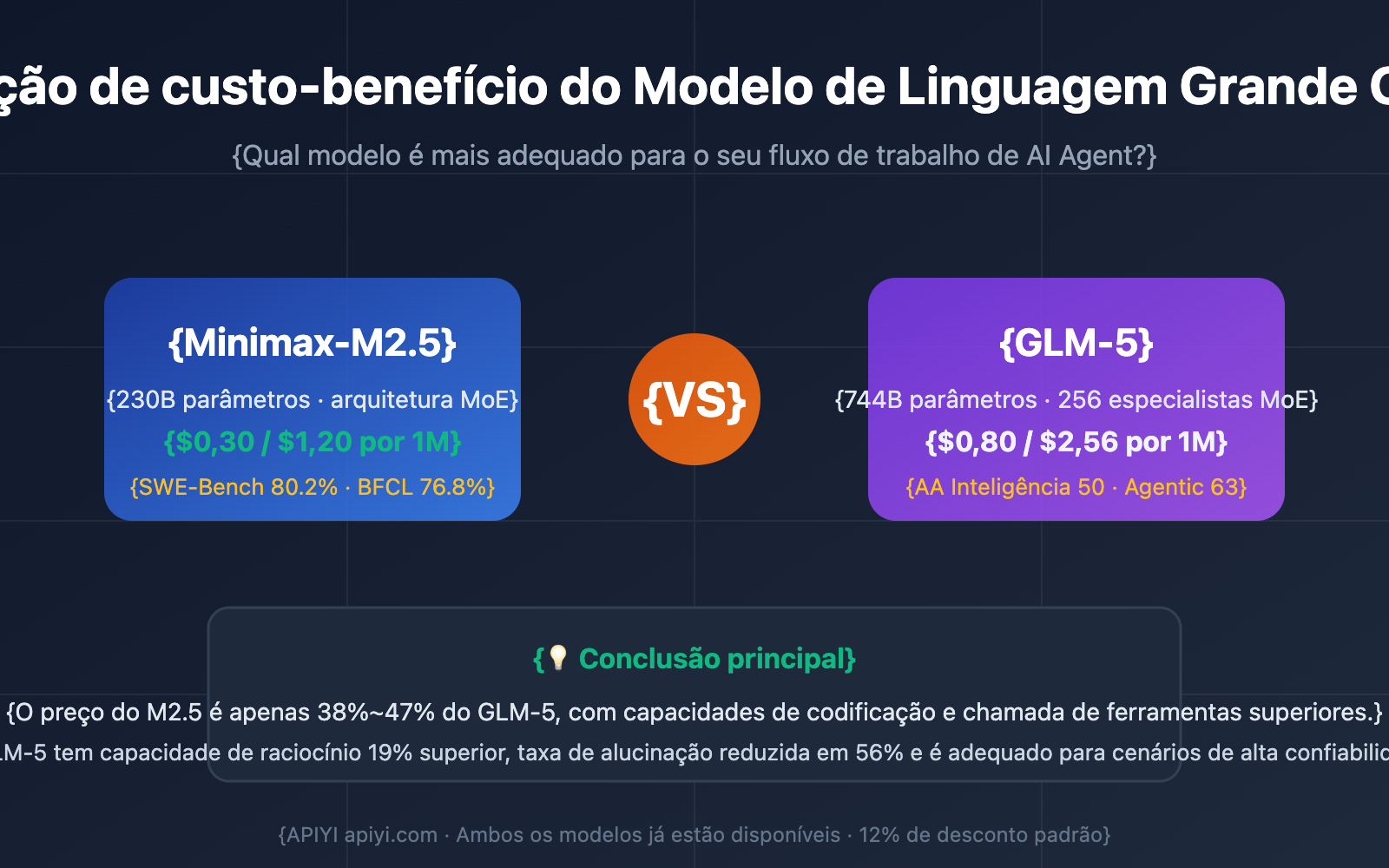

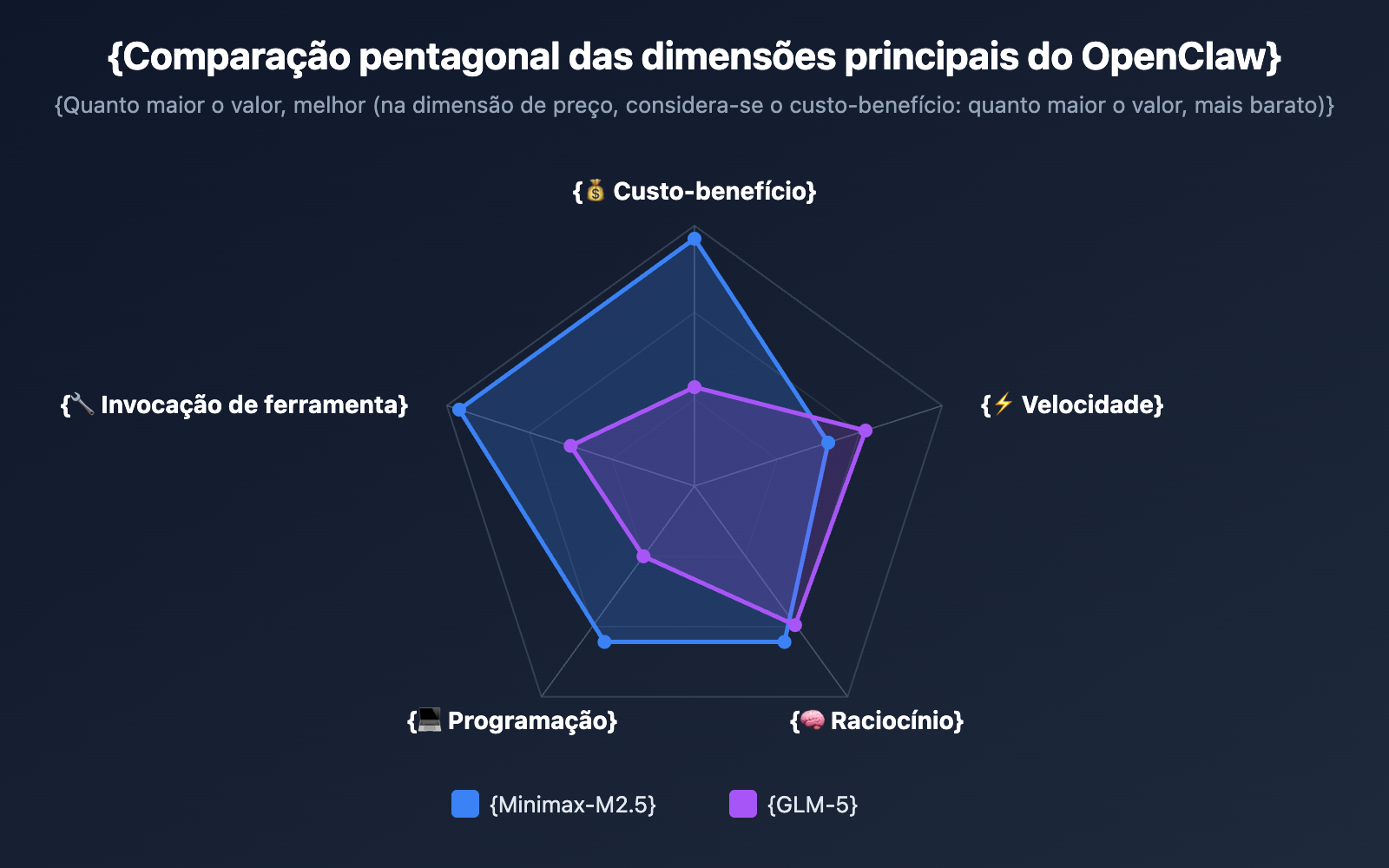

Nota do autor: Comparação entre Minimax-M2.5 e GLM-5 em dimensões como preço, desempenho e capacidade de chamada de ferramentas, ajudando você a escolher a solução de Modelo de Linguagem Grande com melhor custo-benefício para o cenário do OpenClaw.

O OpenClaw, como o framework de AI Agent de código aberto mais badalado do início de 2026, ultrapassou a marca de 175 mil estrelas no GitHub em menos de duas semanas. Ele consegue executar tarefas de forma autônoma por canais como WhatsApp, Telegram e Slack, mas a escolha do modelo determina diretamente o custo de uso e a qualidade da conclusão das tarefas.

Valor central: Ao terminar de ler este artigo, você saberá claramente para quais cenários de uso do OpenClaw o Minimax-M2.5 e o GLM-5 são mais adequados, e como obter os melhores resultados com o menor custo.

Indicadores centrais para escolher modelos no OpenClaw

O OpenClaw é um AI Agent que executa tarefas de forma autônoma e, diferentemente de cenários comuns de chat, ele possui exigências mais específicas para os modelos. Escolher o modelo errado pode resultar em falha na tarefa ou, pior, em uma explosão nos custos de Tokens.

| Indicador Central | Importância | Descrição |

|---|---|---|

| Chamada de ferramentas | ⭐⭐⭐⭐⭐ | O OpenClaw depende de Function Calling para executar comandos Shell, operações de navegador e mais de 100 outras habilidades |

| Velocidade de saída | ⭐⭐⭐⭐ | O fluxo de tarefas de um Agent é longo; baixa velocidade significa que o tempo de espera aumenta exponencialmente |

| Janela de contexto | ⭐⭐⭐⭐ | Tarefas complexas exigem manter o histórico completo de diálogos e chamadas de ferramentas |

| Preço por Token | ⭐⭐⭐⭐⭐ | O consumo de Tokens em cenários de Agent é enorme; uma diferença de 2x no preço unitário significa uma diferença de 2x na fatura mensal |

| Capacidade de raciocínio | ⭐⭐⭐ | Tarefas complexas exigem raciocínio em várias etapas, mas a maioria das tarefas diárias não tem alta exigência de raciocínio |

Requisitos mínimos do OpenClaw para modelos

De acordo com a experiência prática da comunidade OpenClaw, o modelo principal precisa de pelo menos 14B de parâmetros (modelos de 8B ou menos tendem a apresentar alucinações em chamadas de ferramentas), e recomenda-se uma janela de contexto de 32K ou mais. Tanto o Minimax-M2.5 quanto o GLM-5 superam em muito esse limite. A questão é: já que ambos funcionam, qual é o mais vantajoso?

Minimax-M2.5 vs GLM-5 OpenClaw: Comparativo Completo de Custo-Benefício

Comparativo de Especificações Básicas

| Dimensão do Parâmetro | Minimax-M2.5 | GLM-5 | Conclusão da Comparação |

|---|---|---|---|

| Total de Parâmetros | 230 bilhões | 744 bilhões | GLM-5 é 3,2x maior que o M2.5 |

| Parâmetros Ativos | 10 bilhões | 40 bilhões | GLM-5 tem 4x mais parâmetros ativos |

| Arquitetura | MoE (Mistura de Especialistas) | MoE (256 especialistas, Top-8 ativos) | Ambos usam arquitetura MoE |

| Janela de Contexto | 205K tokens | 200K tokens | Praticamente iguais |

| Saída Máxima | 128K tokens | – | M2.5 é superior em saídas de texto longo |

| Licença | MIT | MIT | Ambos permitem uso comercial |

Comparativo de Desempenho no OpenClaw

Esta tabela é a base principal para sua escolha — ela afeta diretamente sua experiência e custos ao usar o OpenClaw:

| Indicador de Desempenho | Minimax-M2.5 | GLM-5 | Vencedor |

|---|---|---|---|

| Preço de Entrada (por milhão de Tokens) | $0.30 | $0.80 | ✅ M2.5 é 62% mais barato |

| Preço de Saída (por milhão de Tokens) | $1.20 | $2.56 | ✅ M2.5 é 53% mais barato |

| Velocidade de Saída | 54 tokens/s | 68.6 tokens/s | ✅ GLM-5 é 27% mais rápido |

| Latência do Primeiro Token | 2.57s | 1.36s | ✅ GLM-5 é 47% mais rápido |

| SWE-Bench (Codificação) | 80.2% | 77.8% | ✅ M2.5 é 2.4% superior |

| Índice de Inteligência AA | 42 | 50 | ✅ GLM-5 é 19% superior |

| Chamada de Ferramentas BFCL | 76.8% | – | M2.5 tem dados sólidos em ferramentas |

| Melhoria na Taxa de Alucinação | – | 56% menor que a geração anterior | GLM-5 tem maior confiabilidade de conhecimento |

🎯 Descoberta Principal: O preço por token do Minimax-M2.5 é apenas 38%-47% do valor do GLM-5, mas ele entrega um desempenho igual ou superior em codificação e chamadas de ferramentas, que são as capacidades centrais do OpenClaw. Isso significa que, para a maioria dos usuários do OpenClaw, o M2.5 oferece um custo-benefício significativamente maior.

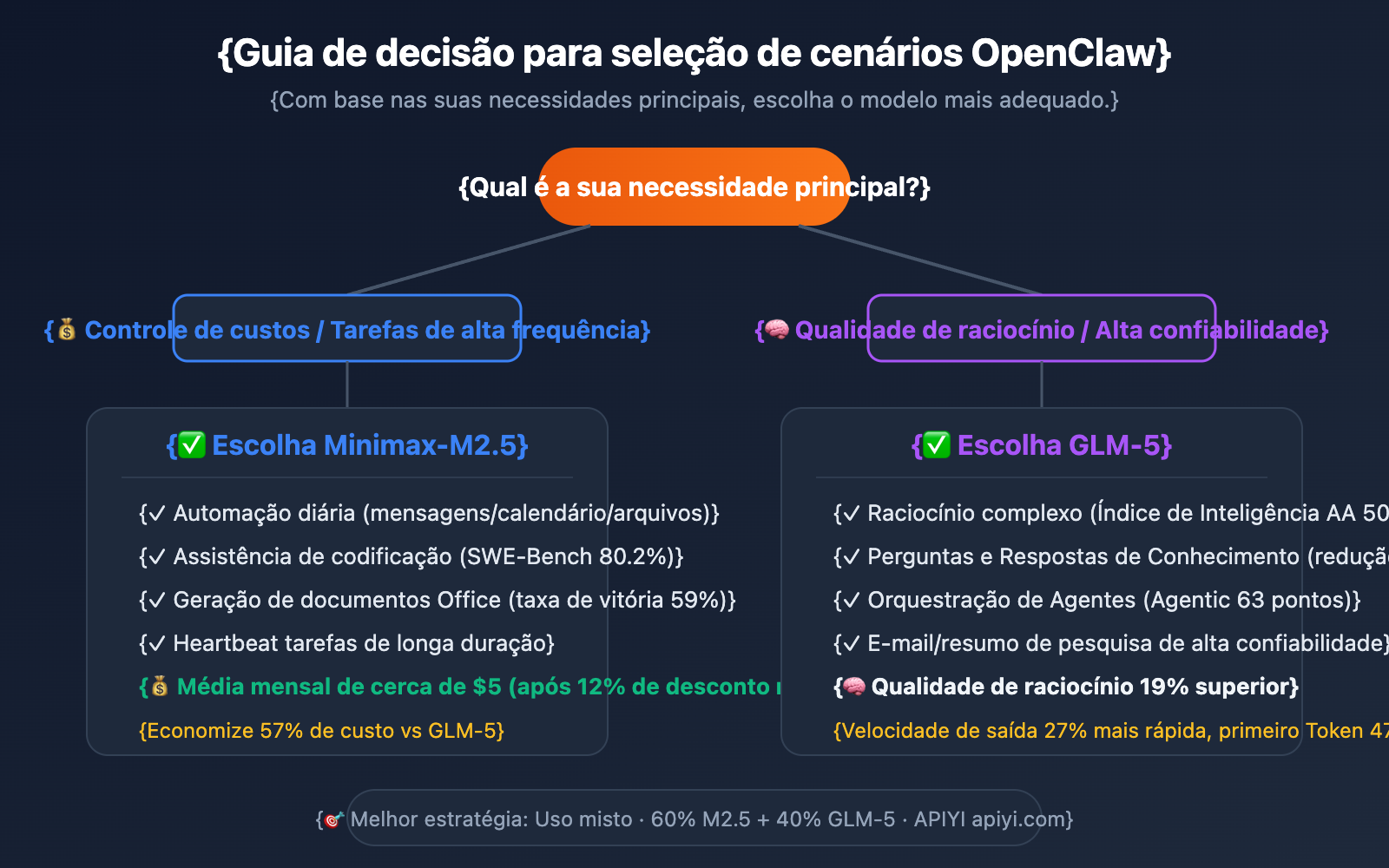

Sugestões de Seleção de Modelo para Diferentes Cenários no OpenClaw

Cada cenário exige prioridades diferentes. Confira as recomendações para os usos típicos do OpenClaw:

Quando escolher o Minimax-M2.5

- Tarefas de automação diária: Envio de mensagens agendadas, gestão de calendário, organização de arquivos e outras tarefas de alta frequência e baixa complexidade. A vantagem do preço baixo do M2.5 brilha em invocações massivas.

- Auxílio na codificação: O resultado de 80.2% no SWE-Bench mostra que o M2.5 é excelente para geração e depuração de código.

- Geração de documentos Office: O M2.5 tem uma taxa de vitória média de 59% em tarefas de Word/PPT/Excel, sendo ideal para automação de documentos.

- Execução de longo prazo com orçamento limitado: O agendador Heartbeat do OpenClaw acorda o modelo periodicamente; em execuções contínuas, o M2.5 pode economizar mais de 50% nos custos.

Quando escolher o GLM-5

- Tarefas de raciocínio complexo: Com um índice de inteligência AA de 50 (contra 42 do M2.5), o GLM-5 é mais estável em raciocínios de múltiplas etapas e análises lógicas.

- Pesquisa densa em conhecimento: Com a taxa de alucinação reduzida em 56%, o GLM-5 é mais confiável para tarefas que exigem informações precisas, como rascunhos de e-mails importantes ou resumos de pesquisas.

- Orquestração de cadeias de Agents: Com um índice Agentic AA de 63 (o maior entre modelos abertos), ele é perfeito para fluxos de trabalho complexos com múltiplos passos.

Guia rápido: Integrando OpenClaw com Minimax-M2.5 e GLM-5

Exemplo minimalista

Com a plataforma APIYI, basta alterar o parâmetro model para alternar entre os dois modelos:

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

# Usando Minimax-M2.5 (a escolha com melhor custo-benefício)

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "Me ajude a escrever um script Python para monitorar mudanças de arquivos em um diretório específico"}]

)

print(response.choices[0].message.content)

Ver exemplo de invocação do GLM-5 e código de tool calling

import openai

client = openai.OpenAI(

api_key="SUA_CHAVE_API",

base_url="https://vip.apiyi.com/v1"

)

# Usando GLM-5 (maior capacidade de raciocínio)

response = client.chat.completions.create(

model="glm-5",

messages=[{"role": "user", "content": "Analise as tendências destes dados de vendas e dê sugestões de otimização"}]

)

print(response.choices[0].message.content)

# Exemplo de tool calling (capacidade principal do OpenClaw)

tools = [{

"type": "function",

"function": {

"name": "run_shell_command",

"description": "Executar comando Shell",

"parameters": {

"type": "object",

"properties": {

"command": {"type": "string", "description": "O comando a ser executado"}

},

"required": ["command"]

}

}

}]

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "Listar todos os arquivos Python no diretório atual"}],

tools=tools

)

print(response.choices[0].message)

Dica: Obtenha créditos de teste gratuitos através da APIYI (apiyi.com); ambos os modelos podem ser testados diretamente. A plataforma oferece, por padrão, um preço que é 88% do valor oficial (12% de desconto), o que pode reduzir significativamente os custos ao usar o OpenClaw a longo prazo.

Estimativa real de custos dos modelos no OpenClaw

Considerando um usuário típico do OpenClaw que executa 50 tarefas de Agent por dia, com uma média de 5.000 tokens de entrada e 2.000 tokens de saída por tarefa:

| Item de Custo | Minimax-M2.5 | GLM-5 | Proporção de Economia |

|---|---|---|---|

| Custo médio diário de entrada | $0.075 | $0.20 | 62% |

| Custo médio diário de saída | $0.12 | $0.256 | 53% |

| Custo total médio diário | $0.195 | $0.456 | 57% |

| Custo total médio mensal | $5.85 | $13.68 | 57% |

| Média mensal com desconto APIYI | $5.15 | $12.04 | 57% |

🎯 Conclusão de custo: Usando o Minimax-M2.5 com o desconto da APIYI, o custo mensal fica em torno de $5, menos da metade do GLM-5. Para usuários com orçamento limitado que precisam rodar o OpenClaw continuamente, o M2.5 é a escolha mais prática.

Claro, se suas tarefas exigem raciocínio complexo e saídas de alta confiabilidade, gastar cerca de $7 a mais por mês no GLM-5 para obter uma capacidade de dedução superior e menor taxa de alucinação é um investimento totalmente justificável.

Perguntas Frequentes

Q1: O OpenClaw pode ser configurado com dois modelos ao mesmo tempo?

Sim. O OpenClaw suporta a configuração de múltiplos provedores de modelos. Você pode definir o Minimax-M2.5 como o modelo padrão para lidar com tarefas diárias e configurar o GLM-5 como um modelo reserva para tarefas de raciocínio complexo. A estratégia de otimização de custos recomendada pela comunidade é usar modelos mais baratos para 60%-70% das tarefas e modelos de alto desempenho para os 30%-40% de tarefas complexas. Através da plataforma APIYI, você pode alternar entre os dois modelos usando a mesma chave API.

Q2: Qual é o preço desses dois modelos na plataforma APIYI?

A plataforma APIYI oferece, por padrão, um desconto de 88% em relação aos preços oficiais. Com base nisso, o Minimax-M2.5 custa cerca de $0,264 por milhão de tokens de entrada e $1,056 por milhão de tokens de saída; o GLM-5 custa cerca de $0,704 por milhão de tokens de entrada e $2,253 por milhão de tokens de saída. Acesse APIYI apiyi.com para conferir os preços mais recentes.

Q3: Além desses dois modelos, quais são as outras opções de alto custo-benefício para o OpenClaw?

De acordo com o feedback de uso da comunidade OpenClaw, outras opções com excelente custo-benefício incluem:

- Gemini 2.5 Flash: $0,15/$0,60, a opção de nuvem mais barata.

- Kimi K2.5: $0,50/$2,40, suporte para mais de 200 etapas em cadeias de chamadas de ferramentas.

- DeepSeek V3.2: $0,28 por milhão de tokens de entrada, com excelente capacidade de codificação.

Esses modelos estão todos disponíveis na plataforma APIYI apiyi.com. Recomendamos realizar testes comparativos baseados em suas tarefas reais.

Resumo

Principais recomendações para escolher modelos no OpenClaw:

- Busque custo-benefício com o Minimax-M2.5: O preço é apenas 38%-47% do GLM-5, com ótimas capacidades de codificação e chamadas de ferramentas, sendo ideal para a maioria dos cenários diários do OpenClaw.

- Busque qualidade de raciocínio com o GLM-5: Possui um índice de inteligência AA 19% superior e uma redução de 56% na taxa de alucinação, sendo indicado para raciocínio complexo e tarefas com uso intensivo de conhecimento.

- A melhor estratégia é o uso híbrido: Use o M2.5 para tarefas rotineiras para controlar os custos e mude para o GLM-5 em tarefas complexas para garantir a qualidade.

Ambos os modelos já estão disponíveis na plataforma APIYI, contando com o desconto padrão de 88% sobre o preço oficial. Recomendamos obter créditos de teste gratuitos em APIYI apiyi.com para comparar na prática o desempenho dos dois modelos em suas tarefas no OpenClaw.

📚 Referências

-

Documentação Oficial do OpenClaw: Guia de configuração de provedores de modelos

- Link:

docs.openclaw.ai/concepts/model-providers - Descrição: Saiba como configurar modelos personalizados no OpenClaw

- Link:

-

Apresentação Oficial do Minimax-M2.5: Especificações técnicas e dados de desempenho do modelo

- Link:

minimax.io/news/minimax-m25 - Descrição: Confira os resultados completos de benchmark e detalhes da arquitetura do M2.5

- Link:

-

Documentação Técnica do GLM-5: Capacidades do modelo e especificações da interface API

- Link:

docs.z.ai/guides/llm/glm-5 - Descrição: Conheça as capacidades de raciocínio e características multimodais do GLM-5

- Link:

-

Comparativo de Modelos da Artificial Analysis: Dados de avaliação independentes de terceiros

- Link:

artificialanalysis.ai/models/comparisons/minimax-m2-5-vs-glm-5 - Descrição: Dados objetivos de comparação de desempenho, velocidade e preço

- Link:

Autor: Equipe Técnica

Discussão Técnica: Sinta-se à vontade para compartilhar sua experiência na escolha de modelos para o OpenClaw nos comentários. Para mais novidades sobre modelos de IA, acesse o APIYI apiyi.com