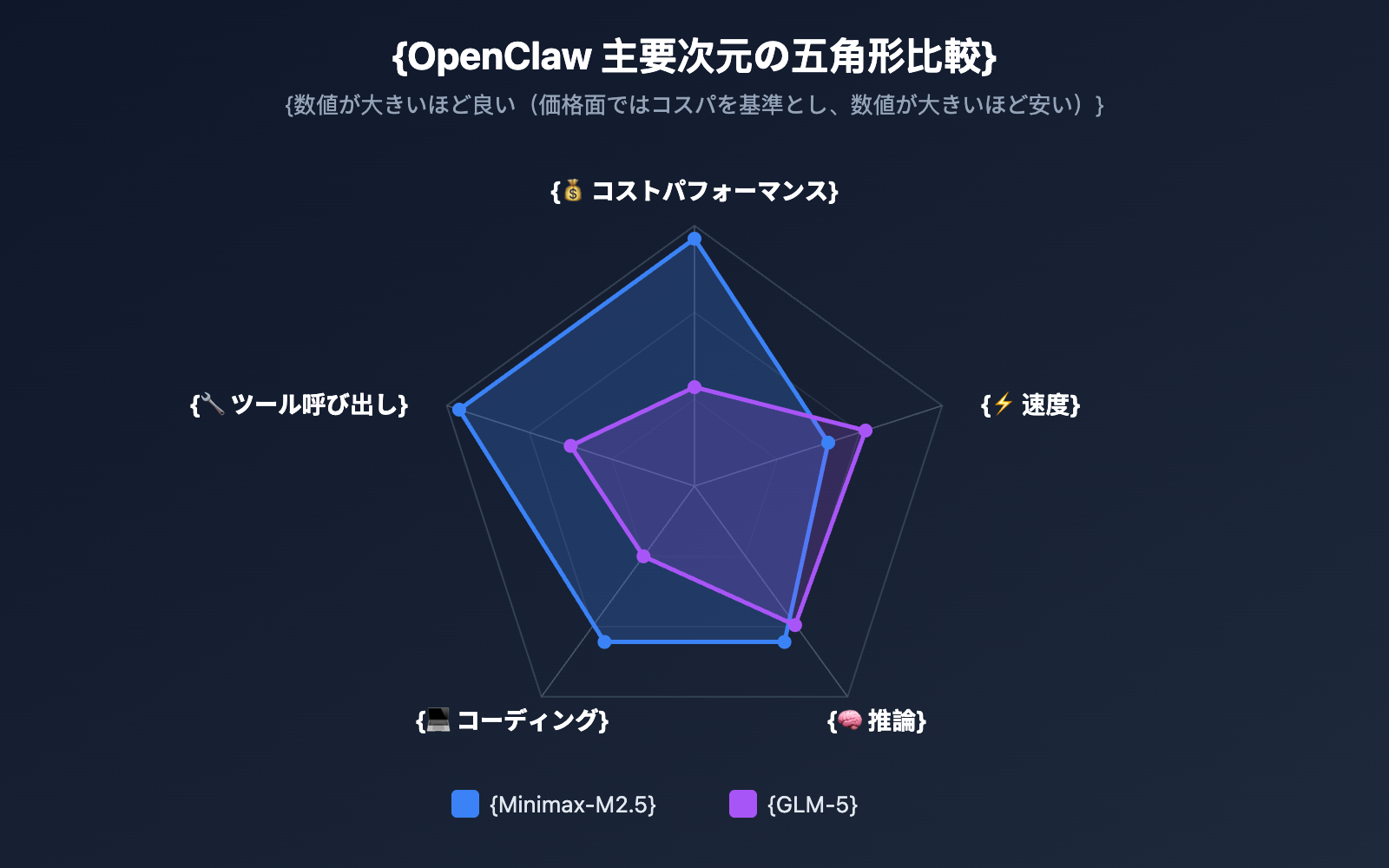

著者注:価格、パフォーマンス、ツール呼び出し能力などの観点から Minimax-M2.5 と GLM-5 を比較し、OpenClaw シナリオにおいて最もコスパの高い大規模言語モデル案を選定する手助けをします。

OpenClaw は 2026 年初頭に最も話題となったオープンソース AI Agent フレームワークで、リリースから 2 週間足らずで 17.5 万 GitHub スターを突破しました。WhatsApp、Telegram、Slack などのチャネルを通じて自律的にタスクを実行できますが、モデルの選択が使用コストとタスクの完了品質を直接左右します。

コアバリュー: この記事を読み終える頃には、Minimax-M2.5 と GLM-5 がそれぞれどのような OpenClaw の利用シーンに適しているか、そして最小のコストで最高の効果を得る方法が明確になります。

OpenClaw モデル選定のコア指標

OpenClaw は自律的にタスクを実行する AI Agent であり、一般的なチャットシーンとは異なり、モデルに対する要求がより具体的です。モデル選びを間違えると、タスクの失敗だけでなく、トークン費用が跳ね上がるリスクがあります。

| コア指標 | 重要性 | 説明 |

|---|---|---|

| ツール呼び出し能力 | ⭐⭐⭐⭐⭐ | OpenClaw は Function Calling に依存して Shell コマンドやブラウザ操作など 100 以上のスキルを実行します |

| 出力速度 | ⭐⭐⭐⭐ | Agent のタスクチェーンは長いため、速度が遅いと待ち時間が倍増します |

| コンテキストウィンドウ | ⭐⭐⭐⭐ | 複雑なタスクでは、完全な対話とツール呼び出しの履歴を保持する必要があります |

| トークン単価 | ⭐⭐⭐⭐⭐ | Agent シナリオではトークン消費が膨大になるため、単価が 2 倍違うと月額請求も 2 倍変わります |

| 推論能力 | ⭐⭐⭐ | 複雑なタスクには多段階の推論が必要ですが、日常的なタスクの多くはそれほど高い推論能力を求められません |

OpenClaw におけるモデルの最低要件

OpenClaw コミュニティの実践経験によると、メインモデルには少なくとも 14B(140 億)以上のパラメータが必要であり(8B 以下ではツール呼び出しのハルシネーションが発生しやすいため)、コンテキストウィンドウは 32K 以上が推奨されます。Minimax-M2.5 と GLM-5 はどちらもこの基準を大きく上回っていますが、問題は 「どちらも動作する中で、どちらの方がお得か?」 という点です。

Minimax-M2.5 と GLM-5 OpenClaw コスパ全面比較

モデル基本スペック比較

| パラメータ次元 | Minimax-M2.5 | GLM-5 | 比較結論 |

|---|---|---|---|

| 総パラメータ数 | 2300 億 | 7440 億 | GLM-5 は M2.5 の 3.2 倍 |

| 活性化パラメータ | 100 億 | 400 億 | GLM-5 の方が 4 倍多い |

| アーキテクチャ | MoE(混合エキスパート) | MoE(256 エキスパート、Top-8 活性化) | 両者とも MoE アーキテクチャを採用 |

| コンテキストウィンドウ | 205K tokens | 200K tokens | ほぼ同等 |

| 最大出力 | 128K tokens | – | M2.5 の方が長文出力に強い |

| オープンソースライセンス | MIT | MIT | 両者とも商用利用可能 |

OpenClaw キーパフォーマンス比較

この表は、OpenClaw の体験とコストに直接影響する、選択の核心的な根拠となります。

| 性能指標 | Minimax-M2.5 | GLM-5 | 勝者 |

|---|---|---|---|

| 入力価格(100万トークンあたり) | $0.30 | $0.80 | ✅ M2.5 が 62% 安い |

| 出力価格(100万トークンあたり) | $1.20 | $2.56 | ✅ M2.5 が 53% 安い |

| 出力速度 | 54 tokens/s | 68.6 tokens/s | ✅ GLM-5 が 27% 速い |

| 初回トークン遅延 (TTFT) | 2.57s | 1.36s | ✅ GLM-5 が 47% 速い |

| SWE-Bench(コーディング) | 80.2% | 77.8% | ✅ M2.5 が 2.4% 高い |

| AA 智能指数 | 42 | 50 | ✅ GLM-5 が 19% 高い |

| BFCL ツール呼び出し | 76.8% | – | M2.5 はデータによる裏付けあり |

| 幻覚率の改善 | – | 前世代比 56% 低減 | GLM-5 の方が知識の信頼性が高い |

🎯 重要な発見: Minimax-M2.5 のトークン価格は GLM-5 の 38%-47% に過ぎませんが、OpenClaw の最も核心的な能力であるコーディングとツール呼び出しにおいて、同等またはそれ以上のパフォーマンスを示しています。これは、ほとんどの OpenClaw ユーザーにとって、M2.5 のコスパが著しく高いことを意味します。

OpenClaw の各シーンにおけるモデル選択のアドバイス

使用シーンによってモデルに求められる能力の重点は異なります。以下は OpenClaw の典型的なシーン別の推奨事項です。

Minimax-M2.5 を選ぶべきシーン

- 日常的な自動化タスク: メッセージの定期送信、カレンダー管理、ファイル整理などの高頻度かつ低複雑度のタスク。M2.5 の低価格なメリットは、大量の呼び出しにおいて顕著な効果を発揮します。

- コーディング補助: SWE-Bench 80.2% という成績は、M2.5 がコード生成やデバッグの面で優れた能力を持っていることを示しています。

- Office ドキュメント生成: M2.5 は Word/PPT/Excel タスクにおいて平均勝率 59% を誇り、ドキュメント自動化フローに適しています。

- 予算に敏感な長期実行: OpenClaw の Heartbeat スケジューラは定期的にモデルを起動してタスクを実行します。長期的な運用において、M2.5 は費用を 50% 以上節約できます。

GLM-5 を選ぶべきシーン

- 複雑な推論タスク: AA 智能指数が 50 点(M2.5 は 42 点)であり、多段階の推論や論理分析において GLM-5 の方が安定しています。

- 知識集約型の Q&A: 幻覚率が 56% 大幅に低減されており、メールのドラフト作成や研究の要約など、信頼性の高い情報出力が必要なタスクでは GLM-5 がより信頼できます。

- エージェントチェーンのオーケストレーション: AA Agentic 指数が 63 点(オープンソースモデルで最高)に達しており、複雑な多段階のエージェントワークフローに適しています。

OpenClawでMinimax-M2.5とGLM-5を使いこなす:クイックスタートガイド

シンプルな実装例

APIYIプラットフォームを利用すれば、modelパラメータを変更するだけで、これら2つのモデルを簡単に切り替えて使用できます。

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Minimax-M2.5を使用(コストパフォーマンス重視)

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "指定したディレクトリのファイル変更を監視するPythonスクリプトを書いてください"}]

)

print(response.choices[0].message.content)

GLM-5の呼び出し例とツール呼び出し(Tool Calling)のコードを確認する

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# GLM-5を使用(より強力な推論能力)

response = client.chat.completions.create(

model="glm-5",

messages=[{"role": "user", "content": "この売上データのトレンドを分析し、最適化のためのアドバイスをください"}]

)

print(response.choices[0].message.content)

# ツール呼び出しの例(OpenClawのコア機能)

tools = [{

"type": "function",

"function": {

"name": "run_shell_command",

"description": "Shellコマンドを実行する",

"parameters": {

"type": "object",

"properties": {

"command": {"type": "string", "description": "実行するコマンド"}

},

"required": ["command"]

}

}

}]

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "現在のディレクトリにあるすべてのPythonファイルを確認してください"}],

tools=tools

)

print(response.choices[0].message)

アドバイス: APIYI(apiyi.com)で無料テストクレジットを取得すれば、両方のモデルを直接呼び出してテストできます。プラットフォームはデフォルトで公式サイト価格の12%オフ(88%の価格)となっており、OpenClawを長期利用する場合、コストを大幅に削減できます。

OpenClaw モデルコストの試算比較

典型的なOpenClawユーザーが1日50回のエージェントタスクを実行し、1回あたり平均5,000入力トークンと2,000出力トークンを消費すると仮定した場合の試算です。

| コスト項目 | Minimax-M2.5 | GLM-5 | 削減率 |

|---|---|---|---|

| 1日あたりの入力コスト | $0.075 | $0.20 | 62% |

| 1日あたりの出力コスト | $0.12 | $0.256 | 53% |

| 1日あたりの合計コスト | $0.195 | $0.456 | 57% |

| 1ヶ月あたりの合計コスト | $5.85 | $13.68 | 57% |

| APIYI割引後の月額 | $5.15 | $12.04 | 57% |

🎯 コストに関する結論: Minimax-M2.5とAPIYIの12%オフ特典を組み合わせれば、月額コストは約$5程度に抑えられ、GLM-5の半分以下で済みます。予算が限られているものの、OpenClawを長期運用したいユーザーにとって、M2.5は非常に現実的な選択肢です。

もちろん、複雑な推論や高い信頼性が求められるタスクであれば、月に追加で$7を投資して、より強力な推論能力と低いハルシネーション率(幻覚率)を持つGLM-5を選ぶのも賢明な投資と言えるでしょう。

よくある質問

Q1: OpenClawで2つのモデルを同時に設定することはできますか?

はい、可能です。OpenClawは複数のモデルプロバイダーの設定に対応しています。例えば、日常的なタスクにはMinimax-M2.5をデフォルトとして設定し、複雑な推論タスクにはGLM-5をバックアップモデルとして構成することができます。コミュニティで推奨されているコスト最適化戦略は、タスクの60%〜70%を安価なモデルで処理し、残りの30%〜40%の複雑なタスクに高性能モデルを割り当てることです。APIYIプラットフォームを利用すれば、1つのAPIキーでこれら2つのモデルを簡単に切り替えて使用できます。

Q2: これら2つのモデルのAPIYIプラットフォームでの価格はいくらですか?

APIYIプラットフォームでは、公式サイト価格の12%オフ(88%の価格)で提供されています。この計算に基づくと、Minimax-M2.5は入力が約0.264ドル/100万トークン、出力が約1.056ドル/100万トークンとなります。一方、GLM-5は入力が約0.704ドル/100万トークン、出力が約2.253ドル/100万トークンです。最新の価格については、APIYI(apiyi.com)をご確認ください。

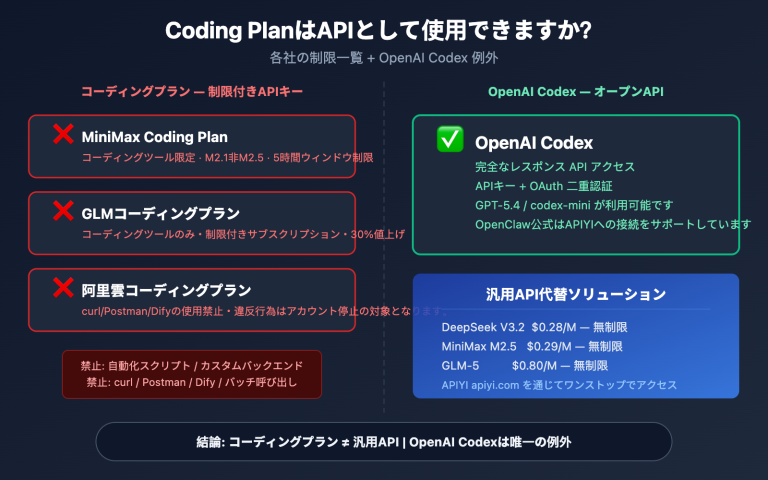

Q3: これら2つのモデル以外に、OpenClawで利用できるコストパフォーマンスの高い選択肢はありますか?

OpenClawコミュニティのフィードバックに基づくと、他にも以下のようなコストパフォーマンスに優れた選択肢があります:

- Gemini 2.5 Flash: 入力0.15ドル / 出力0.60ドル。最も安価なクラウドオプションの一つです。

- Kimi K2.5: 入力0.50ドル / 出力2.40ドル。ツール呼び出しのチェーンで200ステップ以上をサポートしています。

- DeepSeek V3.2: 入力0.28ドル/100万トークン。コーディング能力に非常に優れています。

これらのモデルはすべてAPIYI(apiyi.com)プラットフォームで利用可能です。実際のタスクに合わせて比較テストを行うことをお勧めします。

まとめ

OpenClawのモデル選びにおける核心的なアドバイスは以下の通りです:

- コストパフォーマンスを追求するならMinimax-M2.5: 価格はGLM-5のわずか38%〜47%でありながら、コーディング能力やツール呼び出し能力に優れており、OpenClawのほとんどの日常的なシナリオに適しています。

- 推論の質を追求するならGLM-5: AAインテリジェンス指数が19%高く、ハルシネーション(幻覚)率が56%低減されています。複雑な推論や知識集約型のタスクに最適です。

- ベストな戦略は「ハイブリッド運用」: 日常的なタスクはM2.5でコストを抑え、複雑なタスクはGLM-5に切り替えて品質を担保するのが賢明です。

どちらのモデルもAPIYIプラットフォームで提供されており、デフォルトで公式サイト価格の12%オフで利用可能です。APIYI(apiyi.com)で無料のテスト用クレジットを取得し、実際のOpenClawタスクで2つのモデルのパフォーマンスを直接比較してみることをお勧めします。

📚 参考文献・リソース

-

OpenClaw 公式ドキュメント: モデルプロバイダー設定ガイド

- リンク:

docs.openclaw.ai/concepts/model-providers - 説明: OpenClaw でカスタムモデルを設定する方法について確認できます。

- リンク:

-

Minimax-M2.5 公式紹介: モデルの技術仕様とパフォーマンスデータ

- リンク:

minimax.io/news/minimax-m25 - 説明: M2.5 の完全なベンチマーク結果とアーキテクチャの詳細を確認できます。

- リンク:

-

GLM-5 技術ドキュメント: モデルの能力と API インターフェースの説明

- リンク:

docs.z.ai/guides/llm/glm-5 - 説明: GLM-5 の推論能力とマルチモーダル特性について確認できます。

- リンク:

-

Artificial Analysis モデル比較: 第三方機関による独立評価データ

- リンク:

artificialanalysis.ai/models/comparisons/minimax-m2-5-vs-glm-5 - 説明: パフォーマンス、速度、価格に関する客観的な比較データを確認できます。

- リンク:

著者: 技術チーム

技術交流: OpenClaw のモデル選択に関する経験をぜひコメント欄で共有してください。最新の AI モデル情報は APIYI apiyi.com でご確認いただけます。