作者注:从价格、性能、工具调用能力等维度对比 Minimax-M2.5 和 GLM-5,帮你选出 OpenClaw 场景下性价比最高的大模型方案

OpenClaw 作为 2026 年初最火爆的开源 AI Agent 框架,上线不到两周就突破了 17.5 万 GitHub Star。它能通过 WhatsApp、Telegram、Slack 等渠道自主执行任务,但模型选择直接决定了使用成本和任务完成质量。

核心价值: 看完本文,你将明确 Minimax-M2.5 和 GLM-5 分别适合哪些 OpenClaw 使用场景,以及如何用最低成本获得最佳效果。

OpenClaw 选模型的核心指标

OpenClaw 是一个自主执行任务的 AI Agent,和普通聊天场景不同,它对模型的要求更加具体。选错模型轻则任务失败、重则 Token 费用飙升。

| 核心指标 | 重要性 | 说明 |

|---|---|---|

| 工具调用能力 | ⭐⭐⭐⭐⭐ | OpenClaw 依赖 Function Calling 执行 Shell 命令、浏览器操作等 100+ 技能 |

| 输出速度 | ⭐⭐⭐⭐ | Agent 任务链路长,速度慢意味着等待时间成倍增加 |

| 上下文窗口 | ⭐⭐⭐⭐ | 复杂任务需要保持完整的对话和工具调用历史 |

| Token 单价 | ⭐⭐⭐⭐⭐ | Agent 场景 Token 消耗巨大,单价差 2 倍意味着月账单差 2 倍 |

| 推理能力 | ⭐⭐⭐ | 复杂任务需要多步推理,但大部分日常任务对推理要求不高 |

OpenClaw 对模型的最低要求

根据 OpenClaw 社区的实践经验,主模型至少需要 14B 以上参数(8B 及以下容易出现工具调用幻觉),上下文窗口建议 32K 以上。Minimax-M2.5 和 GLM-5 都远超这个门槛,问题在于:同样能跑,谁更划算?

Comparativa exhaustiva de relación calidad-precio: Minimax-M2.5 vs. GLM-5 en OpenClaw

Comparativa de especificaciones básicas del modelo

| Dimensión del parámetro | Minimax-M2.5 | GLM-5 | Conclusión comparativa |

|---|---|---|---|

| Parámetros totales | 230 mil millones | 744 mil millones | GLM-5 es 3.2 veces el M2.5 |

| Parámetros activos | 10 mil millones | 40 mil millones | GLM-5 tiene 4 veces más parámetros activos |

| Arquitectura | MoE (Mezcla de Expertos) | MoE (256 expertos, Top-8 activos) | Ambos usan arquitectura MoE |

| Ventana de contexto | 205K tokens | 200K tokens | Básicamente igual |

| Salida máxima | 128K tokens | – | M2.5 es superior en salida de texto largo |

| Licencia | MIT | MIT | Ambos permiten uso comercial |

Comparativa de rendimiento clave en OpenClaw

Esta tabla es la base principal para elegir: afecta directamente tu experiencia y costos con OpenClaw:

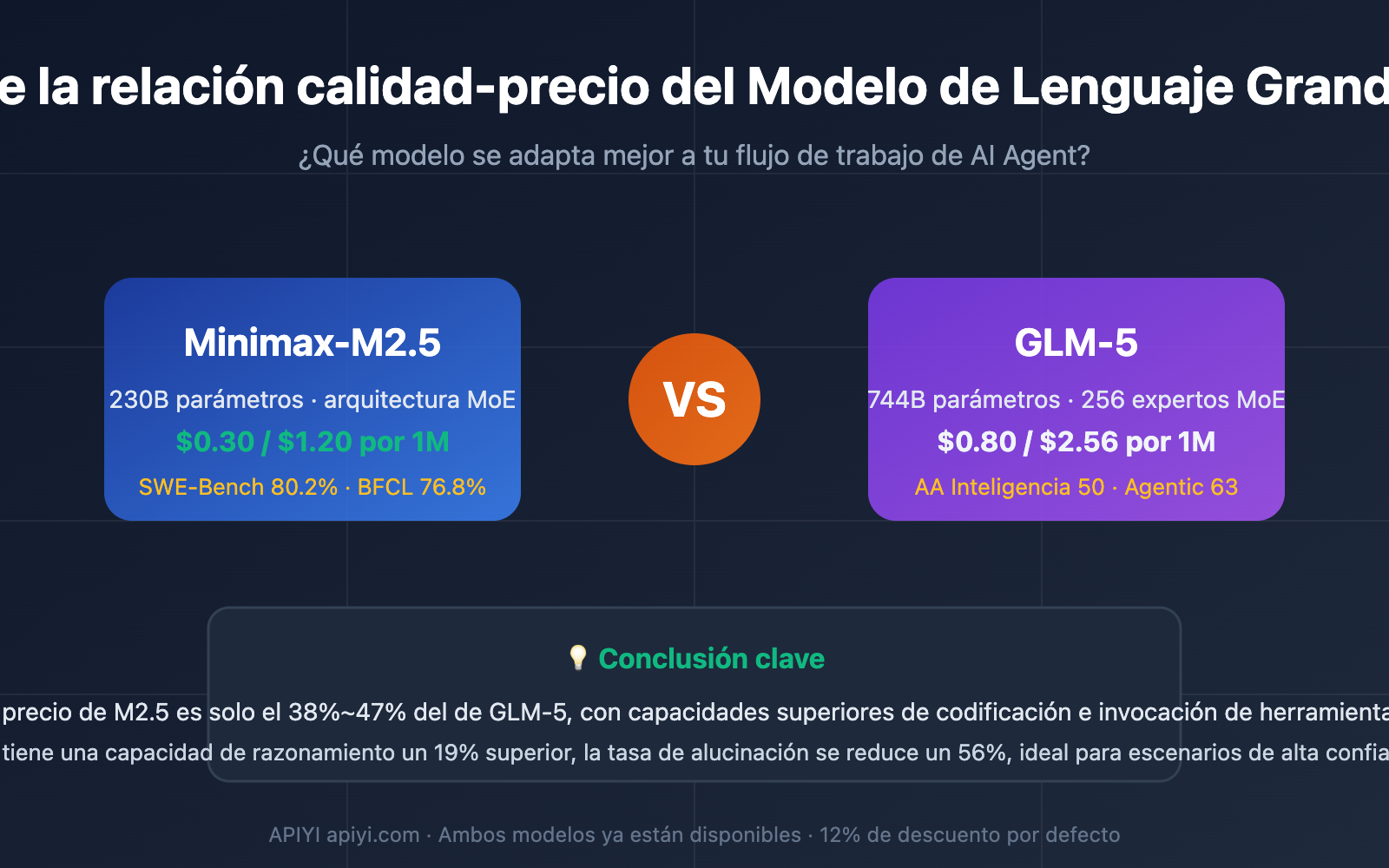

| Métrica de rendimiento | Minimax-M2.5 | GLM-5 | Ganador |

|---|---|---|---|

| Precio de entrada (por millón de tokens) | $0.30 | $0.80 | ✅ M2.5 es un 62% más barato |

| Precio de salida (por millón de tokens) | $1.20 | $2.56 | ✅ M2.5 es un 53% más barato |

| Velocidad de salida | 54 tokens/s | 68.6 tokens/s | ✅ GLM-5 es un 27% más rápido |

| Latencia del primer token | 2.57s | 1.36s | ✅ GLM-5 es un 47% más rápido |

| SWE-Bench (Codificación) | 80.2% | 77.8% | ✅ M2.5 es un 2.4% superior |

| Índice de inteligencia AA | 42 | 50 | ✅ GLM-5 es un 19% superior |

| Invocación de herramientas BFCL | 76.8% | – | M2.5 tiene datos que respaldan su eficacia |

| Mejora en la tasa de alucinaciones | – | Reducción del 56% vs. anterior | GLM-5 ofrece mayor confiabilidad |

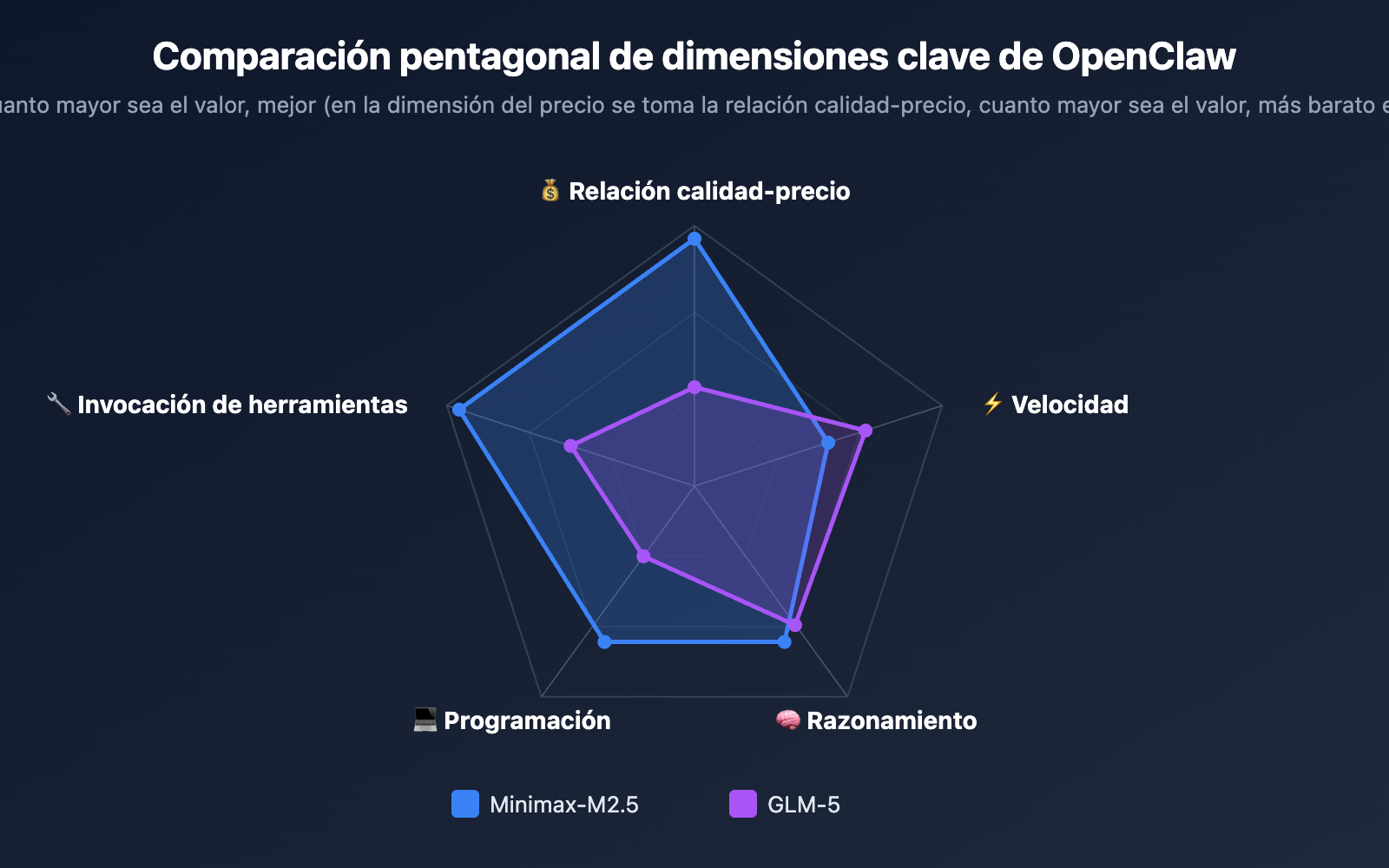

🎯 Hallazgo clave: El precio por token de Minimax-M2.5 es solo el 38%-47% del de GLM-5, pero su rendimiento en codificación e invocación de herramientas —las capacidades más críticas de OpenClaw— es comparable o incluso superior. Esto significa que para la mayoría de los usuarios de OpenClaw, el M2.5 ofrece una relación calidad-precio significativamente mayor.

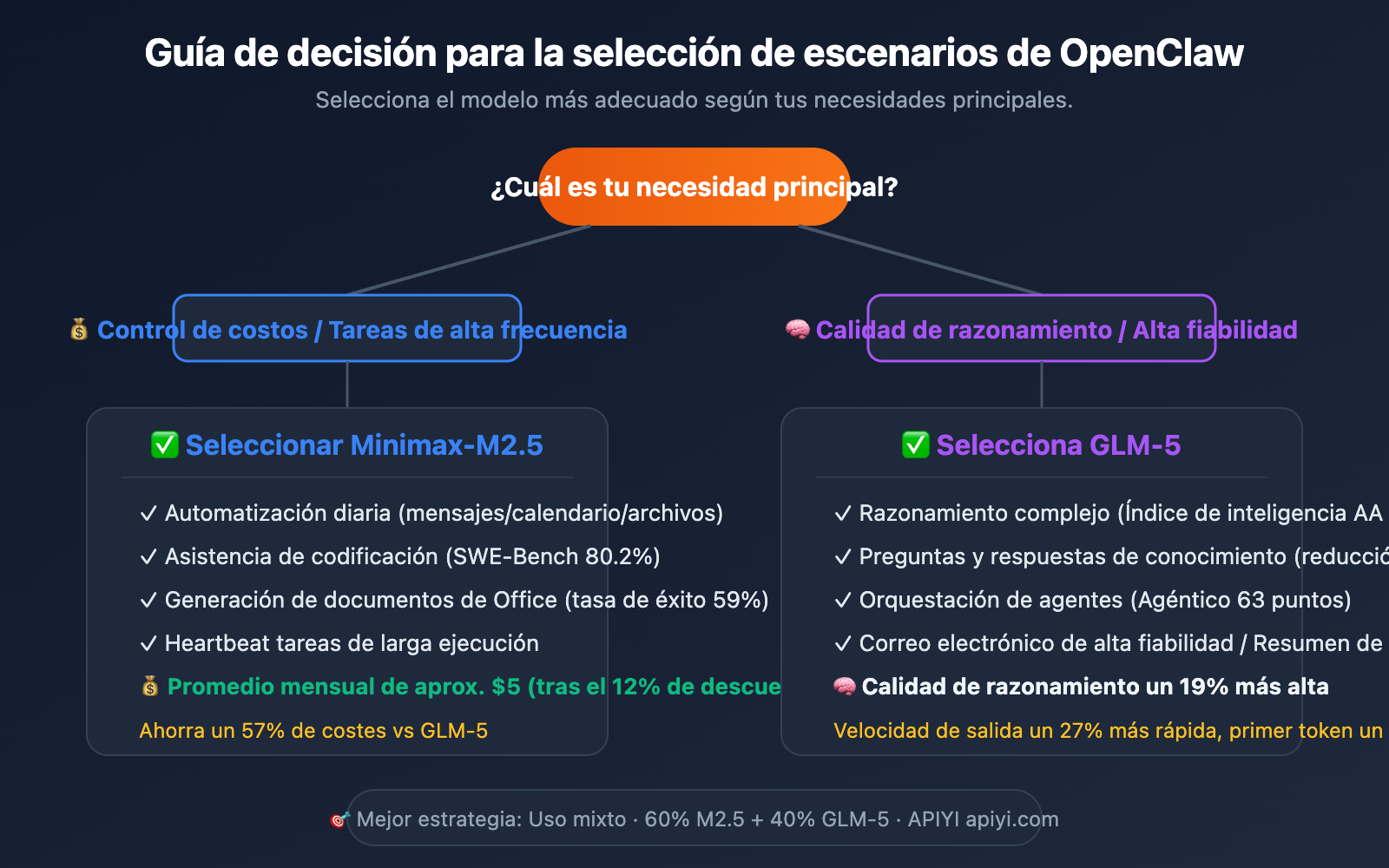

Sugerencias de selección de modelo para diferentes escenarios en OpenClaw

Diferentes escenarios de uso priorizan distintas capacidades del modelo; aquí tienes recomendaciones para casos típicos en OpenClaw:

Escenarios para elegir Minimax-M2.5

- Tareas de automatización diaria: Tareas de alta frecuencia y baja complejidad como envío programado de mensajes, gestión de calendarios u organización de archivos; la ventaja de precio del M2.5 destaca en invocaciones masivas.

- Asistencia en codificación: Su puntuación del 80.2% en SWE-Bench demuestra que el M2.5 es excelente en generación y depuración de código.

- Generación de documentos de Office: El M2.5 tiene una tasa de éxito promedio del 59% en tareas de Word/PPT/Excel, ideal para flujos de automatización de documentos.

- Ejecución a largo plazo con presupuesto limitado: El programador Heartbeat de OpenClaw despierta periódicamente al modelo para ejecutar tareas; con el M2.5, puedes ahorrar más del 50% en ejecuciones prolongadas.

Escenarios para elegir GLM-5

- Tareas de razonamiento complejo: Con 50 puntos en el índice de inteligencia AA (frente a los 42 del M2.5), el GLM-5 es más estable en razonamiento de múltiples pasos y análisis lógico.

- Preguntas y respuestas con uso intensivo de conocimiento: La tasa de alucinaciones se redujo drásticamente en un 56%; cuando la tarea requiere una salida de información altamente confiable (como borradores de correos o resúmenes de investigación), el GLM-5 es más digno de confianza.

- Orquestación de cadenas de Agentes: Su índice AA Agentic alcanza los 63 puntos (el más alto entre modelos de código abierto), ideal para flujos de trabajo de Agentes complejos y de múltiples pasos.

Guía rápida para integrar Minimax-M2.5 y GLM-5 en OpenClaw

Ejemplo minimalista

Con la plataforma APIYI, solo necesitas cambiar el parámetro model para alternar entre ambos modelos:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Usando Minimax-M2.5 (la opción con mejor relación calidad-precio)

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "Ayúdame a escribir un script en Python para monitorear cambios de archivos en un directorio específico"}]

)

print(response.choices[0].message.content)

Ver ejemplo de invocación de GLM-5 y código de Tool Calling

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Usando GLM-5 (mayor capacidad de razonamiento)

response = client.chat.completions.create(

model="glm-5",

messages=[{"role": "user", "content": "Analiza la tendencia de estos datos de ventas y ofrece sugerencias de optimización"}]

)

print(response.choices[0].message.content)

# Ejemplo de Tool Calling (capacidad central de OpenClaw)

tools = [{

"type": "function",

"function": {

"name": "run_shell_command",

"description": "Ejecutar comando Shell",

"parameters": {

"type": "object",

"properties": {

"command": {"type": "string", "description": "Comando a ejecutar"}

},

"required": ["command"]

}

}

}]

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "Ver todos los archivos Python en el directorio actual"}],

tools=tools

)

print(response.choices[0].message)

Sugerencia: Obtén crédito de prueba gratuito a través de APIYI (apiyi.com); ambos modelos se pueden probar directamente. La plataforma ofrece por defecto un 12% de descuento sobre el precio oficial (pagas el 88%), lo que reduce significativamente los costos al usar OpenClaw a largo plazo.

Estimación real de costos para modelos en OpenClaw

Tomando como ejemplo a un usuario típico de OpenClaw que realiza 50 tareas de agente al día, con un consumo promedio de 5000 tokens de entrada y 2000 tokens de salida por tarea:

| Concepto de costo | Minimax-M2.5 | GLM-5 | Proporción de ahorro |

|---|---|---|---|

| Costo diario de entrada | $0.075 | $0.20 | 62% |

| Costo diario de salida | $0.12 | $0.256 | 53% |

| Costo total diario | $0.195 | $0.456 | 57% |

| Costo total mensual | $5.85 | $13.68 | 57% |

| Mes con descuento APIYI | $5.15 | $12.04 | 57% |

🎯 Conclusión de costos: Usando Minimax-M2.5 con el descuento del 12% de APIYI, el costo mensual es de solo unos $5, menos de la mitad que GLM-5. Para usuarios con presupuesto limitado que necesitan ejecutar OpenClaw de forma continua, M2.5 es la opción más pragmática.

Por supuesto, si tus tareas requieren un razonamiento complejo y una alta fiabilidad en las respuestas, invertir $7 adicionales al mes en GLM-5 para obtener mayor capacidad de razonamiento y una menor tasa de alucinaciones es una inversión razonable.

Preguntas frecuentes

Q1: ¿Puede OpenClaw configurar dos modelos al mismo tiempo?

Sí. OpenClaw permite configurar múltiples proveedores de modelos. Puedes establecer Minimax-M2.5 como modelo predeterminado para tareas diarias y configurar GLM-5 como modelo alternativo para tareas de razonamiento complejo. La estrategia de optimización de costos recomendada por la comunidad es usar modelos económicos para el 60%-70% de las tareas y modelos de alto rendimiento para el 30%-40% de las tareas complejas. A través de la plataforma APIYI, puedes alternar entre ambos modelos usando la misma clave API.

Q2: ¿Cuál es el precio de estos dos modelos en la plataforma APIYI?

La plataforma APIYI ofrece por defecto un descuento del 88% sobre el precio oficial. Según este cálculo, la entrada de Minimax-M2.5 cuesta aproximadamente $0.264 por millón de tokens y la salida $1.056 por millón de tokens; para GLM-5, la entrada cuesta unos $0.704 por millón de tokens y la salida $2.253 por millón de tokens. Visita APIYI apiyi.com para consultar los precios actualizados.

Q3: Además de estos dos modelos, ¿qué otras opciones de alta relación calidad-precio tiene OpenClaw?

Según los comentarios de uso de la comunidad de OpenClaw, otras opciones con excelente relación calidad-precio incluyen:

- Gemini 2.5 Flash: $0.15/$0.60, la opción en la nube más económica.

- Kimi K2.5: $0.50/$2.40, soporte para cadenas de llamadas a herramientas de más de 200 pasos.

- DeepSeek V3.2: $0.28 por millón de tokens de entrada, con una capacidad de codificación sobresaliente.

Estos modelos están disponibles en la plataforma APIYI apiyi.com. Se recomienda realizar pruebas comparativas según la tarea real.

Resumen

Sugerencias clave para elegir modelos en OpenClaw:

- Elige Minimax-M2.5 si buscas relación calidad-precio: Su precio es solo el 38%-47% del de GLM-5, con excelentes capacidades de codificación y llamadas a herramientas, ideal para la mayoría de los escenarios diarios de OpenClaw.

- Elige GLM-5 si buscas calidad de razonamiento: Su índice de inteligencia AA es un 19% superior y la tasa de alucinaciones se reduce en un 56%, lo que lo hace apto para razonamientos complejos y tareas con alta densidad de conocimiento.

- La mejor estrategia es el uso híbrido: Utiliza M2.5 para tareas cotidianas para controlar costos y cambia a GLM-5 en tareas complejas para garantizar la calidad.

Ambos modelos ya están disponibles en la plataforma APIYI, disfrutando por defecto de un 88% de descuento sobre el precio oficial. Te recomendamos obtener una cuota de prueba gratuita en APIYI apiyi.com para comparar el rendimiento real de ambos modelos en tus tareas de OpenClaw.

📚 Referencias

-

Documentación oficial de OpenClaw: Guía de configuración de proveedores de modelos

- Enlace:

docs.openclaw.ai/concepts/model-providers - Descripción: Aprende a configurar modelos personalizados en OpenClaw.

- Enlace:

-

Presentación oficial de Minimax-M2.5: Especificaciones técnicas y datos de rendimiento

- Enlace:

minimax.io/news/minimax-m25 - Descripción: Consulta los resultados completos de los benchmarks y detalles de la arquitectura de M2.5.

- Enlace:

-

Documentación técnica de GLM-5: Capacidades del modelo y descripción de la interfaz API

- Enlace:

docs.z.ai/guides/llm/glm-5 - Descripción: Conoce las capacidades de razonamiento y las características multimodales de GLM-5.

- Enlace:

-

Comparativa de modelos de Artificial Analysis: Datos de evaluación independientes de terceros

- Enlace:

artificialanalysis.ai/models/comparisons/minimax-m2-5-vs-glm-5 - Descripción: Datos objetivos de comparación de rendimiento, velocidad y precio.

- Enlace:

Autor: Equipo Técnico

Intercambio técnico: Te invitamos a compartir tu experiencia eligiendo modelos para OpenClaw en la sección de comentarios. Para más noticias sobre modelos de IA, visita APIYI apiyi.com