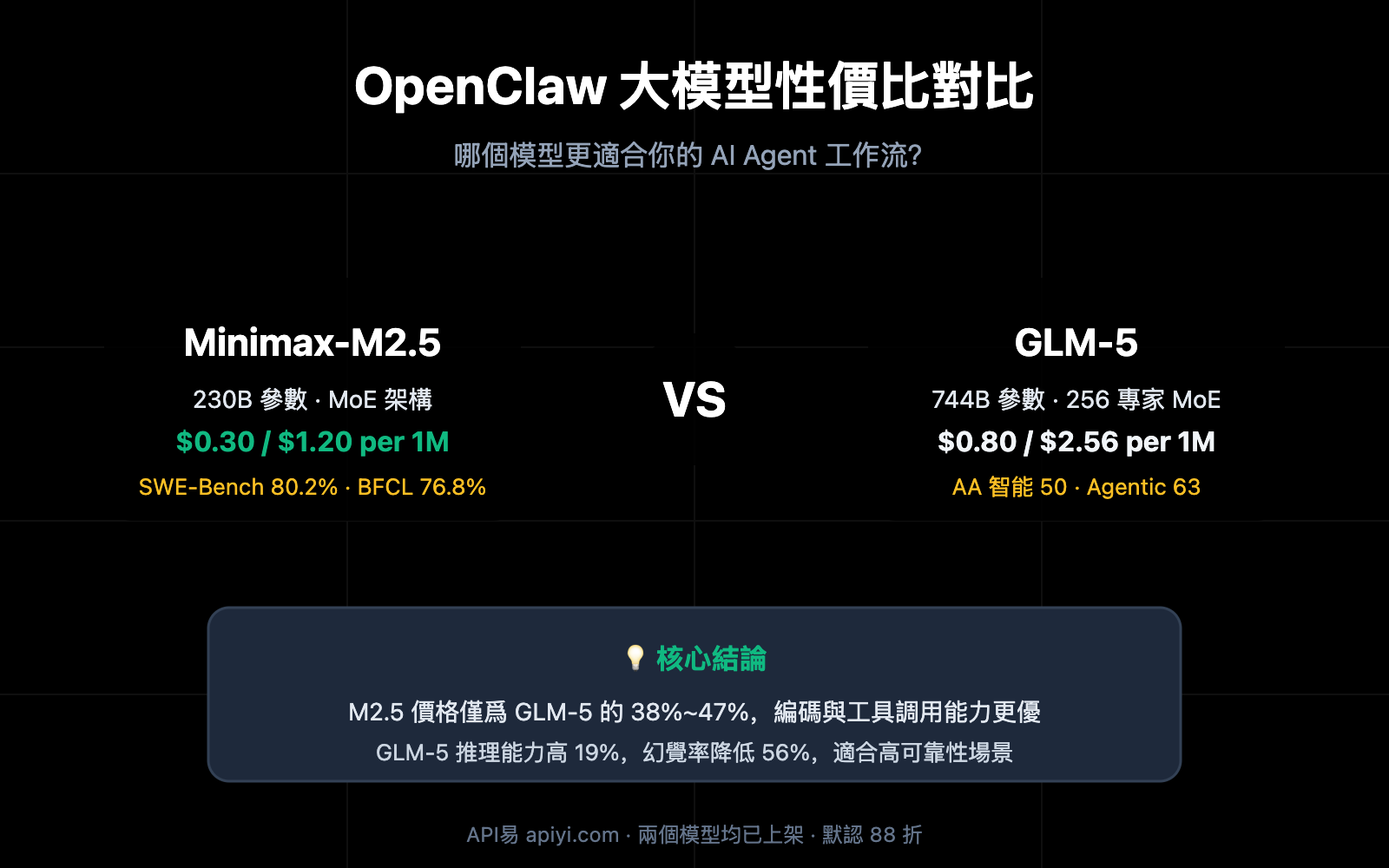

作者注:從價格、性能、工具調用能力等維度對比 Minimax-M2.5 和 GLM-5,幫你選出 OpenClaw 場景下性價比最高的大模型方案

OpenClaw 作爲 2026 年初最火爆的開源 AI Agent 框架,上線不到兩週就突破了 17.5 萬 GitHub Star。它能通過 WhatsApp、Telegram、Slack 等渠道自主執行任務,但模型選擇直接決定了使用成本和任務完成質量。

核心價值: 看完本文,你將明確 Minimax-M2.5 和 GLM-5 分別適合哪些 OpenClaw 使用場景,以及如何用最低成本獲得最佳效果。

OpenClaw 選模型的核心指標

OpenClaw 是一個自主執行任務的 AI Agent,和普通聊天場景不同,它對模型的要求更加具體。選錯模型輕則任務失敗、重則 Token 費用飆升。

| 核心指標 | 重要性 | 說明 |

|---|---|---|

| 工具調用能力 | ⭐⭐⭐⭐⭐ | OpenClaw 依賴 Function Calling 執行 Shell 命令、瀏覽器操作等 100+ 技能 |

| 輸出速度 | ⭐⭐⭐⭐ | Agent 任務鏈路長,速度慢意味着等待時間成倍增加 |

| 上下文窗口 | ⭐⭐⭐⭐ | 複雜任務需要保持完整的對話和工具調用歷史 |

| Token 單價 | ⭐⭐⭐⭐⭐ | Agent 場景 Token 消耗巨大,單價差 2 倍意味着月賬單差 2 倍 |

| 推理能力 | ⭐⭐⭐ | 複雜任務需要多步推理,但大部分日常任務對推理要求不高 |

OpenClaw 對模型的最低要求

根據 OpenClaw 社區的實踐經驗,主模型至少需要 14B 以上參數(8B 及以下容易出現工具調用幻覺),上下文窗口建議 32K 以上。Minimax-M2.5 和 GLM-5 都遠超這個門檻,問題在於:同樣能跑,誰更划算?

Minimax-M2.5 與 GLM-5 OpenClaw 性價比全面對比

模型基礎規格對比

| 參數維度 | Minimax-M2.5 | GLM-5 | 對比結論 |

|---|---|---|---|

| 總參數量 | 2300 億 | 7440 億 | GLM-5 是 M2.5 的 3.2 倍 |

| 激活參數 | 100 億 | 400 億 | GLM-5 激活參數多 4 倍 |

| 架構 | MoE(混合專家) | MoE(256 專家,Top-8 激活) | 都採用 MoE 架構 |

| 上下文窗口 | 205K tokens | 200K tokens | 基本持平 |

| 最大輸出 | 128K tokens | – | M2.5 長文本輸出更強 |

| 開源協議 | MIT | MIT | 都可商用 |

OpenClaw 關鍵性能對比

這張表是選擇的核心依據——直接影響你用 OpenClaw 的體驗和成本:

| 性能指標 | Minimax-M2.5 | GLM-5 | 勝出方 |

|---|---|---|---|

| 輸入價格(每百萬 Token) | $0.30 | $0.80 | ✅ M2.5 便宜 62% |

| 輸出價格(每百萬 Token) | $1.20 | $2.56 | ✅ M2.5 便宜 53% |

| 輸出速度 | 54 tokens/s | 68.6 tokens/s | ✅ GLM-5 快 27% |

| 首 Token 延遲 | 2.57s | 1.36s | ✅ GLM-5 快 47% |

| SWE-Bench(編碼) | 80.2% | 77.8% | ✅ M2.5 高 2.4% |

| AA 智能指數 | 42 | 50 | ✅ GLM-5 高 19% |

| BFCL 工具調用 | 76.8% | – | M2.5 工具調用有數據支撐 |

| 幻覺率改善 | – | 較前代降低 56% | GLM-5 知識可靠性更高 |

🎯 關鍵發現: Minimax-M2.5 的 Token 價格僅爲 GLM-5 的 38%-47%,但在編碼和工具調用這兩個 OpenClaw 最核心的能力上表現相當甚至更優。這意味着對於大多數 OpenClaw 用戶,M2.5 的性價比顯著更高。

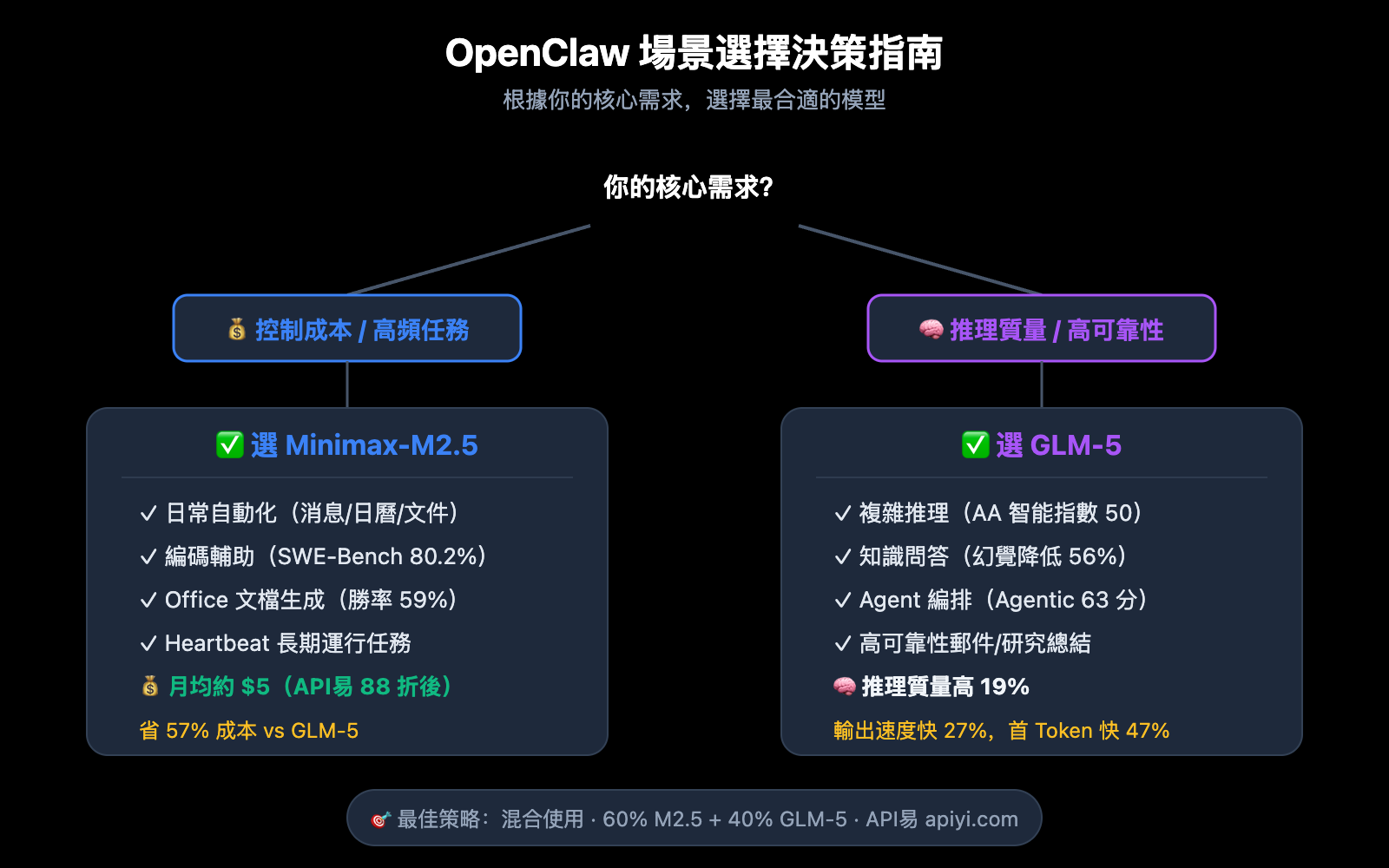

OpenClaw 不同場景的模型選擇建議

不同使用場景對模型能力的側重點不同,以下是針對 OpenClaw 典型場景的推薦:

選 Minimax-M2.5 的場景

- 日常自動化任務: 定時發送消息、管理日曆、文件整理等高頻低複雜度任務,M2.5 的低價格優勢在海量調用中效果顯著

- 編碼輔助: SWE-Bench 80.2% 的成績說明 M2.5 在代碼生成、調試方面能力出色

- Office 文檔生成: M2.5 在 Word/PPT/Excel 任務中平均勝率 59%,適合文檔自動化流程

- 預算敏感的長期運行: OpenClaw 的 Heartbeat 調度器會定期喚醒模型執行任務,長期運行下 M2.5 可節省超過 50% 的費用

選 GLM-5 的場景

- 複雜推理任務: AA 智能指數 50 分(M2.5 爲 42 分),在多步推理和邏輯分析上 GLM-5 更穩定

- 知識密集型問答: 幻覺率大幅降低 56%,當任務需要高可靠性的信息輸出時(如郵件草擬、研究總結),GLM-5 更可信

- Agent 鏈路編排: AA Agentic 指數達 63 分(開源模型最高),適合複雜的多步驟 Agent 工作流

OpenClaw 接入 Minimax-M2.5 和 GLM-5 快速上手

極簡示例

通過 API易平臺,只需修改 model 參數即可在兩個模型間切換:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 使用 Minimax-M2.5(性價比之選)

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "幫我寫一個 Python 腳本,監控指定目錄的文件變化"}]

)

print(response.choices[0].message.content)

查看 GLM-5 調用示例和工具調用代碼

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# 使用 GLM-5(推理能力更強)

response = client.chat.completions.create(

model="glm-5",

messages=[{"role": "user", "content": "分析這份銷售數據的趨勢並給出優化建議"}]

)

print(response.choices[0].message.content)

# 工具調用示例(OpenClaw 核心能力)

tools = [{

"type": "function",

"function": {

"name": "run_shell_command",

"description": "執行 Shell 命令",

"parameters": {

"type": "object",

"properties": {

"command": {"type": "string", "description": "要執行的命令"}

},

"required": ["command"]

}

}

}]

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "查看當前目錄下所有 Python 文件"}],

tools=tools

)

print(response.choices[0].message)

建議: 通過 API易 apiyi.com 獲取免費測試額度,兩個模型都可以直接調用測試。平臺默認官網價格的 88% 折扣,長期使用 OpenClaw 可以顯著降低成本。

OpenClaw 模型成本實測估算

以一個典型的 OpenClaw 用戶每天執行 50 次 Agent 任務爲例,每次任務平均消耗 5000 輸入 Token 和 2000 輸出 Token:

| 成本項目 | Minimax-M2.5 | GLM-5 | 節省比例 |

|---|---|---|---|

| 日均輸入成本 | $0.075 | $0.20 | 62% |

| 日均輸出成本 | $0.12 | $0.256 | 53% |

| 日均總成本 | $0.195 | $0.456 | 57% |

| 月均總成本 | $5.85 | $13.68 | 57% |

| API易折扣後月均 | $5.15 | $12.04 | 57% |

🎯 成本結論: 使用 Minimax-M2.5 搭配 API易 88 折優惠,月均成本僅約 $5,不到 GLM-5 的一半。對於預算有限但需要長期運行 OpenClaw 的用戶,M2.5 是更務實的選擇。

當然,如果你的任務偏重複雜推理和高可靠性輸出,GLM-5 每月多花 $7 換來更強的推理能力和更低的幻覺率,也是合理的投資。

常見問題

Q1: OpenClaw 可以同時配置兩個模型嗎?

可以。OpenClaw 支持配置多個模型 Provider,你可以將 Minimax-M2.5 設爲默認模型處理日常任務,將 GLM-5 配置爲複雜推理任務的備選模型。社區推薦的成本優化策略是 60%-70% 的任務用便宜模型,30%-40% 的複雜任務用高性能模型。通過 API易平臺,兩個模型使用同一個 API Key 即可切換。

Q2: 這兩個模型在 API易平臺的價格是多少?

API易平臺默認官網價格的 88% 折扣。按此計算,Minimax-M2.5 輸入約 $0.264/百萬 Token,輸出約 $1.056/百萬 Token;GLM-5 輸入約 $0.704/百萬 Token,輸出約 $2.253/百萬 Token。訪問 API易 apiyi.com 查看最新價格。

Q3: 除了這兩個模型,OpenClaw 還有哪些高性價比選擇?

根據 OpenClaw 社區的使用反饋,其他高性價比選擇包括:

- Gemini 2.5 Flash: $0.15/$0.60,最便宜的雲端選項

- Kimi K2.5: $0.50/$2.40,工具調用鏈路支持 200+ 步

- DeepSeek V3.2: $0.28/百萬 Token 輸入,編碼能力出色

這些模型在 API易 apiyi.com 平臺均可使用,建議根據實際任務對比測試。

總結

OpenClaw 選模型的核心建議:

- 追求性價比選 Minimax-M2.5: 價格僅爲 GLM-5 的 38%-47%,編碼能力和工具調用能力出色,適合大多數 OpenClaw 日常場景

- 追求推理質量選 GLM-5: AA 智能指數高 19%,幻覺率降低 56%,適合複雜推理和知識密集型任務

- 最佳策略是混合使用: 日常任務用 M2.5 控制成本,複雜任務切換 GLM-5 保證質量

兩個模型在 API易平臺均已上架,默認享受官網價格 88% 折扣。推薦通過 API易 apiyi.com 獲取免費測試額度,實際對比兩個模型在你的 OpenClaw 任務中的表現。

📚 參考資料

-

OpenClaw 官方文檔: 模型提供商配置指南

- 鏈接:

docs.openclaw.ai/concepts/model-providers - 說明: 瞭解如何在 OpenClaw 中配置自定義模型

- 鏈接:

-

Minimax-M2.5 官方介紹: 模型技術規格和性能數據

- 鏈接:

minimax.io/news/minimax-m25 - 說明: 查看 M2.5 的完整 Benchmark 成績和架構細節

- 鏈接:

-

GLM-5 技術文檔: 模型能力和 API 接口說明

- 鏈接:

docs.z.ai/guides/llm/glm-5 - 說明: 瞭解 GLM-5 的推理能力和多模態特性

- 鏈接:

-

Artificial Analysis 模型對比: 第三方獨立評測數據

- 鏈接:

artificialanalysis.ai/models/comparisons/minimax-m2-5-vs-glm-5 - 說明: 客觀的性能、速度、價格對比數據

- 鏈接:

作者: 技術團隊

技術交流: 歡迎在評論區討論你的 OpenClaw 模型選擇經驗,更多 AI 模型資訊可訪問 API易 apiyi.com