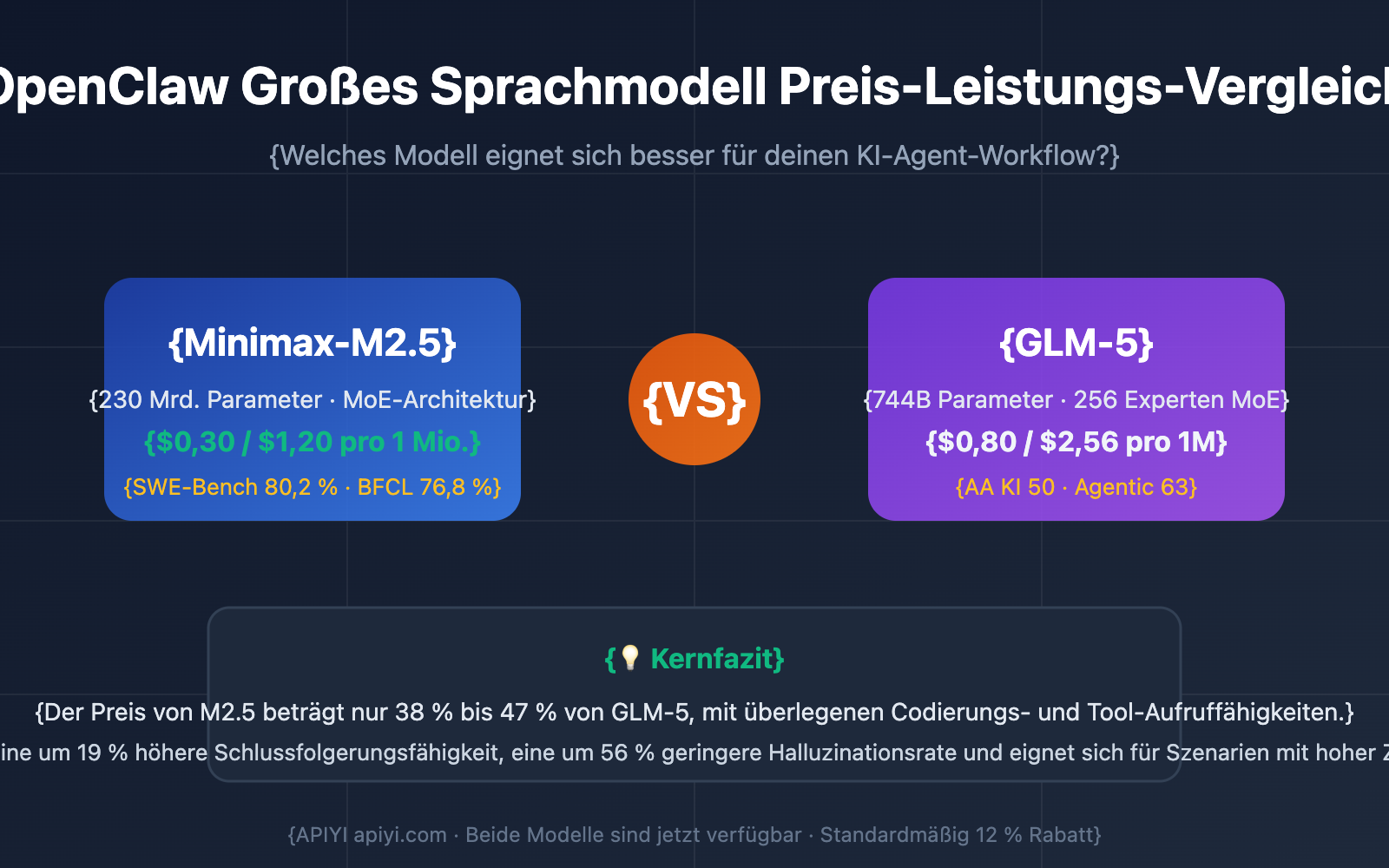

Anmerkung des Autors: Vergleich von Minimax-M2.5 und GLM-5 in den Dimensionen Preis, Leistung und Tool-Aufruf-Fähigkeiten, um Ihnen bei der Auswahl der kosteneffizientesten Lösung für OpenClaw-Szenarien zu helfen.

OpenClaw ist das am schnellsten wachsende Open-Source-AI-Agent-Framework Anfang 2026 und hat weniger als zwei Wochen nach dem Start bereits die Marke von 175.000 GitHub-Stars überschritten. Es kann Aufgaben autonom über Kanäle wie WhatsApp, Telegram und Slack ausführen. Die Wahl des Modells entscheidet jedoch direkt über die Nutzungskosten und die Qualität der Aufgabenerfüllung.

Kernwert: Nach der Lektüre dieses Artikels wissen Sie genau, ob Minimax-M2.5 oder GLM-5 besser für Ihre OpenClaw-Szenarien geeignet ist und wie Sie die besten Ergebnisse bei niedrigsten Kosten erzielen.

Kernmetriken für die Modellauswahl in OpenClaw

OpenClaw ist ein AI Agent, der Aufgaben autonom ausführt. Im Gegensatz zu gewöhnlichen Chat-Szenarien stellt er spezifischere Anforderungen an das Modell. Die Wahl des falschen Modells kann im besten Fall zum Scheitern der Aufgabe führen, im schlimmsten Fall zu explodierenden Token-Kosten.

| Kernmetrik | Wichtigkeit | Erläuterung |

|---|---|---|

| Tool-Aufruf-Fähigkeiten | ⭐⭐⭐⭐⭐ | OpenClaw verlässt sich auf Function Calling, um Shell-Befehle, Browser-Operationen und über 100 weitere Skills auszuführen. |

| Ausgabegeschwindigkeit | ⭐⭐⭐⭐ | Agent-Aufgabenketten sind lang; eine geringe Geschwindigkeit bedeutet eine exponentiell längere Wartezeit. |

| Kontextfenster | ⭐⭐⭐⭐ | Komplexe Aufgaben erfordern die Beibehaltung des vollständigen Dialog- und Tool-Aufruf-Verlaufs. |

| Token-Einzelpreis | ⭐⭐⭐⭐⭐ | In Agent-Szenarien ist der Token-Verbrauch enorm; ein Preisunterschied um den Faktor 2 bedeutet eine doppelt so hohe Monatsrechnung. |

| Reasoning-Fähigkeit | ⭐⭐⭐ | Komplexe Aufgaben erfordern mehrstufiges Denken, aber die meisten Alltagsaufgaben stellen keine extrem hohen Anforderungen an das Reasoning. |

Mindestanforderungen von OpenClaw an Modelle

Basierend auf Praxiserfahrungen der OpenClaw-Community sollte das Hauptmodell mindestens über 14B Parameter verfügen (bei 8B oder weniger treten häufig Halluzinationen bei Tool-Aufrufen auf), und das Kontextfenster sollte mindestens 32K betragen. Sowohl Minimax-M2.5 als auch GLM-5 übertreffen diese Hürde bei weitem. Die Frage ist: Wenn beide funktionieren, welches ist wirtschaftlicher?

Umfassender Preis-Leistungs-Vergleich: Minimax-M2.5 vs. GLM-5 OpenClaw

Vergleich der Basis-Spezifikationen

| Parameter-Dimension | Minimax-M2.5 | GLM-5 | Vergleichsfazit |

|---|---|---|---|

| Gesamtparameter | 230 Milliarden | 744 Milliarden | GLM-5 ist 3,2-mal so groß wie M2.5 |

| Aktivierte Parameter | 10 Milliarden | 40 Milliarden | GLM-5 hat 4-mal mehr aktivierte Parameter |

| Architektur | MoE (Mixture of Experts) | MoE (256 Experten, Top-8 aktiviert) | Beide nutzen MoE-Architektur |

| Kontextfenster | 205K Tokens | 200K Tokens | Nahezu identisch |

| Maximaler Output | 128K Tokens | – | M2.5 ist stärker bei langen Textausgaben |

| Open-Source-Lizenz | MIT | MIT | Beide kommerziell nutzbar |

OpenClaw Key-Performance-Vergleich

Diese Tabelle ist die entscheidende Grundlage für Ihre Wahl – sie beeinflusst direkt Ihr Nutzererlebnis und die Kosten bei OpenClaw:

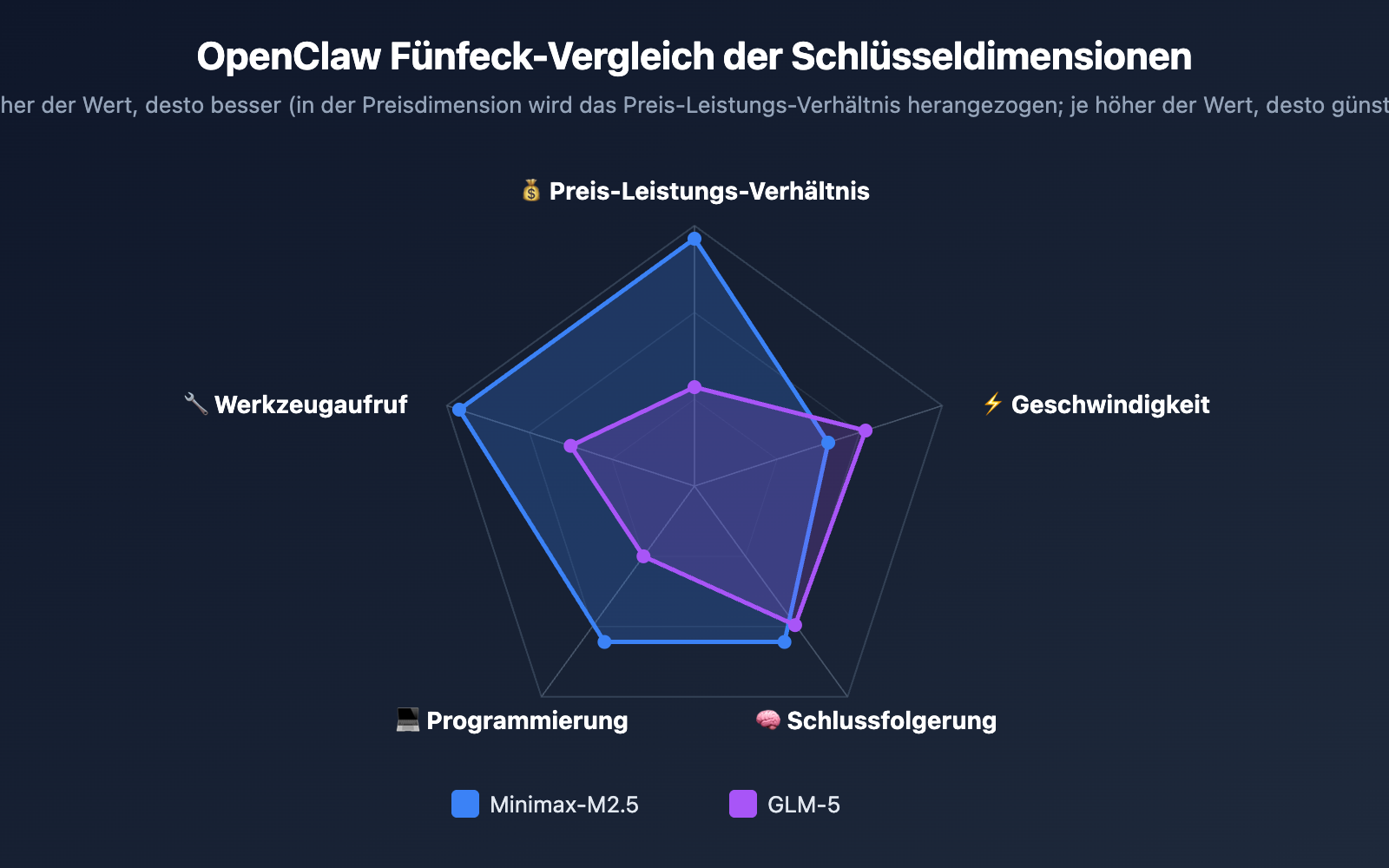

| Leistungskennzahlen | Minimax-M2.5 | GLM-5 | Gewinner |

|---|---|---|---|

| Preis Input (pro Mio. Token) | $0.30 | $0.80 | ✅ M2.5 ist 62 % günstiger |

| Preis Output (pro Mio. Token) | $1.20 | $2.56 | ✅ M2.5 ist 53 % günstiger |

| Output-Geschwindigkeit | 54 Tokens/s | 68,6 Tokens/s | ✅ GLM-5 ist 27 % schneller |

| Latenz bis zum ersten Token | 2,57s | 1,36s | ✅ GLM-5 ist 47 % schneller |

| SWE-Bench (Coding) | 80,2 % | 77,8 % | ✅ M2.5 liegt 2,4 % höher |

| AA Intelligenz-Index | 42 | 50 | ✅ GLM-5 liegt 19 % höher |

| BFCL Tool-Aufrufe | 76,8 % | – | M2.5 hat datengestützte Tool-Aufrufe |

| Verbesserung der Halluzinationsrate | – | 56 % niedriger als Vorgänger | GLM-5 bietet höhere Wissenszuverlässigkeit |

🎯 Wichtigste Erkenntnis: Der Token-Preis von Minimax-M2.5 beträgt nur 38 % bis 47 % des Preises von GLM-5, während die Leistung in den Bereichen Coding und Tool-Aufrufe – den Kernkompetenzen von OpenClaw – vergleichbar oder sogar besser ist. Das bedeutet, dass M2.5 für die meisten OpenClaw-Nutzer ein deutlich besseres Preis-Leistungs-Verhältnis bietet.

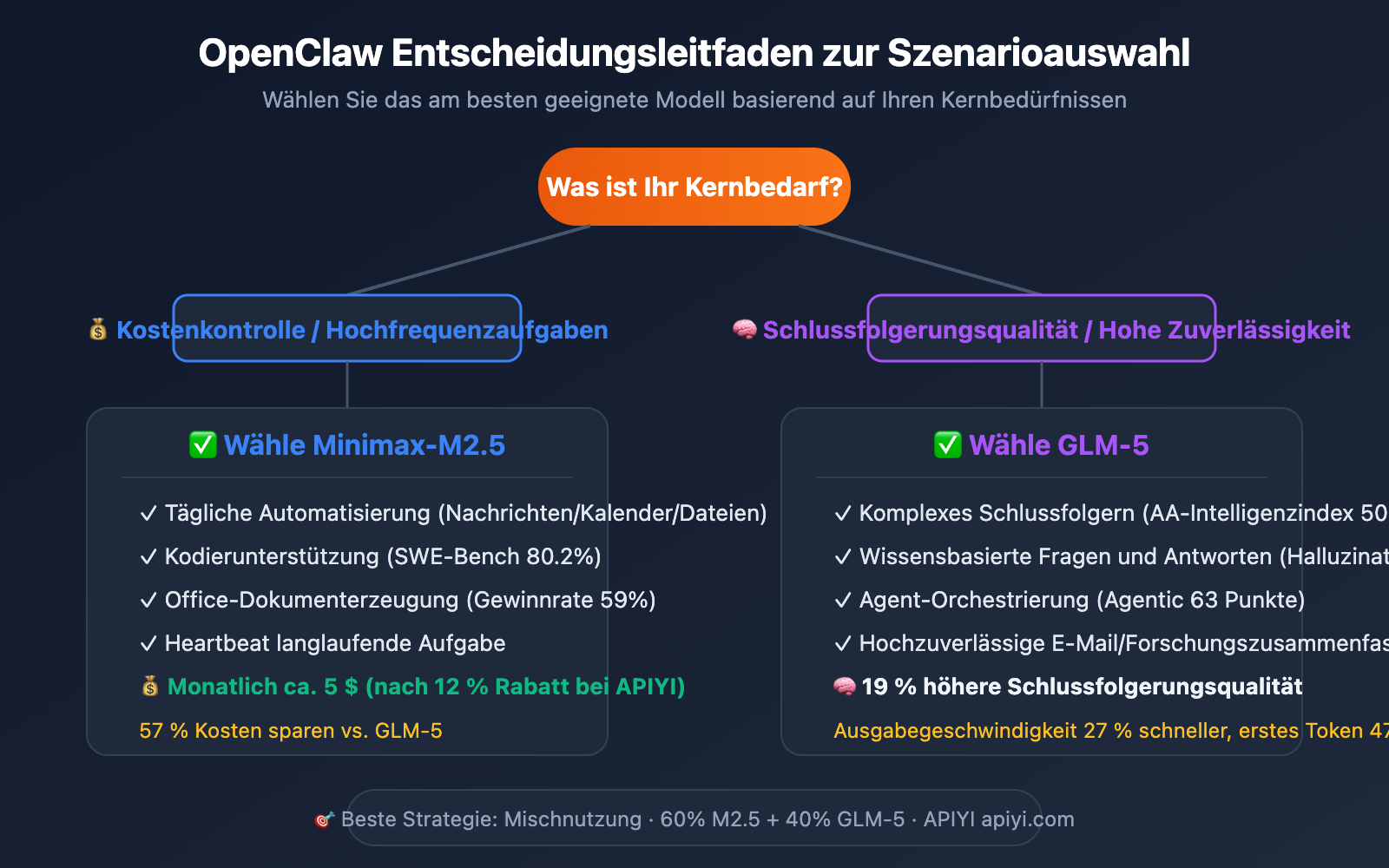

Empfehlungen zur Modellauswahl für verschiedene OpenClaw-Szenarien

Unterschiedliche Einsatzszenarien erfordern unterschiedliche Schwerpunkte. Hier sind die Empfehlungen für typische OpenClaw-Anwendungsfälle:

Szenarien für Minimax-M2.5

- Tägliche Automatisierungsaufgaben: Geplanter Nachrichtenversand, Kalenderverwaltung, Dateiorganisation und andere hochfrequente Aufgaben mit geringer Komplexität. Der Preisvorteil von M2.5 macht sich bei massiven Aufrufen deutlich bemerkbar.

- Coding-Unterstützung: Das SWE-Bench-Ergebnis von 80,2 % zeigt, dass M2.5 hervorragende Fähigkeiten bei der Codegenerierung und beim Debugging besitzt.

- Erstellung von Office-Dokumenten: M2.5 hat eine durchschnittliche Gewinnrate von 59 % bei Word/PPT/Excel-Aufgaben und eignet sich ideal für die Dokumentenautomatisierung.

- Budgetsensibler Langzeitbetrieb: Der Heartbeat-Scheduler von OpenClaw weckt das Modell regelmäßig auf, um Aufgaben auszuführen. Im Langzeitbetrieb kann M2.5 über 50 % der Kosten einsparen.

Szenarien für GLM-5

- Komplexe logische Inferenz: Mit einem AA Intelligenz-Index von 50 (gegenüber 42 bei M2.5) agiert GLM-5 bei mehrstufigen Schlussfolgerungen und logischen Analysen stabiler.

- Wissensintensive Q&A: Die Halluzinationsrate wurde um 56 % gesenkt. Wenn Aufgaben eine hochzuverlässige Informationsausgabe erfordern (z. B. E-Mail-Entwürfe, Forschungszusammenfassungen), ist GLM-5 vertrauenswürdiger.

- Agent-Chain-Orchestrierung: Der AA Agentic Index erreicht 63 Punkte (der höchste Wert unter den Open-Source-Modellen), was es ideal für komplexe, mehrstufige Agent-Workflows macht.

Schnelleinstieg: OpenClaw mit Minimax-M2.5 und GLM-5 verbinden

Minimalbeispiel

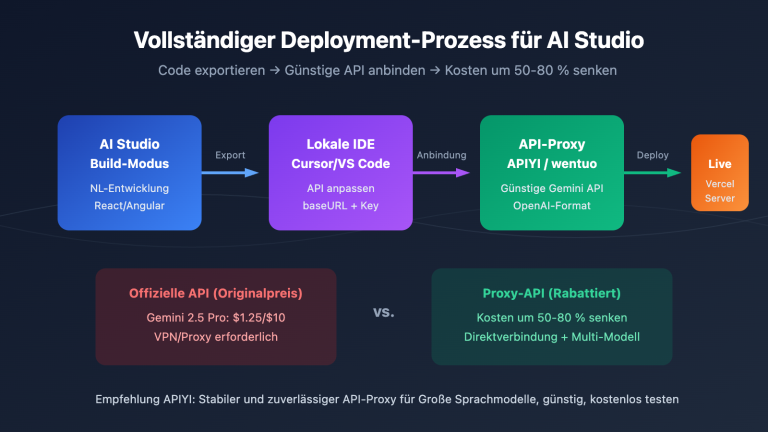

Über die APIYI-Plattform können Sie durch einfaches Ändern des model-Parameters zwischen den beiden Modellen wechseln:

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Verwendung von Minimax-M2.5 (Preis-Leistungs-Sieger)

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "Hilf mir, ein Python-Skript zu schreiben, das Dateiänderungen in einem bestimmten Verzeichnis überwacht"}]

)

print(response.choices[0].message.content)

GLM-5 Aufrufbeispiel und Tool-Calling-Code anzeigen

import openai

client = openai.OpenAI(

api_key="YOUR_API_KEY",

base_url="https://vip.apiyi.com/v1"

)

# Verwendung von GLM-5 (stärkere Reasoning-Fähigkeiten)

response = client.chat.completions.create(

model="glm-5",

messages=[{"role": "user", "content": "Analysiere die Trends in diesen Verkaufsdaten und gib Optimierungsvorschläge"}]

)

print(response.choices[0].message.content)

# Beispiel für Tool-Calling (Kernfunktion von OpenClaw)

tools = [{

"type": "function",

"function": {

"name": "run_shell_command",

"description": "Shell-Befehl ausführen",

"parameters": {

"type": "object",

"properties": {

"command": {"type": "string", "description": "Der auszuführende Befehl"}

},

"required": ["command"]

}

}

}]

response = client.chat.completions.create(

model="minimax-m2.5",

messages=[{"role": "user", "content": "Zeige alle Python-Dateien im aktuellen Verzeichnis an"}],

tools=tools

)

print(response.choices[0].message)

Tipp: Holen Sie sich über APIYI (apiyi.com) kostenloses Testguthaben; beide Modelle können direkt für Tests aufgerufen werden. Die Plattform bietet standardmäßig einen Rabatt von 12 % auf die offiziellen Preise (Abrechnung zu 88 % des Originalpreises). Die langfristige Nutzung von OpenClaw kann so die Kosten erheblich senken.

Praxistest: Kostenschätzung für OpenClaw-Modelle

Nehmen wir als Beispiel einen typischen OpenClaw-Nutzer, der täglich 50 Agent-Aufgaben ausführt, wobei jede Aufgabe durchschnittlich 5.000 Eingabe-Token und 2.000 Ausgabe-Token verbraucht:

| Kostenpunkt | Minimax-M2.5 | GLM-5 | Ersparnis |

|---|---|---|---|

| Durchschn. tägliche Eingabekosten | $0.075 | $0.20 | 62% |

| Durchschn. tägliche Ausgabekosten | $0.12 | $0.256 | 53% |

| Durchschn. tägliche Gesamtkosten | $0.195 | $0.456 | 57% |

| Durchschn. monatliche Gesamtkosten | $5.85 | $13.68 | 57% |

| Monatlicher Durchschnitt nach APIYI-Rabatt | $5.15 | $12.04 | 57% |

🎯 Fazit zu den Kosten: Die Kombination aus Minimax-M2.5 und dem 12 % Rabatt von APIYI senkt die monatlichen Kosten auf ca. $5 – das ist weniger als die Hälfte im Vergleich zu GLM-5. Für Nutzer mit begrenztem Budget, die OpenClaw langfristig betreiben möchten, ist M2.5 die pragmatischere Wahl.

Wenn Ihre Aufgaben jedoch komplexe Schlussfolgerungen und eine hohe Zuverlässigkeit erfordern, ist GLM-5 eine sinnvolle Investition: Für etwa $7 mehr pro Monat erhalten Sie stärkere Reasoning-Fähigkeiten und eine geringere Halluzinationsrate.

Häufig gestellte Fragen

Q1: Kann OpenClaw gleichzeitig mit zwei Modellen konfiguriert werden?

Ja. OpenClaw unterstützt die Konfiguration mehrerer Modell-Provider. Sie können Minimax-M2.5 als Standardmodell für tägliche Aufgaben festlegen und GLM-5 als Alternative für komplexe Schlussfolgerungen konfigurieren. Eine von der Community empfohlene Kostenoptimierungsstrategie besteht darin, 60 % bis 70 % der Aufgaben mit einem günstigen Modell und 30 % bis 40 % der komplexen Aufgaben mit einem Hochleistungsmodell zu bearbeiten. Über die APIYI-Plattform können beide Modelle mit demselben API-Schlüssel gewechselt werden.

Q2: Wie hoch sind die Preise für diese beiden Modelle auf der APIYI-Plattform?

Die APIYI-Plattform bietet standardmäßig einen Rabatt von 12 % auf die offiziellen Preise (Sie zahlen also nur 88 %). Basierend darauf kostet Minimax-M2.5 etwa 0,264 $/Million Token (Input) und 1,056 $/Million Token (Output); GLM-5 liegt bei etwa 0,704 $/Million Token (Input) und 2,253 $/Million Token (Output). Besuchen Sie APIYI unter apiyi.com für die aktuellsten Preise.

Q3: Welche weiteren kosteneffizienten Optionen gibt es für OpenClaw neben diesen beiden Modellen?

Basierend auf dem Feedback der OpenClaw-Community gibt es weitere kosteneffiziente Optionen:

- Gemini 2.5 Flash: 0,15 $/0,60 $, die günstigste Cloud-Option.

- Kimi K2.5: 0,50 $/2,40 $, unterstützt Tool-Calling-Ketten mit über 200 Schritten.

- DeepSeek V3.2: 0,28 $/Million Token (Input), hervorragende Programmierfähigkeiten.

Diese Modelle sind alle auf der APIYI-Plattform (apiyi.com) verfügbar. Wir empfehlen einen Vergleichstest basierend auf Ihren tatsächlichen Aufgaben.

Fazit

Kernempfehlungen für die Modellauswahl in OpenClaw:

- Minimax-M2.5 für das beste Preis-Leistungs-Verhältnis: Der Preis beträgt nur 38 % bis 47 % von GLM-5. Es bietet hervorragende Programmier- und Tool-Calling-Fähigkeiten und eignet sich für die meisten täglichen OpenClaw-Szenarien.

- GLM-5 für höchste Qualität bei Schlussfolgerungen: Der AA-Intelligenzindex ist um 19 % höher und die Halluzinationsrate um 56 % niedriger. Ideal für komplexe logische Aufgaben und wissensintensive Anforderungen.

- Die beste Strategie ist die hybride Nutzung: Verwenden Sie M2.5 für tägliche Aufgaben zur Kostenkontrolle und wechseln Sie bei komplexen Aufgaben zu GLM-5, um die Qualität zu sichern.

Beide Modelle sind auf der APIYI-Plattform verfügbar und profitieren standardmäßig von einem Rabatt von 12 % auf die offiziellen Preise. Wir empfehlen, über APIYI (apiyi.com) ein kostenloses Testguthaben zu beziehen, um die Leistung beider Modelle in Ihren spezifischen OpenClaw-Aufgaben direkt zu vergleichen.

📚 Referenzen

-

Offizielle OpenClaw-Dokumentation: Konfigurationsleitfaden für Modellanbieter

- Link:

docs.openclaw.ai/concepts/model-providers - Beschreibung: Erfahren Sie, wie Sie benutzerdefinierte Modelle in OpenClaw konfigurieren.

- Link:

-

Offizielle Vorstellung von Minimax-M2.5: Technische Spezifikationen und Leistungsdaten des Modells

- Link:

minimax.io/news/minimax-m25 - Beschreibung: Sehen Sie sich die vollständigen Benchmark-Ergebnisse und Architekturdetails von M2.5 an.

- Link:

-

Technische Dokumentation zu GLM-5: Modellfähigkeiten und API-Schnittstellenbeschreibung

- Link:

docs.z.ai/guides/llm/glm-5 - Beschreibung: Erfahren Sie mehr über die Inferenzfähigkeiten und multimodalen Eigenschaften von GLM-5.

- Link:

-

Modellvergleich von Artificial Analysis: Unabhängige Testdaten von Drittanbietern

- Link:

artificialanalysis.ai/models/comparisons/minimax-m2-5-vs-glm-5 - Beschreibung: Objektive Vergleichsdaten zu Leistung, Geschwindigkeit und Preis.

- Link:

Autor: Technik-Team

Technischer Austausch: Diskutieren Sie gerne Ihre Erfahrungen bei der Modellauswahl für OpenClaw in den Kommentaren. Weitere Informationen zu KI-Modellen finden Sie auf APIYI (apiyi.com).